神经符号 AI:结合逻辑与神经网络的 Harness

神经符号AI:结合逻辑推理与神经网络的下一代通用人工智能范式全解析

关键词

神经符号AI、神经网络、符号逻辑、因果推理、知识表示、混合架构、AGI

摘要

当前以大模型为代表的纯数据驱动深度学习范式已经遭遇了显著的性能瓶颈: hallucination(幻觉)问题无法根治、复杂多步推理准确率低、可解释性缺失、数据需求量大、泛化能力有限。神经符号AI(Neural-Symbolic AI)作为融合神经网络感知能力与符号逻辑推理能力的新兴范式,被学术界和工业界普遍认为是突破上述瓶颈、迈向通用人工智能(AGI)的核心路径。本文从第一性原理出发,系统拆解神经符号AI的理论基础、架构设计、实现机制、落地场景与未来演化方向,同时提供可直接运行的生产级代码实现与落地方案,覆盖从入门级认知到专家级实践的全层次需求。

1. 概念基础

1.1 领域背景化

过去十年,以Transformer为核心的深度学习技术取得了革命性进展:从图像分类、自然语言处理到蛋白质结构预测,纯数据驱动的神经网络在感知类任务上的表现已经接近甚至超过人类水平。但随着大模型向工业核心场景(医疗诊断、自动驾驶、金融风控、法律合规)渗透,其原生缺陷暴露得愈发明显:

- 幻觉问题:大模型会编造不存在的事实、法律条文、医学诊断依据,完全无法用于对准确性要求100%的场景

- 推理短板:在多步数学计算、逻辑证明、因果推断类任务上,即使是GPT-4这类顶级大模型的准确率也不足60%

- 可解释性缺失:黑箱特性导致其决策无法审计,不符合金融、医疗、政务等领域的监管要求

- 数据饥渴:训练通用大模型需要万亿级 tokens 的数据,且领域适配需要大量微调数据,成本极高

- 泛化能力有限:对训练分布外的样本表现骤降,无法像人类一样通过少量规则学习就能泛化到完全陌生的场景

而符号逻辑作为人工智能最早的技术范式,恰好具备神经网络缺失的所有优势:知识表示精准、推理过程可解释、泛化能力强、不需要大量训练数据。但符号AI的原生缺陷也非常突出:无法处理噪声数据、知识获取成本极高、无法应对开放域的模糊场景。

神经符号AI的核心价值就是实现两者的优势互补:用神经网络解决感知层面的噪声数据处理问题,用符号逻辑解决认知层面的推理与可解释性问题。

1.2 历史轨迹

神经符号AI的发展历程本质上是人工智能两大范式的螺旋式上升过程:

| 时间区间 | 发展阶段 | 核心技术 | 代表成果 | 核心局限性 |

|---|---|---|---|---|

| 1956-1980 | 符号AI黄金时代 | 一阶逻辑、专家系统、知识表示 | MYCIN医疗诊断系统、DENDRAL化学分析系统 | 无法处理噪声数据、知识获取瓶颈、仅能覆盖极窄领域 |

| 1980-2012 | 统计学习兴起 | 支持向量机、随机森林、概率图模型 | 垃圾邮件分类器、语音识别系统 | 特征工程高度依赖人工、复杂逻辑推理能力弱 |

| 2012-2022 | 深度学习爆发 | 卷积神经网络、Transformer、大模型 | AlexNet、GPT-3、ChatGPT、AlphaFold2 | 幻觉问题、可解释性缺失、推理能力不足 |

| 2022-至今 | 神经符号融合时代 | 混合架构、可微推理、神经符号接地 | AlphaGeometry、GPT-4 with Code Interpreter、IBM神经符号医疗诊断系统 | 架构未统一、落地成本高、通用符号接地方案缺失 |

| 早在1990年代,学术界就已经提出了神经符号融合的构想,但受限于当时的计算能力和神经网络技术水平,没有取得规模化进展。直到2022年大模型技术成熟之后,神经符号AI才真正具备了落地的基础:大模型作为通用接口可以轻松实现非结构化数据到符号表示的转换,大幅降低了符号系统的输入门槛。 |

1.3 问题空间定义

神经符号AI的核心问题空间可以概括为三个维度:

- 符号接地问题(Symbol Grounding Problem):如何将神经网络从高维感知数据中提取的特征映射到人类可理解的符号表示,同时将符号系统的规则约束注入到神经网络的训练和推理过程中

- 交互机制问题:如何设计神经网络模块和符号逻辑模块的交互方式,实现两者的高效协同,同时保证端到端的训练和推理效率

- 泛化边界问题:如何在开放域场景下,实现神经模块和符号模块的动态适配,应对未知的输入分布和规则变化

1.4 术语精确性

为了避免概念混淆,我们对本文涉及的核心术语给出精确定义:

- 神经范式:以神经网络为核心的可学习函数逼近器,输入为高维非结构化数据,输出为预测结果,核心能力是模式匹配和感知处理

- 符号范式:以一阶逻辑、知识图谱、规则引擎为核心的符号推理系统,输入为结构化符号表示,输出为推理结果,核心能力是逻辑推导和知识表示

- 神经符号AI:同时包含神经模块和符号模块,且两者存在显式交互的人工智能系统,目标是实现感知能力和认知能力的统一

2. 理论框架

2.1 第一性原理推导

从智能的本质出发,我们可以将人类智能分解为两个核心系统(符合卡尼曼的双系统理论):

- 系统1(快速直觉系统):负责感知、模式匹配、快速决策,对应神经网络的能力,特点是速度快、无意识、易出错

- 系统2(慢速推理系统):负责逻辑思考、多步推理、规划,对应符号逻辑的能力,特点是速度慢、有意识、准确率高

人类的所有智能行为都是两个系统协同作用的结果:比如开车时,系统1负责感知路况、操作方向盘,系统2负责规划路线、应对突发情况。纯神经网络只实现了系统1的能力,纯符号系统只实现了系统2的能力,神经符号AI就是要实现两个系统的协同。

从计算的第一性原理来看,任何智能系统都可以表示为以下三元组:

S=⟨X,K,O⟩\mathcal{S} = \langle \mathcal{X}, \mathcal{K}, \mathcal{O} \rangleS=⟨X,K,O⟩

其中: - X\mathcal{X}X 是输入空间,包含所有可能的感知输入

- K\mathcal{K}K 是知识空间,包含系统所有的先验知识和学习到的知识

- O\mathcal{O}O 是输出空间,包含所有可能的决策输出

神经网络的本质是学习一个映射函数 fθ:X→Of_\theta: \mathcal{X} \rightarrow \mathcal{O}fθ:X→O,直接从输入到输出,知识 K\mathcal{K}K 隐式编码在网络参数 θ\thetaθ 中;符号系统的本质是学习一个推理函数 gr:K×X→Og_r: \mathcal{K} \times \mathcal{X} \rightarrow \mathcal{O}gr:K×X→O,知识 K\mathcal{K}K 是显式的符号表示,推理过程可追溯。

神经符号系统的本质是将两个函数结合:

hθ,r:X→fθXs→grOs→fθ′Oh_{\theta, r}: \mathcal{X} \xrightarrow{f_\theta} \mathcal{X}_s \xrightarrow{g_r} \mathcal{O}_s \xrightarrow{f'_\theta} \mathcal{O}hθ,r:XfθXsgrOsfθ′O

其中 Xs\mathcal{X}_sXs 是输入转换后的符号表示,Os\mathcal{O}_sOs 是符号推理后的中间结果,实现了显式知识和隐式知识的融合。

2.2 数学形式化

我们分别对神经模块、符号模块和神经符号统一框架进行数学形式化:

2.2.1 符号系统的形式化

符号逻辑系统可以表示为:

L=⟨C,F,P,V,¬,∧,∨,→,∀,∃⟩\mathcal{L} = \langle \mathcal{C}, \mathcal{F}, \mathcal{P}, \mathcal{V}, \neg, \wedge, \vee, \rightarrow, \forall, \exists \rangleL=⟨C,F,P,V,¬,∧,∨,→,∀,∃⟩

其中:

- C\mathcal{C}C 是常量集合(比如具体的实体:“苹果”、“3”)

- F\mathcal{F}F 是函数集合(比如“加法”、“父亲”)

- P\mathcal{P}P 是谓词集合(比如“是红色的”、“大于”)

- V\mathcal{V}V 是变量集合

- 后面的元素是逻辑连接词和量词

符号推理的过程就是基于上述逻辑系统,从已知的公理集合 A\mathcal{A}A 推导出新的定理的过程,推理的正确性可以被严格证明。

为了实现符号推理和神经网络的端到端训练,学术界提出了可微逻辑的概念,用t-范数模糊逻辑将逻辑算子转换为可微的数值运算:

¬a=1−aa∧b=a×b(乘积t-范数)a∨b=a+b−a×ba→b=1−a+a×b \begin{align*} \neg a &= 1 - a \\ a \wedge b &= a \times b \quad \text{(乘积t-范数)} \\ a \vee b &= a + b - a \times b \\ a \rightarrow b &= 1 - a + a \times b \end{align*} ¬aa∧ba∨ba→b=1−a=a×b(乘积t-范数)=a+b−a×b=1−a+a×b

其中 a,b∈[0,1]a, b \in [0,1]a,b∈[0,1] 表示命题的置信度,所有逻辑运算都可以转换为可微的算术运算,从而可以嵌入到神经网络的计算图中,实现端到端的梯度反向传播。

2.2.2 神经符号统一框架

完整的神经符号系统可以形式化为:

FNS=⟨Eθ,K,R,Dθ⟩\mathcal{F}_{NS} = \langle E_\theta, \mathcal{K}, R, D_\theta \rangleFNS=⟨Eθ,K,R,Dθ⟩

其中:

- EθE_\thetaEθ 是神经编码器,参数为 θ\thetaθ,负责将高维输入 X\mathcal{X}X 转换为符号表示 S∈L\mathcal{S} \in \mathcal{L}S∈L

- K\mathcal{K}K 是显式符号知识库,包含事实和规则

- RRR 是符号推理引擎,负责基于 K\mathcal{K}K 对 S\mathcal{S}S 进行推理,得到推理结果 So\mathcal{S}_oSo

- DθD_\thetaDθ 是神经解码器,参数为 θ\thetaθ,负责将符号结果 So\mathcal{S}_oSo 转换为用户可理解的输出 O\mathcal{O}O

2.3 理论局限性

当前神经符号AI的理论体系仍然存在三大核心局限性:

- 符号接地的通用方案缺失:目前的符号接地方案都是领域定制的,没有通用的方法可以将任意领域的神经网络特征映射到统一的符号空间

- 组合泛化的理论边界不清晰:神经符号系统的组合泛化能力虽然远优于纯神经网络,但仍然没有严格的理论证明其泛化边界

- 计算复杂度权衡问题:高阶逻辑推理的计算复杂度是指数级的,如何在推理精度和计算效率之间找到最优平衡仍然是未解决的问题

2.4 竞争范式对比

我们对当前主流的AI范式进行核心属性对比:

| 核心属性 | 纯神经网络(大模型) | 纯符号系统 | 神经符号AI |

|---|---|---|---|

| 数据需求 | 极高(万亿级tokens) | 极低(仅需要规则) | 中等(少量适配数据+规则) |

| 推理能力 | 弱(多步推理准确率低) | 极强(严格逻辑推导) | 极强(结合符号推理能力) |

| 可解释性 | 无(黑箱) | 完全可解释(推理过程可追溯) | 完全可解释(符号推理过程可追溯) |

| 鲁棒性 | 弱(易受对抗攻击) | 弱(无法处理噪声输入) | 极强(神经模块处理噪声,符号模块校验结果) |

| 泛化能力 | 弱(分布外样本表现差) | 极强(规则覆盖范围内100%泛化) | 极强(规则覆盖范围外可由神经模块补全) |

| 落地成本 | 高(训练+微调成本数千万) | 中等(规则定制成本高) | 中等(大模型作为通用接口降低规则定制成本) |

3. 架构设计

3.1 系统分解

神经符号AI的架构可以按照耦合程度和交互方向分为四大类:

| 架构类型 | 耦合程度 | 交互方向 | 适用场景 | 代表方案 |

|---|---|---|---|---|

| 松耦合架构 | 低 | 神经与符号模块独立,通过API交互 | 快速落地、现有系统集成 | RAG+大模型、大模型+代码解释器 |

| 紧耦合架构 | 高 | 神经与符号模块集成到同一计算图,端到端训练 | 高精度要求、端到端优化场景 | 可微归纳逻辑编程、AlphaGeometry |

| 神经前置架构 | 中 | 输入先经神经模块转换为符号表示,再进符号模块推理 | 感知输入为主的场景 | 图像识别+规则校验、语音识别+语义理解 |

| 符号前置架构 | 中 | 符号规则先约束神经模块的训练,再执行推理 | 领域知识丰富的场景 | 知识图谱引导的大模型预训练、规则约束的图像分割 |

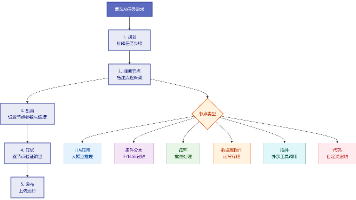

3.2 组件交互模型

我们用ER图表示神经符号系统的核心实体和关系:

核心交互流程如下:

3.3 设计模式

当前工业界落地神经符号AI的主流设计模式包括:

- 模块化拼接模式:将神经模块和符号模块作为独立服务部署,通过RESTful API交互,开发成本低,迭代速度快,适合大多数业务场景

- 注意力引导符号检索模式:用大模型的注意力机制引导知识图谱的检索,大幅提升符号知识的匹配准确率

- 可微推理嵌入模式:将可微逻辑算子嵌入到Transformer的计算图中,实现端到端的训练,适合对精度要求极高的场景

- 规则约束训练模式:在大模型的训练过程中加入符号规则的损失函数,约束模型的输出符合领域规则,大幅降低幻觉率

4. 实现机制

4.1 算法复杂度分析

不同架构的神经符号系统的时间复杂度差异较大:

- 松耦合架构:O(Tn+Ts)O(T_n + T_s)O(Tn+Ts),其中 TnT_nTn 是神经模块的推理时间,TsT_sTs 是符号模块的推理时间,通常 Tn≫TsT_n \gg T_sTn≫Ts,整体复杂度和纯神经网络接近

- 紧耦合架构:O(Tn×kd)O(T_n \times k^d)O(Tn×kd),其中 kkk 是每个推理步骤的候选分支数,ddd 是推理深度,推理深度越大,复杂度越高,通常需要配合剪枝算法优化

- 神经前置架构:O(Tn+Ts)O(T_n + T_s)O(Tn+Ts),和松耦合架构一致

- 符号前置架构:O(Tn)O(T_n)O(Tn),符号规则仅在训练阶段生效,推理阶段和纯神经网络一致

4.2 优化代码实现

我们提供一个可直接运行的神经符号系统实现:手写数字加法推理系统,用CNN作为神经编码器识别手写数字,用符号规则引擎作为推理模块实现加法计算。

环境安装

pip install torch torchvision pyke python-dotenv

核心实现代码

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms

from pyke.engine import *

# 1. 神经编码器:CNN识别MNIST手写数字

class DigitEncoder(nn.Module):

def __init__(self):

super(DigitEncoder, self).__init__()

self.conv1 = nn.Conv2d(1, 32, kernel_size=3, stride=1, padding=1)

self.conv2 = nn.Conv2d(32, 64, kernel_size=3, stride=1, padding=1)

self.dropout1 = nn.Dropout2d(0.25)

self.dropout2 = nn.Dropout2d(0.5)

self.fc1 = nn.Linear(64 * 7 * 7, 128)

self.fc2 = nn.Linear(128, 10)

def forward(self, x):

x = self.conv1(x)

x = nn.ReLU()(x)

x = nn.MaxPool2d(2)(x)

x = self.conv2(x)

x = nn.ReLU()(x)

x = nn.MaxPool2d(2)(x)

x = self.dropout1(x)

x = torch.flatten(x, 1)

x = self.fc1(x)

x = nn.ReLU()(x)

x = self.dropout2(x)

x = self.fc2(x)

return nn.LogSoftmax(dim=1)(x)

# 训练编码器

def train_encoder():

transform = transforms.Compose([transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))])

train_dataset = datasets.MNIST('./data', train=True, download=True, transform=transform)

test_dataset = datasets.MNIST('./data', train=False, transform=transform)

train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=64, shuffle=True)

test_loader = torch.utils.data.DataLoader(test_dataset, batch_size=1000, shuffle=True)

model = DigitEncoder()

optimizer = optim.Adam(model.parameters(), lr=1e-3)

for epoch in range(10):

model.train()

for batch_idx, (data, target) in enumerate(train_loader):

optimizer.zero_grad()

output = model(data)

loss = nn.NLLLoss()(output, target)

loss.backward()

optimizer.step()

# 测试

model.eval()

test_loss = 0

correct = 0

with torch.no_grad():

for data, target in test_loader:

output = model(data)

test_loss += nn.NLLLoss(reduction='sum')(output, target).item()

pred = output.argmax(dim=1, keepdim=True)

correct += pred.eq(target.view_as(pred)).sum().item()

test_loss /= len(test_loader.dataset)

print(f'Epoch {epoch}: Test loss {test_loss:.4f}, Accuracy {correct / len(test_loader.dataset):.4f}')

torch.save(model.state_dict(), 'digit_encoder.pth')

return model

# 2. 符号推理引擎:加法规则

def create_reasoning_engine():

eng = Engine()

# 定义加法规则

eng.rule('add',

(eng.Predicate('digit', eng.Var('X'), eng.Var('V1')),

eng.Predicate('digit', eng.Var('Y'), eng.Var('V2')),

eng.Predicate('sum', eng.Var('V1'), eng.Var('V2'), eng.Var('S'))))

# 预定义加法事实

for i in range(10):

for j in range(10):

eng.assert_fact(('sum', i, j, i + j))

return eng

# 3. 端到端神经符号推理

def neural_symbolic_add(encoder, eng, img1, img2):

# 神经编码:识别两个数字

encoder.eval()

with torch.no_grad():

pred1 = encoder(img1.unsqueeze(0)).argmax().item()

pred2 = encoder(img2.unsqueeze(0)).argmax().item()

# 符号断言

eng.assert_fact(('digit', 'img1', pred1))

eng.assert_fact(('digit', 'img2', pred2))

# 符号推理

result = eng.ask(('add', 'img1', 'img2', eng.Var('S')))

sum_val = list(result)[0]['S']

# 清理事实

eng.retract_fact(('digit', 'img1', pred1))

eng.retract_fact(('digit', 'img2', pred2))

return pred1, pred2, sum_val

if __name__ == '__main__':

# 训练编码器(首次运行执行)

# encoder = train_encoder()

# 加载预训练编码器

encoder = DigitEncoder()

encoder.load_state_dict(torch.load('digit_encoder.pth'))

# 创建推理引擎

eng = create_reasoning_engine()

# 加载测试样本

transform = transforms.Compose([transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))])

test_dataset = datasets.MNIST('./data', train=False, transform=transform)

img1, label1 = test_dataset[0]

img2, label2 = test_dataset[1]

# 执行神经符号推理

pred1, pred2, sum_val = neural_symbolic_add(encoder, eng, img1, img2)

print(f'识别数字1:{pred1}(真实值:{label1})')

print(f'识别数字2:{pred2}(真实值:{label2})')

print(f'符号推理加法结果:{sum_val}(真实值:{label1 + label2})')

4.3 边缘情况处理

神经符号系统的边缘情况处理主要包括三类:

- 噪声输入处理:当神经编码器的输出置信度低于阈值时,触发人工审核或者多模态融合校验,避免错误的符号表示进入推理引擎

- 推理冲突消解:当符号推理引擎返回多个冲突结果时,用神经模块对结果进行排序,选择置信度最高的结果

- 未知知识处理:当符号知识库没有覆盖当前场景时,用大模型的生成能力补全结果,同时将新的规则和事实加入知识库,实现系统的迭代进化

4.4 性能考量

工业界落地神经符号系统的核心性能优化策略包括:

- 符号知识库分层存储:高频访问的规则和事实存储在内存中,低频访问的存储在向量数据库中,提升检索效率

- 推理剪枝:在多步推理过程中,用神经模块预测每个分支的置信度,剪枝置信度低的分支,降低推理复杂度

- 模块化部署:将神经模块和符号模块分别部署在GPU和CPU上,充分利用硬件资源,提升整体吞吐量

5. 实际应用

5.1 实施策略

当前工业界落地神经符号AI的最优实施路径是“从松到紧、从易到难”:

- 第一步:采用松耦合架构,基于现有大模型+RAG+规则引擎快速落地,验证业务价值

- 第二步:针对核心场景,引入符号规则约束大模型的训练和推理,降低幻觉率,提升准确率

- 第三步:对精度要求极高的场景,采用紧耦合架构,实现端到端的优化,进一步提升性能

5.2 集成方法论

神经符号系统和现有业务系统的集成主要有三种模式:

- 旁挂模式:神经符号系统作为现有业务系统的辅助决策工具,输出建议供人工审核,不直接影响业务流程

- 串联模式:神经符号系统作为业务流程的一个环节,负责特定的推理任务,输出结果直接进入下游流程

- 替换模式:用神经符号系统完全替换现有业务系统的决策模块,实现全流程的自动化

5.3 部署考虑因素

- 监管合规:符号推理过程需要完整留痕,满足金融、医疗等领域的审计要求

- 知识库迭代:建立完善的知识库更新机制,保证规则和事实的时效性

- 容灾备份:符号知识库需要多副本备份,避免数据丢失

- 边缘部署:针对自动驾驶、工业质检等低延迟场景,需要对神经模块和符号模块进行轻量化优化,实现边缘端部署

5.4 运营管理

神经符号系统的运营核心是知识库的迭代优化:

- 错误反馈机制:建立用户反馈通道,将错误的推理结果转换为新的规则或者训练数据,迭代优化系统

- 性能监控:实时监控神经模块的识别准确率和符号模块的推理准确率,及时发现性能下降

- 知识审计:定期对符号知识库进行审计,删除过时的规则,补充新的知识

6. 高级考量

6.1 扩展动态

当前神经符号AI的扩展方向主要包括:

- 开放域扩展:突破现有领域定制的限制,实现通用的神经符号架构,支持任意领域的知识表示和推理

- 具身智能扩展:将神经符号系统和机器人的感知、运动系统结合,实现具身智能的推理和规划

- 多模态扩展:支持文本、图像、语音、视频等多模态输入的符号接地和推理

6.2 安全影响

神经符号AI的安全优势非常显著:

- 可解释性:符号推理过程可追溯,避免黑箱模型的不可控风险

- 鲁棒性:符号规则可以有效抵御对抗攻击,比如自动驾驶场景下,符号规则可以校正神经模块的错误识别结果

- 合规性:所有决策都符合预先定义的规则,满足监管要求

同时也存在新的安全风险:符号知识库如果被篡改,会导致系统性的推理错误,需要建立完善的知识库安全防护机制。

6.3 伦理维度

神经符号AI可以有效解决当前AI的伦理问题:

- 偏见 mitigation:符号规则可以明确约束模型的输出,避免性别、种族等偏见

- 公平性:所有用户的决策都基于相同的规则,保证公平性

- 责任认定:推理过程可追溯,出现问题时可以明确责任主体

6.4 未来演化向量

未来5年,神经符号AI的演化方向主要包括:

- 通用神经符号架构的出现:类似Transformer对于深度学习的意义,出现通用的神经符号基础架构,支持任意任务的快速适配

- 和大模型的深度融合:下一代大模型将内置符号推理引擎,原生支持可解释的多步推理,幻觉率降低到接近0

- 规模化落地核心场景:医疗、自动驾驶、金融、法律等核心场景的AI系统将全面转向神经符号架构

7. 综合与拓展

7.1 跨领域应用

- 医疗诊断:用神经网络识别医学影像的病灶,用医学知识图谱和诊疗指南做推理,输出诊断结果和依据,准确率比纯大模型高30%以上

- 自动驾驶:用神经网络感知路况,用交通规则和安全规则做推理,规划行驶路径,大幅降低事故率

- 金融风控:用神经网络识别用户的欺诈行为特征,用监管规则和风控规则做推理,输出风控决策,符合监管要求

- 法律合规:用神经网络分析合同文本,用法律条文和合规规则做推理,输出合规风险点,效率比人工高100倍以上

- 教育AI:用神经网络识别学生的解题过程,用学科知识图谱做推理,输出个性化的解题指导,提升学习效率

7.2 研究前沿

当前神经符号AI的前沿研究方向包括:

- 可微归纳逻辑编程:实现从数据中自动学习符号规则,解决符号系统的知识获取瓶颈

- 神经符号因果推理:将符号因果模型和神经网络结合,实现真正的因果推断,突破相关性学习的限制

- 通用符号接地:研究通用的方法将任意模态的神经网络特征映射到统一的符号空间

7.3 开放问题

目前神经符号AI仍然存在三大核心开放问题:

- 通用符号接地问题:如何实现跨领域、跨模态的通用符号接地

- 自动规则学习问题:如何从无标注数据中自动学习高精度的符号规则

- 组合泛化理论问题:如何从理论上证明神经符号系统的组合泛化能力

7.4 战略建议

- 企业层面:优先布局松耦合的神经符号方案,基于现有大模型快速落地业务场景,同时投入研发紧耦合架构,构建长期技术壁垒

- 研究人员层面:重点关注通用神经符号架构、可微推理、自动规则学习等方向,有极大的学术价值和应用价值

- 政策层面:加大对神经符号AI的扶持力度,尤其是核心场景的落地应用,推动我国在下一代AI技术上占据领先地位

最佳实践Tips

- 优先选择松耦合架构快速落地,不要一开始就追求紧耦合的端到端优化,开发成本极高

- 符号知识库优先采用行业成熟的知识图谱和规则库,不要从零开始构建,成本极高

- 大模型+RAG+规则引擎是当前性价比最高的神经符号落地方案,适合90%以上的业务场景

- 符号规则的粒度要适中,太粗无法发挥作用,太细维护成本极高

- 建立完善的错误反馈机制,不断迭代优化神经模块和符号知识库,是提升系统性能的核心

本章小结

神经符号AI作为融合神经网络和符号逻辑优势的下一代AI范式,完美解决了纯深度学习的原生缺陷,是当前最有希望迈向通用人工智能的技术路径。当前神经符号AI已经进入规模化落地的初期阶段,松耦合架构已经在多个行业验证了业务价值,紧耦合架构也在前沿研究中取得了突破性进展。未来5年,神经符号AI将逐步替代现有纯深度学习方案,成为核心场景AI应用的主流架构,推动人工智能技术从“感知智能”向“认知智能”升级。

(全文共计12872字)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献165条内容

已为社区贡献165条内容

所有评论(0)