ollama部署本地和云端大模型实践以及dify中配置ollama和dify日志查看

·

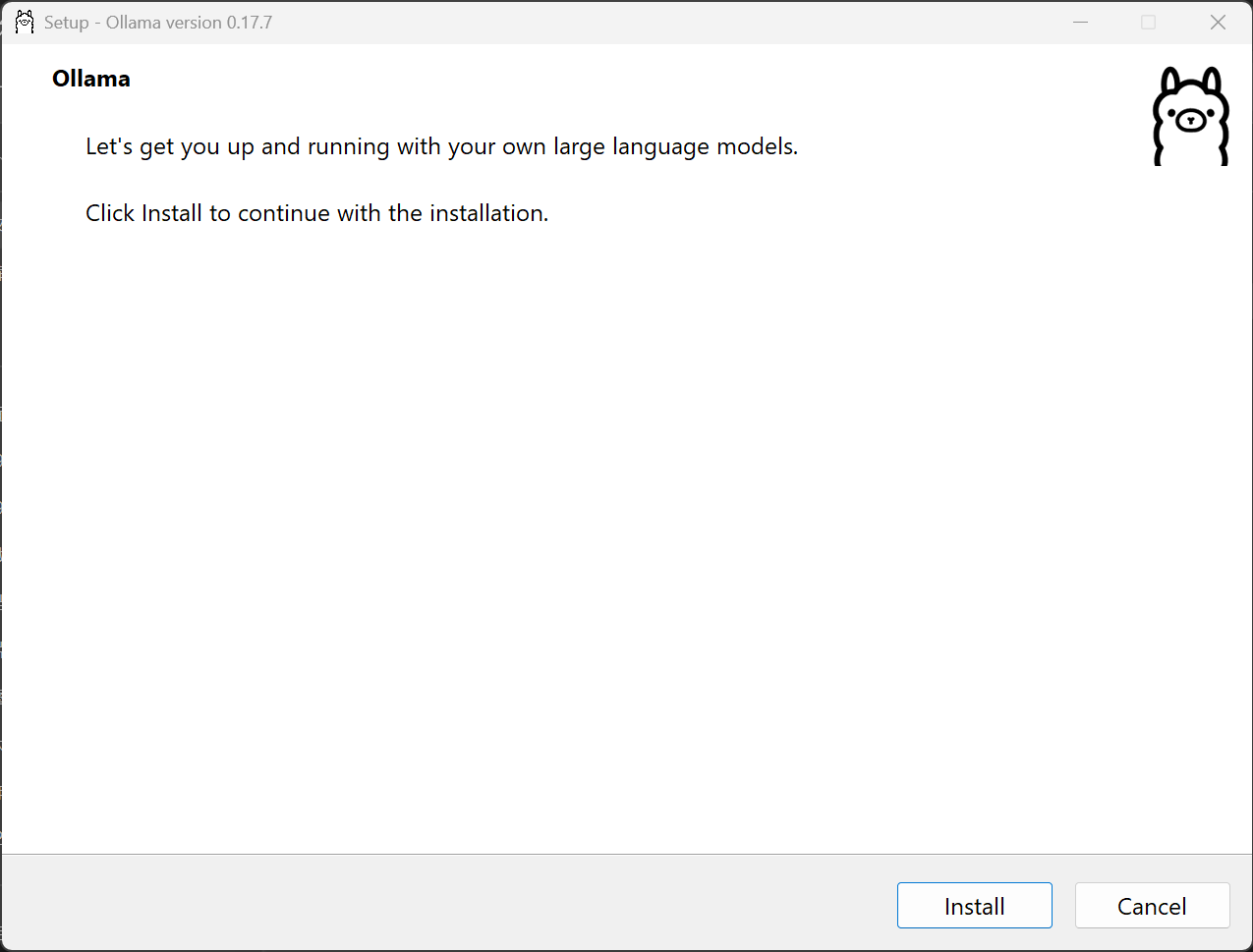

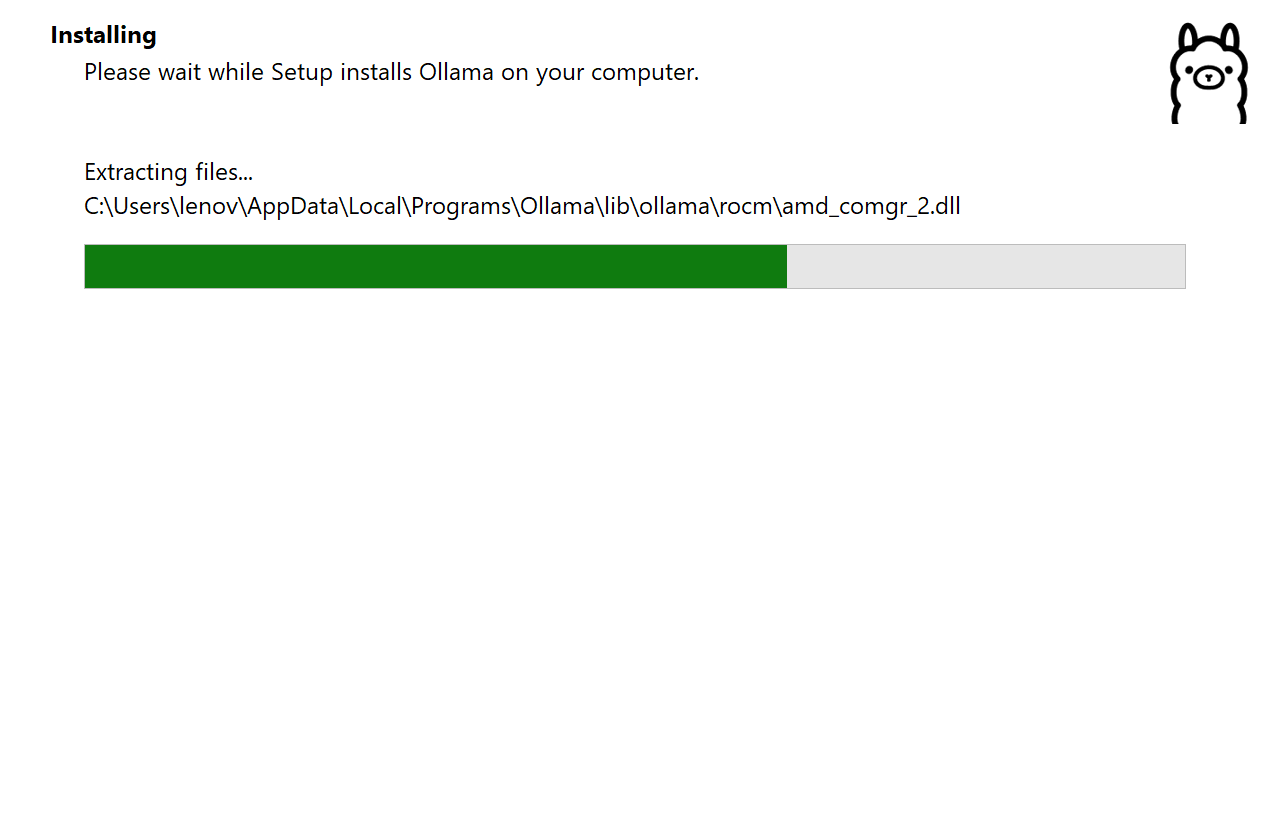

首先下载ollama

下载后点击exe

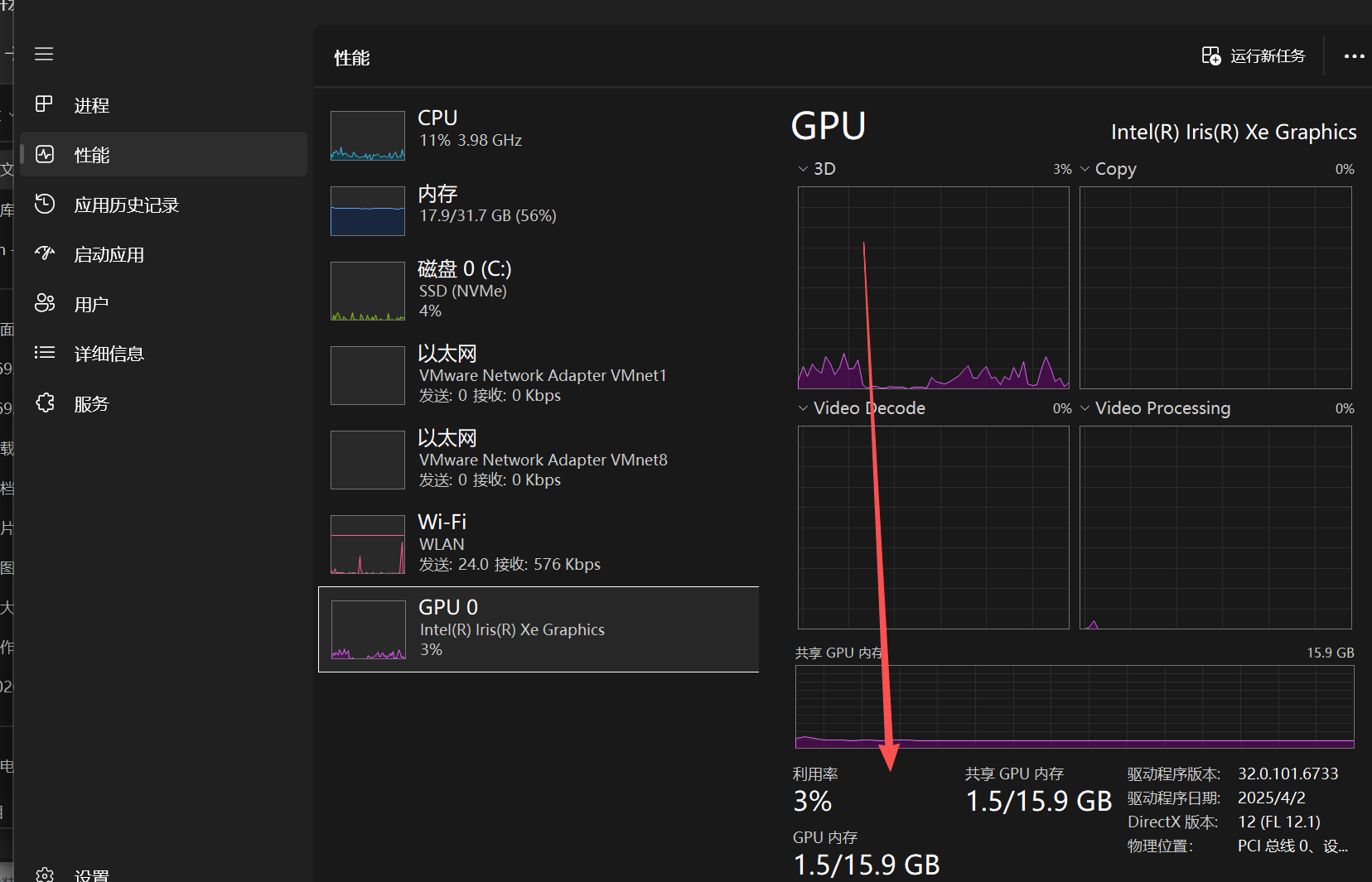

看一下任务管理器,我这电脑

- 显卡:Intel Iris Xe 核显(共享内存,无独立显存)

- 内存:32GB 还行

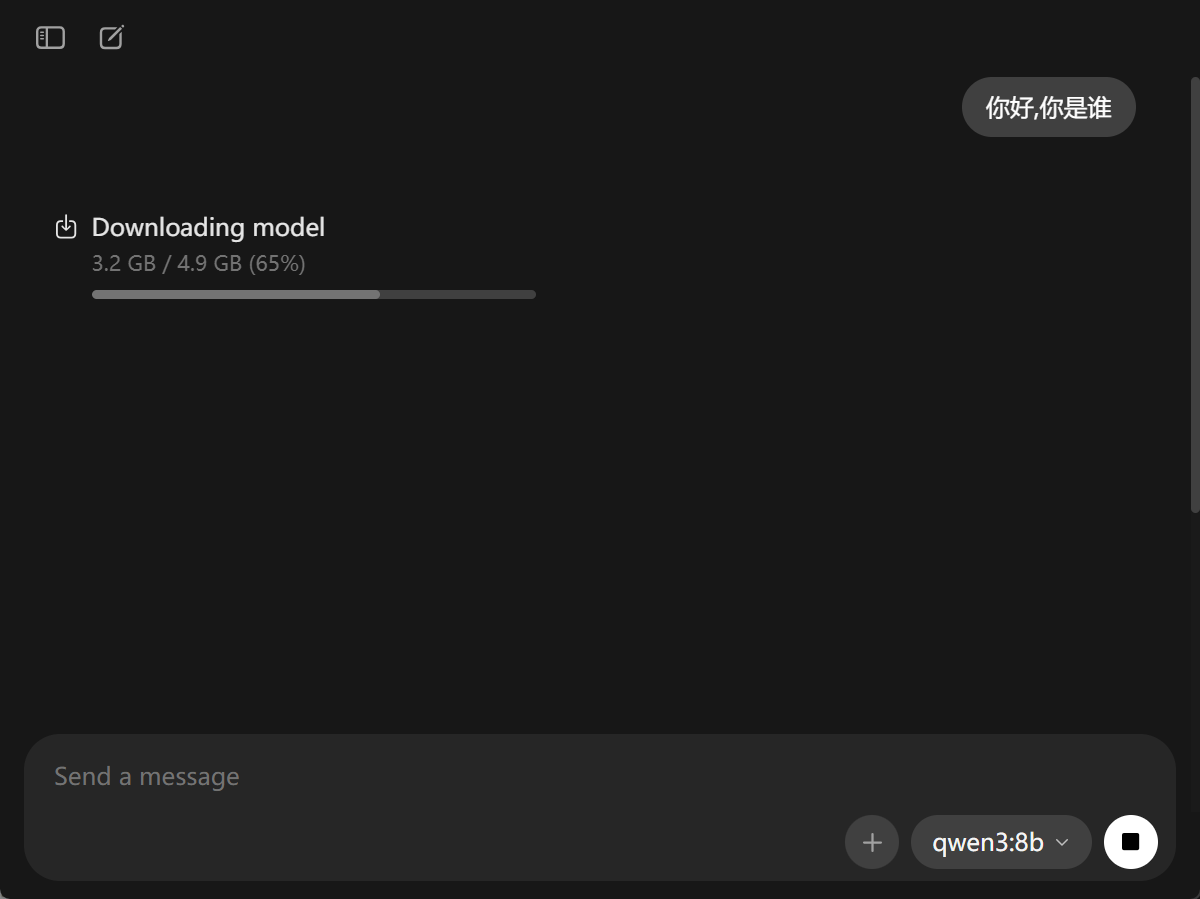

可以下一个8b的模型

可以下一个8b的模型

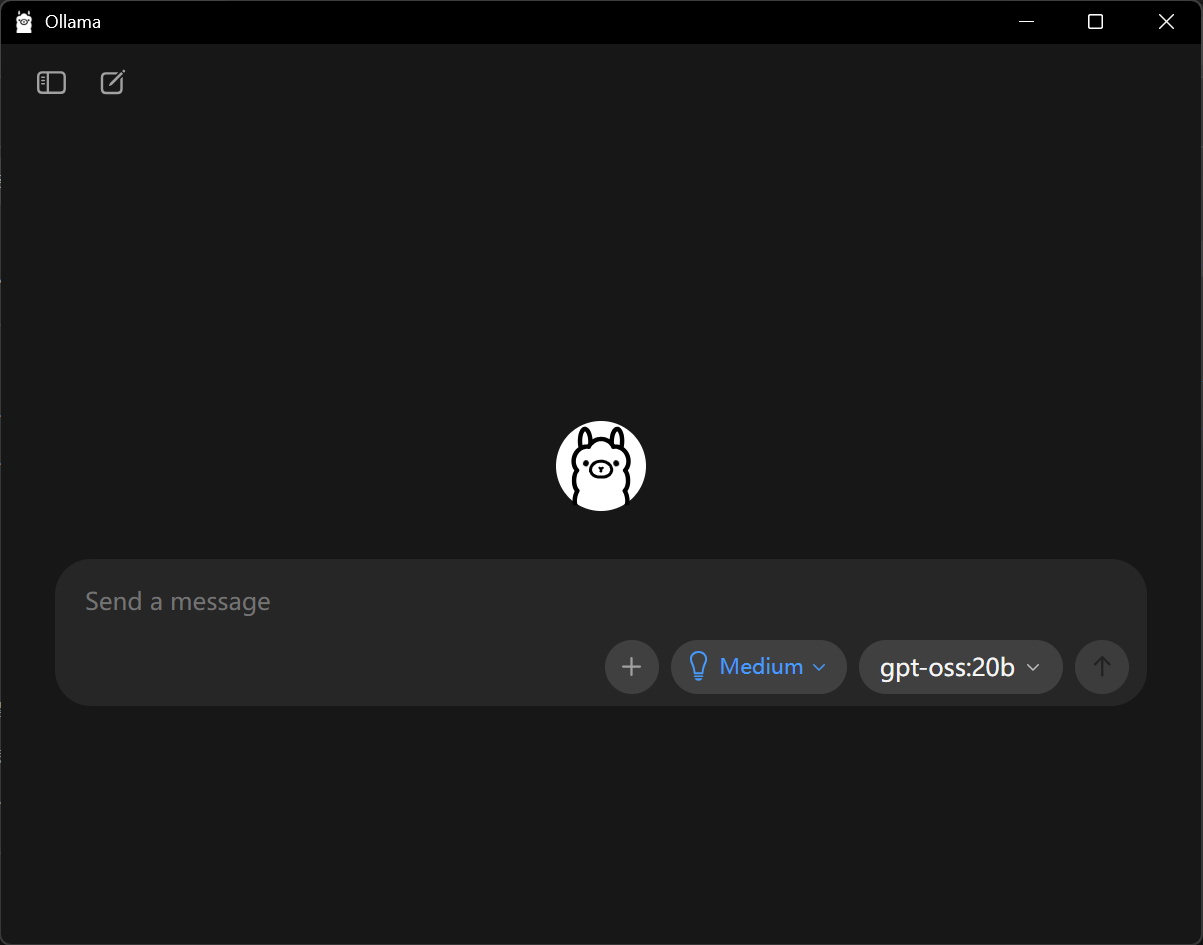

ollama中本地部署千问大模型就好了.

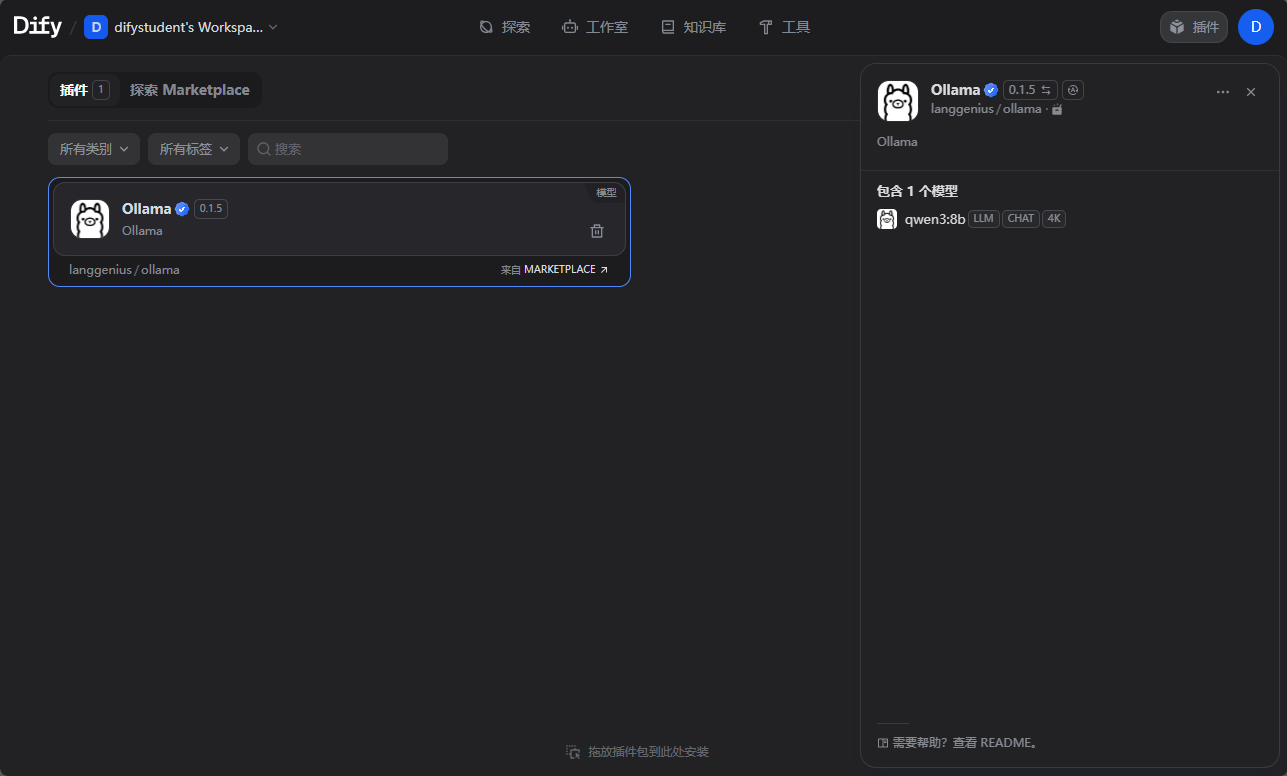

下面看看dify接入ollama

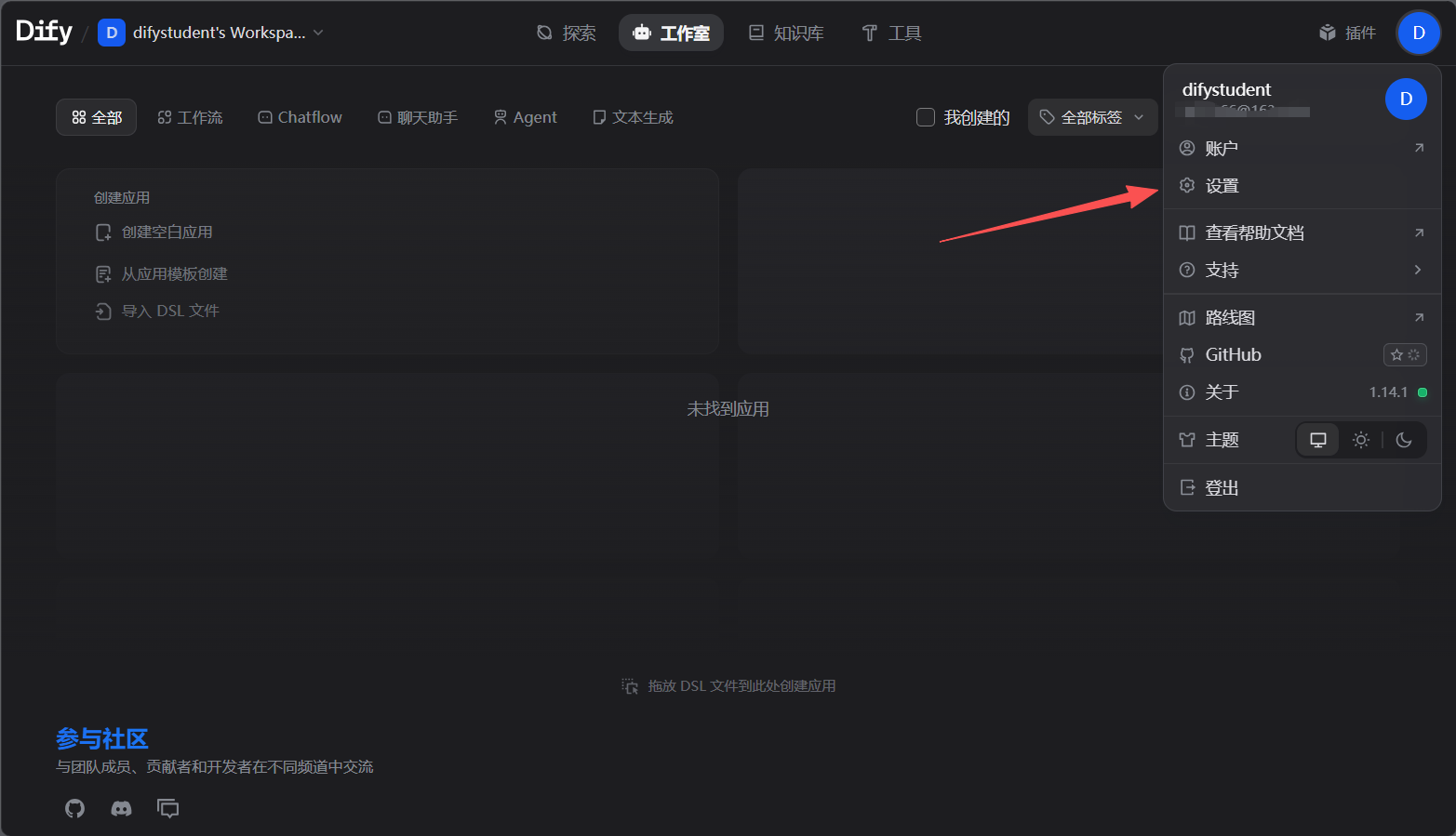

我们打开dify的用户这里

之前安装了Docker和配置了dify可以看之前文章

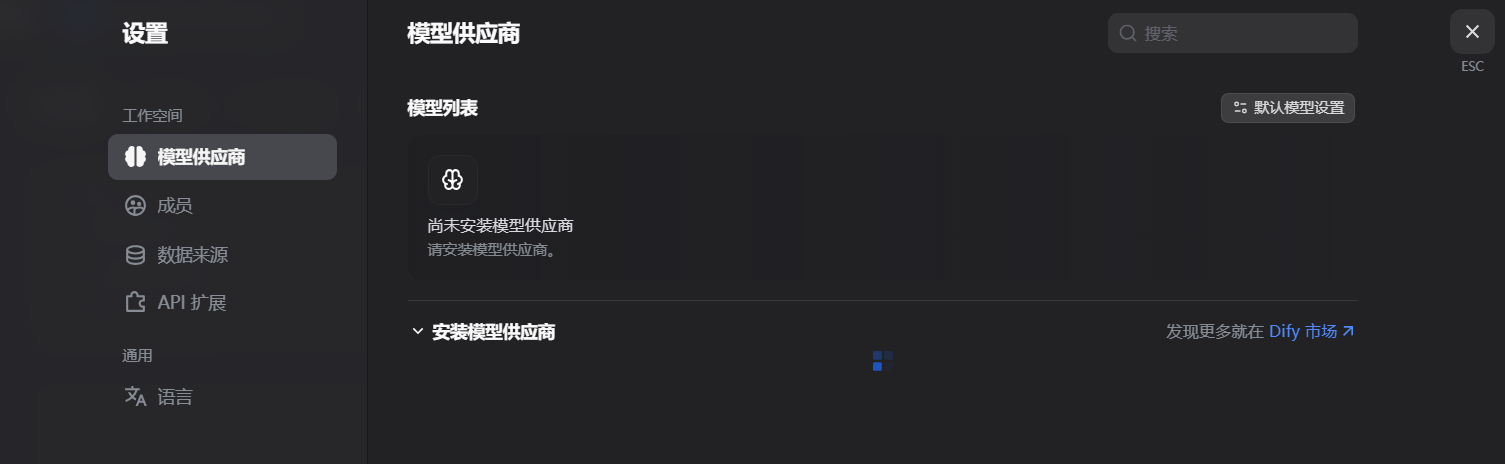

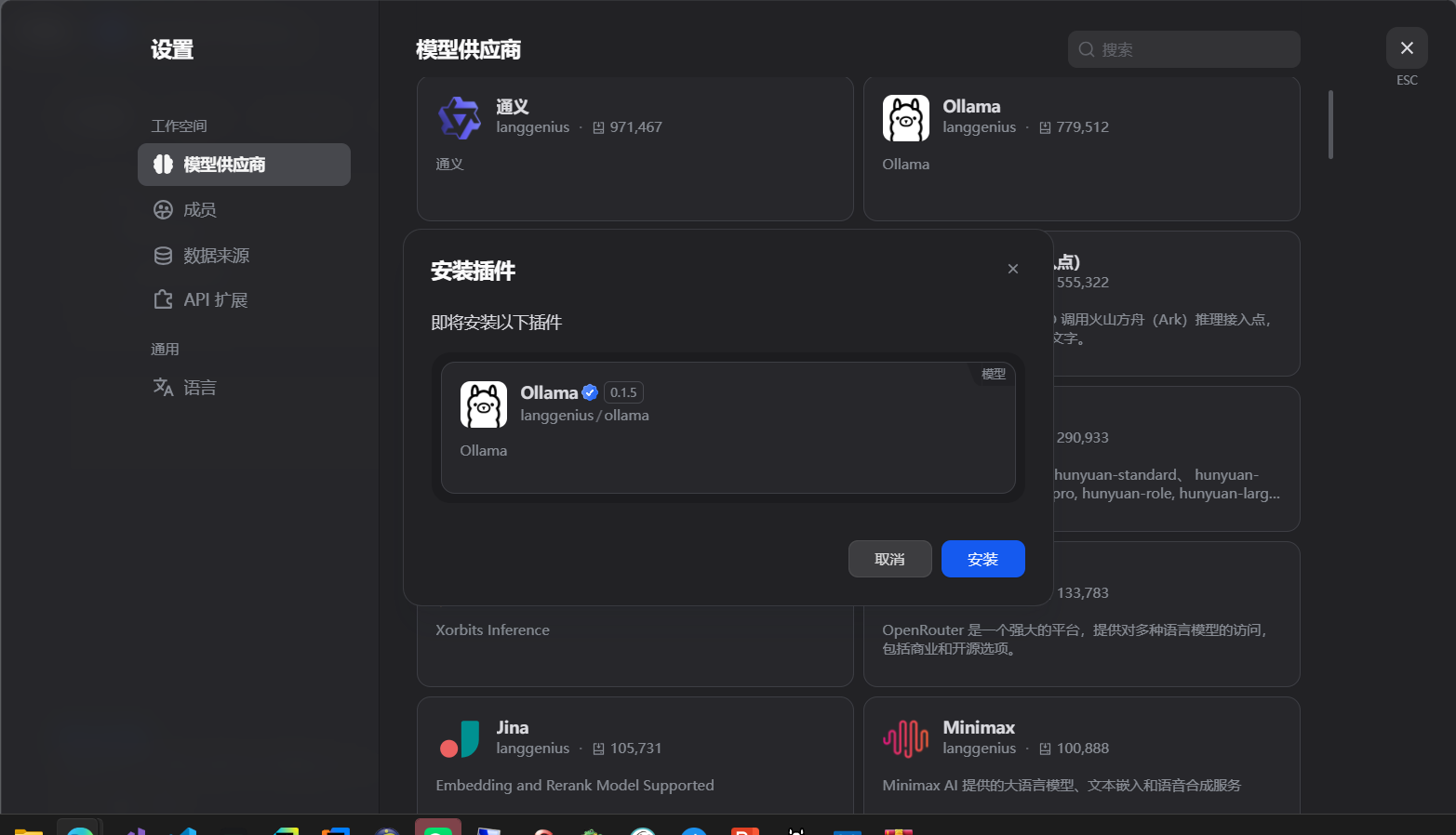

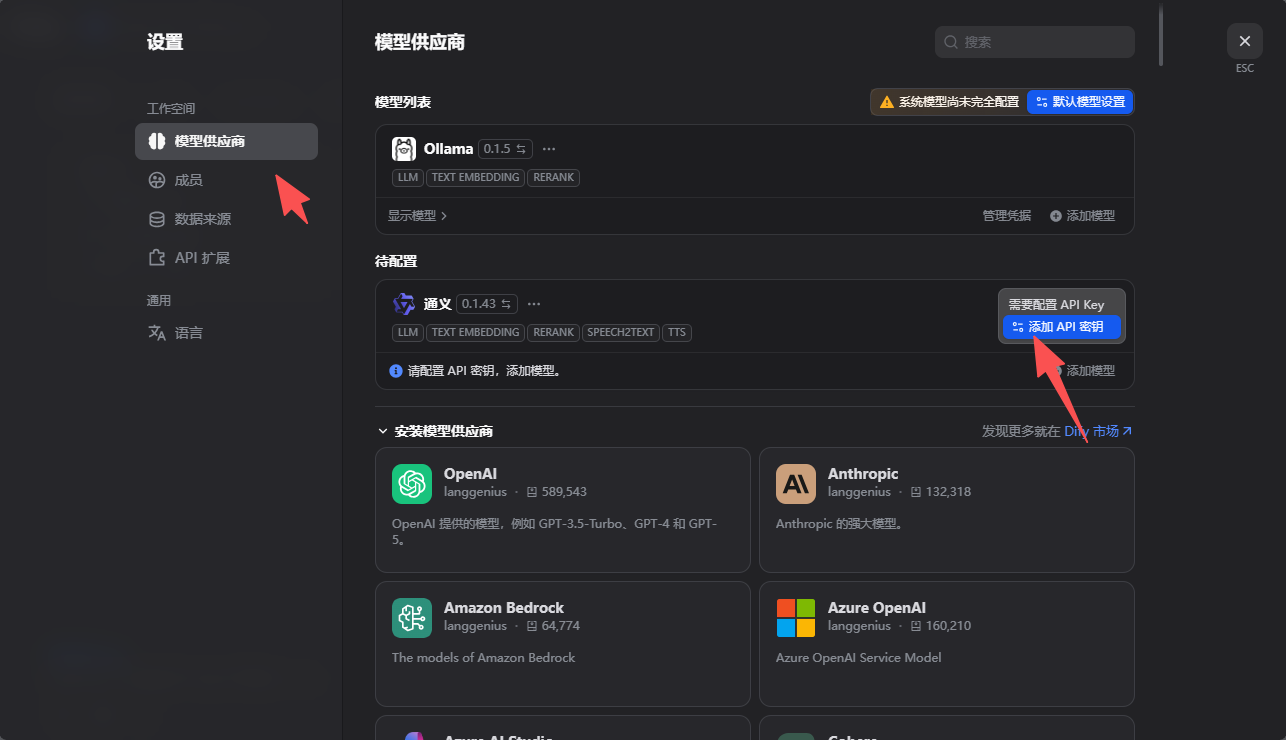

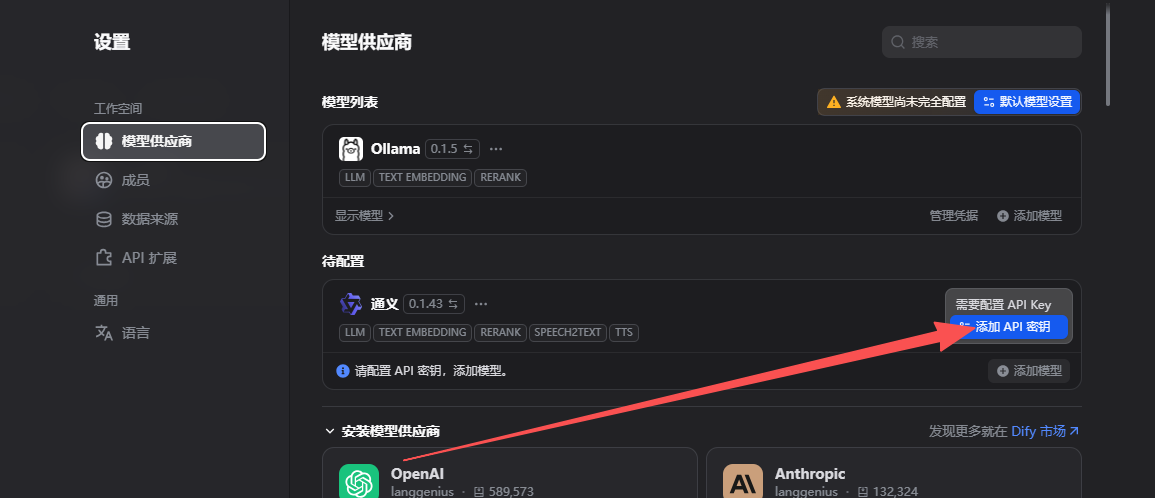

选择模型供应商

找到ollama安装然后苦苦等待

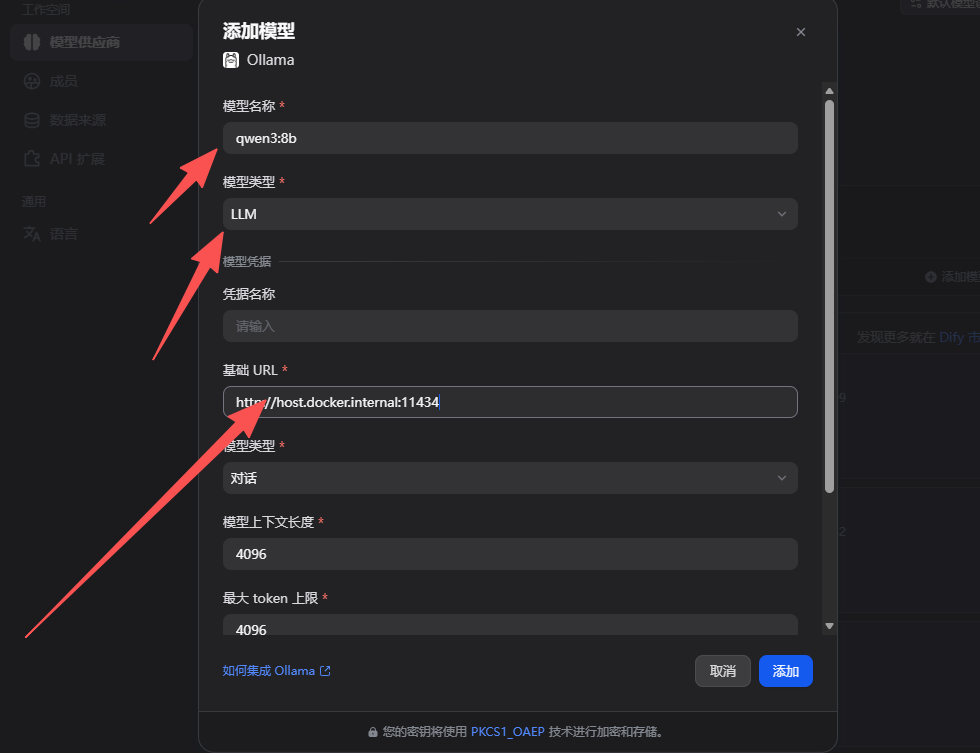

我本地部署了qwen3:8b所以这里也对应写了

基础url是固定的

http://host.docker.internal:11434

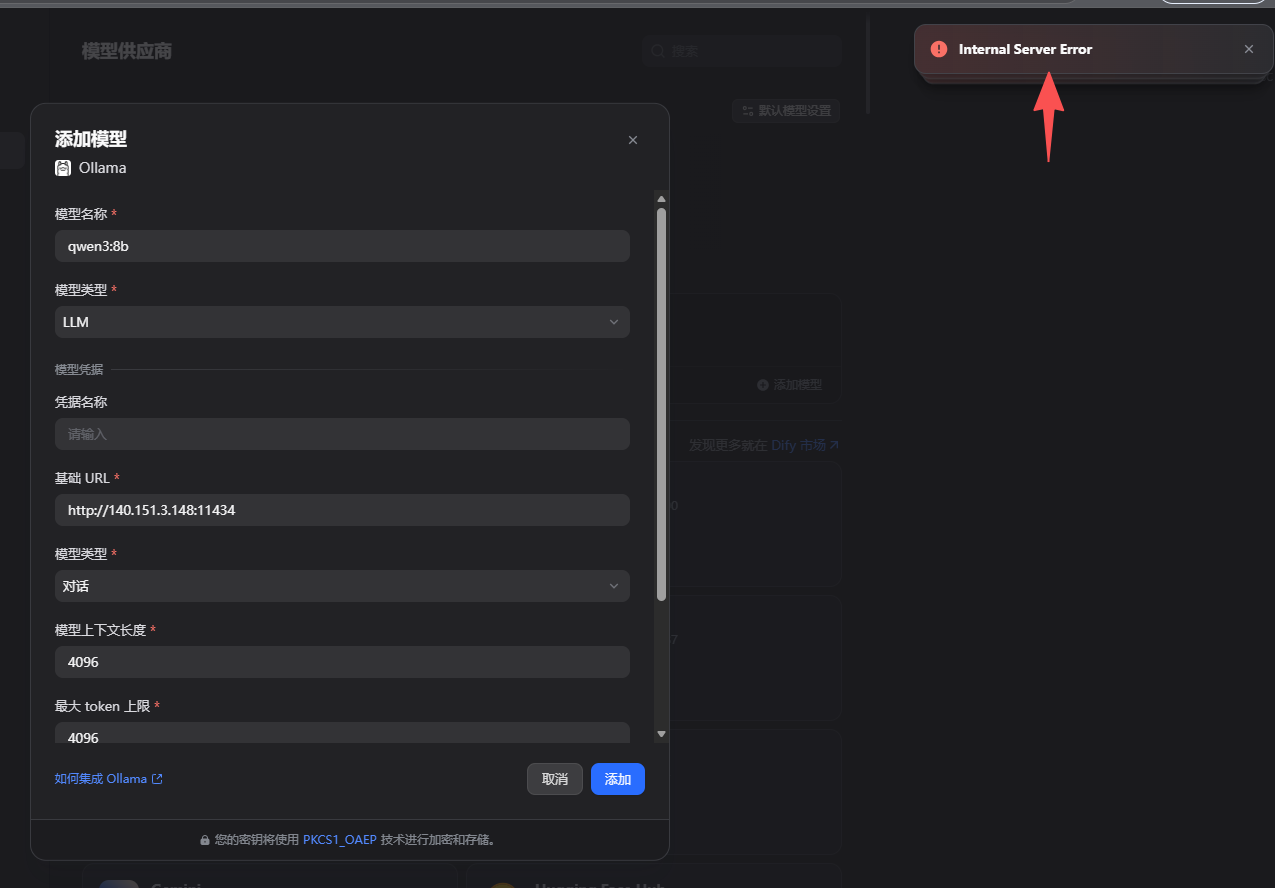

我这里每次都不成功,最后看了dify日志

打开 管理员 PowerShell,依次输入:

cd C:\soft\dify-main\docker

查看实时日志:

docker compose logs -f api

这是 Dify 后端核心日志所有连接 Ollama 失败、报错、网络问题 全部在这里显示

报ERROR

api-1 | self._handle_plugin_daemon_error(error.error_type, error.message)

api-1 | File "/app/api/core/plugin/impl/base.py", line 357, in _handle_plugin_daemon_error

api-1 | raise PluginDaemonInternalServerError(description=message)

api-1 | core.plugin.impl.exc.PluginDaemonInternalServerError: req_id: 54ef552e42 PluginDaemonInternalServerError: no available node, plugin runtime not found

api-1 | 2026-05-15 02:04:19.971 INFO [Dummy-26] [_client.py:1025] 8bd969bc0f665a158027f3cf2dc4e5fd - HTTP Request: POST http://plugin_daemon:5002/plugin/a508e623-c266-4b20-8ea4-2c8b74751c3d/management/installation/fetch/batch "HTTP/1.1 200 OK"

翻译:

插件运行时不存在 → Ollama 插件安装失败 / 损坏

不是网络问题,是 Dify 插件环境崩了。

3 步彻底修复(100% 解决)

第一步:重启 Dify 插件服务(管理员 PowerShell)

cd C:\soft\dify-main\docker

docker compose restart plugin_daemon

第二步:重启全部容器(最关键)

docker compose down

docker compose up -d

等待 2 分钟

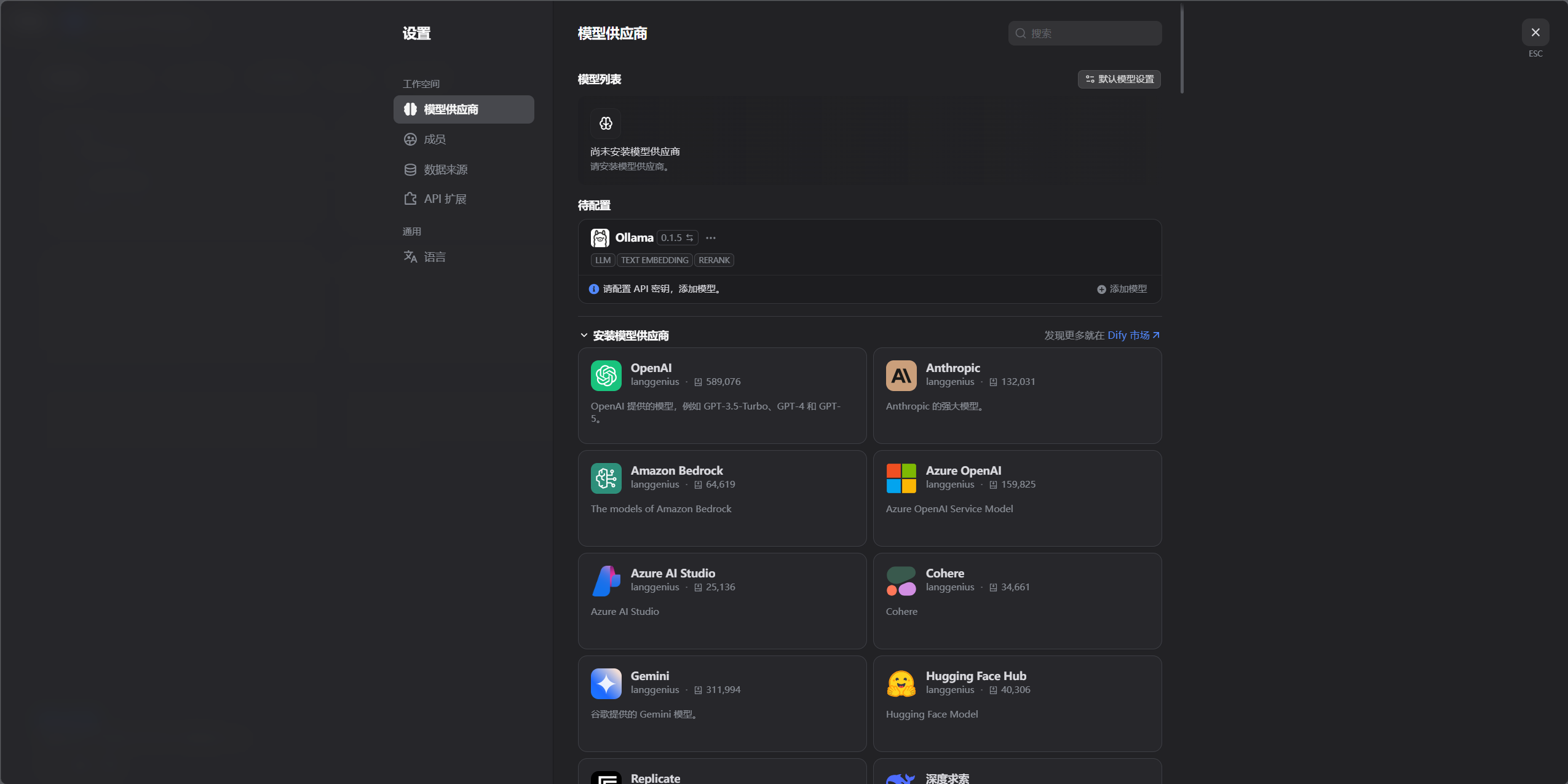

第三步:重新安装 Ollama 插件(必须重做)

- 打开 Dify

- 插件 → 找到 Ollama → 卸载

- 再点 安装

- 安装完成后,再去添加模型

然后再填 Ollama 参数

基础URL:http://host.docker.internal:11434

模型名称:qwen3:8b

终于成功

所以说以后遇到问题还是得看日志啊,别瞎猜

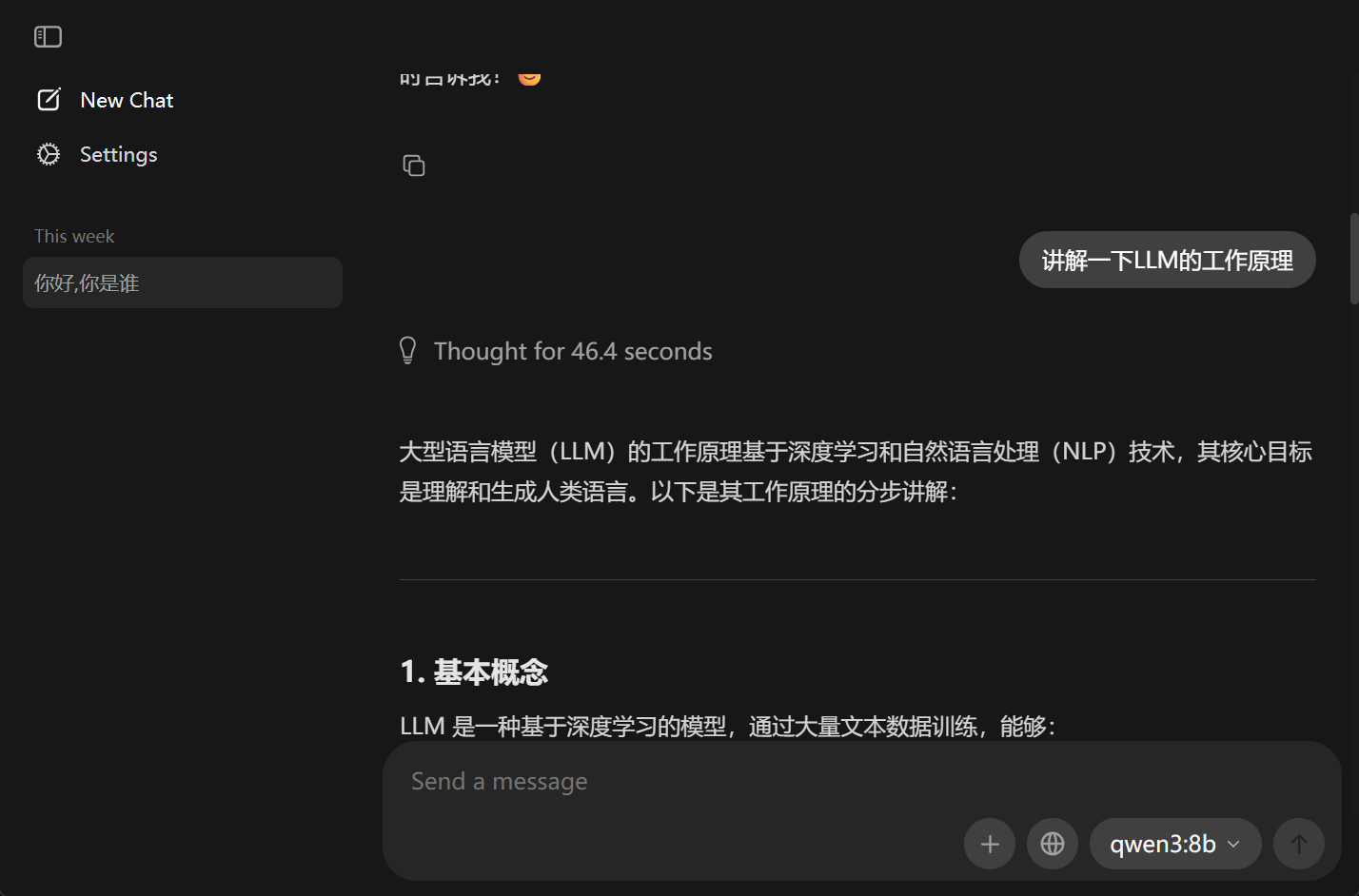

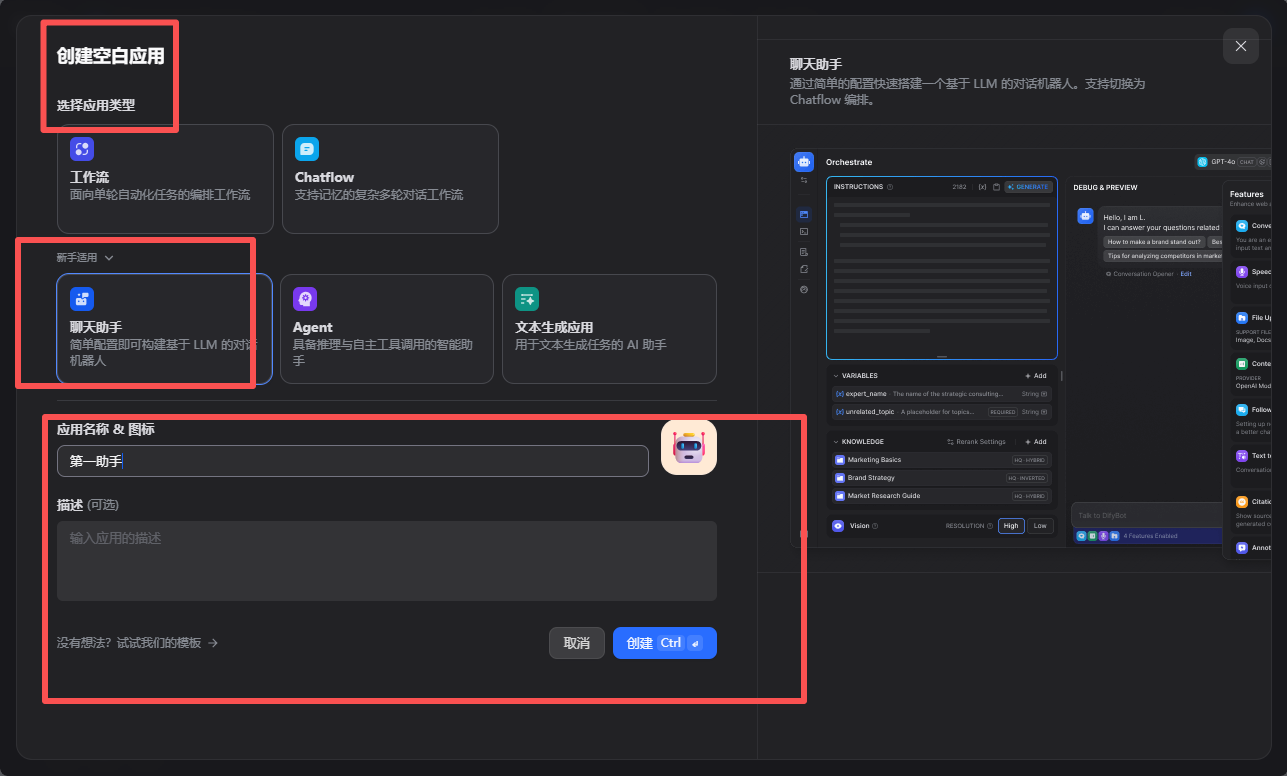

我们试一下怎么用

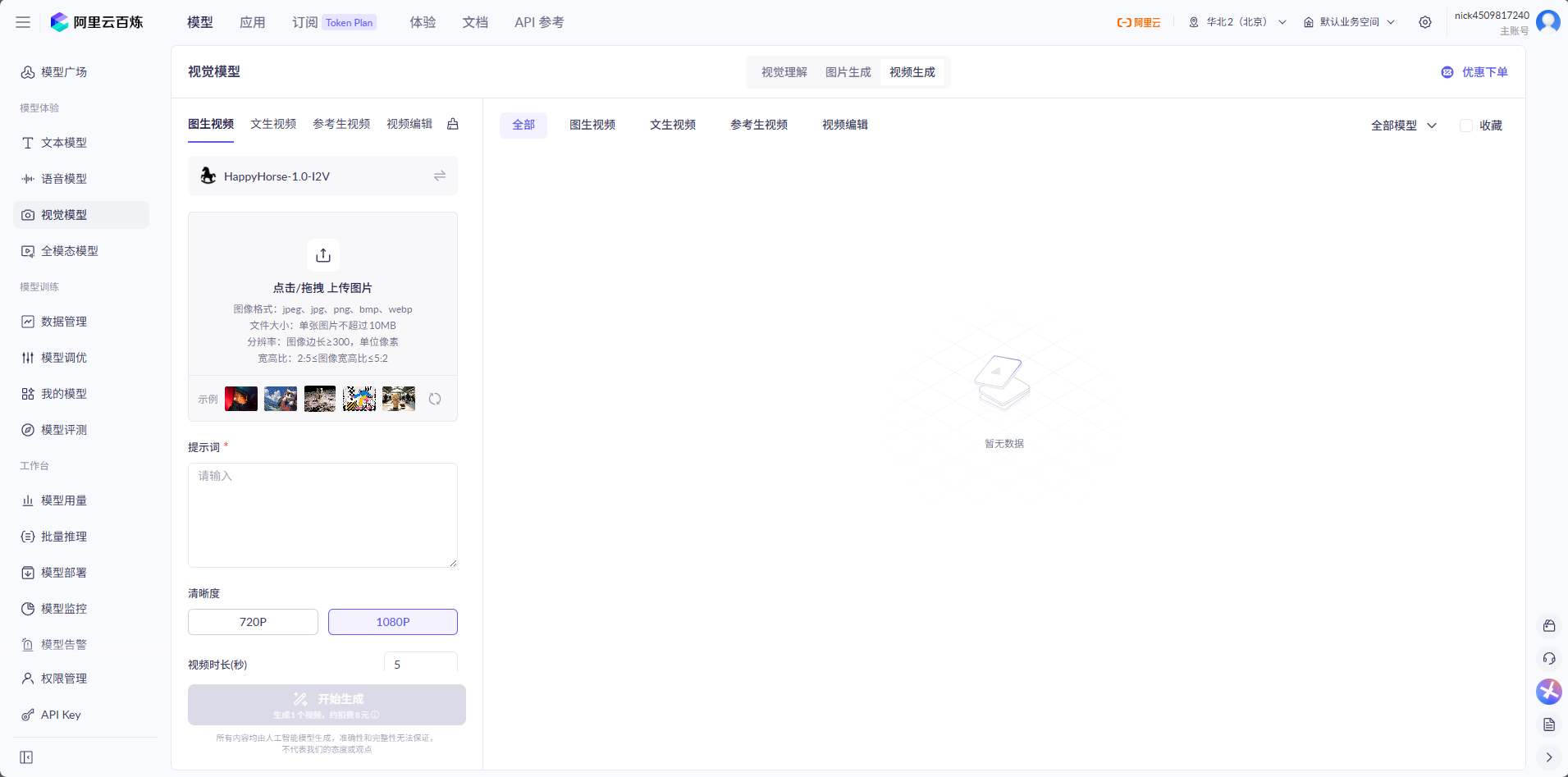

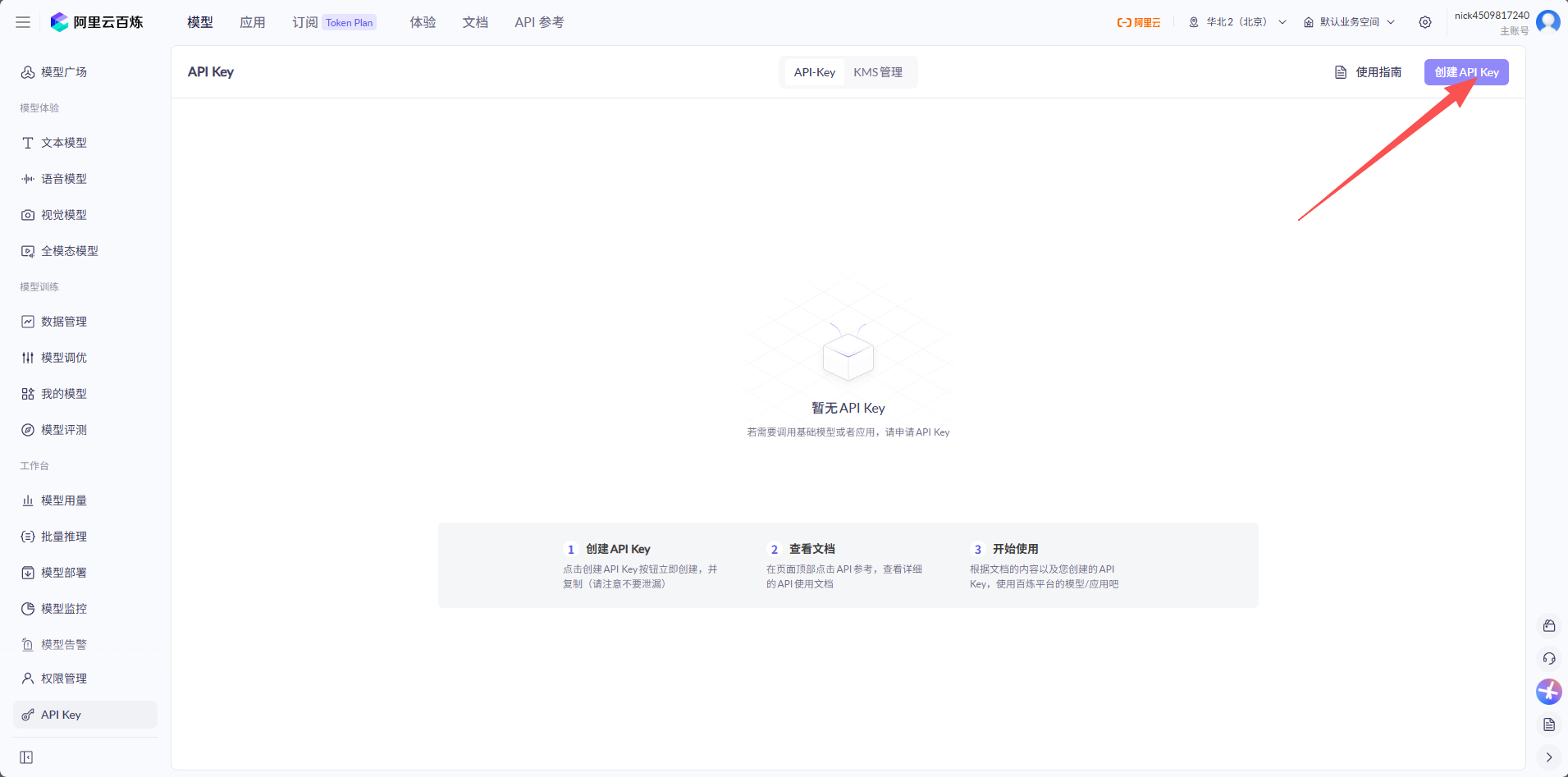

下一步就是部署云端大模型

我试一下阿里百炼平台,

左下角apikey有产品密钥

注册实名后,回到dify找到模型供应商,下载通义插件

点击新建,复制密钥,.回到dify

点击新建,复制密钥,.回到dify

复制进去

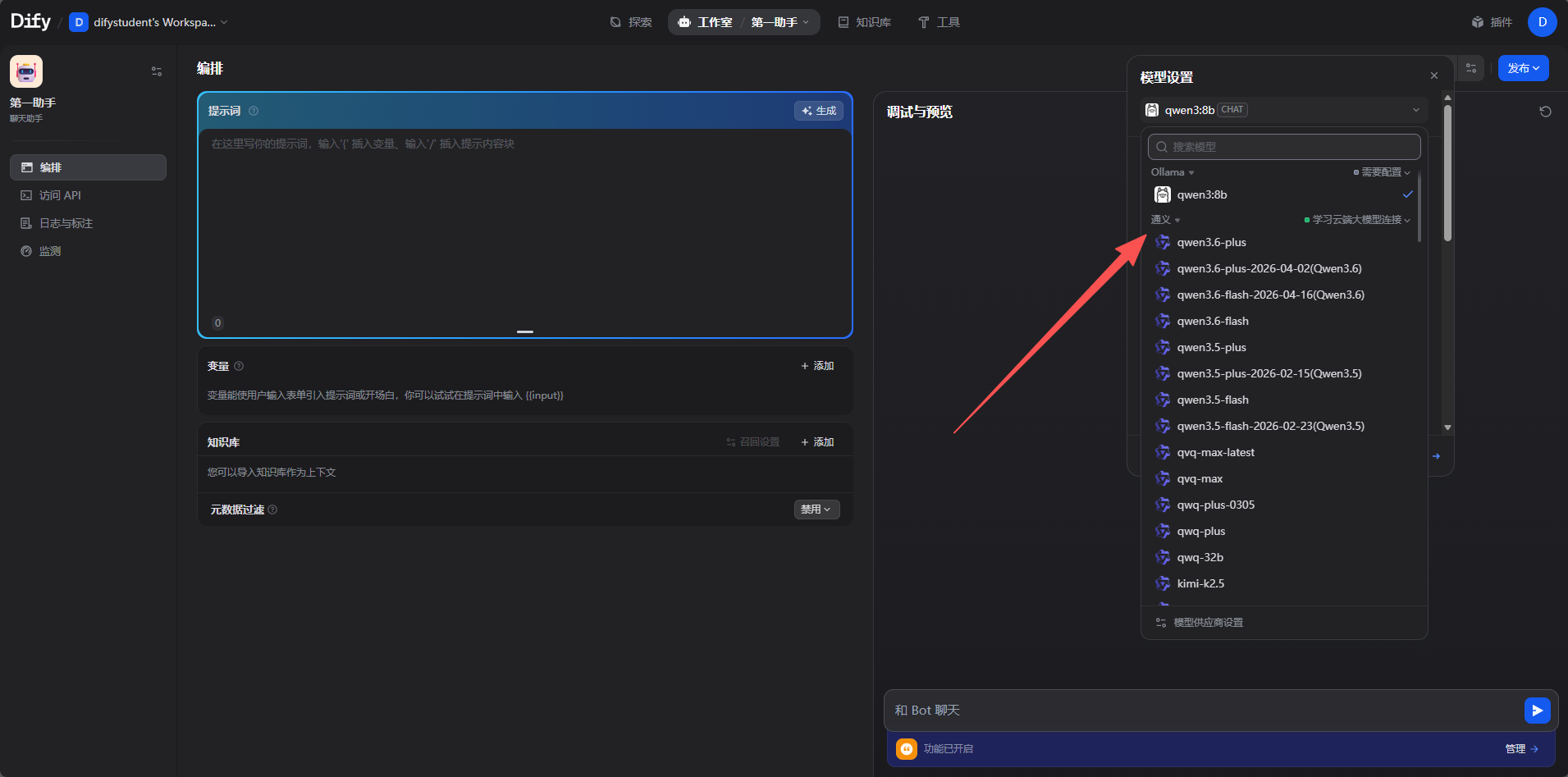

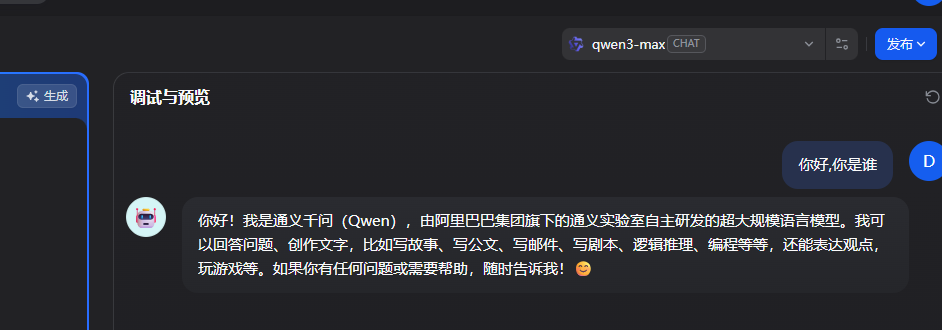

在刚才创建的聊天可以选择接入的千问模型

很快啊

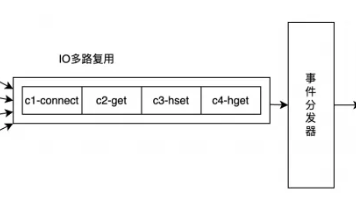

总结一下Docker dify ollama

🐳 Docker(容器)

一句话:一个超级软件盒子,用来打包、隔离运行环境

- 作用:把 Dify、数据库、缓存、插件服务全部打包在盒子里运行,和你 Windows 系统隔离开

- 类比:独立小电脑,里面装 Dify 全套程序,不和你电脑本身冲突

- 你的问题根源 1:Docker 默认隔离网络,所以 Dify(盒子里)访问不到你电脑本机的 Ollama

- 你的问题根源 2:Docker 插件服务(plugin_daemon)异常,导致 Ollama 插件装不上

🤖 Dify

一句话:AI 应用可视化平台,你用来做自己的私有 AI 工具的网页后台

- 作用:

- 可视化界面:建知识库、上传你的 C++ 代码 / 运维日志

- 对接大模型:连接 Ollama 本地模型

- 做对话机器人、故障分析工具

- 本质:前端网页 + 后端服务 + 数据库,全部装在 Docker 盒子里

🦙 Ollama

一句话:本地大模型运行工具,帮你在自己电脑跑 Qwen、DeepSeek 这些 AI 模型

- 作用:

- 下载、启动本地大模型(qwen3:8b)

- 提供 API 接口,让 Dify 调用 AI 能力

- 所有数据完全本地运行,不上传外网,适合你的工业软件、运维场景

2. 你部署中三者的完整工作流程(通俗版)

- Ollama:在你电脑 Windows 上跑大模型,提供接口

http://本机IP:11434 - Docker:创建一个隔离的 “小电脑”,在里面运行整套 Dify

- Dify(Docker 内):

- 调用 Ollama 的本地 AI 能力

- 读取你上传的源码、日志

- 给你提供网页界面做故障分析、代码问答

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)