黄仁勋的Token经济,李彦宏的DAA,AI度量衡之争才刚开始

刷到黄仁勋和李彦宏最近关于AI计费的讨论,第一反应是——好家伙,这哪是定价,这是在定规矩。

黄老板在Computex上说,未来的AI世界将由“Token经济”驱动,计算要按Token来买卖。几乎同时,李彦宏在百度AI开发者大会上,把自家的计费单位从“千Tokens”换成了“DAA”(DAA Hour)。这俩词,一个来自芯片霸主,一个来自国内大厂,背后是两套完全不同的价值坐标系。

说白了,这不是简单的价格战,是AI基础设施的“度量衡”之争。就像当年秦始皇统一货币和度量衡,谁定义了标准,谁就握住了生态的钥匙。

1. 黄仁勋的“Token经济”:从芯片到算力货币

先看黄仁勋的Token。这玩意儿,说白了就是把大模型“吃进去”的文字、图片、代码,量化成一个个标准化的计算单元。1个Token约等于0.75个英文单词或半个汉字。

听起来挺技术,对吧?但老黄把它拔高到了“经济”层面。他的逻辑链条是:

- 一切皆Token:未来所有数字内容(文本、图像、视频、3D模型)都能被Token化。

- 计算即交易:你需要AI处理这些Token,就得用我的GPU(或者我授权的云服务)来“燃烧”算力。

- Token即货币:于是,Token成了衡量和交换AI算力的基本单位,形成一套闭环经济。

这招挺狠的。它把英伟达从单纯的“卖铲子”(GPU硬件)升级成了“制定金本位”(Token标准)的角色。你想玩AI?先得用我的“货币”体系。

不过这里有个前提。Token经济的底层假设是:AI推理的成本,主要由“处理的数据量”(Token数)线性决定。这在小模型、短上下文场景下可能成立,但遇到动辄百万Token的长上下文、复杂推理链(Chain-of-Thought),或者需要频繁调用外部工具(Tool Calling)的智能体(Agent),情况就复杂了。

我跑了一下几个主流API的价格表,发现一个反直觉的点:按Token计费时,输入(Input)和输出(Output)的价格经常不一样,而且长上下文可能有额外溢价或折扣。这说明,纯粹按Token数量计价,模型厂商自己都觉得有点“糙”,得打各种补丁。

2. 李彦宏的“DAA”:回归“有效计算时间”

再看李彦宏的DAA(DAA Hour)。百度文心大模型把这个新单位定义为:“每秒处理1.5K Tokens的算力,持续运行一小时”。

这就有意思了。DAA跳出了“数豆子”(Token数)的逻辑,转向了“看钟表”(计算时间)。它更接近于我们租用云服务器时熟悉的“vCPU小时”或“GPU小时”。

这种转变,个人觉得,反映了国内大模型在追求“性价比”和“场景适配”上的务实思路。

| 计费维度 | Token经济 (如 OpenAI) | DAA (百度文心) |

|---|---|---|

| 核心单位 | Token (输入/输出数量) | DAA Hour (有效算力时间) |

| 定价逻辑 | 按“数据吞吐量”收费 | 按“计算资源占用时间”收费 |

| 优势 | 简单直观,易于理解 | 可能更贴合复杂、长耗时任务的实际成本 |

| 挑战 | 长文本、复杂推理的成本估算可能失真 | 需要明确界定何为“有效”计算,避免争议 |

DAA试图把黑盒的模型推理,包装成一个更“云原生”、更让企业IT采购部门熟悉的商品。对于需要长时间、高并发调用AI服务的企业应用来说,按时间包月/包年,可能比按Token数零敲碎打,在预算管理上更友好。

但问题也在这儿。“有效计算时间”怎么界定?模型预热、排队等待的时间算不算?不同复杂度的请求(比如简单分类 vs 代码生成)都按同一时间单价算,公平吗?这需要非常透明和精细的监控与计费系统来支撑,不然容易变成一笔糊涂账。

3. 为什么是现在?成本与场景的双重挤压

这场度量衡之争现在爆发,不是偶然。

首先是成本压力打到骨头里了。 国内大模型价格战已经卷到了“毛分时代”。输入Token价格低至每百万0.4元人民币,做个内部工具,调用成本相比去年直接降了两个数量级。当价格低到一定程度,计费模型本身的“摩擦成本”和“认知成本”就凸显出来了。继续按Token几分几厘地算,财务对账能累死。

其次是应用场景复杂化了。 早期的AI应用多是“一问一答”。现在呢?AI要写长篇报告、要分析上百页PDF、要当24小时在线的客服机器人、要调度整个业务流程。这些场景里,单纯的Token数已经很难准确反映AI服务提供的价值(或消耗的资源)。用户开始关心“完成我这个任务,到底要花多少钱/占用多少资源”,而不是“你处理了多少个字”。

说实话,这两种模式没有绝对的对错,它们很可能长期共存,服务于不同的客户和场景。

- 标准化、轻量级、高频的调用(比如智能客服的简单问答、文本润色),可能更适合按Token计费,清晰明了。

- 重型、长耗时、定制化的企业级服务(比如代码生成平台、AI数据分析流水线),按DAA这类“计算时间”或“资源包”计费,可能更符合甲方的采购习惯和预算模型。

4. 对开发者意味着什么?新的成本和架构考量

对我们一线搞技术的来说,这事儿不能只看热闹。

第一,成本模型变复杂了。 以后选型大模型API,不能只看Token单价那张表。你得问:

- 你们支持DAA计费吗?和Token计费怎么换算?

- 长上下文(128K+)有额外计费规则吗?

- 流式响应(Streaming)的计费方式是什么?(是输出第一个Token就开始算,还是输出完毕才算?)

- 有没有针对高频、固定场景的“资源预留”套餐?

第二,架构设计可能要变。 如果未来DAA这类“计算时间”模式成为主流,我们优化AI应用的方向,可能要从“减少Token数”(比如拼命做提示词压缩)转向“提高计算效率”。比如:

- 更积极地使用缓存,避免对相同或相似的问题进行重复计算。

- 优化任务编排,让AI的“思考时间”(计算占用)尽可能集中和高效,减少空转。

- 考虑混合计费策略,在应用内对不同优先级的任务采用不同的计费后端。

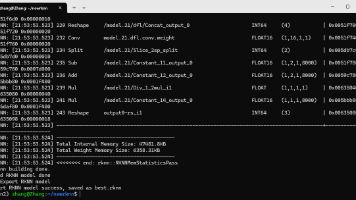

# 假设未来API调用可能要带计费模式参数

curl -X POST https://api.big-model.com/v1/chat/completions \

-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "ernie-4.0",

"messages": [...],

"billing_mode": "daa" # 指定按DAA计费

}'

(当然,这只是个设想,目前API还没这么复杂)

5. 我的看法:标准之争,生态之始

总之,东西不错但坑也不少。

黄仁勋的Token经济,野心在于构建一个以英伟达算力为核心的、全球统一的AI价值尺度。李彦宏的DAA,更像是从中国市场和企业级需求出发,做的一次本地化改良和差异化竞争。

这场度量衡之争,短期内不会结束,反而会随着更多玩家(云厂商、模型公司、开源社区)的加入,变得更加热闹。说不定过几个月,我们还能看到按“推理步骤数”、“智能体调用次数”甚至“业务价值分成”来计费的新模式。

对于开发者而言,这既是挑战也是机会。挑战是,以后做技术选型和成本评估得更费脑子了。机会是,更精细、更多元的计费模式,或许能让我们以更低的成本、更灵活的方式,去实验和落地那些以前觉得“太贵”的AI应用场景。

最后提一嘴,无论标准怎么定,赢家大概率是那些能提供稳定、高性能、且价格透明的算力供应商和模型服务商。毕竟,再花哨的度量衡,也得先有“货”可度才行。

你们觉得呢?在你们的项目里,是更愿意接受按Token计费,还是希望有DAA这类按时间/资源包的计费方式?评论区聊聊。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)