Ollama:从理解到应用的简述

一、Ollama 到底是什么?

1.Ollama 是 Windows 本地跑 AI 大模型的“一键启动器 + 模型管家”

2.就像玩游戏时用到的Steam、wegame,下载游戏、管理游戏、支配和使用游戏

3.跑本地大模型同理,就要用到Ollama下载各种模型、管理和使用

4.能够支持绝大多数开源大模型,全自动调用你的(本地配置)显卡 + 处理器。

二、为什么本地部署大模型,优先采用 Ollama作为媒介?

- 完全傻瓜,零技术门槛

不用装 Python、不用装 PyTorch、不用配置环境变量、不用折腾编译。

安装完 Ollama,复制一行命令,自动下载模型、自动用 GPU 跑,小白也能直接用。 - 自动识别你的电脑硬件,根据使用情况智能分配,如:

自动检测显卡显存、CPU 内存

自动把模型该放显卡的放显卡,不够自动少量分给内存

不会爆显存、不会闪退、不用你手动调参数其他的部署软件需要自己调层数、分片、KV 缓存,很容易过量分配工作导致显存崩掉。 - 模型仓库最全

Ollama 内置海量模型库,99%大模型全系列支持

直接一行命令下载,不用自己找网盘、找量化包。 - 占用低、后台常驻、秒切换模型

开一次 Ollama 后台挂着,随时调用:

想写开展工作A切 DeepSeek,想开展工作B切 GPT,秒切换不用重新加载。

使用多核线程 - 私人风格持续优化

相当于本地自建了一个私人 AI 服务器,打造属于自己的专属工作流+专属生态。

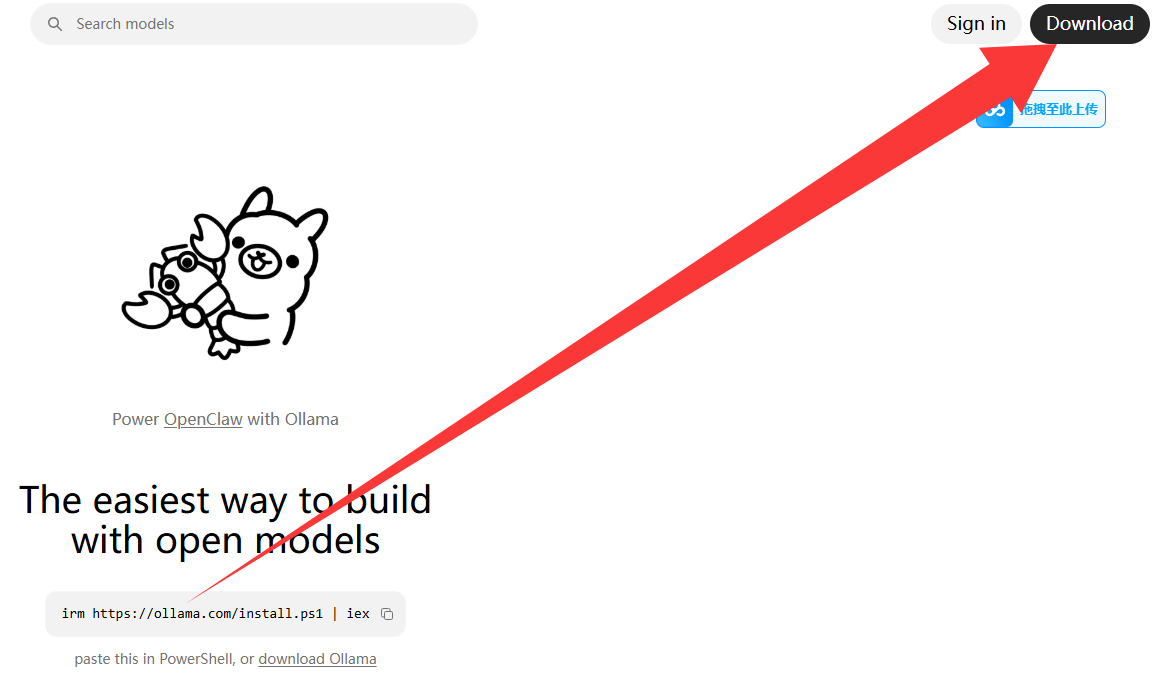

三、Ollama 官方下载地址

1.官网:https://ollama.com/(下载方式不止一种,直接搜通过网盘下载别人的也行)

直接下载页面:https://ollama.com/download

Windows 安装包直链:https://ollama.com/install/windows

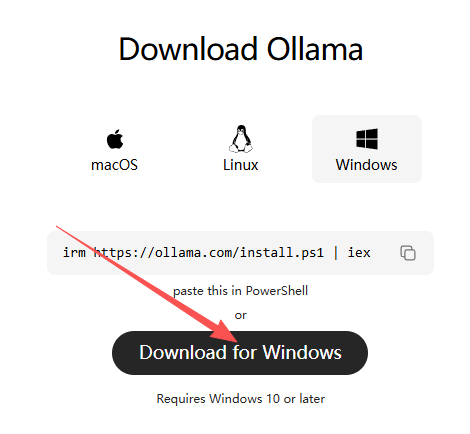

(打开 → 点 Download for Windows,下载 OllamaSetup.exe)

2.根据操作系统,选择要下载的ollama,比如我是Windows,则有:

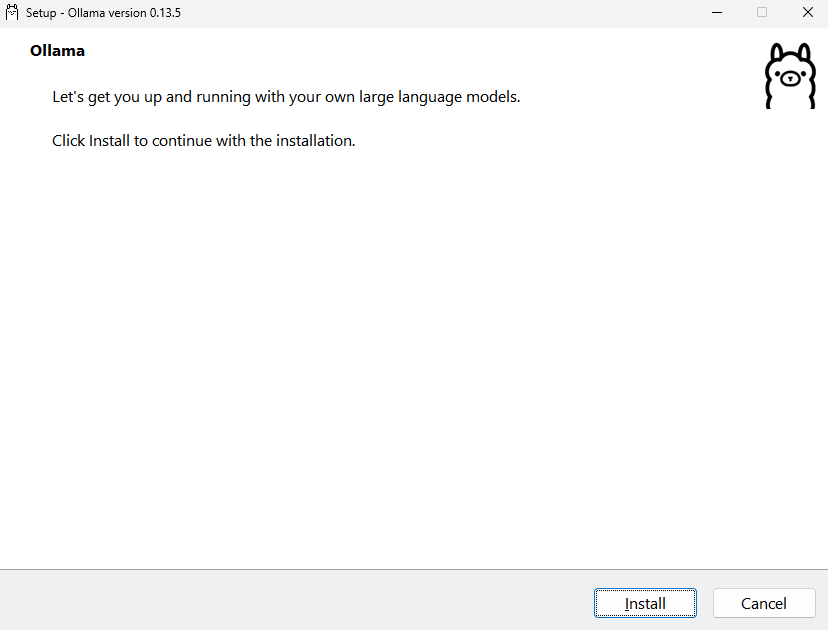

四、Ollama安装步骤(比下载都简单)

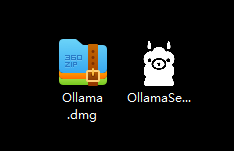

默认用户使用的是windows,如果是linux可以一行指令下载,这里不过做赘述。两个安装包如下,左边的是linux系统下使用的,右边的是windows系统下使用的,win10和win11都有较好的兼容性,没试过其他windows系统。linux指令安装,windows用exe安装包安装:

1.双击右侧小猪图标,install,等待安装完成,千万别cancel(取消)。安装完成后,可以重启一次电脑。

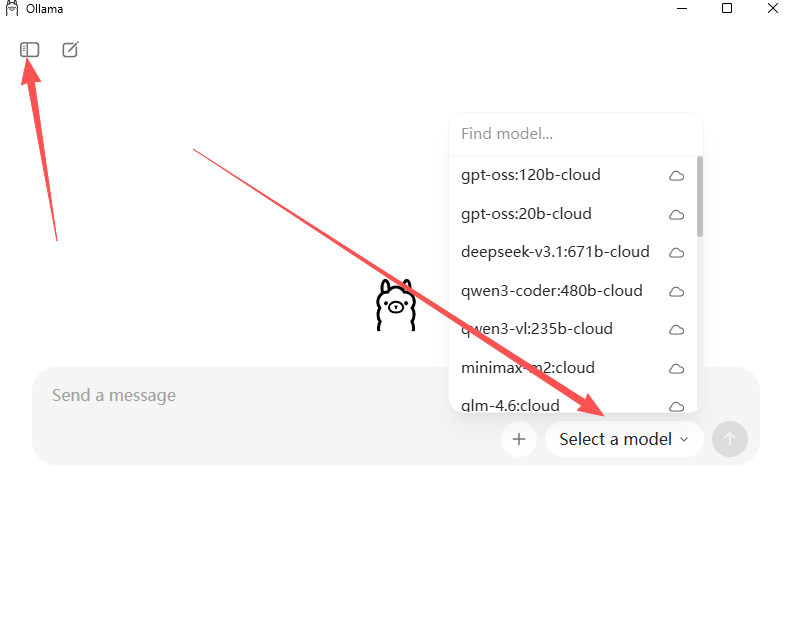

2.右下角可以根据需要调用大模型,左上角可以进行使用设置

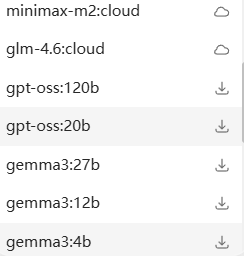

3.需要说明一点:带有cloud标识的,具备云调用能力,即大部分计算工作并不在你本地的电脑上完成,而是在大模型部署地计算,给你传输计算结果(绝大多数都是收费的,而且价格不低);没有这个后缀的,是本地部署大模型,需要下载,绝大部分工作在你自己电脑上完成。14b的本地,一般就是私人电脑的上限。比如我的电脑配置是微星超龙的5080+9950X3D+96G内存,跑18b以内还行,再多就容易崩,可能损伤硬件或加快硬件消耗。

另外,很多大模型需要付费购买才能使用,就像steam平台购买游戏一样。

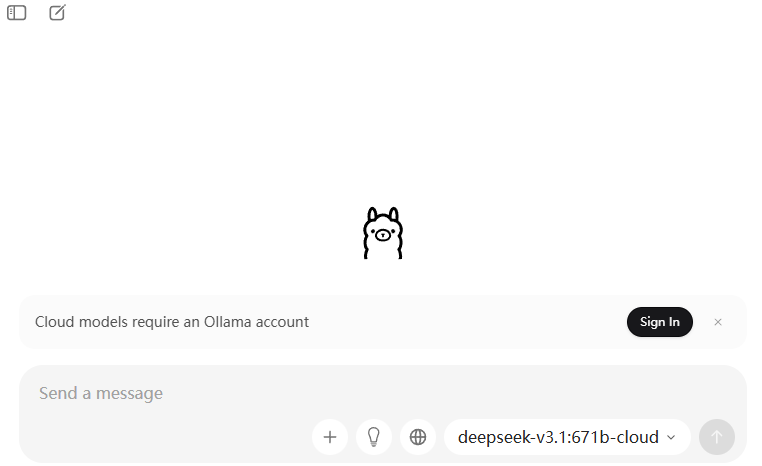

4.选定大模型后,还需要注册和登录,很简单,这里不一一演示

5.值得一提的是,注册需要根据注册地实际号码(不是区号)填写,比如中国大陆地区代码是+86,那么在第一个格子里放+86,第二个各自格子填写自己的手机号。

注册成功后,你上一步填写的邮箱会收到短信提醒:

点击connect,出现下图即可关闭页面,返回Ollma本地进行登录:

选择本地大模型时,要进行下载,默认为Ollma存储的根目录,想卸载时可以找到根目录删除或者回收站卸载。虽然下载速度一般,但稳定性还可以,感觉速度提不上来可以考虑买个加速器(能正常下载的不太有必要)。

本地部署大模型,一般也不需要买token了,全看你自己电脑什么配置,虽然省下了买token的钱,但是使用效果只能说,差太多了。本地还是线上模型选型,只能说见仁见智了。二者都在发展,说不定哪天本地可以部署超牛的大模型(概率不大),或者线上可以使用超低算力达到超高效果的线上大模型,都不一定。到时候我再回来修改这篇博文。

星球:人工智能AIopc花果山

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)