FastGS: Training 3D Gaussian Splatting in 100 Seconds

一、论文信息

论文标题:FastGS: Training 3D Gaussian Splatting in 100 Seconds

作者:Shiwei Ren, Tianci Wen, Yongchun Fang, Biao Lu

单位:Nankai University(南开大学)

发布:arXiv:2511.04283v3,CVPR 2026

核心口号:100 秒训练 3DGS,不丢画质、通用极强

二、论文摘要

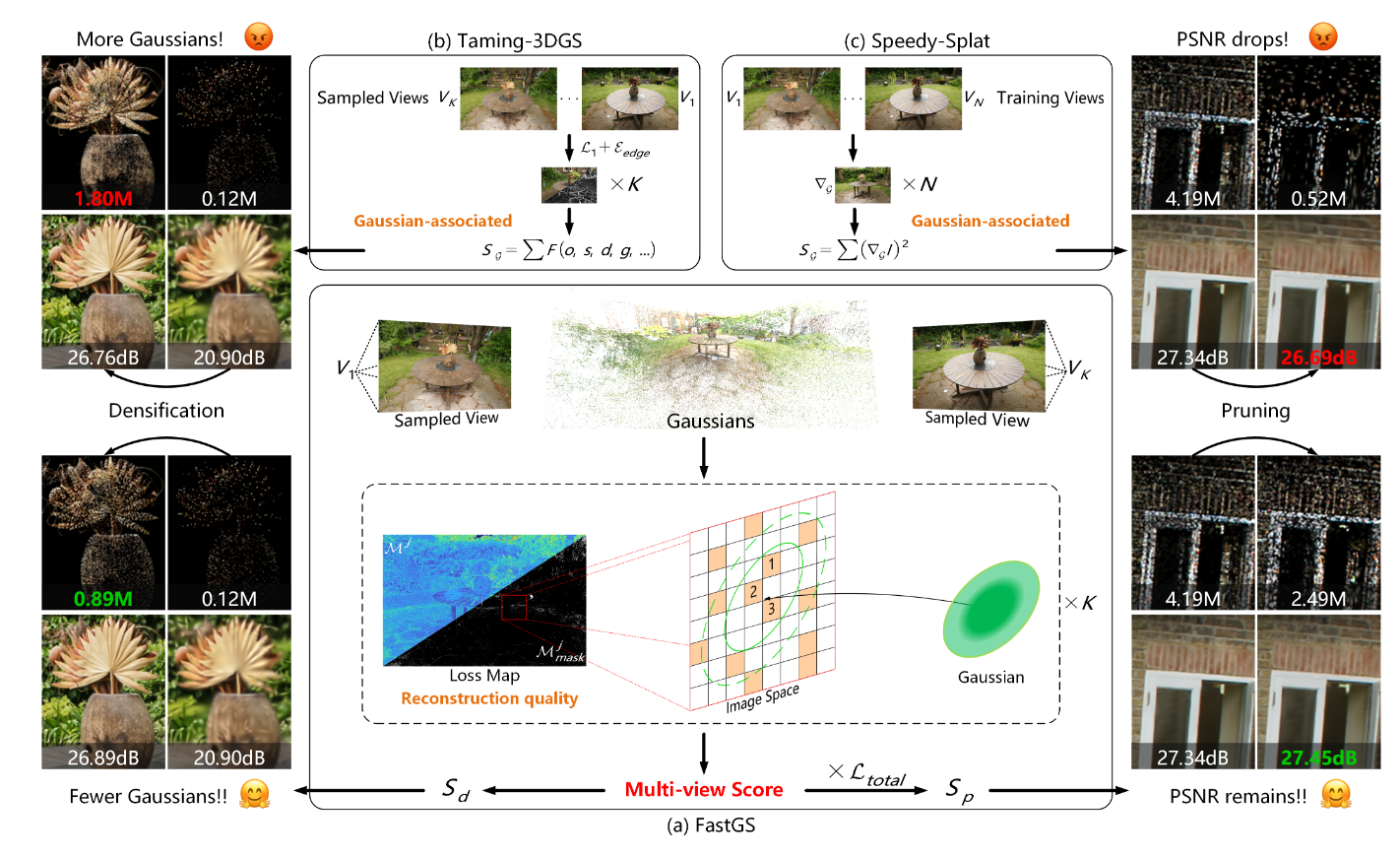

3D 高斯溅射(3DGS)虽然比 NeRF 快很多,但训练依然要十几分钟,瓶颈在冗余高斯太多、密度控制不合理。现有加速方法要么靠 “预算限制”,要么剪枝太狠掉画质,多视角信息用得很粗糙。

本篇文章提出FastGS:一套简单通用的 3DGS 加速框架,基于多视角一致性设计稠密化与剪枝策略,不需要预算机制。在多个数据集上实现3.29×~15.45× 加速,静态场景最快77 秒训完,还能无缝适配动态重建、表面重建、稀疏视角、大场景、SLAM 等任务,实现2–6 倍提速。

三、论文动机

3DGS 训练太慢:单场景动辄十几分钟,不利于 AR/VR、实时建模落地。

冗余高斯泛滥:原自适应密度控制(ADC)只看单视角梯度,生成大量无效高斯。

现有加速不完美:

靠 “高斯预算” 上限控制,依然冗余;

剪枝只看高斯自身属性(不透明度、尺度),多视角利用很弱;

要么速度上不去,要么画质明显下降。

四、论文创新点

4.1 基于多视角一致性的无预算密度控制框架

针对现有 3D 高斯溅射(3DGS)加速方法依赖人工预算机制、高斯增生冗余度高、多视角信息利用不充分等问题,本文提出一种无预算约束、以多视角重建质量为核心的自适应密度控制框架。该框架摒弃传统基于高斯自身属性(不透明度、尺度、梯度等)与人工数量配额的密度调控范式,首次将多视角几何与光度一致性作为高斯增删的唯一判断依据,实现高斯数量的全自动、精细化、全局最优管控。框架无需预设增长预算、无需分阶段调度,从根源上避免冗余高斯增生,同时保证场景关键细节不丢失,为 3DGS 全任务加速提供统一、简洁的技术底座。

4.2 多视角一致性稠密化与剪枝双策略(VCD+VCP)

本文提出一对协同工作的 ** 多视角一致性稠密化(VCD)与多视角一致性剪枝(VCP)** 核心模块,构成精准高效的密度控制闭环。

多视角一致性稠密化(VCD):通过跨视角采样构建逐像素重建误差图,以高斯投影覆盖域内的多视角高误差像素均值作为稠密化依据,仅对多视角一致欠重建区域执行高斯分裂与克隆,杜绝单视角误差带来的无效增生,显著降低高斯冗余。

多视角一致性剪枝(VCP):联合高误差掩码与全局光度损失构建剪枝评分,精准识别并移除对多视角渲染无实质贡献的冗余高斯,在大幅压缩高斯数量的同时保持渲染质量无损。

双策略严格遵循多视角一致性约束,实现 “只增必要高斯、只删冗余高斯”,相较于现有方法具备更高的效率与质量平衡性。

4.3 基于紧凑盒(CB)的光栅化高效加速

为进一步释放渲染性能,本文提出紧凑盒(Compact Box, CB)光栅化优化策略。该方法在 Speedy-Splat 精确瓦片相交基础上,引入马氏距离约束对 2D 高斯有效投影区域进行紧致裁剪,剔除对最终像素贡献可忽略的边缘区域,大幅减少高斯–瓦片配对数量与光栅化计算开销。CB 模块以极小的实现代价,在不降低渲染质量的前提下,进一步提升训练与推理速度,与 VCD–VCP 形成 “密度控制 + 光栅化” 的全链路加速体系。

4.4 通用即插即用的跨任务加速能力

FastGS 具备强通用性、零侵入、即插即用的工程特性,可直接替换任意 3DGS 变体的自适应密度控制(ADC)模块,无需修改主干网络结构、参数化方式与优化目标,无缝适配动态场景重建、表面重建、稀疏视角重建、大尺度场景重建、SLAM 等主流任务。在 Deformable-3DGS、PGSR、DropGaussian、Octree-GS、Photo-SLAM、Mip-Splatting、Scaffold-GS 等经典主干上,FastGS 均实现2–8 倍训练加速,且渲染质量(PSNR/SSIM/LPIPS)保持持平或优于基线,为 3DGS 全生态落地提供统一高效的加速方案。

五、研究方法

FastGS 摒弃了 Taming-3DGS、Speedy-Splat 等传统方法依赖单视角信号或固定预算的弊端,通过构建多视角重建质量感知框架实现无预算的自适应密度控制。其核心流程为:首先随机采样多视角图像,基于渲染与真值图像间的光度误差生成逐视角损失图与高误差掩码;随后将三维高斯投影至图像空间,统计其在跨视角高误差区域的覆盖情况,分别计算稠密化分数 Sd 与剪枝分数 Sp;基于这一多视角一致性分数,仅对跨视角均存在重建缺陷的区域执行高斯分裂 / 克隆,同时精准移除对多视角渲染贡献可忽略的冗余高斯,最终在大幅压缩高斯数量的同时,保持甚至提升场景的重建精度与 PSNR 指标。

5.1 初始化

用 SfM 点云初始化高斯,输入多视角图片。

5. 2 多视角一致性稠密化 VCD

采样若干视角,算渲染图与真值的逐像素 L1 误差。

标出高误差区域掩码。

把高斯投影到 2D,统计它覆盖多少多视角高误差像素。

分数够高才稠密化,避免乱加高斯。

5.3 多视角一致性剪枝 VCP

计算整张图光度损失(L1+SSIM)。

给每个高斯算 “多视角无用度” 分数。

冗余高斯直接删掉,关键高斯全部保留。

5.4 紧凑盒 CB 优化

基于马氏距离缩小 2D 高斯范围,砍掉无效高斯 - 瓦片对,渲染更快。

5.5 训练策略

前 15000 轮:每 500 轮做一次 VCD+VCP。

15000 轮后:降低剪枝频率,稳定高斯数量。

损失函数沿用标准 L1+SSIM。

六、 实验分析

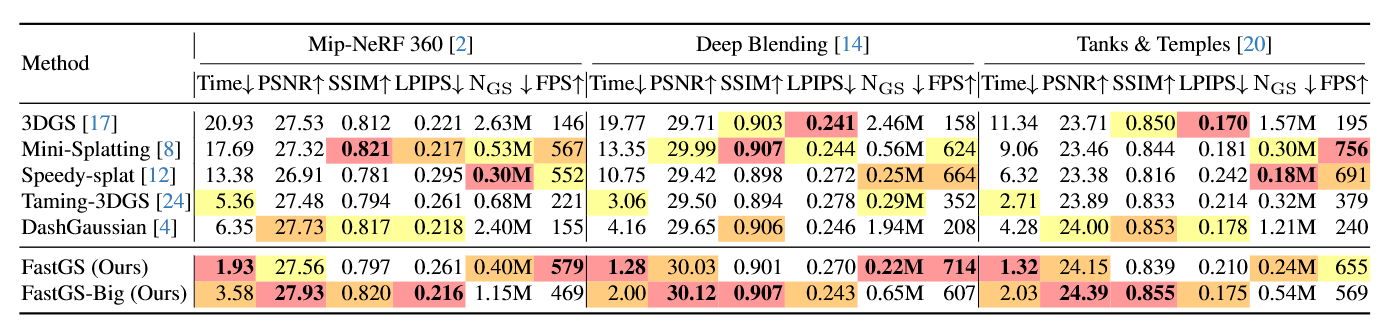

6.1 静态场景(主结果)

Mip-NeRF 360:比 DashGaussian 快3.29×,画质持平。

Deep Blending:比原始 3DGS 快15.45×。

Tanks & Temples:100 秒内训完,PSNR 更高。

高斯数量大幅减少,显存占用更低。

6.2 多任务泛化(最强亮点)

动态重建:平均 2.84× 加速。

表面重建:2.24× 加速。

稀疏视角:2.56× 加速。

大场景:2.19× 加速。

SLAM:2.70×加速。

所有任务画质基本不变。

6.3 消融实验

VCD:训练加速 > 2×,高斯少 80%。

VCP:再加速 25%,高斯再少 26%。

CB:再加速 14%。

三者叠加 = FastGS 全程极速。

七、结论与展望

7.1 结论

FastGS 是一套简单、高效、通用的 3DGS 加速框架:训练时间进入百秒级别;

不靠预算,靠多视角一致性控制高斯;静态、动态、表面、稀疏视角、SLAM 全都能用;速度大幅提升,渲染质量保持 SOTA 水平。

7.2 展望

未来可进一步优化前向推理速度与移动端部署。可与更多 3DGS 变体结合,覆盖更多实时重建场景。有望推动实时 3D 内容生成在 AR/VR、数字人、自动驾驶等领域更快落地。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)