多模态大模型学习笔记(四十)——从“看字”到“懂结构”:版面分析与表格解析技术全解

从“看字”到“懂结构”:版面分析与表格解析技术全解

在数字化转型的今天,我们每天都要处理海量的文档——PDF报告、扫描合同、学术论文、财务报表。传统OCR技术只能将图像中的文字提取为纯文本,但它无法理解“哪里是标题”“哪里是正文”“表格里的数字对应哪个指标”。这就导致提取出的文字杂乱无章,无法直接用于后续的信息抽取、数据分析和自动化处理。

版面分析(Layout Document Analysis, LDA)与表格结构解析技术正是为了解决这个问题而生的。它们让AI从“只会认字”进化到“能懂结构”,将平面无结构的文档图像转化为层次化、结构化的数据,是文档智能领域的核心基础技术。

1. 版面分析(LDA):让AI看懂文档的“排版逻辑”

版面分析是文档智能的第一步,它的核心任务是理解文档页面上内容的组织方式,区分出不同的功能区域,并建立它们之间的逻辑关系。

1.1 版面分析的三大核心步骤

一个完整的版面分析流程通常分为三个递进的阶段,缺一不可:

- 区域分割:这是最基础的物理层面处理。模型需要识别页面上所有独立的物理块,将整个页面切割成文本行、段落、图片、表格、公式等基本元素。就像我们读文章时,会先把页面分成不同的“块”一样。

- 区域分类:在分割出物理块后,需要给每个块打上逻辑标签,确定它的类型——是“Title(标题)”“Text(正文)”“List(列表)”还是“Table(表格)”。这一步让AI知道每个区域的功能是什么。

- 结构解析:这是最关键的逻辑层面处理。模型需要建立各个块之间的阅读顺序和层次关系,比如确定中文文档是“从左到右、从上到下”的阅读流向,识别主标题与副标题的隶属关系,区分正文段落和脚注。

1.2 传统版面分析方法的局限

在LayoutLM系列模型出现之前,版面分析主要依赖传统的计算机视觉方法:

- 对于干净规整的文档(如教科书、标准期刊),常采用投影和分割的方法,通过水平和垂直投影来区分行和列。

- 对于复杂布局的文档,常采用区域聚类和知识规则的方法,根据文本块的大小、位置、字体等特征进行聚类,再结合人工定义的规则进行分类。

这些方法在特定场景下效果尚可,但存在致命的缺点:泛化能力极差。一旦文档布局发生变化,或者出现倾斜、模糊、水印等干扰,传统方法的准确率会急剧下降,而且无法处理复杂的嵌套结构。

2. 为什么通用文档理解模型“搞不定”复杂表格?

LayoutLMv3是目前最流行的通用文档理解模型之一,它在命名实体识别(NER)、关键信息抽取(KIE)等任务上表现出色。但很多人会发现,用LayoutLMv3处理复杂表格时,效果往往不尽如人意。这并不是模型不够好,而是它的设计目标和底层架构天生就不适合做表格结构解析。

2.1 架构局限:一维序列化丢失二维表格关系

LayoutLMv3以Transformer编码器为核心,它会将所有输入(单词、图像块、坐标)都处理成一个一维序列。但表格是典型的二维网格结构,它的信息不仅存在于单元格的文本中,更存在于单元格之间的行和列关系中。

当表格内容被展平成一维文本时,单元格之间的显式行/列关系就完全丢失了。模型无法知道“10.00”这个数字和“Apple”这个商品名在同一行,自然也就无法建立它们之间的对应关系。

2.2 输出目标局限:只能分类,不能建立关系

LayoutLMv3的典型任务是Token分类(序列标注),它输出的是每个词的标签。例如,它可以正确地将“Apple”标记为“商品名称”,将“10.00”标记为“价格”,但它无法输出这两个实体之间的关联关系。

更重要的是,它无法处理跨行、跨列、跨实体的复杂关系。例如,在一个合并了多行的表头表格中,LayoutLMv3无法知道下面的所有数据行都属于这个表头。

2.3 缺乏表格特有的编码:没有行列索引

LayoutLMv3的布局信息是相对的——它只知道“哪个词在哪个位置”,但没有专门为表格设计的结构性编码。它不知道一个token位于表格的第几行、第几列,更无法识别合并单元格和跨行/跨列的复杂表头。

这就导致它在处理包含合并单元格、嵌套表头的复杂表格时,几乎完全失效。

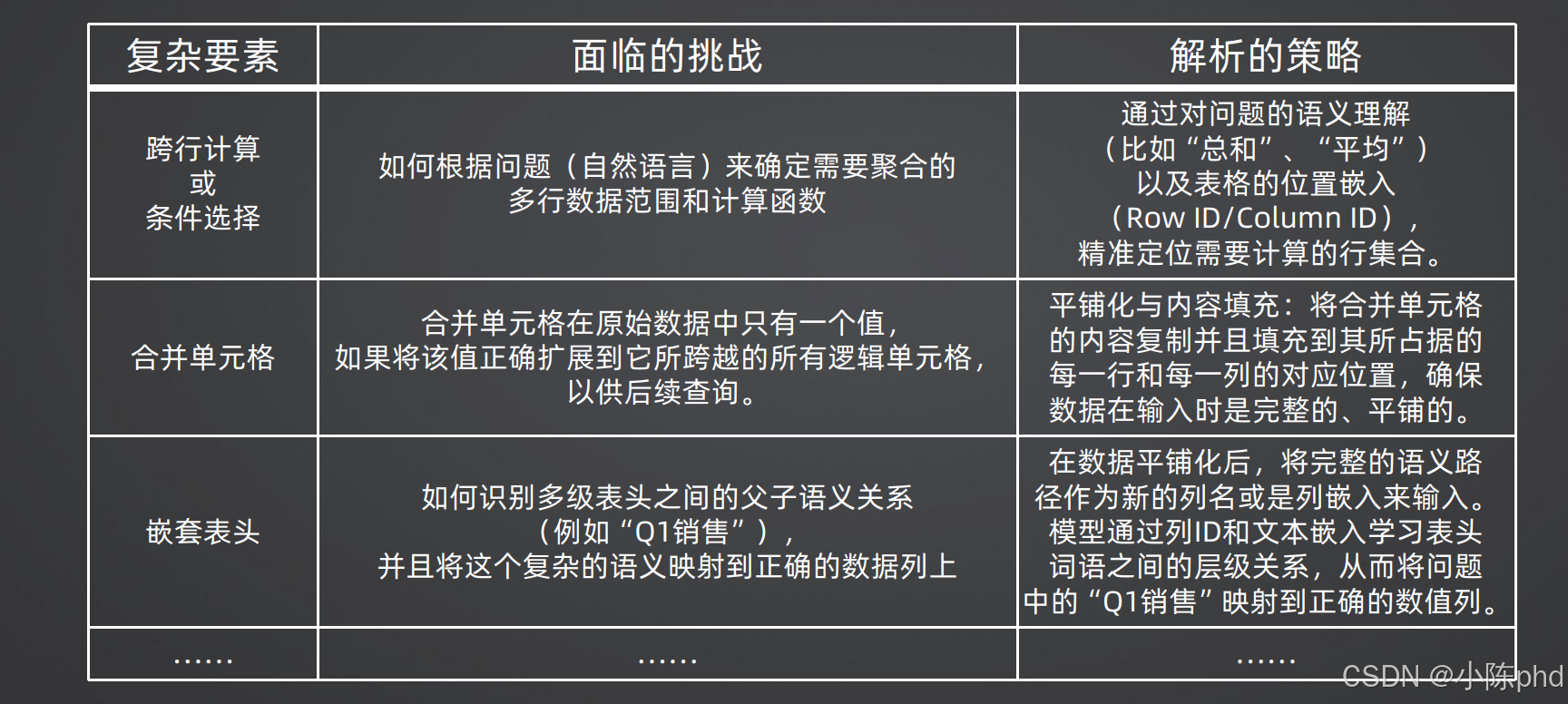

3. 复杂表格解析的三大核心挑战与破解策略

表格是文档中信息密度最高、结构最复杂的元素。一个看似简单的表格,可能包含合并单元格、嵌套表头、跨行计算等多种复杂要素,给解析带来了巨大的挑战。

3.1 跨行计算或条件选择

挑战:当用户用自然语言提问“2024年第一季度的总销售额是多少?”时,模型不仅要找到“销售额”列和“2024年Q1”对应的行,还要理解“总和”这个计算语义,并对多行数据进行聚合。

解析策略:通过对问题的语义理解,识别出需要执行的聚合函数(如总和、平均、最大值),同时结合表格的行ID(Row ID)和列ID(Column ID)嵌入,精准定位需要计算的行集合和列集合,最后执行对应的计算操作。

3.2 合并单元格

挑战:合并单元格在原始数据中只有一个值,但它实际上跨越了多个逻辑单元格。如果不能将这个值正确扩展到它所占据的所有行和列,后续的查询和计算就会出现错误。

解析策略:采用平铺化与内容填充的方法。首先识别出所有合并单元格的边界,然后将合并单元格的内容复制并填充到它所跨越的每一行和每一列的对应位置,确保输入到模型的数据是完整的、平铺的。

3.3 嵌套表头

挑战:很多业务表格会使用多级嵌套表头,例如“2024年”下面分为“Q1”“Q2”“Q3”“Q4”,每个季度下面又分为“销售额”和“利润”。模型需要识别出这些表头之间的父子语义关系,并将复杂的语义映射到正确的数据列上。

解析策略:在数据平铺化后,将完整的语义路径作为新的列名或列嵌入输入模型。例如,将“2024年-Q1-销售额”作为列名。模型通过列ID和文本嵌入学习表头词语之间的层级关系,从而将问题中的“2024年第一季度销售额”正确映射到对应的数值列。

4. 三大主流表格解析模型技术详解

针对表格解析的特殊需求,学术界和工业界提出了多种专门的深度学习模型。其中最具代表性、应用最广泛的是Google的TAPAS、TableFormer以及微软的Table Transformer。

4.1 TAPAS:首个基于BERT的表格问答模型

TAPAS(Table Parser)由Google DeepMind于2020年初提出,是首个基于BERT架构、专门针对表格数据进行自然语言问答和推理的深度学习模型。

TAPAS的核心创新在于多重嵌入机制和聚合预测头:

- 多重嵌入:在BERT的基础上,增加了四种专门的表格嵌入:

- 列ID嵌入(Column ID):标记单元格属于哪一列

- 行ID嵌入(Row ID):标记单元格属于哪一行

- 秩ID嵌入(Rank ID):标记单元格在该列中数值大小的顺序,用于数值推理

- 段ID嵌入(Segment ID):用于区分问题文本和表格内容

- 聚合预测:模型同时输出两个结果:

- 单元格选择:预测哪些单元格是答案的基础

- 聚合操作预测:预测需要对选中的单元格执行哪种聚合函数(如求和、计数、平均)

TAPAS的优势在于它强大的表格推理能力,能够直接回答基于表格的自然语言问题,非常适合智能问答、报表分析等场景。

4.2 TableFormer:专注表格结构识别的Transformer

TableFormer同样由Google提出,它在TAPAS的基础上,将Transformer架构应用于表格结构识别任务,专门解决“表格长什么样”的问题。

TableFormer的核心能力体现在两个方面:

- 精确的元素识别:模型能够精准预测表格中各个结构元素的边界框,包括:

- 表格整体边界(Table Bounding Box)

- 行边界(Row Bounding Box)

- 列边界(Column Bounding Box)

- 单元格边界(Cell Bounding Box)

- 复杂结构解析:它能够有效识别复杂的表格结构,包括:

- 跨越多行或多列的合并单元格

- 表头区域内的多层嵌套表头

TableFormer弥补了TAPAS在表格结构识别上的不足,能够将任意表格图像转化为结构化的HTML或Markdown格式。

4.3 Table Transformer:基于DETR的端到端表格识别

Table Transformer由微软于2021年提出,它基于Meta的DETR(Detection Transformer)目标检测架构,直接从输入图像的像素中预测出表格元素的边界框和类别,是目前开源且最先进的表格结构识别模型之一。

Table Transformer的核心特点:

- 端到端的结构元素预测:模型直接输出表格的四个层级结构元素:表格(作为一个整体)、行、列、单元格。它不需要传统的后处理步骤,如非极大值抑制(NMS),大大简化了 pipeline。

- 强大的复杂表格处理能力:通过精确输出每个单元格的边界框,Table Transformer能够非常有效地识别出跨多行或跨多列的合并单元格,从而准确解析复杂表格的逻辑结构。

Table Transformer是目前工业界应用最广泛的表格识别模型,很多主流的OCR产品(如阿里云OCR、腾讯云OCR)的表格识别功能都基于它或它的改进版本。

5. 表格解析领域常用公开数据集

训练一个高性能的表格解析模型需要大量高质量的标注数据。以下是三个最常用、最权威的公开数据集:

5.1 PubTabNet

- 数据来源:PMC(PubMed Central)开放获取的高质量学术文献截图

- 规模:约56.8万张表格

- 特点:数据来源专业,标注质量高,提供HTML格式的完整结构标注,包含大量复杂的学术表格

- 链接:https://huggingface.co/datasets/ajimeno/PubTabNet/tree/main

5.2 TableBank

- 数据来源:互联网上的Word和LaTeX文档

- 规模:约41.7万张表格

- 特点:数据来源广泛,覆盖了更多样化的表格样式和布局,适合训练泛化能力强的通用表格识别模型

- 链接:https://huggingface.co/datasets/liminghao1630/TableBank/tree/main

5.3 WTQ(Wiki Table Questions)

- 数据来源:维基百科页面中的表格,配合人工标注的自然语言问题

- 特点:经典的表格问答(Table QA)数据集,专门用于评估模型的表格推理能力

- 链接:https://huggingface.co/datasets/stanfordnlp/wikitablequestions/tree/main

6. 总结与未来展望

版面分析与表格结构解析技术,让AI真正具备了理解文档的能力。从传统的投影分割到基于Transformer的深度学习方法,技术的进步使得文档处理的准确率和效率得到了质的飞跃。

目前,表格解析技术已经在金融、法律、医疗、教育等多个行业得到了广泛应用,例如自动提取财务报表数据、解析合同条款、处理医疗病历等。但我们也要看到,对于极度复杂的文档(如手写表格、倾斜严重的扫描件、包含大量嵌套结构的报表),现有技术仍有提升空间。

未来,版面与表格解析技术的发展方向将主要集中在以下几个方面:

- 端到端的多模态融合:将OCR、版面分析、表格解析、信息抽取等多个任务整合到一个统一的模型中,实现“输入一张图,输出结构化数据”的端到端处理。

- 大语言模型(LLM)的深度融合:利用LLM强大的语义理解和推理能力,解决复杂表格的语义理解和逻辑推理问题。

- 少样本和零样本学习:降低模型对标注数据的依赖,让模型能够快速适应新的文档类型和表格样式。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献28条内容

已为社区贡献28条内容

所有评论(0)