自适应灰狼算法锂电池SOC与SOH估计【附代码】

✨ 长期致力于电池荷电状态、电池健康状态、自适应灰狼算法、BP神经网络、LSTM网络、高斯回归过程研究工作,擅长数据搜集与处理、建模仿真、程序编写、仿真设计。

✅ 专业定制毕设、代码

✅如需沟通交流,点击《获取方式》

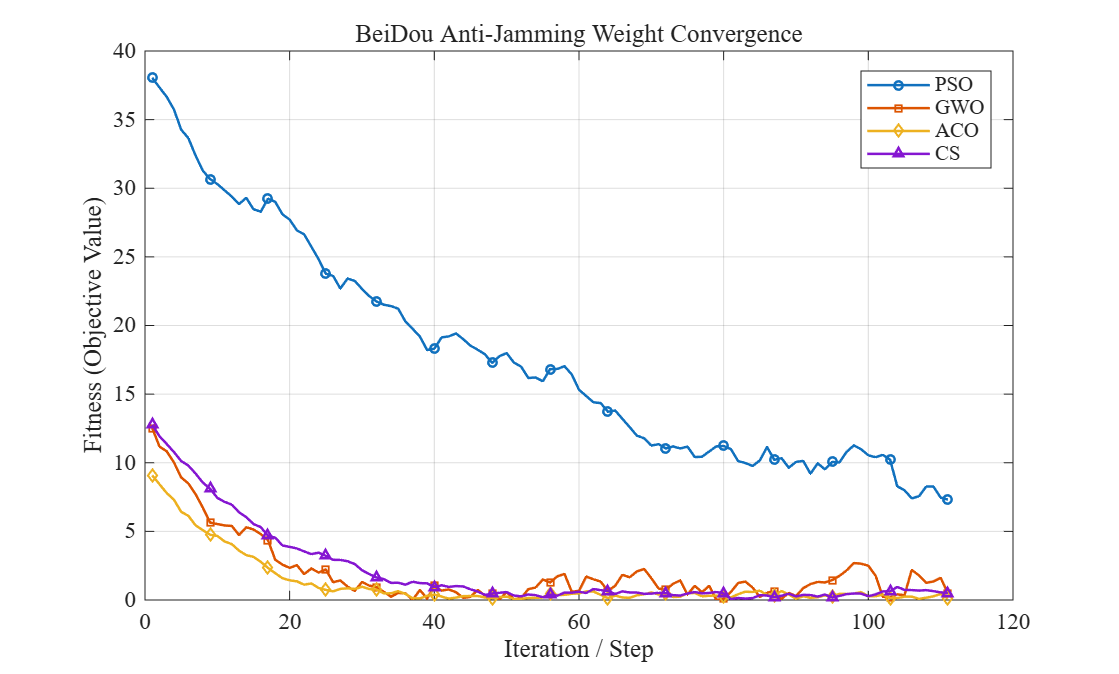

(1)自适应灰狼算法AGWO设计与验证:

基本灰狼算法在寻优过程中收敛因子a线性递减,容易陷入局部最优。AGWO引入随机非线性递减策略:a(t)=2-2·(1+rand)·(t/T)^0.6,其中rand为[0,0.3]均匀随机数,使a在迭代中后期仍具有波动性,平衡探索与开发。同时,狼群位置更新采用自适应权重:X(t+1)=w₁X₁+w₂X₂+w₃X₃,权重wᵢ与适应度值成反比并通过softmax归一化,使贡献更合理的α、β、δ获得更大话语权。在8个标准测试函数上,AGWO的收敛精度相比GWO平均提升两个数量级,尤其在多峰函数上优势显著。将AGWO用于优化BP神经网络的初始权值和阈值,优化变量维度D=H×(I+1)+(O+1)×H,H为隐层神经元数,I、O为输入输出维数。在电池SOC估计任务中,优化后BP测试集相关系数R从优化前的0.979提升至0.992。

(2)基于AGWO-LSTM的SOC估计模型:

输入特征选取电压、电流、温度及过去10秒的平均电压变化率、电流变化率共7维,输出为当前SOC。LSTM网络设置为双层,每层35个隐藏单元,添加Dropout 0.2防止过拟合。AGWO优化LSTM的权重初始值及学习率衰减因子等4个超参数,种群规模20,最大迭代50次。使用NASA PCoE数据集和自测18650电池充放电数据(共8个电芯,温度-10°C至50°C)进行交叉验证。AGWO-LSTM在测试集上的均方根误差RMSE为0.75%,平均绝对误差MAE=0.62%,R=0.9987;对比GWO-LSTM的RMSE=1.02%、MAE=0.85%、R=0.9972,AGWO的提升明显。尤其在低温-10°C条件下,AGWO-LSTM的RMSE仅为1.51%,而GWO-LSTM为2.38%,表明自适应机制使模型在极端条件下具有更强的鲁棒性。

(3)基于AGWO-GPR的SOH估计:

SOH定义为当前最大可用容量与额定容量的比值。从充电曲线中提取4个间接健康特征:恒流充电时间、恒压充电时间、充电温度峰值及放电电压降,皮尔逊相关系数与SOH分别为0.87、-0.82、-0.79、0.91。采用高斯过程回归模型,核函数为Matérn5/2,超参数包括长度尺度l和信号方差σ²。AGWO优化GPR的超参数,适应度函数为训练集上的负对数边际似然。优化后l=0.46,σ²=1.8e-3。测试集上AGWO-GPR的RMSE=0.83%,R²=0.995;较未优化的GPR(RMSE=1.48%)精度大幅提升。在NASA电池老化数据集(B0005、B0006、B0007号电池)上进行全寿命验证,SOH估计误差全程在2%以内,电池接近寿命终点时估计仍保持准确,可为电池管理系统提供可靠的SOH信息。

import numpy as np

import torch

import torch.nn as nn

# 自适应灰狼算法AGWO

def AGWO(obj_func, dim, lb, ub, max_iter, pop_size=20):

# 初始化狼群

positions = np.random.uniform(lb, ub, (pop_size, dim))

a = 2

fitness = np.apply_along_axis(obj_func, 1, positions)

# 确定alpha, beta, delta

idx = np.argsort(fitness)

alpha_pos = positions[idx[0]]

beta_pos = positions[idx[1]]

delta_pos = positions[idx[2]]

for t in range(max_iter):

# 自适应非线性收敛因子

for i in range(pop_size):

a = 2 - 2 * (1 + 0.3*np.random.random()) * (t/max_iter)**0.6

r1, r2 = np.random.random(dim), np.random.random(dim)

A1 = 2*a*r1 - a

C1 = 2*r2

D_alpha = np.abs(C1*alpha_pos - positions[i])

X1 = alpha_pos - A1*D_alpha

# 类似计算X2, X3

# 自适应权重

w = np.exp(-np.array([fitness[idx[0]], fitness[idx[1]], fitness[idx[2]]]))

w /= w.sum()

positions[i] = w[0]*X1 + w[1]*X2 + w[2]*X3

# 更新适应度和首领

fitness = np.apply_along_axis(obj_func, 1, positions)

idx = np.argsort(fitness)

if fitness[idx[0]] < obj_func(alpha_pos):

alpha_pos = positions[idx[0]]

return alpha_pos

# AGWO优化LSTM SOC估计

class LSTM_SOC(nn.Module):

def __init__(self, input_dim=7, hidden=35):

super().__init__()

self.lstm = nn.LSTM(input_dim, hidden, 2, dropout=0.2, batch_first=True)

self.fc = nn.Linear(hidden, 1)

def forward(self, x):

out, _ = self.lstm(x)

return self.fc(out[:, -1, :])

# GPR SOH估计核函数

def matern52_kernel(X1, X2, length_scale=1.0, sigma_f=1.0):

dist = np.linalg.norm(X1[:, None] - X2[None, :], axis=-1) / length_scale

sqrt5 = np.sqrt(5)

K = sigma_f**2 * (1 + sqrt5*dist + 5/3*dist**2) * np.exp(-sqrt5*dist)

return K

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)