告别“模型债”:坤擎智能体企业级 AI 模型管理实战与架构全解

告别“模型债”:坤擎智能体企业级 AI 模型管理实战与架构全解

📅 发表于 2025-12-09 | 🏷️ 人工智能 · AI架构 · 模型管理 · 企业级应用

摘要:当企业内部模型数量激增、API 密钥散落、调试成本失控时,如何破局?本文深度解析「坤擎智能体平台」模型管理模块的四层架构设计,涵盖统一配置管理、智能调试器、推理过程分离、安全加密方案及高并发优化等核心技术,并结合金融风控与客服场景案例,为企业 AI 应用落地提供可参考的工程实践。

引言:AI 时代的“模型债”

在 AI 技术快速发展的今天,企业面临着前所未有的挑战。我们接触过一家中型科技公司,他们的情况颇具代表性:

- 3 个团队使用 5 种不同的大语言模型

- 12 个独立项目中散落着 47 个 API 密钥

- 每月因模型调用失败造成的直接损失超过 5 万元

- 新员工需要 2 周 时间才能熟悉现有的模型调用方式

这正是我们常说的 “模型债”——技术债务在 AI 领域的具体体现。坤擎智能体平台的模型管理模块,正是在这样的背景下应运而生。

💡 阅读提示:本文涉及较多代码示例,建议先收藏,再结合自己的项目场景对照阅读。

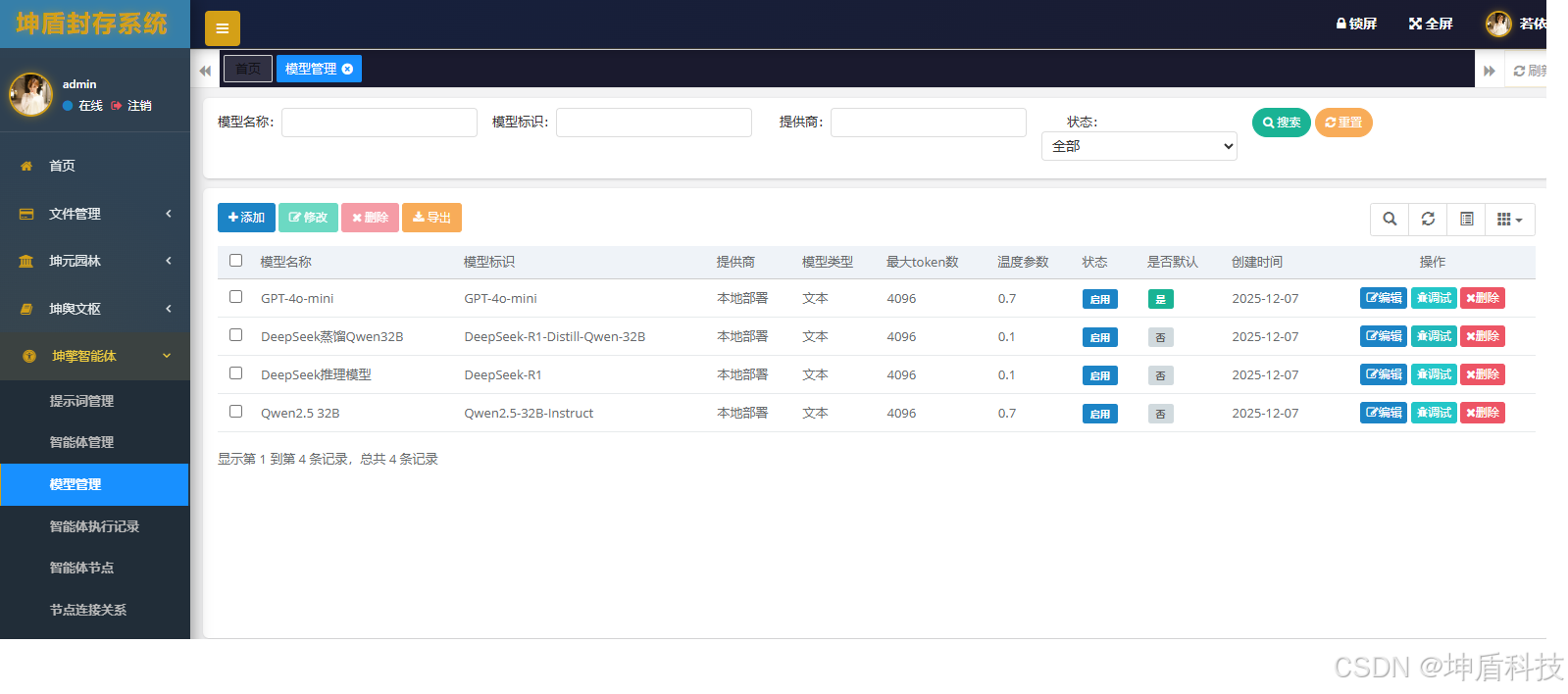

一、模型管理:从混乱到秩序的跨越

1.1 传统模型使用的四大痛点

在坤擎智能体平台开发之初,我们总结了企业使用 AI 模型的四个核心痛点:

| 痛点 | 具体表现 | 影响 |

|---|---|---|

| 配置混乱 | 模型配置信息分散在各个配置文件中 | 维护困难,易出错 |

| 成本失控 | 无法统一监控和管理 API 调用成本 | 预算超支,资源浪费 |

| 调试困难 | 没有统一的调试界面 | 问题排查耗时耗力 |

| 安全风险 | API 密钥以明文形式存储 | 泄漏风险极高 |

1.2 坤擎的解决方案:四层架构设计

坤擎模型管理模块采用创新的四层架构设计:

- 接入层:统一 API 网关,支持多协议适配

- 服务层:模型调度、调试、监控核心逻辑

- 数据层:加密存储、缓存、持久化

- 插件层:可扩展的模型提供商插件体系

🔔 思考:你的团队目前卡在哪一层?欢迎评论区对照。

二、核心技术特性深度解析

2.1 统一的模型配置管理

🎯 解决的问题:告别散落的配置文件,一处管理、全局生效。

我们设计了一套完整的模型配置实体:

@Entity

@Table(name = "ai_model")

public class AiModel {

@Id

@GeneratedValue(strategy = GenerationType.IDENTITY)

private Long id;

@Column(name = "model_name", nullable = false)

private String modelName; // 模型显示名称

@Column(name = "model_alias", unique = true)

private String modelAlias; // 模型技术标识(唯一索引)

@Column(name = "model_endpoint", nullable = false)

private String modelEndpoint; // API 端点

@Column(name = "api_key", length = 1000)

private String apiKey; // 🔐 AES256 加密存储的 API 密钥

@Column(name = "provider")

private String provider; // 提供商(OpenAI / DeepSeek / 公司内部)

@Column(name = "model_type")

private String modelType; // 模型类型分类

@Column(name = "max_tokens")

private Integer maxTokens; // 最大 token 数

@Column(name = "temperature")

private BigDecimal temperature; // 温度参数(控制随机性)

@Column(name = "status")

private Integer status = 1; // 1-启用 0-禁用

@Column(name = "is_default")

private Boolean isDefault = false; // 是否默认模型

}

创新点:

API 密钥 AES256 加密存储,前端仅显示掩码(如 sk-abc1****xy89)

支持多种提供商的统一配置格式

内置模型类型分类,便于筛选和管理

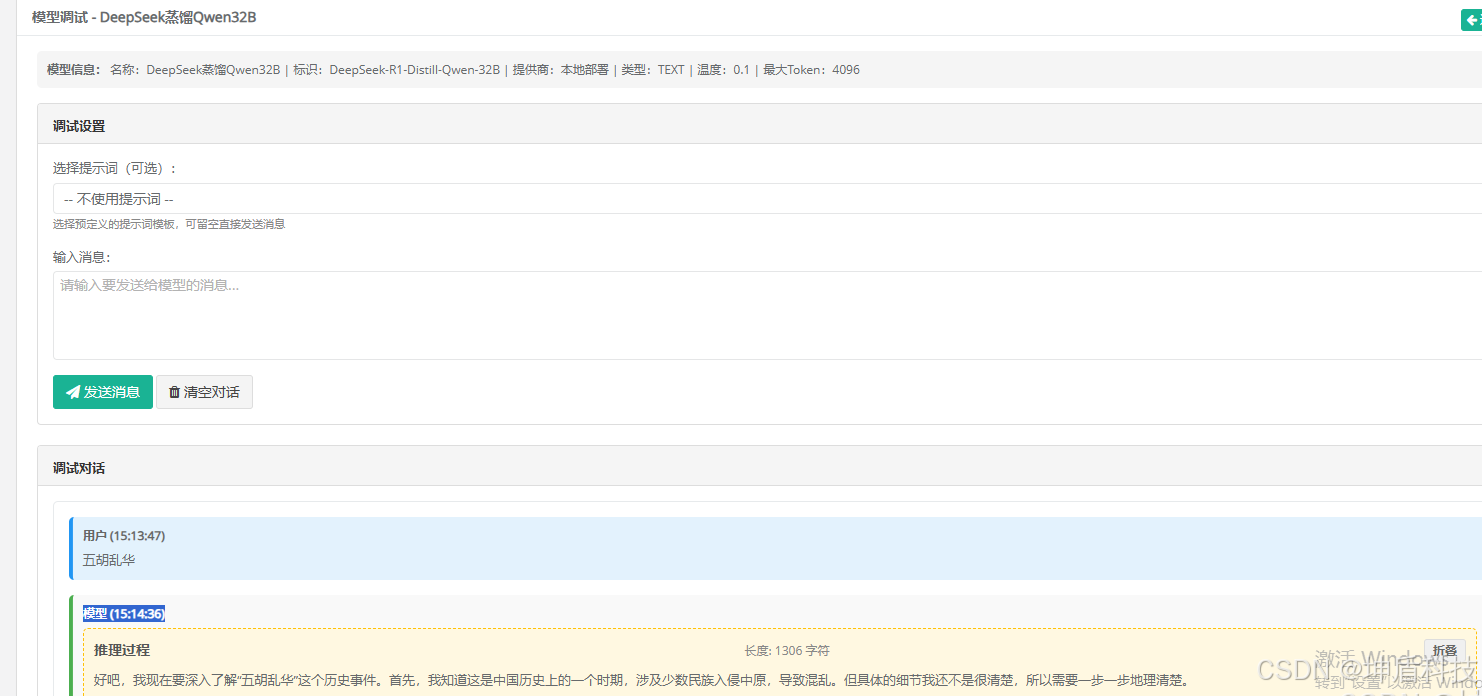

### 2.2 智能模型调试器

### 2.2 智能模型调试器

🎯 解决的问题:告别繁琐的命令行调试,提供可视化交互界面。

@Service

public class ModelInvokeServiceImpl implements IModelInvokeService {

/**

* 统一模型调用接口

* 场景:前端调试器点击"发送"时,后端根据模型配置自动路由到对应提供商

*/

public ModelResponse invokeModel(Long modelId, Long promptId, String userInput) {

// 1. 获取模型配置(含解密后的 API 密钥)

AiModel model = aiModelService.selectAiModelById(modelId);

// 2. 构建最终消息(支持提示词模板变量替换)

String finalMessage = buildFinalMessage(promptId, userInput);

// 3. 根据提供商路由到对应 API

String provider = model.getProvider();

ModelResponse response = switch (provider) {

case "公司内部" -> callInternalModel(model, finalMessage);

case "OpenAI" -> callOpenAIModel(model, finalMessage);

case "DeepSeek" -> callDeepSeekModel(model, finalMessage);

default -> throw new IllegalArgumentException("不支持的提供商: " + provider);

};

// 4. 解析并分离推理过程与最终答案

return parseModelResponse(response);

}

}

核心特性:

实时对话界面:支持多轮对话调试

推理过程可视化:自动分离并展示模型的思考过程(如 DeepSeek-R1 的 CoT)

性能监控:实时显示 token 消耗和响应时间

历史记录:完整保存调试会话,便于回溯分析

2.3 推理过程分离技术

🎯 解决的问题:推理模型(如 DeepSeek-R1、o1)会输出冗长的思考链,业务场景只需要最终答案。

private ModelResponse parseModelResponse(String responseBody) {

JSONObject jsonResponse = JSON.parseObject(responseBody);

JSONArray choices = jsonResponse.getJSONArray("choices");

if (choices != null && !choices.isEmpty()) {

JSONObject message = choices.getJSONObject(0).getJSONObject("message");

String content = message.getString("content");

String reasoningContent = message.getString("reasoning_content");

String reasoning = "";

String answer = "";

if (reasoningContent != null && !reasoningContent.isEmpty()) {

// ✅ 情况1:优先使用 reasoning_content 字段(OpenAI / DeepSeek 标准)

reasoning = reasoningContent;

answer = extractAnswerFromContent(content);

} else if (content.contains("<think>") && content.contains("</think>")) {

// ✅ 情况2:从 <think> 标签提取(DeepSeek 早期格式)

reasoning = extractBetweenTags(content, "<think>", "</think>");

answer = content.replaceAll("(?s)<think>.*?</think>", "").trim();

} else {

// ✅ 情况3:无推理过程,直接作为答案

answer = content;

}

return new ModelResponse(reasoning, answer, content);

}

return null;

}

技术亮点:

支持多种推理格式(reasoning_content 字段、 标签)

智能内容清洗,确保最终答案纯净可用

完整原始内容保留,便于审计和分析

三、安全架构:企业级保护策略

3.1 四级防护体系

层级 措施 说明

传输层 全链路 HTTPS 防中间人攻击

存储层 AES256 加密 API 密钥落盘加密

访问层 RBAC 权限控制 按角色授权模型调用

操作层 完整审计日志 所有操作可追溯

3.2 API 密钥安全管理

@Component

public class ApiKeyEncryptor {

@Value("${encryption.aes.key}")

private String aesKey; // 32 字节密钥(从配置中心拉取)

@Value("${encryption.aes.iv}")

private String aesIv; // 16 字节初始向量

/**

* 加密 API 密钥(入库前调用)

*/

public String encrypt(String plainText) {

Cipher cipher = Cipher.getInstance("AES/CBC/PKCS5Padding");

SecretKeySpec keySpec = new SecretKeySpec(aesKey.getBytes(), "AES");

IvParameterSpec ivSpec = new IvParameterSpec(aesIv.getBytes());

cipher.init(Cipher.ENCRYPT_MODE, keySpec, ivSpec);

byte[] encrypted = cipher.doFinal(plainText.getBytes(StandardCharsets.UTF_8));

return Base64.getEncoder().encodeToString(encrypted);

}

/**

* 生成前端展示用的掩码(如 sk-abc1****xy89)

*/

public String generateMask(String apiKey) {

if (apiKey == null || apiKey.length() <= 8) return "***";

return apiKey.substring(0, 8) + "******" + apiKey.substring(apiKey.length() - 4);

}

}

⚠️ 安全提示:生产环境中,加密密钥应通过密钥管理服务(如 HashiCorp Vault)动态获取,切勿硬编码。

四、可扩展性设计:支持未来无限可能

4.1 插件化模型提供商支持

public interface ModelProviderPlugin {

String getProviderName();

boolean supports(String provider);

ModelResponse callModel(AiModel model, String message);

Map<String, Object> validateConfig(Map<String, Object> config);

}

// 注册中心:启动时自动扫描并注册所有插件实现

@Component

public class ModelPluginRegistry {

private final Map<String, ModelProviderPlugin> plugins = new ConcurrentHashMap<>();

public void registerPlugin(ModelProviderPlugin plugin) {

plugins.put(plugin.getProviderName(), plugin);

log.info("注册模型插件: {}", plugin.getProviderName());

}

public ModelResponse invokeByProvider(String provider, AiModel model, String message) {

ModelProviderPlugin plugin = plugins.get(provider);

if (plugin == null) {

throw new IllegalArgumentException("不支持的模型提供商: " + provider);

}

return plugin.callModel(model, message);

}

}

设计优势:新增模型提供商只需实现接口并注册,无需修改核心代码——对扩展开放,对修改关闭。

4.2 配置驱动的模型管理

{

"model": {

"retry_policy": {

"max_retries": 3,

"backoff_factor": 1.5,

"retryable_errors": ["timeout", "rate_limit"]

},

"fallback_config": {

"enabled": true,

"fallback_model_id": 2,

"conditions": ["timeout", "api_error"]

},

"cost_optimization": {

"strategy": "performance_cost_balance",

"preferred_models": [1, 3],

"budget_limit": 1000

}

}

}

五、性能优化:企业级高并发支持

5.1 多级缓存策略

@Service

@CacheConfig(cacheNames = "modelConfig")

public class AiModelServiceImpl implements IAiModelService {

// L1 缓存:单个模型配置(过期时间 30 分钟)

@Cacheable(key = "'model:' + #id", unless = "#result == null")

public AiModel selectAiModelById(Long id) {

return aiModelMapper.selectAiModelById(id);

}

// L2 缓存:活跃模型列表(过期时间 10 分钟)

@Cacheable(key = "'active_models'")

public List<AiModel> selectActiveModels() {

AiModel query = new AiModel();

query.setStatus(1);

return aiModelMapper.selectAiModelList(query);

}

// 更新时主动淘汰缓存

@CacheEvict(key = "'active_models'")

public int updateAiModel(AiModel aiModel) {

return aiModelMapper.updateAiModel(aiModel);

}

}

5.2 连接池与限流策略

@Configuration

public class ModelInvokeConfig {

@Bean

public RestTemplate modelRestTemplate() {

PoolingHttpClientConnectionManager connectionManager =

new PoolingHttpClientConnectionManager();

connectionManager.setMaxTotal(100); // 最大连接数

connectionManager.setDefaultMaxPerRoute(20); // 单路由最大连接数

RequestConfig requestConfig = RequestConfig.custom()

.setConnectTimeout(30000) // 建立连接超时 30s

.setSocketTimeout(120000) // 读取响应超时 120s(模型推理可能较慢)

.setConnectionRequestTimeout(5000) // 从连接池获取连接超时 5s

.build();

CloseableHttpClient httpClient = HttpClients.custom()

.setConnectionManager(connectionManager)

.setDefaultRequestConfig(requestConfig)

.build();

return new RestTemplate(new HttpComponentsClientHttpRequestFactory(httpClient));

}

}

六、实际应用场景案例

6.1 金融风控场景

某金融机构使用坤擎模型管理模块,实现了:

多模型 A/B 测试:同时测试 GPT-4 和 Claude 在风险识别任务上的表现

智能故障转移:主模型故障时自动切换到备用模型

成本优化:根据任务复杂度自动选择性价比最高的模型

📊 效果:风险识别准确率提升 15%,模型调用成本降低 40%

6.2 客服智能辅助场景

某电商平台利用坤擎的调试功能:

提示词优化:通过实时调试找到最优客服提示词

多轮对话测试:模拟完整客服对话流程

性能对比:对比不同模型在客服场景下的表现

📊 成果:客服问题解决率从 78% 提升到 92%,单次对话成本降低 60%

七、监控与告警体系

7.1 监控指标

类别 指标 用途

性能 响应时间、成功率、token 消耗 服务质量评估

成本 API 调用费用、token 成本 预算控制

业务 模型使用频率、用户满意度 产品决策

健康 服务可用性、错误率、延迟分布 故障预警

7.2 智能告警实现

@Component

public class ModelMonitoringService {

@Scheduled(fixedDelay = 60000) // 每分钟巡检

public void checkModelHealth() {

List<AiModel> activeModels = aiModelService.selectActiveModels();

for (AiModel model : activeModels) {

ModelHealthStatus status = checkSingleModel(model);

if (status.getErrorRate() > 0.1) {

sendAlert("🚨 模型错误率过高",

String.format("模型 %s 错误率达 %.2f%%,建议立即检查",

model.getModelName(), status.getErrorRate() * 100));

}

if (status.getAvgResponseTime() > 30000) {

sendAlert("⚠️ 模型响应过慢",

String.format("模型 %s 平均响应 %.1f 秒,可能需切换备用模型",

model.getModelName(), status.getAvgResponseTime() / 1000.0));

}

}

}

}

八、未来展望

方向 计划 预期价值

智能模型推荐 根据任务类型自动推荐最优模型 降低选型成本

联邦学习支持 分布式模型训练和版本管理 数据不出域,安全合规

模型市场 企业内部分享和交易模型 复用沉淀,避免重复投入

结语

坤擎智能体平台的模型管理模块,不仅是一个技术产品,更是我们对企业 AI 应用未来的一次探索。我们的目标是:

降低 AI 使用门槛:让非技术背景的业务人员也能轻松使用 AI

提升开发效率:让 AI 工程师专注于业务逻辑而非基础设施

控制运营成本:通过智能优化降低 AI 应用的总拥有成本

保障应用安全:为企业 AI 应用提供可靠的安全保障

在这个 AI 技术快速发展的时代,真正的竞争优势不在于拥有多少模型,而在于如何 高效、安全、经济 地使用这些模型。

👍 如果这篇文章对你有启发,请点赞、收藏支持一下!

💬 你的团队遇到过哪些“模型债”问题?欢迎评论区交流,我会一一回复。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)