秒级生图新体验:用 OpenVINO™ 部署 FLUX.2 Klein 实战指南

作者:杨亦诚

引言:当实时图像生成遇见边缘部署

想象一下:只需 4 步推理、不到 5秒的时间,就能从一段文字描述生成一张逼真的 512x512 图片;或者提供一张参考图加上简短的编辑指令,模型即刻理解并输出修改后的结果。这并不是遥不可及的未来——FLUX.2 [klein] 已经做到了。

FLUX.2 [klein] 是 Black Forest Labs(Stable Diffusion 原始团队)发布的最新一代快速图像模型家族。"klein"源自德语"小"的意思,既代表紧凑的模型体积,也意味着极低的推理延迟。本文将带你了解如何借助 Intel® OpenVINO™ 工具套件,将 FLUX.2 Klein 4B 模型部署到 Intel 硬件上,充分释放其实时图像生成与编辑的能力。

一、FLUX.2 Klein:重新定义快速图像生成

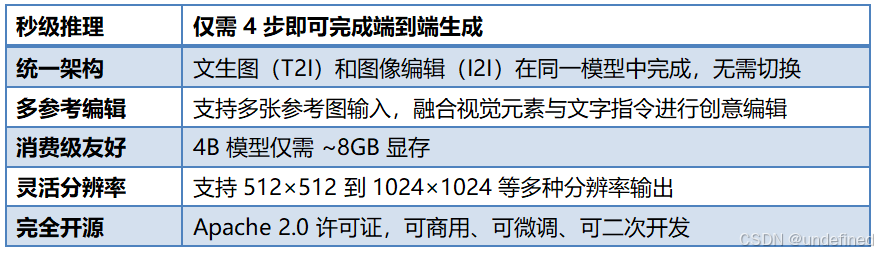

1.1 模型亮点

1.2 模型家族一览

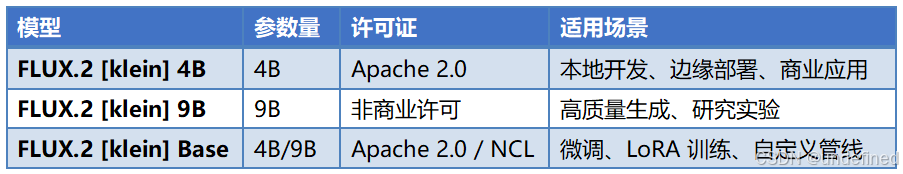

FLUX.2 [klein] 提供多个变体以满足不同场景需求:

1.3 技术架构

FLUX.2 Klein 采用 Rectified Flow Transformer 架构,推理管线由三个核心组件构成:

-

文本编码器(Text Encoder) — 基于 Qwen3 语言模型,从文本提示中提取多层隐藏状态作为条件嵌入

-

变换器(Transformer) — Flux2Transformer2DModel,负责逐步去噪潜在图像表示

-

VAE 解码器 — AutoencoderKLFlux2,在像素空间与潜在空间之间编解码

二、为什么选择 OpenVINO™ 部署?

✅ 跨硬件加速:OpenVINO™ 支持在 Intel CPU、集成显卡(iGPU)、独立显卡(Arc™)及 NPU 上统一部署,一次优化即可跨平台运行。

✅ INT4 权重压缩:通过 NNCF 进行 4-bit 权重量化,大幅降低内存占用和推理延迟,同时保持生成质量。

✅ 生产级推理:OpenVINO™ GenAI API 提供简洁的 Python 接口,内置 KV-cache 优化、动态 batch 等生产级特性。

✅ 无缝集成 Hugging Face:通过 Optimum Intel 一键导出,兼容 Diffusers 生态,迁移成本极低。

三、实战:从模型转换到图像生成

3.1 环境准备

首先安装必要依赖:

pip install -U "openvino>=2026.1" "nncf>=2.15"pip install -U "torch>=2.5" "diffusers" "transformers>=4.48" "gradio>=4.19"pip install "git+https://github.com/openvino-dev-samples/optimum-intel.git@flux.2-klein"

3.2 模型转换与 INT4 压缩

FLUX.2 Klein 的 PyTorch 检查点可通过 Optimum Intel CLI 一键导出为 OpenVINO™ IR 格式,同时应用 INT4 权重压缩以获得最佳性价比:

optimum-cli export openvino \--model black-forest-labs/FLUX.2-klein-4B \--task text-to-image \--weight-format int4 \FLUX.2-klein-4B/INT4

INT4 权重压缩通过 NNCF(Neural Network Compression Framework)实现。它仅压缩模型权重而保留激活值的浮点精度,是大模型推理的推荐优化方式——既显著降低内存占用,又能维持接近原始精度的生成质量。

3.3 加载 OpenVINO™ 管线

转换完成后,使用 Diffusers 的 OpenVINO™ 管线加载模型:

import torchfrom optimum.intel.openvino import OVFlux2KleinPipelinemodel_dir = "FLUX.2-klein-4B/INT4"ov_pipe = OVFlux2KleinPipeline.from_pretrained(model_dir, device="CPU" # 也可选 "GPU" 或 "AUTO")

3.4 文生图(Text-to-Image)

FLUX.2 Klein 蒸馏版仅需 4 步推理,guidance_scale 设为 1.0 即可获得最佳效果:

prompt = "A cat holding a sign that says hello world"result = ov_pipe(prompt=prompt,height=512,width=512,guidance_scale=1.0,num_inference_steps=4,generator=torch.Generator("cpu").manual_seed(0))result.images[0].save("output.png")

▶ 文生图演示视频

3.5 图像编辑(Image Editing)

FLUX.2 Klein 的一大亮点是支持多参考图编辑——你可以传入一张或多张参考图片,配合文字指令引导生成。模型会智能融合参考图中的视觉元素与文字描述,输出编辑后的图像。

from PIL import Image# 加载参考图片ref_image = Image.open("reference.png")result = ov_pipe(prompt="A cat wearing a tiny top hat and bow tie, sitting on a velvet cushion",image=[ref_image],height=512,width=512,guidance_scale=1.0,generator=torch.Generator("cpu").manual_seed(0))result.images[0].save("edited_output.png")

▶ 图像编辑演示视频

3.6 交互式 Gradio 演示

为了获得更直观的体验,可以启动内置的 Gradio Web UI,支持实时调整参数并预览生成效果:

from gradio_helper import make_demodemo = make_demo(ov_pipe)demo.launch()

启动后在浏览器中打开显示的 URL,即可通过可视化界面体验文生图和图像编辑功能,适合快速原型验证和效果展示。

四、应用场景展望

FLUX.2 Klein 与 OpenVINO™ 的结合,为以下场景打开了新的可能性:

-

实时设计工具:设计师可在本地即时预览创意效果,无需等待云端渲染

-

AI Agent 视觉推理:为智能体提供实时图像生成能力,支撑多模态交互

-

边缘端内容创作:在笔记本、工作站等设备上实现低延迟图像生成

-

生产级部署:利用 Apache 2.0 开放许可进行商业化部署,无许可顾虑

-

定制化微调:基于 Base 模型进行 LoRA/全量微调,适配垂直领域需求

五、快速开始

完整的端到端教程已作为 Jupyter Notebook 发布在 OpenVINO™ Notebooks 仓库中:https://github.com/openvinotoolkit/openvino_notebooks/blob/latest/notebooks/flux.2-klein/flux.2-klein.ipynb

只需三步即可体验:

1. 克隆仓库并安装依赖

2. 运行 Notebook 完成模型导出(约 10 分钟,取决于网络速度)

3. 享受实时图像生成!

参考资料

— 本文基于 OpenVINO™ Notebooks 官方教程编写 —

Intel、OpenVINO™ 是 Intel Corporation 的商标。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)