RT-DTER最新创新改进系列:(购买资料的粉丝反馈涨点的TOP1模块)我们将BiFPN的加权双向融合之力,注入RT-DETR的端到端Transformer架构,创新与涨点的双丰收!!!!!!

RT-DTER最新创新改进系列:(购买资料的粉丝反馈涨点的TOP1模块)我们将BiFPN的加权双向融合之力,注入RT-DETR的端到端Transformer架构,创新与涨点的双丰收!!

购买相关资料后畅享一对一答疑!

畅享超多免费持续更新且可大幅度提升文章档次的纯干货工具!

一 、BiFPN网络

BiFPN 的主要思想:高效双向跨尺度连接和加权特征融合。

多尺度特征表示是目标检测的重点方向之一,作者认为其主要困难是如何有效地表示和处理多尺度特征。

早期的检测器通常直接根据从骨干网络中提取的金字塔特征层次结构进行预测 。

特征金字塔网络 (FPN)提出了一种自上而下的途径来组合多尺度特征。

基于FPN,PANet 在 FPN 之上添加了一个额外的自下而上的路径聚合网络;

NAS‑FPN [8]利用神经架构搜索来自动设计特征网络拓扑。虽然实现了更好的性能,但 NAS‑FPN 在搜索过程中需要数千 GPU 小时,并且生成的特征网络是不规则的,因此难以解释。

BiFPN:引入可学习的权重来学习不同输入特征的重要性,同时重复应用自上而下和自下而上的多尺度特征融合.

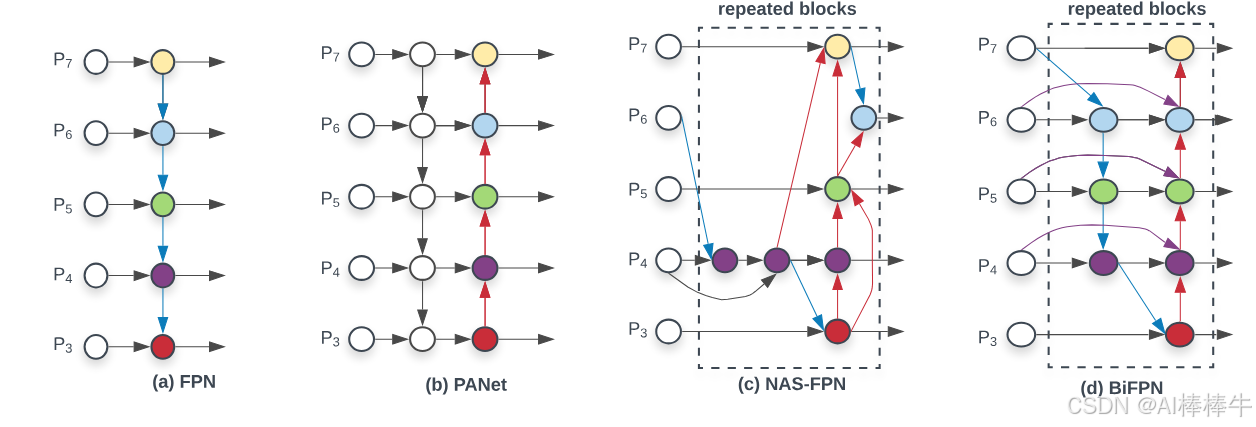

下图表示各类网络模型的结构:

二、亮点

1. 背景与要解决的问题

在目标检测中,处理不同尺度的目标是一个核心挑战。特征金字塔网络 (FPN) 的提出就是为了解决这个问题,它通过融合来自主干网络不同层(拥有不同分辨率和语义信息)的特征来构建一个多尺度的特征金字塔。

然而,传统的FPN及其后续改进(如PANet)存在一些局限性:

- 信息流动单向:FPN只有自顶向下的路径,PANet增加了自底向上的路径,但两者都是简单的“相加”或“拼接”融合,没有考虑不同输入特征的重要性差异。

- 融合方式平等:传统的融合方式(如相加)默认所有输入特征对输出特征的贡献是相等的,这显然不是最优的,因为不同分辨率的特征图包含的信息量和重要性是不同的。

- 节点冗余:PANet等结构引入了较多的节点和连接,增加了计算量,但其中一些节点对最终输出的贡献很小。

BiFPN的核心思想就是:如何更高效、更智能地进行多尺度特征融合。

2. BiFPN 的核心思想

BiFPN从三个方向对之前的FPN结构进行了优化:

-

移除只有一个输入的节点:

如果一个节点只有一个输入边,没有特征融合发生,那么它对融合不同特征贡献很小。移除这些节点可以简化网络,几乎不影响性能。 -

增加一条从原始输入到输出的快捷路径:

在同一尺度上,增加一条额外的边(如下图中的“Extra Edge”),以便在不增加太多成本的情况下融合更多特征。这类似于ResNet中的残差连接,有助于梯度的流动和特征的学习。 -

将PANet的单条自顶向下和自底向上路径视为一个“特征网络层”,并重复这个层多次:

与只能使用一次的FPN/PANet不同,BiFPN被设计为一个可以重复堆叠的模块,从而实现更高级的特征融合。

最重要的创新:加权特征融合

BiFPN并非简单地将不同分辨率的特征图相加或拼接,而是为每个输入引入一个可学习的权重,让网络自己去学习哪些特征更重要。

3. 加权特征融合的两种方式

a) 无界快速归一化融合 (Unbounded Fast Normalized Fusion)

这是BiFPN论文中主要采用的方式。公式如下:

O = ∑ i w i ϵ + ∑ j w j ⋅ I i O = \sum_i \frac{w_i}{\epsilon + \sum_j w_j} \cdot I_i O=i∑ϵ+∑jwjwi⋅Ii

O:输出特征图。I_i:第i个输入特征图。w_i:对应于第i个输入特征图的可学习权重(每个特征图都有一个)。ϵ:一个很小的常数(如0.0001),防止数值不稳定。∑j w_j:对所有参与融合的输入的权重求和。

特点:

- 可学习权重:权重

w_i是通过反向传播学习的,没有限制范围(无界)。 - 归一化:通过除以所有权重的和来实现软归一化,使得最终的融合权重是一个介于0和1之间的值,保证了融合的稳定性。

- 高效:比Softmax更快,因为不需要计算指数。

b) 基于Softmax的融合 (Softmax-based Fusion)

另一种选择是使用Softmax进行归一化,但计算量稍大:

O = ∑ i e w i ∑ j e w j ⋅ I i O = \sum_i \frac{e^{w_i}}{\sum_j e^{w_j}} \cdot I_i O=i∑∑jewjewi⋅Ii

虽然性能也很好,但作者发现前面的快速归一化方法在速度和精度上取得了更好的平衡。

4. BiFPN 的整体结构

解读上图:

- 图 © PANet: 在FPN的基础上,增加了一个自底向上的路径(蓝色箭头)。

- 图 (d) 简化版PANet: 移除了那些只有一个输入的节点(红圈所示),简化了网络。

- 图 (e) BiFPN: 在简化版PANet的基础上:

- 增加了同一层的快捷连接(灰色虚线箭头)。

- 将PANet的双向路径视为一个可重复的块。

- 最关键的是,在所有的特征融合处(每个圆圈),都使用了上述的加权融合方法,而不是简单的相加。

5. 性能与效果

BiFPN作为EfficientDet backbone的核心组成部分,展现了卓越的性能:

- 更高的精度:通过高效的加权双向融合,更充分地利用了多尺度特征。

- 更少的参数量和计算量 (FLOPs):通过移除冗余节点和采用高效的融合方式,在更小的计算开销下实现了更好的性能。

- 可扩展性:作为一个小型模块,可以轻松嵌入到其他网络架构中,并且可以通过堆叠BiFPN的层数(如EfficientDet-D0到D7)或调整主干网络和特征图通道数来权衡精度和速度。

6. 应用与影响

BiFPN不仅用于原论文的EfficientDet,由于其高效性,它已经被广泛采纳和集成到许多现代目标检测模型中,例如:

- YOLO 等版本的某些变体中采用了类似BiFPN的思想。

- 各种轻量级或移动端部署的检测模型,因为它提供了精度和速度的绝佳平衡。

7. 原文链接

- 原文标题: EfficientDet: Scalable and Efficient Object Detection

- 作者: Mingxing Tan, Ruoming Pang, Quoc V. Le

- 会议: CVPR 2020

- 原文链接: arXiv:1911.09070

总结

| 特性 | 描述 |

|---|---|

| 全称 | Weighted Bi-directional Feature Pyramid Network |

| 核心创新 | 1. 加权特征融合:引入可学习权重,让网络自适应学习不同输入特征的重要性。 2. 简化双向网络:移除冗余节点,添加快捷连接,形成高效的双向流动路径。 3. 可重复结构:将BiFPN设计为一个可堆叠的模块。 |

| 关键公式 | 快速归一化融合: O = ∑ i w i ϵ + ∑ j w j ⋅ I i O = \sum_i \frac{w_i}{\epsilon + \sum_j w_j} \cdot I_i O=∑iϵ+∑jwjwi⋅Ii |

| 主要优势 | 在更低的计算成本下,实现了更高的多尺度特征融合效率,从而提升了目标检测的精度。 |

| 经典应用 | EfficientDet 系列模型 |

写在最后

学术因方向、个人实验和写作能力以及具体创新内容的不同而无法做到一通百通,关注UP:Ai学术叫叫兽

在所有B站资料中留下联系方式以便在科研之余为家人们答疑解惑,本up主获得过国奖,发表多篇SCI,擅长目标检测领域,拥有多项竞赛经历,拥有软件著作权,核心期刊等经历。

因为经历过所以更懂小白的痛苦!

因为经历过所以更具有指向性的指导!

祝所有科研工作者都能够在自己的领域上更上一层楼!

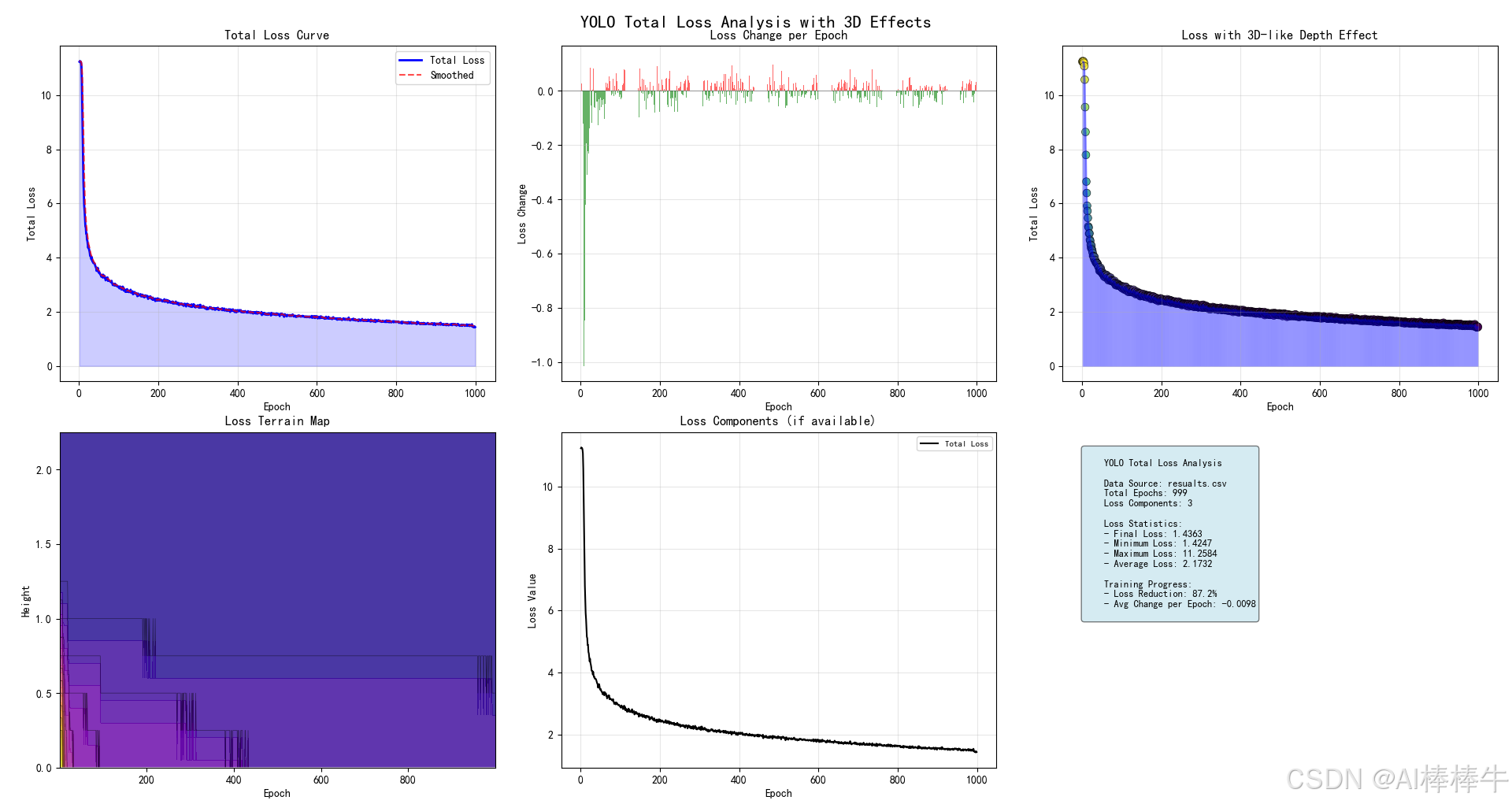

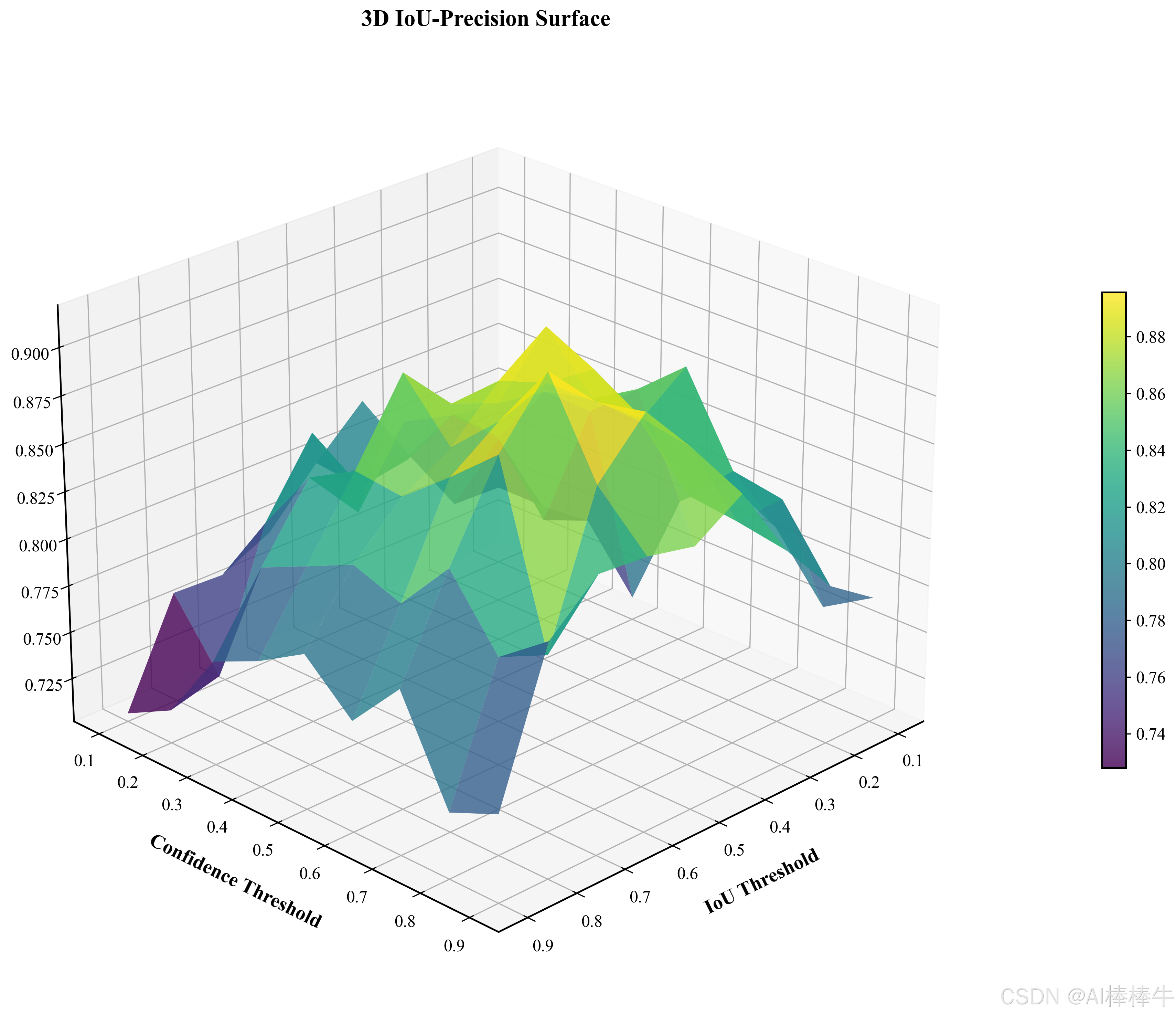

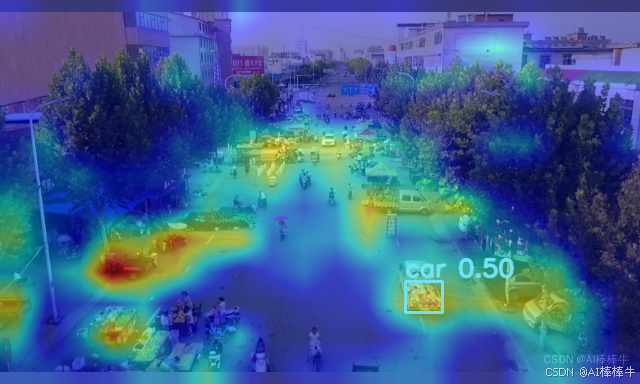

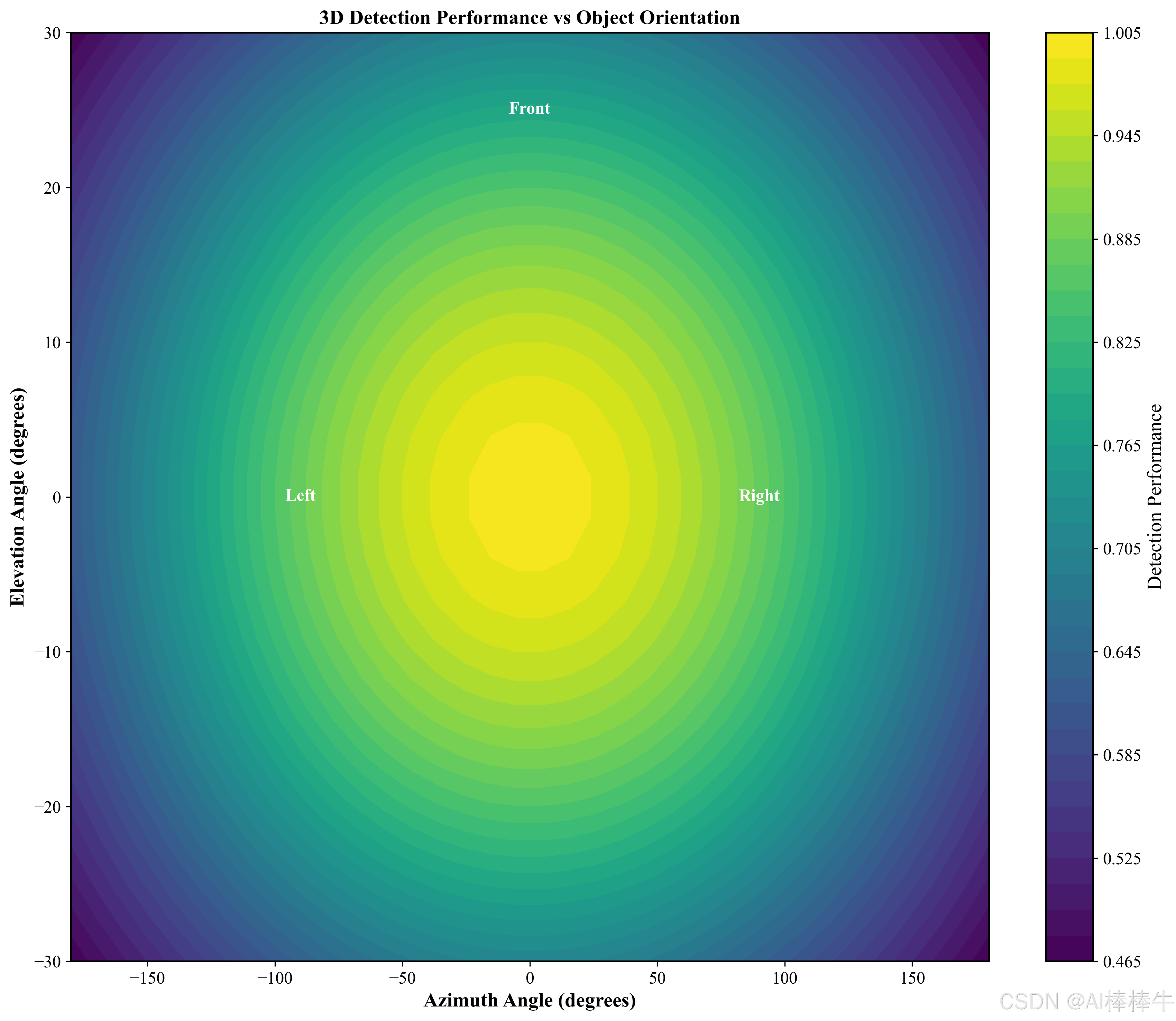

以下为给大家庭小伙伴们免费更新过的绘图代码,均配有详细教程,超小白也可一键操作! 后续更多提升文章档次的资料的更新请大家庭的小伙伴关注UP:Ai学术叫叫兽!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献62条内容

已为社区贡献62条内容

所有评论(0)