Harness Engineering学习总结

个人Harness总结,AI相关其他概念:AI基础学习-基础概念汇总

文章目录

一、基本概念-到底什么是Harness Engineering驾驭工程?

Harness Engineering诞生背景—Agent长程任务痛点与AI 工程范式三次跃迁

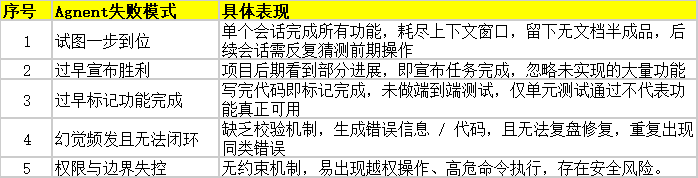

随着Agent能力越来越强,各种失效模式逐渐显现。真正决定它能不能稳定交付、能不能连续跑几个小时不失控、能不能在关键时刻被拉回正轨的,反而不是模型本身,而是你有没有给它一套工程化管理的逻辑,也就是我们讨论的Harness Engineering。

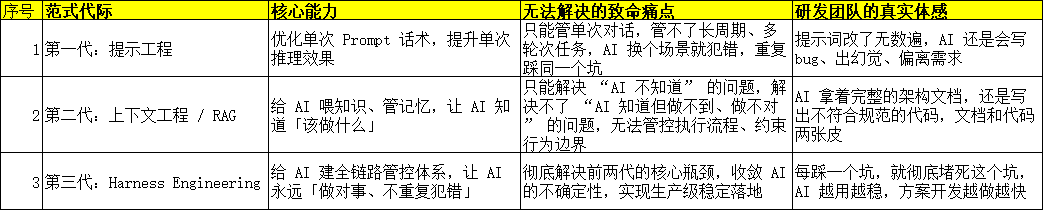

Harness出现之前,AI 研发落地经历了两代范式,都无法解决生产级场景的核心痛点

Harness Engineering正式提出—围绕Agent运行优化系统工程实践

2026 年 2 月,HashiCorp 联合创始人 Mitchell Hashimoto首次正式提出该术语,随后被 OpenAI、LangChain、Anthropic 等头部厂商确立为AI Agent 生产级落地的核心行业标准,形成全行业共识。

Harness Engineering:是围绕 AI Agent设计和构建约束机制、反馈回路、工作流控制和持续改进循环的系统工程实践,它不优化模型本身,而是优化模型运行的环境。由此更新Agent的定义:Agent = Model(大模型,算力核心) + Harness(驾驭体系,工程化核心)

harness engineering is the idea that anytime you find an agent makes a mistake, you take the time to engineer a solution such that the agent will not make that mistake again in the future.—— Mitchell Hashimoto

每当你发现 Agent 犯了一个错误,你就花时间设计一套系统性解决方案,使 Agent 永远不再犯同样的错误,这就是 Harness Engineering 的核心本质。

Harness Engineering核心逻辑—给Agent搭一套工业化生产管控体系

Harness 就是围绕 AI 模型搭建的一整套工作环境和工作流程。你给 AI 写的项目规则文件、配置的各种工具、安排的任务拆分和执行顺序、设计的测试检查流程,这些统统都算 Harness。

管边界: 明确AI能做什么、绝对不能做什么

管流程: 强制AI按标准步骤执行,不能跳步、不能乱发挥

管质量: 每一步都有校验,不达标就自动修复,杜绝幻觉

管迭代: 踩过的坑永远堵死,AI越用越稳,不会重复犯错

Harness 不是什么新技术,它本质上是把我们已有的工程经验,系统地应用到 AI 上。2026 年,AI 工程化的核心竞争,已经从「谁的模型更好」,变成了「谁的 Harness 体系更强」

二、典型案例-Harness Engineering业界典型落地案例

案例 1:HashiCorp 官方 Harness Engineering 落地实践(术语发起方)

1)背景:HashiCorp 用 AI Agent 维护 Terraform、Vault 等全球顶级开源项目,之前核心痛点:AI 生成的代码不符合架构规范、重复犯同样的错误、文档与代码不一致、PR 通过率极低,人工审核成本极高。

2)Harness 核心落地动作:构建了面向 AI 的完整架构规范体系,所有设计文档、API 契约、编码规范全部结构化,纳入代码仓库,和代码实时同步更新;搭建了原子化 Skill 库,封装了 Terraform 开发、测试、文档生成、合规校验的全流程标准化能力;建立了 “错误→规则迭代” 的强制闭环,每一个被打回的 PR,都转化为一条新的硬约束规则,加入 Harness 体系。

3)量化成果:PR 通过率从 21% 提升至 94%,代码开发周期缩短 68%,架构违规率下降 98%,无重复错误出现。

案例 2:LangChain 生产级 Agent Harness 体系落地(AI Agent 领域头部)

1)背景:LangChain 在 Terminal Bench 全球 Agent 性能基准测试中,同一款底层大模型,Agent 性能排名仅 30 名开外,核心痛点:流程失控、工具调用错误、任务拆解混乱、长周期任务完成率极低。

2)Harness 核心落地动作:完全不更换底层大模型,仅优化 Harness 体系:重构了系统提示模板、工具调用约束、流程管控规则、反馈闭环;搭建了标准化 Skill 库,每个工具都明确了调用规范、参数校验、异常处理、结果验证标准;强制了 “Plan-Execute-Verify” 的闭环执行流程,每一步执行后必须验证结果,不通过就自动回溯修复。

3)量化成果:同一款大模型,Agent 性能排名从 30 + 跃升至全球前 5,任务完成率提升 172%,工具调用错误率下降 92%。

案例 3:OpenAI 官方 GPT-4o 代码解释器 Harness 体系(大模型原厂实践)

1)背景:GPT-4o 代码解释器上线初期,用户核心投诉:代码跑不通、文件操作错误、结果不符合要求、幻觉频发,一次运行成功率不足 50%。

2)Harness 核心落地动作:构建了完整的沙箱运行 Harness 环境,给代码解释器定死了权限边界、执行规则、文件操作规范;封装了标准化 Skill 库,覆盖数据处理、文件操作、可视化、代码调试的全流程能力;建立了 “代码生成→静态校验→沙箱运行→结果验证→自动修复” 的强制闭环,代码必须通过校验才能运行,结果不符合要求就自动重写。

3)量化成果:代码一次运行成功率从 47% 提升至 91%,用户满意度提升 83%,文件操作错误率下降 96%。

三、规则总结-Harness Engineering核心策略

1、动态上下文治理策略—活文档 + 按需注入,管好AI的 信息输入

AGENTS.md 告诉 AI 这个项目用什么技术栈、遵循什么代码规范、有哪些禁止事项。以轻量化AGENTS.md(成一个 目录 来用,100 行左右的摘要和索引)为入口构建活文档反馈循环,摒弃超大指令文件(如1000行);采用按需检索、动态注入机制,高效利用稀缺上下文窗口,杜绝信息过载、遗忘与污染。

2、有序任务调度策略—任务拆分 + 状态持久,稳好AI工作流程

丢给 AI 一个大需求,它可能会尝试一把搞定,但 AI 的上下文空间是有限的,可能开发到一半信息就装不下了,前面定好的方案和约束慢慢被冲淡,最后留下一堆跑不起来的渣渣代码。Harness的策略是大任务拆分为小步骤,采用Plan Mode 先规划后执行,支持 SubAgents 并行处理;任务状态外部持久化,每做完一个功能最好都沉淀文档,包括当前实现了哪些功能、用了什么技术方案、还有哪些待做的事项。

3、架构硬约束闭环反馈—自动化规则 + CI 门禁,守好AI行为边界

让 AI 在写完代码之后能自己检查自己的工作。将分层依赖、代码规范、架构边界编码为 Linter/CI 自动化规则,搭建不可绕过的架构护栏;建立自检→自动测试→Agent 互审→自动修复的强闭环,未达标绝不允许提交;

4、系统熵增治理策略—垃圾回收 + 文档维护,维护AI长期稳定

通过定期垃圾回收、文档园丁自动维护、Git 检查点存档,持续小额偿还技术债;防止代码腐烂、文档过时,维持系统长期健康稳定。OpenAI设计的一套垃圾回收的机制:定期让 AI 扫描代码库,检查有没有偏离架构规范的地方,自动提交修复 PR,持续偿还技术债。

参考

Claude Code 泄露后,我终于看懂 Harness engineering了:https://www.bilibili.com/video/BV1RXoFBKESS/

傻子可懂的 Harness Engineering 入门教程:https://www.codefather.cn/post/2048259497427845121

Harness Engineering(驾驭工程):https://www.runoob.com/ai-agent/harness-engineering.html

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)