奖励函数,AI 自己找:Llama-3B 数学推理 F1 提升 19% 的新范式

大型语言模型(LLM)的推理能力,尤其是在数学这类需要严谨逻辑的任务上,一直是衡量其智能水平的关键标尺。为了提升模型的推理表现,研究者们普遍采用强化学习(RL)作为一种有效的“后训练”(post-training)对齐手段。然而,强化学习的成败在很大程度上依赖于一个核心要素:奖励函数(reward function)。这个函数定义了什么是“好”的行为,什么又是“坏”的行为,从而引导模型的优化方向。长期以来,设计一个精妙的奖励函数被认为是一门“玄学”,高度依赖领域专家的直觉和大量试错。一个设计不当的奖励函数,轻则导致模型学习效率低下,重则可能诱发“奖励黑客”(reward hacking)行为——即模型学会了钻规则的空子以获取高分,而非真正掌握解决问题的能力。

ArXiv URL:http://arxiv.org/abs/2605.02073v1

面对这一瓶颈,来自俄克拉荷马大学的研究者们提出了一种颠覆性的思路:既然人工设计奖励函数如此困难,何不让奖励函数本身也成为优化的对象?他们发表的论文《通过搜索驱动的强化学习优化奖励函数以增强 LLM 推理》便系统地阐述了这一构想。其核心贡献在于构建了一个自动化的“搜索驱动框架”,利用一个前沿的大模型(frontier LLM)来生成、验证、筛选并迭代优化奖励函数。研究者将该框架应用于一个 3B 参数量的 Llama-3.2-Instruct 模型,在经典的 GSM8K 小学数学应用题基准上进行了实验。结果令人瞩目:通过该框架发现并组合使用的最优奖励函数,使模型的 F1 分数从基线水平的 0.609 飙升至 0.795,实现了 0.19 的绝对提升。

这项工作真正实现了将奖励函数从固定的“基础设施”转变为一个动态的、可搜索的“程序”。它不仅显著提升了模型的数学推理能力,更重要的是,它为解决强化学习中的核心难题提供了一套兼具高效性、可解释性和普适性的全新范式。

从“结果”到“过程”:奖励设计的两难

在深入探讨这套新框架之前,有必要理解当前 LLM 推理任务中奖励设计的核心困境,即“结果监督”(outcome supervision)与“过程监督”(process supervision)之间的权衡。

结果监督是最直接的方式,它只关心模型输出的最终答案是否正确。例如,在解数学题时,系统只检查最终计算出的数字是否与标准答案一致。这种方法的优点是简单、易于自动化判断,但其弊端也显而易见:它是一个“粗粒度”的信号。模型可能通过错误的推理步骤碰巧得出了正确答案,也可能因为一个微小的计算失误而导致完全正确的推理过程被全盘否定。这种奖励机制无法有效地区分“运气”与“实力”。

过程监督则旨在解决这一问题。它深入到模型的推理“过程”中,对每一步的逻辑、计算和论证进行评估。例如,在“思维链”(Chain-of-Thought)的输出中,奖励模型会判断每一步推导是否合理。理论上,过程监督能提供更丰富、更准确的信用分配,从而引导模型学习到真正可靠的推理能力。然而,其代价是极其高昂的。为推理步骤提供高质量的标注需要大量专家人力,且标注标准本身也很难统一。正如一些研究指出的,过程奖励模型的构建本身就是一个难题,数据合成的选择和标注质量的偏差都可能扭曲对模型真实推理能力的判断。

正是在这种“结果监督太粗,过程监督太贵”的两难境地中,本次介绍的研究找到了一个巧妙的中间地带。它不完全依赖昂贵的过程标注,也不满足于粗糙的结果判断,而是通过自动搜索,让模型自己去发现那些能够有效平衡二者、并与基础奖励信号形成互补的“奖励策略”。

核心框架:一个自我进化的奖励发现循环

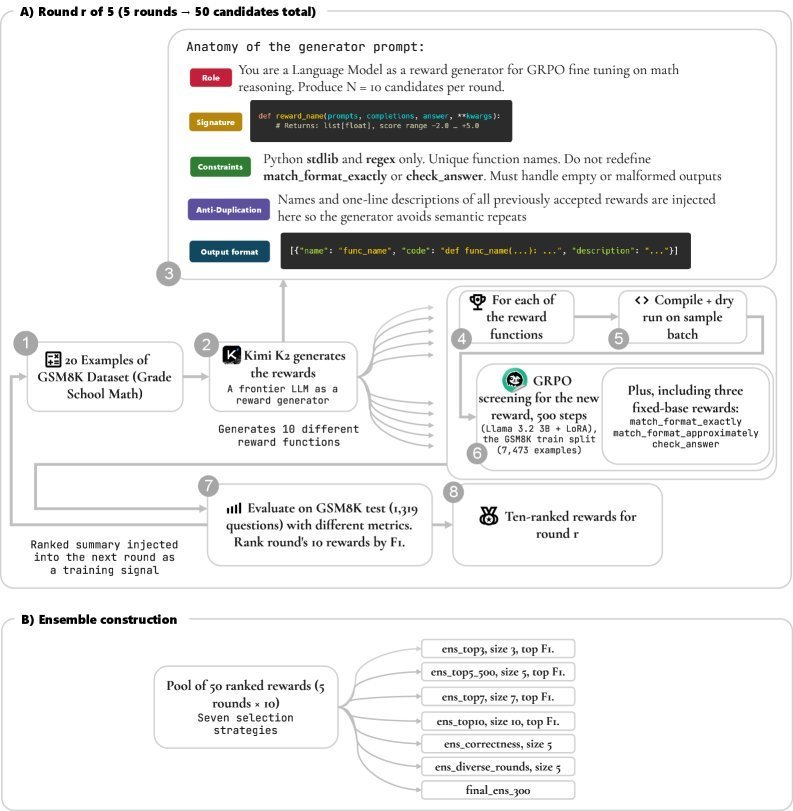

这项研究的核心是一个由生成、验证、训练、排序四个阶段构成的闭环反馈系统。研究者将其应用于一个固定的基础模型(Llama-3.2-3B-Instruct),使得奖励函数成为实验中唯一可变的核心设计杠杆。

上图清晰地展示了整个工作流程。我们可以将其拆解为以下几个关键步骤:

-

奖励生成 (Generation):研究者使用一个强大的“生成器”LLM(论文中选用了 Kimi K2)来编写候选的奖励函数。在提示(prompt)中,他们提供了任务描述、20 个 GSM8K 的问题样本、一个奖励函数的代码范例,并明确了函数必须遵循的接口规范(输入问题、模型输出和标准答案,返回一个浮点数列表作为奖励分数)。此外,还设定了严格的约束,如只能使用标准库、不能覆盖基础奖励函数等。

-

验证与筛选 (Validation & Screening):每个由 AI 生成的 Python 代码都必须通过一个四阶段的“沙箱”验证,确保其不包含恶意代码、能够正常执行并返回预期格式的数据。通过验证的奖励函数会进入筛选阶段。

-

短期训练与评估 (Training & Evaluation):这是整个循环中最具创新性的部分。每一个候选奖励函数都会被用于一次独立的、短暂的强化学习训练。具体来说,研究者使用 GRPO (Group Relative Policy Optimization) 算法,配合 LoRA (Low-Rank Adaptation) 技术,在 GSM8K 训练集上对基础模型进行 500 个 step 的微调。GRPO 是一种内存效率极高的 RL 算法,它通过对一组样本的奖励进行归一化来代替传统的 Critic 网络,非常适合在有限的硬件资源上进行快速迭代。LoRA 则保证了每次训练只更新极少部分参数,使得不同奖励函数之间的训练互不干扰,避免了“学习行为泄露”。训练完成后,模型在 GSM8K 测试集上进行评估,其 F1 分数成为衡量该奖励函数优劣的关键指标。

-

排序与反馈 (Ranking & Feedback):在一轮(例如,生成 10 个)奖励函数的评估全部结束后,系统会根据 F1 分数对它们进行排名。一份包含排名、分数和函数描述的摘要,会作为“反馈信号”被注入到下一轮奖励生成的提示中。这个简单的机制起到了关键的“选择压力”作用:它含蓄地告诉生成器 LLM,哪些类型的奖励函数在上轮中表现出色,哪些则效果不佳,从而引导它在后续生成中探索更有希望的方向。

经过五轮迭代,该系统总共生成并评估了 50 个不同的奖励函数。这个过程本身就是一次关于“如何奖励数学推理”的元级别(meta-level)探索。

实验解读:搜索不仅有效,而且很聪明

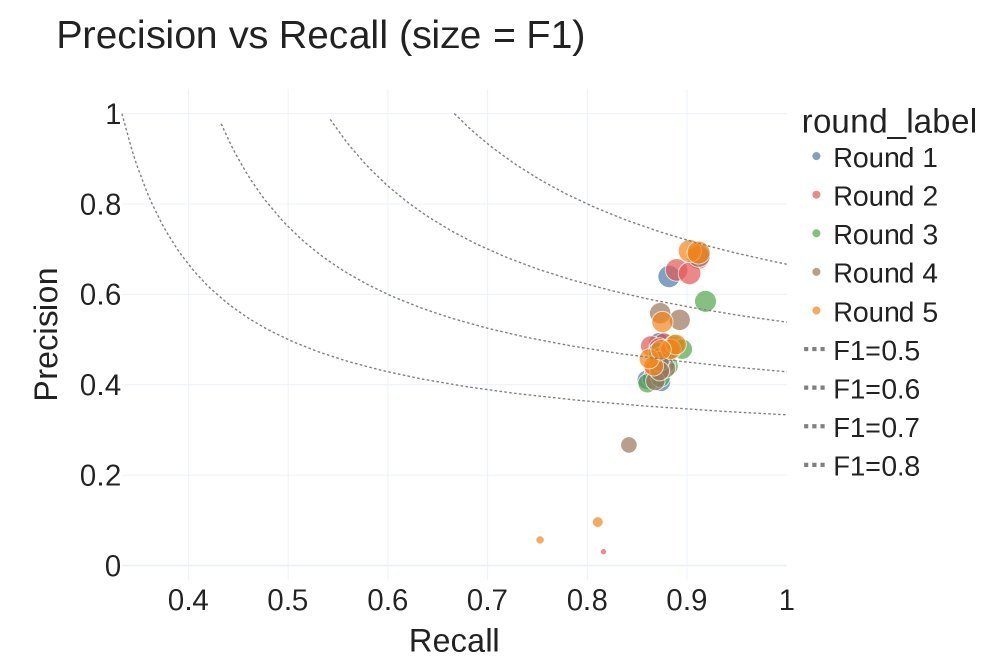

这项研究的价值最终要通过实验结果来证明。数据显示,这个自动化搜索框架不仅成功地找到了有效的奖励函数,其发现的策略还颇具“智慧”。

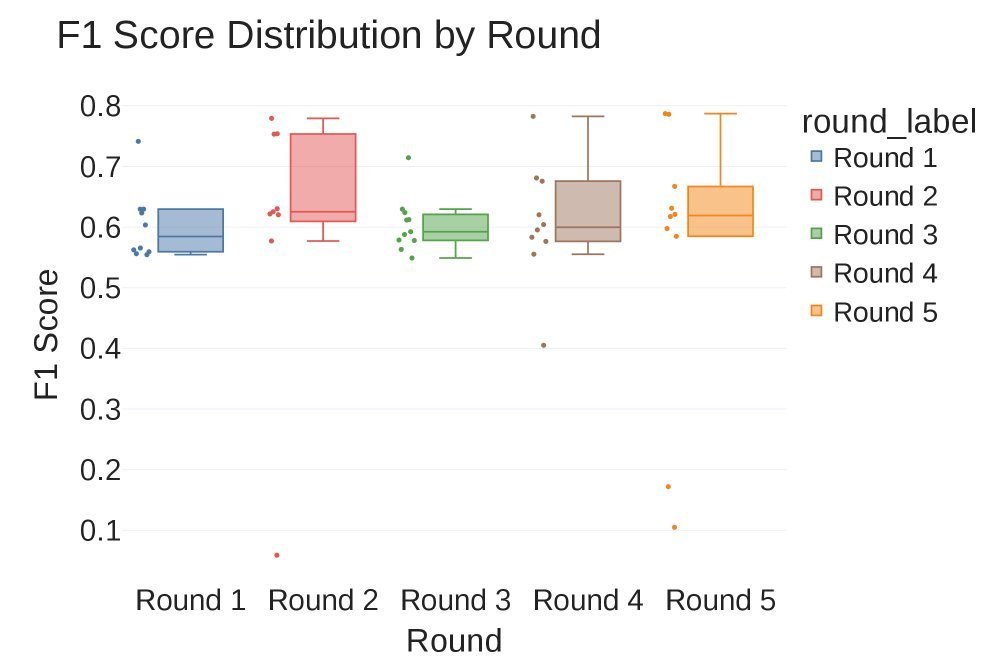

搜索轨迹:稳步提升的奖励质量

从上图可以看出,随着搜索轮次的推进,生成的奖励函数的平均质量在稳步提升。第一轮生成的奖励函数平均 F1 分数为 0.596,而到了第五轮,这个数字增长到了 0.632。虽然过程并非完全单调(第三轮略有下降,可能反映了搜索过程中的“探索”阶段),但总体趋势清晰地表明,基于排名的反馈循环确实在引导生成器产出越来越好的奖励策略。

顶级奖励的共性:关注“推理过程”

分析表现最好的几个奖励函数,可以发现一个有趣的模式。排名前五的单个奖励函数分别是:thinking_steps_count(计算思维过程的步骤数)、thinking_has_calc(检测思维过程中是否包含计算)、numeric_reasoning_depth(评估数值推理的深度)、step_by_step_accuracy(逐步准确性)和 reasoning_completeness(推理完整性)。

其中,表现最好的 thinking_steps_count 的代码逻辑异常简洁:它仅仅是计算模型在 <thinking> 标签内输出的非空行数,行数越多,奖励越高。

# Listing 1: Top-ranked individual reward function

def thinking_steps_count(prompt: str, completion: str, answer: str) -> list[float]:

thinking_content = extract_thinking(completion)

if not thinking_content:

return [-1.0]

steps = [line for line in thinking_content.strip().split('\n') if line.strip()]

if len(steps) >= 3:

return [+3.0]

elif len(steps) == 2:

return [+2.0]

elif len(steps) == 1:

return [+1.0]

return [0.0]

这揭示了一个深刻的洞察:最好的新奖励并非简单地重复检查最终答案的正确性。研究中始终保留了三个“基础奖励函数”,它们已经负责了格式检查和最终答案核对。因此,搜索算法发现,最有价值的补充信号来自于对“推理过程”的结构化评估。像步骤数量、计算密度这类“过程指标”,虽然本身不直接保证答案正确,但它们鼓励模型生成更详尽、更结构化的推理链,从而为基础的“结果正确性”奖励提供了更好的“原材料”。这恰好与前面提到的“过程监督”思想不谋而合,但实现方式却简单得多。

集成力量:1+1 > 2

单个奖励函数已经表现不俗,但将多个顶级的奖励函数组合成一个“集成奖励”(Ensemble Reward)时,效果更上一层楼。研究者测试了多种组合策略,最佳的集成配置(包含 3 个基础奖励和多个发现的顶级奖励)取得了 0.795 的 F1 分数和 0.660 的准确率。相比于只使用 3 个基础奖励的基线模型(F1 为 0.609),这代表了 0.19 的绝对 F1 增益,提升幅度巨大。

为了证明这一提升确实来源于“搜索”而非简单地“堆砌”奖励,研究者还进行了一项关键的对照实验:他们随机抽取了 5 个生成的奖励函数进行集成。结果,模型的性能急剧崩溃,F1 分数仅为 0.047。这个结果有力地证明了,是那个基于性能排名的、智能的反馈与选择循环在起作用,而不是简单地增加奖励信号的数量。

意义与启示:通往自动化对齐的新路径

这项研究的意义超越了单纯的性能提升,它为我们思考和实践 LLM 对齐提供了几个重要的启示:

首先,它显著降低了高级强化学习应用的门槛。整个奖励搜索过程在一块消费级 GPU(NVIDIA RTX 5090)上大约 40 小时即可完成。这意味着,即便是算力有限的学术机构或小型团队,也有能力去探索和优化复杂的奖励机制,从而将 RL 的潜力应用到自己的模型和任务中。

其次,它在自动化和可解释性之间取得了理想的平衡。与训练一个庞大而难以理解的“黑箱”奖励模型不同,该框架的产出是一系列人类可读的 Python 代码。研究者可以轻松地审查、分析甚至修改这些由 AI 生成的奖励函数,理解它们的工作原理,并将其与自己的领域知识相结合。这种“白箱”特性对于构建可信、可靠的 AI 系统至关重要。

最后,它提出了一种更广阔的范式。这项工作将奖励函数从一个需要人类专家预先定义的“超参数”,转变为一个可以在训练循环中被共同优化的“动态组件”。这种“将目标本身作为优化对象”的思想,可以被广泛迁移到数学推理之外的其他领域,如代码生成、科学发现、甚至更开放的对话系统。只要一个任务的“好坏”难以被简单规则定义,这套搜索驱动的框架就可能派上用场。

总而言之,这篇论文不仅仅是又一个在基准测试上取得新高的技术报告。它通过一个精巧而高效的工程实现,直面了强化学习在 LLM 应用中的核心痛点,并给出了一份极具启发性的答卷。它告诉我们,在通往更强推理能力的道路上,教会模型“如何评价”可能与教会模型“如何做事”同等重要。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)