全文 - Fast and accurate AI-based pre-decoders for surface codes -- Ising decoding

表面码的快速精确AI预解码器

摘要

快速、可扩展的解码架构,能够在空间和时间上以块级并行方式运行,对于实时容错量子计算至关重要。我们为表面码引入了一种可扩展的基于AI的预解码器,它以低解码运行时间执行局部、并行纠错,在将残余综合征传递给下游全局解码器之前去除大部分物理错误。这种模块化架构与后端无关,可与为表面码设计的任意全局解码算法组合,且我们的实现完全开源。与无关联PyMatching集成后,该流水线在NVIDIA GB300 GPU上于大码距处实现了每轮 O ( 1 μ s ) \mathcal{O}(1\mu s) O(1μs) 量级的端到端解码运行时间,同时相对于单独全局解码降低了逻辑错误率(LER)。在可访问多个GPU的块级并行解码方案中,解码运行时间可降低至远低于 O ( 1 μ s ) \mathcal{O}(1\mu s) O(1μs) 每轮。通过训练更大的模型,我们观察到进一步的LER改进,在码距13以内优于关联PyMatching。此外,我们引入了一种噪声学习架构,可直接从实验可获取的综合征统计信息中推断解码权重,无需显式的电路级噪声模型。我们表明,纯粹数据驱动的图权重估计在某些情况下几乎可以匹配无关联PyMatching并超越关联PyMatching,当硬件噪声模型未知或时变时,以及使用真实噪声模型训练预解码器时,能够实现高度优化的解码。总之,这些结果建立了一个实用、模块化、高吞吐量的解码框架,适用于大码距表面码实现。

代码: GitHub

模型: Hugging Face

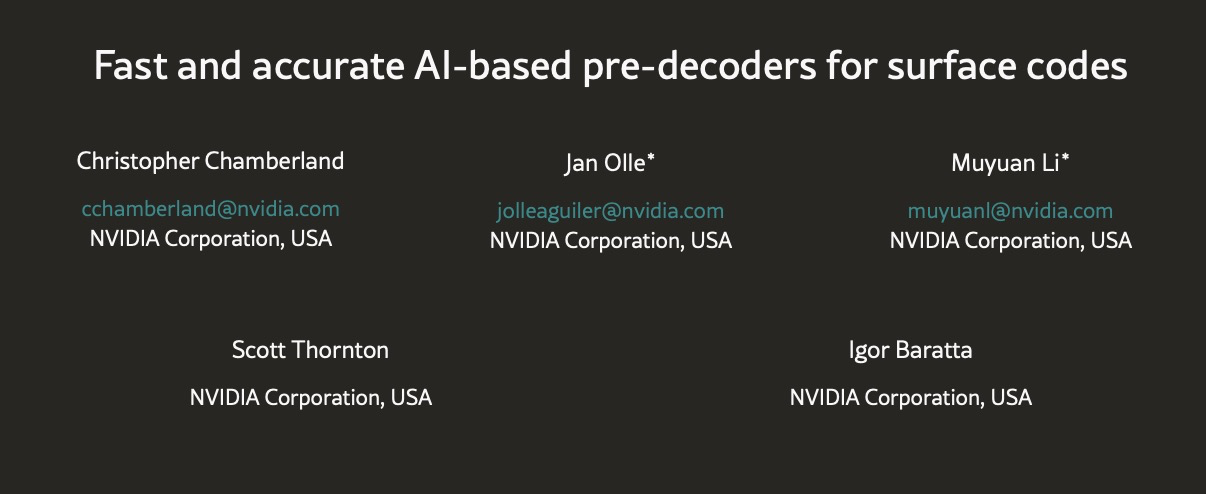

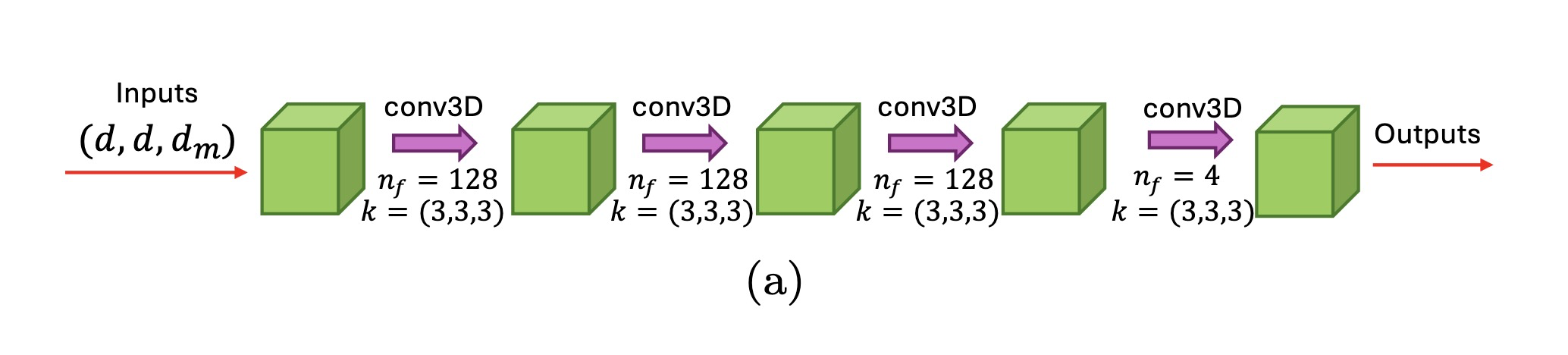

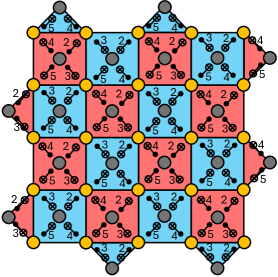

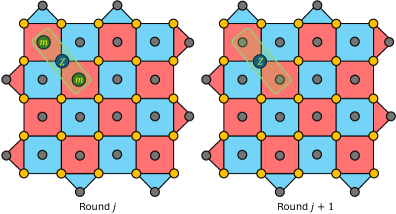

Figure 1: Example showing the syndrome density being reduced by the pre-decoder for both X X X-type and Z Z Z-type stabilizers. The residual syndromes are passed on to a global decoder to perform final corrections.

I. 引言

量子纠错(QEC)是构建大规模容错量子计算机(FTQC)的根本要求。QEC解码器是经典算法,用于从综合征测量数据推断物理错误——或等价地,逻辑可观测量的值——以及在某些方案中,还利用附加信息如标记量子比特(flag-qubit)结果。

如参考文献所示,解码器运行时间必须足够高,以防止在执行量子算法期间未处理综合征数据的指数级积压。在下文中,运行时间将指代解码器处理一块综合征测量轮次所需的时间。对于许多硬件平台,滑动窗口解码对每轮综合征测量施加了 O ( 1 μ s ) \mathcal{O}(1\mu s) O(1μs) 量级的运行时间要求,这是当前最先进经典硬件难以达到的 regime。

并行块级解码架构可以通过并发解码提交(commit)和清理(cleanup)窗口来部分缓解这一约束,前提是提供足够的经典资源。然而,即使在此并行化设置中,量子算法的运行时间仍然根本上受限于解码一块 d m d_m dm 轮综合征测量所需的时间,即使 d m ≪ d d_m \ll d dm≪d。因此,在块级别最小化解码运行时间对于可扩展FTQC至关重要。

已提出了多种基于AI的QEC解码器,旨在实现低解码运行时间和改进的逻辑错误率(LER)。然而,许多此类方法遇到了可扩展性挑战,包括随着码距增加所需训练数据量的增长,以及它们在时间和空间上与并行块级解码架构的兼容性。空间并行性对于基于晶格手术的容错逻辑操作尤为关键,其中合并的码片可能具有有效码距 d eff ≫ 100 d_{\text{eff}} \gg 100 deff≫100。在此regime下,满足实时解码要求可能需要跨大码片的空间并行块级解码。因此,不兼容空间并行性的解码器可能成为逻辑操作的瓶颈,即使它们在适中的码距下表现良好。

基于AI的预解码器已被明确开发以解决速度和向非常大码距的可扩展性问题。由于预解码器在标记数据上训练并在局部操作,此类预解码器天然兼容空间和时间上的并行块级解码。此外,它们的局部性允许在适中码距 d 1 d_1 d1 训练的模型推广到更大的码距 d 2 ≫ d 1 d_2 \gg d_1 d2≫d1。在典型的流水线中,预解码器局部分处理综合征数据,执行校正,并将残余综合征和逻辑信息传递给执行最终校正的全局解码器。图1展示了在应用预解码器后传递给全局解码器的残余综合征示例。

虽然这种混合方法利用了学习型和算法型解码器各自的优势,但在此之前尚未证明预解码器与最先进的全局解码器组合可以同时实现每轮 O ( 1 μ s ) \mathcal{O}(1\mu s) O(1μs) 量级的总解码运行时间和低于单独全局解码器的逻辑错误率。

本文贡献概述:

在本文中,我们为旋转表面码引入了一种新的基于AI的预解码器架构。我们开发了处理标记训练数据的新方法,明确解决了类空和类时故障机制。这些方法显著改善了预解码器性能,并使每轮综合征测量达到 O ( 1 μ s ) \mathcal{O}(1\mu s) O(1μs) 量级的端到端解码运行时间,包括预解码和使用PyMatching的后续全局解码。我们在码距 d = 21 d=21 d=21 和 d = 31 d=31 d=31 处展示了这些结果,其中组合的预解码器+无关联PyMatching流水线实现了比单独无关联PyMatching更低的逻辑错误率,同时减少了总解码运行时间。此外,相对于PyMatching的总解码时间改进随码距增加而增加。对于关联PyMatching全局解码器,我们训练了一个更大的模型,其性能优于单独的关联PyMatching,并在码距达13时实现更低的运行时间。

低运行时间源于预解码器产生的有效综合征密度的显著降低,以及在NVIDIA GB300 GPU上的高效部署。当我们在时间并行块级解码方案中应用预解码器时,在访问足够GPU的情况下可以实现远低于 1 μ s 1\mu s 1μs 的运行时间。

噪声学习架构:

在PyMatching的标准实现中,匹配图中的边权重从假设的电路级噪声模型导出以优化LER性能。然而,预解码器的应用以原始噪声模型未捕获的方式修改了综合征统计信息,导致次优的匹配权重。更广泛地说,存在许多实际设置,其中完整的电路级噪声模型未知或随时间漂移,而来自底层硬件的综合征数据仍可访问。这促使需要直接从观测数据推断有效解码参数的方法。

为应对这些挑战,我们引入了一种基于AI的噪声学习架构,仅使用综合征统计信息推断无关联和关联PyMatching的近最优边权重,无需显式了解底层噪声模型。我们证明将此协议应用于原始综合征数据产生的边权重,对于无关联匹配实现了几乎相同的LER,对于关联匹配则优于从已知噪声模型获得的边权重。

当将噪声学习架构应用于预解码器产生的综合征统计信息时,我们未观察到LER的进一步改善。这种行为与预解码器输出的残余误差的结构化性质一致,其已经编码了下游解码的大部分相关信息,从而限制了通过权重重新优化可实现的额外收益。

论文结构:

- 第III节:回顾旋转表面码的关键性质

- 第IV节:介绍预解码器架构

- 第V节:介绍基于综合征统计信息的噪声学习框架

- 第VI节:数值结果和性能基准

- 第VII节:通过批处理改进并行化

- 第VIII节:总结结果并概述未来方向

II. 贡献总结

本工作的主要贡献如下:

1. 具有类空和类时校正的预解码器架构。 我们为旋转表面码引入了一种全卷积3D神经网络预解码器,它在整个时空综合征体积上联合预测类空(数据量子比特)和类时(测量)校正。该架构与后端无关:它不仅可与PyMatching组合,还可与为表面码设计的任何全局解码器组合,并可通过调整模型深度、宽度和训练配置来适应不同的噪声模型、码距和运行时间预算。我们开发了新的数据处理技术——包括用于隔离类时故障组件的协议、防止人工类时检测事件的故障延迟方案以及类时同调等价协议——大幅改善了训练标签质量和预解码器性能。

2. 同时实现LER改进和端到端运行时间减少。 我们证明将预解码器与无关联PyMatching组合,在码距 d ≥ 21 d \geq 21 d≥21 接近表面码阈值时,比单独的无关联PyMatching同时实现了更低的逻辑错误率和更低的总解码运行时间。据我们所知,这是首次证明基于AI的预解码器可以同时改进相对于最先进全局解码器的两个指标。LER和运行时间的相对改进都随码距增加而增长。通过训练具有残差连接的更大模型,我们进一步展示了在码距达 d = 13 d=13 d=13 时相对于关联PyMatching的LER改进。

3. GPU部署和解码器运行时间基准测试。 我们在NVIDIA GB300 GPU上以FP8精度对五种预解码器架构进行基准测试,系统探索模型宽度、深度、核大小、推断运行时间和LER性能之间的权衡。组合的预解码器+PyMatching流水线实现了最高达3.4倍(相对于无关联PyMatching)和3.5倍(相对于关联PyMatching)的总加速。当部署在具有多个GPU的时间并行块级解码方案中时,每轮预解码器运行时间远低于 1 μ s 1\mu s 1μs。

4. 从综合征统计信息中进行噪声学习的架构。 我们引入了一种基于AI的架构,直接从实验可获取的综合征统计信息推断无关联和关联PyMatching的近最优边和超边权重,无需了解底层电路级噪声模型。该架构利用所有18种边类型和43种超边类型组合的距离无关概率公式,使在单一码距训练的模型能够推广到任意码距。应用于原始综合征数据时,学习到的权重几乎匹配无关联PyMatching性能,并改善关联PyMatching的LER。

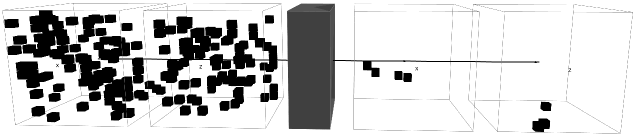

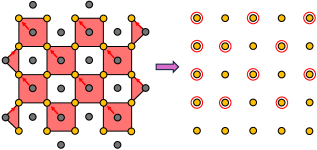

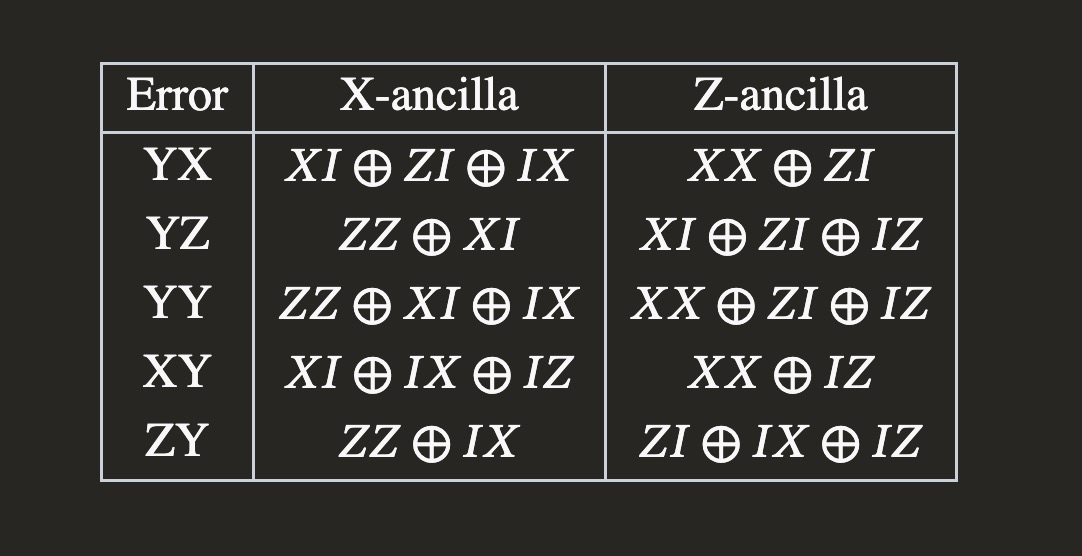

Figure 2: Example of a surface code patch for d=5. Data qubits correspond to yellow vertices, whereas ancillas used to measure the stabilizers correspond to grey vertices. X ( Z ) X (Z) X(Z) stabilizers are represented by red (blue) plaquettes. Minimum-weight representatives for logical X L ( Z L ) X_L (Z_L) XL(ZL) observables are shown as horizontal (vertical) strings. We provide a gate scheduling such that weight-two errors arising from a single fault propagate perpendicular to its corresponding logical observable.

III. 表面码简要回顾

本节回顾与预解码器开发相关的表面码关键性质。本节建立的概念和符号并非表面码特有,可适应于其他拓扑QEC码。

表面码基础:

表面码是一种二维拓扑量子纠错码,其稳定子可以使用最近邻相互作用测量,对于电路级去极化噪声模型展现出约0.7%的阈值。此外,通用容错量子计算可以仅通过最近邻相互作用通过晶格手术实现。因此,尽管已开发出许多具有吸引力理论性质的其他编码,表面码仍然是近中期量子计算架构的领先候选,特别是那些量子比特连通性有限的架构。

表面码由参数 [ [ d x d z , k , min ( d x , d z ) ] ] [[d_x d_z, k, \min(d_x, d_z)]] [[dxdz,k,min(dx,dz)]] 表征,其中 k = 1 k=1 k=1 是编码逻辑量子比特数, d x d_x dx( d z d_z dz)表示逻辑 X X X( Z Z Z)算符的最小权重。本文中,我们关注 d x = d z = d d_x = d_z = d dx=dz=d 的方形码片,但第IV节的方法自然扩展到具有任意 d x d_x dx 和 d z d_z dz 的矩形码片。图2展示了一个 d = 5 d=5 d=5 表面码片的例子。

解码与综合征密度:

两种广泛使用的表面码解码器是最小权重完美匹配(MWPM)和并查集(UF)。重要的是,两种解码器的运行时间都依赖于综合征密度 s s s。对于 d m d_m dm 轮测量和每轮 S ( d ) = d 2 − 1 S(d) = d^2 - 1 S(d)=d2−1 个稳定子,综合征密度定义为:

s = ∣ Syn ∣ / ( d m S ( d ) ) s = |\text{Syn}| / (d_m S(d)) s=∣Syn∣/(dmS(d))

其中 ∣ Syn ∣ |\text{Syn}| ∣Syn∣ 表示非平凡检测事件的数量。MWPM的解码复杂度按 O ( s 3 ) \mathcal{O}(s^3) O(s3) 缩放,而UF按 O ( s ) \mathcal{O}(s) O(s) 缩放。尽管UF提供更快的运行时间,MWPM通常实现更低的逻辑错误率。相比之下,基于AI的解码器具有独立于 s s s 的固定复杂度。

并行窗口解码:

如参考文献所示,当使用滑动窗口方法解码一系列综合征测量轮次时,如果每轮解码时间 T DEC T_{\text{DEC}} TDEC 超过测量稳定子所需的时间 T s T_s Ts,则会产生指数积压。更新Pauli帧的等待时间为:

T b j = c j r T s j − 1 + T l [ T s 1 − j ( c j − r T s j ) c − T s ] r T_b^j = c \frac{j^r T_s^{j-1} + T_l [T_s^{1-j}(c^{j-r} T_s^j) c - T_s]}{r} Tbj=crjrTsj−1+Tl[Ts1−j(cj−rTsj)c−Ts]

为缓解指数积压,参考文献引入了并行窗口解码策略。 syndrome测量历史被划分为大小为 d m d_m dm 的提交区域,前后均放置等大小的缓冲区域。所有提交区域并行解码,剩余的清理区域同样可以划分为并发解码的块。指数积压可以避免,前提是并行解码资源数 N par N_{\text{par}} Npar 满足:

N par ≥ 2 T DEC ( T l + T s ) ( n com + n W ) N_{\text{par}} \geq \frac{2T_{\text{DEC}}}{(T_l + T_s)(n_{\text{com}} + n_W)} Npar≥(Tl+Ts)(ncom+nW)2TDEC

然而,即使在此并行化设置中,整体算法运行时间仍然强烈依赖于 T DEC T_{\text{DEC}} TDEC。在第IV节,我们引入了一种预解码架构,在GPU上实现快速执行和综合征密度 s s s 的显著降低,从而在与全局算法解码器(如MWPM或并查集)组合时最小化 T DEC T_{\text{DEC}} TDEC。

IV. 预解码器架构

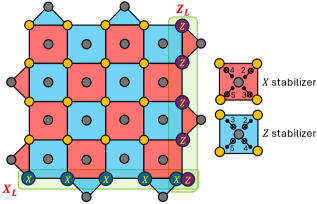

Figure 3: In a vanilla decoding algorithm, an algorithmic decoder receives the error syndromes from the QPU and performs corrections to determine the signs S L S_L SL of the relevant logical observables. When using a pre-decoder, the pre-decoder receives the error syndrome from the QPU and applies spacelike and timelike corrections across all syndrome measurement rounds that were used as inputs. Such corrections produce the signs S L ( 1 ) S_L^{(1)} SL(1) of the logical observables. The new error syndrome obtained from the corrections are then passed to an algorithmic decoder to apply the final set of corrections resulting in a sign S L ( 2 ) S_L^{(2)} SL(2) of the logical observables. The final sign is computed as S L = S L ( 1 ) ⊕ S L ( 2 ) S_L=S_L^{(1)} \oplus S_L^{(2)} SL=SL(1)⊕SL(2).

IV.1 使用预解码器的动机

如第III节所讨论的,最小权重完美匹配(MWPM)或并查集(UF)等算法解码器的解码时间 T DEC T_{\text{DEC}} TDEC 强烈依赖于综合征密度 s s s。综合征密度本身由底层噪声模型和用于综合征提取的电路等因素决定。这种依赖在接近错误阈值时变得尤为明显,此时 s s s 可能很大——特别是对于MWPM,其运行时间按 T DEC ∝ O ( s 3 ) T_{\text{DEC}} \propto \mathcal{O}(s^3) TDEC∝O(s3) 缩放。因此,通过在全局解码之前降低有效综合征密度,可以实现解码运行时间的实质性减少。

使用纯算法解码器处理 r r r 轮综合征测量所需的总时间为:

T tot ( a l ) ( r , s ) = T s + T l + T DEC ( a l ) ( r , s ) T_{\text{tot}}^{(al)}(r, s) = T_s + T_l + T_{\text{DEC}}^{(al)}(r, s) Ttot(al)(r,s)=Ts+Tl+TDEC(al)(r,s)

其中 T DEC ( a l ) ( r , s ) T_{\text{DEC}}^{(al)}(r, s) TDEC(al)(r,s) 表示以综合征密度 s s s 解码 r r r 轮所需的时间。

通过引入基于AI的预解码器可以实现综合征密度的降低,该预解码器在测量综合征的时空体积上执行局部校正。得到的混合解码流水线——由预解码器后接全局算法解码器组成——如图3所示。局部时空校正使用全卷积三维神经网络实现。

设 T l 1 T_{l1} Tl1 表示从量子处理单元(QPU)传输测量综合征到实现预解码器的经典设备所需的时间, T l 2 T_{l2} Tl2 表示从预解码器传输更新后的综合征到实现全局解码器的设备所需的时间。在此设置中,处理 r r r 轮综合征测量的总时间为:

T tot ( p r a ) ( r , s ) = T s + T l 1 + T DEC ( pre ) ( r ) + T l 2 + T DEC ( a l ) ( r , s ′ ) T_{\text{tot}}^{(pra)}(r, s) = T_s + T_{l1} + T_{\text{DEC}}^{(\text{pre})}(r) + T_{l2} + T_{\text{DEC}}^{(al)}(r, s') Ttot(pra)(r,s)=Ts+Tl1+TDEC(pre)(r)+Tl2+TDEC(al)(r,s′)

其中 T DEC ( pre ) ( r ) T_{\text{DEC}}^{(\text{pre})}(r) TDEC(pre)(r) 是预解码器运行时间, s ′ s' s′ 是应用预解码器后从 s s s 得到的降低的综合征密度。关键的是,由于其基于AI的实现, T DEC ( pre ) ( r ) T_{\text{DEC}}^{(\text{pre})}(r) TDEC(pre)(r) 独立于输入综合征密度 s s s。

比较两个方程,当满足以下条件时实现净加速:

T DEC ( pre ) ( r ) + T DEC ( a l ) ( r , s ′ ) + T l 1 + T l 2 < T DEC ( a l ) ( r , s ) + T l T_{\text{DEC}}^{(\text{pre})}(r) + T_{\text{DEC}}^{(al)}(r, s') + T_{l1} + T_{l2} < T_{\text{DEC}}^{(al)}(r, s) + T_l TDEC(pre)(r)+TDEC(al)(r,s′)+Tl1+Tl2<TDEC(al)(r,s)+Tl

对于固定架构和部署设置,传输时间 T l T_l Tl、 T l 1 T_{l1} Tl1 和 T l 2 T_{l2} Tl2 是常数偏移量,因此条件主要取决于 syndrome密度降低的程度和预解码器运行时间。

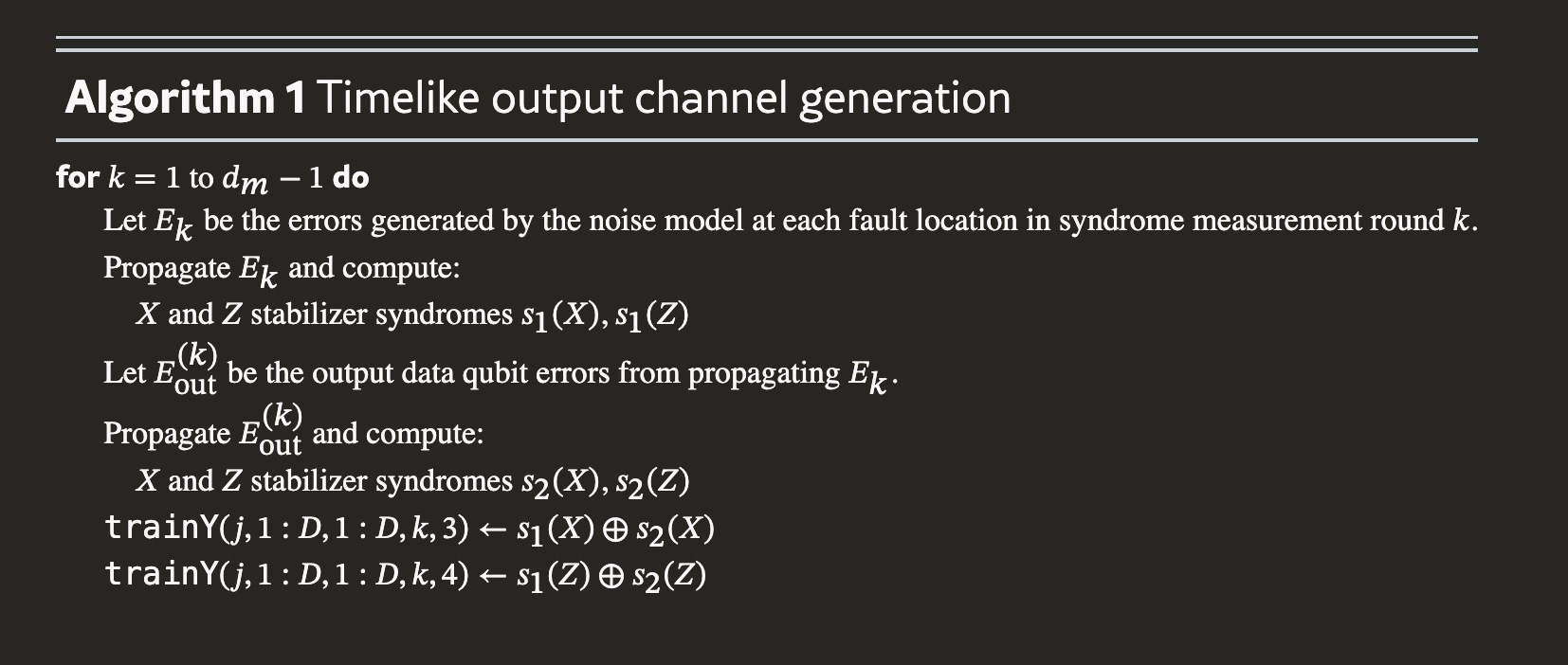

Figure 4: Example of a four-layer fully connected three-dimensional convolutional neural network used to train our AI-based pre-decoder. The first three layers use nf=128 filters with three-dimensional kernels of size (3,3,3). The final layer always uses four filters since the network has 4 output correction channels.

预解码器架构:

预解码器由全卷积3D CNN实现,其架构如图4所示。网络架构由一系列3D卷积层组成,每个层由三维核大小和滤波器数量指定。每层使用步幅1,并使用填充使每层的输入和输出网格尺寸相同。最后一层始终使用四个滤波器,对应于下面描述的四个输出通道。

更深层架构需要跳跃连接以避免梯度消失,这在参考文献中有探讨。虽然本文主要关注最小化预解码器运行时间,我们也在第VI.2节考虑更深层的架构以实现进一步的LER改进。

3D卷积网络的一个重要架构参数是感受野,它量化了影响给定输出元素的输入局部三维窗口的大小。感受野在决定预解码器的最大有效解码距离方面起着核心作用,因为空间或时间范围大于感受野的误差链通常无法仅通过局部操作完全校正。

考虑一个具有 l l l 个卷积层的网络,其中第 j j j 层的核大小为 ( k j , k j , k j ) (k_j, k_j, k_j) (kj,kj,kj)。假设所有层使用单位步幅和膨胀系数 D = 1 D=1 D=1,感受野由下式给出:

R l = 1 + ∑ i = 1 l ( k i − 1 ) R_l = 1 + \sum_{i=1}^{l}(k_i - 1) Rl=1+i=1∑l(ki−1)

因此,可以通过增加层数或使用更大的卷积核来增加感受野。然而,如第VI.3节所示,增加核大小比增加深度导致 T DEC ( pre ) T_{\text{DEC}}^{(\text{pre})} TDEC(pre) 显著更大的增加,这促使了本文采用的架构选择。

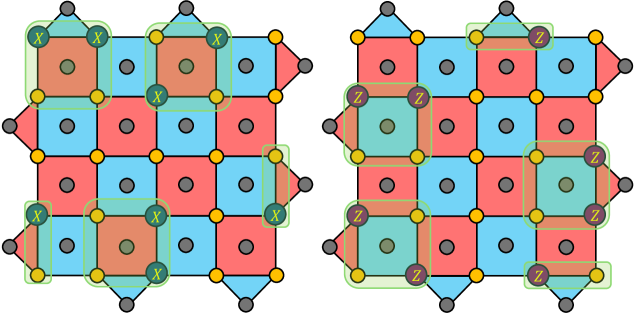

Figure 5: (a) Example mapping of X X X-type stabilizers to a D × D D×D D×D grid (with D = 5 D=5 D=5). For any D D D, measurement outcomes of weight-four X X X-type stabilizers are mapped to the top-left data qubit in its support. Weight-two stabilizers on the left or right boundary are mapped to the top data in its support. (b) Similar mapping as in (a) but for Z Z Z-type stabilizers.

IV.2.1 输入训练数据

本节描述用于训练神经网络的输入数据结构。输入和输出训练数据张量分别记为 trainX \text{trainX} trainX 和 trainY \text{trainY} trainY。

为使神经网络能够识别由重复稳定子测量产生的类空和类时错误,必须在二维网格上高效编码每轮测量的综合征。此外,晶格边界附近的稳定子统计信息与体区域不同。为此,我们向网络提供显式的几何信息,编码稳定子位置及其相应权重。

考虑嵌入在 D × D D \times D D×D 网格上的表面码片。假设生成了 N train N_{\text{train}} Ntrain 个训练样本。对于每个样本 j j j,稳定子测量进行 d m d_m dm 轮。对于电路中的每个故障位置,根据底层噪声模型采样错误并通过电路传播。

错误传播后,我们存储:(i) 连续轮次之间数据量子比特错误的差异(以及类时故障),和 (ii) 连续轮次之间稳定子测量结果的差异,通常称为检测事件。

设 s i , k s_{i,k} si,k 表示第 i i i 个稳定子在第 k k k 轮的测量结果。对应的检测事件定义为:

d i , k = s i , k ⊕ s i , k − 1 d_{i,k} = s_{i,k} \oplus s_{i,k-1} di,k=si,k⊕si,k−1

输入张量 trainX \text{trainX} trainX 的形状为 ( N train , D , D , d m , N s ) (N_{\text{train}}, D, D, d_m, N_s) (Ntrain,D,D,dm,Ns),其中 N s N_s Ns 表示输入通道数。对于本文考虑的量子存储器设置, N s = 4 N_s = 4 Ns=4。

我们首先描述 trainX \text{trainX} trainX 的两个检测事件通道。对于第 k k k 轮综合征测量和训练样本 j j j:

trainX ( j , 1 : D , 1 : D , k , 1 ) = x_type ( k , j ) \text{trainX}(j, 1:D, 1:D, k, 1) = \text{x\_type}(k, j) trainX(j,1:D,1:D,k,1)=x_type(k,j)

trainX ( j , 1 : D , 1 : D , k , 2 ) = z_type ( k , j ) \text{trainX}(j, 1:D, 1:D, k, 2) = \text{z\_type}(k, j) trainX(j,1:D,1:D,k,2)=z_type(k,j)

这种映射过程的一个示例如图5所示。来自权重为4的 X X X( Z Z Z)型稳定子的检测事件被映射到该稳定子支撑中的左上(右上)数据量子比特。对于权重为2的稳定子, X X X型检测事件映射到顶部数据量子比特,而 Z Z Z型检测事件映射到右侧数据量子比特。

除了检测事件外,我们使用相同的稳定子到量子比特映射编码局部几何信息。这些通道在对应网格位置编码归一化的稳定子权重。对于每轮 k k k,这些通道记为 x_present ( k ) \text{x\_present}(k) x_present(k) 和 z_present ( k ) \text{z\_present}(k) z_present(k)。

对于图5所示的 D = 5 D=5 D=5 表面码片,中间轮次的儿何通道具有特定形式,然后被纳入 trainX \text{trainX} trainX 的第3和第4个通道。

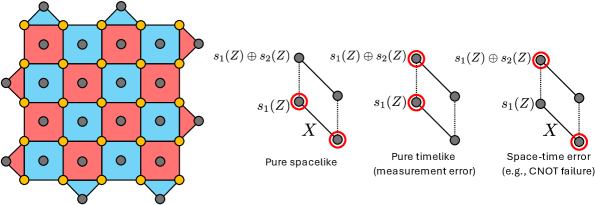

Figure 6: Example illustrations of the computation of s 1 ( Z ) ⊕ s 2 ( Z ) s_1(Z)\oplus s_2(Z) s1(Z)⊕s2(Z) used in Algorithm 1. Only pure timelike and space-time failures result in a non-trivial value for s 1 ( Z ) ⊕ s 2 ( Z ) s_1(Z)\oplus s_2(Z) s1(Z)⊕s2(Z). Red circles illustrate stabilizers that are measured as −1 instead of +1 (vertices without a red circle) in a given round.

IV.2.2 输出训练数据

我们现在描述用于训练预解码器的输出标签。为降低传递给全局解码器的综合征密度,预解码器必须执行类空(数据量子比特)和类时(稳定子测量)校正。因此,训练目标编码两种类型的校正。

输出张量 trainY \text{trainY} trainY 由四个通道组成:两个通道对应于数据量子比特上的 Z Z Z 型和 X X X 型Pauli校正,两个通道对应于 X X X 型和 Z Z Z 型稳定子的类时校正。

我们首先描述占据 trainY \text{trainY} trainY 前两个通道的类空输出通道:

trainY ( j , 1 : D , 1 : D , k , 1 ) = Z ~ k ( j ) \text{trainY}(j, 1:D, 1:D, k, 1) = \tilde{Z}_k^{(j)} trainY(j,1:D,1:D,k,1)=Z~k(j)

trainY ( j , 1 : D , 1 : D , k , 2 ) = X ~ k ( j ) \text{trainY}(j, 1:D, 1:D, k, 2) = \tilde{X}_k^{(j)} trainY(j,1:D,1:D,k,2)=X~k(j)

剩余两个通道编码纯类时校正。为构造这些标签,我们通过比较在额外一轮电路中传播相同错误配置前后获得的稳定子综合征来隔离每个故障机制的类时组件。

算法1给出了类时输出通道生成协议。直观上,两阶段传播程序通过在跨轮次抵消持续的类空效应来隔离给定综合征测量轮次中故障的纯类时贡献。这些类时标签使预解码器能够学习抑制时间相关检测事件的局部校正,从而进一步降低传递给全局解码器的综合征密度。

Figure 7: Circuit for a d = 5 d=5 d=5 surface code showing the CNOT gates and corresponding time steps used to generate our data. The time step t = 1 t=1 t=1 is used for preparing the ancillas (grey vertices) in the |+⟩ and |0⟩ basis. The time step t = 6 t=6 t=6 is for measuring the ancillas in the X X X or Z Z Z basis.

IV.2.3 数据处理

本节描述在生成输出标签 trainY \text{trainY} trainY 期间应用的数据处理技术,以避免引入人工类时检测事件。

为说明此效应,考虑图7所示的稳定子测量电路。关注第 k k k 轮综合征测量( k > 1 k > 1 k>1)。假设在辅助量子比特测量期间的时间步骤6发生 Z Z Z 错误。受此错误影响的稳定子直到第 k + 1 k+1 k+1 轮才被测量。然而,由于故障发生在第 k k k 轮,结果数据量子比特错误可能被错误地分配到第 k k k 轮的 trainY \text{trainY} trainY 类空输出通道,而对应的综合征在第 k + 1 k+1 k+1 轮的 trainX \text{trainX} trainX 中出现。

更一般地,存在许多主要阶故障过程,其中数据量子比特错误在第 k k k 轮生成但仅在第 k + 1 k+1 k+1 轮产生可检测的综合征信息。如果不仔细处理,此类过程会导致虚假的时空垂直对,人为增加网络看到的类时事件数量。

为防止引入这些伪影,我们应用算法2中描述的数据生成协议。关键思想是仅当故障在同轮产生非平凡稳定子综合征时才更新训练标签;否则,结果数据量子比特错误被延迟并视为下一轮的输入错误。

处理包含 Y Y Y 错误的故障时需要额外注意。例如,数据量子比特上的单个 Y Y Y 错误可以在第 k k k 轮产生 X X X 型检测事件并在第 k + 1 k+1 k+1 轮产生 Z Z Z 型检测事件,导致混合类空-类时特征。为避免引入此类人工关联,所有包含 Y Y Y 错误的故障在应用算法2之前被分解为等效的 X X X 和 Z Z Z 错误组合。

对于单量子比特故障,此分解简单,因为 Y = X ⊕ Z Y = X \oplus Z Y=X⊕Z,两个组件可独立传播。对于包含至少一个 Y Y Y 错误的两量子比特故障,分解将数据量子比特错误的 X X X/ Z Z Z 内容与辅助量子比特可检测的错误类型相关联。表1总结了本工作使用的完整分解规则集。

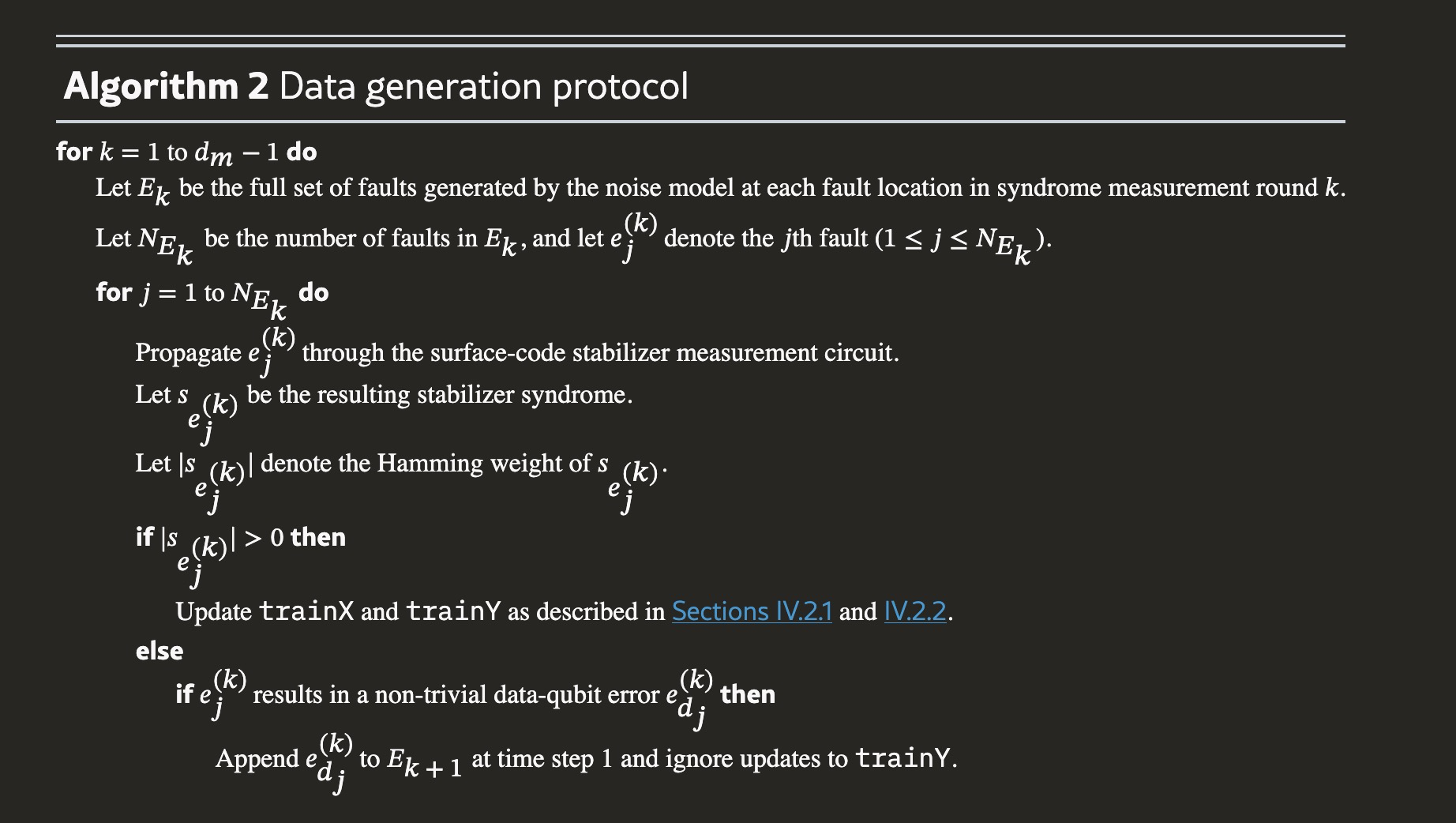

Table 1: Decomposition rules for two-qubit faults containing Y errors. The first qubit is always a data qubit and the second is an ancilla qubit. Columns distinguish the ancilla type.

Figure 8: Spacelike homological equivalence convention as shown in a d=5 surface code lattice. On the left part of the figure, we show X error configurations which are invariant under the transformations of the functions weightReductionX and fixEquivalenceX. On the right part of the figure, we show Z error configurations which are invariant under the transformations of the functions weightReductionZ and fixEquivalnceZ.

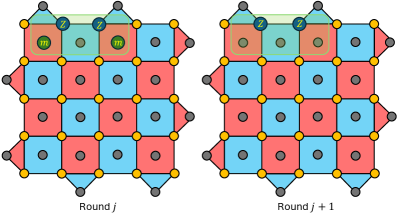

Figure 9: Timelike homological equivalence convention for a d=5 surface code. (a) For each data qubit in two consecutive syndrome measurement rounds, we apply a Z correction. Measurement errors that anti-commute with the Z error are added in the first round that a Z data qubit error is added. If the number of 1’s in trainY is reduced, we accept the trivial correction. (b) Same as (a) but with X corrections.

Figure 10: Timelike homological equivalence convention for a d=5 surface code for weight-two errors arising from a single fault. (a) For each weight-four Z-type stabilizer, after applying the fixEquivalenceZ function in two consecutive rounds, add a horizontal weight-two Z error in the direction set by fixEquivalenceZ in two consecutive syndrome measurement rounds, along with measurement errors on X-type stabilizers that anticommute with the Z errors in the first round the Z errors are introduced. Apply such corrections to trainY. If the number of 1’s in trainY is reduced, we accept the trivial correction. (b) Same as (a) but with X corrections, and where the weight-two X errors are added in the vertical direction.

IV.2.4 同调等价函数

许多作用于数据量子比特的错误配置在物理上是等价的。如果存在稳定子 g ∈ S g \in \mathcal{S} g∈S 使得 E 1 = g E 2 E_1 = gE_2 E1=gE2,我们说两个Pauli错误 E 1 E_1 E1 和 E 2 E_2 E2 是同调等价的。为降低标记训练数据的复杂性并改善训练性能,我们在每个同调等价类中固定一个典范代表选择。

类空同调等价协议: 对于类空协议,考虑图8中表示为红色平面的权重为4的 X X X 型稳定子 g k ( X ) g_k^{(X)} gk(X)。任何支撑在 g k ( X ) g_k^{(X)} gk(X) 上的权重为3的 X X X 错误 E 3 E_3 E3 可以通过乘以稳定子简化为权重为1的错误。类似地,支撑在 g k ( X ) g_k^{(X)} gk(X) 上的权重为4的 X X X 错误等价于 g k ( X ) g_k^{(X)} gk(X) 本身,因此可以完全移除。

我们定义函数 weightReductionX \text{weightReductionX} weightReductionX 在所有相关稳定子上应用这些权重约简变换。此外,它移除支撑在表面码片左右边界上权重为2的 X X X 稳定子的权重为2的 X X X 错误。

接下来定义 fixEquivalenceX \text{fixEquivalenceX} fixEquivalenceX 函数,通过典范化规则映射权重为2的 X X X 错误:

- 垂直 X X X 链: 如果 E x E_x Ex 支撑在 ( α , β ) (\alpha, \beta) (α,β) 和 ( α + 1 , β ) (\alpha+1, \beta) (α+1,β) 上,映射到 ( α , β + 1 ) (\alpha, \beta+1) (α,β+1) 和 ( α + 1 , β + 1 ) (\alpha+1, \beta+1) (α+1,β+1)

- 水平 X X X 链: 如果 E x E_x Ex 支撑在 ( α + 1 , β ) (\alpha+1, \beta) (α+1,β) 和 ( α + 1 , β + 1 ) (\alpha+1, \beta+1) (α+1,β+1) 上,映射到 ( α , β ) (\alpha, \beta) (α,β) 和 ( α , β + 1 ) (\alpha, \beta+1) (α,β+1)

- 对角 X X X 链: 如果 E x E_x Ex 支撑在 ( α , β ) (\alpha, \beta) (α,β) 和 ( α + 1 , β + 1 ) (\alpha+1, \beta+1) (α+1,β+1) 上,映射到 ( α , β + 1 ) (\alpha, \beta+1) (α,β+1) 和 ( α + 1 , β ) (\alpha+1, \beta) (α+1,β)

我们定义 simplifyX \text{simplifyX} simplifyX 为在所有 X X X 型稳定子上依次应用 weightReductionX \text{weightReductionX} weightReductionX 和 fixEquivalenceX \text{fixEquivalenceX} fixEquivalenceX,迭代直到收敛。

对于 Z Z Z 型数据量子比特错误,类似地定义 weightReductionZ \text{weightReductionZ} weightReductionZ 和 fixEquivalenceZ \text{fixEquivalenceZ} fixEquivalenceZ。

类时同调等价协议: 在独立对所有综合征测量轮次应用类空同调等价协议后,我们应用简化连续轮次之间标签结构的类时同调等价协议。

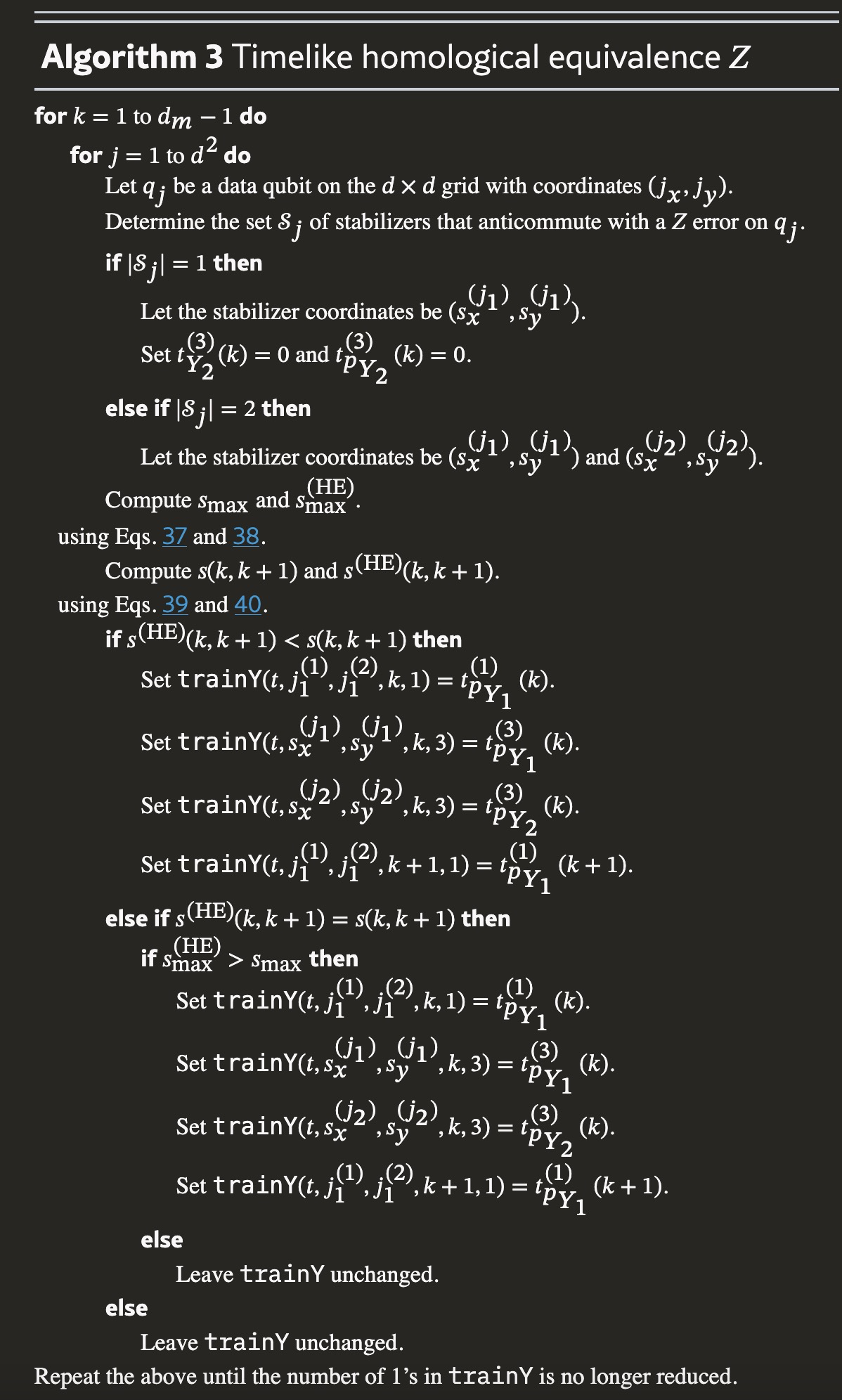

假设有 d m d_m dm 轮综合征测量和 d 2 d^2 d2 个数据量子比特。对于连续轮次 k k k 和 k + 1 k+1 k+1,我们定义一系列辅助变量来计算应用平凡校正前后的代价。算法3给出了类时同调等价协议。

直观上,在两个连续轮次中对同一数据量子比特应用 X X X 或 Z Z Z 错误——以及在两个轮次的第一个轮次中与添加的错误反交换的稳定子上的测量错误——可以对应于平凡操作,因为没有净综合征变化被记录。利用这种自由度可以通过引入CNN更容易学习的额外结构来简化 trainY \text{trainY} trainY。

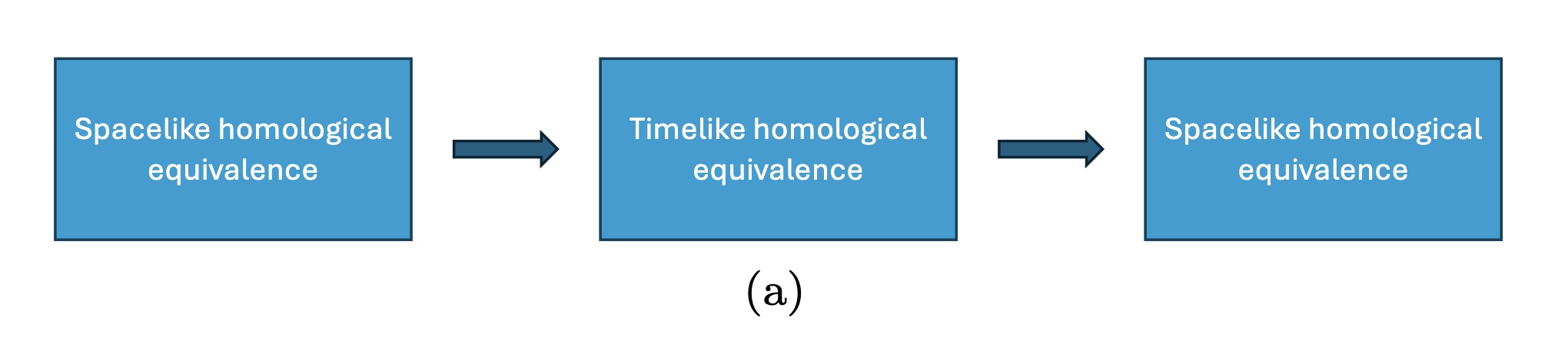

Figure 11: Sequence of operations for the complete homological equivalence protocol. We first apply the spacelike homological equivalence protocol, followed by the timelike homological equivalence protocol (for weight-one errors), and finally reapply the spacelike protocol as a cleanup step.

完整协议结合类空和类时变换于迭代方案中。我们首先对所有轮次应用类空同调等价,然后对权重为1的数据量子比特错误应用类时同调等价。由于类时变换可能为类空简化创造新机会,我们执行最终的类空遍作为清理步骤。此序列如图11所示。

IV.2.5 损失函数

为训练预解码器网络,我们使用二元交叉熵(BCE)目标,因为模型预测类空Pauli校正和类时综合征翻转的独立每体素概率。具体地,网络产生四个输出通道,我们对每个通道应用sigmoid非线性以获得 [ 0 , 1 ] [0,1] [0,1] 中的概率。

对于 D × D D \times D D×D 网格上具有 d m d_m dm 轮综合征测量的表面码片,损失函数为:

L BCE = − 1 4 D 2 d m ∑ c = 1 4 ∑ x , y , k [ Y c , x , y , k log Y ^ c , x , y , k + ( 1 − Y c , x , y , k ) log ( 1 − Y ^ c , x , y , k ) ] \mathcal{L}_{\text{BCE}} = -\frac{1}{4D^2d_m}\sum_{c=1}^{4}\sum_{x,y,k}[Y_{c,x,y,k}\log\hat{Y}_{c,x,y,k} + (1-Y_{c,x,y,k})\log(1-\hat{Y}_{c,x,y,k})] LBCE=−4D2dm1c=1∑4x,y,k∑[Yc,x,y,klogY^c,x,y,k+(1−Yc,x,y,k)log(1−Y^c,x,y,k)]

由于输出概率独立作用于每个体素,损失函数可以按通道分解。这种分解是可取的,因为它允许每个预测任务(类空 Z Z Z 和 X X X 校正,类时 X X X 和 Z Z Z 稳定子翻转)独立优化。

IV.2.6 预解码器校正流程

在推断期间,预解码器网络处理输入综合征体积 trainX \text{trainX} trainX 以生成输出概率 Y ^ \hat{Y} Y^。通过对每个输出通道应用阈值(通常取0.5)获得二元校正:

- 类空校正: 通道1和2分别确定数据量子比特上的 Z Z Z 型和 X X X 型Pauli校正。

- 类时校正: 通道3和4确定 X X X 型和 Z Z Z 型稳定子的测量错误校正。

设 SynX corr ( j , k ) \text{SynX}_{\text{corr}}(j,k) SynXcorr(j,k) 和 SynZ corr ( j , k ) \text{SynZ}_{\text{corr}}(j,k) SynZcorr(j,k) 分别表示第 j j j 个样本和第 k k k 轮的类时 X X X 型和 Z Z Z 型校正。在应用类空和类时校正后,传递给全局解码器的残余综合征为:

R ( j , 1 ) ( X ) = SynX ( j , 1 ) ⊕ SynX corr ( j , 1 ) ⊕ S X ( j , 1 ) R^{(j,1)}(X) = \text{SynX}^{(j,1)} \oplus \text{SynX}_{\text{corr}}^{(j,1)} \oplus S_X^{(j,1)} R(j,1)(X)=SynX(j,1)⊕SynXcorr(j,1)⊕SX(j,1)

R ( j , k > 1 ) ( X ) = SynX ( j , k ) ⊕ SynX corr ( j , k ) ⊕ SynX corr ( j , k − 1 ) ⊕ S X ( j , k ) R^{(j,k>1)}(X) = \text{SynX}^{(j,k)} \oplus \text{SynX}_{\text{corr}}^{(j,k)} \oplus \text{SynX}_{\text{corr}}^{(j,k-1)} \oplus S_X^{(j,k)} R(j,k>1)(X)=SynX(j,k)⊕SynXcorr(j,k)⊕SynXcorr(j,k−1)⊕SX(j,k)

(对于 Z Z Z 型有类似方程)

当应用预解码器和全局校正的总和与数据量子比特上发生的实际错误反交换时,发生逻辑错误。逻辑错误的最终判断通过比较累积校正与逻辑算符来确定。

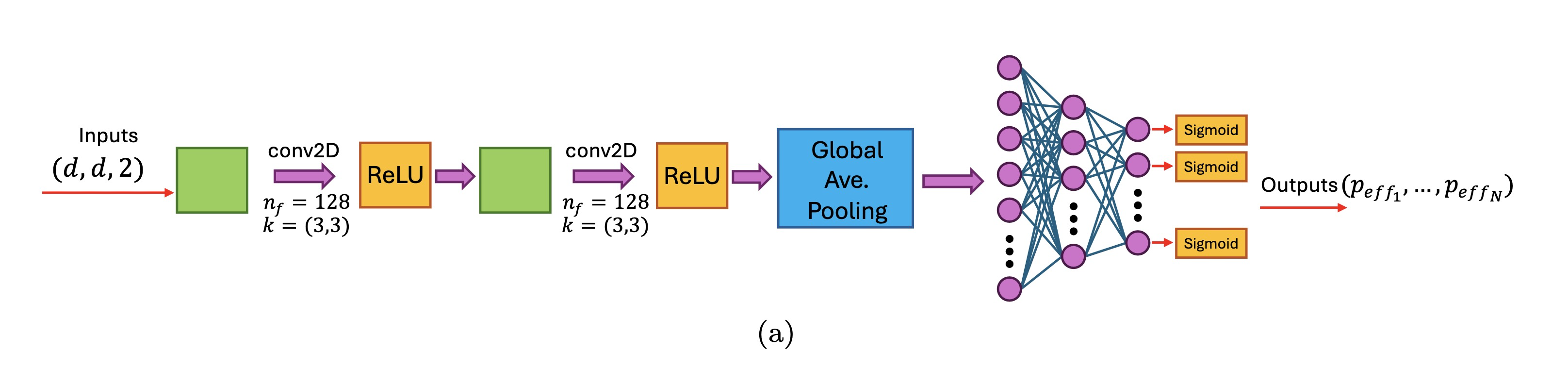

Figure 12: Architecture for learning the circuit-level noise parameters of the gates used to implement the surface code. Two-dimensional convolutional layers extract local spatial features from two consecutive syndrome-measurement rounds mapped to a 2D grid following the procedure in Fig. 5. A global average pooling layer aggregates these features into global statistics that capture syndrome-motif frequencies. The final MLP head maps these global features to the estimated noise parameters for each circuit-level component.

V. 从综合征统计信息中进行噪声学习的架构

当操作量子设备时,并不总是能够以足够精度完全表征底层电路级噪声模型来计算最优解码权重。在实践中,噪声过程可能部分未知、随时间漂移,或偏离模拟中使用的简化假设。然而,来自重复稳定子轮的综合征测量数据是实验可访问的,并包含关于影响编码的有效错误过程的统计信息。这促使了直接从综合征统计信息推断解码参数的方法,而不是依赖显式的电路级噪声模型。

当预解码器应用于测量综合征数据时,产生的残余综合征根据特定方程修改。因此,残余综合征的统计信息由通常不同于用于生成物理错误的原始电路级模型的有效噪声模型控制。全局解码器如PyMatching使用从假设噪声模型导出的概率计算匹配图边权重。如果有效噪声统计信息与解码器假设的不同,产生的边权重可能是次优的。

核心思想:

本节介绍一种神经网络架构,从两个连续体测量轮的综合征统计信息中学习计算近最优边权重和相关结构所需的有效噪声参数。学习到的参数支持标准(无关联)匹配和关联匹配。训练期间,网络从已知电路级噪声模型生成的综合征数据提供。推断时,训练好的网络可应用于实验获得的综合征统计信息——或预解码器产生的残余综合征——以估计对应的有效噪声模型。这些学习到的概率可用于构建提供给PyMatching的检测器错误模型。

实现此方法的一个关键观察是表面码匹配图中边和超边的概率公式与码距无关。对于 X X X 型和 Z Z Z 型稳定子匹配图,有18种不同的边类型和43种不同的超边类型组合,其概率表达式对于所有码距 d ≥ 5 d \geq 5 d≥5 相同。虽然每种类型的实例数量随码距缩放,但它们对底层噪声参数的函数依赖不随码距变化。

这种距离无关性,结合神经网络架构中使用的全局平均池化,使噪声学习模型能在单一码距训练并在推断期间推广到任意码距。

V.1 架构

噪声学习架构的概述如图12a所示。网络输入由来自两个连续体测量轮的综合征数据组成,使用第IV.2.1节描述的相同约定映射到二维网格。

架构由三个阶段组成:

卷积特征提取器。 4层2D CNN独立处理每对综合征。输入通道通过滤波器计数为 [ 128 , 256 , 256 , 128 ] [128, 256, 256, 128] [128,256,256,128] 的层处理,每层使用 3 × 3 3 \times 3 3×3 核并填充以保持空间维度。我们使用GroupNorm(32组)归一化和GeLU激活。仅在最终CNN层应用Dropout( p = 0.1 p=0.1 p=0.1)。

全局平均池化。 最终CNN层的输出通过在所有空间位置上平均减少为128维特征向量。此操作是距离保持的:无论码距 d d d 如何,池化特征具有相同的维度,使单一训练模型能够跨码距推广。

带后MLP平均的MLP预测头。 我们独立地将3层MLP应用于每个样本的池化特征,产生每样本对数几率:

z k = MLP ( g k ) ∈ R 25 \mathbf{z}_k = \text{MLP}(\mathbf{g}_k) \in \mathbb{R}^{25} zk=MLP(gk)∈R25

其中MLP具有隐藏维度 [ 256 , 128 ] [256, 128] [256,128],使用GeLU激活和dropout( p = 0.2 p=0.2 p=0.2)。然后对批次平均对数几率:

z ˉ = 1 B ∑ k = 1 B z k \bar{\mathbf{z}} = \frac{1}{B}\sum_{k=1}^{B}\mathbf{z}_k zˉ=B1k=1∑Bzk

最后,使用有界对数空间变换将对数几率映射到噪声参数:

p ^ i = exp ( log p min ′ + ( log p max ′ − log p min ′ ) ⋅ σ ( z ˉ i ) ) \hat{p}_i = \exp(\log p'_{\min} + (\log p'_{\max} - \log p'_{\min}) \cdot \sigma(\bar{z}_i)) p^i=exp(logpmin′+(logpmax′−logpmin′)⋅σ(zˉi))

其中 σ \sigma σ 是sigmoid函数, p min ′ = p min / 100 p'_{\min} = p_{\min}/100 pmin′=pmin/100, p max ′ = 3 p max p'_{\max} = 3p_{\max} pmax′=3pmax, p min = 10 − 3 p_{\min} = 10^{-3} pmin=10−3, p max = 10 − 2 p_{\max} = 10^{-2} pmax=10−2。扩展边界考虑了单个噪声参数可能显著小于或大于基础错误率的事实。这种对数空间参数化使网络能够自然跨越概率值的多数量级,同时确保所有预测位于有效范围内。

V.2 边和超边概率公式

PyMatching使用的匹配图包含连接可能由同一错误引起的检测器对的边,以及表示相关多检测器事件的超边。为计算标准匹配的边权重和关联匹配的联合概率,我们为所有边和超边类型推导了闭合形式概率公式。

边公式。 通过在电路中系统激活每个单Pauli错误并追踪其翻转哪些检测器对,我们识别出对每条边有贡献的所有错误机制。当多个独立机制翻转同一检测器对时,它们的概率通过异或组合:

P 1 ⊕ P 2 = P 1 + P 2 − 2 P 1 P 2 P_1 \oplus P_2 = P_1 + P_2 - 2P_1P_2 P1⊕P2=P1+P2−2P1P2

对于 X X X 型和 Z Z Z 型稳定子匹配图,此分析产生18种不同的边类型:3种类空、4种类时、5种对角和6种边界类型。这些公式是距离无关的。

超边公式。 当Stim以 decompose_errors=True 生成检测器错误模型时,相关多检测器事件被分解为由 ^ 运算符分隔的边对。PyMatching使用这些分解的超边进行关联两遍匹配。

使用与边相同的单错误追踪方法,我们识别出产生每个分解超边模式的所有错误机制。每个超边的联合概率计算为贡献错误概率的异或组合。按组件边类型对超边分类产生43种不同的类型组合。这些公式是距离无关的。

V.3 损失函数

噪声学习网络预测参数 p ^ \hat{\mathbf{p}} p^,从中我们计算预测的边和超边概率。损失函数结合边和超边损失的贡献:

L = L edge + L hyper \mathcal{L} = \mathcal{L}_{\text{edge}} + \mathcal{L}_{\text{hyper}} L=Ledge+Lhyper

边损失计算为真实和预测边概率之间的均方误差:

L edge = 1 N e ∑ j = 1 N e ( P j ( true ) − P ^ j ) 2 \mathcal{L}_{\text{edge}} = \frac{1}{N_e}\sum_{j=1}^{N_e}(P_j^{(\text{true})} - \hat{P}_j)^2 Ledge=Ne1j=1∑Ne(Pj(true)−P^j)2

超边损失类似地计算:

L hyper = 1 N h ∑ k = 1 N h ( H k ( true ) − H ^ k ) 2 \mathcal{L}_{\text{hyper}} = \frac{1}{N_h}\sum_{k=1}^{N_h}(H_k^{(\text{true})} - \hat{H}_k)^2 Lhyper=Nh1k=1∑Nh(Hk(true)−H^k)2

此损失函数选择确保网络学习预测准确的边和超边概率。

V.4 训练过程

训练数据使用GPU加速Pauli帧模拟器即时生成。对于每个训练步骤:

- 从 [ p min , p max ] [p_{\min}, p_{\max}] [pmin,pmax] 上的对数均匀分布采样基础错误率 p base p_{\text{base}} pbase,然后用位置特定的随机乘数和随机Pauli类型分布推导25个噪声参数。

- 使用采样噪声模型在训练码距 d d d 生成 B B B 个独立综合征样本。

- 对每个样本 k k k,计算 z k = MLP ( GAP ( CNN ( x k ) ) ) \mathbf{z}_k = \text{MLP}(\text{GAP}(\text{CNN}(\mathbf{x}_k))) zk=MLP(GAP(CNN(xk)))。

- 平均对数几率,然后通过有界对数空间变换转换为噪声参数。

- 计算 P ^ j = E j ( p ^ ) \hat{P}_j = \mathcal{E}_j(\hat{\mathbf{p}}) P^j=Ej(p^) 和 H ^ k = H k ( p ^ ) \hat{H}_k = \mathcal{H}_k(\hat{\mathbf{p}}) H^k=Hk(p^)。

- 最小化 L = L edge + L hyper \mathcal{L} = \mathcal{L}_{\text{edge}} + \mathcal{L}_{\text{hyper}} L=Ledge+Lhyper 并通过可微分公式反向传播。

分层噪声采样确保跨越多数量级的多样训练数据,同时保持物理上合理的参数间相关性。

V.5 推断策略

推断时,训练好的网络应用于预解码器产生的综合征数据。从任何具有 d m ≥ 3 d_m \geq 3 dm≥3 轮综合征测量的表面码实验中,我们提取一对连续的体轮(避免第一和最后一轮以排除时间边界效应)。这两个轮格式化为输入张量,与 N test ≫ 1 N_{\text{test}} \gg 1 Ntest≫1 个样本一起通过网络,产生平均并转换为噪声参数的对数几率。

学习到的参数 p ^ \hat{\mathbf{p}} p^ 用于构建具有相应噪声模型的完整Stim电路,从中生成 decompose_errors=True 和 approximate_disjoint_errors=True 的检测器错误模型。此检测器错误模型然后加载到PyMatching中,支持无关联匹配(仅使用边权重)和关联匹配(使用边权重和超边条件概率)。

VI. 数值结果与性能基准

本节我们为表2中总结的预解码器模型族呈现数值结果。所有模型基于全卷积3D CNN架构。

| 模型 | 滤波器数量 | 核大小 | 感受野 | 参数量 |

|---|---|---|---|---|

| 模型1 | [128,128,128,4] | [3,3,3,3] | 9 | 912,272 |

| 模型2 | [256,256,256,4] | [3,3,3,3] | 9 | 3,595,012 |

| 模型3 | [128,128,128,4] | [5,5,5,5] | 17 | 4,224,388 |

| 模型4 | [128,128,128,128,128,4] | [3,3,3,3,3,3] | 13 | 1,797,764 |

| 模型5 | [256,256,256,256,256,4] | [3,3,3,3,3,3] | 13 | 7,134,468 |

表2:本工作考虑的预解码器模型。

Table 2: Pre-decoder models considered in this work. The size of the vectors used for num_filters and kernel_size indicate how many 3DConv layers are used. The entries in num_filters and kernel_size indicate the number of filters and kernel size used in that given layer. Note that if an entry in the j-th column of kernel_size is K, a kernel size of K×K×K is used in that layer. We use Eq. 8 to compute the receptive field size. All models use stride 1 and no dilation.

五个模型旨在探索表达能力和预解码运行时间之间的架构权衡。增加滤波器数量(模型宽度)通常提高表示能力,但增加每次卷积的浮点运算次数,导致推断期间更高的运行时间。例如,模型1使用三个隐藏层,每层128个滤波器和 3 × 3 × 3 3 \times 3 \times 3 3×3×3 核,产生相对轻量级的架构,运行时间低但能力有限。

所有预解码器模型使用表3中列出的超参数训练。除非另有说明,本节模拟采用以下去极化电路级噪声模型:

- ∣ 0 ⟩ |0\rangle ∣0⟩( ∣ + ⟩ |+\rangle ∣+⟩)态制备后跟 X X X( Z Z Z)错误,概率为 2 p / 3 2p/3 2p/3

- 每次 Z Z Z( X X X)基测量前, X X X( Z Z Z)错误概率为 2 p / 3 2p/3 2p/3

- 每个双量子比特门以概率 p p p 后跟从 { I , X , Y , Z } ⊗ 2 ∖ { I ⊗ I } \{I,X,Y,Z\}^{\otimes 2} \setminus \{I \otimes I\} {I,X,Y,Z}⊗2∖{I⊗I} 均匀抽取的双量子比特Pauli错误

- 与CNOT门或态制备和测量相关的空闲位置,Pauli错误从 { X , Y , Z } \{X,Y,Z\} {X,Y,Z} 均匀抽取,概率为 p p p

| 超参数 | 值 |

|---|---|

| 每轮样本数 | 67,108,864 |

| 训练轮数 | 100 |

| 每GPU批次大小 | 第1轮: 512, 第≥2轮: 2048 |

| GPU数量 | 8 |

| 优化器 | Lion: 权重衰减=10⁻⁷, beta2=0.95 |

| 学习率调度 | 预热后衰减(100预热步骤),在[0.25, 0.5, 1.0]处以γ=0.7衰减 |

| 学习率 | 模型1=3×10⁻⁴, 模型2=2×10⁻⁴, 模型3=1×10⁻⁴, 模型4=2×10⁻⁴, 模型5=1×10⁻⁴ |

| 激活函数 | GeLU(tanh近似) |

| Dropout | 0.05 |

| 指数移动平均(ema) | 衰减=0.0001 |

表3:训练模型1至5的超参数。

Table 3: Hyperparameters used to train models 1 to 5 from Table 2. The γ=0.7 is applied to the learning rate at milestones [0.25,0.5,1.0]. For instance, the first milestone 0.25 indicates that at 25% of training steps, the learning rate becomes 0.7×base. The tanh approximation of GeLU uses the function GeLU(x)≈0.5x(1+tanh(2/π(x+0.044715x3))).

VI.1 无关联PyMatching的逻辑错误率和综合征密度

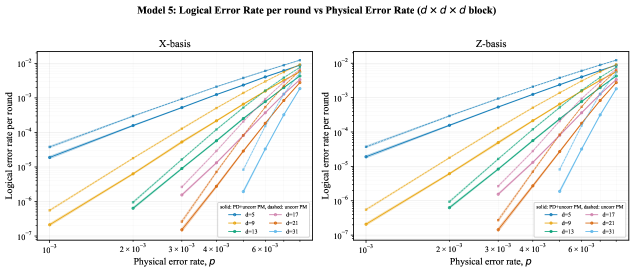

Figure 13: Plots of per-round LER for uncorrelated PyMatching (dashed lines) vs per-round LER of a pre-decoder model followed by uncorrelated PyMatching (solid lines). Due to the low LER’s at (31,31,31), we only provide data near threshold. In (a) we use model 1 from Table 2 (which corresponds to the fastest model, see Section VI.3) whereas in (b) we use model 5.

本节我们比较单独使用无关联PyMatching获得的逻辑错误率(LER)与使用预解码器后接无关联PyMatching获得的LER。

我们关注表2中的模型1和模型5,分别代表最快和最高容量的预解码器架构。模型1在所有考虑的预解码器中实现最低推断运行时间,但由于其有限的深度和通道宽度,也表现出最小的LER改进。对于 p ≳ 0.004 p \gtrsim 0.004 p≳0.004,使用模型1后接PyMatching获得的LER低于单独PyMatching。然而,在较低的 p p p 值下,存在模型1+PyMatching略逊于单独PyMatching的regime。此行为是预期的,因为训练期间损失的大部分贡献来自较高 p p p 样本。

相比之下,模型5在几乎所有考虑的码距和物理错误率上一致优于单独PyMatching。对于 p = 0.006 p = 0.006 p=0.006,模型1和5获得的LER改进因子总结于表4中。

| 模型 | d=5 | d=9 | d=13 | d=17 | d=21 | d=31 |

|---|---|---|---|---|---|---|

| 模型1 | 1.29x | 1.24x | 1.27x | 1.29x | 1.33x | 1.44x |

| 模型4 | 1.44x | 1.66x | 1.76x | 1.98x | 2.28x | 3.21x |

| 模型5 | 1.50x | 1.90x | 2.08x | 2.48x | 2.96x | 4.66x |

表4:在 p = 0.006 p=0.006 p=0.006 时,模型1、4和5后接无关联PyMatching相对于单独无关联PyMatching的LER改进因子(X基)。

Table 4: LER improvement factor (X-basis) for models 1, 4 and 5 of Table 2 followed by uncorrelated PyMatching compared to uncorrelated PyMatching alone. All data is obtained at p=0.006.

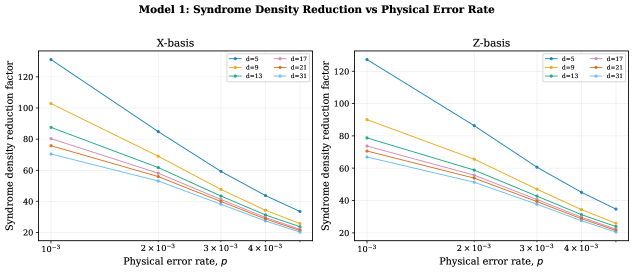

Figure 14: Plots of the syndrome density reduction factor for models 1 and 5 as a function of the physical error rate p at various code distances. In (a) we show results for model 1 and in (b) for model 5.

图14展示了模型1和5实现的综合征密度降低(SDR)因子。较大的综合征密度降低直接转化为更快的全局解码。最大的SDR增益发生在较低的 p p p 值,这与预解码器的局部性质一致。

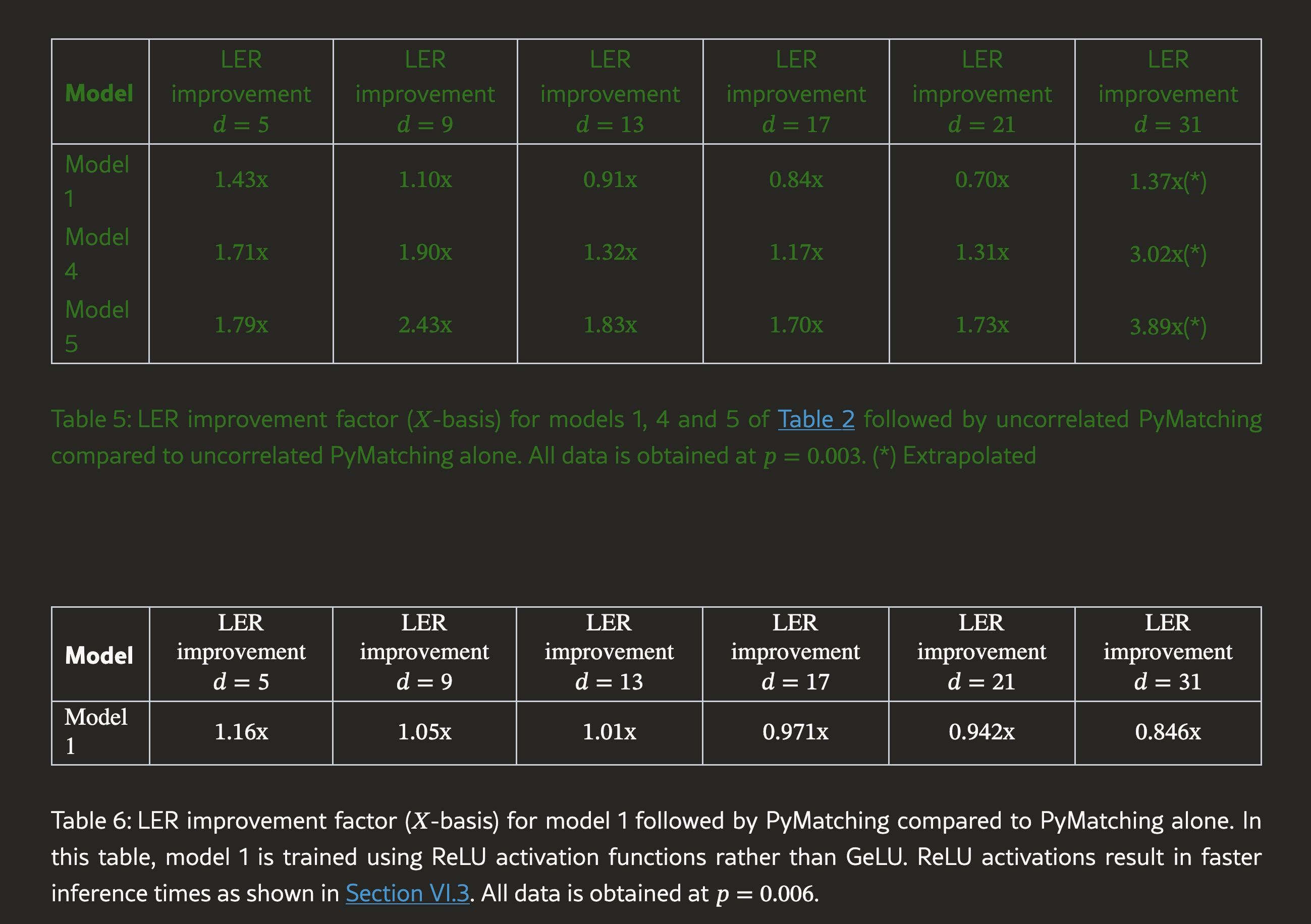

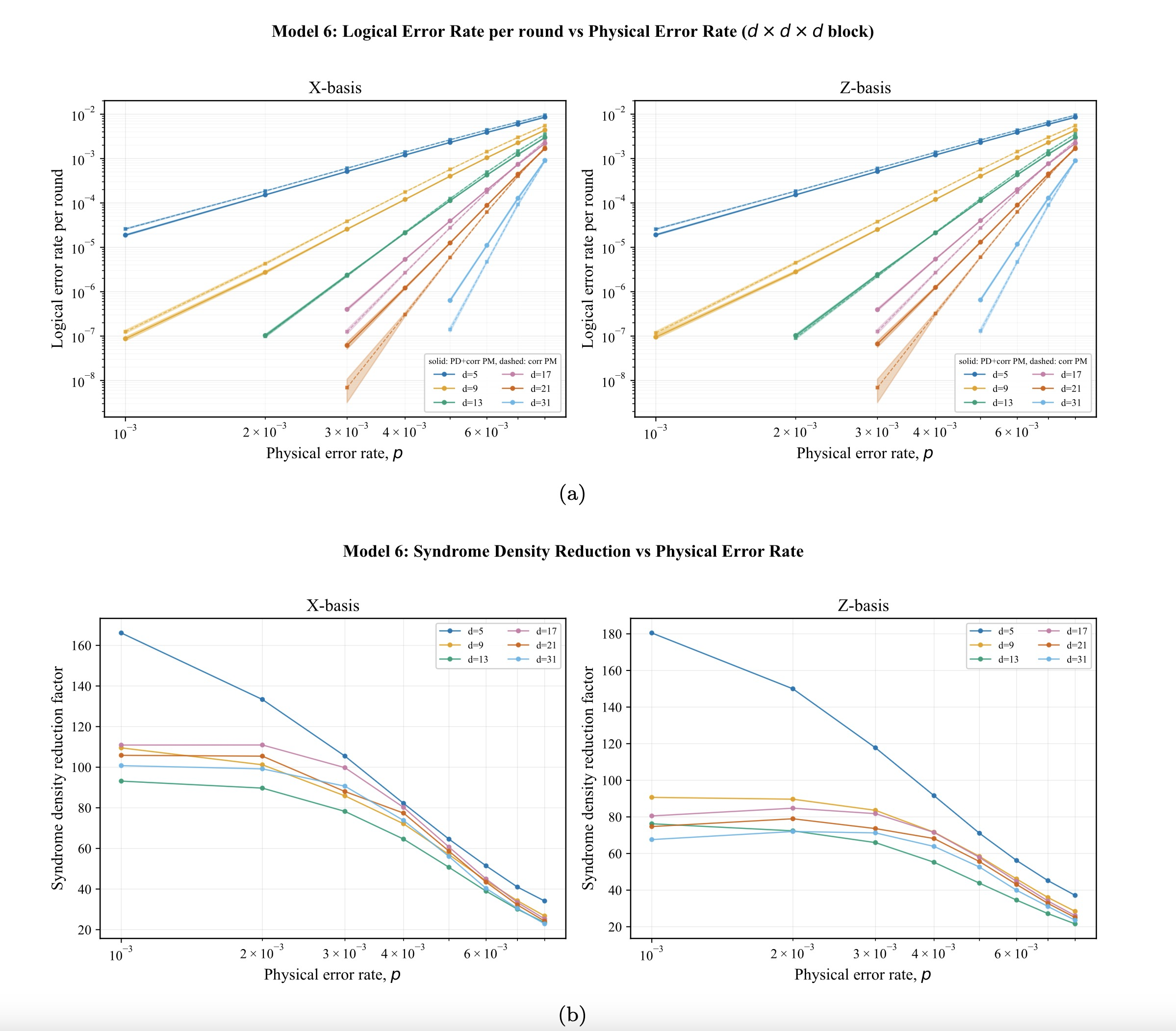

VI.2 关联匹配全局解码器的逻辑错误率和综合征密度

本节我们对全局解码器使用关联匹配解码器进行类似分析。关联匹配解码器通过使用超边信息实现比无关联PyMatching更低的LER。

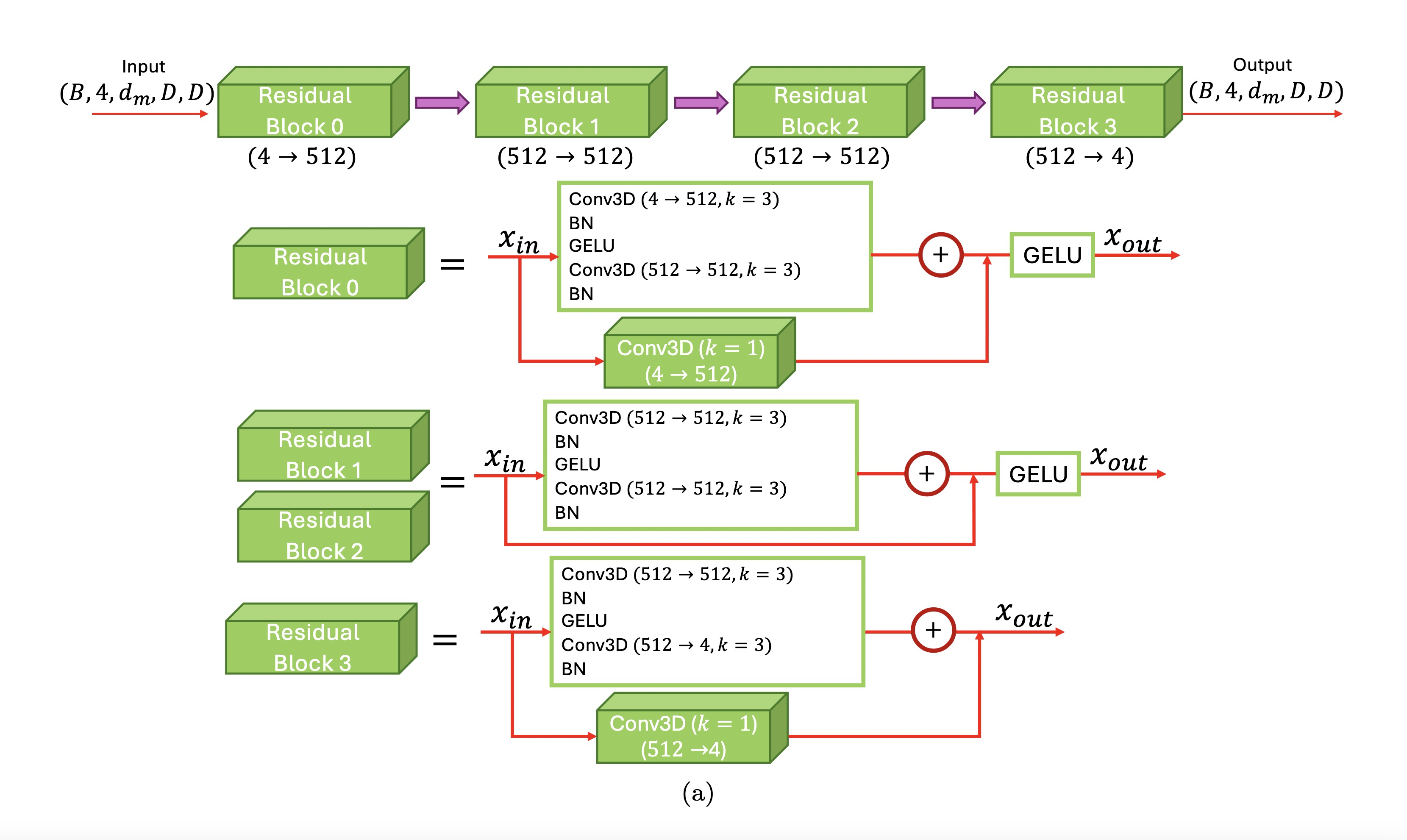

当考虑关联匹配作为全局解码器时,我们发现表2中的预解码器模型导致比单独关联匹配更高的LER。原因是大多数产生逻辑故障的预解码器残余错误具有形成长度大于 ( d − 1 ) / 2 (d-1)/2 (d−1)/2 且平行于逻辑可观测量的字符串的结构。为缓解此问题,我们使用图15所示的更大CNN网络(模型6)。

模型6是一个全卷积3D残差网络,由四个残差块组成,每个块包含两个 3 × 3 × 3 3 \times 3 \times 3 3×3×3 卷积与BatchNorm。第一个块将通道维度从4扩展到512,最终块通过 1 × 1 × 1 1 \times 1 \times 1 1×1×1 投影捷径从512压缩到4;中间块使用恒等跳跃连接。该网络感受野大小为17,总参数量为42,593,296。

Figure 15: Pre-decoder neural network architecture used when the global decoder employs correlated matching. The model is a fully convolutional 3D residual network composed of four residual blocks, each containing two 3×3×3 convolutions with BatchNorm. The first block expands channel dimension from 4 to 512, and the final block compresses from 512 to 4 via 1×1×1 projection shortcuts; intermediate blocks use identity skip connections. Residual connections are employed to improve gradient flow and stabilize deep optimization. The network has a receptive field of size 17 and the total number of parameters for this network is 42,593,296.

预解码器与关联PyMatching组合的LER结果如图16所示。预解码器在 d = 5 , 9 d=5, 9 d=5,9 和13处改善了LER。在 d ≥ 17 d \geq 17 d≥17 处,LER略差。

| d | p | 关联PyMatching (μs/轮) | 关联PyMatching后预解码 (μs/轮) | 加速 |

|---|---|---|---|---|

| 5 | 0.003 | 1.15 | 0.61 | 1.9x |

| 5 | 0.006 | 1.78 | 0.69 | 2.6x |

| 9 | 0.003 | 3.35 | 1.01 | 3.3x |

| 9 | 0.006 | 7.51 | 1.73 | 4.3x |

| 13 | 0.003 | 9.14 | 2.67 | 3.4x |

| 13 | 0.006 | 21.51 | 4.53 | 4.8x |

| 17 | 0.003 | 24.12 | 5.82 | 4.1x |

| 17 | 0.006 | 50.63 | 8.68 | 5.8x |

| 21 | 0.003 | 49.75 | 10.31 | 4.8x |

| 21 | 0.006 | 92.27 | 14.72 | 6.3x |

| 31 | 0.003 | 133.31 | 22.78 | 5.9x |

| 31 | 0.006 | 270.83 | 38.78 | 7.0x |

表9:使用模型6预解码器前后关联PyMatching的解码时间。

VI.3 运行时间性能

本节我们分析预解码器本身的运行时间以及组合预解码器+无关联和关联PyMatching实现的端到端解码运行时间。

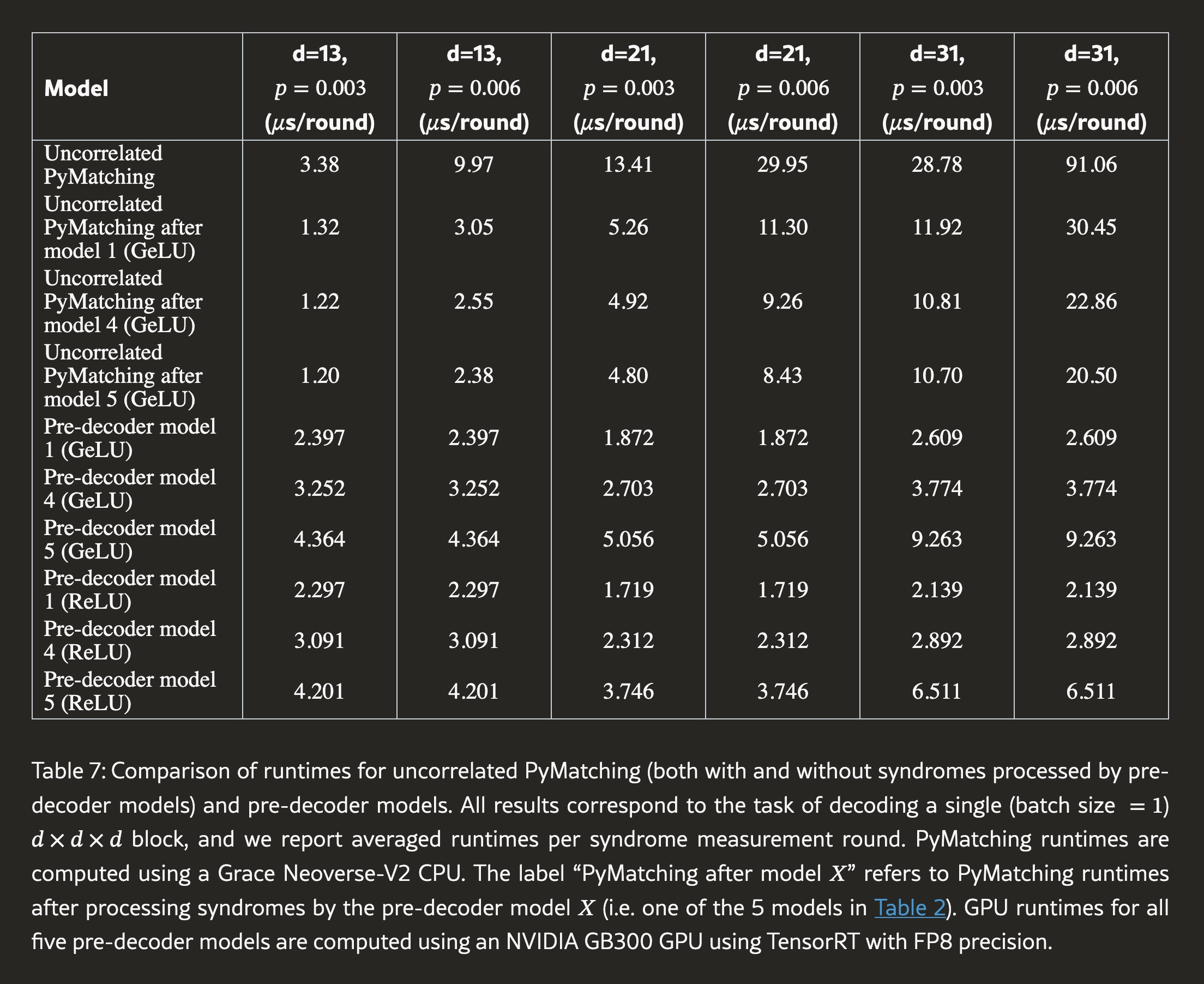

| 配置 | d=13,p=0.003 | d=13,p=0.006 | d=21,p=0.003 | d=21,p=0.006 | d=31,p=0.003 | d=31,p=0.006 |

|---|---|---|---|---|---|---|

| 无关联PyMatching | 3.38 | 9.97 | 13.41 | 29.95 | 28.78 | 91.06 |

| PyMatching后模型1(GeLU) | 1.32 | 3.05 | 5.26 | 11.30 | 11.92 | 30.45 |

| PyMatching后模型4(GeLU) | 1.22 | 2.55 | 4.92 | 9.26 | 10.81 | 22.86 |

| PyMatching后模型5(GeLU) | 1.20 | 2.38 | 4.80 | 8.43 | 10.70 | 20.50 |

| 预解码器模型1(GeLU) | 2.397 | 2.397 | 1.872 | 1.872 | 2.609 | 2.609 |

| 预解码器模型4(GeLU) | 3.252 | 3.252 | 2.703 | 2.703 | 3.774 | 3.774 |

| 预解码器模型5(GeLU) | 4.364 | 4.364 | 5.056 | 5.056 | 9.263 | 9.263 |

| 预解码器模型1(ReLU) | 2.297 | 2.297 | 1.719 | 1.719 | 2.139 | 2.139 |

| 预解码器模型4(ReLU) | 3.091 | 3.091 | 2.312 | 2.312 | 2.892 | 2.892 |

| 预解码器模型5(ReLU) | 4.201 | 4.201 | 3.746 | 3.746 | 6.511 | 6.511 |

表7:无关联PyMatching(有和没有预解码器处理)和预解码器模型的运行时间比较。所有结果对应解码单个 d × d × d d \times d \times d d×d×d 块,报告每轮平均运行时间。PyMatching运行时间在Grace Neoverse-V2 CPU上计算。预解码器运行时间在NVIDIA GB300 GPU上使用TensorRT以FP8精度计算。

预解码器运行时间测量使用NVIDIA TensorRT的trtexec工具以FP8推断进行。关键发现:

- 预解码器运行时间独立于物理错误率 p p p,而无关联和关联PyMatching运行时间强烈依赖于通过综合征密度的 p p p

- 将GeLU替换为ReLU激活函数可进一步降低运行时间

- 使用模型1(ReLU),组合预解码器+无关联PyMatching在 d = 31 d=31 d=31 和 p = 0.006 p=0.006 p=0.006 时实现总加速2.75倍

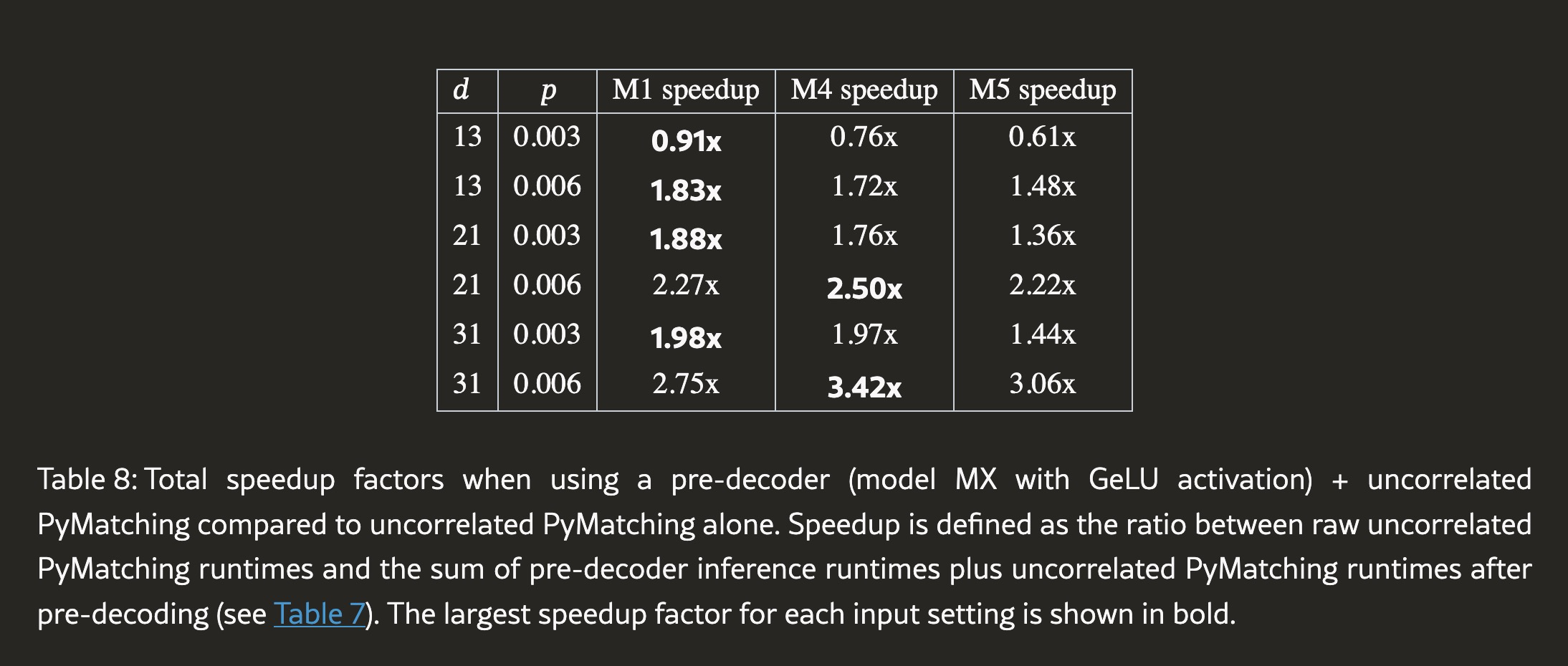

| d | p | M1加速 | M4加速 | M5加速 |

|---|---|---|---|---|

| 13 | 0.003 | 0.91x | 0.76x | 0.61x |

| 13 | 0.006 | 1.83x | 1.72x | 1.48x |

| 21 | 0.003 | 1.88x | 1.76x | 1.36x |

| 21 | 0.006 | 2.27x | 2.50x | 2.22x |

| 31 | 0.003 | 1.98x | 1.97x | 1.44x |

| 31 | 0.006 | 2.75x | 3.42x | 3.06x |

表8:使用预解码器(GeLU激活的模型MX)+无关联PyMatching相对于单独无关联PyMatching的总加速因子。

图19展示了不同解码策略的LER与单次运行时间的权衡。我们看到预解码器模型与全局解码器选择之间存在权衡。在 p = 0.006 p=0.006 p=0.006 时,模型5+无关联PyMatching(深蓝色曲线)在 d ≥ 13 d \geq 13 d≥13 时相比关联PyMatching(灰色曲线)同时实现了LER和运行时间的降低。

VI.4 通过时间并行窗口解码实现更快的预解码器

训练好的预解码器可部署在时间并行窗口解码协议中。具体地,预解码器应用于提交区域(及其相关缓冲轮)和清理区域。当为每个块分配专用GPU时,每个提交块(和每个清理块)可独立并行解码。或者,单GPU可通过使用大于1的批次大小同时处理多个块。

| 模型 | 精度 | 批次大小 | d | 轮数 | 时间(μs)/轮 | GPU数 |

|---|---|---|---|---|---|---|

| 1 | FP8 | 1 | 13 | 1000 | 0.11 | 13 |

| 1 | FP8 | 2 | 13 | 1000 | 0.13 | 7 |

| 1 | FP8 | 4 | 13 | 1000 | 0.179 | 4 |

| 1 | FP8 | 1 | 21 | 1000 | 0.179 | 8 |

| 1 | FP8 | 2 | 21 | 1000 | 0.244 | 4 |

| 1 | FP8 | 4 | 21 | 1000 | 0.423 | 2 |

表11:在使用参考文献[30,31]的时间并行窗口解码方案时,每轮解码时间随批次大小的变化。

如表11所示,增加批次大小减少了所需GPU数量,同时相应增加每轮解码时间。然而,在所有考虑的配置中,每轮解码时间仍远低于 1 μ s 1\mu s 1μs。

VI.5 噪声学习模型评估

本节我们评估图12a中训练的噪声学习模型在来自两个连续轮的表面码综合征统计信息上的表现。

图20a展示了使用噪声学习模型预测的概率向量构建DEM时关联和无关联PyMatching的相对LER。四个噪声学习模型被训练:两个在 d = 21 d=21 d=21,两个在 d = 31 d=31 d=31。对于每个码距,我们考虑有偏和无偏损失函数。使用无偏损失在 d = 31 d=31 d=31 训练的模型通常在应用于 d = 21 d=21 d=21 和 d = 31 d=31 d=31 数据时提供最佳结果。

我们还注意到,与从电路级噪声模型直接计算概率的基线结果相比,关联PyMatching的LER有改善。然而对于无关联匹配,从噪声学习模型计算的边权重接近基线结果但略有不足。

图20b展示了将噪声学习模型应用于模型5预解码器的综合征输出。我们看到在关联或无关联PyMatching中使用预测概率导致的性能略差于在DEM中使用原始电路级概率。这看似反直觉,因为预解码器产生与原始DEM不同的综合征统计信息。然而,模型5预解码器校正的大多数残余错误具有非常特定的结构:几乎所有导致逻辑故障的残余错误形成长度大于 ( d − 1 ) / 2 (d-1)/2 (d−1)/2 且平行于感兴趣逻辑可观测量的字符串。

VII. 通过批处理改进并行化

回顾避免指数积压所需的并行资源数 N par N_{\text{par}} Npar 由公式4给出。从表7,在 p = 0.006 p=0.006 p=0.006 和输入体积大小 ( 13 , 13 , 13 ) (13,13,13) (13,13,13) 时,使用纯无关联PyMatching的解码器需要 N par = 8 N_{\text{par}} = 8 Npar=8。另一方面,我们的预解码器后接无关联PyMatching需要 N par = 5 N_{\text{par}} = 5 Npar=5,同时在使用表2中模型1时每个块给出1.993倍的整体加速(假设使用ReLU激活函数)。

使用图17a的结果,当增加GPU使用的批次大小时可进一步改善 N par N_{\text{par}} Npar。例如,在批次大小为2时,处理输入体积 ( 13 , 13 , 13 ) (13,13,13) (13,13,13) 的预解码器运行时间不变。因此,两个逻辑量子比特可并行解码而不影响方程4中的 T DEC T_{\text{DEC}} TDEC。

| 批次大小 | N par N_{\text{par}} Npar 改进 | 加速因子 |

|---|---|---|

| 2 | 3.2x | 1.993x |

| 4 | 3.56x | 0.996x |

| 64 | 12.49x | 0.2x |

表13: N par N_{\text{par}} Npar 的改进及对应加速因子(来自图17a的数据)。所有数据在 p = 0.006 p=0.006 p=0.006 和输入体积 ( 13 , 13 , 13 ) (13,13,13) (13,13,13) 下获得。

VIII. 结论

本文我们引入了一种用于旋转表面码的可扩展基于AI的预解码器架构。该架构执行局部、并行纠错,具有低解码运行时间,在将残余综合征传递给下游全局解码器之前去除大部分物理错误。关键成果包括:

-

速度与精度的同时提升:在码距 d ≥ 21 d \geq 21 d≥21 时,预解码器+PyMatching流水线同时实现了比单独PyMatching更低的LER和更低的总解码运行时间。在 d = 31 d=31 d=31 和 p = 0.006 p=0.006 p=0.006 时,总加速达3.4倍。

-

GPU高效部署:在NVIDIA GB300 GPU上以FP8精度,预解码器运行时间可低于每轮 1 μ s 1\mu s 1μs。在时间并行块级解码方案中,使用多个GPU可实现远低于 1 μ s 1\mu s 1μs 的每轮运行时间。

-

噪声学习:我们引入了从综合征统计信息推断近最优边权重的架构,无需显式噪声模型。应用于原始综合征数据时,学习到的权重几乎匹配无关联PyMatching并改善关联PyMatching。

-

开源实现:完整实现已在GitHub上开源,预训练模型可在Hugging Face获取。

未来工作的重要方向是将我们的架构适配于通过晶格手术在块级并行解码(空间和时间两者)中执行的逻辑操作解码。我们相信我们的预解码器将很好适应此类设置,推动我们更接近实现通用容错量子计算的实时解码。

附录A 边权重计算

本附录提供计算表面码匹配图中使用的边权重的详细信息。图7所示的 d = 5 d=5 d=5 表面码电路包含在任意码距下获得的所有不同类型的边。

A.1 电路级噪声模型

我们使用具有25个参数的电路级噪声模型。每个CNOT门具有15个两量子比特Pauli通道,每个单量子比特操作具有参数。25个噪声参数为:

- P C X ( p q ) P_{CX}^{(pq)} PCX(pq) 对于 p , q ∈ { I , X , Y , Z } p,q \in \{I,X,Y,Z\} p,q∈{I,X,Y,Z}, p ≠ I p \neq I p=I 或 q ≠ I q \neq I q=I(15个参数)

- P I ( X ) P_I^{(X)} PI(X), P I ( Y ) P_I^{(Y)} PI(Y), P I ( Z ) P_I^{(Z)} PI(Z)(3个单量子比特错误参数)

- P S X P_{S_X} PSX, P S Z P_{S_Z} PSZ(2个态制备参数)

- P M X P_{M_X} PMX, P M Z P_{M_Z} PMZ(2个测量参数)

- P idle P_{\text{idle}} Pidle(1个空闲参数)

- P crosstalk P_{\text{crosstalk}} Pcrosstalk(2个串扰参数)

A.2 边权重公式

匹配图中边的权重计算为 w = − log ( p / ( 1 − p ) ) w = -\log(p/(1-p)) w=−log(p/(1−p)),其中 p p p 是对应错误机制的概率。

A.3 边类型概率公式

对于 X X X 型和 Z Z Z 型稳定子图,我们有以下边类型:

A.3.1 类空边

P S 1 ( X ) = ⨁ [ P C X ( I Y ) , P C X ( Y Y ) , P C X ( Y Z ) + P C X ( Z Z ) , P C X ( I Z ) , P C X ( I Z ) , P C X ( Z I ) + P C X ( Z Z ) , P I ( Z ) , P I ( Z ) , P I ( Z ) ] P_{S1}^{(X)} = \bigoplus[P_{CX}^{(IY)}, P_{CX}^{(YY)}, P_{CX}^{(YZ)}+P_{CX}^{(ZZ)}, P_{CX}^{(IZ)}, P_{CX}^{(IZ)}, P_{CX}^{(ZI)}+P_{CX}^{(ZZ)}, P_I^{(Z)}, P_I^{(Z)}, P_I^{(Z)}] PS1(X)=⨁[PCX(IY),PCX(YY),PCX(YZ)+PCX(ZZ),PCX(IZ),PCX(IZ),PCX(ZI)+PCX(ZZ),PI(Z),PI(Z),PI(Z)]

(其他类空边类型公式类似)

A.3.2 类时边

P T 1 ( X ) = ⨁ [ P C X ( Z I ) , P C X ( Y I ) + P C X ( Z I ) , P S X , P S X , P C X ( Y X ) , P C X ( Y I ) , P C X ( Z X ) , P C X ( Y X ) + P C X ( Z X ) ] P_{T1}^{(X)} = \bigoplus[P_{CX}^{(ZI)}, P_{CX}^{(YI)}+P_{CX}^{(ZI)}, P_{S_X}, P_{S_X}, P_{CX}^{(YX)}, P_{CX}^{(YI)}, P_{CX}^{(ZX)}, P_{CX}^{(YX)}+P_{CX}^{(ZX)}] PT1(X)=⨁[PCX(ZI),PCX(YI)+PCX(ZI),PSX,PSX,PCX(YX),PCX(YI),PCX(ZX),PCX(YX)+PCX(ZX)]

(其他类时边类型公式类似)

A.3.3 对角边

P D 1 ( X ) = ⨁ [ P C X ( Z Z ) , P C X ( Y Y ) , P C X ( Z Y ) , P C X ( Y Z ) ] P_{D1}^{(X)} = \bigoplus[P_{CX}^{(ZZ)}, P_{CX}^{(YY)}, P_{CX}^{(ZY)}, P_{CX}^{(YZ)}] PD1(X)=⨁[PCX(ZZ),PCX(YY),PCX(ZY),PCX(YZ)]

(其他对角边类型公式类似)

A.3.4 边界边

边界边类型的公式具有更多XOR组件,代表边界稳定子位置的额外错误机制。

参考文献

[1] C. Chamberland et al., “Techniques for combining fast local decoders with global decoders under circuit-level noise,” Quantum Science and Technology, 2023.

[2] A. W. Senior et al., “A scalable and real-time neural decoder for topological quantum codes,” arXiv:2512.07737, 2025.

[3] NVIDIA, “NVQLink Architecture Whitepaper,” 2024.

[4] S. Gicev, L. C. L. Hollenberg, and M. Usman, “A scalable and fast artificial neural network syndrome decoder for surface codes,” Quantum, 2023.

[5] R. Chao and B. W. Reichardt, “Quantum error correction with only two extra qubits,” Physical Review Letters, 2018.

[6] C. Chamberland and E. T. Campbell, “Universal quantum computing with twist-free and temporally encoded lattice surgery,” PRX Quantum, 2022.

[7] C. Chamberland et al., “Techniques for combining fast local decoders with global decoders under circuit-level noise,” Quantum Science and Technology, 2023.

[8] C. Chamberland and K. Noh, “Very low overhead fault-tolerant magic state preparation using redundant ancilla encoding and flag qubits,” npj Quantum Information, 2020.

[9] C. Chamberland et al., “Techniques for combining fast local decoders with global decoders under circuit-level noise,” Quantum Science and Technology, 2023.

[10] C. Chamberland and K. Noh, “Very low overhead fault-tolerant magic state preparation using redundant ancilla encoding and flag qubits,” npj Quantum Information, 2020.

[11] C. Chamberland and P. Ronagh, “Deep neural decoders for near term fault-tolerant experiments,” Quantum Science and Technology, 2018.

[12] R. Chao and B. W. Reichardt, “Quantum error correction with only two extra qubits,” Physical Review Letters, 2018.

[13] R. Chao and B. W. Reichardt, “Flag fault-tolerant error correction for any stabilizer code,” PRX Quantum, 2020.

[14] N. Delfosse and N. H. Nickerson, “Almost-linear time decoding algorithm for topological codes,” Quantum, 2021.

[15] E. Dennis, A. Kitaev, A. Landahl, and J. Preskill, “Topological quantum memory,” Journal of Mathematical Physics, 2002.

[16] J. Edmonds, “Paths, trees, and flowers,” Canadian Journal of Mathematics, 1965.

[17] A. G. Fowler and C. Gidney, “Low overhead quantum computation using lattice surgery,” arXiv:1808.06709, 2018.

[18] A. G. Fowler, M. Mariantoni, J. M. Martinis, and A. N. Cleland, “Surface codes: towards practical large-scale quantum computation,” Physical Review A, 2012.

[19] S. Gicev, L. C. L. Hollenberg, and M. Usman, “A scalable and fast artificial neural network syndrome decoder for surface codes,” Quantum, 2023.

[20] S. Gicev, L. C. L. Hollenberg, and M. Usman, “Fully convolutional 3D neural network decoders for surface codes with syndrome circuit noise,” arXiv:2506.16113, 2025.

[21] O. Higgott and C. Gidney, “Sparse Blossom: correcting a million errors per core second with minimum-weight matching,” Quantum, 2025.

[22] O. Higgott, “PyMatching: a python package for decoding quantum codes with minimum-weight perfect matching,” ACM Transactions on Quantum Computing, 2022.

[23] G. Hinton, O. Vinyals, and J. Dean, “Distilling the knowledge in a neural network,” arXiv preprint arXiv:1503.02531, 2015.

[24] E. Knill, R. Laflamme, and L. Viola, “Theory of quantum error correction for general noise,” Physical Review Letters, 2000.

[25] D. Litinski and F. v. Oppen, “Lattice surgery with a twist: Simplifying Clifford gates of surface codes,” Quantum, 2018.

[26] D. Litinski, “A Game of Surface Codes: Large-Scale Quantum Computing with Lattice Surgery,” Quantum, 2019.

[27] P. Prabhu and C. Chamberland, “New magic state distillation factories optimized by temporally encoded lattice surgery,” arXiv:2210.15814, 2022.

[28] A. W. Senior et al., “A scalable and real-time neural decoder for topological quantum codes,” arXiv:2512.07737, 2025.

[29] P. W. Shor, “Scheme for reducing decoherence in quantum computer memory,” Physical Review A, 1995.

[30] L. Skoric et al., “Parallel window decoding enables scalable fault tolerant quantum computation,” Nature Communications, 2023.

[31] X. Tan et al., “Scalable Surface-Code Decoders with Parallelization in Time,” PRX Quantum, 2023.

[32] B. M. Terhal, “Quantum error correction for quantum memories,” Reviews of Modern Physics, 2015.

[33] Y. Tomita and K. M. Svore, “Low-distance surface codes under realistic quantum noise,” Physical Review A, 2014.

[34] K. Zhang et al., “LATTE: A Decoding Architecture for Quantum Computing with Temporal and Spatial Scalability,” arXiv:2509.03954, 2025.

[35] K. Zhang et al., “Learning to Decode in Parallel: Self-Coordinating Neural Network for Real-Time Quantum Error Correction,” arXiv:2601.09921, 2026.

https://arxiv.org/html/2604.12841v1

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)