本地部署大模型避坑实录|Ollama+AnythingLLM 一直加载、CPU 爆满、GPU 闲置问题完整解决

本地部署大模型避坑实录|Ollama+AnythingLLM 一直加载、CPU 爆满、GPU 闲置问题完整解决

前言

最近在本地搭建 Ollama + AnythingLLM 大模型运行环境,本以为流程很简单,结果接连遇到 界面无限加载、回复极慢、CPU 跑满 GPU 闲置 等问题。折腾许久才彻底解决,期间还踩了手动安装 CUDA 和驱动报错的坑。

一、问题现象描述

硬件环境

- CPU:i7-8700K

- 内存:32GB

- 显卡:NVIDIA RTX 2060 6GB

- 软件:Ollama + AnythingLLM

初始异常表现

- AnythingLLM 发送“你好”后一直加载,无任何回复

- 但直接在 Ollama 终端对话 可以正常回复

- 后续能回复后,速度极慢(几秒蹦一个字)

- 任务管理器中 CPU 占用拉满,GPU 纹丝不动

二、第一个坑:端口 11434 被占用

排查过程中,我手动执行服务启动命令:

ollama serve

直接报错:

Error: listen tcp 127.0.0.1:11434: bind: Only one usage of each socket address (protocol/network address/port) is normally permitted.

问题原因

Ollama 安装后会自动在后台运行服务,再次手动执行 ollama serve 导致端口冲突。

解决方法

taskkill /f /im ollama.exe

关闭所有 Ollama 进程后,端口占用问题解决,AnythingLLM 可以正常收发消息。

三、第二个坑:回复巨慢,CPU 满载、GPU 闲置

端口问题解决后,虽然能回复,但速度极其缓慢。

打开任务管理器发现:

- CPU 占用接近 100%

- GPU 显存与利用率几乎为 0

明显是模型没有调用 GPU,完全在 CPU 上推理,导致性能严重不足。

四、排查尝试:环境变量与手动安装 CUDA 均无效

为了解决 GPU 不调用的问题,我尝试了网上常见的两种方法,但都失败了:

-

设置环境变量无效

配置了OLLAMA_CUDA=1等变量,重启后问题依旧。 -

手动安装 CUDA Toolkit 无效

我怀疑是系统缺少 CUDA 库,于是下载并安装了cuda_13.2.0_windows_network。

结果:安装过程顺利,但重启后 Ollama 依然无法识别显卡,速度没有提升。

结论:Ollama 在 Windows 下通常自带所需的 CUDA 库,不需要用户手动安装 CUDA Toolkit。问题不在于缺库,而在于显卡驱动本身。

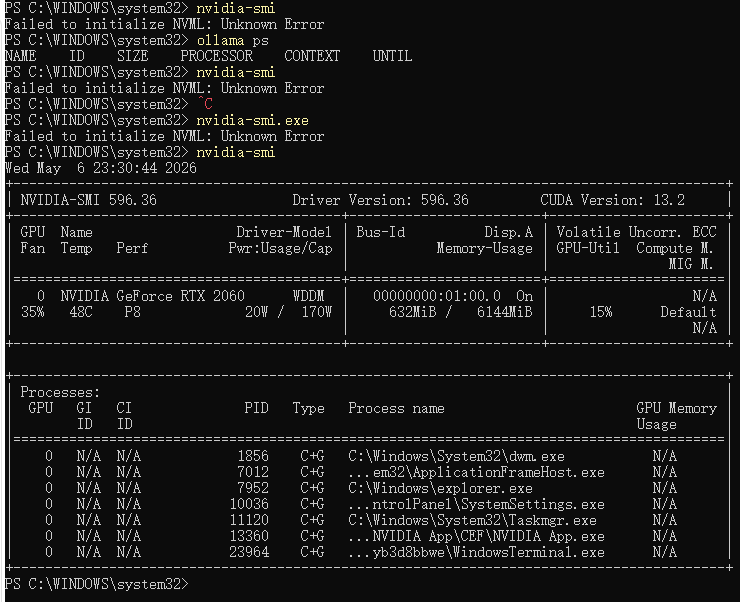

五、关键排查:nvidia-smi 报错与驱动真相

为了进一步确认显卡状态,我执行了命令:

nvidia-smi

意外发现:

终端报错 Failed to initialize NVML: Unknown Error。

原因分析:

- 虽然电脑之前一直在玩游戏,看似驱动正常,但安装的是 Game Ready 游戏驱动。

- 这种驱动对 AI 推理场景(CUDA 计算)的兼容性较差,甚至会导致 NVML 初始化失败,使得 Ollama 无法检测到显卡。

- 之前手动安装 CUDA Toolkit 无效,正是因为底层驱动(Driver)本身就不支持或存在冲突。

六、最终解决方案:更换 NVIDIA Studio 驱动

既然 Game Ready 驱动不行,必须更换为面向创作和计算的 NVIDIA Studio 驱动。

操作步骤:

- 前往 NVIDIA 官网驱动下载页面。

- 产品类型选择 Studio 驱动(而非 Game Ready)。

- 安装时选择 自定义安装 + 勾选“执行清洁安装”(这一步很重要,能清除旧驱动残留)。

- 安装完成后重启电脑。

七、最终成功:GPU 正常加速

重启后再次验证:

-

检查驱动状态:执行

nvidia-smi,不再报错,成功显示显卡信息。

-

检查 Ollama 日志:执行

ollama serve,日志中出现:inference compute: CUDA name: NVIDIA GeForce RTX 2060 total_vram: 6.0 GiB表示 GPU 已被正常识别并启用 CUDA 加速。

-

实测效果:

- AnythingLLM 发送消息秒回。

- CPU 占用率恢复正常(个位数)。

- GPU 利用率跑满,显存被占用。

八、总结(干货速查)

-

AnythingLLM 一直加载

→ 端口 11434 被占用,执行taskkill /f /im ollama.exe即可。 -

模型回复慢、CPU 跑满、GPU 闲置

→ Ollama 未识别显卡,强制使用 CPU 推理。 -

手动安装 CUDA Toolkit 无效

→ Ollama 自带 CUDA 库,不需要手动装。根本原因通常是显卡驱动不匹配。 -

nvidia-smi 报错或 Ollama 不识别显卡

→ 即使玩游戏正常,也请将 Game Ready 驱动 更换为 NVIDIA Studio 驱动,并进行清洁安装。 -

判断是否成功启用 GPU

→ 运行ollama serve,日志出现CUDA+ 显卡型号即成功。

希望这个版本能帮到更多遇到同样问题的人!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)