Dify 接入 ClaudeAPI.com 完整教程:在 Dify 中使用 Claude 模型

Dify 接入 ClaudeAPI.com 完整教程:在 Dify 中使用 Claude 模型

最近很多人在用 Dify 搭建自己的 AI 应用,比如客服机器人、知识库问答、Agent 工作流、企业内部助手等。

Dify 本身已经支持很多模型供应商,但如果想在 Dify 里使用 Claude 系列模型,最简单的方式之一就是通过 OpenAI API 兼容接口 来接入。

本文记录一次完整的配置流程:如何通过 ClaudeAPI.com,把 Claude 模型接入 Dify。

整体流程不复杂,主要分为:

- 准备 Dify 环境

- 安装 OpenAI-API-compatible 插件

- 添加 Claude 模型

- 在应用中调用模型

- 排查常见报错

适合刚开始使用 Dify 的开发者参考。

一、准备工作

开始之前,需要先准备好下面几项内容。

| 项目 | 说明 |

|---|---|

| Dify 账号 | 可以使用 Dify Cloud,也可以 Docker 自部署 |

| API Key | 在 ClaudeAPI.com 控制台获取 |

| API Base URL | https://gw.claudeapi.com/v1 |

| 模型 ID | 例如 claude-sonnet-4-6、claude-opus-4-7 |

这里需要注意一点:

Dify 接入第三方模型时,最关键的是 接口格式是否兼容。

ClaudeAPI.com 提供的是 OpenAI API 兼容格式,因此可以直接配合 Dify 的 OpenAI-API-compatible 插件使用,不需要额外写适配代码。

二、选择 Dify 使用方式

Dify 有两种常见使用方式:Cloud 版和自部署版。

如果只是测试、学习、快速搭建应用,建议直接使用 Dify Cloud。

如果对数据隔离、私有化部署、内网环境有要求,可以选择 Docker 自部署。

方式一:使用 Dify Cloud

直接访问:

https://dify.ai

注册并登录账号即可使用。

这种方式的优点是:

- 不需要服务器

- 不需要 Docker

- 不需要维护环境

- 适合新手快速上手

如果只是想验证 Claude 模型能不能在 Dify 里跑通,推荐先用 Cloud 版测试。

方式二:Docker 自部署 Dify

如果你有自己的服务器,也可以使用 Docker Compose 部署 Dify。

官方部署方式如下:

git clone https://github.com/langgenius/dify.git

cd dify/docker

cp .env.example .env

docker compose up -d

启动完成后,访问:

http://你的服务器IP/install

如果是在本地部署,则访问:

http://localhost/install

完成初始化后即可进入 Dify 后台。

官方文档地址:

https://docs.dify.ai/en/self-host/quick-start/docker-compose

一般来说,测试环境最低建议配置:

| 配置 | 建议 |

|---|---|

| CPU | 2 核及以上 |

| 内存 | 4 GiB 及以上 |

| 磁盘 | 20GB 以上更稳 |

如果后续要跑知识库、向量检索、多个应用,建议配置再高一些。

三、安装 OpenAI-API-compatible 插件

登录 Dify 后,进入模型供应商配置页面:

右上角头像 → Settings → Model Providers

在模型供应商或插件列表中找到:

OpenAI-API-compatible

然后点击安装。

插件地址:

https://marketplace.dify.ai/plugin/langgenius/openai_api_compatible

这个插件的作用是让 Dify 可以调用兼容 OpenAI API 格式的第三方模型服务。

也就是说,只要接口格式符合 OpenAI API 调用规范,就可以通过这个插件接入 Dify。

ClaudeAPI.com 正好提供了这种兼容接口,所以这里不需要额外开发 Provider,也不需要改 Dify 源码。

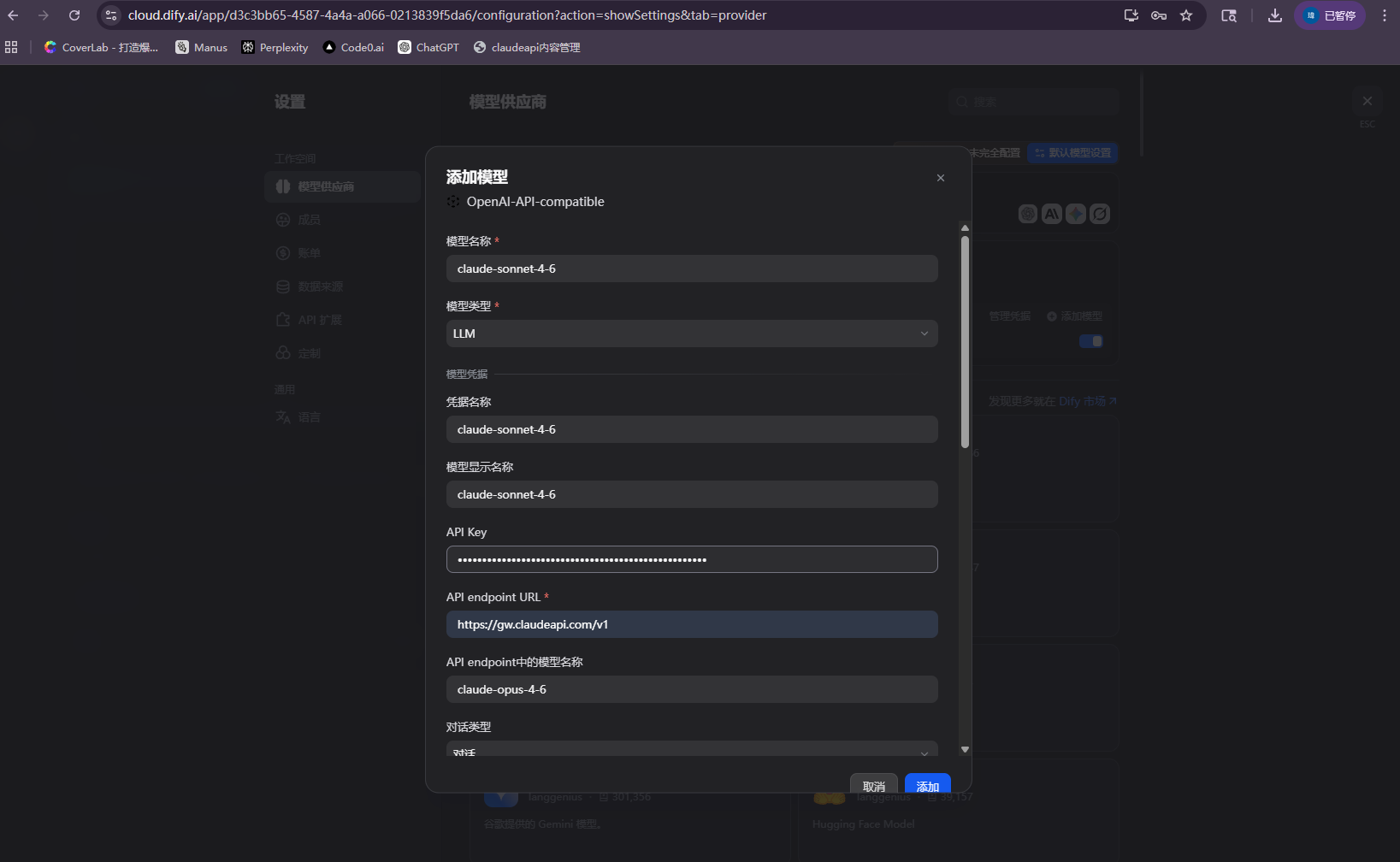

四、添加 Claude 模型

插件安装完成后,进入 OpenAI-API-compatible 配置页面,点击:

Add Model

然后按照下面的信息填写。

| 配置项 | 填写内容 |

|---|---|

| Model Type | LLM |

| Model Name | claude-sonnet-4-6 |

| API Key | ClaudeAPI.com 控制台获取的 API Key |

| API Endpoint URL | https://gw.claudeapi.com/v1 |

| Completion mode | Chat |

| Stream | 建议开启 |

这里最容易出错的是 Model Name。

模型名称必须填写准确的模型 ID,不能写中文名,也不能写简称。

例如:

正确写法:

claude-sonnet-4-6

claude-opus-4-7

claude-haiku-4-5-20251001

错误写法:

Claude Sonnet

Claude 4.6

sonnet-4

opus

如果模型 ID 写错,后面调用时很容易出现:

model not found

所以这里建议直接从控制台或模型列表复制,不要手动猜名称。

五、测试模型是否可用

保存模型配置后,可以先在 Dify 的模型配置页面里输入一个简单问题测试。

例如:

你好,请用一句话介绍一下你自己。

如果模型能正常返回内容,说明 Dify 和接口已经连通。

如果没有返回,先不要急着改应用配置,优先检查这几个地方:

- API Key 是否正确

- API Endpoint URL 是否带了

/v1 - 模型 ID 是否填写准确

- 当前服务器网络是否能访问接口

其中 Base URL 一定要写完整:

https://gw.claudeapi.com/v1

不要写成:

https://gw.claudeapi.com

少了 /v1 是非常常见的错误。

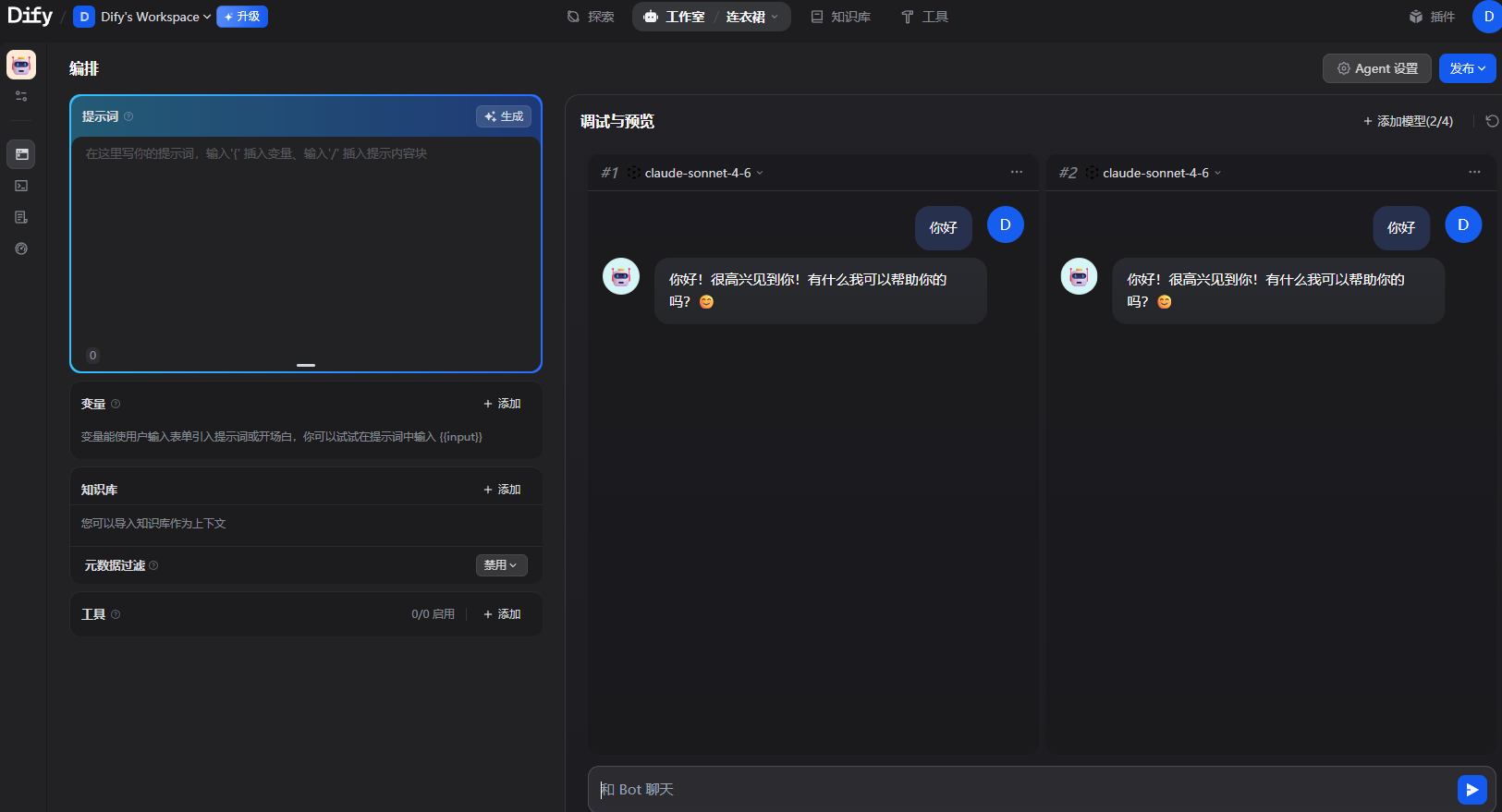

六、在 Dify 应用中使用 Claude 模型

模型添加完成后,回到 Dify 首页,新建一个应用。

路径如下:

Create App → Chatbot / Agent / Workflow

常见选择方式:

| 应用类型 | 适合场景 |

|---|---|

| Chatbot | 普通聊天机器人、客服助手 |

| Agent | 需要工具调用、自动规划任务的智能体 |

| Workflow | 流程编排、批处理、自动化任务 |

| Knowledge Base + Chatbot | 企业知识库问答、文档检索 |

进入应用编排页面后,在模型选择处选择刚才添加的模型:

claude-sonnet-4-6

选择完成后,就可以正常在 Dify 中调用 Claude 模型了。

七、推荐参数设置

不同应用场景下,模型参数可以稍微调整。

下面是一个比较通用的参考配置。

| 场景 | Temperature | Max Tokens |

|---|---|---|

| 普通聊天机器人 | 0.7 | 4096 |

| 知识库 RAG 问答 | 0.2 - 0.5 | 4096 |

| 代码生成 | 0.2 - 0.4 | 8192 |

| 长文档分析 | 0.2 - 0.4 | 8192 |

| 客服问答 | 0.3 - 0.5 | 4096 |

| 内容创作 | 0.7 - 0.9 | 4096 |

简单理解:

- Temperature 越低,回答越稳定

- Temperature 越高,回答越发散

- Max Tokens 越大,允许模型输出越长

如果是知识库问答、企业内部助手、客服机器人,建议 Temperature 不要太高。

如果是文案生成、创意写作,可以适当调高。

八、常见报错排查

下面整理几个实际配置中最常见的问题。

1. 401 Unauthorized

报错示例:

401 Unauthorized

一般是 API Key 问题。

检查方向:

- API Key 是否复制完整

- 前后是否有多余空格

- Key 是否已经失效

- 是否填到了错误的位置

建议重新到 ClaudeAPI.com 控制台复制一次 Key,再粘贴到 Dify 中。

2. model not found

报错示例:

model not found

一般是模型 ID 写错。

正确示例:

claude-sonnet-4-6

claude-opus-4-7

claude-haiku-4-5-20251001

错误示例:

Claude Sonnet

Claude 4.6

sonnet

opus-4

Dify 调用模型时会严格按照 Model Name 传参,所以模型 ID 必须精确。

3. 接口无响应或超时

如果接口一直无响应,优先检查 API Endpoint URL。

正确写法:

https://gw.claudeapi.com/v1

错误写法:

https://gw.claudeapi.com

如果是自部署 Dify,还需要检查服务器网络环境,比如:

- 防火墙

- DNS

- Docker 容器网络

- 服务器是否能访问外部 API

- 是否需要代理

4. 自部署插件安装失败

如果 Docker 自部署环境中安装插件失败,通常和网络有关。

需要确认服务器能访问:

marketplace.dify.ai

github.com

同时建议检查 Dify 版本是否过旧。

如果版本太旧,可能会出现插件市场加载失败或插件不兼容的问题。

5. 流式输出异常

如果开启 Stream 后输出异常,可以先关闭 Stream 测试。

排查顺序建议如下:

- 关闭 Stream

- 测试普通响应是否正常

- 如果普通响应正常,再重新开启 Stream

- 检查 Dify 日志和接口返回

如果只是普通 Chat 模式,Stream 不是必须项。

但如果用于聊天机器人,开启 Stream 体验会更好。

九、自部署环境下验证接口连通性

如果你使用的是 Docker 自部署 Dify,并且模型调用失败,可以直接在服务器上测试接口是否可达。

执行:

curl https://gw.claudeapi.com/v1/models \

-H "Authorization: Bearer sk-你的key"

如果能正常返回模型列表,说明服务器和接口之间网络是通的。

这时问题大概率出在 Dify 配置层面,比如:

- Model Name 写错

- API Key 填错

- Endpoint URL 填错

- Completion mode 选择错误

如果 curl 没有响应,则优先检查:

- 服务器网络

- DNS 解析

- 防火墙

- Docker 网络

- 代理配置

这个方法比较直接,适合排查自部署环境问题。

十、配置速查表

最后放一张速查表,方便配置时对照。

| 项目 | 内容 |

|---|---|

| Dify 模型插件 | OpenAI-API-compatible |

| Model Type | LLM |

| Completion mode | Chat |

| API Endpoint URL | https://gw.claudeapi.com/v1 |

| API Key | ClaudeAPI.com 控制台获取 |

| 推荐模型 | claude-sonnet-4-6 / claude-opus-4-7 |

| Stream | 建议开启 |

| Dify Cloud | https://dify.ai |

| Dify GitHub | https://github.com/langgenius/dify |

| Dify 插件市场 | https://marketplace.dify.ai |

| ClaudeAPI.com | https://www.claudeapi.com |

总结

Dify 接入 Claude 模型的核心其实就两点:

第一,使用 Dify 的 OpenAI-API-compatible 插件。

第二,填写正确的 API Endpoint URL、API Key 和模型 ID。

由于 ClaudeAPI.com 提供 OpenAI API 兼容格式,所以整个接入过程不需要改代码,也不需要自己写适配器。对于想快速在 Dify 里测试 Claude、搭建 RAG 应用、做 Agent 工作流的开发者来说,这种方式比较省事。

如果只是新手测试,建议先使用 Dify Cloud 跑通流程。

如果后续要做企业内部知识库、私有化应用或生产环境部署,再考虑 Docker 自部署。

整体配置路径可以简单记成:

Dify → Model Providers → OpenAI-API-compatible → Add Model → 填写 ClaudeAPI.com 接口信息

配置完成后,就可以在 Dify 的 Chatbot、Agent、Workflow 和知识库应用中正常使用 Claude 模型了。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)