基于帧+事件:复现扩散模型光流算法,ShiMetaPi 给出了一套硬核工程解法

论文深度解读:针对挑战性场景的帧-事件互补融合扩散光流估计(Diff-ABFlow)

一、研究背景与问题

-

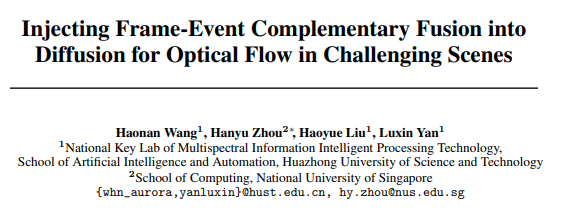

传统场景挑战:虽然光流估计在常规场景已取得进展,但在高速运动和低光照等挑战性场景下表现不佳。

-

画质退化:高速运动导致运动模糊,低光照导致光照不足,这两者都会削弱纹理并放大噪声,使传统帧相机的外观饱和度(Appearance Saturation)变差、边界完整性(Boundary Completeness)受损,从而导致运动特征匹配失效。

-

传感器局限性:

-

帧相机:具有密集的外观饱和度,但由于曝光时间长且动态范围低,在退化场景下边界完整性稀疏。

-

事件相机:外观饱和度稀疏,但凭借短成像时间和高动态范围,在退化场景下能提供密集的边界完整性。

-

-

现有模型缺陷:现有的判别模型和判别式生成模型都极度依赖高质量的视觉特征输入,当输入特征退化时,模型性能会严重下降。

二、核心贡献

-

新框架 Diff-ABFlow:首次提出利用双模态数据(帧+事件)输入来引导扩散模型进行光流估计的框架。

-

互补融合策略:利用帧和事件在“外观-边界”上的互补性,设计了 Attention-ABF 模块,以获得高质量的融合特征。

-

创新解码器 MC-IDD:提出了多条件迭代去噪解码器,结合了 DDIM 范式和光流任务的迭代细化特点,显著提升了模型在退化场景下的鲁棒性。

-

新数据集:提出了两个用于泛化性评估的双模态光流数据集:HS-FEFD(高速场景)和 LL-FEFD(低光场景)。

三、相关工作

-

光流估计发展:从早期的 U-Net 结构进化到集成特征金字塔、代价代价体(Cost Volume),以及近年流行的 GRU 和 Transformer 骨干网络。

-

退化场景处理:现有方法通常采用视觉增强(如去模糊、低光增强)或模态融合,但视觉增强往往会破坏内部特征,而现有的融合方法在外观特征退化时依然难以实现准确匹配。

-

扩散模型应用:扩散模型已在语义分割、深度估计等领域展现出强大的鲁棒性,近期也有研究将其用于光流估计,将任务重构为从噪声光流场到清晰光流场的去噪过程。

四、方法/模型/数据

-

模型架构:

-

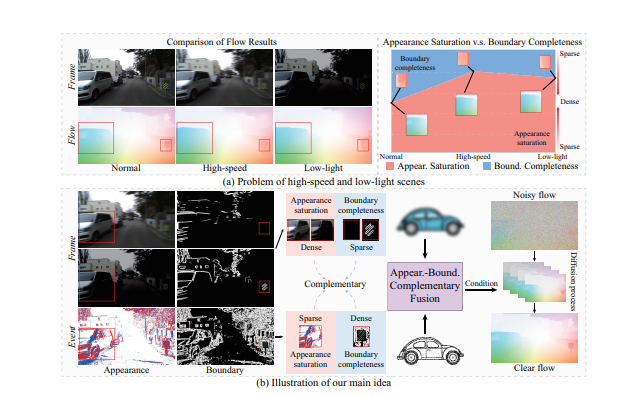

Attention-ABF 模块:通过交叉注意力(Cross-Attention)分别提取帧和事件的优势特征,再利用自注意力机制(Self-Attention)融合得到具备密集饱和度和完整边界的 $x_{fusion}$。

-

TVM-MCA 模块:通过多路交叉注意力机制,将时间嵌入(Time Embedding)、视觉特征和运动特征(Cost Volume)进行深度整合。

-

MGDD 模块:带记忆槽的 GRU 去噪解码器,在去噪过程中存储隐藏特征以保留各噪声等级的细节。

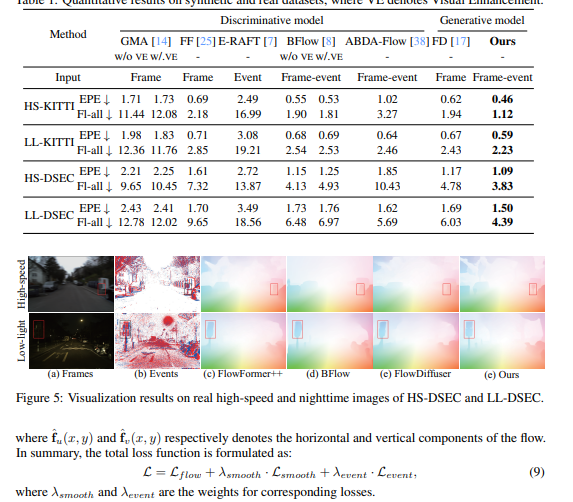

2.损失函数:

3.实验数据:

-

合成数据:HS-KITTI、LL-KITTI。

-

真实数据:HS-DSEC、LL-DSEC,以及作者自研设备采集的 HS-FEFD 和 LL-FEFD。

五、主要结果与证据

-

性能领先:在合成和真实数据集上,Diff-ABFlow 的 EPE(终点误差)和 Fl-all(错误像素百分比)均显著优于现有方法(如 GMA, FlowFormer++, BFlow 等)。

-

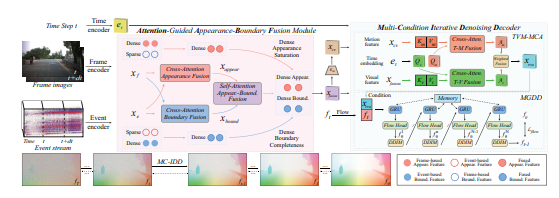

鲁棒性验证:t-SNE 分析显示,当输入退化特征时,判别模型会出现误分类,传统生成模型会出现误采样,而扩散模型(Diff-ABFlow)的分布几乎不受影响。

-

消融实验:实验证明“帧+事件”双模态输入比单模态性能提升巨大;且 Attention 引导的融合策略优于简单的拼接或加权融合。

六、应用与实践意义

-

复杂环境适应性:该研究显著提升了自动驾驶、高速无人机等机器视觉系统在极端天气或夜间环境下的感知能力。

-

范式迁移:所提出的多条件引导去噪扩散范式具有通用性,可推广至深度估计、语义分割等其他计算机视觉领域。

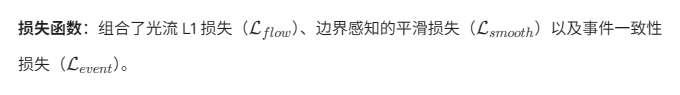

-

效率平衡:通过优化去噪步数(K=4),模型在保持高精度的同时,计算开销和推理时间控制在合理范围内(约 198.5ms),具备一定的实践落地潜力。

七、工程探讨

在复现或落地类似 Diff-ABFlow 这种双模态算法时,开发者往往会面临一个隐形的挑战:如何获取空间位姿完全对齐、时间戳严格同步的“帧+事件”原始数据?

如果使用两台独立的相机通过分光镜组装,不仅体积庞大,且光学轴心偏差(Parallax)会直接抵消掉算法带来的精度增益。针对这一工程痛点,ShiMetaPi 提供的硬件方案给出了更具工程参考价值的选择:

EVS+APS 摄像头模组

这是目前落地该论文算法最理想的硬件载体。它搭载了领先的 ALPIX-Eiger 传感器,在单颗芯片、同一光学轴线下实现了 APS 图像与 EVS 事件数据的同步输出。这种“单芯片双模态”的设计,从物理层解决了空间对齐难题,100dB 的动态范围能为算法提供最纯净的“边界完整性”输入。

灵光 1 号(CF-NRS1)事件相机

对于更专注于纯事件流算法验证、或需要更高环境适应性的场景,灵光 1 号提供了极其稳定的数据采集能力。作为 ShiMetaPi 旗下的专业级工具,它不仅拥有极速响应特性,更在国产化开发生态(如支持 MIPI/网口、兼容主流嵌入式平台)上做了深度优化。

从论文的算法原型到实际的工程部署,高质量的底层感知数据是所有上层架构的基石。ShiMetaPi 的系列硬件方案,正是为了帮助科研与工程团队跨过硬件调优的冗长周期,让前沿视觉算法在现实场景中真正“跑起来”。

声明:

本内容仅作为对相关学术论文/前沿研究的解读与技术分享。文中提及的硬件方案建议,系基于产品技术参数与研究中特定技术路线(如多模态融合、高速感知等)的匹配度所做出的工程化探讨,旨在为相关研究的落地提供工具选型参考。本解读并不代表原论文研究团队使用了文中提及的任何特定品牌或型号的设备。

论文下载:https://arxiv.org/pdf/2510.10577

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)