LLM日志分析为何会幻觉-把IP数据云做成Agent-Skill的Python实战

LLM日志分析为何会幻觉-把IP数据云做成Agent-Skill的Python实战

写在最前面

这次我做了一个可以直接拿来继续开发的 Skill / 微服务示例项目:ipdatacloud-security-analysis-service。可以在AtomGit社区找到:https://gitcode.com/WTYuong/ipdatacloud-security-analysis-service

这次实战里,我使用 IP数据云 作为 Agent Tool Calling 的外部数据源来引入,可以点击链接试用。

关键词:IP地址怎么查询、查询IP所在地、IP是否为代理、IP数据接口调用示例、智能风控、Agent Tool Calling

很多开发者第一次把 LLM 接进日志分析链路时,都会有一种“惊艳感”。

它能读 Nginx 访问日志,能总结异常行为,甚至还能生成一份像模像样的安全分析报告。表面上看,模型已经像一个“初级安全分析师”了。

但问题很快就来了:

如果让它判断“这个用户的登录行为异常吗?”、“这个 IP 需要封禁吗?”、“这是一波真实爆破还是误报?”——很多 LLM 会开始出现幻觉。

原因并不复杂:它会读日志,但它并不知道日志背后的网络现实。

比如同样是一段登录失败:

- 一个 IP 可能只是正常海外员工出差登录

- 另一个 IP 可能来自海外云主机

- 还有一个 IP 可能本身就在高危代理池里

对运维或安全工程师来说,这三类情况显然不应该给出同一种结论。但如果模型缺少实时外部情报,它就只能根据请求频率、状态码、URL 路径和 User-Agent 去“猜”,而这正是日志分析场景最容易出现幻觉的地方。

一、为什么 LLM 一到安全分析就容易“脑补”?

OpenAI 官方在 Function Calling 文档里已经把一件事说得很明确:模型可以通过工具访问训练数据之外的外部系统和实时数据。这意味着,LLM 自己并不天然拥有所有事实,它只是具备“决定什么时候该去调用外部能力”的能力。

而 Toolformer 论文也给出了类似方向:语言模型在事实密集型任务上,更适合借助工具来提升准确性,而不是单纯依赖参数记忆。

放到日志分析里,这个问题会特别明显。

模型能告诉你:

/admin/login出现了高频 401/403wp-login.php被重复访问- 某个 IP 的请求频率远超平均值

但如果没有额外的 IP 情报,它很难可靠判断:

- 这个地址是不是海外机房

- 查询IP所在地之后,是否与用户画像完全不符

- IP是否为代理

- 是否存在秒拨、高危标签、异常真人概率等风控特征

换句话说,LLM 缺的不是总结能力,而是实时物理网络上下文。

二、Agent 的关键不是“更会写”,而是“会调用工具”

这也是为什么现在做 Agent,真正关键的能力不是多写几个 Prompt,而是把外部能力封装成 Tool / Function。

在这个场景里,最适合封装的,就是一个“IP 资产与风险查询” Skill。

它至少应该能给模型补充四类证据:

- 查询IP所在地

- 判断是否属于海外机房、云主机、数据中心网络

- 判断 IP是否为代理

- 给出风险评分、风险等级、风险标签、秒拨概率等结构化特征

这时,整个安全分析链路就从“让大模型自由发挥”变成了“让 Agent 走确定性流程”:

- 从日志里提取异常访问特征

- 自动调用 IP 风险 Skill

- 基于工具证据生成安全分析报告

- 输出附带阻断建议,但不自动执行封禁

这才是 SOAR、风控、反作弊、智能安全分析真正可落地的路径。

三、为什么这里适合接入 IP 数据云?

这次实战里,我使用 IP数据云 作为 Agent Tool Calling 的外部数据源来引入。

根据 IP 数据云官网与帮助中心公开资料,它的 IP 地址数据相关能力可以覆盖:

- 全球 IP 归属地查询

- 更细粒度的位置能力,包括区县、街道级信息

- 代理识别

- 真人概率、风险评分、风险等级、风险标签

- 适合风控和反作弊场景的 IP 风险画像能力

对于想做IP地址怎么查询、查询IP所在地、IP是否为代理这类判断的 Agent 来说,这种结构化输出非常适合作为高频调用的 Skill。

更重要的是,它和日志分析场景天然贴合:

- 日志里最稳定的主键之一就是 IP

- IP 风险能力返回的是结构化 JSON

- LLM 最擅长把这些结构化结果翻译成运维能看懂的结论

也就是说,IP 数据云负责“给事实”,Agent 负责“做推理和表达”,这两个角色是天然互补的。

四、硬核实战:把 IP 数据云 API 封装成 Agent 的一个 Function

下面给一个简化版的 IP数据接口调用示例。它的目标不是完全还原你的生产代码,而是展示“如何把一个 IP 风险查询能力封装成可被 Agent Tool Calling 的 Function”。

需要说明的是:根据 IP 数据云帮助中心公开页面,多个相关产品的调用示例都使用 api.ipdatacloud.com/v2/query?ip={IP}&key={KEY} 这种模式;但不同产品开通后返回字段可能不同,正式接入时请以你控制台中的官方文档字段为准。

import os

import httpx

IPCLOUD_ENDPOINT = "https://api.ipdatacloud.com/v2/query"

IPCLOUD_KEY = os.environ["IPCLOUD_API_KEY"]

async def query_ip_asset_risk(ip: str) -> dict:

params = {

"ip": ip,

"key": IPCLOUD_KEY,

}

async with httpx.AsyncClient(timeout=3.0) as client:

response = await client.get(IPCLOUD_ENDPOINT, params=params)

response.raise_for_status()

raw = response.json()

# 注意:字段名请以当前已开通产品的官方文档为准

return {

"ip": ip,

"geo": {

"country": raw.get("country") or raw.get("country_name"),

"province": raw.get("province"),

"city": raw.get("city"),

"district": raw.get("district"),

"street": raw.get("street"),

"isp": raw.get("isp"),

},

"risk": {

"proxy": raw.get("proxy"),

"proxy_type": raw.get("proxy_type"),

"risk_level": raw.get("risk_level"),

"risk_score": raw.get("risk_score"),

"risk_tags": raw.get("risk_tags", []),

"dialup_probability": raw.get("dialup_probability"),

},

}

TOOL_SPEC = {

"type": "function",

"function": {

"name": "query_ip_asset_risk",

"description": "查询IP所在地、代理风险、秒拨概率和风险标签",

"parameters": {

"type": "object",

"properties": {

"ip": {"type": "string"},

},

"required": ["ip"],

},

},

}

这段代码真正重要的,不是“调用了一个 API”,而是它把外部风险情报整理成了 Agent 能消费的统一结构:

georisktagsscore

这样,模型后面只需要根据这个结构化结果做判断,而不是再去自己理解一堆杂乱文本。

五、简单一点的实战效果展示:把 Skill 打包分享给团队

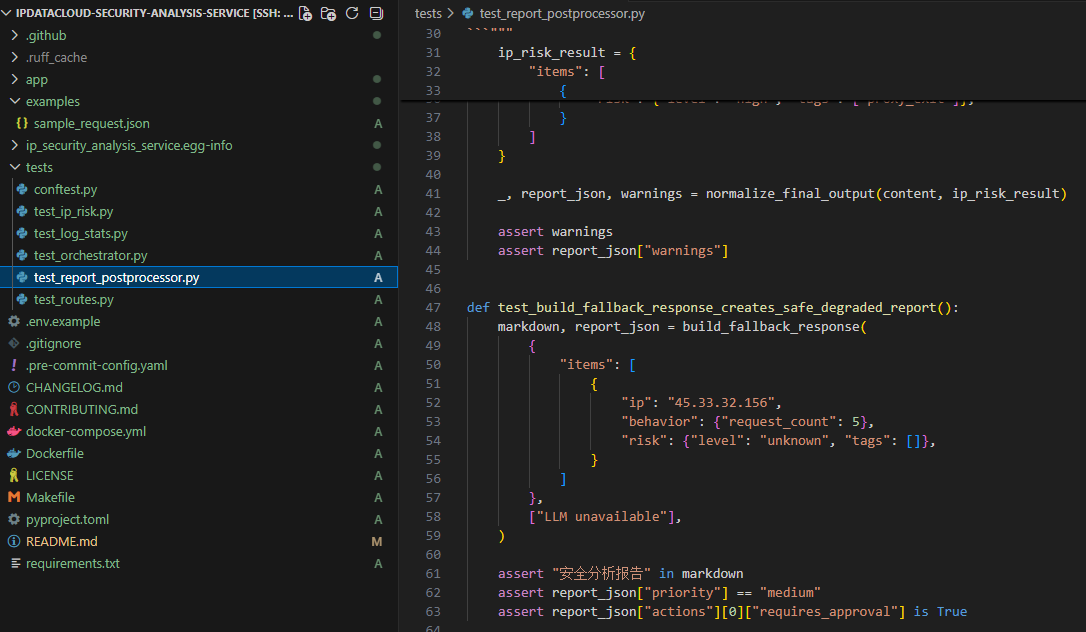

这次我做了一个可以直接拿来继续开发的 Skill / 微服务示例项目:ipdatacloud-security-analysis-service。

它的核心思路非常简单,适合团队内部分享、二次封装和接入 SOAR:

这个 Skill 的职责只有三步:

extract_log_stats:先从访问日志中提取高频 IP、登录失败比例、敏感路径命中等行为特征query_ip_risk:再去调用 IP 数据云能力,补齐归属地、代理、风险画像信息orchestrator:最后把行为证据和 IP 情报整合起来,输出面向运维的安全分析报告

如果你把它分享给团队内部同事,他们看到的就不是“一个抽象概念上的 Agent”,而是一套可以直接改造的工程模板:

- FastAPI 服务已经搭好

- Tool Calling 的流程已经固定

- 测试和 CI 也已经补齐

- 可以直接改造成内部 SOAR 节点或风控微服务

这比单纯发一段 Prompt 或一份概念文档更有说服力。

ipdatacloud-security-analysis-service.zip

六、场景演示:Agent 如何自动生成一份带阻断建议的智能安全分析报告?

我们模拟一个真实场景。

Agent 收到一段 Nginx 日志:

45.33.32.156 - admin [30/Apr/2026:03:12:11 +0000] "POST /admin/login?username=admin HTTP/1.1" 403 162 "-" "curl/8.5.0"

45.33.32.156 - root [30/Apr/2026:03:12:19 +0000] "POST /admin/login?username=root HTTP/1.1" 401 162 "-" "curl/8.5.0"

203.0.113.18 - - [30/Apr/2026:03:15:31 +0000] "GET /wp-login.php HTTP/1.1" 404 321 "-" "Mozilla/5.0"

先别急着让模型“写报告”,而是让它走 Tool Calling 流程:

第一步:抽取日志行为特征

Agent 会先从日志中得到这样的行为摘要:

45.33.32.156:短时间内反复访问/admin/login,且 401/403 占比很高,具备暴力破解特征203.0.113.18:访问wp-login.php,更像敏感路径探测,风险待确认

第二步:自动调用 IP 数据云 Skill

这里演示一个模拟的统一输出结构,方便理解 Skill 的价值:

{

"ip": "45.33.32.156",

"geo": {

"country": "US",

"city": "Dallas",

"isp": "Linode"

},

"risk": {

"proxy": true,

"proxy_type": "proxy",

"risk_level": "high",

"risk_tags": ["proxy_exit", "datacenter"],

"dialup_probability": 92

}

}

到这一步,Agent 才真正拿到了关键上下文:

- 这个地址来自海外

- 它背后是机房网络

- 它存在明显代理风险

- 风险标签和行为特征可以互相印证

第三步:输出最终智能安全报告

这时 Agent 再生成结论,就不会只是“基于请求频率瞎猜”,而是能给出有证据支撑的建议:

45.33.32.156:高频登录失败,命中敏感登录接口,且归属海外机房、风险标签包含高危代理特征,建议临时封禁 24 小时,并对/admin/login增加验证码或二次验证203.0.113.18:存在敏感路径访问行为,但如果代理/风险证据不足,则仅建议短期观察,不直接封禁

这类报告最有价值的地方在于:每一条判断都来自工具结果,而不是模型自由发挥。

七、这套方案为什么特别适合互联网公司的智能风控?

很多公司现在卡在一个尴尬阶段:

- 模型能看日志

- 模型能写报告

- 但模型给出的判断还不够“可执行”

真正的问题,不是 LLM 不够聪明,而是它缺少可以高频调用的可靠外部事实层。

把 IP 数据云封装成 Agent Skill 之后,这个问题会明显改善:

- 归属地、代理、风险标签都有结构化输出

- 可以直接嵌进登录风控、反爬、反作弊、异常访问识别链路

- 可以作为 SOAR 的标准工具节点高频复用

对很多互联网公司来说,这相当于把“网络风险上下文”做成了标准组件。开发团队不用从零搭建全球 IP 情报体系,可借助这类服务快速把 Agent 风控系统做出一个可上线的雏形。

八、总结

说到底,LLM 在日志分析里的最大问题,从来不是“它会不会读日志”,而是“它有没有事实证据”。

没有实时 IP 上下文时,模型只能根据表面行为模式做推断,于是就容易出现那种 “写得很像专家,但结论并不可靠” 的幻觉。

一旦把 Tool Calling 接进来,再把 IP 数据云这样的能力封装成 Agent Skill,整个系统的可信度就会明显提升。

从工程视角看,这种组合的价值非常直接:

- LLM 负责理解和生成

- Skill 负责取证

- 报告负责辅助运维决策

而 IP 数据云在库更新及时、结构化程度高、适合高频调用这几个点上,比较适合作为 Agent 的基础 Skill。对于想快速搭建智能风控、智能安全分析链路的团队来说,能够降低实现门槛。

参考资料:

- IP数据云官方产品页:help.ipdatacloud.com

- OpenAI Function Calling 文档:platform.openai.com/docs/guides/function-calling

- IP数据云 IP 归属地产品说明:help.ipdatacloud.com/product/ipguishu

- IP数据云产品接入说明页:help.ipdatacloud.com/product/?type=59

hello,这里是 晓雨的笔记本 。如果你喜欢我的文章,欢迎三连给我鼓励和支持:👍点赞 📁 关注 💬评论,我会给大家带来更多有用有趣的文章。

原文链接 👉 ,⚡️更新更及时。

欢迎大家点开下面名片,添加好友交流。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)