AI Mission Cloud 分层架构:多模态 AI 推理的控制平面 + 编排平面 + 模型注册中心

AI Mission Cloud 分层架构:多模态 AI 推理的控制平面 + 编排平面 + 模型注册中心

多模态 AI 推理与任务编排的通用基础设施(Mission AI OS)

-

✅ 应该做 “可插拔 AI 推理框架 + 任务级 AI 能力抽象”

-

✅ 把 YOLO / CLIP / VLM / VLA 视为“算子 / 能力模块”

AI Mission Cloud =

多模态 AI 推理的控制平面 + 编排平面 + 模型注册中心

-

端侧 AI 的“大脑协调者”

-

云端 AI 的“认知与任务规划层”

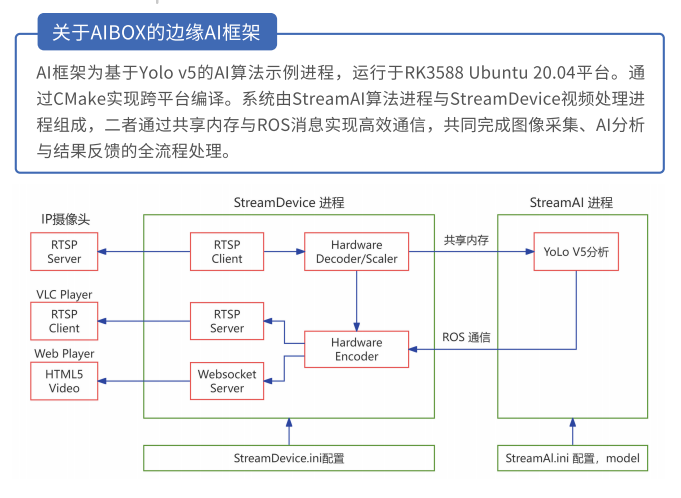

AI Mission Cloud 不是一个算法平台,而是一个多模态 AI 推理与任务编排的基础设施。它通过端侧实时感知(YOLO)与云端语义推理(CLIP / VLM),为无人系统提供可扩展、可组合、可合作的 AI 能力。

AI Mission Cloud 分层架构

架构分 4 层

① AI Runtime Layer(端侧)

-

YOLO / Depth / Tracking

-

CLIP Embedding(可选)

-

推理状态监控

② Semantic Abstraction Layer(端 → 云)

-

Detection Schema

-

Embedding Schema

-

Event Schema

③ Mission Reasoning Layer(云端)

-

CLIP / VLM

-

规则引擎

-

多模态关联推理

④ Task Orchestration Layer(云端)

-

任务 DSL

-

状态机 / 行为树

-

VLA

AI Mission Cloud 负责

-

模型注册规范(Model Manifest)

-

推理接口规范(Input / Output Schema)

-

性能约束(FPS / Latency / Memory)

-

模型热更新 / 回滚机制

合作伙伴负责:

-

数据

-

标注

-

训练

-

精度指标

是否需要 VLA / VLN

1️⃣ 什么时候不需要VLA / VLN

以下场景 不值得现在上:

-

仅 DAA、防撞、巡检

-

规则清晰、目标固定

-

强实时闭环控制

YOLO + 规则 + 状态机 = 最稳

2️⃣ 什么时候值得引入 VLA / VLN

当出现以下需求:

-

「看懂任务说明」

-

「自然语言任务」

-

「跨感知-决策-动作」

-

「任务级泛化」

例如:

“巡检这个区域,如果看到异常就靠近拍照,然后返回。”

这时:

-

VLM:理解“看到了什么”

-

VLA:决定“下一步做什么”

1️⃣ YOLO:端侧模型(AiBrainBox)

|

能力 |

是否端侧 |

原因 |

|---|---|---|

|

目标检测(人 / 车 / 障碍物) |

✅ 必须 |

实时性、闭环控制 |

|

DAA / 防撞 |

✅ 必须 |

延迟 < 50ms |

|

ROI 筛选 / Track |

✅ |

降低上行带宽 |

YOLO 在端侧的角色:“感知层算子”(Perception Operator)

端侧YOLO框架:

-

模型加载接口

-

统一输出结构(Detection Schema)

-

推理状态管理(帧率 / 置信度 / 算力占用)

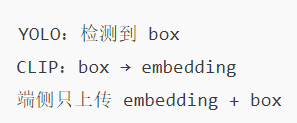

2️⃣ CLIP:端云协同的“语义桥梁模型”

-

端侧 CLIP 可以用于:

|

能力 |

是否推荐 |

|---|---|

|

图像 → 向量 embedding |

⚠️ 可选 |

|

YOLO 结果语义增强 |

✅ 推荐 |

|

本地快速语义过滤 |

✅ |

-

云端 CLIP 的典型角色:

-

文本 ↔ 图像 / 目标的语义匹配

-

“是否出现过 X 类目标”

-

跨任务、跨设备的 语义一致性

端侧 AI vs 云端 AI部署

✅ 端侧 AI(AIBrainBOX)

关键词:实时、确定性、闭环

端侧应该只做:

-

感知(YOLO / 深度 / 跟踪)

-

低阶理解(CLIP embedding、类别映射)

-

安全决策(防撞、避障、告警)

-

数据裁剪与结构化上传

👉 输出的是:

-

结构化事件

-

语义向量

-

低频关键帧

✅☁️ 云端 AI(AI Mission Cloud)

关键词:语义、任务、推理、不确定性

云端应该做:

-

多模态语义推理(CLIP / VLM)

-

跨时间任务理解

-

任务规划 / 规则引擎

-

多设备协同理解

👉 云端不追求毫秒级实时,而追求:

-

可解释

-

可扩展

-

可组合

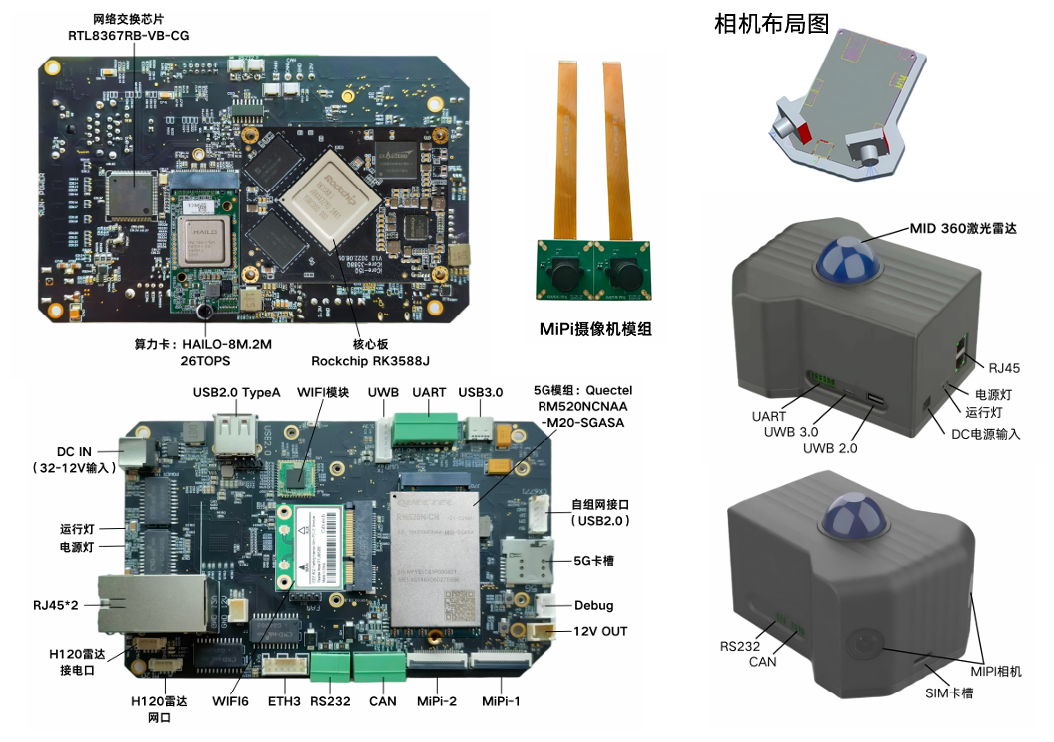

全国产通感算控一体化AiBrainBox

双MIPI相机接口(高帧率、全局曝光)

国产化Sensor、130万像素,全局曝光、高帧率(最高可达240、推荐60-100帧)

ISP定制

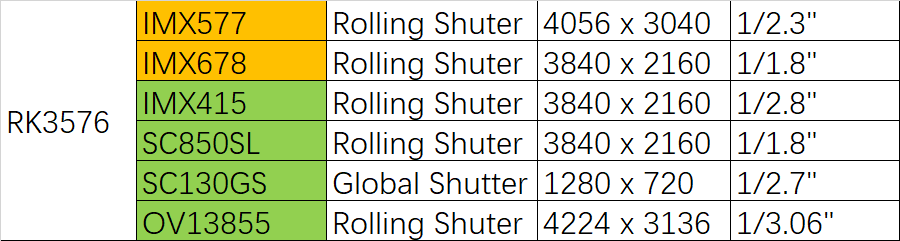

可选MIPI相机模组:

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)