[特殊字符]️ HBase 架构 & HBase过滤器

一. 🗄️ HBase 架构 · 像图书馆管理员一样思考🐘 基于Hadoop的分布式列式数据库 | 适合海量数据,实时读写

📖 一句话理解 HBase

💡 HBase 就像一个超级智能的巨型书架集群:

✨ 书(数据)被分成很多“小书册”(Region),放在不同的书架上(RegionServer)。

✨ 有一位“总馆长”(HMaster)负责管理书架分布,还有一本“万能索引册”(ZooKeeper)记录每一册书的位置。

✨ 当你需要找数据时,先问索引册 -> 找到对应的书架 -> 直接去拿!速度超快 🚀

🏛️ HBase 核心架构图

📡 客户端 Client (应用程序)👩💻 客户端1️⃣ 获取 Region 位置2️⃣ 读写数据(直接)🐘 ZooKeeper(协调中心 & 元数据入口)监控&通知👑 HMaster(管理元数据/Region分配)分配/负载均衡📦 RegionServer 1Region A (Key: user_1000~5000)Region B (Key: user_5001~9000)📦 RegionServer 2Region C (Key: user_9001~13000)Region D (Key: user_13001~20000)📦 RegionServer N更多 Region …🗄️ HDFS (底层存储)HLog(WAL) + HFile | 数据最终落盘 & 备份持久化写

元数据请求/协调客户端直接读写数据HMaster 管理调度RegionServer 数据节点ZooKeeper 协调中心HDFS 最终存储

⭐ 重点:客户端直接从RegionServer读写数据,HMaster不参与数据通道,性能更高!

👑 HMaster (总馆长)

✅ 负责管理RegionServer:监控哪些服务器活着,哪些挂了。

✅ 给RegionServer分配Region(数据分片),并做负载均衡。

✅ 处理DDL操作(创建/删除表)。

🔔 注意:HMaster 挂了不影响数据读写(短暂),但无法进行管理操作,依赖ZooKeeper选举新的Master。

🐘 ZooKeeper (万能索引册)

🔍 存储关键元数据:比如hbase:meta表的位置,以及Master地址。

🤝 协调分布式环境:监听RegionServer的在线状态,如果宕机立即通知Master。

🧭 客户端第一次访问时,先问ZooKeeper“我该找哪个RegionServer?”

✨ 就像图书馆的索引目录,帮你快速定位书架。

📦 RegionServer (书架管理员)

🔄 实际处理读写请求,管理多个Region。

📂 每个Region包含多行数据(按RowKey范围划分),数据先写内存(MemStore)再刷写到HFile。

💾 提供缓存(BloomFilter, BlockCache) 加速读取。

💡 如果某个RegionServer宕机,Master会将其上的Region转移到其他节点。

🗃️ Region (数据分片)

📌 HBase 自动将大表水平切分成多个Region,每个Region是表的连续一段RowKey。

🚀 随着数据增多,Region会自动分裂成两个小Region,避免热点。

🎯 每个Region由特定的RegionServer服务,客户端通过RowKey快速定位Region。

💾 HDFS (最终底座)

📀 HBase 的数据最终存在Hadoop HDFS上,具有高可靠、高容错(多副本)。

🔐 包括WAL(Write-Ahead-Log) 预写日志和实际的HFile。

🌍 即使整个RegionServer崩溃,数据也不会丢失,可重放日志恢复。

⚡ Client 读写流程 (重点)

📖 读:Client → ZooKeeper 获取meta表位置 → 找到对应RegionServer → 直接读取数据

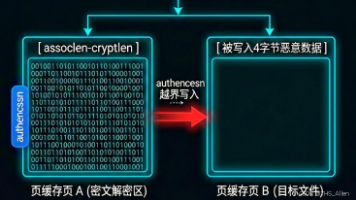

✍️ 写:先写WAL(日志)保证不丢,再写入MemStore,数据排序后定期刷入HFile。

🚫 HMaster 不参与数据IO,所以速度飞快!

📚 有趣类比:学校图书馆的大数据版

🏫 全校图书总系统 → HBase集群

👩🏫 总馆长 → HMaster

负责分配书架,处理新书入库。

📖 索引卡册 → ZooKeeper

告诉你某某主题的书籍在哪个书架区。

📚 每位图书管理员 → RegionServer

管理自己负责的书架(Region)。

📑 书架上的格子 → Region

存放特定索书号范围的书。

🏢 地下超大仓库(HDFS) → 所有书最终备份保存,不怕丢失。

🌰 当同学找一本“计算机-数据库”的书:先去索引卡册查到位置 → 直接跑向对应的管理员(RegionServer)→ 管理员立刻帮你取书!不需要经过总馆长,超级高效~

✨ HBase 亮点 & 为什么这么设计?

📈 海量数据 💨 高吞吐 🔄 自动分片 🔁 强一致性

✔ 横向扩展:加服务器就能提升性能。

✔ 面向列族:适合稀疏表,节省空间。

✔ 实时读写:毫秒级响应,不像Hive那么慢。

✔ 与Hadoop生态完美集成,用于大数据分析平台。

⚠️ 注意点

• 不支持复杂SQL(JOIN/group by),需配合Phoenix

• 只有 RowKey 索引,查询其他列需扫描

• 设计好 RowKey 是关键!避免热点

🎯 一张图记住HBase架构职责

📌 客户端 👉 ZooKeeper (找Meta) 👉 RegionServer (直接读写) 👉 HDFS(持久化)

👑 HMaster 在一旁做“指挥官”:维护Region分配,处理故障转移,不参与数据流。

💡 小测: 如果某个RegionServer宕机,谁会负责转移它的Region? → HMaster + ZooKeeper协同

二. 📡 HBase 过滤器🔍 像筛子一样精准

在大数据海洋里,只拿你想要的那一小勺数据 ✨

🧠 先想一下:什么是“过滤器”?(类比厨房筛面粉)

🥣 全部数据 ➕

行键: user_001, user_002...

列: 姓名, 年龄, 城市...

原始表 100万条

➡️

🔍 【过滤器】

⚙️ 规则: 年龄 > 18 且 城市 = "北京"

过滤逻辑

➡️

✅ 结果

只返回满足条件的少量数据 🎯

精准又快速

💡 简单说:HBase 过滤器 就像带着“条件筛子”去扫描数据,服务器端直接过滤掉不相关的行/列,只把你要的结果返回给你。

🚀 好处:不用把几百万条数据都传到你的程序里再过滤,节省网络和时间,效率超高!

🛠️ 常用过滤器 · 工具箱

下面这几个是最常见的“筛网”,中学生也能轻松理解~

🎯 RowFilter (行键过滤)

根据行键(Rowkey) 做筛选,支持比大小、包含前缀、正则等。就像按名字找人。

// 匹配行键以 "user_2024" 开头的数据

RowFilter.compare = CompareOperator.EQUAL

.new RegexStringComparator("^user_2024.*")

📁 FamilyFilter / QualifierFilter

根据列族或列名过滤,比如只要 'info' 列族,或者只要 'age' 这一列。

// 只拿列名包含 "score" 的列

QualifierFilter(compare,

new SubstringComparator("score"))

⭐ ValueFilter (值过滤)

最常用!根据单元格里的具体数值筛选。比如: 成绩>90分, 年龄=15岁。

// 筛选成绩大于 90 的学生

ValueFilter(CompareOperator.GREATER,

new BinaryComparator(Bytes.toBytes("90")))

✨ SingleColumnValueFilter

针对某一列的值做条件,决定整行是否返回。比如筛选出 "city=上海" 的所有用户。

SingleColumnValueFilter(

'info', 'city', Compare.EQUAL,

'Shanghai')

🔤 PrefixFilter (前缀过滤)

匹配行键的开头,超级快!例如找所有 "order_" 开头的订单行。

PrefixFilter("order_2025")

// 返回 rowkey 以 order_2025 开始的行

📄 PageFilter (分页过滤)

控制每次返回多少行,就像翻页,每次拿10条。配合其他过滤器实现分页查询。

PageFilter(10) // 最多返回10行

🧩 进阶:组合过滤器 (FilterList) —— AND / OR 超能力

你可以把多个过滤器用 AND (必须全部满足) 或 OR (满足任意一个) 组合起来,就像数学里的“且”和“或”。

FilterList list = new FilterList(FilterList.Operator.MUST_PASS_ALL); // AND 关系

list.addFilter( new ValueFilter(...年龄大于18...) );

list.addFilter( new SingleColumnValueFilter(...城市=北京...) );

// 最终只返回 在北京且年龄>18 的人 🎯

⚡ 甚至还可以组合 OR:只要名字包含"张" 或者 成绩大于95分,就返回整行 —— 特别灵活。

⚡ 为什么过滤器超棒? 对比一下:

| 方式 | 网络传输 | 处理速度 | 代码复杂度 |

|---|---|---|---|

| ❌ 没有过滤器 (全表扫描) | 传输全部数据 (可能几GB) | 慢如蜗牛,内存爆炸 | 客户端还需要自己写循环过滤 |

| ✅ 使用过滤器 | 只传最终结果 (几KB) | 快,服务器端直接扔掉不相关数据 | 简单优雅,一个过滤器搞定 |

📖 回忆: 过滤器在RegionServer内部就执行了,不用把数据搬到客户端再丢掉,这就是“谓词下推”的思想!

📚 李华同学的校园数据库小故事

📌 学校的HBase里存了全校3000个学生的成绩表,行键是学号,列有"姓名","班级","数学成绩","语文成绩","年级"。

👩🏫 老师想找出 数学成绩大于90分且年级是八年级的学生 做竞赛培训。

💻 如果不用过滤器,需要把所有3000行数据全部取出,然后遍历检查 ➜ 浪费!

🧹 用了过滤器:

→ SingleColumnValueFilter(数学成绩 >90) + SingleColumnValueFilter(年级 = 八年级) 组合成 AND 过滤。

🚀 结果:只返回符合条件的几十条数据,网络传输轻飘飘~ 老师一秒拿到名单。

// 伪代码示意

FilterList andFilter = new FilterList(MUST_PASS_ALL);

andFilter.addFilter(new SingleColumnValueFilter("score","math", GREATER, "90"));

andFilter.addFilter(new SingleColumnValueFilter("info","grade", EQUAL, "eight"));

scan.setFilter(andFilter); // 完美筛选!

🧠 记忆口诀 & 小贴士

- 🔹 过滤器运行在服务端,减少数据传输,海量数据必备。

- 🔹 行键过滤器(RowFilter, PrefixFilter)最快,因为直接定位行键范围。

- 🔹 列值过滤器(ValueFilter)通用,但是扫描所有单元格,合理使用组合可以提高效率。

- 🔹 特别注意:SingleColumnValueFilter 如果某行没有指定列,可以设定“设置为true时是否返回”的选项,避免误判。

- 🔹 比较器(Comparator)五花八门:BinaryComparator, RegexStringComparator, SubstringComparator... 可以像正则表达式一样花式筛选。

⭐ 一句话总结:HBase过滤器就像是智能筛子,让你在海量数据里只拿有用的果子,省时省力又省流量!

🎒 常见过滤器应用场景(给喜欢思考的你)

| 过滤器 | 生活例子 | 大数据场景举例 |

|---|---|---|

| PrefixFilter | 找姓氏为“王”的同学 👨🎓 | 查询订单号以“ORD_2025”开头的所有订单 |

| ValueFilter | 筛选出成绩90分以上的卷子 📄 | 监控传感器数值大于阈值的报警记录 |

| SingleColumnValueFilter | 购物只挑“价格<100元”的商品 | 找出所有“库存状态=缺货”的商品行 |

| ColumnPaginationFilter | 只看成绩单的前3列(姓名、数学、英语) | 限制返回列的数量,避免宽表拉取过多列 |

| TimestampsFilter | 只看期末考试那次成绩(特定时间点) | 时间序列数据,仅过滤特定版本的数据 |

🌟 小彩蛋:HBase过滤器底层利用Java的Filter Base接口,每个过滤器在扫描时都会调用 filterRowKey / filterCell 等方法。

当你带着过滤器做Scan时,RegionServer一边扫描StoreFile,一边应用过滤逻辑。 —— 懂原理,更厉害!

三. 总结

HBase概述

HBase是一个开源的、分布式的、面向列的NoSQL数据库,基于Google BigTable设计,运行在Hadoop文件系统(HDFS)之上。主要特点包括高可靠性、高性能、可伸缩性,适用于海量数据的随机实时读写访问。

- 分布式架构:数据分片存储于RegionServer,支持水平扩展。

- 列式存储:数据按列族(Column Family)组织,支持动态列和稀疏存储。

- 强一致性:基于HDFS的多副本机制保障数据可靠性。

- 实时读写:支持毫秒级查询,适用于OLTP场景。

HBase过滤器

过滤器(Filter)是HBase中用于在服务端高效筛选数据的机制,避免全表扫描,提升查询性能。

核心过滤器类型

- 比较过滤器:基于列值或列名进行匹配(如

ValueFilter、ColumnPrefixFilter)。 - 专用过滤器:如

PageFilter(分页)、FirstKeyOnlyFilter(仅获取每行第一个键)。 - 组合过滤器:通过

FilterList实现AND/OR逻辑组合。

典型应用场景

- 单列值过滤:使用

SingleColumnValueFilter筛选特定列值。 - 前缀匹配:

PrefixFilter按行键前缀过滤数据。 - 分页查询:

PageFilter限制返回行数,结合startRow实现翻页。

性能优化建议

- 优先使用行键(RowKey)设计减少扫描范围。

- 避免全表扫描,合理组合过滤器降低I/O开销。

- 对高频查询列建立二级索引(如Phoenix)。

HBase过滤器通过服务端预筛选显著提升查询效率,但需结合业务场景设计过滤逻辑。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)