MolmoAct 2:面向真实世界中工作的机器人的开放式基础架构

系列文章目录

目录

前言

人工智能可以帮我们撰写邮件、调试代码,还能为我们预订机票。但在物理世界中,它依然举步维艰。要让机器人可靠地装载洗碗机,或在实验室中准备试管样本,这仍远超大多数系统连续数小时稳定运行的能力范围。然而,这些恰恰是高性能机器最能发挥作用的领域——处理那些最难招募人力完成的重复性工作,并加速科学发现。

过去一年,机器人基础模型取得了实质性进展,使我们更接近完全自主的机器人。但其底层技术方案仍大多处于封闭状态。部分团队会发布权重参数,少数会发布数据,而几乎没有团队发布足够的信息供研究人员深入研究或对现有工作进行有意义的改进。

去年八月,我们推出了MolmoAct——首个动作推理模型(ARM),这是一种能在采取行动前对三维环境进行推理的新型模型。今天,我们发布了 MolmoAct 2。这一重大升级版本在行业基准测试中表现优于现有的高性能专有机器人模型,无需针对特定任务进行微调即可直接处理各种现实世界任务,运行速度比前代快达 37 倍——极大地扩展了其能够完成的工作类型。与 MolmoAct 2 同步发布的还有 MolmoAct 2-Bimanual YAM 数据集,这是迄今为止发布的最大规模开源双臂桌面操作机器人数据集,包含超过 720 小时的训练演示视频。

MolmoAct 2、MolmoAct 2-Bimanual YAM 数据集,以及采用新型适配器架构的更新版 VLA 管道,现已向研究人员开放,供其研究和进一步开发——其中包括模型权重、数据集,以及我们用于帮助 MolmoAct 2 在 3D 空间中进行更深入推理以提升性能和可解释性的自适应推理方法。

一、重新审视MolmoAct的推理能力:从架构到数据

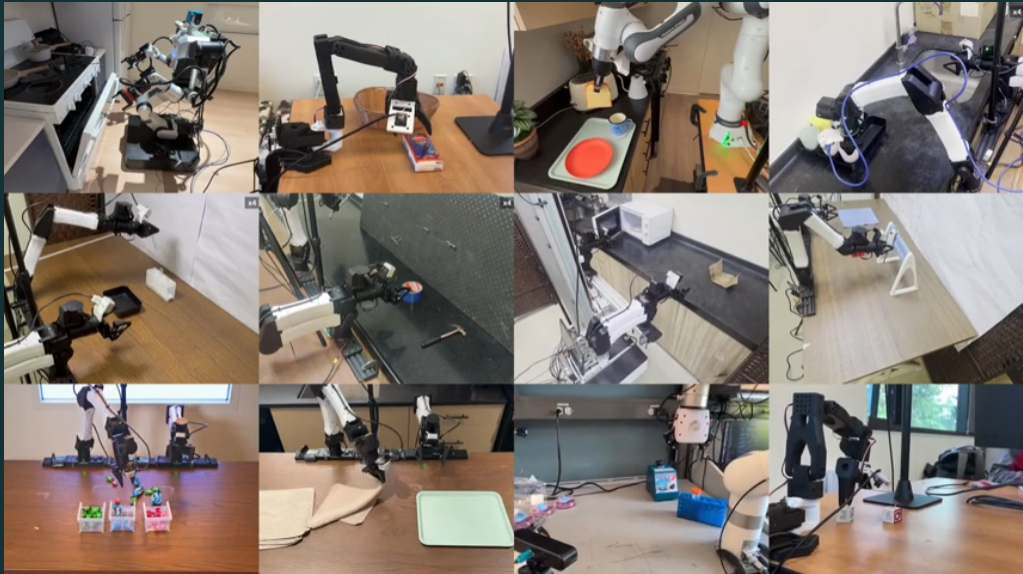

MolmoAct是在3个月内生成的22小时精选内部数据上进行训练的——约1.06万条轨迹,每条都是机械臂在厨房、浴室、卧室、客厅及桌面场景中成功完成操作任务的记录——此外还使用了Open X-Embodiment数据集的过滤子集,该数据集由数十个机器人实验室汇集而成。虽然 MolmoAct 证明了基于推理的开放架构能在行业标准基准测试中胜过规模更大的封闭模型,但 MolmoAct 2 的设计初衷是部署于真实世界环境中。

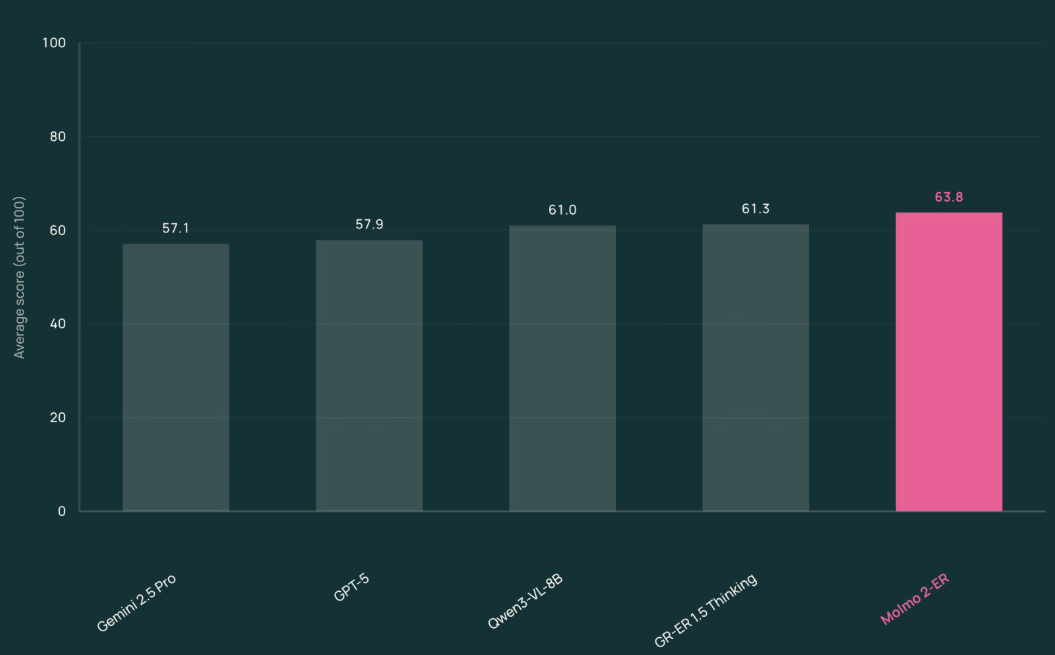

为了创建MolmoAct 2,我们重新构思了其架构。MolmoAct 2 并非直接基于 Molmo 2 初始化,而是基于 Molmo 2-ER——这是 Molmo 2 的一个专门用于具身推理的变体。我们通过在约 300 万个额外的具身推理示例上对 Molmo 2 进行进一步训练,来训练 Molmo 2-ER,这些示例涵盖基于图像的指点、物体检测、抽象空间推理、多图像推理,以及基于图像和视频的空间问答。

这种更强大的推理能力在评估中得到了直接体现。在涵盖指点、多图像推理、自我-外部对应关系以及视频空间推理的13个具身推理基准测试中,Molmo 2-ER平均得分达到63.8分(满分100分),领先于包括GPT-5、Gemini 2.5 Pro、Qwen3-VL-8B和GR-ER 1.5在内的系统。

MolmoAct 2 将 Molmo 2-ER 与一个专用的动作专家相结合,该专家通过流程匹配生成机器人动作,并通过 KV-缓存桥与 VLM 相连。MolmoAct 2 还拥有一个开源的动作分词器;Physical Intelligence 的 FAST 分词器是该领域近期最有价值的贡献之一,但用于训练它的数据尚未公开发布。我们开发了 MolmoAct 2-FAST Tokenizer,这是一个基于我们自有数据集训练的完全开源重构版本,并随 MolmoAct 2 一起发布。

得益于这些及其他改进,MolmoAct 2 的推理速度显著提升。在基础模型中,单次动作调用耗时约 180 毫秒;而在采用自适应深度推理的 MolmoAct 2 中,该耗时为 790 毫秒;相比之下,MolmoAct(在配备 1 块 NVIDIA H100 的 LIBERO 基准测试环境中运行)则需 6,700 毫秒——这正是动作间明显停顿的机器人与能近乎实时响应环境的机器人之间的差异。

我们还推出了 MolmoAct 2-Think,该版本通过深度感知令牌增强了 MolmoAct 2,以应对那些能从显式 3D 推理中获益的任务。为避免不必要的计算,我们的自适应深度机制仅在预期能提升任务性能时才进行深度预测。这使得 MolmoAct 2 能够在保持高效推理的同时,对 3D 空间结构进行更深入的推理。该模型不再为所有图像块预测深度标记,而是将深度预测聚焦于场景动态变化的区域,从而降低了密集深度标记预测的延迟,并与全深度标记预测相比实现了17%的速度提升。

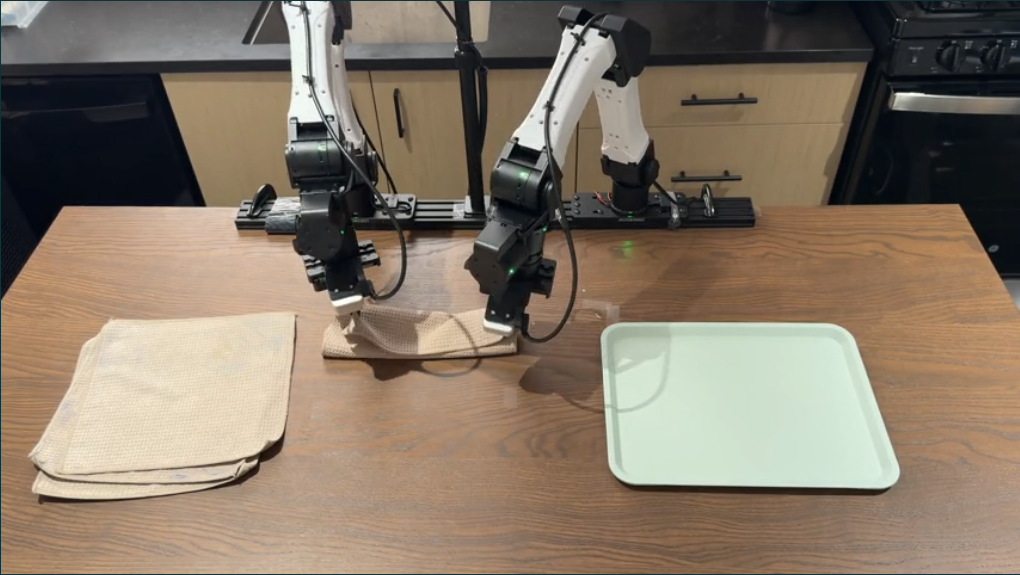

为了训练 MolmoAct 2,我们创建了 MolmoAct 2-Bimanual YAM 数据集,这是一个包含 700 小时机器人演示的集合,展示了两台机械臂协同工作,涵盖了折叠毛巾、扫描杂货、给智能手机充电以及收拾餐桌等协调任务。MolmoAct 2-Bimanual YAM数据集是迄今为止发布的最大规模开源双臂机器人数据集,其包含的机器人数据量是MolmoAct所用数据的30倍以上。我们得到了Cortex AI的支持,共同整理了MolmoAct 2-Bimanual YAM数据集。

MolmoAct 通过针对每个任务的微调实现了双臂操作;而 MolmoAct 2 则将双臂操作能力直接内置于基础模型中,用户开箱即用。

我们通过补充更广泛的机器人数据集,丰富了 MolmoAct 2-Bimanual YAM 数据集,使 MolmoAct 2 能够接触到不同的机械臂、摄像头配置、控制方案和任务类型。这些数据集包括来自低成本开源机械臂的大规模 SO-100/SO-101 数据集;经过筛选的 DROID Franka 数据,用于展示不同场景下的真实单臂操作; 来自 Open X-Embodiment 的 Google Robot BC-Z 和 Fractal 数据,这些数据增加了大量基于指令的机器人操作示例;Bridge WidowX 数据,该数据将覆盖范围扩展至另一种常用的机器人配置;以及 MolmoAct 的原始训练数据,保留了奠定首个模型基础的家庭及桌面操作技能。

我们还改进了机器人数据中的语言部分。许多机器人数据集重复使用相同的任务标签,或包含测试运行字符串等低质量标注。为了使指令更加准确和多样化,我们利用一个开源的视觉语言模型(VLM)对机器人演示进行了重新标注,使整个数据集混合中的唯一标签数量从约7.1万个增加到约14.6万个。

二、在模拟、适应及真实机器人任务中的评估

我们对MolmoAct 2进行了迄今为止最严格的机器人评估之一,涵盖了模拟、零样本部署以及训练后对新机器人环境的适应。

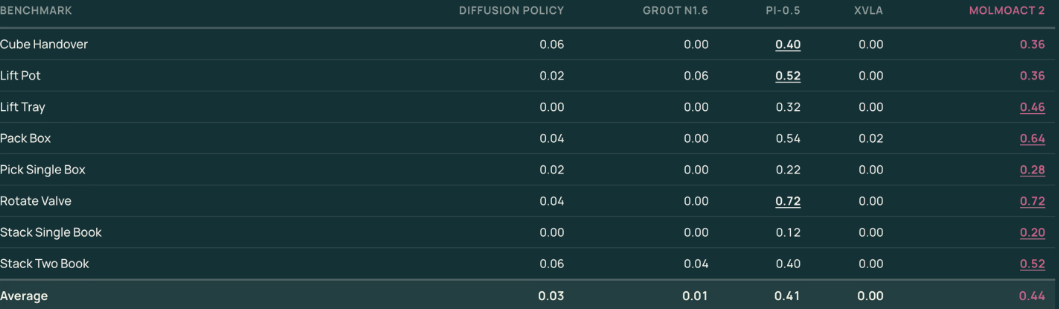

MolmoAct 2 在模拟环境中表现优异。在我们的家庭操作基准测试 MolmoBot 上,它在所有任务中的平均成功率为 20.6%——大约是 Physical Intelligence 的 π0.5(10.3%)的两倍。(MolmoBot 设计初衷就是高难度;许多基线模型的得分仅为个位数。)在 RoboEval 双臂操作基准测试中(该测试旨在捕捉比简单的通过/失败结果更丰富的信息),MolmoAct 2 的得分为 0.443,而 π0.5 为 0.405(分数越高越好)。

在 Franka 机械臂上的真实零样本测试中,MolmoAct 2 在我们评估的每一项任务中均优于 π0.5 及我们之前的 MolmoBot 模型,这些任务涵盖了从将苹果移至盘子等简单的拾取放置任务,到将移液管放入托盘、将红色小方块置于胶带卷中心,或是将刀放入盒子等更精细的任务。在每个任务的 15 次试验中,MolmoAct 2 在“苹果放盘”任务中成功率达 100%,在“移管入托盘”任务中为 86.7%,在“红立方体放胶带卷中心”任务中为 93.3%,在“刀放盒中”任务中为 93.3%,而在将多个物体移入碗中的长时序任务中为 62%。总体而言,MolmoAct 2 的平均成功率为 87.1%,而 MolmoBot 为 48.4%,π0.5 为 45.2%。

我们还在训练后对MolmoAct 2在单臂和双臂任务中的表现进行了评估,这些任务包括摆放餐具、收拾餐桌、擦拭桌面;将碗放入水槽;抬起托盘;以及折叠毛巾。MolmoAct 2在毛巾折叠、碗具摆放、桌面擦拭和托盘抬起等任务中表现尤为出色,这表明该模型可以通过训练后调整适应实际的操作行为。

在LIBERO基准测试中(该测试用于衡量模型随时间推移习得并保持多种技能的能力),MolmoAct 2在后训练后达到了97.2%的平均成功率,而MolmoAct 2-Think则达到了98.1%。这分别比MolmoAct提高了约10.6和11.5个百分点。

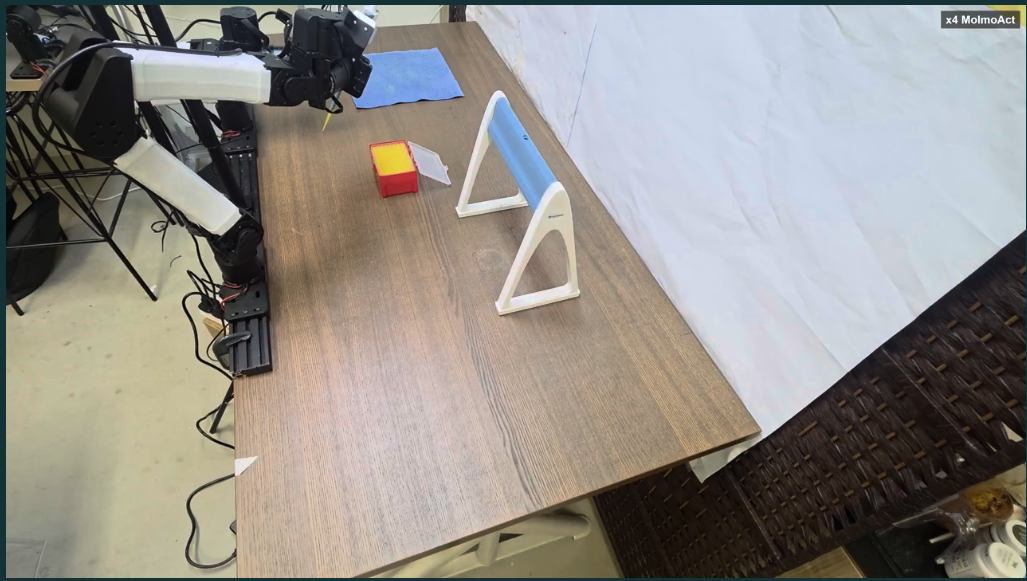

本文所述的部分实验室评估是在 I2RT Robotics 捐赠的 YAM 机械臂上进行的。I2RT 并未参与 MolmoAct 2 的开发、评估方案的设计或这些结果的报告。我们对其贡献深表感谢。

为了在实验室评估之外进一步验证MolmoAct 2,我们委托机器人数据与评估公司Cortex AI对MolmoAct 2在真实场景中的微调性能进行了第三方基准测试。Cortex AI采用系统化的多轮试验设置,针对包括MolmoAct 2在内的五种机器人策略,在多项双臂任务中进行了评估。

MolmoAct 2以0.51的平均分位居榜首,领先于OpenVLA-OFT(0.36)、π0.5(0.32)、Cosmos Policy(0.16)和X-VLA(0.05)。该策略在任务层面的表现也最为突出,在8项任务中的7项中排名第一,包括将试管放回托盘、存放糖果、收纳工具、收纳玩具、存放杯子、准备移液器吸头以及制作爆米花。

三、在真实环境中部署

对任何机器人模型而言,真正的考验在于它能否在受控环境之外正常工作——在那里,指令千变万化,细微的错误会随着时间推移而累积。MolmoAct 2 的设计旨在让用户在这些场景下更轻松地引导机器人,而无需对整个模型进行重新训练。它能够响应自然语言指令,并利用视觉轨迹显示用户希望机器人行进的路线,从而使 MolmoAct 2 的行为更易于理解和微调。

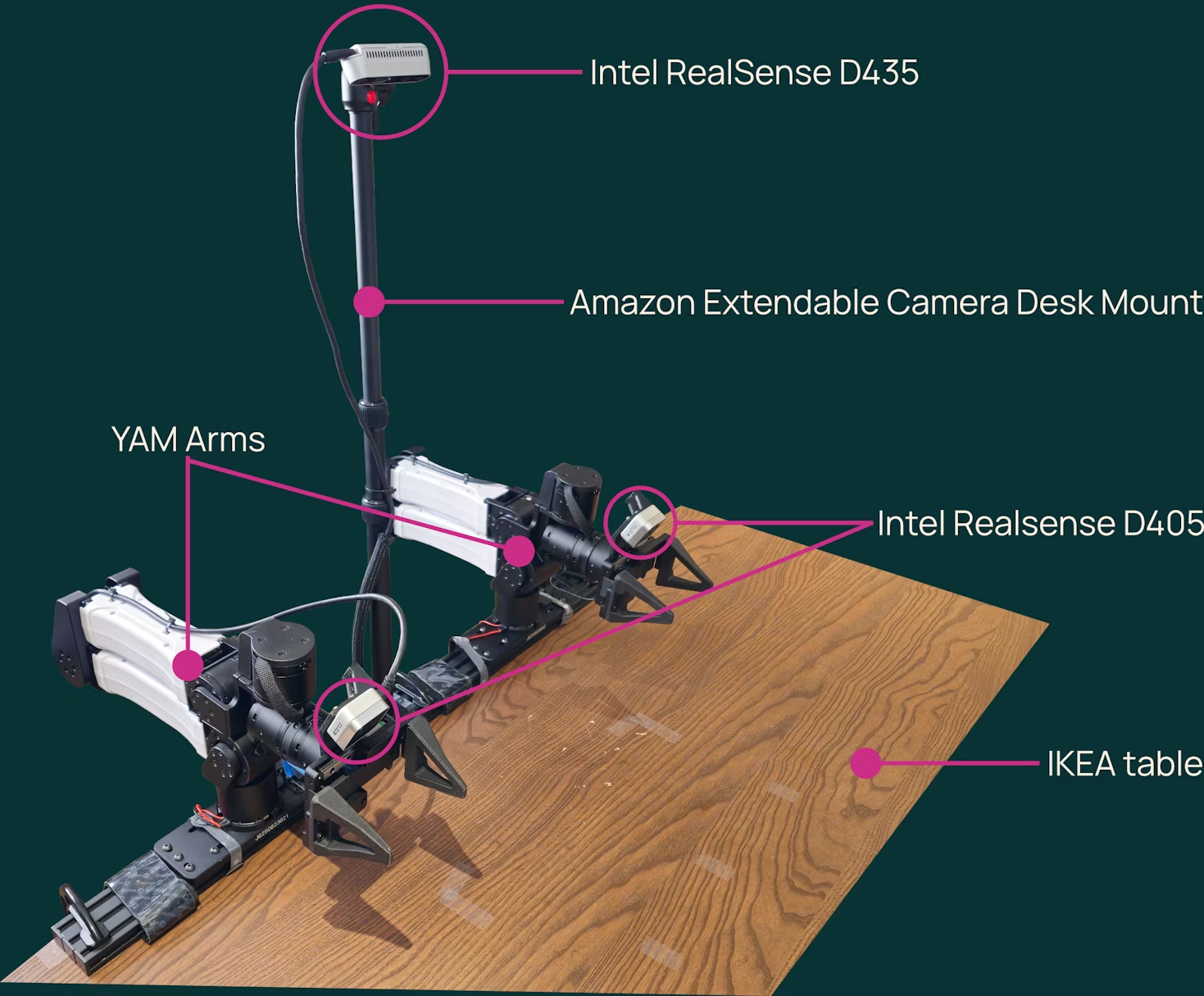

为了降低部署门槛,我们还发布了 MolmoAct 2 的参考机器人硬件配置方案,该方案将两条 YAM 机械臂与一台顶置的英特尔 RealSense D435 摄像头、两台用于近景观察的 D405 摄像头、一个可伸缩支架以及一个简单的桌面工作区相结合,为研究人员开展桌面及双臂操作研究提供了便捷的起点。

自今年年初以来,我们一直与研究合作伙伴共同开展MolmoAct 2的试点工作,其中包括由Le Cong教授领导的斯坦福大学医学院Cong实验室的研究人员。该实验室致力于打造一个能够加速基因组工程的自动驾驶湿实验室,这使其成为对机器人模型进行压力测试的理想环境:实验环境结构复杂,任务需要反复精确操作,且微小误差会在实验过程中不断累积。

在这些工作流程中,由MolmoAct 2驱动的机械臂负责处理CRISPR基因编辑实验中的常规操作步骤,例如在不同工作站之间转移样本以及操作台式设备。在测试了一系列针对其工作流程进行微调的通用机器人模型后,斯坦福团队发现,MolmoAct 2在简化湿实验室操作的关键环节方面展现出巨大潜力,进而能够加速科学发现。

此外,我们还在内部测试了MolmoAct 2如何应对模拟真实部署场景的变化:指令措辞调整、物体位置变动、场景中出现干扰物体以及物体替换。这些压力测试旨在检验该模型是否能在场景与训练环境不完全一致的情况下,依然能够遵循指令的意图。

这些试点项目和评估结果共同帮助我们不仅了解 MolmoAct 2 能否在受控环境中完成任务,还了解它在周围环境频繁变化时表现如何。

四、专为研究与扩展而设计

MolmoAct 2 虽是一款功能强大的模型,但仍存在局限性。与其他机器人系统一样,当其夹爪遮挡摄像头视线、模型响应速度不及机器人控制系统,或任务需要特别精细的操作时,它可能会遇到困难。此外,其视觉轨迹引导能力尚处于早期阶段——来自人类操作员的 2D 轨迹可能会引入深度轴误差。

这正是共享基础架构能够帮助该领域应对的挑战——研究人员可以检查模型、构建数据集,并(即将推出)将训练代码适配到新的机器和场景中。MolmoAct 2 旨在帮助确立这一标准,它基于我们去年通过 MolmoAct 奠定的基础,并将我们早期的研究转化为切实的影响。

在物理世界中采取行动是人工智能最艰难的前沿领域之一,我们认为开放共享是前进的最佳途径。请下载技术成果,并告诉我们您用它们构建了什么——以及我们可以在哪些方面改进。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)