开源vs商业,AI辅助编程工具该如何选择?

👋 大家好,欢迎来到我的技术博客!

📚 在这里,我会分享学习笔记、实战经验与技术思考,力求用简单的方式讲清楚复杂的问题。

🎯 本文将围绕人工智能这个话题展开,希望能为你带来一些启发或实用的参考。

🌱 无论你是刚入门的新手,还是正在进阶的开发者,希望你都能有所收获!

文章目录

开源 vs 商业,AI 辅助编程工具该如何选择?🤔

在过去的两年里,AI 辅助编程工具已经从“新奇玩具”变成了许多开发者日常工作流中不可分割的一部分。从代码自动补全到整个函数的生成,从单元测试的编写到复杂重构的辅助,这些工具正在重新定义我们与代码交互的方式。然而,面对琳琅满目的选项,一个核心问题始终困扰着团队和个人开发者:究竟是选择开源的 AI 编程助手,还是拥抱商业化的产品? 这个选择不仅关乎功能和体验,更涉及成本、隐私、定制性和长期战略。本文将从技术实现、生态对比、成本分析等多个维度,结合真实可运行的代码示例与决策图表,帮助你找到最适合自己的路径。✨

🔍 AI 辅助编程工具的底层逻辑

无论开源还是商业,当前主流的 AI 编程助手几乎都基于大语言模型(LLM),并通过特定的上下文工程和提示策略来理解你的代码库。大体上可以分为两类架构:

- 云托管模型:代码片段发送到云端服务器,由远程 GPU 集群完成推理,结果返回编辑器。商业工具如 GitHub Copilot、Cursor、Amazon CodeWhisperer 等均采用此模式,优势是模型能力持续进化、开箱即用。

- 本地模型/自托管:模型运行在本地或你自己的服务器上,数据不离开你的控制域。开源方案如 Tabby、Continue(配合 Ollama 等本地推理框架)、CodeGPT 支持此模式,适合对安全性、合规性要求极高的场景。

理解这一底层差异,就能解释很多表面上的能力差距和成本结构。接下来,我们深入探索两大阵营的代表性工具,并通过代码示例展示它们的实际用法。

🛠️ 开源 AI 编程工具:自由与控制的代价

开源世界从不让人失望,AI 编程助手领域同样涌现出一批优秀的项目。它们最大的魅力在于数据主权、可定制性和零许可费用。但与之相伴的,往往是需要投入更多精力进行部署、调优和维护。下面我们以三个典型的开源方案为例,看看它们如何工作。

1. Tabby:自托管的代码补全利器

Tabby 是一个完全自托管的 AI 代码助手,支持 CPU 和 GPU 推理,无需将代码发送到外部服务。它提供了 VS Code、JetBrains 等主流 IDE 的插件,后端可以用 Docker 一键部署。

部署 Tabby 服务端(在你的服务器上):

# 拉取 Tabby 的 Docker 镜像并运行

docker run -it \

--gpus all \

-p 8080:8080 \

-v $HOME/.tabby:/data \

tabbyml/tabby \

serve --model StarCoder-1B --device cuda

上述命令使用了一个较小的模型 StarCoder-1B,适合资源有限的场景。如果你有更强的硬件,可以切换到 StarCoder-3B 或 CodeLlama-7B。

配置 VS Code 扩展:

安装 Tabby 扩展后,在设置中指定自托管地址:

// .vscode/settings.json

{

"tabby.endpoint": "http://localhost:8080",

"tabby.completion.triggerMode": "automatic"

}

实际编程体验:

当你在编辑器中编写 Python 时,Tabby 会根据上下文提供补全建议。比如你输入一个函数签名:

def fibonacci(n: int) -> int:

"""

Return the n-th Fibonacci number.

"""

Tabby 可能会自动生成完整的函数体,并且所有计算都在你自己的服务器上完成,代码永远不会离开你的网络。这种隐私性对于金融、医疗或军工领域的开发者至关重要。🔒

2. Continue:将 IDE 变成 LLM 游乐场

Continue 是一个开源的 IDE 扩展(支持 VS Code 和 JetBrains),它充当了多个 LLM 后端的统一前端。你可以连接 OpenAI、Anthropic 的商业模型,也可以连接本地模型(通过 Ollama、LM Studio 等),甚至完全离线工作。它最大的特色是提供了聊天、编辑、自动补全等多种交互模式,并且允许你自定义模型行为。

配置 Continue 使用本地模型(以 Ollama 为例):

首先确保你已安装 Ollama,并拉取一个适合代码的模型:

ollama pull codellama:7b

然后在 Continue 的配置文件 ~/.continue/config.json 中指定模型:

{

"models": [

{

"title": "CodeLlama 7B",

"provider": "ollama",

"model": "codellama:7b"

}

],

"tabAutocompleteModel": {

"title": "StarCoder 3B",

"provider": "ollama",

"model": "starcoder:3b"

},

"contextProviders": [

{ "name": "codebase" },

{ "name": "docs" }

]

}

用 Continue 进行代码重构:

假设你有一段冗长的数据处理逻辑,需要提取为可读性更强的函数。选中代码后,按下快捷键 Cmd+L(Mac)打开 Continue 聊天窗口,输入指令:

“Refactor this code to use a list comprehension and add type hints.”

Continue 会读取当前文件上下文,并返回重构后的代码。你可以通过 Diff 视图直接应用变更。这一切都发生在你的本地模型中,完全离线。🚀

3. CodeGPT:插件体系下的灵活定制

CodeGPT 是一个以插件生态见长的开源 AI 编码助手。它不仅提供云服务,也支持本地模型(通过 Ollama、LocalAI 等),并且允许你创建自定义 Agent 来处理特定任务,如生成提交信息、代码审查、解释代码等。

创建一个自定义 Agent 用于自动生成 JSDoc:

进入 CodeGPT 设置,添加一个新的 Agent,编写系统提示:

You are a JSDoc expert.

Given a JavaScript/TypeScript function, generate a complete JSDoc comment including @param, @returns, and @example if applicable.

Only output the comment block, no additional text.

然后在编辑器中选中函数,右键选择 CodeGPT → 使用自定义 Agent 执行。它会直接插入注释:

/**

* Calculates the great-circle distance between two points on the Earth's surface.

* @param {number} lat1 - Latitude of point 1 in decimal degrees.

* @param {number} lon1 - Longitude of point 1 in decimal degrees.

* @param {number} lat2 - Latitude of point 2 in decimal degrees.

* @param {number} lon2 - Longitude of point 2 in decimal degrees.

* @returns {number} Distance in kilometers.

* @example

* const dist = haversineDistance(52.5200, 13.4050, 48.8566, 2.3522);

* console.log(dist); // 877.46

*/

function haversineDistance(lat1, lon1, lat2, lon2) {

const R = 6371; // Earth's radius in km

const dLat = (lat2 - lat1) * Math.PI / 180;

const dLon = (lon2 - lon1) * Math.PI / 180;

const a = Math.sin(dLat / 2) ** 2 +

Math.cos(lat1 * Math.PI / 180) * Math.cos(lat2 * Math.PI / 180) *

Math.sin(dLon / 2) ** 2;

const c = 2 * Math.atan2(Math.sqrt(a), Math.sqrt(1 - a));

return R * c;

}

这种高度定制化的能力,让团队可以把重复性编码规范工作完全自动化。📋

💼 商业 AI 编程工具:生产力至上的选择

商业工具通常用金钱换取时间和体验。它们拥有更强的模型、更精细的上下文工程、以及完善的集成支持,让开发者几乎无需配置就能享受顶尖的辅助能力。但代价是持续的订阅费用,以及代码数据必须传输到云端(除非有本地端点选项)。

1. GitHub Copilot:行业标杆的云端大脑

GitHub Copilot 由 OpenAI Codex 模型驱动,深度集成在 VS Code、JetBrains、Neovim 等编辑器中。它不仅能补全单行代码,还能根据注释或函数名生成整个块,甚至跨文件提供建议。

实际使用示例:

在 VS Code 中,新建一个 Python 文件,写下注释:

# create a flask route that accepts a POST request with JSON body,

# validates 'name' and 'email' fields, and inserts into PostgreSQL

Copilot 会立即生成类似下面的代码:

from flask import Flask, request, jsonify

import psycopg2

from psycopg2.extras import RealDictCursor

import re

app = Flask(__name__)

def get_db_connection():

conn = psycopg2.connect(

host='localhost',

database='mydb',

user='user',

password='password'

)

return conn

@app.route('/user', methods=['POST'])

def create_user():

data = request.get_json()

if not data:

return jsonify({'error': 'Invalid JSON'}), 400

name = data.get('name')

email = data.get('email')

if not name or not email:

return jsonify({'error': 'name and email are required'}), 400

if not re.match(r"[^@]+@[^@]+\.[^@]+", email):

return jsonify({'error': 'Invalid email format'}), 400

try:

conn = get_db_connection()

cur = conn.cursor()

cur.execute(

"INSERT INTO users (name, email) VALUES (%s, %s)",

(name, email)

)

conn.commit()

cur.close()

conn.close()

return jsonify({'message': 'User created successfully'}), 201

except Exception as e:

return jsonify({'error': str(e)}), 500

这种生成不仅考虑了语法,还包含了合理的验证和错误处理,极大地缩短了从想法到可运行代码的时间。⚡

2. Cursor:为 AI 原生打造的编辑器

Cursor 是基于 VS Code 深度定制的编辑器,它将 AI 能力融入到了几乎每一个交互环节:除了代码补全,还有行内对话、命令面板生成、跨文件上下文感知等。Cursor 使用自己的专有模型,也允许接入 OpenAI API 密钥,提供灵活的定价。

用 Cursor 进行快速代码移植:

假如你要将一段 Rust 的错误处理逻辑移植为 Go 语言,可以直接通过 Cmd+K 打开生成栏,输入指令:

“Rewrite this Rust function in Go, using idiomatic error handling.”

// 原始 Rust 代码

fn read_config(path: &str) -> Result<Config, Box<dyn std::error::Error>> {

let content = std::fs::read_to_string(path)?;

let config: Config = toml::from_str(&content)?;

Ok(config)

}

Cursor 会输出 Go 版本:

import (

"os"

"github.com/BurntSushi/toml"

)

type Config struct {

// fields

}

func ReadConfig(path string) (*Config, error) {

data, err := os.ReadFile(path)

if err != nil {

return nil, fmt.Errorf("reading config file: %w", err)

}

var cfg Config

if err := toml.Unmarshal(data, &cfg); err != nil {

return nil, fmt.Errorf("parsing config: %w", err)

}

return &cfg, nil

}

不仅能翻译语法,还能根据目标语言的惯例调整错误包装方式。🧠

3. Amazon CodeWhisperer:深度融合云服务的个体化助手

Amazon CodeWhisperer 是 AWS 推出的 AI 编程助手,免费提供给个人开发者使用。它对 AWS 服务的代码建议尤其精准,并内置了安全扫描功能,能够检测依赖中的已知漏洞。对于重度使用 AWS 生态的团队,其价值非常明显。

示例:生成 Lambda 函数处理 S3 事件:

在编辑器中输入注释:

// Lambda handler that gets triggered by S3 object creation,

// downloads the object, resizes the image using sharp, and uploads to another bucket

CodeWhisperer 会立刻补全完整的成代码:

import { S3 } from 'aws-sdk';

import sharp from 'sharp';

const s3 = new S3();

const destinationBucket = process.env.DESTINATION_BUCKET;

exports.handler = async (event) => {

const srcBucket = event.Records[0].s3.bucket.name;

const srcKey = decodeURIComponent(event.Records[0].s3.object.key.replace(/\+/g, ' '));

const dstKey = 'resized/' + srcKey;

try {

const image = await s3.getObject({ Bucket: srcBucket, Key: srcKey }).promise();

const resized = await sharp(image.Body)

.resize(800, 600)

.toBuffer();

await s3.putObject({

Bucket: destinationBucket,

Key: dstKey,

Body: resized,

ContentType: 'image/jpeg'

}).promise();

console.log(`Successfully resized ${srcKey} and uploaded to ${dstKey}`);

} catch (err) {

console.error(err);

throw err;

}

};

你可以看到,它自动处理了 S3 事件结构、错误日志以及 sharp 的调用,几乎就是生产可用的代码。📸

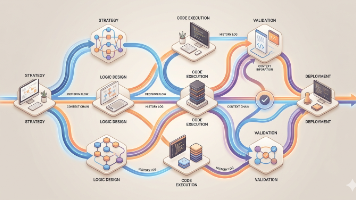

📊 关键维度对比:用 mermaid 图表看清差异

选择工具不能只凭感觉,我们需要建立一个对比框架。下面这张象限图直观地展示了各工具在“定制灵活性”与“开箱即用度”两个维度上的定位:

从图中可以看出,开源工具偏向于高定制、低开箱即用(意味着需要自行部署和配置),而商业工具则占据右侧区域,牺牲了一定的控制权换取顺畅体验。

但只看定位还不够,我们还需要深入其他关键维度:

| 维度 | 开源工具 (Tabby/Continue/CodeGPT) | 商业工具 (Copilot/Cursor/CodeWhisperer) |

|---|---|---|

| 代码隐私与安全 | ⭐⭐⭐⭐⭐ 数据不离开本地/私有网络 | ⭐⭐ 代码发送至云端,需信赖供应商 |

| 模型可定制性 | ⭐⭐⭐⭐⭐ 可换模型、微调、裁剪 | ⭐ 固定模型,部分支持选择 |

| 多语言支持 | ⭐⭐⭐ 受限于所选开源模型 | ⭐⭐⭐⭐⭐ 大模型训练语料广泛 |

| IDE 集成深度 | ⭐⭐⭐ 插件功能完备但偶有滞后 | ⭐⭐⭐⭐⭐ 原生深入,响应迅速 |

| 成本 | 🆓 免费(硬件成本另计) | 💲 月费制,个人约$10-30/月 |

| 法规合规 | ⭐⭐⭐⭐⭐ 满足 GDPR/HIPAA 等 | ⭐⭐ 需审查数据处理协议 |

| 社区与支持 | ⭐⭐⭐ 社区驱动,文档参差 | ⭐⭐⭐⭐ 官方支持,文档完善 |

稍微结合使用场景补充一下:如果你的团队需要对行业合规性负责,比如金融数据不能出境,那么自托管开源方案几乎是唯一选择。如果你从事的是快速原型开发或全栈 Web 应用,商业工具的广度和速度则能显著缩短交付周期。⚖️

🧭 决策框架:如何选择适合你的工具?

面对如此多的变量,我们需要一个清晰的决策路径。下面这个 mermaid 流程图可以帮助你根据自身情况逐步筛选:

此图并非绝对,现实中很多团队采用混合策略:核心敏感代码使用开源本地工具,而外围或非敏感项目使用商业工具以提高效率。例如,一家医疗科技公司可能要求所有处理患者数据的代码必须在隔离网络内编写,此时 Continue + 本地模型是强制选项;但他们的市场部门官网项目则无此限制,完全可以使用 Copilot 加速开发。🏥

🔬 深入实战:搭建一个混合环境的 AI 代码审查流水线

为了展示开源与商业工具如何在实际项目中互补,我们来设计一个自动化的代码审查流水线。流水线分为两个阶段:

- 本地隐私阶段:提交前使用 Continue 和本地模型进行代码风格检查和简单逻辑审查。

- 云端增强阶段:推送代码后,在 CI/CD 中使用商业工具的 API(以 Copilot Chat API 为例)进行更智能的审查,如架构建议、安全漏洞检测。

阶段一:本地审查(开源)

首先,配置 Continue 的 config.json,增加一个审查用的本地模型并启用 codebase 索引:

{

"models": [

{

"title": "CodeLlama-Review",

"provider": "ollama",

"model": "codellama:7b",

"systemMessage": "You are a code reviewer. Focus on readability, adherence to SOLID principles, and potential bugs. Provide concise suggestions."

}

],

"slashCommands": [

{

"name": "review",

"description": "Review current file for code quality",

"prompt": "Review the following code for readability, potential bugs, and adherence to best practices. Give specific line-level suggestions.",

"model": "CodeLlama-Review"

}

]

}

开发者在提交前,可以在 VS Code 中按下 Cmd+L 并输入 /review。Continue 会将当前文件内容发送给本地 Ollama 模型,返回审查意见。例如:

Line 23: Variable

tempis poorly named; consideruserCount.

Line 45: This function has too many responsibilities, consider splitting.

一切都在本地完成,没有丝毫泄漏风险。✅

阶段二:CI 中的商业审查(云端增强)

对于推送到仓库的代码,我们希望利用更强大的模型进行深度安全检查。GitHub Copilot 目前主要通过编辑器交互,没有独立的审查 API,但我们可以使用 Cursor 的命令行工具或 OpenAI API(很多商业工具底层模型)来构建审查步骤。这里以 OpenAI API(注意:需合规处理)为例,但为了保证隐私,我们可以只对非敏感仓库使用。或者使用 CodeWhisperer 的安全扫描功能集成到 AWS CodePipeline 中。下面展示一个使用 OpenAI API 进行代码审查的 GitHub Action 片段(假设代码库已经是公开或允许外传的):

# .github/workflows/ai-review.yml

name: AI Code Review

on:

pull_request:

types: [opened, synchronize]

jobs:

review:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Get diff

id: diff

run: |

git fetch origin main

git diff origin/main -- . > diff.txt

- name: Run AI review

uses: openai/openai-codereview@v1

with:

api-key: ${{ secrets.OPENAI_API_KEY }}

model: gpt-4-turbo

diff-file: diff.txt

prompt: "Review the following diff for security issues, logic errors, and performance problems."

这个 Action 会将 PR 的变更发送给 OpenAI,由商用模型输出结构化审查意见,直接评论在 PR 中。这种混合流水线既保护了核心代码的隐私,又能借助云端智能提升审查深度。🔍

💰 成本精算:不只是订阅费

很多人在比较成本时只盯着价格标签,但这是不够的。我们需要计算总体拥有成本(TCO)。

开源方案的成本组成

以 Continue + 本地 Ollama 部署在一台NVIDIA RTX 4090工作站(约$1,600)为例,假设该工作站寿命5年,每天使用8小时:

- 硬件摊销:$1,600 / (5*365) ≈ $0.88/天

- 电费:RTX 4090 满载约 450W,加系统功耗共600W,8小时耗电4.8kWh,电价$0.12/kWh,约$0.58/天

- 运维人力:初始设置4小时,后续维护每月1小时,以$50/小时计,日均($200 + $600)/1825 ≈ $0.44/天

日均总成本约 $1.90,低于一杯咖啡☕。如果团队多人共享该服务器,每人成本极低。

商业方案的成本

- GitHub Copilot: $10/月/人 ($0.33/天)

- Cursor Pro: $20/月/人 ($0.67/天)

- Amazon CodeWhisperer 个人版: 免费

乍看之下,Copilot 似乎更便宜,但别忘了:商业方案不包含任何硬件前期投入,且无需维护。对于个人开发者来说,一天不到一瓶矿泉水的价格获得顶级模型,性价比很高。但团队规模增长到50人时,年费就是$6,000(Copilot),相比一台$3,000服务器的本地部署方案,商业费用累积速度更快。然而,服务器需要有人维护,加上电力、冷却,可能反而更贵。因此成本结论依赖于团队规模和基础设施现状。通常小型团队(<10人)且无专职运维,商业工具更划算;大型团队且有自建数据中心,开源可能更优。

🧩 定制化:当你需要让 AI 理解你的代码库

开源工具的最大优势之一是可以**微调(Fine-tune)**模型。假设你的公司有一套内部框架和千余行独特的 API 调用模式,通用模型对此一无所知,补全经常不准确。你可以用 Continue 结合微调后的本地模型大幅提升准确率。

微调 StarCoder 的简化流程:

- 收集代码语料:将团队的内部代码库(允许训练的部分)格式化为 prompt/completion 对。

- 使用 PEFT/LoRA 技术进行微调,降低硬件要求。

以 Python 脚本示意(实际需适配框架):

from transformers import AutoModelForCausalLM, AutoTokenizer, TrainingArguments, Trainer

from peft import LoraConfig, get_peft_model

from datasets import Dataset

model_name = "bigcode/starcoderbase-1b"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(model_name, load_in_8bit=True)

# 配置 LoRA

lora_config = LoraConfig(r=8, lora_alpha=32, target_modules=["c_proj"], lora_dropout=0.1)

model = get_peft_model(model, lora_config)

# 加载自定义数据集(JSON Lines格式,每行 {"prompt": "...", "completion": "..."})

dataset = Dataset.from_json("custom_code_dataset.jsonl")

dataset = dataset.map(lambda x: tokenizer(x["prompt"], truncation=True, padding="max_length", max_length=512))

training_args = TrainingArguments(

output_dir="./starcoder-custom",

per_device_train_batch_size=2,

gradient_accumulation_steps=4,

num_train_epochs=3,

logging_steps=10,

save_strategy="epoch",

learning_rate=5e-5,

)

trainer = Trainer(model=model, args=training_args, train_dataset=dataset)

trainer.train()

model.save_pretrained("./starcoder-custom")

训练后,使用 Ollama 导入该模型即可在 Continue 中调用。商业工具虽然通过上下文工程(如最近编辑的文件、打开的选项卡)来提升相关性,但无法达到微调级别的领域适配。尤其当你使用大量内部 DSL 时,微调可能是唯一解。

🌐 社区与生态:开源协作的力量

开源工具的另一个隐形价值是社区驱动的创新。例如,Continue 的 context provider 机制催生了大量第三方集成:从 Jira 议题到 Confluence 文档,从 Rust 的 Cargo.toml 到 Kubernetes 部署文件,任何需要作为上下文注入的内容都可以由社区开发插件实现。你永远不需要等待官方团队排期某个特性。

相比之下,商业工具的能力迭代完全依赖于特定公司。Copilot 的上下文策略你无法干预,Cursor 的模型更新你只能等待。这种差异在长尾需求上体现得尤为明显。如果你是那种喜欢“折腾”,并且享受对工具完全掌控的开发者,开源生态会给你无限的可能。🤓

🔮 未来趋势与建议

AI 辅助编程正在快速演进,我们可能会看到以下融合趋势:

- 开源模型能力逼近商业模型:随着 Meta 的 Code Llama 70B、DeepSeek Coder V2 等发布,本地模型的代码生成质量已接近 GPT-3.5 水平,并在特定基准上超越。

- 混合部署成为主流:越来越多的工具会同时提供云端 API 和本地推理能力,让用户在同一个界面内根据文件敏感度动态切换模型。

- 编辑器和 AI 的界限模糊:类似 Cursor 这样的原生集成可能成为下一代 IDE 的标配。

基于以上分析,给出最终建议:

- 如果你是个人开发者或自由职业者,对成本敏感且项目不涉及极端隐私需求,GitHub Copilot 或 Amazon CodeWhisperer(免费) 是最佳起点。如果需要更灵活的交互,Cursor 值得付费体验。

- 如果你是小型创业团队,代码安全有较高要求但非强制合规,可以采用 Continue 作为统一界面,根据项目性质切换本地模型或云端商业模型,实现成本与安全的平衡。

- 如果你在大型企业或受监管行业,数据安全是红线,必须无条件选择自托管开源方案(Tabby 或 Continue + 本地模型)。可考虑组建内部 AI 平台团队,进行模型微调和统一维护,长期收益巨大。

- 如果你是编程教育者或学生,开源工具提供了极佳的学习平台。你可以深入理解 LLM 的工作原理,甚至通过 Continue 的自定义 slash command 创造教学辅助工具。免费商业工具如 CodeWhisperer 个人版也可用来节省时间。

🎯 结语

开源与商业从来不是非黑即白的对立,而是光谱上可以按需移动的连续体。今天,我们可以用 Continue 连接 Ollama 本地模型审查敏感代码,同时又用 Cursor 加速前端样式的编写;我们可以用 Copilot 快速探索算法思路,再用 Tabby 在内部服务器上复现并对齐私有 API。真正智慧的选择,是构建一个多层级的工具矩阵,让每个任务都匹配最合适的 AI 辅助方案。 这不仅最大化生产力,还确保了数据安全与成本可控。希望本文提供的代码、图表和思考框架,能帮助你在这个快速变化的世界中,做出自信且明智的决策。💪

参考资源

🙌 感谢你读到这里!

🔍 技术之路没有捷径,但每一次阅读、思考和实践,都在悄悄拉近你与目标的距离。

💡 如果本文对你有帮助,不妨 👍 点赞、📌 收藏、📤 分享 给更多需要的朋友!

💬 欢迎在评论区留下你的想法、疑问或建议,我会一一回复,我们一起交流、共同成长 🌿

🔔 关注我,不错过下一篇干货!我们下期再见!✨

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献199条内容

已为社区贡献199条内容

所有评论(0)