Easysearch 文档是目前中文 ES界 最好的学习资料

最近把 Easysearch 的官方文档从头到尾刷了一遍,挺意外的。

在 ES 生态已经分化成 Elasticsearch / OpenSearch / Easysearch 三条主线的今天,能找到一份既不机翻、又不碎片化、还能把底层讲透的中文文档,真不容易。

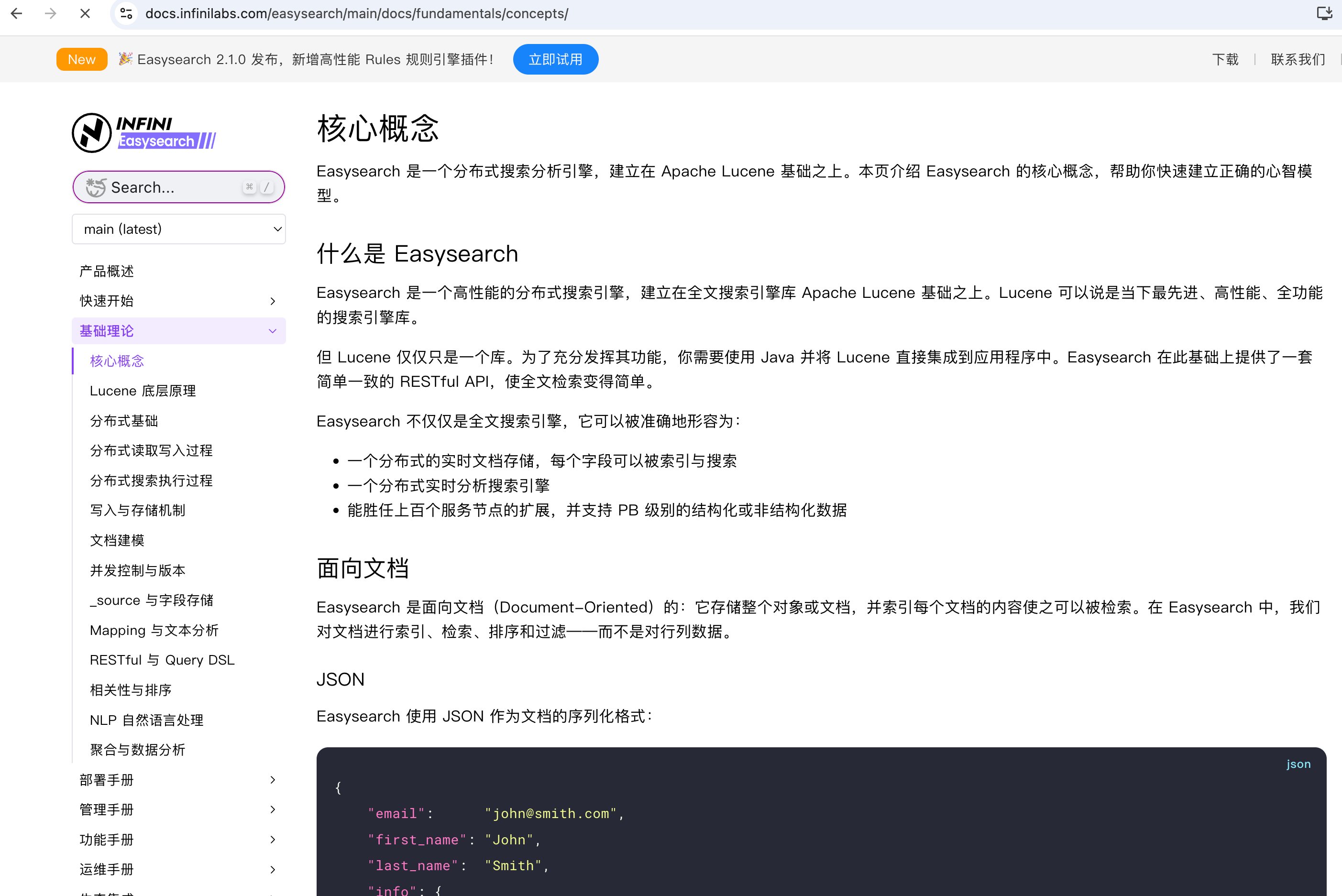

文档地址:https://docs.infinilabs.com/easysearch/main/docs/

经常有朋友问我怎么系统学 ES,以前我都推几本老书加官方英文文档凑着看。现在建议直接换成它。下面聊聊我为什么这么推荐,顺便把文档里几个比较硬核的概念用图的方式再补一遍——文档本身偏文字,配上图看会更清楚。

一、它不是"API 搬运工",而是一本真正的搜索引擎教科书

市面上 90% 的中文 ES 资料都有个通病:

- 要么是官方文档的蹩脚翻译,上来就甩配置项和 API,读完还是不知道"为什么要这么设计";

- 要么是零散博客,搜出来一堆"如何解决 XXX 报错",版本还混乱,ES 5.x、6.x、7.x、8.x 的答案搅在一起,抄上去直接踩坑。

Easysearch 文档走的是第三条路——按认知递进来组织内容。它的目录结构是这样的:

产品概述 → 快速开始 → 基础理论 → 部署手册 → 管理手册

→ 功能手册 → 运维手册 → 生态集成 → 最佳实践

最难得的是 “基础理论” 这一章的位置——放在了"快速开始"后面、"功能手册"前面。也就是说,它不急着教你敲 PUT /index,而是先把下面这些讲清楚:

- Lucene 底层到底是怎么转的

- 分布式读写时数据在节点之间怎么流动

- 写入和存储机制(refresh / flush / translog)

- 文档建模、并发控制、版本控制

_source与字段存储的取舍- Mapping 与文本分析的关系

- 相关性评分和排序

- NLP 与聚合分析

这套顺序很有《Elasticsearch: The Definitive Guide》那本老书的味道——先讲"为什么",再讲"怎么做"。对做 SRE 或者后端的人来说,搞懂了地基,后面那些 API 无非就是查表,遇到问题也能自己推断出原因。

二、把文档里几个核心概念"画"出来

前面那版推荐发出去之后,有人留言说:"文档再好,全是文字,小白看着还是费劲。"这话有道理。Easysearch 文档本身是偏文字型的,下面我把它里面几个最容易卡壳的核心机制画一下,配着文档看会顺很多。

2.1 分布式读写:数据到底怎么跑的

新手最常问的一个问题:“我往节点 A 写,为什么查节点 B 也能查到?”

写入流程是这样的:

关键点:

- 协调节点(Coordinate Node)不做存储,只做路由和聚合

- 路由公式:

shard = hash(routing) % primary_shards(默认 routing 就是_id) - 主分片写完,还要等所有 in-sync 副本都写完才返回(可以通过

wait_for_active_shards调)

读取则是典型的 Scatter & Gather(分散-聚合) 模式:

这一段 Easysearch 文档里写得很清楚,但文字描述多。配这张图再去读"分布式搜索执行过程"那一章,基本就通了——也能解释为什么 from + size 太大时协调节点容易 OOM(每个分片都要返回 from+size 条,然后在协调节点合并排序)。

2.2 倒排索引:搜索的"黑盒"里装了什么

这是理解"为什么搜不到"的终极答案。文档里讲得挺细,但很多人看完还是抽象。其实一张表就能说清:

假设我们写入了三个文档:

| Doc ID | 内容 |

|---|---|

| 1 | I love Go programming |

| 2 | Go is fast |

| 3 | I love Python |

经过标准分词器处理(小写化 + 按空格切分 + 去停用词)后,倒排索引大概长这样:

| Term(词项) | Posting List(倒排表) |

|---|---|

go |

[Doc1:pos3, Doc2:pos1] |

fast |

[Doc2:pos3] |

i |

[Doc1:pos1, Doc3:pos1] |

love |

[Doc1:pos2, Doc3:pos2] |

programming |

[Doc1:pos4] |

python |

[Doc3:pos3] |

换成通俗理解:它就是书末尾的关键字索引页。你搜"分布式",索引表直接告诉你这个词出现在第 10、45、99 页,不用翻整本书。

想通这个,几个常年困扰新手的问题就一起解决了:

- 为什么

keyword字段搜不到 “Apple iPhone”?——因为 keyword 不分词,整个字符串作为一个 term 进去,你搜 “apple” 自然找不到。 - 为什么改了分析器要重建索引?——因为倒排表是按旧分词器生成的,不 reindex 就还是旧的。

- 为什么

match_phrase能识别顺序?——因为 posting list 里存了 position,比较位置就知道相不相邻。

2.3 text vs keyword:一张表把所有坑都列清

这对类型是新手踩坑重灾区,文档里给了决策树,我再加一张对比表:

| 维度 | text(文本型) |

keyword(关键词型) |

|---|---|---|

| 分词 | 会被分析器拆成多个词 | 整体作为一个 term |

| 典型场景 | 商品描述、邮件正文、日志 message | 状态码、用户 ID、标签、枚举 |

| 搜索方式 | match / match_phrase 全文检索 |

term / terms 精确匹配 |

| 能否排序 | ❌ 默认不行(需开 fielddata,慎用,吃内存) | ✅ 基于 doc_values,快 |

| 能否聚合 | ❌ 同上 | ✅ 快 |

| 存储结构 | 倒排索引(Inverted Index) | 倒排索引 + doc_values(列式) |

| 大小写 | 经分析器统一小写 | 默认保留原样 |

实战建议:绝大多数人类可读的字符串字段,都应该用 multi-fields 同时暴露两个视角:

"title": {

"type": "text", // 用来全文搜索

"fields": {

"keyword": {

"type": "keyword", // 用来聚合、排序、精确过滤

"ignore_above": 256

}

}

}

这样 title 能搜,title.keyword 能聚合。文档的"映射模式与最佳实践"那一章把各种变体都列了,非常值得精读。

2.4 段合并(Segment Merge):必懂的 I/O 抖动来源

这一段文档里讲得比较散,但对做运维的人来说太关键了。

核心前提:Lucene 的 Segment(段)一旦写入就不可变。

- 新数据进来 → 先入内存 buffer →

refresh每秒生成一个小 segment(此时可被搜索) - 积累多了 → 后台 merge 线程把小 segment 合并成大 segment

- 删除文档 → 只是在

.del文件里打标记,合并时才真正物理删除

示意:

写入流:

[buffer] --refresh(1s)--> [seg1:10MB]

[seg2:12MB] ──┐

[seg3:8MB] ──┤──merge──> [seg_new:60MB]

[seg4:15MB] ──┤

[seg5:15MB] ──┘

[seg6:9MB] ← 新写入还在继续

痛点:

- 写入高峰期,merge 会抢 I/O 和 CPU,表现为磁盘 await 飙升、写入延迟抖动

- 大量 delete/update 会让 segment 碎片化,查询变慢(要遍历更多 segment)

- force_merge 到 1 个段只适合冷索引,对还在写入的热索引做这个操作等于自杀

文档里的"Refresh、Flush 与 Force Merge"以及"索引压缩"两节,把这些机制讲得挺扎实,配合 _cat/segments API 去观察集群状态,能少踩很多坑。

三、跟得上时代:向量、AI、信创全覆盖

这是一份 2026 年的文档,所以它没死守传统全文检索,把这两年最火的东西都拉通了。

3.1 向量检索:HNSW 图结构别再抽象了

文档里覆盖了完整的向量检索链路:向量字段建模、k-NN API、混合检索(Hybrid Search)、甚至 RAG 和 LLM 集成。但很多人读完只记住了"它支持 k-NN",没搞懂为什么向量检索那么吃内存。

底层用的是 HNSW(Hierarchical Navigable Small World)算法,它的结构是分层图:

Layer 3 (最稀疏): A ─────────── B

│ │

Layer 2: A ── C ──── D ──── B

│ │ │ │

Layer 1: A ── C ── E ── F ── D ── B

│ │ │ │ │ │

Layer 0 (全量): 所有向量点都在这一层,彼此连边

查找过程(从顶层往下跳):

- 从最顶层的入口点开始

- 在当前层找离查询向量"最近"的点

- 下降到下一层,继续找更近的

- 一直下降到底层,返回 top k

这就是为什么向量索引必须常驻内存——每次查询都要在图上做多次跳转,走磁盘根本撑不住。

理解了这一点,再去看文档里"向量字段建模指南"那一章,关于 ef_search、m、ef_construction 这些参数的含义就清楚了:本质是在精度、内存、查询速度之间做权衡。

3.2 信创与国产化:独家内容

这是 Easysearch 的差异化优势,别的 ES 文档基本不讲:

- CPU 架构:龙芯、兆芯、申威、鲲鹏、海光、飞腾

- 操作系统:麒麟、统信 UOS、移动云 BC-Linux

- 国密配置:SM2/SM3/SM4

接政企项目的朋友看到这里基本就不用挣扎了,现成的交付手册。

四、什么人该怎么读

不同身份的读法差别挺大,不推荐从头啃到尾:

| 你是谁 | 推荐路径 |

|---|---|

| ES 零基础 | 产品概述 → 快速开始 → 基础理论全读(重点)→ 功能手册挑感兴趣的 |

| 老手补课 | 直接跳"基础理论"里的 Lucene 原理、写入存储、相关性,很多细节会刷新你的认知 |

| 业务开发 | 功能手册的 Query DSL + 聚合 + 映射基础,最佳实践的建模章节 |

| 运维 / SRE | 部署手册 + 运维手册 + 管理手册(集群管理、CAT 接口、Refresh/Flush) |

| 做 AI 搜索 | 向量搜索 + 语义搜索 + 生态集成的 AI 章节,一条线打通 RAG |

| 政企 / 信创 | 部署手册里的信创平台章节 + 国密配置 + 安全手册 |

五、踩坑建议(动手前必看)

这是我读完文档结合自己踩过的坑总结的:

5.1 建模阶段

- 分片数一旦定了就改不了(除非 reindex)。不要上来就

"number_of_shards": 20,多数场景 1~3 个分片足够。 - 别把所有字段都设成 text——ID、状态、枚举类字段用

keyword,省大量内存。 - Nested 字段是个大坑。每条 nested 记录都会变成一个隐藏的独立文档,写入和查询成本都高。能用对象扁平化就别用 nested。

5.2 写入阶段

- 别一条一条 index,走 Bulk API,批次大小 5~15MB 比较合适。

- 大量写入时把

refresh_interval调大(比如 30s 或 -1),写完再调回来,能显著提升吞吐。 - translog 可以调成 async(

index.translog.durability: async),性能好但有丢数据风险,自己权衡。

5.3 查询阶段

- 深分页用

search_after或 PIT,别用from + size。后者超过 10000 就开始内存爆炸。 - 聚合基数高时加

"size": 0,别把 hits 也拉回来。 - 慢查询先开

_cat/pending_tasks和 profile API 定位,别瞎猜。

5.4 运维阶段

- 别轻易 force_merge 热索引,冷索引归档前做一次合并到 1 段倒是合理的。

- 监控

_cat/thread_pool,写入拒绝(write rejected)比查询慢更致命。 - JVM 堆不要超过 31GB(指针压缩临界),剩下的内存留给 OS page cache。

这些点在文档的"查询调优与慢查询排查"、“数据生命周期”、"写入限流"等章节都有更详细的版本,遇到具体问题可以按关键字搜。

结语

ES 生态这几年其实挺割裂的。Elastic 自己走商业化路线,OpenSearch 跟着 AWS,国内则出现了 Easysearch 这种立足本土场景的分支。中文资料要么停留在 5.x/6.x 时代,要么是某个版本的机翻,想系统学一下 ES 变成了一件意外困难的事。

Easysearch 这份文档难得在哪?

- 它保留了 ES 的经典概念体系——分布式、倒排、评分、聚合这些底层道理不会因为分叉就变;

- 它纳入了向量、AI、RAG 这些新时代内容,不至于学完出来还是 2019 年的知识;

- 它专门处理了中文和信创场景,这是做国内项目的刚需;

- 它用结构化的中文讲清楚了"为什么"——这比什么都重要。

想在 2026 年系统吃透 ES 体系、或者正在评估国产化搜索方案,去读它。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)