Object Detection with Multimodal Large Vision-Language Models论文精读

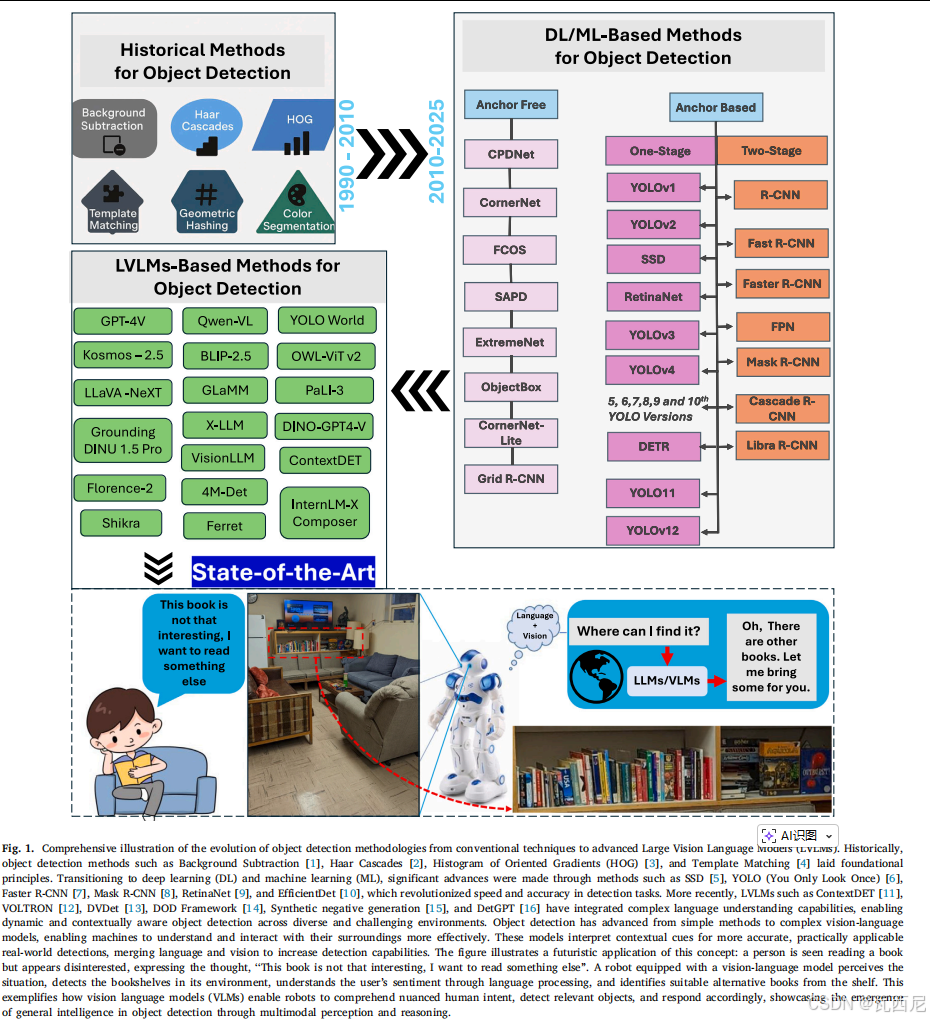

这篇综述论文《Object Detection with Multimodal Large Vision-Language Models: An In-depth Review》为你之前关注的两篇具体研究工作,提供了一个全景式的、系统性的框架。它没有提出新的微调方法,而是整合、分类并对比了当前所有利用大型视觉语言模型进行目标检测的技术路线。

以下是基于该综述论文,从方法论和系统架构角度进行的详细解析。

1. 三大核心应用策略:综述给出的微调/适配总体框架

综述将目前所有利用LVLM进行目标检测的方法,清晰地归纳为三种策略。这正是你问题的直接答案框架。

策略一:零样本预测

这是最直接的方法,无需任何微调,完全依赖LVLM在预训练阶段学到的视觉-语言对齐能力。

- 核心机制:

- 图文匹配:输入一张图和候选文本标签(如

["苹果", "橘子", "樱桃"]),模型计算图像特征与每个文本标签特征的相似度,选择最相似的标签作为检测结果。 - 文本提示:这是零样本策略的一个关键变体,保持模型参数完全冻结,仅通过修改输入的文本提示来引导模型注意力。例如,将简单的类别名“苹果”替换为描述性提示“一个放在白色桌子上的成熟红苹果”,可以极大地提升检测的准确性和对复杂场景的理解能力,而无需任何模型重训练。

- 图文匹配:输入一张图和候选文本标签(如

- 代表模型:CLIP、早期的GLIP、GPT-4V等。

- 优势:灵活性极高,部署最快,能检测训练中未见过的任意类别。

- 劣势:性能高度依赖于提示词工程,对罕见领域、细粒度或抽象概念的理解不够精确,在专门的检测基准(如LVIS)上通常不如微调方法。

策略二:视觉微调

这是你关注的重点。它指的是对LVLM的视觉编码器部分进行特定任务的数据训练,而语言编码器通常保持不变。

- 核心机制与训练范式:

- 领域适配:使用目标领域的标注检测数据(如特定的工业缺陷或医学图像数据集),仅对被冻结的LLM之前的视觉编码器和可能的投影层进行反向传播和参数更新。这使模型能学习到新领域特有的视觉特征(如形状、纹理、光照),同时保留其语言理解能力。

- 组合式微调:综述中的Table 3(8) 提到,像

LED这类工作,通过一个零初始化的交叉注意力适配器,将MLLM中间层的隐藏状态(包含空间-语义关联)迁移到检测解码器中,从而在不依赖人类标注数据的情况下增强检测器的泛化能力。 - 强化学习微调:

VLM-R1等工作开创性地使用强化学习而非传统的监督学习来微调LVLM。它通过设计专门针对目标检测任务的奖励函数(如基于mAP的奖励和防止“奖励黑客”行为的冗余惩罚),让模型在生成检测框的过程中不断优化策略,尤其在需要复杂推理的指代表达理解任务上表现出色。

- 代表模型:LLMDet、VLM-R1、LMMRotate、ROBOFLOW100-VL中的少样本微调方法。

- 优势:显著提升在特定、困难领域的检测性能;通过RL等方法能获得更好的领域外泛化能力。

- 劣势:需要领域内的标注数据;存在灾难性遗忘风险(语言能力可能下降);计算成本较高。

策略三:文本提示

这个策略比较特殊。它和策略一中的文本提示一样,整个LVLM(视觉+语言编码器)的参数完全冻结。区别在于其应用形式:它常被用作一个“推理规划器”,生成可执行代码或子任务序列,去调度其他专门的视觉工具。

- 核心机制:

- 任务编排:LVLM接收高层次的自然语言指令和图像,但它不直接输出检测框。而是通过思维链等方式,动态生成一系列具体指令。

- 工具调用与代码生成:这些指令通常是调用底层视觉API的伪代码或任务描述,例如“使用YOLO-World检测图像中所有的‘人’,并标记出‘穿红裙子’的那一个”。然后,LVLM会把标记任务交给一个更精确的开放词汇检测器或分割模型(如SAM)去执行。

- 结果整合:LVLM整合底层工具的结果,生成最终的回答。

- 代表模型:DetGPT、MM-ReAct、HuggingGPT。

- 优势:结合了LVLM的通用推理能力与专用模型(如YOLO、SAM)的精确性;无需训练,灵活性极高。

- 劣势:系统架构复杂;推理速度慢(涉及多模型协同);性能受限于所调用的底层专家模型。

2. 关键领域的微调架构与创新

综述通过多个实例,展示了上述策略在特定领域的具体微调实现,为你提供了丰富的技术细节:

- 开放词汇检测的微调:

LLMDet通过联合训练Grounding任务和由LLM监督的图像级/区域级描述生成任务,提升了开放词汇检测器对稀有类别的识别能力。 - 遥感图像的适配微调:

LMMRotate针对遥感图像多角度、文本输出格式问题,将检测输出(类别、旋转边界框)标准化为文本格式,使LVLM无需改动其自回归属性,就能通过微调直接适配到遥感检测任务。 - 机器人导航的微调与环境交互:

VLTNet框架和CL-CoTNav展示了如何利用LVLM的推理能力进行零样本物体导航,前者通过树状思维提示多代理反思推理,后者则结合分层思维链和置信度闭环学习,都大大提高了在未知环境中的泛化能力。 - 异常检测与事件理解:

VED-SR框架提出了一种免训练方式,将LVLM与符号回归结合,通过LVLM引导的逻辑搜索,自动发现可解释的符号表达式来检测异常事件,完全避免了数据标注。

3. 对比与总结

结合你之前提出的问题,这篇综述为你梳理了一条清晰的技术路径:

-

从零样本到微调:

Roboflow100-VL证明,对于VLM预训练中的分布外(OOD)数据,零样本完全不够。- 最简单的改进是文本提示增强,无需训练。

- 必须使用微调,但有两种选择:

- A. 微调专用的开放词汇检测器:这是

LLMDet和ROBOFLOW100-VL中GroundingDINO微调的路线。利用LLM的监督信号或直接在少量目标数据上进行参数更新,效果最稳定。 - B. 微调通用LVLM(MLLM)本身:这是

VLM-R1用强化学习、LMMRotate适配输出格式的路线。让通用大模型直接掌握新的任务范式,潜力巨大,但训练难度高、不稳定。

- A. 微调专用的开放词汇检测器:这是

-

选择哪种“微调”?

- 如果目标是精确的定位和识别,策略二(视觉微调),尤其是选择

LLMDet的范式或直接微调GroundingDINO这类模型,是目前的最优解。 - 如果目标是复杂的、需要推理和规划的交互式任务,策略三(文本提示/工具调用) 和用强化学习微调LVLM是前沿方向。

- 综述明确指出,目前看来,将LVLM的推理能力与传统检测器的精确性相结合的混合系统,是平衡性能、速度和可靠性的未来重要方向。

- 如果目标是精确的定位和识别,策略二(视觉微调),尤其是选择

总的来说,这篇综述为你提供了一个决策图谱:根据任务对“精确度”、“泛化能力”、“推理深度”和“开发成本”的不同要求,你可以选择从简单的(零样本)到复杂的(强化学习微调)的不同技术路径。它帮你理清了这些方法之间的演进关系和权衡。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)