具身智能中的遥操作技术与产业发展综述

具身智能中的遥操作技术与产业发展综述

摘要

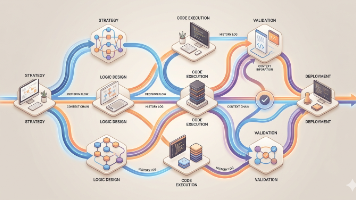

遥操作(Teleoperation)是具身智能领域的核心技术支柱之一,承担着机器人远程控制、高质量演示数据采集与技能迁移的三重关键角色。本文系统梳理了具身智能中遥操作技术的定义与发展历程、核心技术架构、在数据采集中的实践方案、学术前沿与代表性系统,以及面临的挑战与未来趋势。当前,遥操作已从单纯的远程机械控制,升级为融合VR/AR沉浸式反馈、力触觉双边控制、VLA大模型辅助的超远距离低延迟操控体系,是实现“通用、自主、高效”具身智能三角愿景的关键桥梁。

关键词:具身智能;遥操作;模仿学习;人机交互;数据采集;力反馈

1 定义与发展历程

1.1 什么是具身智能中的遥操作

机器人遥操作(Teleoperation)的字面含义为“远距离工作”,指人类操作员(主端)通过控制模块对远程机器人(从端)进行控制,是一种典型的human-in-the-loop控制模式。在这种模式下,高级别的规划或认知决策由人类操作员完成,而机器人则负责执行具体的任务。

在具身智能语境中,遥操作被赋予了新的内涵——它不仅是远程控制手段,更是采集高质量机器人操作数据、训练视觉-语言-行动(VLA)模型的核心数据管道。遥操作能够捕捉目标机器人硬件上专家级的操作演示,操作员通过主从臂、VR头显、外骨骼套装或手持界面远程控制机器人,系统同步记录每个关节角度、夹爪状态、力读数和摄像头帧。

1.2 历史演进

遥操作的历史可追溯至20世纪40年代末至50年代初。Raymond C. Goertz在阿贡国家实验室开发了第一批主从机械手,用于安全处理放射性材料。最初的系统采用电气开关控制电机,操作笨拙且缺乏触觉反馈。Goertz随后改进为机械联动的主从机器人,允许操作员通过自然手部动作进行控制,并通过连接结构传递力和振动,这奠定了现代遥操作和双边力反馈定位伺服系统的基础。

进入20世纪60年代,时间延迟对遥操作性能的影响成为重要研究课题,监督控制(Supervisory Control)的概念被引入。80年代末至90年代初,随着Lyapunov稳定性分析和网络理论的引入,双边控制系统成为核心研究方向。互联网的普及进一步推动了遥操作的发展,使其能够跨越更远的距离。

传统遥操作系统主要应用于人类难以直接介入的危险环境,典型应用包括核材料处理、深海和太空探索,如NASA的机器人燃料补给任务(RRM)和在轨服务任务。

1.3 控制模式的三种类型

遥操作控制模式可细分为三类:一是闭环控制(直接遥操作),操作员直接通过模拟信号控制遥操作器的执行器,并接收实时反馈,仅适用于控制回路延迟极小的情况;二是协调遥操作,遥操作器内部包含部分控制回路,用于处理因延迟而无法由操作员直接控制的方面;三是监督控制,大部分控制智能位于遥操作器端,机器人能够自主执行任务,操作员主要进行监控和发布高层命令。

2 遥操作在具身智能中的关键角色

2.1 破解“不可能三角”

清华大学莫一林教授在EAIRCon 2025大会上提出,具身智能面临“通用、高效、自主”三大目标的“不可能三角”——三者难以同时达到。遥操作作为理解这一困境和技术演进的关键切入点,其路径类似于自动驾驶的发展轨迹:先通过人类操作实现机器人的落地应用,保证效率和通用性,再逐渐通过采集真实数据,提升自主性,逐步实现L0→L2→L4的过渡。

2.2 高质量数据采集的核心方案

具身智能的核心目标是让机器人在物理世界中具备“举一反三”的常识理解能力。不同于语言、图像等低维数据,具身智能需要的是物理世界绝对坐标系下的精确测量数据,包括视觉信息、惯性、触觉、力反馈等多模态信号。遥操作方案是当前数据质量最高的方案之一,其核心逻辑是通过人类直接操控机器人完成任务,同步采集动作与环境数据。

2.3 VLA大模型的训练基础

遥操作采集的数据直接服务于VLA(视觉-语言-行动)大模型的训练。2026年,遥操作已从“远程机械控制”升级为超远距离低延迟通信、VR沉浸式力反馈、AI半自主辅助的综合性技术,可实现“跨洲/跨城毫秒级操控+类人触觉感知+高精度灵巧操作”。

3 核心技术架构

3.1 系统组成

根据IEEE TRO综述,人形机器人遥操作系统的核心组成包括:

- 用户(User) :操作员通过接口设备与机器人交互,负责设定遥操作的目标和意图。

- 接口(Interfaces) :用户与机器人之间的交互媒介,包括各种传感器或输入设备,用于捕捉用户的动作和意图。

- 遥操作架构(Teleoperation Architecture) :包括以下子组件:

- 人体运动学和动力学测量:测量用户的动作和力量,用于生成机器人运动的参考。

- 反馈接口(Feedback Interfaces) :向用户提供机器人状态和远程环境的视觉、触觉或听觉反馈。

- 重定向(Retargeting) :将用户的动作或测量数据转换为机器人运动的参考。

- 通信信道(Communication Channel) :传输用户与机器人之间的信息,可能引入延迟和失真。

此外,还包含稳定器(Stabilizer) :基于零力矩点(ZMP)或动态捕获点(DCM)等稳定性标准,动态调整输入参考以增强机器人的稳定性和平衡;以及全身控制层(WBC) :通过优化问题计算关节扭矩,协调全身运动以实现平衡和灵活性。

3.2 双边遥操作与力反馈

力反馈双边遥操作(Bilateral Teleoperation)是让人类操作员通过机器人感受并操控远处物体的核心技术。现代四通道方案可双向传输位置和力信息,实现操作员与机器人之间的实时能量平衡。

临场感(Telepresence)是遥操作系统的核心——机器人的视觉、力觉、触觉等各种感觉需要第一时间反馈给人,使人“身临其境”;同时也要通过各种传感设备收集人的动作、力度等数据,实时且精确控制远端机器人的运动。

3.3 VR/AR沉浸式遥操作

虚拟现实(VR)技术被认为是远程机器人领域“全面复兴”的“关键推动因素”,它为遥操作提供全新的、沉浸式的人机交互界面。VR技术能有效解决传统遥操作中的多个长期难题:

- 缓解时间延迟:通过预测显示(Predictive Displays)生成合成的、及时的视觉反馈,有效补偿通信延迟带来的负面影响。

- 操作员辅助:VR提供增强的视觉反馈、直观的控制方案,通过“虚拟夹具”等抽象感知信息来引导操作和避障。

- 机器人自主性共享:VR允许开发以人为中心的遥操作方案,操作员能够与机器人共享控制权。

3.4 延迟补偿与通信技术

延迟是遥操作面临的核心挑战之一。工业级遥操系统的延迟标准为<10ms,而VR方案延迟通常在20-50ms。关键解决方案包括:

- 监督控制架构:将大部分控制智能部署在机器人端,操作员只需监控和发布高层命令。

- 预测显示技术:在操作员端生成预测性的视觉反馈,补偿通信延迟。

- 5G通信:利用5G网络的低延迟特性实现远程毫秒级操控。

- 闭环误差校正:如CLONE系统采用基于MoE的闭环误差校正机制,在长距离轨迹中保持极小的位置漂移。

3.5 重定向与动作映射

重定向(Retargeting)技术将用户的动作或测量数据转换为机器人运动的参考。在灵巧操作场景中,动作映射将人手姿态转换为机器人手部关节位置,实现高效的人机技能迁移。例如NVIDIA Isaac Lab 2.3支持宇树G1机器人的遥操作,可对三指灵巧手和Inspire五指灵巧手进行动作映射。

4 数据采集方案与技术路线

4.1 四大数据采集方案对比

从当前技术路径来看,具身智能数据采集形成了遥操作、仿真、UMI多模态传感器融合、视频学习四大方案的差异化竞争格局:

| 方案 | 数据质量 | 成本 | 适用场景 |

|---|---|---|---|

| 遥操作 | 最高 | 高 | 精密操作、高质量演示数据 |

| 仿真 | 中高 | 中 | 大规模数据生成、Sim2Real研究 |

| UMI方案 | 中 | 低 | 快速示教、跨机型复用 |

| 视频学习 | 低 | 极低 | 大规模预训练 |

4.2 三大行业技术路线

行业内已形成三条清晰的技术路线:工业级力反馈遥操系统以戴盟DM-EXton2、越疆X-Trainer为代表,集成高精度力反馈主手与工业级机械臂,实现毫秒级延迟与细腻力控,适用于精密装配、医疗手术等场景;VR/AR沉浸式遥操系统以越疆VR套件、通用VR遥操方案为代表,利用消费级VR头显与手柄实现远程操控,成本较低、部署灵活,适合大规模数据采集与快速原型验证;轻量化UMI示教系统源自斯坦福大学与谷歌联合提出的UMI(Unified Manipulation Interface),以鹿明FastUMI Pro、简智新创等为代表,通过手持传感装置实现示教,单条数据采集时间从50秒缩短至10秒,成本降至传统方法的1/5。

4.3 仿真遥操系统

仿真优先方法在大规模数据采集中发挥重要作用。NVIDIA Isaac Lab 2.3通过扩展遥操作功能,新增对Meta Quest VR和Manus手套等设备的兼容,加速了演示数据集的采集与构建。仿真方法与遥操作互补——前者提供规模和多样性,后者提供精度和真实性。

4.4 开源数据集与生态建设

2026年3月,开放原子开源基金会发起建立了首个国家级具身智能开源数据集社区,由乐聚机器人牵头建设,联合宇树科技等核心单位共建。全球首发OpenLET全身运控数据集,融合触觉灵巧操作与全身高动态运动的多模态数据,也是国内首次开源全尺寸人形机器人全身运控多模态真机数据。

同年4月,智元(AGIBOT)发布了AGIBOT WORLD 2026开源异构数据集,采用遥操作员根据实时条件动态执行任务的自由式数据采集策略,覆盖商业空间、家庭和日常场景,显著提升了数据的多样性和泛化能力。

5 代表性技术与系统

5.1 ALOHA系列系统

ALOHA(A Low-cost Open-source Hardware System for Bimanual Teleoperation) 由斯坦福大学团队开发,是一个低成本的开源双手遥控操作硬件系统。其算法采用Action Chunking with Transformers(ACT),通过模仿学习直接从真实演示中学习策略。

Mobile ALOHA在此基础上增加了移动基座和全身遥操作界面,可用于数据收集和模仿学习,实现如开柜门、乘电梯等需要全身控制的移动操作任务。整个平台预算控制在约32,000美元。后续还涌现了AV-ALOHA(加入主动视觉的第七自由度相机臂)、TactileAloha(集成触觉感知)等扩展版本。

5.2 BEAVR(MIT ARCLab)

BEAVR是MIT ARCLab开发的开源双手、多具身虚拟现实遥操作系统,使用消费级VR硬件实现实时灵巧遥操作,支持从7-DoF机械臂到全身人形机器人的模块化集成,并将同步多模态演示记录在LeRobot数据集模式中。其零拷贝流架构实现≤35ms延迟,“思考-行动”异步控制循环支持可扩展推理。BEAVR已与ACT、DiffusionPolicy、SmolVLA等主流视觉运动策略兼容测试,所有代码公开,数据集发布在Hugging Face上。

5.3 CLONE(北京通用人工智能研究院BIGAI)

CLONE是一个基于混合专家模型(MoE)的闭环全身遥操作系统,发表于CoRL 2025。其核心创新在于闭环误差校正机制,在长距离轨迹中保持极小位置漂移。CLONE仅需MR头显的头部和手部追踪,即可实现如“从地面拾取物体”等复杂协调动作的全身遥操作,为人形机器人在长程人机场景交互中建立了新里程碑。

5.4 TWIST(斯坦福大学 & 西蒙弗雷泽大学)

TWIST(Teleoperated Whole-body Imitation System)由斯坦福大学和西蒙弗雷泽大学联合推出,能使人形机器人实时精准模仿操作者的全身动作,并成功完成多种现实世界任务。

5.5 DART(AR遥操作平台)

DART是基于增强现实的灵巧遥操作平台,通过利用基于云的仿真和增强现实技术,重新定义了机器人数据采集方式,支持大规模众包的数据采集。

5.6 Anthropic的Project Fetch

2025年11月,Anthropic展示了Claude模型对机器狗(Unitree Go2)的编程和控制能力。这个名为“Project Fetch”的实验表明,LLM可帮助无机器人经验的初学者高效编程和控制机器人,降低了机器人编程的门槛,展示了从数字空间到物理世界的连接。

6 核心学术论文与重要会议

6.1 代表性学术论文

- CLONE: Holistic Closed-Loop Whole-Body Teleoperation for Long-Horizon Humanoid Control ——BIGAI,CoRL 2025

- Mobile ALOHA: Learning Bimanual Mobile Manipulation using Low-Cost Whole-Body Teleoperation ——斯坦福大学,2025

- BEAVR: Bimanual, multi-embodiment, accessible, virtual reality teleoperation system for robots ——MIT ARCLab,ICCR Kyoto 2025

- The Developments and Challenges Toward Dexterous and Embodied Robotic Manipulation: A Survey ——IEEE Robotics & Automation Magazine,2026

- Expanding human control: A review of bilateral teleoperation methods in the robotic era ——2025

- A Systematic Review of XR-Enabled Remote Human-Robot Interaction Systems ——香港理工大学,2025

- MolmoAct2: Action Reasoning Models for Real-world Deployment ——2026,包含720小时遥操作双手轨迹数据的大规模开源VLA模型

- Multimodal “Puppeteer”: Exploring Robot Teleoperation Via Virtual Counterpart with LLM-Driven Voice and Gesture Interaction in Augmented Reality ——2025,AR+LLM语音+手势的遥操作框架

6.2 重要学术会议

- IEEE ICRA(International Conference on Robotics and Automation) ——机器人领域顶级会议,2025年在亚特兰大举办,2026年在维也纳举办

- CoRL(Conference on Robot Learning) ——机器人学习领域顶级会议,收录CLONE等重要工作

- IEEE-RAS International Conference on Humanoid Robots(Humanoids) ——2025年在韩国首尔举办

- IEEE RO-MAN(Robot and Human Interactive Communication) ——2025年在荷兰埃因霍温举办

- IEEE CASE(International Conference on Automation Science and Engineering) ——2025年收录沉浸式遥操作框架等工作

- ACM/IEEE International Conference on Human-Robot Interaction(HRI) ——2025年收录表现力实时遥操作等工作

- ICSR(International Conference on Social Robotics) ——2026年在伦敦举办

- TAROS(Towards Autonomous Robotic Systems) ——2025年在英国约克举办

- EAIRCon(中国具身智能机器人大会) ——智猩猩主办的国内大型会议,2025年线下参会超1000人,涵盖遥操作专题

6.3 学术竞赛

- AGIBOT WORLD CHALLENGE @ICRA 2026 ——由智元主办,基于AGIBOT WORLD开源数据集的全球竞赛,聚焦Sim2Real泛化

- ATEC2026真实世界极限挑战 ——核心考察带臂足式机器人的全身运动与操作协同能力,面向全球招募

- ASC26世界大学生超级计算机竞赛 ——首次设置具身智能专项赛题,要求优化“世界模型”的推理性能

7 产业发展与市场格局

7.1 市场规模与趋势

2025年被视为具身智能“商业化元年”,特斯拉Optimus计划量产千台级,华为等企业加速布局。2025年全球人形机器人出货量约1.8万台,同比增长约508%;中国企业合计占据全球约74%的出货量份额。全球市场规模预计2028年达138亿美元,2030年增至151亿美元,年复合增长率超过56%。

7.2 国内外代表性企业与产品

在遥操作硬件系统方面,戴盟DM-EXton2集成高精度力反馈主手与工业级机械臂,支持多维触觉反馈,可感知物体软硬、接触状态;越疆X-Trainer通过动态跟踪算法与5G通信实现<10ms延迟,提供VR套件与工业级方案两条产品线;NVIDIA Isaac Lab 2.3支持Meta Quest VR和Manus手套等设备,并通过宇树G1、Inspire灵巧手进行遥操作数据采集;斯坦福的Mobile ALOHA已成为全球最广泛采用的开源遥操硬件参考设计;MIT的BEAVR和BIGAI的CLONE分别代表了开源沉浸式遥操作和人形机器人全身闭环控制的前沿方向。

在数据采集基础设施方面,智元(AGIBOT)发布了AGIBOT WORLD 2026开源数据集并主办ICRA挑战赛,构建1:1数字孪生仿真环境;深圳某企业搭建了近12,000平方米的数据采集工厂,构建“15+N”全场景矩阵覆盖15大领域,部署150个标准化采集单元;大晓机器人提出ACE具身研发范式,构建“环境式数据采集—世界模型—具身交互”全链路技术体系。

在AI平台与生态建设方面,Anthropic通过Project Fetch展示了Claude控制机器狗的能力,降低了机器人编程门槛;Physical Intelligence开发π系列VLA模型,结合遥操作数据进行预训练;开放原子具身智能开源数据集社区联合多家机构发布OpenLET全身运控数据集。

8 技术挑战与未来展望

8.1 当前主要挑战

-

数据规模化难题:训练L1级模型需要10,000小时以上的数据量支撑,且Scaling Law规模定律在具身智能领域仍未见顶。遥操作的吞吐量限制是关键瓶颈——熟练操作员每小时仅能处理5到50个数据片段,且操作员疲劳时数据质量会下降。

-

延迟与稳定性:远距离遥操作面临非确定性时间延迟问题,尤其在复杂网络环境下,通信延迟会严重影响操作性能和系统稳定性。

-

力反馈与触觉感知:目前多数VR遥操作方案缺乏力反馈通道,仅适用于粗粒度操作数据采集。高精度力反馈系统的成本仍然高昂。

-

全身协调控制:当前遥操作系统在全身协调控制方面存在短板,上下半身控制的解耦限制了自然的全身协调动作。

-

安全与伦理:具身智能的自主决策能力和物理行动能力引发了安全方面的隐忧,需要解决感知-决策-执行闭环中的风险传播机制、行为可控性和跨文化伦理适应性等问题。

8.2 未来发展方向

-

VLA+遥操作深度融合:VLA大模型与遥操作的结合将实现更智能的半自主遥操作机制,AI在执行层辅助人类操作员,逐步提升自主性。

-

仿真的更广泛应用:仿真与现实数据的融合将进一步深化,通过Sim2Real迁移降低遥操作数据采集成本,提高数据多样性和覆盖度。

-

轻量化与低成本方案:UMI等轻量化方案将持续降低遥操作门槛,通过数据-本体解耦实现跨机型复用,推动遥操作从实验室走向大规模工业部署。

-

开源生态建设:AGIBOT WORLD、OpenLET等开源数据集社区将加速具身智能领域的数据共享和模型迭代,打破数据孤岛。

-

跨具身知识迁移:基于多样化机器人数据的跨具身训练可以提升策略泛化能力,超越单一具身数据集的限制。

9 相关资源导航

9.1 开源平台与工具

| 名称 | 简介 |

|---|---|

| Mobile ALOHA | 斯坦福低成本全身遥操作系统 |

| BEAVR | MIT开源VR遥操作与学习平台 |

| Isaac Lab | NVIDIA仿真与遥操作平台 |

| LeRobot | Hugging Face开源机器人学习框架 |

9.2 开源数据集

| 名称 | 简介 |

|---|---|

| AGIBOT WORLD 2026 | 智元开源异构具身智能数据集 |

| OpenLET | 全身运控与触觉灵巧操作数据集 |

| Open X-Embodiment | Google DeepMind跨具身数据集 |

| BEAVR Datasets | MIT开源遥操作数据集(Hugging Face) |

| MolmoAct2-BimanualYAM | 720小时遥操作双手轨迹数据集 |

9.3 重要产业会议与活动

| 会议/活动 | 周期 |

|---|---|

| EAIRCon中国具身智能机器人大会 | 年度 |

| Robotics Summit & Expo | 年度(波士顿) |

| 世界人工智能大会(WAIC) | 年度(上海) |

| NVIDIA GTC(具身智能专场) | 年度(圣何塞) |

结语

遥操作技术正处于从“远程机械控制”向“AI增强的沉浸式人机协作”演进的关键时期。作为具身智能数据采集的核心方案和VLA模型训练的基础设施,遥操作将在推动具身智能从L1特定任务向L5通用智能迈进的过程中发挥不可替代的作用。未来,随着VLA大模型、力反馈硬件、5G/6G通信、仿真技术、开源生态的协同发展,遥操作有望在成本、规模、精度三者之间找到更优平衡,加速具身智能的产业化与通用化进程。

该博客信息持续更新中

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)