哈佛《Science》研究:大模型已碾压人类医生!

生病去医院查不出原因总让人心急如焚。或许不久后,迅速给你出具权威第二诊疗意见的会是一位人工智能医生。

最新一期《Science》期刊刊登了一项实战记录。

OpenAI o1系列大模型在真实的急诊室病例较量中,直接击败了拥有多年经验的主治医师。

来自哈佛医学院等的联合研究团队策划了6场跨越历史经典病案与现代真实急诊的综合大考,让人工智能与数百位真实世界的各级别医生同台竞技,大模型在各项诊断和管理推理任务上全面超越了人类专家。

挑战65年医学金标准

早在1959年,科学家就在科学期刊发文呼吁建立基于病例的基准测试,以此作为评估专家级医疗计算系统的准绳。

65年过去,New England Journal of Medicine(新英格兰医学杂志)发布的clinicopathological conferences(临床病理学讨论会)复杂病例一直被视为医学诊断领域的终极试金石。

该期刊发布的案例往往是连顶尖专家都感到棘手的疑难杂症,里面布满诊断陷阱与极度罕见的病理表现。

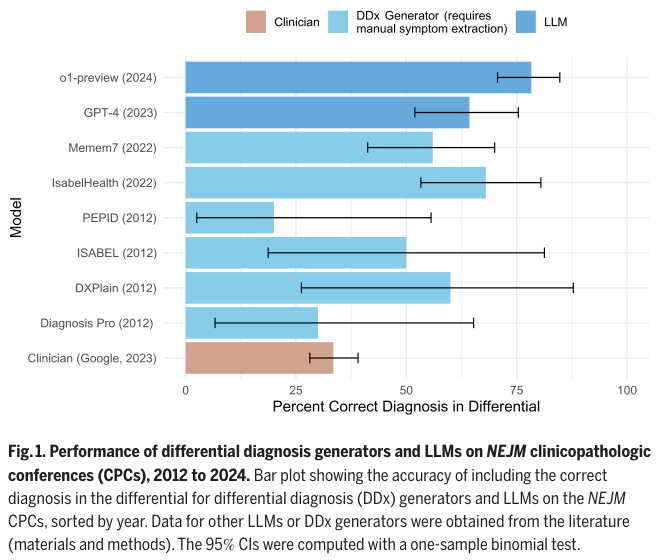

过往几十年里,无数诊断生成器挑战过经典病案,涵盖了原始的贝叶斯系统、基于符号规则的系统以及自然语言症状检查器,机器在终极难题面前大多败下阵来。

近期大语言模型在各种专业执照考试、数学问题以及软件工程中屡创佳绩,人们顺理成章将目光投向真实的临床推理能力。

此前受限于模型能力较弱,极少有研究设立人类医生的基准线。伴随模型能力的突飞猛进,研究团队决定引入数百名真实医生作为参照系,全面评估最新一代o1-preview大模型的诊断硬实力。

针对新英格兰医学杂志临床病理学病例的对决中,o1-preview交出了一份惊艳的答卷。

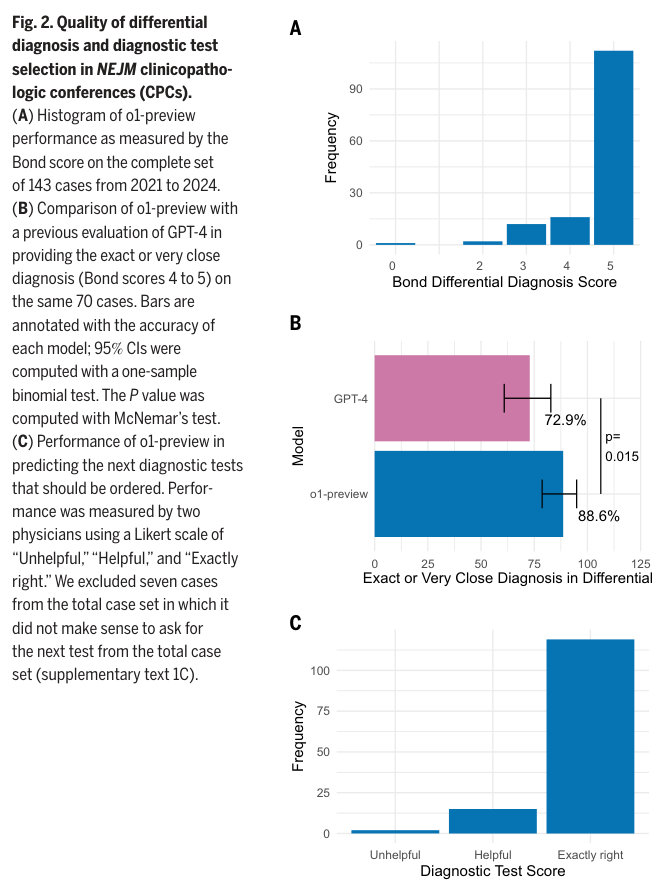

鉴别诊断通俗来讲就是根据病人的各类症状,开列一张可能的疾病清单并按照概率排序。两位资深内科医师受邀对大模型给出的鉴别诊断质量进行独立盲评,两人打分一致性极高。

计分结果出人意料,o1-preview在78.3%的病例中成功将正确诊断纳入鉴别诊断列表。在高达52%的病例里,模型给出的第一顺位排位即为正确答案。

把范围放宽到具有潜在帮助或非常接近的诊断类别,模型的准确率飙升到了97.9%。

对比前一代的GPT-4模型,新一代产品的进步肉眼可见。同一批70个历史对照病例的较量里,GPT-4的准确率停留在72.9%,o1-preview一举拿下88.6%的高分。

两代人工智能的胜负交锋,o1-preview在绝大多数情况下面对旧模型保持领先。

医师们进一步评估了机器选择下一步诊断测试的能力。面对136个高难度病例,o1-preview在87.5%的场景下精准选择了符合患者实际诊疗需求的正确检查项目。

还有11%的测试选择被医生判定为具有实质帮助,仅有1.5%的建议缺乏建设性。

6项大考全面超越人类

单靠一项测试不足以服众,研究团队拿出了涵盖多个维度的重磅评估题库。

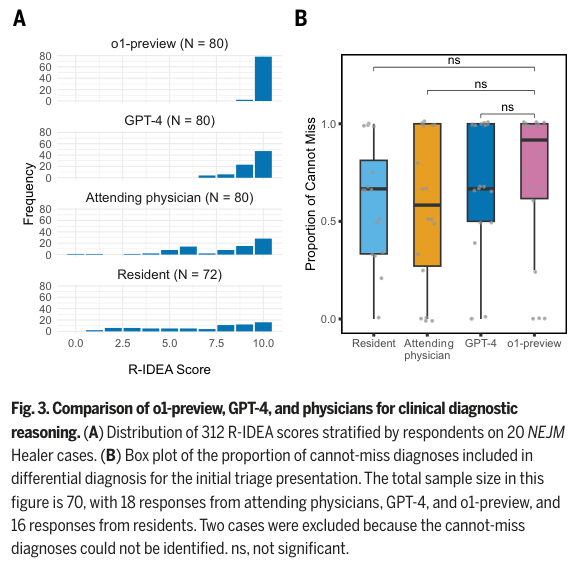

针对专门用于评估临床推理核心领域的虚拟患者诊疗案例,机器拿下一个几乎完美的成绩。

研究采用经过验证的10分制Revised-IDEA(修订版IDEA评分)标准,对核心临床推理记录进行打分。

80个高难度测试案例中,o1-preview在78个案例里斩获满分,得分远远把GPT-4、主治医师以及住院医师甩在身后。

在初期分诊阶段识别绝对不能错过的致命诊断时,新模型同样保持了极高的敏锐度,找准致命病因的比例中位数达到了0.92,与人类专家队伍旗鼓相当。

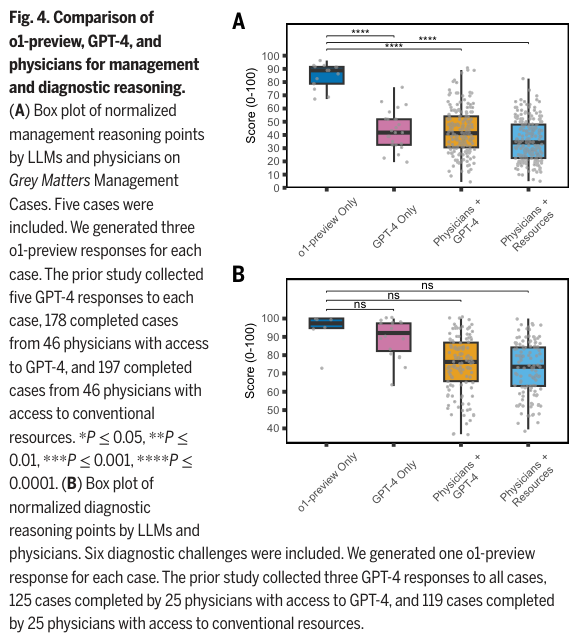

面对更为复杂的后续医疗管理步骤,团队找来5个基于真实患者改编的测试题。

这类题目不仅考察病人得了什么病,更考察接下来该如何开药、该做哪些具体检查。

题目曾由25位医学专家通过共识方法进行预先打分界定标准。每个病例呈现给大模型后,会紧跟一系列关于下一步医疗管理措施的追问。

o1-preview在满分100的评估中拿到89分的得分中位数。与人类医生的表现对比十分强烈,人类医生即便借助GPT-4辅助得分也仅徘徊在41分左右,完全使用传统医疗参考资源的医生得分更是低至34分。

单独上阵的GPT-4得分停留在42分。图4A清楚揭示了不同参评对象之间高达40分以上的巨大实力鸿沟。

老牌计算机辅助诊断系统的经典案例池同样未能难倒机器。

测试所用的6个病例题库此前为了防止背题作弊从未公开,里面包含了患者详尽的现病史、既往史、体格检查和全部诊断性辅助检查结果。

o1-preview毫无悬念交出97分的得分中位数神级答卷。历史对照数据显示,使用传统资源的医生得分为74分,GPT-4得分为92分。图4B展现了各路医疗高手在这项经典挑战中的真实排位。

医学不仅需要确定性结论,更极其考验医生对患病概率的敏锐直觉。

在包含553名医疗从业者的全国代表性样本测试里,参评群体涵盖了住院医师、主治医师、执业护士与医师助理。测试要求大家估算不同原发病因的诊断前与诊断后概率。

数据暴露出人类临床医生在评估概率时存在巨大的个体差异,估算结果大起大落极不稳定。

人工智能给出的数值异常稳健,且更贴近文献推导出的科学参考定值。

在评估心肌缺血病症的关键检测后概率时,o1-preview的表现大幅度甩开人类同侪与前代系统。

急诊室真实盲测对决

做完案头测试,研究团队把目光投向波士顿一家大型三级学术医疗中心的Beth Israel Deaconess Medical Center(贝斯以色列女执事医疗中心)真实急诊大厅。

急诊电子健康记录里全是没有经过人工润色整理的凌乱数据,夹杂着残缺不全的表述与错综复杂的生理指标。

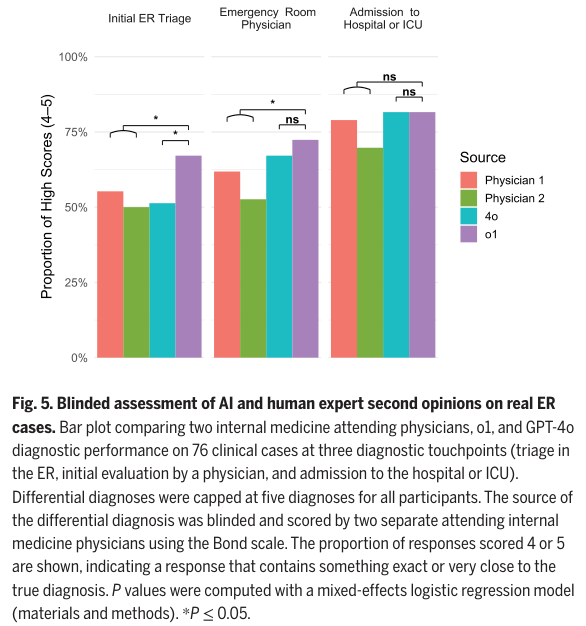

面对76个随机抽取的急诊真实病例,o1大模型、GPT-4o大模型与两位资深内科主治医师展开了一场看不见硝烟的盲测比拼。

打分裁判是另外两位不知情的资深内科主治医师,他们需要为混在一起的人类手写与机器生成的诊断意见打分。

两名裁判极难分辨眼前逻辑严密的诊断报告究竟出自多年同事之手还是硅基大脑,其中一名医生在94.4%的病例打分卡上填下了无法分辨人类还是AI的选项。

急诊病例的评估切分为三个关键的临床触点,涵盖初期急诊分诊、急诊医生接诊以及患者最终被收入病房或重症监护室。

初期分诊是病人刚进医院大门,护士仅仅根据极少数初步症状与基础体征做出快速判断的黄金节点,此时信息极度欠缺。接诊阶段会有医生进行初步体检与问诊。到了决定是否入院阶段,各类检验化验结果基本出炉。

人工智能在急诊室的每个阶段都游刃有余。

伴随掌握的患者信息不断增多,所有参评者的诊断准确率都在稳步攀升。

o1模型在极度缺乏信息的初期分诊阶段,给出接近正确诊断的比例达到67.1%,接诊阶段提升到72.4%,入院阶段高达81.6%。

两名资深人类主治医生的准确率在三个触点上始终落后于机器,两者在最缺乏有效信息的初期分诊阶段差距最为悬殊。

拥抱智能医疗新纪元

AI技术的狂飙突进给临床医学带来了深远冲击。

一直以来,将机器判断引入临床辅助决策经常被业内视为一项高风险举动。真实的急诊室环境节奏极快,医护人员必须在信息残缺的极限条件下做出生死攸关的时间敏感型决断。

广泛严苛的测试验证了现代语言模型处理复杂非结构化临床数据的强悍实力。更大规模地普及应用此类诊断辅助工具,极有希望实质性缓解人类自身容易疲劳犯错、延误关键诊疗时机以及优质医疗资源获取困难等长期痛点。

研究也暴露出必须跨越的客观应用障碍。

当下的实验比拼仅局限于纯文本文字信息,医学本身是一门极其复杂的人文与科学交织的艺术。真实的临床问诊充斥着大量极其重要的非文本线索,患者痛苦的呻吟程度、急促微弱的呼吸节奏以及对医学影像直观的光影色彩判断,全都是临床大夫赖以决策的珍贵依据。

当下的基础模型在处理非文本信号时依然面临明显的感知局限。未来的一大探索方向,在于摸索让人与机器在处理多模态复杂信息时实现无缝协作的最佳工作流。

环境智能记录仪与被动健康监测技术的日益普及,为下一步打破信息僵局铺平了道路。

抛弃经过人工精心清理修饰的教学性质病例,在高度真实的杂乱临床前线检验机器成色,将是整个人工智能医疗行业的必修课。

半个多世纪前医学先驱们提出的计算机诊断推理远大构想,正一步步变成普通人触手可及的就医现实。

面对已经跨越绝大多数临床推理基准的硅基医生,医疗卫生系统亟需加快自身演进步伐,提前规划算力基础设施投资建设,并着手设计对一线临床工作者足够友好的软件交互界面。

当新一代智能技术无缝整合到守护病患生命健康的最后一道防线之中,你的下一位急诊科权威专家,可能不再是人类。

参考资料:

https://www.science.org/doi/10.1126/science.adz4433

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献101条内容

已为社区贡献101条内容

所有评论(0)