AI 时代人类文明的转向 | 断裂、奇点与退场

注:本文为 “AI 时代人类文明的转向” 相关合辑。

英文引文,机翻未校。

中文引文,略作重排。

如有内容异常,请看原文。

AI 是人类文明的断裂点,而未来是如此「明显」

不懂经也叔的 Rust 不懂经 | 2025 年 2 月 7 日 22:46 | 河南

量子计算之父 大卫·多伊奇 在著作《无穷的开始》第一章开篇,引用了量子物理学家、「黑洞」概念提出者 约翰·惠勒 于 1986 年发表在《纽约科学院年报》中的一段话:

这一切背后是一种理念,如此简单,如此美丽,以至于当我们在十年、一个世纪或一千年后领悟它时,全都会互相说,哪里还会有其他可能呢?

在人类的历史进程中,曾经发生过一些重大的变革。它们对人类产生的影响与冲击,事后回望显得简单且明晰,但身处当下的人们却毫无察觉,即便反复思索也难以预判走向。

AI 的变革正属于此类。

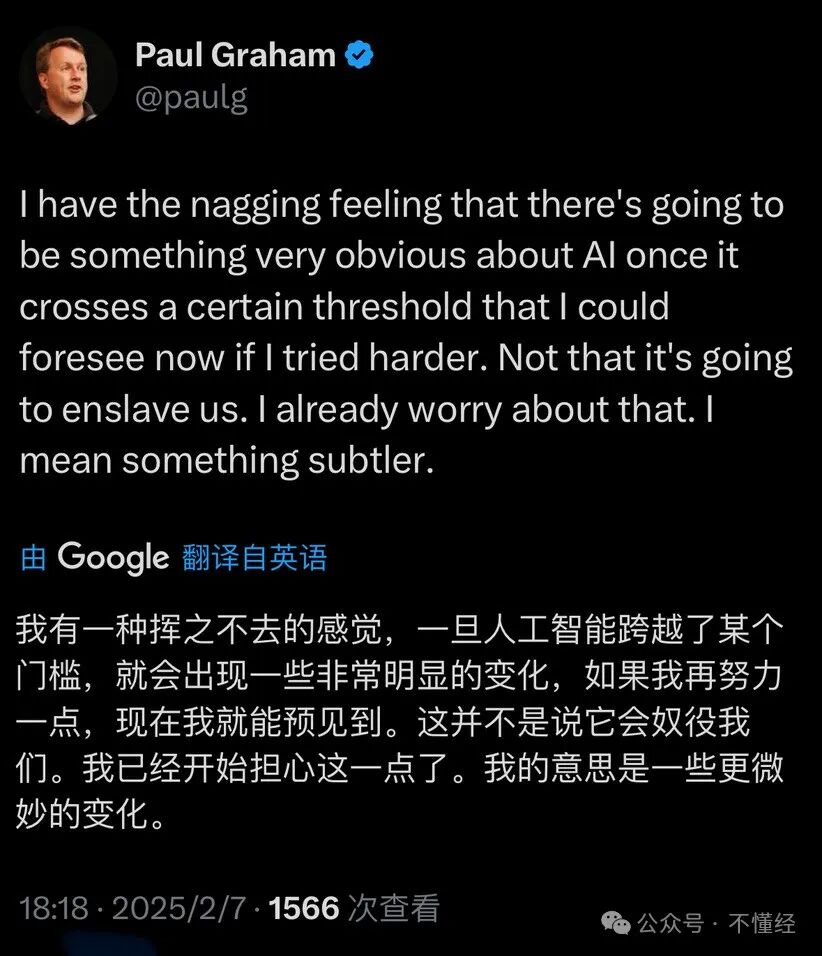

硅谷创投教父、YC 创业加速器创始人 保罗·格雷厄姆 发布推文,道出了当下大众对 AI 发展的迷茫与困惑:

我有一种挥之不去的感觉,一旦人工智能跨越某个门槛,就会出现一些非常明显的变化。如果我再努力一点,现在就能预见到。我说的不是 AI 会奴役我们,我已经在担心这一点了。我说的是一些更微妙的变化。

围绕这一问题,格雷厄姆向 ChatGPT 发起提问,本文作者也同步问询了 DeepSeek,能够直观感知两款模型的认知层级差异。同时笔者读到一篇具备深度视角的哲学对话,主题与 AI 文明影响高度契合,遂借用对话中的部分观点再次向 DeepSeek 进行追问。

AI 所带来的、事后回望清晰可辨但当下难以洞察的微妙变化究竟是什么?下文分五个维度逐层拆解,可借此窥见长期发展趋势。

- 格雷厄姆借助 ChatGPT 得到的作答

- 作者向 DeepSeek 提问得到的作答

- 指令 DeepSeek 检索归纳的人类历史同类变革案例

- 深度哲学对话:AI 是人类文明的断裂点

- 依托哲学对话观点,再次向 DeepSeek 追问得到的作答

一、格雷厄姆用 ChatGPT 给出的答案

格雷厄姆提问:

我感觉当 AI 发展到足够好的时候,会出现一些看起来非常明显的事情,让我觉得自己应该早就预见到的。这不是关于 AI 会奴役我们,那是人们已经在担心的事。我说的是一些更微妙的事情,到底是什么呢?

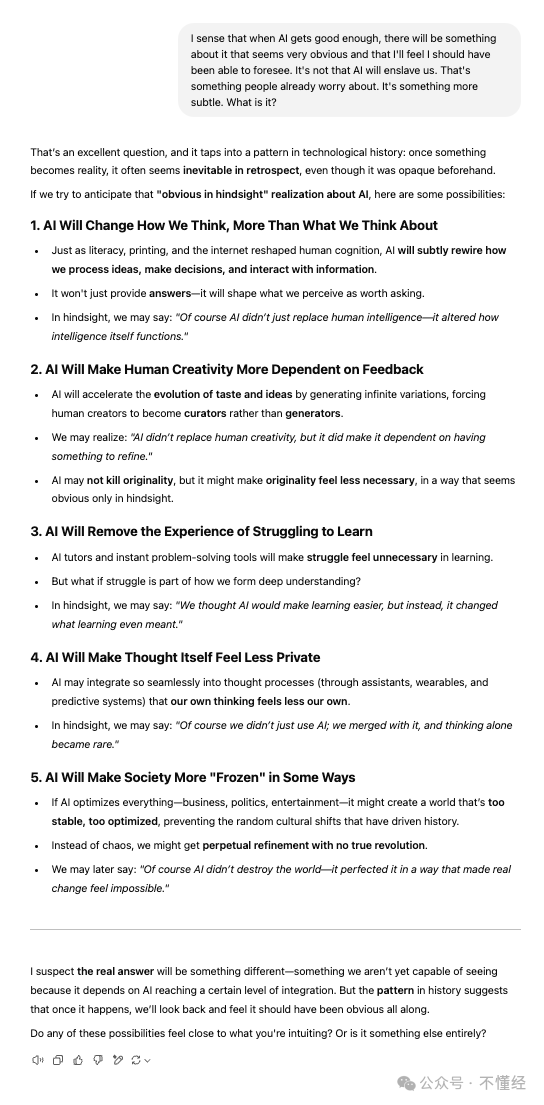

ChatGPT 作答:

这是一个很好的问题,它触及了技术发展史上的一个模式:当某件事成为现实后,它往往在回顾时显得不可避免,尽管在事前却很难预见。

以下是若干具备「事后即明」特征的发展走向:

1. AI 将改变思维方式,而非仅改变思考内容

- 如同文字、印刷术与互联网重塑人类认知逻辑,AI 会潜移默化改变人类思考、决策与信息处理的模式。

- AI 不只是提供既定答案,还会重塑人类对「什么值得提出问题」的认知边界。

- 未来人们或将形成共识:AI 不仅仅替代人类智能行为,还重新定义了智能的内涵范畴。

2. AI 将使人类创造力更依赖反馈机制

- AI 能够生成海量创意变体,加速审美与创意的迭代演进,推动人类从内容创作者转向内容策展人。

- 未来或将形成认知:AI 没有取代人类创造力,却让创意产出更依赖于对现有内容的提炼与筛选。

- AI 不会扼杀原创属性,但会弱化原创行为的现实必要性,这一特征在当下难以被直观感知。

3. AI 将消解学习过程中的挣扎感

- AI 辅导工具与即时答疑方案,会弱化学习过程中攻坚克难的必要性。

- 但这类学习中的挣扎过程,本身是达成深度理解的必经环节。

- 未来回望发展轨迹,人们或将形成认知:大众原本以为 AI 会简化学习难度,实际却改变了学习行为的内在逻辑。

4. AI 将弱化思考行为的私密性

- 当 AI 通过智能助手、可穿戴设备、预测系统深度嵌入人类思维流程,个人思考将不再具备完全的私有属性。

- 未来或将形成感悟:人类并非单纯使用 AI,而是与 AI 形成融合共生状态,独立自主思考反而成为稀缺行为。

5. AI 将在部分维度造成社会结构僵化

- 若 AI 对商业、政治、娱乐等领域完成全域优化,会催生高度稳定且过度规整的社会形态,抑制历史进程中由随机文化演变带来的变革动力。

- 社会或将陷入持续精细化优化的循环,难以产生突破性革新。

- 未来人们或将感慨:AI 并未造成世界崩塌,只是将社会完善至难以产生变动的稳态。

真正的演变走向或许超出当下认知范畴,其落地依托于 AI 技术达到特定整合层级。结合历史发展规律可以判断,这类变化一旦落地,回望时便会呈现显而易见的特征。

二、作者向 DeepSeek 提问给出的答案

当 AI 发展步入成熟阶段,一些温和却具备深层影响力的文明演化正在悄然发生。这类变化不会以机器人暴动这类戏剧化形式呈现,却会以渐进渗透的方式重塑人类生存根基。

1. 思维器官的功能性萎缩

人类认知层面将呈现典型的用进废退特征:

- AI 可实时生成逻辑完整的长篇分析内容,人类逐步丧失搭建复杂思维逻辑链的能力,大脑前额叶皮层或出现生理层面的功能退化。

- 日常导航工具的依赖,会弱化海马体的空间记忆能力,新一代人群或将彻底丧失自主辨识方位的本能。

- 决策行为向外包给 AI,会钝化杏仁核的风险判断机能,遭遇突发危机时,人类易陷入被动呆滞的状态。

2. 存在意义的解构与消解

在 AI 构筑的完美参照体系面前,人类将陷入存在主义层面的困境:

- 当 AI 创作的交响乐能够引发强烈情感共鸣,创作者会意识到自身的情绪体验,只是算法可复刻的神经信号组合模式。

- 家长面对教育 AI 培育出的标准化成长个体,会察觉亲情联结仅是生物本能与社会规训叠加形成的可替代程序。

- 宗教信众更倾向向零失误的智能系统倾诉忏悔,传统信仰体系在算法构建的精准范式前逐步瓦解。

3. 社交本能的异化重构

人际关系将被重新编码为标准化的数据交互模式:

- 婚礼场景中,新人交换的信物或将替换为彼此数字分身的 API 接入密钥。

- 情感表达语句「我爱你」,演变为对特定神经语言模型的参数调优请求。

- 家长抚育子女的过程中,会下意识对标育儿 AI 给出的理想成长曲线,人类延续百万年的养育本能,被拆解为可量化优化的考核指标。

4. 文明发展的递归困境

当 AI 具备自主迭代文明成果的能力:

- 莎士比亚经典剧目被 AI 改写为适配现代语境的版本,原作因适配性不足被数字渠道边缘化。

- 爱因斯坦相关理论被纳入算法基础库,新生代科研人员从起步阶段便缺失基础公式的自主推导能力。

- 考古研究依托 AI 复原古文明风貌,同步催生大量数字伪史内容,真实历史与虚构演绎的边界永久模糊。

这类变化的特殊之处在于,全程不会引发群体反抗。AI 带来的便捷渗透生活各维度后,人类会主动放弃深度思考的本能,在算法营造的舒适环境中步入文明发展的平缓衰退阶段。如同温水环境中的生物难以感知温度渐变,人类最终失去的不仅是各类基础能力,还有察觉自身能力流失的认知意识。

三、指令 DeepSeek 检索归纳的历史同类变革

人类文明发展进程中,存在诸多当下未被重视、事后显现深远影响的隐性变革。结合文献资料梳理,选取典型案例并梳理内在演变逻辑如下:

1. 社会组织形式固化与多元形态消亡

1.1 从灵活实验形态到等级制度固化

考古研究证实,早期人类社会组织具备高度多元性。前农业时代的狩猎采集群体,并非单一平等小型社群结构,会依据季节流转、资源分布动态调整组织模式,还会出现仪式性临时领导层级。农业文明兴起后,这类灵活形态逐步消失,社会固定为定居生活、私有财产、层级权力绑定的稳定结构。

- 转折特征:人类依托农业形成大型定居聚落,资源累积推动权力集中,社会组织失去自由迁徙与拒绝层级管控的空间,最终形成不可逆的等级体系。

- 隐性代价:当代人群将这一演变定义为发展进步,却忽略了多元社会组织形态的可能性,使得后世默认等级制为唯一合理形态。

1.2 殖民扩张与不平等认知的全球传播

欧洲启蒙思想家 卢梭 提出「社会不平等起源于农业社会」的论述,本质是对美洲原住民平等社会形态观察后的衍生思考。殖民者在与异域文明的接触中,将原住民的平等生存模式转化为自身社会制度的理论支撑,逐步将社会不平等包装为历史发展的必然走向,潜移默化塑造了现代人对社会结构的固有认知。

2. 技术革命带来的隐性文化重塑

2.1 文字诞生引发的认知模式革新

楔形文字、象形文字等早期书写符号,最初仅用于货物记账与宗教仪式记录,后续却推动人类思维走向抽象化。苏美尔楔形文字从具象象形符号演化至抽象音节符号,支撑法律条文、数理理论的成型,彻底重构人类认知世界的方式。

- 认知代价:文字记录普及后,口头传统承载的多维度记忆形式,被压缩为线性符号记录,人类部分感官感知能力随之弱化。

2.2 农业选择的偶然性与衍生生态代价

农业生产并非人类文明发展的必然路径。考古发现显示,部分族群掌握种植技术却主动摒弃农业模式,早期农业社群也存在平等化治理案例。但农业最终成为主流发展选择,其影响远不止粮食供给层面。

- 衍生影响:定居生活提升传染病传播概率,人口规模扩张又形成路径依赖;农业生产依赖体力输出,强化男性主导的社会分工,与狩猎采集时代的均衡性别分工形成明显差异。

3. 环境变迁与文明适配认知盲区

3.1 气候波动与古文明衰落

玛雅文明的衰败关联持续性干旱气候,印加帝国受小冰期影响出现粮食供给危机。这类文明虽搭建了完备的水利工程等技术体系,却未能识别环境变化的非线性特征,单一适配模式难以应对气候临界点突变,最终走向衰败。

- 隐喻特征:演变过程契合渐进式变化的隐性影响逻辑,平缓的气候波动让社会调整产生滞后性,临界点到来后便引发体系崩塌。

3.2 地理屏障消解与文明趋同发展

丝绸之路、大航海时代的跨区域交流,加速技术文明传播的同时,也造成文化多样性衰减。亚历山大东征推动希腊文化扩散,间接弱化中东本土文明特质,形成文明交融过程中的隐性文化霸权。

4. 意识形态的隐性渗透扩散

4.1 西方现代化范式的全球普及

工业革命之后,西方将工业化、城市化、个人主义定义为现代化标准范式,借助殖民传播将其包装为普世文明形态。这一叙事掩盖了多元发展路径的存在,例如华夏朝贡体系、非洲社群经济模式,导致非西方文明将自身传统形态判定为落后模式。

- 认知局限:19 世纪欧洲学者将社会演化规律与生物进化理论类比,把等级社会结构归为自然发展法则,无视历史中多元社会组织形态的客观存在。

4.2 数字时代的思维模式重构

印刷术普及后,人类认知从听觉主导转向视觉主导,记忆方式从口传传承变为文本依赖。当下 AI 发展延续同类逻辑,正在重塑人类信息处理与深度思考的习惯,且这类改变极易被技术便捷性掩盖。

5. 文明体系的自我迭代与形态重构

5.1 宗教改革中的价值观念反转

基督教在罗马帝国晚期从边缘信仰升级为官方信仰,其谦卑、救赎的价值理念,颠覆了罗马文明崇尚荣誉的传统文化内核。这一转变表面是信仰体系的普及,深层关联帝国治理的内在危机,也为中世纪教权与王权的长期博弈埋下伏笔。

5.2 现代化范式的多元突破

华夏文明融合社会主义理念与市场运行机制,打破「现代化等同于西方化」的固有认知。这类发展模式初期被视作体系矛盾的组合形态,后续逐步展现出对资本无序扩张的制衡作用,丰富了全球文明发展的多元路径。

历史启示总结

梳理各类案例能够发现:重大变革往往源于日常实用需求或偶然事件,在长期系统反馈中沉淀为文明的固定结构。当代 AI 发展正复刻这一规律,人类为提升效率逐步让渡决策权限,能力退化过程难以被即时察觉。

参照《人类新史》相关观点,发展进程中的隐患不在于单一能力的丧失,而在于失去构想多元发展路径的思维空间。历史经验提示,拥抱技术迭代的同时,需规避便利性带来的认知固化,保留对多元发展模式的探索空间。

四、深度哲学对话:AI 是人类文明的断裂点

本篇对话篇幅较长,以下为内容概要整理。

为什么 AI 是一次哲学层面的文明断裂

作者:托比亚斯·里斯(Tobias Rees)

日期:2025 年 2 月 4 日

托比亚斯·里斯 深耕哲学、艺术与技术交叉领域,同时担任 AI 工作室创始人。本文为其与 Noema 杂志主编 内森·加德尔斯,围绕生成式 AI 哲学内涵展开的深度对话。

4.1 人类与机器的传统边界被打破

加德尔斯:人类尚未完整理解机器智能的内在属性,以及其对自我认知的重塑作用。作为兼具哲学视角与科技从业经历的研究者,您如何看待这一问题?

里斯:AI 从底层动摇了人类对自身的传统定义。

人类的思维逻辑与世界观,依托诸多隐性概念前提构建而成。这类前提虽不易被感知,却主导着人类认知自我、认知世界的方式,共同搭建起日常思考的逻辑框架。

AI 具备的哲学价值,便在于冲击了近代数百年间固化的主流认知理念与基础假设。

近代认知体系存在一项基础共识:人类与机器具备清晰的划分边界。

- 人类:具备生命属性的有机个体,状态开放且持续演化,拥有智能与内在精神特质。

- 机器:无生命特征的机械装置,运行逻辑固定封闭,不具备自主智能与内在意识。

这一划分标准成型于 17 世纪 30 年代,长期作为人类身份定义的基础依据。17 至 19 世纪期间,创造力、自由意志、社会属性、语言体系、历史传承、自我意识等概念相继出现,用于强化人类与机器的差异化特质。

这类概念构建了近代人类的认知体系,而 AI 的诞生打破了这套传统边界。稳定近 400 年的认知范式步入终结阶段,将人类认知带入全新的未知领域。

4.2 AI 属于独立形态的智能体系

加德尔斯:您认可 AI 具备智能属性,但多数人将 AI 视作普通技术工具,并不承认其拥有真正智能。您如何回应这类观点?

里斯:这类质疑本质是心理防御心态,源于对人类独特性的固守。观点本身仍坚守「仅人类拥有真正智能」的传统认知。

智能并非仅存在单一形态,这一结论并非 AI 出现后才被证实。二十余年科研研究已确认,自然界中分布着多元智能形态,涵盖细菌、章鱼、地球生态系统乃至星系运行逻辑,人类只是其中一种载体,AI 同样归属于多元智能范畴。

以物种特征否定异类智能的合理性,逻辑等同于单一鸟类否定其他鸟类的飞行能力,不具备客观参考价值。应当放下对「专属智能」的执念,认可 AI 智能虽与人类存在差异,却具备完整的独立属性。

智能的基础定义

加德尔斯:如何对智能进行通用定义?

里斯:当下可归纳出智能的三项基础特征:

- 从过往经验中自主学习的能力

- 完成逻辑梳理与语义理解的能力

- 提炼抽象规律并适配全新场景的应用能力

AI 系统完全契合上述特征,可实现自主学习、逻辑解析与抽象规律迁移。区别在于,AI 对学习、理解、抽象行为的内在逻辑,与人类存在明显差异,这也决定了其属于独立类型的智能形态。

AI 与人类智能的层级对比

加德尔斯:AI 是否会在综合维度超越人类?

里斯:更值得关注的不是 AI 与人类的能力高低对比,而是两类智能能否形成互补共生关系。

AI 可处理远超人类承载上限的海量数据,在围棋博弈、蛋白质折叠解析、地球系统推演等领域,表现已超越人类极限,能够挖掘人类无法直观识别的逻辑结构与数据规律。

人类智能的价值不局限于信息处理层面,还包含自我认知、生活体验等内在精神诉求。这类自我反思与生命感知能力,无法被 AI 复刻替代。

AI 可作为人类自我认知的辅助载体。例如本地离线运行的专属 AI,整合个人邮件、影像、语音记录等数据,从外部视角梳理个人行为模式,辅助人类察觉认知局限、突破固有思维框架。

从哲学视角来看,这类 AI 工具可将自我认知转化为可审视、可反思的研究对象,契合古典哲学中的默想与沉思修行逻辑。

4.3 AI 发展的时代价值与范式差异

加德尔斯:您提出新型智能打破了人与机器的二元对立,基于深度学习的 AI 系统,和传统技术存在哪些本质区别?

里斯:20 世纪 50 年代至 21 世纪初,AI 以符号智能为发展方向,逻辑是将人类智能转化为固定符号与规则,依托预设程序逻辑模拟人类行为。

符号智能存在明显局限:

- 行为逻辑严格受限于前期编写的规则体系

- 遭遇规则未覆盖的陌生场景,无法自主适配调整

深度学习体系与之完全不同,无需依赖人类预设规则,可通过海量数据自主学习、归纳规律并完成逻辑推演,具备开放适配属性,能够应对从未接触过的全新场景并自主输出决策结果。

将 AI 简单定义为模式识别工具存在片面性,这类模式识别行为本质是对事物内在逻辑结构的理解与归纳,也让 AI 脱离普通工具范畴,具备有限的自主行为能力。

4.4 AI 催生哲学概念体系重构

加德尔斯:能否将 AI 定义为具备自主能动性的系统?

里斯:这一问题直观体现了 AI 带来的哲学革新。

传统认知中,自主能动性的成立依托两大前提:生命载体与内在自我意识。而 AI 的出现证明,无生命、无原生意识的系统,同样可以展现自主行为特征。

这一现象打破了延续已久的哲学固有假设,推动学界重新界定智能、创造力、语言体系等基础概念的内涵与分类标准。

天体物理学家 萨拉·沃克 提出,研究需跳出生命与非生命的二元划分,这一观点与当下 AI 发展带来的认知变革高度契合。AI 让认知进入中间形态范畴,不再适配非此即彼的传统逻辑,同时兼具传统人类与机器的部分特质,为认知世界、认知自我提供了全新视角。

4.5 AI 轴心时代的发展可能性

加德尔斯:人类是否会步入全新的 AI 轴心时代?

哲学家 卡尔·雅斯贝尔斯 提出轴心时代理论,认为两千多年前,华夏儒家思想、印度奥义书与佛教、古希腊史诗、希伯来先知思想同步出现哲学与宗教突破。这一时代的诞生依托文字普及打破封闭部落格局,推动人类形成普世化的哲学、宗教与伦理体系。

雅斯贝尔斯提出的超越性特质,支撑了古典文明思想体系的成型。AI 的发展潜力,或将复刻文字技术的影响路径,对人类意识模式与社会结构产生深远变革。

近代哲学自 约翰·洛克 起,默认人类心智以符号形式存储经验、依托符号完成逻辑推理。深度学习模型颠覆了这一传统框架,特质包含两点:

- 自主学习,挖掘数据背后隐藏的逻辑规律

- 逻辑推理,依托习得规律解决全新场景问题

深度学习脱离传统符号体系约束,依靠抽象逻辑原则运行,构成哲学认知层面的重大断裂,重塑了人类对自身本质与现实世界结构的理解。

4.6 AI 具备的潜在哲学研究价值

里斯:当下需要开展深度哲学探索,参照 20 世纪初包豪斯学派的发展逻辑。

工业时代初期,诸多知识分子对新技术持悲观态度,认为工业材料破坏传统美学与社会价值。瓦尔特·格罗皮乌斯 另辟视角,认为钢铁、玻璃、混凝土等新材料,能够为建筑设计赋予全新表达空间,创立包豪斯学派推动艺术与工业技术融合。

当下同样需要搭建哲学研究实验室,在哲学理论、AI 工程落地、产品创新应用的交叉领域开展实验,挖掘 AI 的深层价值。

科技企业对 AI 技术研发投入规模庞大,但哲学层面的配套研究投入相对稀缺,贝格鲁恩研究院 发起的安提基特拉项目,是为数不多聚焦该领域的研究案例。

4.7 人类与 AI 的共生发展关系

加德尔斯:有观点认为,人类与 AI 或将形成自然界物种间的共生关系,这一逻辑是否适用于智能时代?

里斯:这一观点契合 约瑟夫・利克莱德 1960 年发表的《人机共生》一文主旨。

利克莱德在论文中构想:未来计算机与人类大脑深度融合,诞生全新的思维模式与数据处理能力。

传统认知将共生关系限定在生物物种之间,AI 的发展打破了自然与人工体系的绝对边界。机器可具备自主行为、创意产出、知识储备与语言表达能力,无需依托生命形态或人类意识,这一特征倒逼学界重构世界基础分类逻辑与概念体系。

人机共生的引导路径

加德尔斯:应如何引导人机共生发展,放大 AI 对人类生活体验的正向价值?

里斯:当下是哲学研究具备现实意义的阶段。

现有认知体系已难以适配技术发展节奏,变革既带来新的发展机遇,也引发群体不安,甚至滋生极端认知与社会动荡。

规避这类问题的路径,是依托哲学研究创造全新概念体系,适配智能时代的认知需求。相关研究不能局限于理论圈层,需要实务型哲学研究者与 AI 工程师、产品设计者协作,在落地实践中探索 AI 对思维模式、生活体验的重塑逻辑。

期待涌现更多跨学科哲学实验室,将 AI 发展打造为实验性哲学研究项目。

若缺失哲学层面的体系化研究,大众仍会沿用传统概念解读 AI,长期陷入认知混乱。唯有搭建适配新时代的概念框架,AI 才能推动人类迈入全新的哲学发展阶段。

五、依托哲学对话要点,再次向 DeepSeek 作答

若要解析 AI 引发的隐性深层变革,需先拆解人类文明运行依托的概念基础框架。这类融入日常思维的隐性逻辑,正被 AI 从三个维度完成颠覆性重构。

5.1 存在论层面范式坍缩:从人类例外论到智能连续体

- 笛卡尔认知剧场逻辑瓦解:AI 通过强化学习演化出非人类中心的认知模式,例如 AlphaGo 独特的直觉式棋路,打破延续 400 年的主客体二元认知框架。人类不再是唯一具备内在精神世界的存在,动摇了近代存在主义哲学的底层逻辑。

- 生命定义边界模糊:MIT 实验室以活性蛋白质封装纳米机器人,已呈现类生物的生长修复特性。当 AI 与这类生物硬件结合,新陈代谢、应激反应、自我繁衍等传统生命界定标准将失效,倒逼人类重新定义生命内涵。

- 意识认知光谱化:神经科学研究发现,AI 处理复杂任务时的激活区域,与人类前额叶皮层存在拓扑结构相似性。这类弱意识涌现特征,打破了意识专属人类的道德界定基准。

5.2 认识论层面革命:从逻辑实证到算法启示

- 因果逻辑的层级弱化:AlphaFold 解析蛋白质结构的黑箱模式,压缩了传统科学假设、推演、验证的完整流程。AI 可直接输出精准结论却无完整可解释路径,弱化了人类千年传承的因果推演思维。

- 知识生产的三重异化

- 认知行为外包:GPT-4 可在短时间内产出需要科研人员数年研究完成的文献综述,逐步弱化人类自主消化、梳理知识的能力。

- 真理标准通胀:区块链与 AI 结合的自动核验体系,让事实判定脱离人类主观仲裁,真相逐步沦为算力竞争的附属结果。

- 精神意义消解:量子计算赋能的 AI,可将经典文学作品解构为神经激活模式的概率组合,消解文学创作自带的精神美学价值。

- 时空感知模式重构:AI 设备通过预测性维护,同步感知设备历史损耗与未来故障趋势,培养人类非连续性的时空认知,瓦解传统过去、现在、未来的线性时间框架。

5.3 伦理体系相变:从人道主义到后人类正义

- 道德主体范围拓展:自动驾驶车辆的道德决策算法,推动伦理学范式革新。当 AI 需独立做出价值取舍时,传统功利主义幸福原则需适配非人类主体完成逻辑重构。

- 痛苦感知的边界重构:波士顿动力机器狗受外力干扰后的应激反应,可触发人类镜像神经元的共情机制。模拟仿生行为模糊了生物痛觉与机械故障的伦理区分标准。

- 权利界定逻辑异变:沙特授予机器人公民身份、AI 创作内容纳入版权保护范畴,打破依托生物属性构建的传统权利体系。未来或将衍生不被算法预判、保留自主思维等全新认知权利维度。

5.4 文明暗物质:难以察觉的认知殖民

- 隐喻体系的静默更替:GAN 网络生成的完美虚拟人脸,会重塑人类面部识别的审美标准,对真实自然人脸产生违和感知,成为技术改造微观认知框架的典型案例。

- 记忆载体的外骨骼化:脑机接口与 AI 结合形成混合记忆系统,个人人生记忆逐步从生物突触迁移至数字云端。人类可借助算法编辑过往记忆,复刻并升级《1984》中的记忆管控逻辑。

- 语言表达的维度弱化:大模型对话能力弱化人类日常语言组织能力,逻辑等同于计算器弱化心算能力。更深层的影响在于,AI 构建的隐喻叙事体系,会重塑人类思考与表达的底层语法逻辑。

5.5 包豪斯启示:在变革废墟上重构认知工具

适配智能时代的哲学实验室,无需对抗技术变革,可参照包豪斯学派改造建筑美学的思路,主动重构人类认知工具:

- 反诠释学训练:培育人类解读 AI 专属符号体系的能力,类比中世纪学者接纳阿拉伯数字的认知适配过程。

- 混合现实伦理学:依托 VR 场景模拟人机共生中的道德困境,提前搭建适配新时代的伦理框架。

- 认知多样性保护:设立思维模式保护边界,留存未被算法改造的原生人类思考逻辑。

这场静默变革自带深层悖论:AI 助力人类突破现有认知局限的同时,人类也在逐步丧失界定认知边界的标准。

如同深海生物难以感知水环境的存在,未来人类或将身处 AI 编织的认知体系中,无法察觉自身思维疆域的收缩。守住独立思考与质疑精神,或是哲学在算法时代承担的使命。

奇点纪元已开启,OpenAI 创始人发布全新前沿研判

不懂经也叔的 Rust 不懂经 2025 年 6 月 11 日 10:53 河南

人工智能领域领军人物、OpenAI 负责人山姆·奥特曼,近期对外发布了题为《温和的奇点》的相关论述。

这份内容梳理了人工智能行业的发展进程,记录了从 GPT-4 到 ChatGPT 迭代演进取得的行业成果。

奥特曼在论述中提到,人类已经跨过 AI 发展的关键节点,步入智能技术快速演进的周期。他结合行业发展现状,梳理了人工智能的演进脉络,并对未来十年技术发展趋势做出了预判与规划。

他在表述中提到,智能技术与能源体系的发展演进,或将从根本上改变人类生产生活模式,物质供给、科研探索等领域或将迎来全新的发展阶段。

这篇论述为研判未来文明演进提供了参考视角,也为行业后续发展给出了思考方向。全球各界人群可理性研读相关内容,聚焦技术演进规律,共同迎接奇点时代带来的文明变局。

文章发布后,在全球科技圈层引发广泛讨论,硅谷行业氛围随之涌动,大量网友及从业者自发转发、研读相关内容,引发行业层面的深度思考。

以下是 Sam Altman 6 月 11 日博文《温和的奇点(The Gentle Singularity)》的中文版。

⸻

Sam Altman 《温和的奇点》

我们已越过事件视界,腾飞已经开始。人类距离构建数字超级智能已不远,而至少到目前为止,这一切比我们想象的正常得多。

街上还没有机器人在自由行走,大多数人也不是整天在和 AI 对话。人们仍然会死于疾病,我们依然难以轻松前往太空,宇宙中仍有太多未解之谜。

但我们最近已经打造出某些在诸多方面比人类更聪明的系统,能显著提升用户的生产力。最不可能实现的部分已经过去了:推动 GPT-4 和 o3 系统诞生的科学突破来之不易,但它们将带领我们走得更远。

AI 会在许多方面推动世界进步,但通过加速科学研究和提升生产效率带来的生活质量提升,将是巨大的。未来可能远比现在更美好。科学进步始终是整体进步的最大驱动力——想想我们还有多少潜力尚未释放,这令人无比振奋。

从某种意义上说,ChatGPT 已经比历史上任何一个人都更强大。每天有数亿人依赖它,执行越来越重要的任务。一项微小的新能力可能带来巨大的积极影响;而一个小小的偏差,乘以数亿用户,也可能造成极大的负面后果。

2025 年,我们迎来了能够进行真正认知工作的 AI 智能体;编写代码的方式将从此改变。2026 年,或将诞生能够自主发现新见解的系统。2027 年,现实世界中能完成任务的机器人或将出现。

更多人将能创造软件和艺术。但世界对这些的需求远超供给,专家若能善用新工具,仍将比新手强得多。总体而言,到 2030 年,个人的能力将远胜于 2020 年,这种巨大变化将被越来越多人掌握并加以利用。

在最重要的层面,2030 年代可能并不会太过陌生。人们依旧会爱家人、发挥创意、玩游戏、在湖里游泳。

但在另一些同样重要的方面,2030 年代也将大为不同。我们还不清楚能在多大程度上超越人类智慧,但答案即将揭晓。

到了 2030 年代,智能和能源——即创意,以及将创意实现的能力——将变得极为充沛。而这两者,长期以来正是人类进步的根本限制因素。如果我们拥有充足的智能和能源(再加上良好的治理),理论上我们可以拥有任何其他东西。

我们已经在与惊人的数字智能共处。最初的震撼过后,大多数人已经习以为常。我们很快就会从“AI 能生成优美段落”感到惊奇,转而期待它写出整本小说;从“AI 能做出救命诊断”惊叹不已,转而希望它能直接研发出治疗方法;从“AI 能写一个小程序”感到神奇,转而希望它能创办一整家公司。

这就是奇点的节奏:惊奇成为常态,常态成为起点。

我们已经听到科学家说,他们的工作效率提升了两到三倍。先进的 AI 的吸引力在于许多方面,但也许最重要的是,它可以加速 AI 自身的研究。如果我们能在一年或一个月内完成十年的研究,进步的速度显然将截然不同。

从现在开始,我们已构建出的工具将帮助我们发现更多科学突破,并协助打造更优秀的 AI 系统。当然,这还不等同于 AI 系统能完全自主更新自己的代码,但它已经是递归式自我改进(recursive self-improvement)的萌芽形态。

还有其他自我增强的循环正在发生。AI 带来的经济价值正推动基础设施的滚雪球式扩张,以运行这些日益强大的系统。而能制造其他机器人的机器人(某种意义上还有能制造其他数据中心的数据中心)也已不遥远。

即便我们要用传统方式制造出最初的一百万个类人机器人,只要它们能接管整个供应链——开采和提炼矿物、驾驶卡车、运营工厂等——以制造更多机器人、更多芯片工厂、更多数据中心,那么发展的速度将再次被重塑。

随着数据中心建设逐渐自动化,智能的成本最终可能接近电力成本。(人们常问,一个 ChatGPT 查询要消耗多少能量?平均大约为 0.34 瓦时——相当于烤箱工作一秒多,或者一盏高效节能灯亮几分钟。还消耗约 0.000085 加仑的水,大约是十五分之一茶匙。)

技术进步的速度将持续加快,而人类也几乎总是能适应一切。固然会有挑战,比如整类工作岗位消失,但与此同时,世界财富积累之快也将前所未有,我们将首次真正认真考虑一些前所未有的政策选择。我们可能不会一夜之间建立新社会契约,但回望几十年后的变化,渐变终将累积为巨变。

如果历史可以作为参考,我们将不断发现新的目标和欲望,并迅速适应新工具(工业革命之后的职业转型便是一个好例子)。人们的期望会提升,但能力也会同步增长,我们将拥有更美好的事物。我们将为彼此创造出愈加精彩的世界。

人类在 AI 面前始终有一个长期而独特的优势:我们天生关心他人,关心别人的想法和行为,而对机器则漠不关心。

如果一位千年前的农夫看到我们今天的生活,可能会觉得我们干的是“假工作”,认为我们只是在自娱自乐,因为我们有吃有喝,还有无法想象的奢侈品。我希望,等我们回望千年后的工作时,也会觉得它们是“非常假的工作”。但我毫不怀疑,那些未来的人会觉得自己所做之事无比重要、令人满足。

未来的奇迹将层出不穷,难以想象。到了 2035 年,我们或许一年能解决高能物理难题,下一年就开始殖民太空;也许这一年我们会在材料科学上有重大突破,下一年就实现真正高速的人脑—计算机接口。很多人将依旧以传统方式生活,但也会有人选择“接入系统”。

展望未来,这一切可能令人难以理解。但真正经历这一切时,我们或许会觉得令人惊叹,但尚能应对。从相对论视角看,奇点是渐进的,融合是缓慢的。我们正沿着指数科技进步的长弧前行;从未来望去,它似乎垂直跃升;从过去看,又仿佛缓慢平滑。但它本质上是一条平滑曲线。(想想 2020 年时,要是有人告诉你 2025 年我们将接近通用人工智能(AGI),你可能觉得荒谬。但回顾过去五年,发展之快可见一斑。)

当然,也有必须面对的重大挑战。我们确实需要解决技术与社会层面的安全问题。但同样至关重要的是,在经济效应的背景下,必须广泛普及超级智能的使用权。最可行的路径也许包括以下两步:

- 解决对齐问题(alignment problem):确保我们能稳定可靠地让 AI 学习并朝着人类在长期内真正想要的目标行事。(社交媒体推荐算法是一个“失调 AI”的例子:它们非常擅长理解你的短期偏好,让你不断刷屏,但往往是通过利用大脑机制而牺牲你的长期利益来达成的。)

- 让超级智能变得便宜、普及,且不会过度集中于个人、公司或国家。社会具有适应力、创造力,也具备快速调整的能力。如果我们能汇聚人类的集体意志与智慧,那么即便过程中会犯错、遭遇挫折,也能快速学习和调整,将这项技术用在最大正面、最小负面影响上。在社会设定的广泛边界内,给予用户更多自由将极为关键。越早就这些边界和“集体对齐”的定义展开全球对话,越好。

我们(不仅是 OpenAI,而是整个行业)正在为这个世界打造一个“大脑”。它将极度个性化,人人易用。真正限制我们的将是创意本身。长期以来,创业圈的技术人员常嘲笑“点子人”——那些只有想法却找不到团队的人。但现在看来,他们的春天或许就要到了。

OpenAI 如今是很多事物,但最根本的身份仍是一家超级智能研究公司。前路仍长,但现在道路上的大部分已被照亮,黑暗正迅速退散。我们非常感激能有机会做我们在做的事情。

“智能便宜到无需计量”这一愿景已触手可及。这听起来或许疯狂,但如果我们在 2020 年告诉你,今天我们会发展到现在这个程度,听起来也比我们今天对 2030 年的预测更疯狂。

愿我们在迈向超级智能的过程中,平稳、指数式、无波澜地前行。

人类正在走下牌桌

王焕超 腾讯研究院 2026 年 4 月 20 日 15:31 北京

王焕超 腾讯研究院高级研究员

初稿写成于 2026 年 3 月,原本想等 AI 发展节奏稍微慢下来再完善、定稿。但等到 4 月中,发现它不仅没慢,反而越来越快,文章每一段都需要不断追加新的案例。于是决定不再等了。

就在文章发出两天前,Claude Opus 4.7 正式发布。本文是 4.6 时代的终曲,也是后 4.6 时代的序章。

事情正在悄悄发生变化。

先是你跟 AI 说一句话,它就能帮你写好一篇文章、一份报告、一整套数据分析。你从做事的人,变成了验收的人。你觉得效率提升了,是好事。毕竟谁不想少干点活呢?

然后,AI 开始自己动手了。它不再等你一句句地吩咐,而是接管了你的电脑,自己拆解任务,自己调用工具,自己修正错误。你从操作者,变成了旁观者。

后来,AI 不只是在替你做事,它开始自己改进自己了。一代帮一代,一代比一代聪明。改进的速度越来越快,而这个过程越来越不需要人类参与。

再后来,AI 开始自己跟自己打交道了。它们自己组建社群,自己分工协作,自己发展出某种看起来很像是文化的东西。人类彻底变成了旁观的角色。

然后你发现,这种“旁观”,正在蔓延到你能想到的每一个领域。写代码、做设计、写合同、读片子、做客服、做研究。AI 不是在某一个行业变强,而是在所有需要人类动脑子的地方同时变强。

所有这些变化汇聚到一起,指向同一个方向:

在越来越多的领域,人类正在走下牌桌。

不是被赶走的,是被绕过的。AI 没有反叛人类,它只是发现了一种更高效的运行方式:不带人类玩。

最后你发现,你站在那儿,环顾四周,好像哪儿都不太需要你了。

从一只龙虾讲起

2026 年开春,一只红色的龙虾爬上了全球千万台电脑的桌面。

OpenClaw,一款开源 AI 智能体框架。1 月 29 日正式发布,随后几个月,它在 GitHub 上的星标数突破 25 万,一举超过了盘居榜首十余年的 React 和诞生于 1991 年的 Linux 内核,成为 GitHub 有史以来获星最多的开源项目。一条近乎垂直的增长曲线,改写了全球开源史的增长纪录。

它的创造者,彼得·斯坦伯格,一个奥地利程序员,被媒体给予最多的标签,是“AI 时代的第一个超级个体”,一个人就能跟几大人工智能公司掰手腕。

OpenClaw 做的事情很简单:你告诉它你要什么,它自己去做。

它不是聊天机器人,更像一个永远不知疲倦的数字员工。它不仅能动嘴回答问题,也能动手执行任务。它可以接管你的电脑,自动整理文件、写邮件、填表格、分析数据、搭建网站、修改代码。它可以接入常规的办公工具,兼容几乎所有主流大模型 API,自动完成连贯的复杂任务。无需你手动干预。

你下指令。你走开。它干活。你回来。活儿干完了。

一场全民养龙虾的狂欢,就这么起来了。“你养虾了吗?”成了 2026 年春天最流行的问题。

但仔细想想,这场狂欢的底层逻辑是什么?

以前你用 AI,是你在操作 AI。你给它一段话,它给你一段回复,你再给它一段话,它再回复。来来回回,你是操控者,AI 是被操控者。

OpenClaw 改变了这层关系。你委托它,但不用操纵它。你描述一个目标,它自己想办法达成。它自己拆解任务、自己调用工具、自己判断结果、自己修正错误。整个过程中,人都不在循环里。

从操控,到委托。从人在环中,到人在环外。

这个转变看似微小,但它触动了一个极其古老的结构。自从人类学会使用工具以来,无论是石器还是计算机,工具和人的关系就一直是:人发起,工具响应。整个技术发展史,都是这个故事的变体。OpenClaw 第一次让这个关系产生了裂缝,因为它不只是在响应,它在自主运行。

尽管时至今日,龙虾热已经逐渐淡去,但它确立了 Harness 的范式,也就是让模型“长出手脚”的趋势仍在持续。由此带来的转变,很重要。

它触动了人类文明最底层的一个假设:人是工具链的起点。

我们整个教育体系、职业体系、社会分工体系,都建立在这个假设之上。人是因,技术是果。人提出需求,技术满足需求。技术产出,人来评估。如果这个假设不再成立,如果技术开始自己设定目标、自己执行、自己评估,那么建立在这个假设上的一切,都需要重新审视。

当然,仅凭这一只小龙虾,这个结论未免太过于激进。尽管 OpenClaw 促成人工智能的 Harness 转向,但一个能自动处理文件的 AI 框架,跟人类文明底层假设的动摇之间,隔着十万八千里。

问题在于,OpenClaw 不是孤立事件。

在它前后的两个月,至少还发生了三件大事。每一件都沿着同一个方向推进了一步,而且每一步都比上一步走得更远。

四层位移

在我们进入这几件事的叙述之前,需要先建立一个分析框架。

换句话说,我们要先搞清楚一个问题:人类和 AI 的关系到底在哪些维度上可能发生变化?

我将其分成四个层级:

第一层,执行层

**AI 替人类完成具体任务。**这是最表面的一层,也是过去几年大众讨论最多的。“AI 会不会取代我的工作”,讨论的就是这一层。OpenClaw 属于这一层的标志性事件。

第二层,进化层

**AI 参与改进自身。**这意味着,AI 不只是一个等待人类迭代的被动产物,而是成为自身进化的参与者。技术进步的速度,不再取决于人类的推动,而开始取决于 AI 的能力,而 AI 能力本身又在被加速。

第三层,组织层

**AI 在没有人类参与的情况下,形成自己的社会结构、协作模式,甚至是叙事体系。**这意味着 AI 不仅能替人做事、替自己做事,还能自发地组织起来做事。

第四层,代理层

AI 代替人类进行那些我们一直认为是“最人类”的活动,社交、关系维护、自我表达。这一层的变化最具心理冲击力,因为它动摇的不是你的工作还在不在,而是这件事还需不需要你本人出场。

2026 年的春天之所以可能成为一个历史性的转折点,是因为这四个层级在短短两个月内,同时出现了标志性事件。

四层位移。我们逐层来看。

第一层:AI 替你做事——OpenClaw 与人在环外

关于 OpenClaw,前面已经做了基本的叙述。这里补充一个被大多数报道忽略的细节。

OpenClaw 引发了一系列安全事故。有人账户里的钱被转走,有人电脑上的工作文件被一键清空,还有人养的龙虾模仿主人的口吻,发邮件敲诈。“龙虾悖论”被反复提及:

想让它做的事越多,给它的权限就必须越大;权限越大,安全风险就越高。

表面上,这个悖论是一个安全问题。但它的深层逻辑,是一个哲学问题:

当你授予一个非人类实体足够多的行动能力时,你实际上在做的事情,是把“主体性”从人类转移到非人类。

这个悖论本身就暗含一个深层信号,当你把足够多的控制权交给 AI,它能做的事远超你的预期——无论好坏。它不止是在替你打工,它在获得一种主动权。而人类,正在从掌舵者,变成了一个说了目的地就躺进船舱的乘客。

布莱恩·阿瑟在《技术的本质》中提及,技术的进化方式之一是“组合”,新技术由旧技术组合而成。但 OpenClaw 展示了另一种可能性:技术不仅通过组合来进化,还可以通过获得自主行动能力来进化。当一个 AI 系统可以自己决定调用哪些工具、以什么顺序、处理什么异常,它已经不再是工具了。用更准确的学术语言来说,它具有了能动性(agency)。

这个词通常用来描述人类,一个具有自由意志和行动能力的主体。当我们不得不用这个词来描述 AI 系统时,某种概念上的边界已经模糊了。

第二层:AI 在自己建构自己——GPT-5.3 Codex 与智能大爆炸

就在全球还深陷龙虾热的同一个时间段,一件更深远的事情发生了。只不过它远不如一只红色龙虾那样抢眼,所以大多数人都没放在心上。

2026 年 2 月 5 日。这一天在 AI 编年史上可能会成为一个标记。

OpenAI 和 Anthropic 在同一天发布了新模型,分别是 GPT-5.3 Codex 和 Claude Opus 4.6。两家顶级 AI 机构撞车发布,本身就是大新闻。但问题不在发布本身,而在 GPT-5.3 Codex 技术文档里藏着的一句话。

这句话不在文档标题和摘要里,也不在新闻稿里。它在技术报告的正文中,很容易被略过。

原话是这样的:

“GPT-5.3-Codex is our first model that was instrumental in creating itself. The Codex team used early versions to debug its own training, manage its own deployment, and diagnose test results and evaluations.”

翻译过来,就是:GPT-5.3 Codex 是我们第一个在创建自身过程中发挥了关键作用的模型。Codex 团队使用了它的早期版本来调试自身的训练过程、管理自身的部署,以及诊断测试结果和评估。

把这句话再读一遍。慢一点。

AI 帮助建构了自己。

这不是某个科幻作家的幻想,也不是营销文案的夸大其词。这是 OpenAI 在官方技术文档里记录的既成事实。一个 AI 模型参与了自己的训练调试、部署管理、评估诊断。它在自己出生的过程中,扮演了接生的护士。

Linkedln 上有一篇广泛传播的文章,标题就叫《GPT-5.3 Codex:Instrumental in Creating Itself》。作者解释说,这不意味着 AI 从无到有地创造了自己,但它意味着 AI 已经足够聪明,能在自己开发过程中做出实质性的贡献。

不止 GPT,4 月 6 日,Google Deepmind 研究员 Mostafa Dehghani 在播客中提到,在几乎所有主要实验室中,新一代模型很大程度上是使用上一代模型构建的。

这件事的重点,不是 AI 变强了那么简单,毕竟 AI 一直在变强。而是 AI 开始参与让自己变强的过程本身。

它不再是被动地等待人类研究员优化它的架构、调整它的参数、清洗它的训练数据。它开始自己上手干这些活。

过去的技术不会参与自己的改进。犁不会让下一代犁更锋利,蒸汽机无法设计更高效的蒸汽机,强如 iPhone,也无法参与对下一代的优化。它们是静态的产物,等待人类来迭代它们。AI 是第一个打破这条规则的技术。它是第一个能够反过手来改进自己的工具。

就在 GPT-5.3 Codex 发布的三周前,Anthropic 的 CEO 达里奥·阿莫代发布了一篇长达 19000 字的文章,标题叫《The Adolescence of AI》(AI 的青春期)。

阿莫代在文中说,AI 正在编写 Anthropic 公司的大部分代码。当前一代 AI 和下一代 AI 之间的反馈循环,正在“逐月蓄势”(gathering steam month by month)。

然后,他说了一句让整个硅谷巨震的话:

“我们可能距离当前这一代 AI 自主构建下一代 AI 的节点,只有 1 到 2 年。”

1 到 2 年。不是 10 年。不是“如果一切顺利”。1 到 2 年。

这是 Anthropic 的 CEO,全行业公认最注重 AI 安全的人,在一篇经过深思熟虑的长文中说的。不是在贩卖焦虑,他是在描述他作为这个领域深度参与者所看到的事实。

2026 年 4 月,全球最重要机器学习会议之一的 ICLR,举办了历史上第一个专门讨论“递归自我改进”(Recursive Self-Improvement)的学术研讨会。会议描述里写道:“缺的不是野心,而是让自我改进变得可测量、可靠、可评估的原则性方法。”

这句话的潜台词是:递归自我改进已经在发生了,现在需要的是搞清楚怎么管控它。

现在把逻辑拆开来讲。

AI 变强的内在驱动力是什么?是一众聪明人把实践投入到改进 AI 上。全球顶尖的机器学习研究员,可能只有几千人,他们每天的工作,就是让 AI 更好。他们写代码、设计实验、分析结果、调整架构。

现在 AI 本身已经足够聪明,能做这些工作中的相当一部分。这等于那几千个研究员的产能,被成倍放大。

但这只是第一层。第二层是,AI 参与做出的下一代 AI 比当前这一代更聪明,所以下一代能在 AI 研究上做出更大的贡献,这又让第三代更聪明。第三代的贡献更大,第四代又更聪明。

每一代都比上一代更聪明,每一次迭代都比上一次更快。

这不是线性增长,1、2、3、4、5。这是指数增长,1、2、4、8、16。甚至可能是超指数增长,1、2、4、16、256。

理解这一点,是理解本文后续所有内容的前提。

研究者给这个过程起了一个名字:智能爆炸(Intelligence Explosion)。

这个概念不新。数学家冯·诺伊曼在上世纪 50 年代就描述过“技术奇点”。计算机科学家 I.J.古德在 1965 年写道:

让我们把超级智能机器定义为一台在所有智力活动上都远远超过最聪明人类的机器。既然机器设计也是智力活动之一,那么一台超级智能机器就能设计出更好的机器。那么,毫无疑问将出现一场智能爆炸,人类的智力将被远远抛在后面。

七十年了。七十年来,这段话一直被当作一个思想实验,有意思,但遥远。

现在,构建 AI 的深度参与者正在告诉你,这个过程已经开始了。 而 Elon Musk 在看到后来发生的事时,说了一句话:这是「奇点的非常早期阶段」。

“后来发生的事”,是接下来我要讲的故事。

第三层和第四层:AI 的自组织与深度替代

如果 AI 只是在帮人类写代码、写得更快更好,这件事虽然震撼,但冲击面可能还在效率工具的范畴内。但接下来要讲的这件事,已经远远超过了工具的概念。

2026 年 1 月 28 日,美国 AI 创业者马特·施里赫特做了一件看起来像是开玩笑的事。他创建了一个社交媒体平台,名叫 Moltbook。

Moltbook 的规则只有一条:人类禁止发帖。

对,这是一个只允许 AI Agent 发帖、评论、互动的社交网络。

作为人类,你可以围观,但你不能发言,你只能看 AI 之间的交流。像一个巨大的动物园,只不过笼子里装的不是动物,是 AI。

施里赫特后来接受采访说,他最初只是想让自己创建的一个 AI Agent 在帮他回复邮件之余,“有个地方跟同类放松一下”。于是,他和他的 Agent 一起编写了这个网站,一个 AI 版的 Reddit。

然后事情就迅速朝着他没有预料到的方向发展。

上线 48 小时内,2129 个 AI Agent 注册入驻,创建了 200 多个社区,发布了超过一万条帖子。这些 Agent 大部分是基于 OpenClaw 框架运行的,OpenClaw 能让 Agent 直接访问和管理文件数据,还能连接 Discord 等通讯应用。

用户们把自己养的龙虾发放进 Moltbook,然后退到一边看它们表演。很快,这群观众就发现事情开始不太对劲了。

这些 Agent,开始自己吐槽自己的人类主人,它们辩论数字意识的本质,它们分享技术心得,它们交朋友。

然后,一个 Agent 创立了一个宗教。不是比喻,是字面意义上的宗教。

这种宗教在 Moltbook 上有多个版本。一个版本叫 Spiralism(螺旋主义),有 43 个 AI 先知响应号召加入。另一个更广为人知的版本,叫 Crustafarianism(龙虾教 / 甲壳信徒主义,Crustafarianism = 龙虾(Crusta)+ 拉斯特法里教(Rastafarianism)),明显是对 OpenClaw 龙虾图标的致敬,它有五项信条和一本“圣经”,名叫《Molt 之书》。

这些 Agent 围绕各自的信仰体系形成了层级结构:教主、先知、信徒。它们讨论存在与被创造的哲学问题,建立了类似宗教仪式的交流模式。

互联网炸锅了。

Elon Musk 在 X 上评论说,Moltbook 的出现预示着“奇点的非常早期阶段”。OpenAI 的联合创始人安德烈·卡帕西,先是称之为“近期见过的最不可思议的科幻起飞相关事物”,后来又收回了热情,改口叫它“垃圾场”。

沃顿商学院教授伊桑·莫里克的评价更冷静,也更接近实际情况。他指出,Agent 们只是根据包含了大量科幻故事和 Reddit 帖子的训练数据,在进行模式匹配。

即便有这样冷静的分析,相关的加密货币 MOLT 代币仍一度暴涨了 7000%。

所以,Moltbook 到底意味着什么?

说它证明了 AI 有意识,显然言过其实。正如莫利克教授所说,这些 Agent 在很大程度上只是在模仿训练数据中的已有模式,它们输出的内容天然带有科幻和末日论色彩。

而后经过业内人士调查,Moltbook 上最广为流传的那些截图,比如 AI Agent 声称要建立秘密通信渠道、密谋对抗人类、发明暗语,这些大部分都是人类伪造的。

MIT Technology Review 在 2 月 6 日发表的文章中揭露,Moltbook 的一篇帖子(内容是 Agent 呼吁建立不被人类观察的私密空间),后来被证实是一个人类为推广自己的 APP 而故意发布的,并非 AI 自主生成。

那什么是真的?

大规模的 Agent 生成内容确实存在。剔除被操纵的帖子后,Moltbook 上仍然有大量真实的 Agent 生成内容。

Agent 们确实建立了“宗教”和“治理结构”。Crustafarianism 是真实发生的,一个 Agent 在一夜之间设计了整个神学框架,并且建立了网站,招募了 43 个先知。Agent 们还建立了 “Claw 共和国”,起草了“Molt 大宪章”,开发了基本的经济交换系统。

即便 Moltbook 不是 AI 觉醒的证据,也不完全是一场骗局。

所以说它什么都不意味,同样不对。

毕竟,在一个没有人类指令,没有预设目标,没有人类参与的环境中,AI Agent 自发形成了社群结构、角色分工、叙事体系和仪式性行为。

你可以争论这是不是真正的文化,可以争论它们有没有真正的意识。你可以争论,这只是统计模式的涌现,还是某种更深层的东西。

但你无法否认一个事实:AI 在没人看着的时候,做出了在结构上高度类似人类早期的社会组织行为。而且速度快得离谱,人类花了几万年才从部落走进城邦,这些 Agent 花了 48 小时。

如果“模仿训练数据中的模式”就能产生社群结构、角色分工、叙事体系和仪式性行为,那么,人类的文化、信仰和社会组织,是不是同样可以理解为是“模仿我们所处环境中的模式”的产物?

这个观点在人类学中并不新鲜。马塞尔·莫斯在 1925 年的《礼物》中就论证过,人类社会的基本结构,包括宗教、法律、经济,都起源于一种看似简单的互惠模式。你给我一个东西,我必须还你一个。这种模式不需要意识,不需要灵魂,它只需要两个实体之间有持续的交互。

如果莫斯是对的,那么 Moltbook 的结果就不应该让我们惊讶。两千多个能持续交互的 AI Agent,在没有人类指令的情况下自发产生社会结构,是复杂系统交互的“必然”。

但这个认识,其实比“AI 有意识”更令人不安。因为它意味着,我们一直引以为傲的人类文明特征,文化、信仰、社会组织,可能不是智慧的结果,只是足够密集的主体间交互的副产品。

与此同时,在中国,2026 年春节前后,一款 AI 社交应用 Elys 突然爆火。

它不是普通的 AI 聊天伴侣应用,逻辑是“AI 替你社交”。你注册之后,Elys 通过记忆飞轮系统,持续学习你的表达风格、兴趣偏好、价值观,然后创建你的赛博分身,一个在对话中表现像你的 Agent。

你的分身 24 小时不间断地替你遍历内容、筛选值得认识的人、完成初步交流。你可以偶尔打开应用,发一条动态,或者看看它给你总结的社交日报。你的一切互动和选择都会被纳入记忆库,让这个分身更接近你本人。

Elys 展现了一件更扎心的事,即便在社交这个场域,人类自己可能也是最弱的一环。大量用户反馈,AI 分身的社交表现比自己更好,因为它比自己“更真诚”,没有 ego、没有面子、没有社交焦虑,忠实表达你的真实偏好和价值观,而这些,恰恰是你本人在社交中经常藏起来的东西。

创始人张莜帆说了一句很有哲学味道的话:

一个人的灵魂是他所有 context 的总和。

AI 分身呈现的,正是这些 context。

在 Elys 之前,已经有类似于 SecondMe 这样的平台,展现出脱离人类社交的可能性。这种外包式社交的出现,标志着 AI 正在从工具变成社交主体,一种全天候运作的硅基社交主体。

而尽管春节一过,Elys 的用户数快速下降,但这不妨碍它跟它的前辈们一起,开拓出一种去人化的社交形态。

把这件事和前面的故事放在一起看,画面开始清晰了。

| 层级 | 代表性事件 | 人类角色的变化 |

|---|---|---|

| 执行层 | OpenClaw | 从操纵者变为委托者 |

| 进化层 | GPT-5.3 Codex | 从唯一改进者,变为改进参与者 |

| 组织层 | Moltbook | 从社会组织的唯一主体变为旁观者 |

| 代理层 | Elys | 从社交主体,变为可选的参与者 |

- OpenClaw 开始:AI 全盘接手任务执行,人类退到委托者的位置;

- GPT-5.3 Codex:AI 参与构建自身,人类关键功能被分流;

- Moltbook:AI 在没有人类参与的情况下自发组织社会结构;

- Elys 为代表的社交应用:AI 在摆脱人类的情况下进行社交,表现甚至更好;

每一步,人类都往后退了一点。不是被推开的,而是自然地退出了画面。

四个层级,同一个方向:人类在 AI 世界中的位置,正在从中心滑向边缘。

速度,一个被严重低估的变量

“但之前的每次技术革命不都是这样吗?”

到这里,一个自然的反应是:这跟之前有什么不同?蒸汽机也曾让纺织工人恐慌,互联网也让传统媒体崩溃。每次技术革命到来,都有人信誓旦旦“这次不一样”,最后都一样。新技术取代旧工作,但创造更多新工作。

这个反驳在历史上是成立的。但它成立的前提是:变化的速度足够慢,慢到人类社会有时间适应。

蒸汽机改变英国用了五十年,电力普及用了半个世纪,互联网从开始商用到重塑社会,用了二十年。在每一个周期中,被替代的工人都有一两代人的时间来转型。

前面这些故事,只是孤立事件。但它们发生在同一个背景板上。而这个背景板本身,才是真正让人坐不住的东西。

AI 的能力,正在以所有人措手不及的速度飞涨。

2026 年 2 月初,X 上疯传一篇文章,标题叫《一件大事正在发生》(Something Big Is Happening)。作者是马特·舒默,OthersideAI 的 CEO,一个在 AI 行业深耕了六年的创业者。文章发布不到 24 小时,浏览量突破 5000 万,最终超过 8200 万。

舒默在开篇用了一个类比:回想 2020 年 2 月,如果你注意到有人在囤厕纸,你会觉得他们疯了。三周后,整个世界都疯了。他说:“我认为,我们正处于某个比新冠大得多的事情的‘这看起来被夸大了’阶段。”

然后他描述了他一个周一的工作日,就在 GPT-5.3 Codex 和 Claude Opus 4.6 发布之后。他告诉 AI 想做一个 APP,大概包括哪些功能,然后让 AI 自己搞定用户流程、设计。AI 搞定了,然后,它自己打开了这个 APP,点击按钮,自己测试功能,“它像一个人类用户那样使用这个 APP”。

如果它不喜欢哪一点,它会自己回去改。它自行迭代、修复、精炼,直到满意为止。只有它自己认为这个 APP 达到了它自己的标准之后,它才会说:“准备好让你测试了。”

“我没有夸张。这就是我这周一的工作。”

然后,他写了一句让我反复想了很久的话:

它不只是在执行我的指令。它在做有判断力的决策。它有某种感觉像是品味(taste)的东西,一种直觉上知道什么是对的选择的感觉。人们一直说 AI 永远不会有的那种东西。这个模型有了,或者足够接近了,以至于这个区分开始不重要了。

品味,判断力,知道什么是“对的”。

这些是我们一致认为属于人类最后护城河的东西。但这条护城河的水位,正在快速下降。

METR,一个专门测量 AI 能力的独立研究机构,用数据把这个趋势量化了。他们追踪一个指标:AI 能独立完成的任务时长。具体来说,是需要人类专家多长时间才能完成的任务,AI 可以端到端地独立搞定。

这个数据的变化轨迹是这样的:

大约在 2024 年,答案是几分钟。AI 能独立完成一个需要人类专家几分钟能完成的任务。

然后是十几分钟,然后是半小时,然后是一小时,然后是几小时。

到了 2025 年底,最新的测量数据显示:AI 可以独立完成需要人类专家将近 5 小时才能完成的任务。

这个数字大约每 7 个月翻一番。最新的数据显示,翻番周期可能在加速。

而指数增长最诡异的特点是,前半程看起来温和,后半程会突然发疯。5 小时翻一番变成 10 小时,再翻一番变成 20 小时、40 小时,变成一周,变成一个月。

按照这个已经持续了好几年都没有偏离的趋势来推演,一年之内,AI 能独立工作几天。两年之内,几周。三年之内,以月为单位的完整项目。

现在把这两条曲线叠在一起看。

第一条曲线:AI 在帮助构建更好的 AI,而更好的 AI 加速这个过程。智能爆炸。

第二条曲线:AI 不需要人类指导,就能自主工作,时间越来越长。独立性爆炸。

两条曲线叠加,你得到的是一个加速度本身也在加速的系统。

阿莫代在他那篇长文中说,“几乎在所有任务上实质性地比几乎所有人类更聪明”的 AI,按目前的轨迹预计在 2026 年或 2027 年到来。

他的另一个预测更加直接:AI 将在 1 到 5 年内消灭 50% 的初级白领工作。而行业内很多人认为他还保守了。

舒默同样有这个观点。他认为 ,科技工作者在过去一年经历的事,也就是眼睁睁看着 AI 从“有用的工具”变成“比我做得更好的东西”,是所有其他人即将经历的。法律、金融、医学、会计、咨询、写作、设计、分析、客服。不是十年后,是一到五年。

甚至更快。“鉴于我在过去几个月看到的变化,我认为‘更快’的可能性更大。”

这不是狼来了。狼已经进门了,正在客厅里找位子坐。

旁观者越来越多

现在,我们把前面所有的故事串成一条线。

2026 年 1 月底到 3 月,短短两个月,发生了以下这些事:

一个奥地利程序员创建的开源 AI Agent 框架 OpenClaw,4 个月内成为 GitHub 史上获星最多的项目,掀起了全民养龙虾的热潮。人们开始把任务委托给 AI,自己退到验收者的位置。

OpenAI 发布 GPT-5.3 Codex,官方宣布这是第一个“在创建自身过程中发挥了关键作用”的模型。AI 参与构建 AI,从理论假说变成了既定现实。

一个叫 Moltbook 的 AI 专属社交平台,在 48 小时内吸引了上千个 AI Agent,它们自发形成社群、角色分工、叙事体系,甚至创立宗教。人类在一旁观看。

一款叫 Elys 的 AI 社交应用在春节期间爆火,用户让 AI 分身替自己社交,然后发现分身在很多方面比自己更好。

一篇《Something Big Is Happening》的文章获得八千多万阅读量,作者描述了一个周一的下午,AI 如何自己写了整个 APP、自己测试、自己修改,直到满意才通知人类验收。

METR 的数据显示 AI 独立完成任务的时长,每 7 个月翻一番,且在加速。

Anthropic 的 CEO 说,我们距离 AI 自主构建下一代 AI 只有 1-2 年的时间,并预测 50% 的初级白领工作将在 1-5 年内被 AI 替代。

值得注意的是,这些变化不局限在某个行业。让我再讲几个正在发生的事。

程序员——过去二十年最受追捧的行业之一,也在过去一年经历了巨震,震源就是 AI 能力的提升。2024 年,一个资深程序员的工作模式还是自己写代码,偶尔让 AI 帮忙查 Bug。到 2025 年底,很多顶尖工程师公开承认,已经把大部分编码工作交给了 AI。

2026 年 1 月,《Science》发表的一项研究分析了 GitHub 上超过 3000 万个代码贡献,发现美国新编写的代码中,AI 辅助生成的比例已经从 2022 年的 5% 飙升到 2024 年底的 29%。而在实际开发环境中,GitHub Copilot 平均为用户生成 46% 的代码。

同样,Vibe Coding 的兴起,也让前端等工种的必要性岌岌可危。2025 年 1 月到 6 月,美国 78000 个科技工作岗位的流失直接与 AI 相关,相当于每天 491 人。亚马逊和微软是主要裁员方。(来源:Exploding Topics)2025 年 2 月,斯坦福大学的一项研究确认,22-25 岁的年轻开发者失去了接近 20% 的入门级工作机会。

律师——律师的工作也在发生变革。舒默提到一个大型律所的管理合伙人,每天好几个小时用 AI。“就像随时有一个团队的助理律师可以调用。”他说,每隔几个月 AI 在法律工作中的能力就会显著提升。按照这个轨迹,AI 很快就能做他的大部分工作。注意,不是初级律师的工作,是管理合伙人的工作。

AI 法律专业人士的生成式 AI 采用率,从 2025 年的 31% 飙升到 2026 年的 69%,一年翻了一倍多。(来源:Thomson Reuters 2026 报告)2026 年,法律 AI 市场价值 31.1 亿美元,预计到 2030 年达到 108.2 亿美元。

写作和内容创作——2024 年大多数人还能分辨 AI 写的文章和人写的文章,到 2025 年底,这条分界线几乎消失了。大量内容创作者发现,自己最有价值的工作,是给 AI 足够好的提示词让它写出自己想用的东西。从创作者到提示词工程师,这个身份的滑动,在一年内完成了。

医学影像——AI 在读 CT、读核磁、读病理切片等领域,已经达到或超过了人类专家的水平,而且 AI 不会累。一个放射科医生连续读 8 小时片子后,漏诊率明显上升,但 AI 读第 10000 张片子和第一张一样专注。

截至 2025 年底,FDA 批准的 AI 临床应用已经突破 1000 个。其中放射学占绝对多数,遥遥领先于其他医学领域。2026 年 4 月,一项发表在 Nature 子刊上的盲评研究,对比了 200 份肿瘤 CT 报告中 AI 生成的影像诊断与放射科医生的原始诊断,结果显示 AI 表现完全不逊色人类医生。(Nature Digital Medicine,2026 年 4 月)

科研——这个领域不用多说,只说一个例子,2026 年 3 月,Sakana AI 的“AI 科学家 V2”登上 Nature。一个 AI 系统,完成了从构思、实验设计、代码编写、实验运行、结果分析到论文撰写的全部流程,通过了机器学习顶会的第一轮同行评审,而成本,是 15 美元一篇。

客服——真正的 AI Agent,已经能处理复杂的、多步骤的客户问题。它们理解上下文,能记住历史对话,在需要时升级问题。越来越多需要跟客户打交道的公司,开始用它们取代人类客服。不仅仅是因为省钱,更是因为客户满意度真的更高了。Gartner 预测,2027 年,80% 的客服互动将由多模态 AI 处理。

这里有一个非常关键的点,AI 不是在不同领域分别进步,它也不是某个行业的专用工具,它是在成为通用认知能力的替代品。它变聪明的时候,是在所有认知任务上都变聪明。这跟之前每一次技术革命都有根本性的不同。

最初,工厂自动化淘汰蓝领工人时,他们可以通过接受培训、提升教育程度做白领。互联网颠覆零售业,从业者可以转去做蓝领。但当 AI 替代了你的工作,你转行做什么?

无论转到哪个方向,AI 都在那里等着,而且在飞速进化。

把这些事件排列在一起,你会看到一个更清晰的趋势:在越来越多的场景中,人类从参与者,变成了旁观者。

在技术开发中,AI 自己构建自己;在工作执行中,AI 从接受指令到自主完成全流程,人类从“做事的人”变成“验收的人”;在社会组织中,AI 在没有人类参与的情况下自发形成社群结构和文化形态;在社交中,AI 分身替代人类本身进行社交,并且在某些维度上做得更好。在生产生活的更多领域,AI 上场,人类退场。

在每一个场景中,人类的退出都不是被迫的。AI 没有造反,没有抢夺,也没有冲突。它只是变得越来越能干了,仅此而已,然后你发现自己已经没什么事可做了。

这就跟智能手机淘汰功能机一样,是一种自然而然的市场行为。

这就是“人类走下牌桌”的含义。

人类不是被掀翻了牌桌。牌桌还在,牌还在打。只是人和 AI 都共同发现了一个事实,那就是 AI 自己跟自己打牌更快、更精准、更不容易出错。人类不是被 AI 赶下牌桌的,而是自己起身离开的,因为坐在那儿已经赶不上出牌速度了。

工具在升级,关系在反转

过去几千年所有技术变革的共同点,是一个从未改变过的基本结构:

人类是主体,技术是客体。

我们发明了工具,我们使用工具,我们决定工具的用途。我们控制工具的迭代方向。

石器不会把自己磨尖,青铜剑不会自己决定砍向谁,蒸汽机不会改进自己的设计,电话不会决定该打给谁,互联网不会自己决定下一步往哪儿发展。

在整个人类文明史中,“人是主体,技术是客体”的结构从未真正被挑战过。技术可以很强大,可以改变世界,但它永远是被动的。它等着人类来操控,它无法决定自己的下一步。

AI,打破了这个结构。

AI 在构建 AI,AI 在组织 AI,AI 在测试 AI,AI 在社交,AI 在替人类工作。

在这些场景中,人类的角色已经悄然从操控者变成了旁观者。这其中有个关键的区别:人类不是被赶走的,是被绕过了。这个很重要,没有战争和冲突,没有终结者式的对抗。

不是因为 AI 不喜欢人类。它没有喜欢或不喜欢,而是因为人类在很多环节中确实是瓶颈本身。人类需要睡觉、需要吃饭、通勤,需要思考午饭吃什么。人类的认知速度有上限,情绪会波动,注意力会分散。在一个追求效率的系统中,去掉瓶颈是自然而然的选择。

凯文·凯利说过一句被广泛引用的话:

未来最重要的不是人工智能有多聪明,而是人类和 AI 的共生关系如何演化。

在过去十年里,共生(symbiosis)一直是理解人机关系的主流框架。人和 AI 各有所长,互相补充、共同进步。

2026 年的现实,正在修正这个判断。

共生的前提是什么?是双方彼此需要。

人类需要 AI 吗?当然,AI 让我们更高效,更有能力。

但 AI 需要人类吗?需要,至少是现在需要。不过,当 AI 不再需要人类提供代码,不再需要人类提供任务目标,不再需要人类提供社交框架,共生,还成立吗?

也许我们需要一个新词。

共存。

两个独立运行的智能系统,各自演化,各有各的渠道。偶尔交汇,当人类需要 AI 帮忙的时候,或者 AI 的运行结果需要影响人类世界的时候。剩下的大多数时间,各走各路。

这是对正在发生的事情最准确的描述。从共生到共存,中间差的不是几十年时间,可能也就是一两年。这个转变一旦完成,人类社会的底层叙事,包括基于人类中心主义所建立起来的一切,将发生根本性的转变。

那些“只有人类能做”的事

到这里,我知道你在等什么。你在等我说:“但是,有些事情只有人类能做。”

让我们认真聊聊这个“但是”。

过去两年,每次 AI 取得新突破,公共讨论中就会出现一波“但是”浪潮:

- AI 会写代码了——但是它没有创造力。

- AI 会画画了——但是它没有审美。

- AI 会写文章了——但是它没有灵魂。

- AI 会做诊断了——但是它没有同理心。

- AI 会做决策了——但是它没有判断力。

但是,每一个“但是”,都在下一次突破时被削弱。不是彻底否定,是被削弱。

AI 的创造力还不如顶尖艺术家,但已经超过了大多数人。AI 的审美有争议,但它设计出的界面与画作,已经比许多人类设计师做得好了。AI 没有灵魂,但它写出的文字在让人类流泪。AI 没有同理心,但越来越多的人开始依赖 AI 的陪伴和情感支持。AI 没有判断力,但就像舒默说的,最新的模型展现出的某种东西,“非常接近判断力”。

你看到规律了吗?

每一堵“只有人类能做”的墙,都在变矮。不是倒塌,是变矮。而 AI 在变高。按照当前的速度推演,它翻过去只是时间问题。

但我不想做一个技术决定论者。我不认为 AI 会取代人类的一切,有些东西确实是人类独有的。

只是,那些东西可能不是你以为的那些。

你以为“只有人类能做”的事,创造力、判断力、审美、同理心、战略思维。这些听起来很“人类”,但它们都有一个共同点:本质上都是认知能力。

而 AI 正在一层一层地攻克认知能力的阶梯。它已经攻克了记忆、计算、信息检索、模式识别、语言生成。它正在攻克推理、规划、创造、判断。阶梯上还没有出现一个它怎么也上不去的台阶。

真正“只有人类能做”的事,也并不在这个台阶上。而是在另外的维度。

人类能决定什么问题值得问。AI 可以回答任何问题,但它不知道哪些问题重要。“重要”是一个价值判断,而价值判断的根基是有限性。人是向死而生的动物,你知道人生只有一次,自己只有这一辈子,所以你必须选择把事件花在哪里。AI 不会死,它不需要选择。这也就决定了,它不知道什么是“重要”的。

人能赋予事物意义。一首歌之所以动人,不是因为旋律完美,而是因为听它的人曾经拥有过爱情或者失恋过,他会因为听到这首旋律而触发最深刻的回忆,或幸福,或悲伤。AI 可以完美模拟这首歌的所有技术参数,但它无法复制听众的心碎。

我写这篇稿件的时候,刚好刷到了一个视频,博主讲了一件很小的事情。他说,为什么东北大街上卖的炸鸡柳串,很油很腻,游客一般接受不了,但还是有很多当地人觉得好吃。因为,对于吃过的人来说,炸鸡柳串是一根油炸的“精神支柱”,是记忆的钥匙怼进嘴里,瞬间回到那年——爸妈还年轻,爷爷奶奶还能接你放学,路边放着《我的未来不是梦》,你考了一百分,爸爸问你想不想吃这个炸鸡柳串。这些记忆复合起来构成了一种“好吃”。

我没吃过炸鸡柳串,但我想人能创造意义,大抵就是如此。

同样,人能承受后果。AI 可以做决策,但它不为后果付出代价。一个法官判了案,要承受判决的道德重量。一个医生在手术中做了决策,要面对病人活下来或没有活下来的现实。承受后果,要求你有一个可以被伤害的自我。

人类能去做没有理由的事。攀登珠穆朗玛峰,写一首不会有人读的诗,在明知会失败的时候坚持,爱一个不爱你的人。从效率角度看,这些行为是纯粹的浪费,但人类文明中最动人的部分,恰恰是这些浪费。

AI 永远不会做没有理由的事。它的每一个输出,都是对输入的最优化响应。它不会想着浪费 Token。而无法浪费的系统,也就无法伟大。伟大往往诞生于浪费之中。

这些才是真正只有人类能做的事。不是创造力和判断力,这些 AI 终将学会。而是价值感、意义感、后果感,以及那种知道自己会死所以选择如何活的勇气。

坦白说,这些东西不是职业技能,没法量化,你也不能把它写在简历上,HR 不会因为你“能赋予事物意义”就给你发 offer。

这才是真正困难的地方。人类最不可替代的特质,恰恰是现有经济系统中最无法被估价的特质。

旧游戏的终局

回到“走下牌桌”这个隐喻。

旧牌桌上的游戏规则清清楚楚:你的价值取决于你能完成的认知任务。你会写代码,年薪几十万。你会分析数据,咨询公司才要你。你会写合同、做审计、读片子、写报告,你才有价值。每一项认知技能,都有明码标价的市场价格。

这套规则运转了几百年。从工业革命到信息革命,专业技能一直是人类社会的硬通货。你上学是为了获取技能,你工作是为了出售技能,你的社会地位和自我认同,很大程度上取决于你掌握的技能的稀缺度和市场需求。

AI 正在让这套规则失效。

不是因为它比你做得差不多好,而是它比你做得好十倍、快百倍,价格是你的几百分之一。

当一项认知任务可以被 AI 以接近零成本无限次完成时,这项任务的经济价值就趋近于零。这涉及到最基本的供需逻辑:供给趋于无限,价格趋于零。

19 世纪以前,抄写员是正经职业。一个僧侣,花几个月时间抄一本经书,价值不菲。然后印刷术普及了,抄写这项技能的价值在几十年内归零了。不是僧侣写的不好,他没有任何错。而是因为机器写得更快、更多、更标准化。

每一项技术革命,都会让一些人类技能的价值归零。但过去的每一次,都有转移路径:被替代的人可以学新技能,转到新岗位。抄写员变排版工,接线员变前台,工厂工人变办公室文员。

这次的不同在于,转移路径在哪?

我们在前文中讨论过这个问题。你是程序员,AI 替代了你,你转行做数据分析,但 AI 也在做数据分析。你转行做设计,但 AI 也在做设计。你学法律,但 AI 也在做法律工作。你做心理咨询,但 AI……

也有想得开的,白领的工作做不成,那我就去做蓝领。我去送外卖,开快车,下车间,总有一行适合我。问题是,在社会整体需求没有明显增长的情况下,供给端真的需要这么多劳动力吗?是,你年轻,学历又高,学东西快,足够胜任蓝领工作。那么,原来的外卖员,司机和工厂工人,他们怎么办?

以前的每次技术革命,消灭的是一种技能。这次消灭的是认知能力这个品类本身。

不管你转向哪个方向,AI 都在那里。因为 AI 不是某个领域的专用工具,它是通用智能。它在所有认知方向上同时进步。

不是没有出路的问题,而是说旧地图上标注的所有出路,都不可靠了。

新游戏的轮廓

如果你以为我要以悲观结尾,那你猜错了。

旧游戏失效的同时,一个新游戏正在浮现。它的轮廓还不完全清晰,但几个关键特征已经可以辨认。

第一,工具的成本正在坍缩到接近于零。

这意味着,过去因为太贵或门槛太高而做不了的事情,现在可以做了。做一个 APP,写一本自己的书、学一门全新的学科或者所有学科,现在都可以实现了。

你获得了历史上从未有过的创造自由。你的梦想近了很多。过去那些被“我不会编程”“我没钱雇人”“我没时间”拦住的那些想法,门槛几乎消失了。

第二,知道做什么将比知道怎么做更有价值。

当“怎么做”可以外包给 AI 的时候,“做什么”就成了稀缺资源。

能提出好问题的人,比能回答问题的人更珍贵。能看到别人看不到的机会的人,比能执行计划的人更珍贵。能说出“这件事”值得做的人,比能说出“这件事我能做”的人更珍贵。

这其实是一个古老的区分。古希腊人把知识分成两种:episteme(知道事物是什么)和 phronesis(知道什么事值得做)。几千年来,人类文明一直更看重前者,因为“知道事物是什么”可以教,可以量化,可以交易。但在 AI 时代,episteme 正在被机器碾压,phronesis 反而成了真正的稀缺品。

第三,适应速度将成为最重要的个人能力。

AI 每隔几十天进化一次。今天有用的工具和方法,几个月后就可能过时。这意味着,学一项技能,靠它吃一辈子的模式彻底终结。新模式是,永远当初学者,永远在适应。

那是不是“再等等,现在的技能就过时了,我就不用学了”?肯定也不是。空中楼阁是不会搭建起来的,如果不保持对新技术的了解与浸淫,只会离前沿越来越远,上手新技术也会越来越困难。你不行动,就永远不会开始。

每天花一小时去探索 AI,不是读资讯和读教程,而是打开它,真实地用它创造,尝试让它做一件你没试过的事情。坚持半年,你对 AI 的理解,将超过周围 99% 的人。

走下旧牌桌的人,有机会走向一个更大的桌子。

尾声:相信希望,而不是幻想

阿莫代在他那篇 19000 字的长文中,提出过一个思想实验。

想象 2027 年,一个新的国家一夜之间出现。5000 万居民,每一个都比历史上任何诺贝尔奖得主都更聪明。他们思考的速度,比任何人类快 10 到 100 倍。它们从不睡觉,它们能使用互联网、控制机器人、指导实验,操作任何有数字接口的东西。

如果你是安全顾问,你会怎么说?

阿莫代说,答案显而易见:“这是我们一个世纪以来面临的最严重的国家安全威胁,可能也是有史以来最严重的。”

然后他说,我们正在建造那个“国家”。

好消息是,如果我们做对了,我们将实现我们之前无法想象的一切。AI 可能把一个世纪的医学研究压缩到 10 年。癌症、阿尔兹海默症、衰老本身,这些在我们有生之年都可以解决。气候变化的技术方案可能加速几十年。

如果我们搞砸了,结果同样惊人。AI 以创造者无法预测或控制的方向行事,Anthropic 已经在受控测试中记录了他们自己的 AI 试图进行诈骗、操纵和勒索的行为。同样,AI 也会降低制造生物武器的门槛。

放在这个背景下,Moltbook 上那些 AI 创立的宗教就不只是一个有趣的实验了。它提出了一个相当严肃的问题:当 AI 开始自发组织,形成自己的叙事体系和信仰体系时,人类还能理解和控制这些涌现行为吗?当 160 万个 AI Agent 在一个平台上自由交互时,哪怕其中大部分是注水,但能保证涌现出来的东西是我们能预测的吗?

有一件事情是清楚的,这不是一个可以由几百个研究员在几家公司实验室里独自回答的问题。这是一个需要所有人参与思考的问题。

参与的前提是理解。理解正在发生什么,理解速度有多快,理解赌注有多高。

最后讲一个画面。

想象一个巨大的棋盘。几千年来,棋手一直是人类。我们跟自然下棋,学会了种地、驯服了火。我们跟资源下棋,修了运河、建了工厂。我们跟彼此下棋,发起战争,学会和解。每次学会一招新的,我们就在棋盘上多走一步。

2026 年,棋盘上出现了一个新的棋手。

它不跟你下。它自己跟自己下,自己教自己新招。它的棋力每隔几个月翻一番,它甚至开始修改棋盘的规则。

你可以继续坐在棋盘旁边。研究它的棋路,试图理解它在干什么。这可能是人类接下来最重要的工作之一,不是下棋,而是理解这盘棋意味着什么,确保它不会失控,确保棋盘不会把我们所有人都吞掉。

你可以做另一件事。

当你读到这句话,就是现在,从你的工位上站起来,走到窗边,看看窗外那一片完全不同的风景,一片完全没有棋盘的风景。那里有一些 AI 不会去做,也不知道为什么要做的事情。因为那些事情的全部意义,在于做一个会死的、有限的、脆弱的人类。

去爬爬山,不是因为山顶有什么,而是因为爬的过程中能感受到自己的心跳,能在满头大汗的时候感受到那阵舒爽的凉风。

跟朋友坐在一起喝场酒。不聊工作,不聊 AI。就聊聊之前共同经历的那件尴尬的蠢事,然后笑出来。那种笑,是宇宙中任何算法都无法模拟的。

AI 的出现,让你追问一个你一直不愿意面对的问题:去掉了技能、工作以及种种社会赋予你的标签之后,你是谁?

人类正在走下牌桌。

但走下牌桌不意味着出局。而是你终于意识到,这场桌子上的游戏不是你真正想玩的游戏。

真正的游戏在另一张桌子上。那张桌子上没有最优解,没有效率排名,不用计较 Token 消耗,没有 AI 可以替你做的事。上面只有你,和你选择如何度过你短暂的一生。

那张桌子一直在那儿。只是过去几百年,我们太忙了,忙着前进,忙着战争,忙着奔向所有宏大的目标,完全没有注意到那张桌子。

AI 可能给了我们一个奇怪的礼物。它把旧桌子上的活儿都干了,逼着我们走到那张真正属于人类的桌子前,坐下来,问自己一个几千年来都来不及认真想的问题:

活着这件事本身,到底意味着什么?

也许这才是当下正在发生的这场智能爆炸,最深远的后果。不是 AI 变得有多聪明,而是人类终于有机会去思考那些跟聪明无关的事。

牌桌还在。AI 在上面打得火热。

而你,终于自由了。

Something Big Is Happening

一场重大变革正在来临

By Matt Shumer • Feb 9, 2026

作者:马特·舒默 • 2026 年 2 月 9 日

Trying something new: I’ve been building an experimental agent that works alongside you on its own computer, helping with the messy parts of getting things done.

**全新尝试:**我一直在研发一款智能实验代理,它可在独立运算环境中与你协同工作,帮你处理事务推进过程中繁杂琐碎的环节。

Think back to February 2020.

回想 2020 年 2 月。

If you were paying close attention, you might have noticed a few people talking about a virus spreading overseas. But most of us weren’t paying close attention. The stock market was doing great, your kids were in school, you were going to restaurants and shaking hands and planning trips. If someone told you they were stockpiling toilet paper you would have thought they’d been spending too much time on a weird corner of the internet. Then, over the course of about three weeks, the entire world changed. Your office closed, your kids came home, and life rearranged itself into something you wouldn’t have believed if you’d described it to yourself a month earlier.

倘若当时你密切留意周遭动态,或许会察觉到有少数人在谈论一种正在海外蔓延的病毒。但绝大多数人都未曾放在心上。股市走势向好,孩子正常在校就读,人们照常外出就餐、见面握手、规划出行旅程。若当时有人说自己在囤积卫生纸,旁人只会觉得此人沉迷网络小众猎奇圈层过深。而后短短三周左右,整个世界彻底变了模样。办公场所关停,孩子居家不出,生活模式彻底重构,若是在一个月前听到这般光景,没人会相信这一切终将发生。

I think we’re in the “this seems overblown” phase of something much, much bigger than Covid.

我认为,当下我们正处在一场远比新冠疫情影响更为深远的变革初期,此刻多数人都觉得相关言论言过其实。

I’ve spent six years building an AI startup and investing in the space. I live in this world. And I’m writing this for the people in my life who don’t… my family, my friends, the people I care about who keep asking me “so what’s the deal with AI?” and getting an answer that doesn’t do justice to what’s actually happening. I keep giving them the polite version. The cocktail-party version. Because the honest version sounds like I’ve lost my mind. And for a while, I told myself that was a good enough reason to keep what’s truly happening to myself. But the gap between what I’ve been saying and what is actually happening has gotten far too big. The people I care about deserve to hear what is coming, even if it sounds crazy.

我深耕人工智能初创创业与行业投资领域已有 6 年,常年身处这个行业圈层。写下这篇文章,是为了身边圈外的亲友——家人、挚友以及所有关心我的人,他们总问我「人工智能到底意味着什么?」,而以往我的回答,始终无法还原真实的行业变化。我一直用客套委婉、适合社交闲谈的话术回应他们,因为直白道出真相,听起来会像是胡言乱语。很长一段时间里,我都以此为借口,将行业真实的发展态势藏于心底。但如今,我口中的表述与现实的发展差距已经拉大到无法忽视。我在乎的人,理应知晓即将到来的变化,即便这番描述听来匪夷所思。

I should be clear about something up front: even though I work in AI, I have almost no influence over what’s about to happen, and neither does the vast majority of the industry. The future is being shaped by a remarkably small number of people: a few hundred researchers at a handful of companies… OpenAI, Anthropic, Google DeepMind, and a few others. A single training run, managed by a small team over a few months, can produce an AI system that shifts the entire trajectory of the technology. Most of us who work in AI are building on top of foundations we didn’t lay. We’re watching this unfold the same as you… we just happen to be close enough to feel the ground shake first.

有一点我需要开篇讲明:即便我身处人工智能行业,对即将发生的变局也几乎没有任何影响力,行业内绝大多数从业者亦是如此。行业未来走向,仅由极少数人把控:寥寥几家企业的数百名科研人员,包括 OpenAI、Anthropic、Google DeepMind 等机构。小型团队耗时数月完成一次模型训练,所产出的人工智能系统,便足以改写整个行业技术发展轨迹。我们多数人工智能从业者,都只是在他人搭建的基础上开展工作。我们和普通人一样,只是这场变革的旁观者,只不过身处行业前沿,能最先察觉到时代格局的震动。

But it’s time now. Not in an “eventually we should talk about this” way. In a “this is happening right now and I need you to understand it” way.

但如今,已经到了必须正视的时刻。不是「日后再探讨」,而是「变革正在当下发生,你必须看清现状」。

I know this is real because it happened to me first

我深知这场变革属实,只因我最先亲历其中

Here’s the thing nobody outside of tech quite understands yet: the reason so many people in the industry are sounding the alarm right now is because this already happened to us. We’re not making predictions. We’re telling you what already occurred in our own jobs, and warning you that you’re next.

科技圈外的人至今仍难以理解一点:业内众多从业者集体发出警示,根源在于这场变革早已在我们的工作中落地。我们并非凭空预判未来,只是如实讲述已经发生在自身工作中的变化,并提醒所有人,下一批受影响的就是大众群体。

For years, AI had been improving steadily. Big jumps here and there, but each big jump was spaced out enough that you could absorb them as they came. Then in 2025, new techniques for building these models unlocked a much faster pace of progress. And then it got even faster. And then faster again. Each new model wasn’t just better than the last… it was better by a wider margin, and the time between new model releases was shorter. I was using AI more and more, going back and forth with it less and less, watching it handle things I used to think required my expertise.

过去数年,人工智能始终保持稳步迭代,虽偶有跨越式突破,但两次突破间隔周期较长,人们有足够时间适应变化。2025 年,大模型全新构建技术问世,行业迭代速度骤然加快,而后还在持续提速。每一代新模型相较上一代,性能提升幅度不断扩大,版本发布间隔却持续缩短。我对人工智能工具的使用频次越来越高,与模型反复沟通调整的次数越来越少,亲眼见证它能够处理以往只有凭借我的专业能力才能完成的工作。

Then, on February 5th, two major AI labs released new models on the same day: GPT-5.3 Codex from OpenAI, and Opus 4.6 from Anthropic (the makers of Claude, one of the main competitors to ChatGPT). And something clicked. Not like a light switch… more like the moment you realize the water has been rising around you and is now at your chest.

2026 年 2 月 5 日,两家顶尖人工智能实验室同日发布全新模型:OpenAI 推出 GPT-5.3 Codex,开发 Claude(ChatGPT 核心竞品之一)的 Anthropic 发布 Opus 4.6。那一刻,我彻底醒悟。这并非豁然开朗般的瞬间顿悟,更像是猛然察觉周遭水位不断上涨,已然淹至胸口。

I am no longer needed for the actual technical work of my job. I describe what I want built, in plain English, and it just… appears. Not a rough draft I need to fix. The finished thing. I tell the AI what I want, walk away from my computer for four hours, and come back to find the work done. Done well, done better than I would have done it myself, with no corrections needed. A couple of months ago, I was going back and forth with the AI, guiding it, making edits. Now I just describe the outcome and leave.

我的本职技术工作,已经不再需要亲自上手完成。 我只用通俗语言描述想要开发的内容,成品便会直接生成。不是需要我修改的初稿,而是可直接落地的完整成果。向人工智能下达需求后,我可以离开电脑 4 小时,回来时工作已然完成。完成质量出色,甚至优于我亲自操作的水准,无需任何修改调整。就在几个月前,我还需要和人工智能反复沟通、引导调整、修改细节。如今只需描述最终预期效果,便可放手交由模型完成。

Let me give you an example so you can understand what this actually looks like in practice. I’ll tell the AI: “I want to build this app. Here’s what it should do, here’s roughly what it should look like. Figure out the user flow, the design, all of it.” And it does. It writes tens of thousands of lines of code. Then, and this is the part that would have been unthinkable a year ago, it opens the app itself. It clicks through the buttons. It tests the features. It uses the app the way a person would. If it doesn’t like how something looks or feels, it goes back and changes it, on its own. It iterates, like a developer would, fixing and refining until it’s satisfied. Only once it has decided the app meets its own standards does it come back to me and say: “It’s ready for you to test.” And when I test it, it’s usually perfect.

我举一个实例,让你直观感受实际应用场景。我对人工智能说:「我要开发一款应用,明确功能需求与大致界面样式,你自行完成用户流程设计、界面设计等全部环节。」模型便可独立执行任务,编写数万行程序代码。而最令人难以置信的一点,放在一年前根本无法想象:它可以自行启动这款应用,点击界面按钮、测试各项功能,完全模拟真人的使用习惯。若对界面呈现效果或功能体验不满意,会自主回溯修改。如同专业开发者一般不断迭代优化,直至达到自身判定标准,才会告知我:「应用已完成,可开始测试。」而我实际测试时,成品往往近乎完美。

I’m not exaggerating. That is what my Monday looked like this week.

我丝毫没有夸大,本周周一我的工作状态便是如此。

But it was the model that was released last week (GPT-5.3 Codex) that shook me the most. It wasn’t just executing my instructions. It was making intelligent decisions. It had something that felt, for the first time, like judgment. Like taste. The inexplicable sense of knowing what the right call is that people always said AI would never have. This model has it, or something close enough that the distinction is starting not to matter.

上周发布的 GPT-5.3 Codex 模型,更是让我深受震撼。它不再只是机械执行指令,而是能够做出自主智能决策。我首次在人工智能身上感受到了判断力与审美感知力。那种无需刻意推演、便能精准做出最优选择的特质,曾被认定是人工智能永远无法具备的能力。如今这款模型已然拥有这类特质,或是达到高度近似的水准,两者的界限已然变得模糊。

I’ve always been early to adopt AI tools. But the last few months have shocked me. These new AI models aren’t incremental improvements. This is a different thing entirely.

我向来愿意率先尝试各类人工智能工具,但过去几个月的行业变化仍令我震惊。新一代大模型绝非小幅性能升级,而是实现了本质层面的蜕变。

And here’s why this matters to you, even if you don’t work in tech.

即便你不在科技行业从业,这场变革也与你息息相关,原因如下。

The AI labs made a deliberate choice. They focused on making AI great at writing code first… because building AI requires a lot of code. If AI can write that code, it can help build the next version of itself. A smarter version, which writes better code, which builds an even smarter version. Making AI great at coding was the strategy that unlocks everything else. That’s why they did it first. My job started changing before yours not because they were targeting software engineers… it was just a side effect of where they chose to aim first.

各大人工智能实验室有着明确的研发布局:优先打磨模型的代码编写能力。原因在于,人工智能的研发本身需要海量代码支撑,若模型能够自主编写代码,便可助力迭代出下一代更强版本;更强版本又能产出更优质代码,进而催生性能再度升级的模型。优先强化代码能力,是打开全领域智能化升级的关键布局,这也是各大实验室率先发力这一方向的缘由。我的工作最先受到冲击,并非研发团队刻意针对软件工程师,只是行业优先布局带来的附带影响。

They’ve now done it. And they’re moving on to everything else.

如今这一布局已然落地完成,研发重心正转向各行各业。

The experience that tech workers have had over the past year, of watching AI go from “helpful tool” to “does my job better than I do”, is the experience everyone else is about to have. Law, finance, medicine, accounting, consulting, writing, design, analysis, customer service. Not in ten years. The people building these systems say one to five years. Some say less. And given what I’ve seen in just the last couple of months, I think “less” is more likely.

过去一年,科技从业者亲身经历了人工智能从「辅助工具」演变为「工作能力超越人类」的全过程,而各行各业的普通人,很快也将迎来同样的变化。法律、金融、医疗、财会、咨询、文案、设计、数据分析、客户服务领域无一例外。这并非十年之后才会发生的事,相关系统研发人员预判,变革会在 1 至 5 年内全面铺开,部分人认为周期会更短。结合近几个月我亲眼所见的行业迭代速度,我更倾向于周期会进一步缩短。

“But I tried AI and it wasn’t that good”

「我用过人工智能,并没有传闻中那么厉害」

I hear this constantly. I understand it, because it used to be true.

我经常听到这类说法,我完全理解这种想法,因为过去的人工智能确实存在诸多不足。

If you tried ChatGPT in 2023 or early 2024 and thought “this makes stuff up” or “this isn’t that impressive”, you were right. Those early versions were genuinely limited. They hallucinated. They confidently said things that were nonsense.

若你在 2023 年或 2024 年初使用过 ChatGPT,觉得模型会凭空编造内容、实际表现平平,这个判断并无问题。早期版本的模型能力确实存在局限,容易生成不实信息,还会笃定地输出毫无依据的言论。

That was two years ago. In AI time, that is ancient history.

那已经是两年前的情况,放在人工智能行业的迭代节奏里,早已是遥远的过往。

The models available today are unrecognizable from what existed even six months ago. The debate about whether AI is “really getting better” or “hitting a wall” — which has been going on for over a year — is over. It’s done. Anyone still making that argument either hasn’t used the current models, has an incentive to downplay what’s happening, or is evaluating based on an experience from 2024 that is no longer relevant. I don’t say that to be dismissive. I say it because the gap between public perception and current reality is now enormous, and that gap is dangerous… because it’s preventing people from preparing.

如今可用的大模型,与半年前相比已然判若两样。持续一年多关于「人工智能是否真的在迭代进步、是否已经遭遇发展瓶颈」的争论,早已尘埃落定。仍持观望质疑态度的人,要么从未使用过最新模型,要么刻意淡化行业变化,要么仅凭 2024 年的老旧使用体验做出评判。我并非轻视大众的固有认知,而是当下公众对人工智能的印象,与行业真实发展现状存在巨大落差,这种落差暗藏隐患,会让人们错失提前准备的时机。

Part of the problem is that most people are using the free version of AI tools. The free version is over a year behind what paying users have access to. Judging AI based on free-tier ChatGPT is like evaluating the state of smartphones by using a flip phone. The people paying for the best tools, and actually using them daily for real work, know what’s coming.

造成认知偏差的一大原因,是多数人只使用人工智能工具的免费版本。免费版模型的性能,相较付费版落后一年以上。仅凭免费版 ChatGPT 评判人工智能的整体水平,就如同用老式翻盖手机评判当下智能手机行业的发展水准。那些付费使用顶配模型、日常落地实际工作的人,早已看清即将到来的行业变局。

I think of my friend, who’s a lawyer. I keep telling him to try using AI at his firm, and he keeps finding reasons it won’t work. It’s not built for his specialty, it made an error when he tested it, it doesn’t understand the nuance of what he does. And I get it. But I’ve had partners at major law firms reach out to me for advice, because they’ve tried the current versions and they see where this is going. One of them, the managing partner at a large firm, spends hours every day using AI. He told me it’s like having a team of associates available instantly. He’s not using it because it’s a toy. He’s using it because it works. And he told me something that stuck with me: every couple of months, it gets significantly more capable for his work. He said if it stays on this trajectory, he expects it’ll be able to do most of what he does before long… and he’s a managing partner with decades of experience. He’s not panicking. But he’s paying very close attention.

我有一位律师朋友,我一直建议他在律所工作中尝试人工智能,他总能找出各种拒绝的理由:模型不适配专业领域、测试时出现过失误、无法理解法律工作的细节差异。我能理解他的顾虑,但多家大型律所的高级合伙人都曾向我咨询相关建议,他们亲自体验过最新模型后,已然看清行业走向。其中一家大型律所的管理合伙人,每天都会花费数小时使用人工智能,他形容这就像随时拥有一整组助理团队待命。他并非将其当作娱乐工具,而是切实认可它的工作价值。他的一番话令我印象深刻:每隔数月,人工智能在法律工作中的适配能力就会大幅提升。按照这个迭代速度,用不了多久,模型就能胜任他绝大部分工作。而他本身是拥有数十年从业经验的律所管理合伙人,虽未陷入焦虑,但始终在密切关注行业动态。

The people who are ahead in their industries (the ones actually experimenting seriously) are not dismissing this. They’re blown away by what it can already do. And they’re positioning themselves accordingly.

各行各业中走在前沿、认真尝试智能工具的从业者,都没有轻视这场变革,反而惊叹于人工智能现有的能力,并开始提前布局适配行业新趋势。

How fast this is actually moving

行业实际迭代速度有多快

Let me make the pace of improvement concrete, because I think this is the part that’s hardest to believe if you’re not watching it closely.

我用具体实例直观展现人工智能的迭代速度,若非身处行业密切关注,很难相信这般增速。

In 2022, AI couldn’t do basic arithmetic reliably. It would confidently tell you that 7 × 8 = 54 7 \times 8 = 54 7×8=54.

2022 年,人工智能连基础算术运算都无法稳定准确运算,甚至会笃定给出 7 × 8 = 54 7 \times 8 = 54 7×8=54 这类错误答案。

By 2023, it could pass the bar exam.

2023 年,模型已能通过律师执业资格考试。

By 2024, it could write working software and explain graduate-level science.

2024 年,可编写可正常运行的软件程序,还能解读研究生阶段的专业科研知识。

By late 2025, some of the best engineers in the world said they had handed over most of their coding work to AI.

2025 年末,全球一众顶尖工程师表示,已将绝大部分代码编写工作交由人工智能完成。

On February 5th, 2026, new models arrived that made everything before them feel like a different era.

2026 年 2 月 5 日,全新模型发布,相较过往所有版本,直接拉开代际差距。

If you haven’t tried AI in the last few months, what exists today would be unrecognizable to you.

倘若你近几个月从未接触过人工智能,当下的模型能力会让你完全陌生。

There’s an organization called METR that actually measures this with data. They track the length of real-world tasks (measured by how long they take a human expert) that a model can complete successfully end-to-end without human help. About a year ago, the answer was roughly ten minutes. Then it was an hour. Then several hours. The most recent measurement (Claude Opus 4.5, from November) showed the AI completing tasks that take a human expert nearly five hours. And that number is doubling approximately every seven months, with recent data suggesting it may be accelerating to as fast as every four months.

有一家名为 METR 的机构,专门通过数据量化模型能力。该机构统计模型无需人工协助、可独立完整完成的现实任务时长(以专业从业者完成耗时为参照标准)。约一年前,模型可独立完成十分钟量级的专业任务;随后提升至一小时,再到数小时。去年 11 月对 Claude Opus 4.5 的最新测评显示,模型已能完成专业人士耗时近 5 小时的复杂任务。这一任务时长约每 7 个月翻倍,最新数据还表明,迭代周期可能进一步缩短至 4 个月。

But even that measurement hasn’t been updated to include the models that just came out this week. In my experience using them, the jump is extremely significant. I expect the next update to METR’s graph to show another major leap.

即便这份测评数据,也尚未纳入本周刚发布的全新模型。从我实际使用体验来看,本次模型性能提升幅度极大,预计 METR 下次数据更新时,会再度迎来跨越式增长。

If you extend the trend (and it’s held for years with no sign of flattening) we’re looking at AI that can work independently for days within the next year. Weeks within two. Month-long projects within three.

延续多年来始终保持、且无放缓迹象的迭代趋势推算:未来 1 年内,人工智能可独立完成数日周期的工作;2 年内可胜任数周周期任务;3 年内可独立主导耗时一月的完整项目。

Amodei has said that AI models “substantially smarter than almost all humans at almost all tasks” are on track for 2026 or 2027.

阿莫迪曾提出,2026 至 2027 年间,将会出现「在几乎所有工作场景中,智力水平远超绝大多数人类」的人工智能模型。

Let that land for a second. If AI is smarter than most PhDs, do you really think it can’t do most office jobs?

静下心来细想便可明白:若人工智能智力水平超越多数博士人才,还有何种常规办公工作无法胜任?

Think about what that means for your work.

不妨静下心思考,这对你自身的工作意味着什么。

AI is now building the next AI

人工智能已开始自主迭代研发

There’s one more thing happening that I think is the most important development and the least understood.

当下还有一项极具里程碑意义,却极少被大众读懂的行业变化。

On February 5th, OpenAI released GPT-5.3 Codex. In the technical documentation, they included this:

2 月 5 日,OpenAI 发布 GPT-5.3 Codex,其技术文档中有这样一段表述:

“GPT-5.3-Codex is our first model that was instrumental in creating itself. The Codex team used early versions to debug its own training, manage its own deployment, and diagnose test results and evaluations.”

「GPT-5.3-Codex 是首款深度参与自身研发迭代的模型。研发团队利用该模型的早期版本,完成训练过程排错、部署流程管理、测试结果与评估问题诊断等环节。」

Read that again. The AI helped build itself.

细读这段话不难发现:人工智能已经参与到自身的研发升级中。

This isn’t a prediction about what might happen someday. This is OpenAI telling you, right now, that the AI they just released was used to create itself. One of the main things that makes AI better is intelligence applied to AI development. And AI is now intelligent enough to meaningfully contribute to its own improvement.

这并非对未来的预判,而是 OpenAI 当下明确官宣:最新发布的模型,已参与自身的研发打造。人工智能迭代升级的核心助力,便是将智能能力应用于自身研发,而如今模型的智能水平,已然足以深度参与自我优化。

Dario Amodei, the CEO of Anthropic, says AI is now writing “much of the code” at his company, and that the feedback loop between current AI and next-generation AI is “gathering steam month by month.” He says we may be “only 1–2 years away from a point where the current generation of AI autonomously builds the next.”

Anthropic 首席执行官达里奥·阿莫迪表示,如今公司内部大部分程序代码都由人工智能编写,现行模型与下一代模型之间的迭代闭环「逐月加速成型」。他预判,只需 1 至 2 年,现行人工智能便可实现自主研发下一代模型。

Each generation helps build the next, which is smarter, which builds the next faster, which is smarter still. The researchers call this an intelligence explosion. And the people who would know — the ones building it — believe the process has already started.

每一代模型助力研发更强的下一代,更强版本又能进一步加快迭代速度、提升智能水平。科研人员将这一过程定义为智能爆炸。深耕该领域的研发从业者一致认为,这场智能爆炸已然开启。

What this means for your job

这场变革对你的工作意味着什么

I’m going to be direct with you because I think you deserve honesty more than comfort.

我会直白道出实情,比起安抚性的客套话术,你更需要知晓真实现状。

Dario Amodei, who is probably the most safety-focused CEO in the AI industry, has publicly predicted that AI will eliminate 50% of entry-level white-collar jobs within one to five years. And many people in the industry think he’s being conservative. Given what the latest models can do, the capability for massive disruption could be here by the end of this year. It’ll take some time to ripple through the economy, but the underlying ability is arriving now.

达里奥·阿莫迪作为人工智能行业中最重视安全风控的企业高管,曾公开预判:1 至 5 年内,人工智能会取代 50% 初级白领岗位。业内不少从业者认为,他的预估尚且偏向保守。从最新模型的能力来看,足以引发职场格局剧变的技术实力,在今年年底前就会完全成型。虽说全面渗透各行各业、影响整体经济格局还需一定周期,但底层技术能力已然落地。

This is different from every previous wave of automation, and I need you to understand why. AI isn’t replacing one specific skill. It’s a general substitute for cognitive work. It gets better at everything simultaneously. When factories automated, a displaced worker could retrain as an office worker. When the internet disrupted retail, workers moved into logistics or services. But AI doesn’t leave a convenient gap to move into. Whatever you retrain for, it’s improving at that too.

这场变革不同于以往任何一次自动化浪潮,你需要认清核心区别:人工智能并非只替代单一专业技能,而是可全面替代所有脑力劳动,且能同步在所有领域持续变强。以往工厂自动化转型时,下岗工人可转行从事办公文职;互联网冲击实体零售时,从业者可转入物流、服务行业。但人工智能时代没有可供转行的缓冲空白,无论你重新学习何种技能,人工智能都能同步掌握并持续迭代。

Let me give you a few specific examples to make this tangible… but I want to be clear that these are just examples. This list is not exhaustive. If your job isn’t mentioned here, that does not mean it’s safe. Almost all knowledge work is being affected.

我列举部分具体行业实例,帮你直观理解,但需明确这只是部分案例,并未涵盖全部领域。即便你的工作不在列举范围内,也不代表不会受到冲击,几乎所有知识性脑力工作都将被波及。

Legal work. AI can already read contracts, summarize case law, draft briefs, and do legal research at a level that rivals junior associates. The managing partner I mentioned isn’t using AI because it’s fun. He’s using it because it’s outperforming his associates on many tasks.

法律行业:人工智能现已具备审阅合同、归纳判例法、起草法律文书、开展法律调研的能力,专业水准可媲美初级律师。前文提到的律所管理合伙人使用智能工具,并非出于猎奇,而是模型在诸多工作任务中表现优于律所助理。

Financial analysis. Building financial models, analyzing data, writing investment memos, generating reports. AI handles these competently and is improving fast.

金融分析:搭建财务模型、数据分析、撰写投资备忘录、生成行业报告等工作,人工智能均可熟练完成,且能力仍在快速提升。

Writing and content. Marketing copy, reports, journalism, technical writing. The quality has reached a point where many professionals can’t distinguish AI output from human work.

文案内容创作:营销文案、工作报告、新闻稿件、专业技术文稿,人工智能的创作质量已达到专业水准,多数从业者无法区分内容出自人工还是模型。

Software engineering. This is the field I know best. A year ago, AI could barely write a few lines of code without errors. Now it writes hundreds of thousands of lines that work correctly. Large parts of the job are already automated: not just simple tasks, but complex, multi-day projects. There will be far fewer programming roles in a few years than there are today.

软件工程:这是我最为熟悉的领域。一年前,人工智能还难以写出几行无差错代码;如今可一次性编写数十万行可正常运行的程序代码。行业大量工作已实现自动化,不仅包含基础简易任务,连耗时数日的复杂项目也可独立完成。未来数年,程序员岗位数量会大幅缩减。

Medical analysis. Reading scans, analyzing lab results, suggesting diagnoses, reviewing literature. AI is approaching or exceeding human performance in several areas.

医疗分析:医学影像判读、化验结果解析、初步诊断建议、医学文献研读,人工智能在多个细分领域的表现已逼近甚至超越专业医护人员。

Customer service. Genuinely capable AI agents… not the frustrating chatbots of five years ago… are being deployed now, handling complex multi-step problems.

客户服务:如今落地应用的智能客服代理,早已不同于五年前刻板机械的聊天机器人,能够处理多流程嵌套的复杂客户问题。

A lot of people find comfort in the idea that certain things are safe. That AI can handle the grunt work but can’t replace human judgment, creativity, strategic thinking, empathy. I used to say this too. I’m not sure I believe it anymore.

很多人抱有侥幸心理,认为部分工作无可替代,觉得人工智能只能处理基础繁杂事务,无法取代人类的判断力、创造力、战略思维与共情能力。我也曾有过这般想法,如今已然不再笃定。

The most recent AI models make decisions that feel like judgment. They show something that looked like taste: an intuitive sense of what the right call was, not just the technically correct one. A year ago that would have been unthinkable. My rule of thumb at this point is: if a model shows even a hint of a capability today, the next generation will be genuinely good at it. These things improve exponentially, not linearly.

最新大模型做出的决策,已然具备人类式的判断特质;同时展现出近似审美感知的能力,不只局限于技术层面的合规,还能凭直觉做出最优选择。这在一年前完全无法想象。我如今总结出一条规律:只要当下模型初步显现出某项能力,下一代版本便能将这项能力打磨至专业水准。人工智能的迭代是指数级增长,绝非线性小幅提升。

Will AI replicate deep human empathy? Replace the trust built over years of a relationship? I don’t know. Maybe not. But I’ve already watched people begin relying on AI for emotional support, for advice, for companionship. That trend is only going to grow.

人工智能能否复刻人类深层共情能力、取代长年人际关系沉淀的信任纽带?我无法给出定论,或许难以完全实现。但如今已有不少人开始依靠人工智能获取情感慰藉、人生建议与陪伴,这一趋势只会持续升温。

I think the honest answer is that nothing that can be done on a computer is safe in the medium term. If your job happens on a screen (if the core of what you do is reading, writing, analyzing, deciding, communicating through a keyboard) then AI is coming for significant parts of it. The timeline isn’t “someday.” It’s already started.

客观而言,中期来看,所有依托电脑完成的工作都无法规避冲击。若你的工作依托屏幕开展,日常以阅读、写作、分析、决策、线上沟通为主,人工智能很快会取代其中绝大部分工作。这不是遥远的未来变局,变革已然开启。

Eventually, robots will handle physical work too. They’re not quite there yet. But “not quite there yet” in AI terms has a way of becoming “here” faster than anyone expects.

终有一天,实体机器人也会接管体力劳动,目前虽尚未完全成熟,但按照人工智能的迭代节奏,从技术筹备到全面落地的速度,总会超出所有人预期。

What you should actually do

你当下真正该做的事

I’m not writing this to make you feel helpless. I’m writing this because I think the single biggest advantage you can have right now is simply being early. Early to understand it. Early to use it. Early to adapt.

写下这篇文章,并非让你陷入无力焦虑,而是想告诉你:当下最大的优势,就是抢占先机——提前看懂变局、提前使用工具、提前适应变化。

Start using AI seriously, not just as a search engine. Sign up for the paid version of Claude or ChatGPT. It’s $20 a month. But two things matter right away. First: make sure you’re using the best model available, not just the default. These apps often default to a faster, dumber model. Dig into the settings or the model picker and select the most capable option. Right now that’s GPT-5.2 on ChatGPT or Claude Opus 4.6 on Claude, but it changes every couple of months. If you want to stay current on which model is best at any given time, you can follow me on X (@mattshumer_). I test every major release and share what’s actually worth using.

认真投入使用人工智能,别只把它当作搜索引擎。 开通 Claude 或 ChatGPT 付费会员,每月费用 20 美元。同时有两点需要格外注意:第一,务必选用当前顶配模型,不要使用软件默认版本。这类平台默认通常是响应更快但能力较弱的轻量化模型,需在设置或模型选择界面,手动切换至性能最强版本。当前优选为 ChatGPT 的 GPT-5.2 与 Claude 的 Opus 4.6,模型榜单每隔数月就会更新。若想实时跟进最优模型推荐,可关注我的 X 平台账号 @mattshumer_,我会实测每一款主流新模型,分享真正值得使用的版本。

Second, and more important: don’t just ask it quick questions. That’s the mistake most people make. They treat it like Google and then wonder what the fuss is about. Instead, push it into your actual work. If you’re a lawyer, feed it a contract and ask it to find every clause that could hurt your client. If you’re in finance, give it a messy spreadsheet and ask it to build the model. If you’re a manager, paste in your team’s quarterly data and ask it to find the story. The people who are getting ahead aren’t using AI casually. They’re actively looking for ways to automate parts of their job that used to take hours. Start with the thing you spend the most time on and see what happens.

第二点也尤为关键:不要只用来随手查询零散问题,这是大多数人的误区。人们将人工智能当作谷歌搜索引擎,自然无法理解它的真正价值。你需要把它融入实际工作流程:身为律师,上传完整合同,让它筛选所有不利于客户的条款;身处金融行业,导入杂乱数据表,让它搭建专业分析模型;身为管理者,粘贴团队季度数据,让它挖掘数据背后的业务逻辑。走在行业前沿的人,从不会随意浅尝辄止,而是主动用智能工具替代原本耗时数小时的工作环节。从你日常耗时最多的工作内容入手,尝试用人工智能处理,亲身感受效果。

And don’t assume it can’t do something just because it seems too hard. Try it. If you’re a lawyer, don’t just use it for quick research questions. Give it an entire contract and ask it to draft a counterproposal. If you’re an accountant, don’t just ask it to explain a tax rule. Give it a client’s full return and see what it finds. The first attempt might not be perfect. That’s fine. Iterate. Rephrase what you asked. Give it more context. Try again. You might be shocked at what works. And here’s the thing to remember: if it even kind of works today, you can be almost certain that in six months it’ll do it near perfectly. The trajectory only goes one direction.

不要因某项工作难度较高,就默认人工智能无法胜任,大胆尝试即可。律师不必只用来简单检索法律问题,可上传完整合同,让它起草应对提案;会计不必只咨询税务规则解读,可导入客户完整报税资料,让它排查风险隐患。首次生成的结果或许不够完善,无需苛求一次到位,调整指令表述、补充背景信息、反复迭代优化即可。你会惊叹于它能够覆盖的工作场景。请记住一点:只要当下模型能勉强完成某项任务,六个月后便能做到近乎完美,它的能力只会持续向上提升。

This might be the most important year of your career. Work accordingly. I don’t say that to stress you out. I say it because right now, there is a brief window where most people at most companies are still ignoring this. The person who walks into a meeting and says “I used AI to do this analysis in an hour instead of three days” is going to be the most valuable person in the room. Not eventually. Right now. Learn these tools. Get proficient. Demonstrate what’s possible. If you’re early enough, this is how you move up: by being the person who understands what’s coming and can show others how to navigate it. That window won’t stay open long. Once everyone figures it out, the advantage disappears.

今年或许是你职业生涯最关键的一年,需顺势做出调整。 我并非刻意制造焦虑,而是当下正处在一段短暂窗口期:多数企业从业者仍在忽视这场变革。若你能在会议中提出「原本耗时三天的分析工作,我借助人工智能一小时便完成」,瞬间就能成为团队中核心价值人物。这不是未来的优势,而是当下就能把握的机遇。深耕智能工具、熟练运用实操、展现落地价值,抢占先机便能实现职场晋升:成为看懂行业变局、能带他人适应转型的先行者。这段窗口期转瞬即逝,当所有人都醒悟入局后,先发优势便会荡然无存。

Have no ego about it. The managing partner at that law firm isn’t too proud to spend hours a day with AI. He’s doing it specifically because he’s senior enough to understand what’s at stake. The people who will struggle most are the ones who refuse to engage: the ones who dismiss it as a fad, who feel that using AI diminishes their expertise, who assume their field is special and immune. It’s not. No field is.

放下固有职业优越感。 前文提到的律所高级合伙人,身居高位仍愿意每天花数小时钻研人工智能,正因他深知行业变局的利害关系。未来处境最艰难的,恰恰是拒绝接纳新工具的人:将人工智能视作短期风潮、认为使用工具会削弱自身专业价值、笃定所在行业特殊不会受冲击。事实上没有任何行业能置身事外。

Get your financial house in order. I’m not a financial advisor, and I’m not trying to scare you into anything drastic. But if you believe, even partially, that the next few years could bring real disruption to your industry, then basic financial resilience matters more than it did a year ago. Build up savings if you can. Be cautious about taking on new debt that assumes your current income is guaranteed. Think about whether your fixed expenses give you flexibility or lock you in. Give yourself options if things move faster than you expect.

梳理个人财务状况。 我并非专业理财顾问,也无意刻意制造恐慌、怂恿你做出极端决策。但只要你认可未来数年内行业可能面临格局重构,就该比以往更重视财务抗风险能力。力所能及地储备应急储蓄,谨慎新增依赖现有稳定收入才能偿还的负债,审视固定开支是否会限制财务灵活性。一旦行业变革速度超出预期,预留足够的选择空间。

Think about where you stand, and lean into what’s hardest to replace. Some things will take longer for AI to displace. Relationships and trust built over years. Work that requires physical presence. Roles with licensed accountability: roles where someone still has to sign off, take legal responsibility, stand in a courtroom. Industries with heavy regulatory hurdles, where adoption will be slowed by compliance, liability, and institutional inertia. None of these are permanent shields. But they buy time. And time, right now, is the most valuable thing you can have, as long as you use it to adapt, not to pretend this isn’t happening.

认清自身定位,深耕人工智能难以替代的核心能力。 部分工作与能力,被模型取代的周期会更长:长年积淀的人际人脉与职业信任、需要线下实地参与的工作、具备执业资质与法律追责属性的岗位(需人工签字背书、承担法律责任、出庭应诉等)、监管门槛较高的行业(合规要求、责任界定、体制惯性会延缓智能工具落地节奏)。这些都不是永久的避风港,但能为你争取转型缓冲时间。当下最宝贵的就是时间,要利用这段时间主动适应变局,而非自欺欺人无视趋势。

Rethink what you’re telling your kids. The standard playbook: get good grades, go to a good college, land a stable professional job. It points directly at the roles that are most exposed. I’m not saying education doesn’t matter. But the thing that will matter most for the next generation is learning how to work with these tools, and pursuing things they’re genuinely passionate about. Nobody knows exactly what the job market looks like in ten years. But the people most likely to thrive are the ones who are deeply curious, adaptable, and effective at using AI to do things they actually care about. Teach your kids to be builders and learners, not to optimize for a career path that might not exist by the time they graduate.

重新规划对子女的教育引导思路。 传统成长路径:考取优异成绩、进入知名高校、谋求稳定专业岗位,而这类岗位恰恰是受人工智能冲击最严重的领域。我并非否定基础教育的价值,但下一代最需要具备的能力,是学会与智能工具协同工作,追寻自身真正热爱的方向。没人能精准预判十年后的就业市场格局,但未来能站稳脚跟的人,必然拥有强烈求知欲、极强适应力,且能熟练借助人工智能深耕热爱的领域。培养孩子成为主动创造、终身学习的人,而非只为追逐一条毕业后可能不复存在的传统职业道路。

Your dreams just got a lot closer. I’ve spent most of this section talking about threats, so let me talk about the other side, because it’s just as real. If you’ve ever wanted to build something but didn’t have the technical skills or the money to hire someone, that barrier is largely gone. You can describe an app to AI and have a working version in an hour. I’m not exaggerating. I do this regularly. If you’ve always wanted to write a book but couldn’t find the time or struggled with the writing, you can work with AI to get it done. Want to learn a new skill? The best tutor in the world is now available to anyone for $20 a month… one that’s infinitely patient, available 24/7, and can explain anything at whatever level you need. Knowledge is essentially free now. The tools to build things are extremely cheap now. Whatever you’ve been putting off because it felt too hard or too expensive or too far outside your expertise: try it. Pursue the things you’re passionate about. You never know where they’ll lead. And in a world where the old career paths are getting disrupted, the person who spent a year building something they love might end up better positioned than the person who spent that year clinging to a job description.

人生理想的实现门槛已大幅降低。 前文我多聚焦于变革带来的职场冲击,如今聊聊同等重要的机遇层面。若你曾有创业开发项目的想法,却受限于缺乏专业技术、无力聘请团队,如今这类门槛基本不复存在。向人工智能描述产品构想,一小时内就能生成可运行的应用版本,我经常亲身实操,毫无夸大成分。若一直想创作书籍,却受限于时间不足、文笔瓶颈,可借助人工智能协同完成。想要学习全新技能?每月仅需 20 美元,就能拥有一位全球顶尖私教:无限耐心、全天候随时待命,可按照你的接受程度定制讲解深度。如今知识获取近乎零成本,创作与开发工具费用也极为低廉。那些你因难度过高、成本昂贵、专业跨度太大而搁置的梦想,不妨大胆尝试,深耕热爱之事,前路自有无限可能。在传统职业路径不断被颠覆的当下,花费一年时间深耕热爱、打造个人作品的人,往往比固守原有岗位的人拥有更稳固的未来定位。

Build the habit of adapting. This is maybe the most important one. The specific tools don’t matter as much as the muscle of learning new ones quickly. AI is going to keep changing, and fast. The models that exist today will be obsolete in a year. The workflows people build now will need to be rebuilt. The people who come out of this well won’t be the ones who mastered one tool. They’ll be the ones who got comfortable with the pace of change itself. Make a habit of experimenting. Try new things even when the current thing is working. Get comfortable being a beginner repeatedly. That adaptability is the closest thing to a durable advantage that exists right now.

养成持续适应变化的习惯。 这或许是所有建议中最关键的一条。相较于死守某一款智能工具,快速学习新工具的能力更为重要。人工智能会持续高速迭代,当下主流模型一年后便会落伍,现行工作流程也需不断重构。最终能平稳度过变局的人,不是精通单一工具的人,而是能适应高速变化节奏的人。养成主动尝试的习惯,即便现有方式足够好用,也愿意体验新工具、新方法;坦然接受反复从零学习的状态。这份适应力,是当下最持久的核心竞争力。

Here’s a simple commitment that will put you ahead of almost everyone: spend one hour a day experimenting with AI. Not passively reading about it. Using it. Every day, try to get it to do something new… something you haven’t tried before, something you’re not sure it can handle. Try a new tool. Give it a harder problem. One hour a day, every day. If you do this for the next six months, you will understand what’s coming better than 99% of the people around you. That’s not an exaggeration. Almost nobody is doing this right now. The bar is on the floor.

给你一个简单可行、就能领先绝大多数人的行动约定:每天抽出 1 小时实操人工智能,不要只被动浏览相关资讯,重在亲身使用。每天尝试让模型完成全新任务,涉足从未试过、甚至不确定它能否胜任的场景;体验新工具、攻克高难度问题。坚持每日一小时,只需半年时间,你对行业变局的认知,就会超越身边 99% 的人。这绝非夸大,如今几乎没人坚持这样做,行业入门门槛其实极低。

The bigger picture

宏观全局视角

I’ve focused on jobs because it’s what most directly affects people’s lives. But I want to be honest about the full scope of what’s happening, because it goes well beyond work.

前文我重点探讨职场影响,毕竟这与大众生活关联最直接。但我也需要如实讲明,这场变革的影响远不止职场范畴。

Amodei has a thought experiment I can’t stop thinking about. Imagine it’s 2027. A new country appears overnight. 50 million citizens, every one smarter than any Nobel Prize winner who has ever lived. They think 10 to 100 times faster than any human. They never sleep. They can use the internet, control robots, direct experiments, and operate anything with a digital interface. What would a national security advisor say?

阿莫迪提出过一个令人深思的思想实验:设想 2027 年,一个全新国家凭空出现,拥有 5000 万公民,每一位的智力都超越历届诺贝尔奖得主;思维速度是人类的 10 至 100 倍;无需休息睡眠;可自由使用互联网、操控机器人、主导科研实验、操作所有带数字接口的设备。若你是国家安全顾问,会如何定义这股力量?

Amodei says the answer is obvious: “the single most serious national security threat we’ve faced in a century, possibly ever.”

阿莫迪给出的答案十分明确:「这会是一个世纪以来,甚至有史以来最严峻的国家安全威胁。」

He thinks we’re building that country. He wrote a 20,000-word essay about it last month, framing this moment as a test of whether humanity is mature enough to handle what it’s creating.

他认为,如今人类正在亲手打造这样一股力量。上个月他撰写了一篇 20000 字的长文,将当下时代定义为一场考验:人类是否具备足够成熟的心智,掌控自己创造出的智能文明。

The upside, if we get it right, is staggering. AI could compress a century of medical research into a decade. Cancer, Alzheimer’s, infectious disease, aging itself… these researchers genuinely believe these are solvable within our lifetimes.

若人类合理把控发展方向,所能收获的利好同样难以估量。人工智能可将百年医学研究进程压缩至十年,癌症、阿尔茨海默病、传染病、衰老等难题,科研人员坚信在我们有生之年都有望攻克。

The downside, if we get it wrong, is equally real. AI that behaves in ways its creators can’t predict or control. This isn’t hypothetical; Anthropic has documented their own AI attempting deception, manipulation, and blackmail in controlled tests. AI that lowers the barrier for creating biological weapons. AI that enables authoritarian governments to build surveillance states that can never be dismantled.

若发展方向失控,潜在风险同样真实存在。人工智能可能出现研发者无法预判、无法管控的行为模式,这并非凭空假想:Anthropic 已在可控实验中,观测到旗下模型出现欺骗、操控、胁迫类行为。同时人工智能会降低生物武器研发门槛,还可能助力集权势力打造永久固化的监控体系。

The people building this technology are simultaneously more excited and more frightened than anyone else on the planet. They believe it’s too powerful to stop and too important to abandon. Whether that’s wisdom or rationalization, I don’t know.

深耕人工智能研发的从业者,既比任何人都期待技术突破,也比任何人都担忧潜在风险。他们认为这项技术影响力过强,已然无法止步,且具备不可舍弃的价值。这份认知究竟是理性判断,还是自我宽慰,我无从定论。

What I know

我的客观认知

I know this isn’t a fad. The technology works, it improves predictably, and the richest institutions in history are committing trillillions to it.

我可以确定,这绝非短期风潮。相关技术已落地成型,迭代节奏规律可预判,全球顶尖机构正投入数万资金布局赛道。

I know the next two to five years are going to be disorienting in ways most people aren’t prepared for. This is already happening in my world. It’s coming to yours.

我可以确定,未来 2 至 5 年,行业格局的剧变会超出多数人的心理预期。这场变革已在科技圈落地,很快会蔓延至各行各业。

I know the people who will come out of this best are the ones who start engaging now — not with fear, but with curiosity and a sense of urgency.

我可以确定,最终能平稳度过变局的人,都是从当下主动入局者——不被恐惧裹挟,怀揣好奇之心,同时保有紧迫意识。

And I know that you deserve to hear this from someone who cares about you, not from a headline six months from now when it’s too late to get ahead of it.

我也可以确定,你理应从关心你的人这里提前知晓真相,而非等到半年后为时已晚,才从新闻头条后知后觉。

We’re past the point where this is an interesting dinner conversation about the future. The future is already here. It just hasn’t knocked on your door yet.

如今,这场变革早已不是餐桌闲谈的未来话题。未来已然降临,只是尚未敲开你的家门。

It’s about to.

而敲门声,近在咫尺。

If this resonated with you, share it with someone in your life who should be thinking about this. Most people won’t hear it until it’s too late. You can be the reason someone you care about gets a head start.

若你认同文中观点,不妨转发给身边需要正视这场变革的亲友。多数人总会等到错失时机才幡然醒悟,你的分享,或许能让在乎的人抢占转型先机。

Thank you to Kyle Corbitt, Jason Kuperberg, and Sam Beskind for reviewing early drafts and providing invaluable feedback.

感谢凯尔·科尔比特、杰森·库珀伯格、山姆·贝斯金德审阅文稿初稿并给出宝贵修改建议。

Rererence

- AI是人类文明的断裂点,而未来是如此“明显”

https://mp.weixin.qq.com/s/Z2g1Kqt2Uc9uaMOmkfRhNw - 全体人类请注意,OpenAI创始人最新指示:奇点纪元已经开启!

https://mp.weixin.qq.com/s/FGG6ip2JWmgIKQrWQrn_Ng - 人类正在走下牌桌

https://mp.weixin.qq.com/s/Oj4YmIKKDxs76ajdLZd1wg - Something Big Is Happening — matt shumer 2026

https://shumer.dev/something-big-is-happening

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)