一个月小白变大神!收藏这份AI大模型学习宝典,轻松入门并实践

本文提供了一份为期四周的学习计划,旨在帮助初学者在一个月内快速掌握人工智能大模型的核心知识,并具备实践能力。计划涵盖Transformer架构理论学习、Hugging Face工具使用、模型调用与微调、以及RAG问答系统构建等内容,强调动手实践与开源社区资源的重要性,适合想要提升核心竞争力的技术人员。

学习前提:准备工作

要在一个月内完成目标,你并非需要从零开始。以下是必要的“装备”:

- 熟练的Python编程能力:这是与大模型“对话”的语言。你需要熟悉Python的语法、数据结构、函数、类以及异步编程的基本概念。

- 机器学习基础知识:了解监督学习、无监督学习、损失函数、梯度下降、过拟合与欠拟合等基本概念。无需精通,但需理解其含义。

- 环境与工具:

- Git与GitHub:用于代码版本控制和获取开源项目。

- Jupyter Notebook/VS Code:用于编写和调试代码。

- Google Colab:免费的云端GPU环境,是初期学习和实验的绝佳平台。

- 一颗好奇且能坚持的心:这将是一段高强度的学习旅程。

四周学习计划详情

第一周:奠定理论基石 (Laying the Foundation)

目标:理解大模型的“灵魂”——Transformer架构,并掌握其核心概念。本周以理论学习为主,辅以少量代码验证。

- Day 1-2:宏观认知与核心术语

-

观看 introductory videos on YouTube to get a high-level overview.

-

阅读相关科普文章,理解Token和Embedding的基本原理。

-

学习内容:

-

推荐资源:

- 什么是AI大模型?它的发展简史(从RNN/LSTM到Transformer)。

- 关键术语:Tokenization(分词)、Embeddings(词嵌入)、Context Window(上下文窗口)。

- 了解当前主流模型:GPT系列(OpenAI)、LLaMA系列(Meta)、Gemini(Google)等。

- Day 3-5:深入Transformer核心——注意力机制 (Attention is All You Need)

-

必读:Jay Alammar 的博客文章 《The Illustrated Transformer》,这是最经典、最直观的图解教程。

-

视频:观看Andrej Karpathy的 “Let’s build GPT: from scratch” 视频,跟随时,你会对模型内部的工作方式有深刻理解。

-

学习内容:

-

推荐资源:

- 精读经典论文《Attention Is All You Need》的图解版。这是理解一切的起点。

- 理解Self-Attention(自注意力机制)的计算过程:Query (Q), Key (K), Value (V)。

- 理解Multi-Head Attention(多头注意力机制)的作用。

- 了解Positional Encoding(位置编码)为何对Transformer至关重要。

- 构建Transformer的整体架构图:Encoder-Decoder结构。

- Day 6-7:模型的训练与演进

- 学习内容:

- 任务:用几句话向非技术人员解释清楚ChatGPT是如何“炼”成的。

- 理解预训练(Pre-training)和微调(Fine-tuning)的概念和区别。

- 了解几种关键的微调技术:指令微调(Instruction-Tuning)、基于人类反馈的强化学习(RLHF)。

第二周:工具上手与模型应用 (Tools and Application)

目标:熟练使用业界标准库Hugging Face,并能调用预训练模型完成基本任务。本周是理论到实践的关键过渡。

- Day 8-10:拥抱Hugging Face生态

- 学习内容:

- 探索Hugging Face Hub:一个巨大的模型、数据集和演示中心。

- 掌握Hugging Face的核心库:

transformers,datasets,tokenizers。 - 学习使用

pipeline函数,这是最简单的模型调用方式。

- Day 11-12:手动加载模型与分词器

-

选择一个开源模型(如

meta-llama/Llama-2-7b-chat-hf,需申请权限),在Colab中手动加载它。 -

编写代码,手动对一段文本进行分词、编码,送入模型,然后解码模型的输出,得到生成的文本。

-

学习内容:

-

动手实践:

- 理解

pipeline背后的工作原理。 - 学习使用

AutoModelForCausalLM和AutoTokenizer手动加载模型和对应的分词器。 - 理解模型输入(

input_ids,attention_mask)和输出的格式。

- Day 13-14:探索不同模型的应用

- 学习内容:

- 任务:构建一个简单的函数,输入一段英文,输出其法文翻译和情感倾向(正面/负面)。

- 除了文本生成模型,了解并尝试其他类型的模型,如BERT(用于理解)、T5(用于文本到文本任务)。

- 了解如何在Hugging Face Hub上筛选和选择适合特定任务的模型。

第三周:模型微调与定制 (Fine-Tuning and Customization)

目标:掌握为特定任务微调一个预训练模型的能力,让模型更“懂”你的业务。

- Day 15-17:微调基础与数据准备

-

找一个小的、开源的指令数据集(如

databricks/databricks-dolly-15k)。 -

使用

datasets库加载并预览数据,理解其结构。 -

学习内容:

-

动手实践:

- 理解为什么需要微调,以及全量微调(Full Fine-Tuning)的优缺点(效果好但资源消耗大)。

- 学习数据集的格式化:如何将你的数据转换成模型可以理解的指令格式(例如Alpaca格式)。

- Day 18-21:高效参数微调(PEFT)与LoRA

-

在Google Colab上,选择一个基础模型(如

distilgpt2或Qwen/Qwen1.5-1.8B-Chat)。 -

使用

PEFT库和TrainerAPI,在你准备好的数据集上进行LoRA微调。 -

微调完成后,加载你自己的模型,测试它是否能更好地遵循指令。

-

学习内容:

-

动手实践:

- 学习参数高效微调(Parameter-Efficient Fine-Tuning, PEFT)的概念,了解其为何能极大降低微调成本。

- 重点掌握LoRA(Low-Rank Adaptation)技术,理解其通过引入少量可训练参数来实现微调的原理。

- 学习使用Hugging Face的

PEFT库和TrainerAPI来简化微调过程。

第四周:高级应用与项目实战 (Advanced Applications & Project)

目标:将所学知识融会贯通,构建一个完整的、有价值的AI应用,并了解前沿方向。

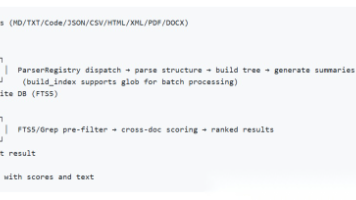

- Day 22-24:构建知识库问答系统(RAG)

-

学习使用一个应用框架,如

LangChain或LlamaIndex。 -

准备几个你自己的文档(如PDF或TXT)。

-

构建一个简单的RAG流程:加载文档 -> 创建向量索引 -> 实现输入一个问题,从文档中找到相关信息并生成答案。

-

学习内容:

-

动手实践:

- 理解大模型“幻觉”问题的局限性。

- 学习**检索增强生成(Retrieval-Augmented Generation, RAG)**的核心思想:让模型能够查询外部知识库后再回答问题。

- 了解RAG的关键组件:文档加载与切分、文本嵌入、向量数据库(Vector Store)、检索器(Retriever)。

- Day 25-26:模型量化与部署初探

- 学习内容:

- 任务:尝试使用

bitsandbytes库以4-bit或8-bit模式加载一个大模型,感受其对显存占用的降低。

- 了解模型量化(Quantization)的概念,知道它如何减小模型体积、提升推理速度。

- 了解将模型部署为API的基本思路(如使用FastAPI)。

- Day 27-30:毕业项目 (Capstone Project)

- 目标:选择一个项目,从头到尾完整实现它。这是检验学习成果的最佳方式。

- 项目建议:

- 要求:项目虽小,五脏俱全。包含数据准备、模型选择/微调、应用逻辑构建和效果展示。

- 个人简历优化助手:微调一个模型,让它能根据职位描述(JD)优化你的简历。

- 个人文档智能问答:构建一个RAG系统,导入你所有的学习笔记,让你可以通过提问来复习。

- 代码解释器:微调一个Code LLM,让它能为你解释复杂的代码片段。

学习心态与建议

- 动手优于空想:代码跑一遍,胜过文章读十遍。遇到不懂的,先动手试。

- 拥抱开源社区:多逛GitHub、Hugging Face社区,看别人是如何解决问题的。

- 从宏观到微观:先理解系统如何工作,再深入探究某个具体算法的数学细节。不要一开始就陷入数学公式的泥潭。

- 善用工具:AI本身就是最好的学习工具。用deepseek来解释你不懂的概念、来帮你写代码。

- 建立反馈循环:将你学到的东西教给别人,或者写成博客,这是巩固知识的最好方法。

遵循这份计划,一个月后,你将不仅仅是AI大模型的旁观者,更将成为一名有能力、有见解的实践者。祝你学习顺利!

最后

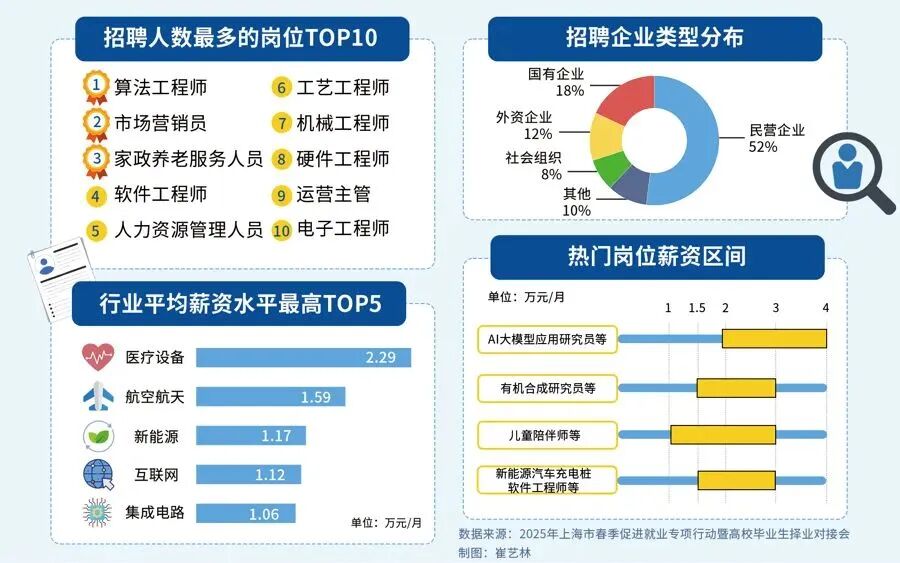

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?

答案只有一个:人工智能(尤其是大模型方向)

当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应聘者,月基础工资也能稳定在4万元左右。

再看阿里、腾讯两大互联网大厂,非“人才计划”的AI相关岗位应聘者,月基础工资也约有3万元,远超其他行业同资历岗位的薪资水平,对于程序员、小白来说,无疑是绝佳的转型和提升赛道。

对于想入局大模型、抢占未来10年行业红利的程序员和小白来说,现在正是最好的学习时机:行业缺口大、大厂需求旺、薪资天花板高,只要找准学习方向,稳步提升技能,就能轻松摆脱“低薪困境”,抓住AI时代的职业机遇。

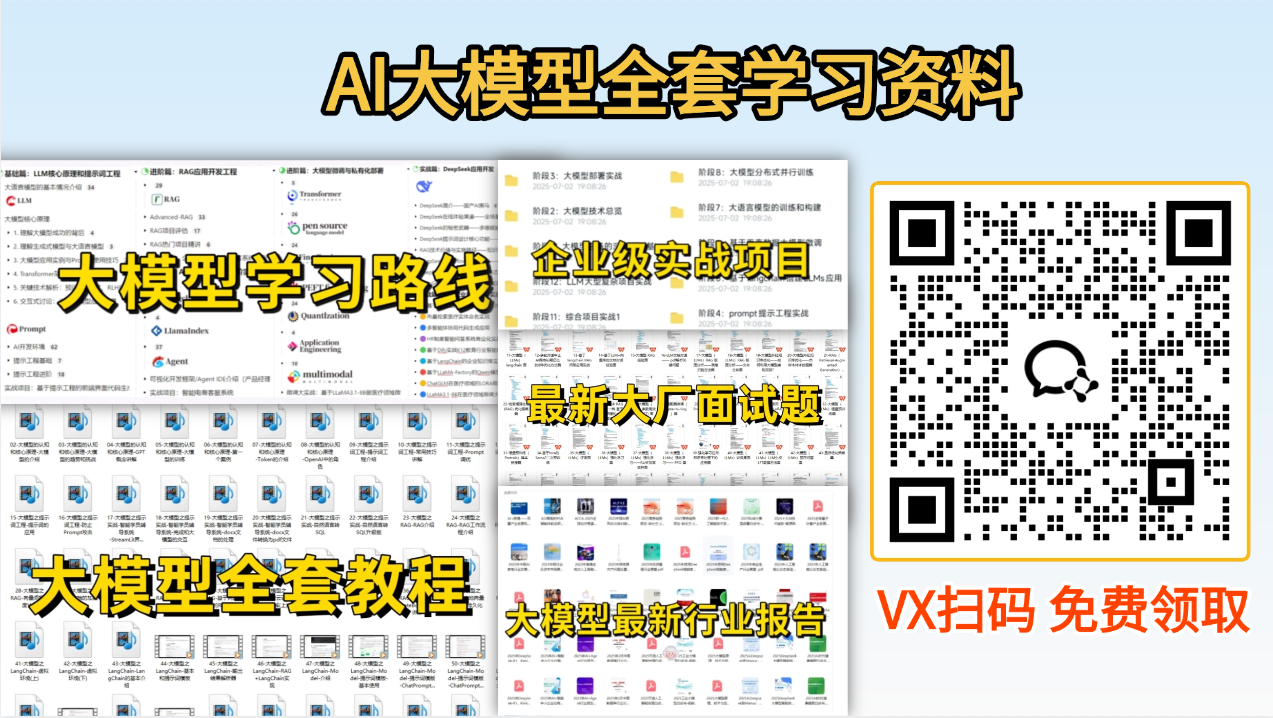

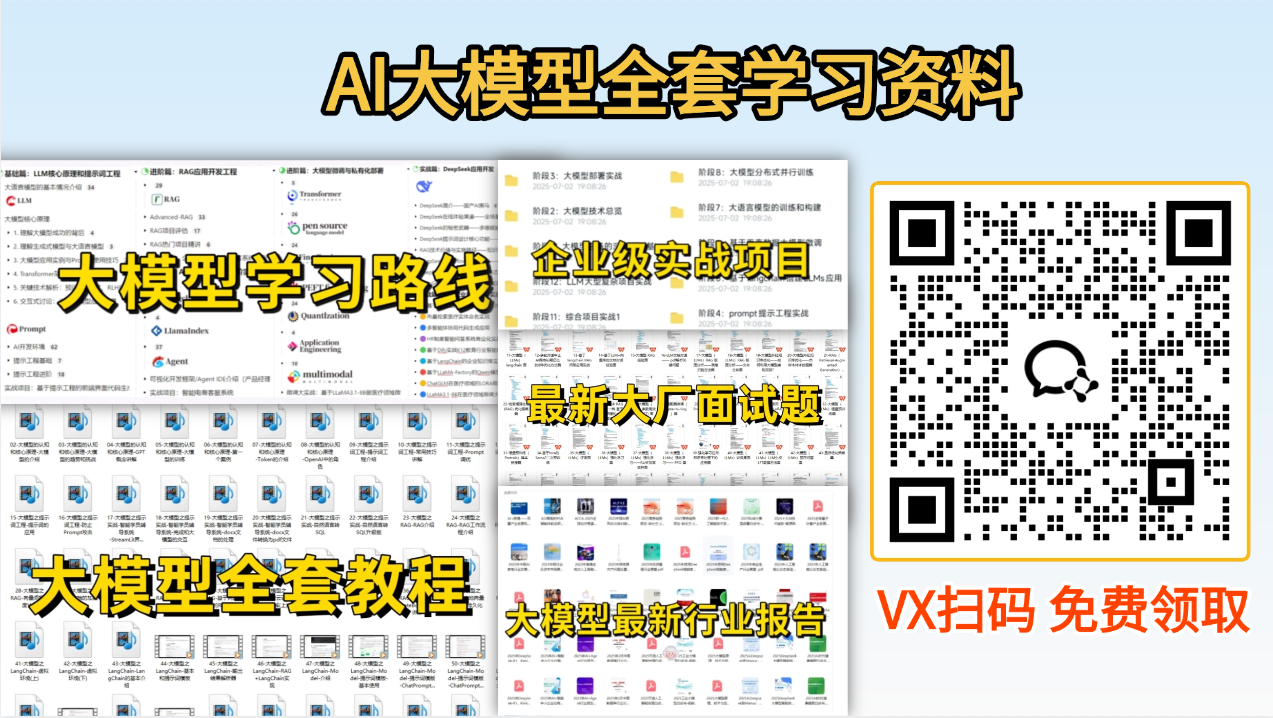

如果你还不知道从何开始,我自己整理一套全网最全最细的大模型零基础教程,我也是一路自学走过来的,很清楚小白前期学习的痛楚,你要是没有方向还没有好的资源,根本学不到东西!

下面是我整理的大模型学习资源,希望能帮到你。

👇👇扫码免费领取全部内容👇👇

1、大模型学习路线

2、从0到进阶大模型学习视频教程

从入门到进阶这里都有,跟着老师学习事半功倍。

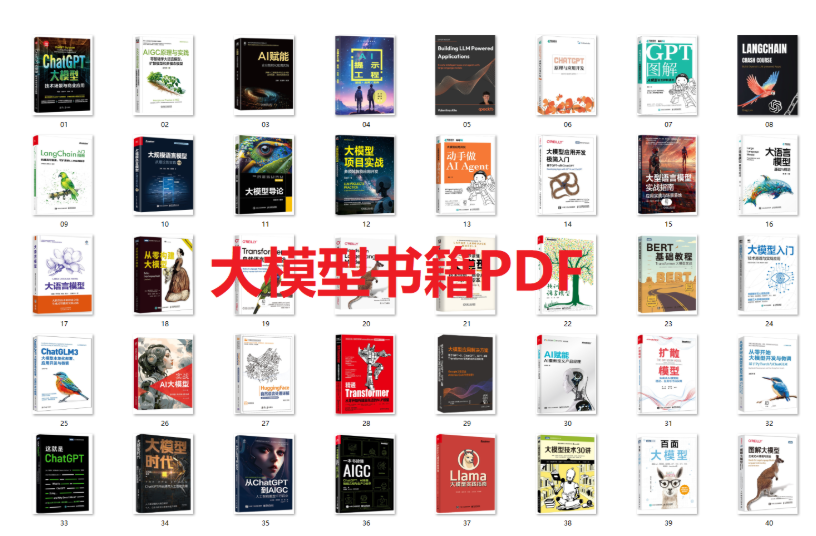

3、 入门必看大模型学习书籍&文档.pdf(书面上的技术书籍确实太多了,这些是我精选出来的,还有很多不在图里)

4、 AI大模型最新行业报告

2026最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

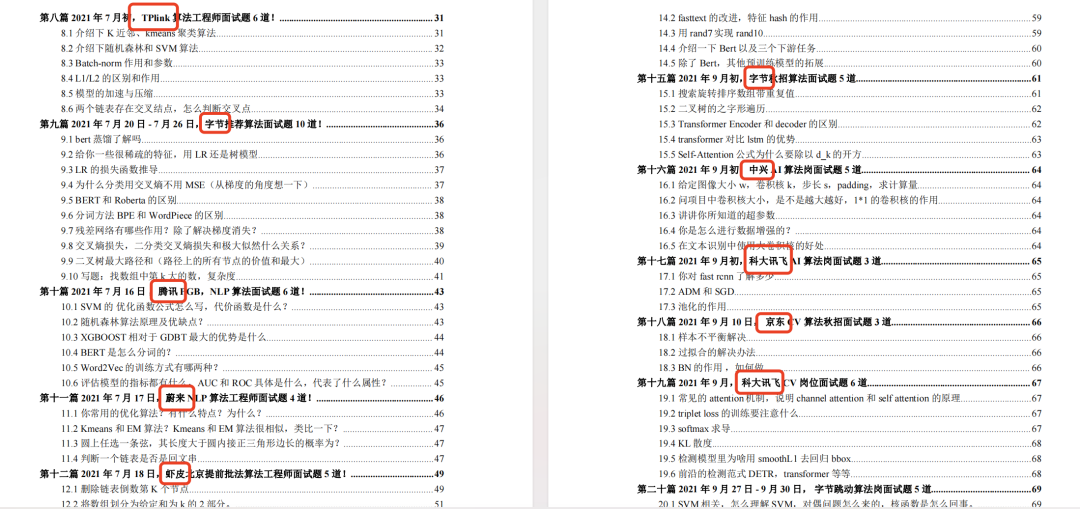

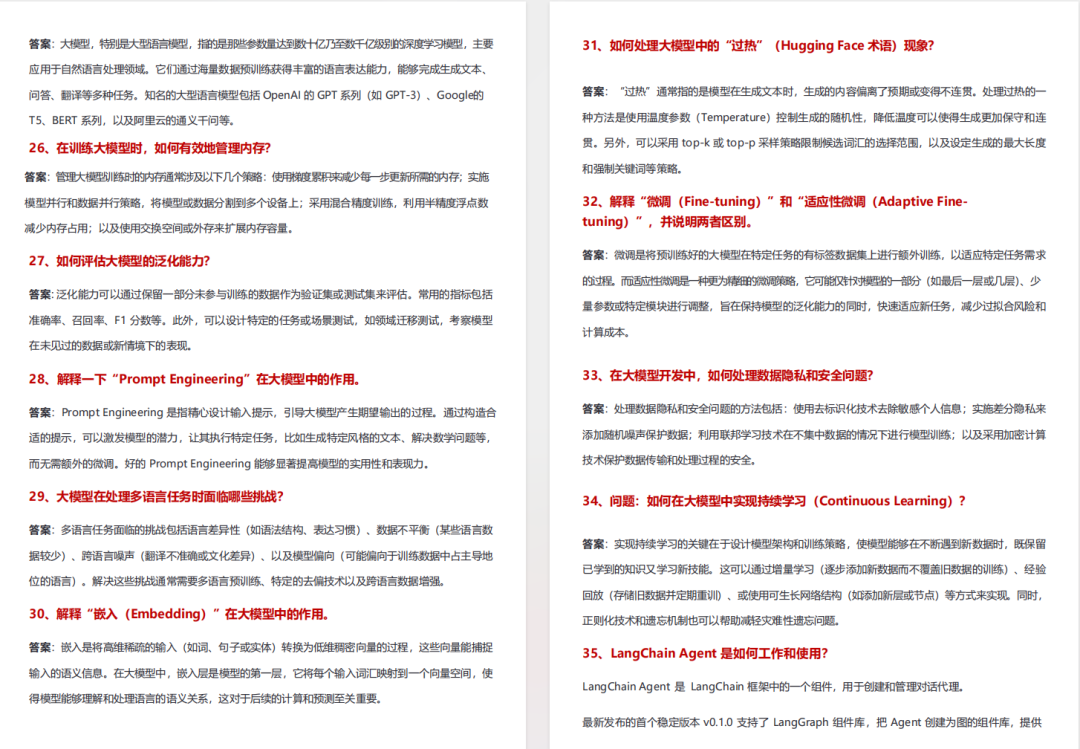

5、面试试题/经验

【大厂 AI 岗位面经分享(107 道)】

【AI 大模型面试真题(102 道)】

【LLMs 面试真题(97 道)】

6、大模型项目实战&配套源码

适用人群

四阶段学习规划(共90天,可落地执行)

第一阶段(10天):初阶应用

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

- 大模型 AI 能干什么?

- 大模型是怎样获得「智能」的?

- 用好 AI 的核心心法

- 大模型应用业务架构

- 大模型应用技术架构

- 代码示例:向 GPT-3.5 灌入新知识

- 提示工程的意义和核心思想

- Prompt 典型构成

- 指令调优方法论

- 思维链和思维树

- Prompt 攻击和防范

- …

第二阶段(30天):高阶应用

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

- 为什么要做 RAG

- 搭建一个简单的 ChatPDF

- 检索的基础概念

- 什么是向量表示(Embeddings)

- 向量数据库与向量检索

- 基于向量检索的 RAG

- 搭建 RAG 系统的扩展知识

- 混合检索与 RAG-Fusion 简介

- 向量模型本地部署

- …

第三阶段(30天):模型训练

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- 为什么要做 RAG

- 什么是模型

- 什么是模型训练

- 求解器 & 损失函数简介

- 小实验2:手写一个简单的神经网络并训练它

- 什么是训练/预训练/微调/轻量化微调

- Transformer结构简介

- 轻量化微调

- 实验数据集的构建

- …

第四阶段(20天):商业闭环

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

-

硬件选型

-

带你了解全球大模型

-

使用国产大模型服务

-

搭建 OpenAI 代理

-

热身:基于阿里云 PAI 部署 Stable Diffusion

-

在本地计算机运行大模型

-

大模型的私有化部署

-

基于 vLLM 部署大模型

-

案例:如何优雅地在阿里云私有部署开源大模型

-

部署一套开源 LLM 项目

-

内容安全

-

互联网信息服务算法备案

-

…

👇👇扫码免费领取全部内容👇👇

3、这些资料真的有用吗?

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献245条内容

已为社区贡献245条内容

所有评论(0)