【大模型 API 落地核心】Token Plan 全解析 + API 设计 / 优化 / 成本管控实战指南

目录

一、写在前面:为什么 Token Plan 是大模型落地的生死线?

3.2 计费方案选型(Billing Model Selection)

四、主流大模型厂商 Token Plan 与 API 能力对比

五、实战落地:Token Plan 与 API 管控全流程代码实现

七、避坑指南:Token Plan 与 API 调用的 10 个高频踩坑点

8.1 短期(2026 下半年):动态智能 Token Plan

一、写在前面:为什么 Token Plan 是大模型落地的生死线?

2026 年,大模型 API 已经成为 AI 应用、Agent 系统、企业数字化的基础设施,但 90% 的开发者和企业都踩过同一个致命的坑:

- 个人开发者:上线一个 AI 小工具,没几天 API 账单超支几百上千,直接关停服务;

- 创业团队:SaaS 产品上线爆火,月底一看大模型账单远超营收,利润被 Token 成本吃光;

- 企业级客户:Agent 系统上线后,因为单会话 Token 超限频繁触发 API 限流,核心业务频繁中断;

- 算法团队:做模型微调,没算准训练 Token 配额,训练任务中途中断,几天的工作白费。

Andrej Karpathy 在 2026 年的 Agentic Engineering 分享中直言:“一个优秀的 Agent 系统,70% 的工程工作不是写 Prompt,而是 Token 的全生命周期管理。” 而这正是Token Plan的核心价值。

很多人对 Token Plan 的理解停留在 “选一个 API 计费套餐”,但本质上,Token Plan 是一套覆盖「配额规划、计费选型、API 运行时管控、成本优化、风险兜底」的全生命周期管理体系,是大模型 API 从 “Demo 能用” 到 “生产稳定” 的核心门槛,也是决定 AI 应用能否盈利的关键。

我之前写过 Agentic Engineering 六大核心能力、Claude Agent 评估模型指南,这篇是大模型工程化的 “成本与稳定性篇”,完整拆解 Token Plan 的底层逻辑、核心模块、API 实战与避坑指南。

二、核心基础:Token 与 API 计费的底层逻辑

2.1 什么是 Token?

Token 是大模型处理文本的最小分词单位,也是所有大模型 API 的计费基础,核心规则:

- 英文:1 Token ≈ 4 个英文字母 / 0.75 个英文单词

- 中文:1 Token ≈ 0.75 个汉字(不同厂商 Tokenizer 略有差异)

- 特殊规则:标点、换行、空格、工具调用参数、系统提示词,全部计入 Token 消耗

举个例子:一句 “帮我生成一份 2026 年 Q2 的销售数据分析报告”,中文共 22 个字,对应约 29 个输入 Token;如果生成 1000 字的报告,对应约 1300 个输出 Token。

2.2 大模型 API 的 5 类 Token 计费项

绝大多数开发者只关注 “输入 + 输出 Token”,但生产环境中,这 5 类 Token 都会计入账单,必须纳入 Token Plan:

表格

| Token 类型 | 定义 | 计费规则 | 高频场景 |

|---|---|---|---|

| 输入 Token(Prompt Token) | 用户发送的提示词、系统指令、上下文历史消耗的 Token | 全量计费,主流厂商 0.1-1.5 元 / 百万 Token | 所有 API 调用场景 |

| 输出 Token(Completion Token) | 大模型生成的回复内容消耗的 Token | 全量计费,价格通常是输入 Token 的 1.5-3 倍 | 所有生成场景 |

| 缓存 Token(Cached Token) | 重复使用的系统提示词、长上下文,开启缓存后的 Token | 折扣计费,主流厂商减免 50%-90% 费用 | 多轮对话、Agent 系统、固定规则的 SaaS 场景 |

| 工具调用 Token | Function Calling 的函数定义、参数、返回结果消耗的 Token | 全量计入输入 Token 计费 | Agent 系统、插件调用场景 |

| 训练 Token | 微调模型时,训练数据集、验证集消耗的 Token | 单独计费,通常是推理 Token 的 2-5 倍 | 模型微调、垂直领域定制场景 |

2.3 主流厂商的 API 计费模型

Token Plan 的核心第一步,是选对适配业务的计费模型,目前主流大模型厂商提供 6 种计费模式,各有适配场景:

表格

| 计费模型 | 核心规则 | 适配场景 | 代表厂商 |

|---|---|---|---|

| 按量后付费 | 按实际消耗的 Token 量实时计费,用多少付多少 | 测试期、小流量项目、波动极大的业务 | 所有厂商均支持 |

| 阶梯计费 | Token 用量越大,单价越低,按自然月用量阶梯结算 | 流量稳定的中大型项目、生产环境 | OpenAI、Claude、豆包 |

| 配额包年包月 | 预付费购买固定 Token 配额,有效期内用完即止,未用完不退款 | 流量可预估的稳定业务、成本锁定需求 | 国内厂商为主(豆包、DeepSeek) |

| 预留容量(PT) | 预付费锁定固定的 Token 吞吐量 / 并发数,保障调用稳定性,超出部分按量计费 | 高并发生产环境、核心业务、企业级客户 | Claude、OpenAI、Azure OpenAI |

| 按次计费 | 按 API 调用次数计费,不单独计算 Token(通常有单请求 Token 上限) | 轻量调用、短文本分类、固定 Prompt 场景 | 部分垂直领域模型厂商 |

| 训练 Token 包 | 预付费购买微调训练专用 Token 配额 | 模型微调、持续训练场景 | 所有支持微调的厂商 |

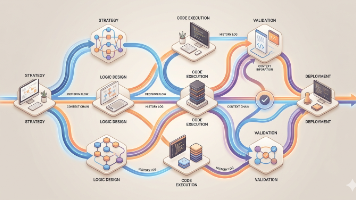

三、Token Plan 五大核心模块(生产级标准)

一个完整的、可落地的生产级 Token Plan,必须包含五大核心模块,覆盖从前期规划到线上运行的全流程,缺一不可。

3.1 配额规划(Quota Planning)

配额规划是 Token Plan 的起点,核心是基于业务场景,精准测算 Token 需求量,提前规划配额与峰值容量,避免 “上线就超支”“峰值被限流”。

核心测算公式(可直接套用)

latex

\text{月度总Token预算} = \text{日活用户数} \times \text{人均日调用次数} \times \text{单次调用平均Token量} \times 30 \times \text{峰值系数}

- 单次调用平均 Token 量 = 平均输入 Token + 平均输出 Token

- 峰值系数:常规业务取 1.2-1.5,节假日 / 活动期业务取 2.0-3.0

落地执行 3 步法

- 基准测试:用真实业务 Prompt 做 100 次以上测试,统计单请求的输入 / 输出 Token 均值、最大值,确定基准值;

- 分场景测算:区分普通用户 / 付费用户、测试环境 / 生产环境、常规调用 / Agent 多轮调用,分别测算配额需求;

- 阶梯预留:基础配额覆盖 80% 的常规流量,弹性配额覆盖 20% 的峰值流量,预留 10% 的应急配额应对突发情况。

3.2 计费方案选型(Billing Model Selection)

选对计费方案,能直接降低 30%+ 的 Token 成本,不同业务阶段 / 场景有明确的选型标准,核心适配规则如下:

表格

| 业务阶段 | 推荐计费方案 | 选型逻辑 | 避坑要点 |

|---|---|---|---|

| 开发测试期 | 按量后付费 | 用量小、波动大,按需付费无浪费 | 不要买包月配额,测试期用量不稳定,大概率用不完 |

| 小流量上线期 | 阶梯计费 + 小额配额包 | 流量逐步上涨,阶梯单价更低,小额配额包锁定基础成本 | 配额包不要买超过 3 个月的,流量变化快,容易浪费 |

| 稳定生产期 | 预留容量 + 阶梯计费 | 预留容量保障核心业务稳定性,超出部分用阶梯计费兜底 | 预留容量不要按峰值满配,按日常均值的 70% 配即可,弹性部分用按量付费 |

| 多租户 SaaS 场景 | 配额包 + 按量后付费 | 预付费配额包降低基础成本,超量部分按量计费,成本分摊给租户 | 必须做租户级配额隔离,避免单个租户耗光全平台配额 |

| 模型微调场景 | 训练 Token 包 | 训练 Token 单独计费,包价比按量付费低 40%+ | 先做小批量测试测算训练 Token 量,再买对应配额包,避免买多浪费 |

3.3 API 运行时 Token 管控

这是 Token Plan 的核心执行环节,也是避免预算超支、业务中断的关键,核心是在 API 调用的全流程,对 Token 消耗做精细化管控,而不是等账单出来才发现问题。

核心管控能力

- 单请求 Token 硬限制:给每个 API 请求设置最大输入 Token 上限、最大输出 Token 上限,避免超长 Prompt / 无限生成导致的 Token 暴增;

- 会话级 Token 预算:给单用户 / 单会话设置 Token 总预算,比如免费用户单会话最多消耗 10000Token,超出后终止会话;

- 用户级配额隔离:多租户场景下,给每个用户 / 租户分配独立的 Token 配额,配额用完后仅限制该用户,不影响全局业务;

- 限流熔断机制:设置单分钟 / 单小时 Token 消耗上限,超出阈值后触发限流,避免异常流量 / 攻击导致的巨额账单;

- 工具调用 Token 管控:Agent 场景下,限制 Function Calling 的调用次数、单次返回结果的 Token 长度,避免工具返回超长内容耗光 Token。

3.4 Token 成本优化体系

Token 成本优化不是 “抠门”,而是用最少的 Token 实现最优的业务效果,行业最佳实践中,优秀的优化体系能降低 50%-90% 的 Token 成本,核心优化手段如下:

表格

| 优化手段 | 实现方法 | 成本降低幅度 | 适配场景 |

|---|---|---|---|

| Prompt Cache 缓存复用 | 固定系统提示词、长上下文规则开启缓存,重复调用仅对新增内容计费 | 50%-90% | 多轮对话、Agent 系统、SaaS 固定规则场景 |

| Prompt 精简压缩 | 去除冗余描述,用结构化指令替代长文本,合并重复规则 | 20%-40% | 所有场景 |

| 模型分级选型 | 简单任务用小模型(如 Claude Haiku、GPT-4o Mini),复杂任务用大模型 | 60%-80% | 分类、摘要、简单问答等轻量场景 |

| 上下文动态截断 | 对话历史按重要性排序,自动截断低价值内容,保留核心上下文 | 30%-50% | 长对话、多轮会话场景 |

| 批处理合并调用 | 多个短文本任务合并为单次 API 调用,减少重复系统提示词消耗 | 20%-30% | 批量分类、批量摘要、离线处理场景 |

| 输出格式约束 | 限制模型输出长度、格式,禁止冗余解释,用 JSON / 结构化输出 | 40%-60% | 接口调用、数据提取、工具调用场景 |

3.5 风险兜底与监控体系

再好的规划,也需要兜底机制应对突发情况,一个完整的 Token Plan 必须包含全链路的监控与风险兜底能力:

- 实时监控看板:实时统计总 Token 消耗、分用户 / 分场景 Token 消耗、API 调用成功率、Token 单价预估,做到 “账单可实时预估”,而不是月底才知道花了多少钱;

- 多维度预算告警:设置日 / 周 / 月度预算阈值,比如当日消耗达到月度预算的 10%、30%、50% 时,通过短信 / 邮件 / 企业微信推送告警,提前干预;

- 超支自动熔断:设置绝对预算红线,当 Token 消耗达到月度预算上限时,自动降级(如切换到小模型)或暂停非核心业务的 API 调用,避免账单无限超支;

- 异常检测:实时识别异常 Token 消耗,比如单用户分钟级消耗超阈值、单次调用 Token 量远超基准值,自动触发拦截与告警,避免攻击 / 代码 bug 导致的巨额损失;

- 账单审计:每日 / 每周生成 Token 消耗审计报告,拆解分场景、分模型、分用户的消耗占比,定位浪费点,持续优化 Token Plan。

四、主流大模型厂商 Token Plan 与 API 能力对比

2026 年主流大模型厂商的 Token Plan 与 API 能力差异极大,选错厂商可能导致成本翻倍、稳定性不足,以下为全维度对比表:

表格

| 厂商 | 核心计费优势 | Token 管控 API 能力 | Prompt Cache 支持 | 企业级特性 | 核心坑点 |

|---|---|---|---|---|---|

| Anthropic Claude | 缓存 Token 折扣最高达 90%,长上下文单价低,预留容量稳定性强 | 支持单请求 Token 限制、配额实时查询、消耗明细 API | 系统提示词 / 长上下文永久缓存 + 临时缓存,自动生效 | 企业级多租户配额管理、细粒度权限控制、账单拆分 | 短文本场景单价高于国内厂商,新用户配额申请门槛高 |

| OpenAI GPT | 阶梯计费档位多,模型覆盖全,生态完善 | 支持组织级 / 项目级配额隔离、实时消耗监控、超支告警 | 分级缓存,折扣 50%-75%,需手动配置 | 预留容量、Azure 企业级合规支持、多项目账单拆分 | 超配额后直接停服,无缓冲期,缓存配置复杂度高 |

| 字节跳动豆包 | 国内厂商中单价最低,包月配额包灵活,中文 Tokenizer 优化好 | 支持用户级配额隔离、流式调用 Token 实时统计、超支熔断 | 支持 Prompt 缓存,折扣 50%,配置简单 | 国内合规资质齐全、多租户 SaaS 适配、专属集群支持 | 长上下文场景单价上涨明显,海外节点覆盖少 |

| DeepSeek | 推理 / 微调单价极低,长文本处理性价比高 | 支持基础配额管控、消耗明细 API | 支持基础缓存,折扣 60% | 开源模型适配、私有化部署支持、定制化计费 | 高并发场景稳定性弱于 Claude/OpenAI,企业级功能少 |

| Meta Llama API | 开源模型免费商用,按量付费单价极低 | 基础配额管控、开源生态适配 | 第三方插件支持缓存 | 私有化部署、无数据留存风险、完全自定义 | 官方 API 服务稳定性弱,企业级支持不足 |

五、实战落地:Token Plan 与 API 管控全流程代码实现

以下为基于 Claude API 的生产级 Token Plan 管控代码,可直接复制运行,覆盖 Token 计算、预算管控、缓存优化、超支告警、熔断机制全环节,代码高亮适配 CSDN 平台。

5.1 环境安装与初始化

bash

运行

# 安装核心依赖

pip install anthropic tiktoken python-dotenv

python

运行

# token_plan_core.py

import os

import time

from dotenv import load_dotenv

from anthropic import Anthropic, AsyncAnthropic

from anthropic.types import MessageParam

import tiktoken

# 加载环境变量

load_dotenv()

API_KEY = os.getenv("ANTHROPIC_API_KEY")

MONTHLY_BUDGET = int(os.getenv("MONTHLY_TOKEN_BUDGET", 100000000)) # 月度Token预算

DAILY_WARNING_THRESHOLD = MONTHLY_BUDGET * 0.03 # 日消耗告警阈值

CUTOFF_THRESHOLD = MONTHLY_BUDGET * 0.9 # 超支熔断阈值

# 初始化Anthropic客户端

client = Anthropic(api_key=API_KEY)

async_client = AsyncAnthropic(api_key=API_KEY)

# 全局Token消耗统计(生产环境建议替换为Redis/数据库持久化)

token_consumption = {

"total_input_tokens": 0,

"total_output_tokens": 0,

"daily_consumption": 0,

"monthly_consumption": 0,

"user_consumption": {}, # 用户级消耗统计

"last_reset_time": time.time()

}

5.2 精准 Token 计算工具函数

python

运行

def count_tokens(text: str, is_chinese: bool = True) -> int:

"""

精准计算文本Token数,适配中英文场景

:param text: 待计算文本

:param is_chinese: 是否为中文为主的文本

:return: Token数量

"""

if not text:

return 0

# Claude官方Tokenizer适配,中文用cl100k_base分词器误差<5%

tokenizer = tiktoken.get_encoding("cl100k_base")

return len(tokenizer.encode(text))

def count_message_tokens(messages: list[MessageParam], system_prompt: str = "") -> int:

"""

计算对话消息的总输入Token数

:param messages: 对话历史消息

:param system_prompt: 系统提示词

:return: 总输入Token数

"""

total_tokens = count_tokens(system_prompt)

for message in messages:

total_tokens += count_tokens(message["content"])

return total_tokens

5.3 会话级 Token 预算管控与 API 封装

python

运行

def claude_chat_with_token_control(

user_id: str,

session_id: str,

messages: list[MessageParam],

system_prompt: str = "",

model: str = "claude-3-5-sonnet-20240620",

max_output_tokens: int = 4096,

session_token_budget: int = 20000, # 单会话Token预算

user_daily_budget: int = 50000 # 单用户日预算

) -> dict:

"""

带Token管控的Claude API封装,核心实现预算控制、超支拦截、消耗统计

"""

# 1. 前置校验:全局熔断检查

if token_consumption["monthly_consumption"] >= CUTOFF_THRESHOLD:

return {

"success": False,

"error": "月度Token预算已达90%,触发熔断机制,非核心业务暂停调用",

"consumption": token_consumption

}

# 2. 计算输入Token,校验预算

input_token_count = count_message_tokens(messages, system_prompt)

# 预估总消耗(输入+最大输出)

estimated_total = input_token_count + max_output_tokens

# 3. 单会话预算校验

user_session_key = f"{user_id}_{session_id}"

session_used = token_consumption["user_consumption"].get(user_session_key, 0)

if session_used + estimated_total > session_token_budget:

return {

"success": False,

"error": f"单会话Token预算不足,已用{session_used},预算{session_token_budget}",

"session_used": session_used

}

# 4. 单用户日预算校验

user_daily_key = f"{user_id}_daily"

user_daily_used = token_consumption["user_consumption"].get(user_daily_key, 0)

if user_daily_used + estimated_total > user_daily_budget:

return {

"success": False,

"error": f"用户日Token预算不足,已用{user_daily_used},预算{user_daily_budget}",

"user_daily_used": user_daily_used

}

# 5. 日消耗告警检查

if token_consumption["daily_consumption"] >= DAILY_WARNING_THRESHOLD:

print(f"【告警】日Token消耗已达阈值,当前消耗:{token_consumption['daily_consumption']}")

# 6. 调用Claude API,开启Prompt Cache

try:

response = client.messages.create(

model=model,

max_tokens=max_output_tokens,

system=system_prompt,

messages=messages,

# 开启Prompt缓存,核心优化手段

extra_headers={"anthropic-prompt-cache": "true"}

)

except Exception as e:

return {

"success": False,

"error": f"API调用失败:{str(e)}"

}

# 7. 统计Token消耗,更新全局数据

actual_input = response.usage.input_tokens

actual_output = response.usage.output_tokens

cache_creation_input = response.usage.cache_creation_input_tokens

cache_read_input = response.usage.cache_read_input_tokens

# 计算实际计费Token(缓存读取部分按10%计费)

billable_input = cache_creation_input + int(cache_read_input * 0.1)

total_billable = billable_input + actual_output

# 更新全局统计

token_consumption["total_input_tokens"] += actual_input

token_consumption["total_output_tokens"] += actual_output

token_consumption["monthly_consumption"] += total_billable

token_consumption["daily_consumption"] += total_billable

token_consumption["user_consumption"][user_session_key] = session_used + total_billable

token_consumption["user_consumption"][user_daily_key] = user_daily_used + total_billable

# 8. 返回结果

return {

"success": True,

"content": response.content[0].text,

"usage": {

"input_tokens": actual_input,

"output_tokens": actual_output,

"cache_creation_tokens": cache_creation_input,

"cache_read_tokens": cache_read_input,

"billable_tokens": total_billable

},

"consumption": token_consumption

}

5.4 超支告警与熔断定时任务

python

运行

import threading

from datetime import datetime

def check_budget_and_alert():

"""

定时检查预算,触发告警与熔断

"""

while True:

# 每日0点重置日消耗

now = datetime.now()

if now.hour == 0 and now.minute == 0:

token_consumption["daily_consumption"] = 0

token_consumption["user_consumption"] = {k: v for k, v in token_consumption["user_consumption"].items() if not k.endswith("_daily")}

print("【重置】日Token消耗已清零")

# 月度预算检查

monthly_used = token_consumption["monthly_consumption"]

if monthly_used >= MONTHLY_BUDGET * 0.5:

print(f"【严重告警】月度Token预算已使用50%,当前消耗:{monthly_used},总预算:{MONTHLY_BUDGET}")

elif monthly_used >= MONTHLY_BUDGET * 0.3:

print(f"【告警】月度Token预算已使用30%,当前消耗:{monthly_used}")

# 每分钟检查一次

time.sleep(60)

# 启动后台告警线程

alert_thread = threading.Thread(target=check_budget_and_alert, daemon=True)

alert_thread.start()

5.5 调用示例

python

运行

# 测试调用

if __name__ == "__main__":

# 系统提示词(开启缓存后,重复调用仅首次计费)

SYSTEM_PROMPT = """

你是一个专业的销售数据分析助手,严格按照以下规则回复:

1. 所有分析结果用结构化JSON格式输出,禁止冗余解释

2. 数据维度必须包含:销售额、同比增长率、环比增长率、TOP3产品

3. 输出内容控制在500字以内

"""

# 对话消息

MESSAGES = [

{

"role": "user",

"content": "帮我分析2026年4月的销售数据,总销售额1200万,3月1000万,2025年4月800万,TOP3产品是A、B、C"

}

]

# 调用带Token管控的API

result = claude_chat_with_token_control(

user_id="user_001",

session_id="session_001",

messages=MESSAGES,

system_prompt=SYSTEM_PROMPT

)

# 打印结果

if result["success"]:

print("生成内容:", result["content"])

print("Token消耗详情:", result["usage"])

else:

print("调用失败:", result["error"])

六、不同业务场景的 Token Plan 最佳实践

6.1 个人开发者 / 小项目

- Token Plan 选型:按量后付费为主,搭配小额月度配额包

- 核心管控:单请求 Token 硬限制,设置月度绝对预算红线,开启超支熔断

- 优化重点:Prompt 精简,小模型优先,开启 Prompt Cache,避免长上下文浪费

- 避坑要点:不要预付费买大额长期配额,测试环境设置独立 API 密钥,限制单 IP 调用频率

6.2 多租户 SaaS 产品

- Token Plan 选型:基础配额包 + 阶梯计费,预留容量保障核心业务

- 核心管控:租户级配额隔离,用户分级配额管理(免费 / 付费用户差异化预算),单租户超支仅限制该租户

- 优化重点:固定系统提示词全量缓存,按任务复杂度分级选型模型,批量任务离线合并调用

- 避坑要点:必须做租户级消耗统计与账单拆分,成本分摊到对应租户;免费用户设置严格的 Token 上限,避免被刷量

6.3 Agent / 多轮对话系统

- Token Plan 选型:预留容量保障并发稳定性,按量付费兜底峰值

- 核心管控:会话级 Token 预算,工具调用次数与返回长度限制,上下文动态截断

- 优化重点:系统提示词永久缓存,对话历史分层管理,工具返回结果精简,非核心信息用摘要替代

- 避坑要点:避免无限循环的工具调用导致 Token 暴增,设置单会话最大轮数,工具调用失败后及时终止

6.4 企业级高并发生产场景

- Token Plan 选型:预留容量为主,阶梯计费兜底,签订年度框架协议锁定单价

- 核心管控:多项目 / 多部门配额隔离,双活容灾 API 配置,精细化权限控制,全链路监控审计

- 优化重点:离线任务与在线业务分离,高低峰弹性配额调整,缓存分层复用,模型混合部署

- 避坑要点:预留容量按日常均值配置,不要满配峰值;设置多厂商 API 容灾,避免单厂商故障导致业务中断

七、避坑指南:Token Plan 与 API 调用的 10 个高频踩坑点

- 只算输入 Token,忽略输出 Token:输出 Token 单价通常是输入的 2-3 倍,很多开发者只预估输入 Token,导致实际账单远超预期;

- Prompt Cache 用错场景:只有重复使用的长上下文适合开启缓存,单次调用的短 Prompt 开启缓存,反而会产生额外的缓存创建 Token 成本;

- 没有做租户隔离:多租户场景下,单个用户的异常调用耗光全平台配额,导致所有用户业务中断;

- 忽略流式输出的 Token 计费:流式输出的 Token 计费规则和同步调用完全一致,很多开发者误以为流式输出更便宜,实则没有任何差异;

- 阶梯计费选错档位:为了低单价买了高用量档位,实际用量没达到,反而比低档位花了更多钱;

- 没有做异常检测:代码 bug 导致无限循环调用 API,一夜之间产生巨额账单,没有熔断机制兜底;

- 系统提示词重复冗余:每次调用都传入完整的长系统提示词,没有开启缓存,导致 90% 的 Token 浪费在重复的固定规则上;

- 忽略工具调用的 Token 消耗:Function Calling 的函数定义、返回结果全部计入输入 Token,长文本工具返回会导致 Token 量暴增;

- 预付费配额买多了:业务流量不及预期,买的年度配额包用不完,到期直接作废,造成资金浪费;

- 没有做容灾备份:单厂商 API 配额用完后,没有备用厂商 API 切换,导致业务直接中断。

八、未来展望:Token Plan 的演进方向

8.1 短期(2026 下半年):动态智能 Token Plan

- AI 驱动的自动配额规划:基于业务历史数据,自动预测 Token 需求量,动态调整计费方案与配额分配;

- 跨厂商 Token 池:统一的 Token 管理平台,支持多厂商 API 的 Token 池共享、成本统一管控、自动路由最优单价厂商;

- 精细化计费粒度:按 Token 的 “价值” 计费,核心内容全价计费,冗余 / 重复内容大幅减免,进一步降低成本。

8.2 中期(2027 年):零信任 Token 管控

- 基于用户行为的动态 Token 配额:根据用户等级、行为、业务价值,动态调整单用户 Token 预算,实现成本与收益的最优匹配;

- Token 安全加密:端到端的 Token 加密管控,避免 Prompt 泄露、Token 盗用,同时精准统计每一个 Token 的使用场景;

- 绿色 Token 计费:根据模型推理的碳排放,差异化定价,低碳推理路径享受更低单价。

8.3 长期(2028+):Token 经济体系

- Token 与业务收益挂钩:API 计费不再按 Token 量,而是按业务产生的价值分成,实现厂商与开发者的利益绑定;

- 跨平台 Token 流通:Token 配额可跨平台、跨厂商流通,形成统一的大模型 Token 经济体系;

- 自治 Token Agent:AI Agent 自主管理 Token 预算、优化调用策略、控制成本,无需人工干预。

🎁 总结速查卡

Token Plan 核心模块速查

| 核心模块 | 核心目标 | 关键动作 |

|---|---|---|

| 配额规划 | 精准测算 Token 需求,避免超支 / 限流 | 基准测试、分场景测算、阶梯预留 |

| 计费选型 | 选对方案,降低基础成本 | 按业务阶段适配计费模型,不盲目买长期配额 |

| 运行时管控 | 实时控制 Token 消耗,避免异常暴增 | 单请求 / 会话 / 用户级预算管控、限流熔断 |

| 成本优化 | 用最少的 Token 实现最优效果 | Prompt Cache、模型分级、Prompt 精简、上下文截断 |

| 监控兜底 | 应对突发情况,避免巨额损失 | 实时监控、多维度告警、超支熔断、异常检测 |

不同场景计费方案选型速查

| 业务场景 | 推荐计费方案 | 核心优化方向 |

|---|---|---|

| 测试期 / 小项目 | 按量后付费 | Prompt 精简、小模型优先 |

| 稳定生产环境 | 预留容量 + 阶梯计费 | 缓存复用、模型分级 |

| 多租户 SaaS | 配额包 + 按量付费 | 租户隔离、成本分摊 |

| Agent 多轮对话 | 按量付费 + 小额配额包 | 会话预算管控、上下文动态截断 |

| 企业级高并发 | 预留容量 + 年度框架 | 多项目隔离、容灾备份 |

高频避坑要点

- 必须同时预估输入 + 输出 Token,预留 30% 的缓冲预算;

- 固定长上下文必须开启 Prompt Cache,最高可省 90% 成本;

- 多租户场景必须做租户级配额隔离,绝对不能共用全局配额;

- 必须设置超支熔断机制,绝对不能无限度按量付费;

- 生产环境必须配置双厂商 API 容灾,避免单厂商配额耗尽导致业务中断。

系列文章:

参考链接:

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献122条内容

已为社区贡献122条内容

所有评论(0)