本地部署 AI 大模型保姆级教程:Ollama 安装、模型下载与终端实战全流程

随着 AI 大模型技术的快速普及,越来越多开发者和普通用户希望拥有本地可运行、无网络依赖、隐私安全的 AI 对话能力。然而,传统大模型部署往往面临环境配置复杂、显存要求高、依赖安装繁琐等痛点,让很多新手望而却步。

Ollama 的出现彻底解决了这一难题,它是一款专为本地运行大模型设计的开源工具,支持一键安装、一键拉取模型,无需复杂配置,即可在 Windows、Linux、macOS 系统上运行主流开源大模型(如 Qwen、Llama、Mistral 等)。本文将结合实战截图,从环境准备、Ollama 安装、模型拉取、终端交互到进阶应用,完整讲解 Ollama 的使用全流程,带你零门槛实现本地 AI 大模型部署。

一、Ollama 是什么?为什么选择它?

1.1 Ollama 的核心定位

Ollama 是一个开源的大模型本地运行工具,核心目标是简化大模型部署流程,让用户在本地设备上快速运行、管理和交互开源大模型。它封装了模型下载、环境配置、硬件加速、推理优化等复杂流程,用户只需通过简单的终端命令,即可完成大模型的安装与运行。

1.2 Ollama 的核心优势

| 优势 | 说明 |

|---|---|

| 零门槛安装 | 支持 Windows/macOS/Linux 一键安装,无需手动配置 Python、PyTorch 等环境 |

| 一键拉取模型 | 内置模型库,一条命令即可下载并配置好 Qwen、Llama、Phi 等主流模型 |

| 硬件自动优化 | 自动识别设备配置,优先使用 GPU 加速推理,无 GPU 时也可在 CPU 上运行 |

| 轻量高效 | 对模型进行了量化优化,低配置设备也能流畅运行轻量级模型(如 1.5B 参数) |

| 隐私安全 | 所有对话与数据均在本地处理,无需上传云端,保护数据隐私 |

| 多场景支持 | 支持终端交互、API 调用、二次开发,可快速集成到自己的项目中 |

1.3 适用场景

- 学习大模型交互,不想依赖在线 AI 工具

- 本地开发、测试 AI 应用,需要稳定的模型服务

- 隐私敏感场景,不希望对话数据上传云端

- 低配置电脑体验本地大模型,无需昂贵 GPU

二、环境准备:你的设备能跑 Ollama 吗?

Ollama 对设备的硬件要求非常友好,轻量级模型(如 1.5B 参数)在普通笔记本上即可流畅运行,具体配置要求如下:

2.1 硬件配置要求

| 模型参数规模 | 最低配置(CPU 运行) | 推荐配置(GPU 加速) |

|---|---|---|

| 1.5B(如 Qwen2.5:1.5b) | 4GB 内存,2 核 CPU | 8GB 内存,NVIDIA 显卡(2GB 显存) |

| 7B(如 Llama3:7b) | 8GB 内存,4 核 CPU | 16GB 内存,NVIDIA 显卡(4GB 显存) |

| 13B(如 Qwen2:13b) | 16GB 内存,8 核 CPU | 16GB 内存,NVIDIA 显卡(8GB 显存) |

我使用的是qwen2.5:1.5b模型,该模型仅需约 1GB 显存 / 4GB 内存即可运行,普通 Windows 笔记本完全无压力。

2.2 系统与软件要求

- 系统:Windows 10/11、macOS 12+、Linux(Ubuntu 20.04 + 等主流发行版)

- 额外:Windows 用户无需额外安装依赖,Ollama 安装包已内置所有运行环境;Linux 用户需确保

curl工具可用

三、Ollama 安装全流程(Windows 为例)

下面以 Windows 系统为例,一步步讲解 Ollama 的安装过程,Linux 和 macOS 用户可参考对应步骤。

3.1 下载 Ollama 安装包

- 访问 Ollama 官方网站:https://ollama.com/

- 点击首页的 “Download for Windows” 按钮,下载 Windows 版本的安装包(

.exe格式) - 下载完成后,双击运行安装包,按照向导完成安装(默认安装路径即可,无需修改)

3.2 验证安装是否成功

安装完成后,打开 Windows 终端(CMD 或 PowerShell),输入以下命令:

ollama --version

如果终端输出类似ollama version 0.1.38的版本信息,说明安装成功。

四、核心操作:Ollama 中下载并运行 AI 模型

Ollama 的核心操作围绕模型管理展开,下面以你截图中的qwen2.5:1.5b模型为例,讲解模型拉取、运行、管理的完整流程。

4.1 查看 Ollama 支持的模型

Ollama 官方模型库提供了上百款开源大模型,涵盖对话、代码、多模态等场景,可在官网查看完整模型列表:https://ollama.com/library常用热门模型包括:

- 通义千问系列:

qwen2.5:1.5b、qwen2.5:7b、qwen2:14b(阿里开源,中文优化优秀) - Llama 系列:

llama3:8b、llama3:70b(Meta 开源,生态完善) - Mistral 系列:

mistral:7b、mixtral:8x7b(轻量高效,推理速度快) - 代码专用:

codellama:7b、deepseek-coder:6.7b(编程场景优化)

4.2 拉取模型(两种方式)

直接运行模型命令(自动拉取)

这是最便捷的方式,直接在终端输入ollama run 模型名,Ollama 会自动检测本地是否存在该模型,不存在则自动拉取。以qwen2.5:1.5b为例,输入命令:

使用ollama list命令,即可查看本地所有已下载的模型:

ollama list

ollama run qwen2.5:1.5b

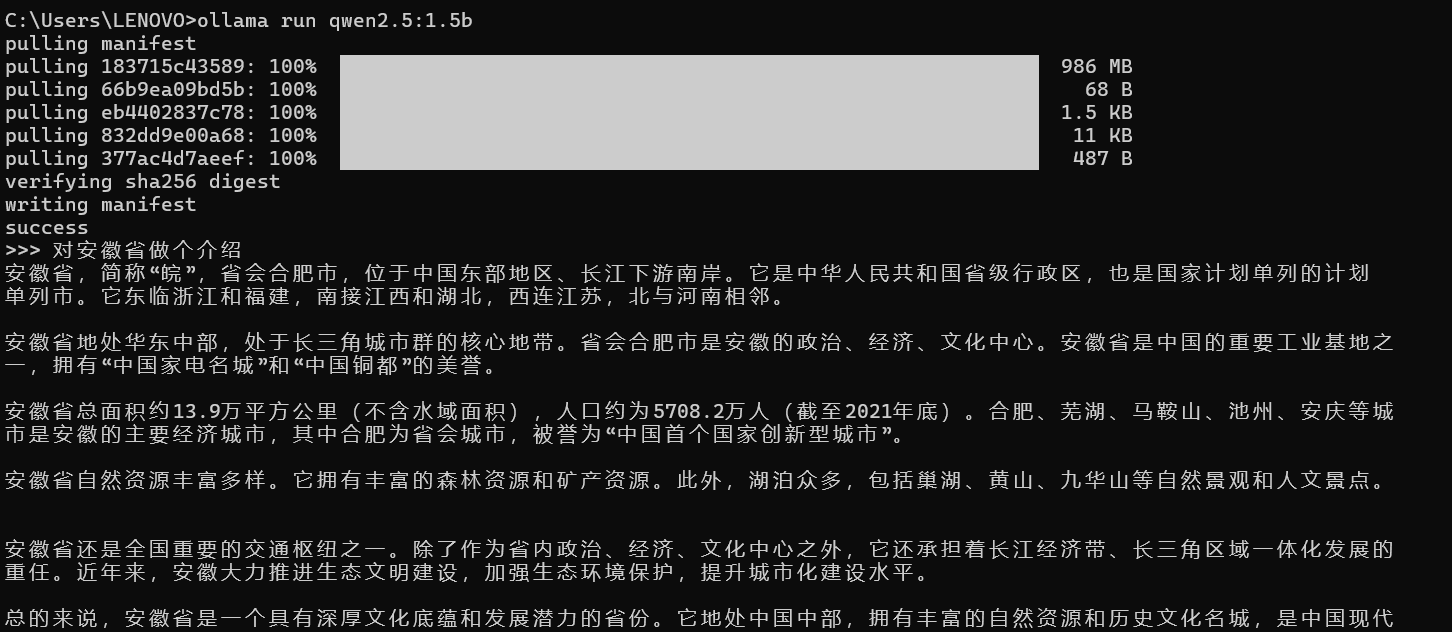

终端会显示拉取进度,截图中所示:

等待进度达到 100%,模型验证完成后,会出现success提示,代表模型下载成功。

并且可以问它问题了,例如:

4.3 模型管理常用命令

| 命令 | 作用 |

|---|---|

ollama list |

查看本地已下载的所有模型 |

ollama pull 模型名 |

下载指定模型 |

ollama run 模型名 |

下载并进入模型交互模式 |

ollama rm 模型名 |

删除本地已下载的模型(释放磁盘空间) |

ollama ps |

查看当前正在运行的模型进程 |

ollama info 模型名 |

查看模型的详细信息(大小、参数、配置等) |

五、总结与展望

Ollama 凭借其零门槛、轻量化、高效率的特点,彻底降低了本地大模型部署的门槛,让普通用户也能轻松拥有属于自己的 AI 助手。从安装、拉取模型到终端交互,再到 API 调用与二次开发,本文完整覆盖了 Ollama 的核心使用流程,结合实战截图,手把手带你实现本地 AI 大模型的部署与使用。

从技术趋势来看,开源大模型的轻量化、易用化是必然方向,Ollama 这类工具的出现,让大模型不再局限于专业开发者,而是走向了普通用户的桌面。无论是学习大模型交互、保护数据隐私,还是开发本地 AI 应用,Ollama 都是一款不可多得的利器。

未来,随着开源模型的不断迭代,Ollama 也会持续优化,支持更多模型、更多平台,为用户提供更流畅的本地 AI 体验。希望本文能帮助你顺利开启本地大模型之旅,探索 AI 的更多可能性。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)