OpenClaw如何助力企业构建AI应用

当前行业发展面临诸多挑战,许多企业在AI落地方面存在焦虑。AI技术如此火热,究竟应该如何有效应用?作为一名自2008年起从事软件开发与技术管理工作的技术从业者,我经历了从单体架构到微服务、从传统开发到敏捷转型的完整过程。近两年,我主导了企业AI转型的推行工作,构建AI应用底座,助力多部门实现AI赋能。本文将结合实践经验,探讨OpenClaw这一开源AI智能体框架如何帮助企业构建安全、可控、可观测的AI应用。

系列文章导读:

2. 为什么你的系统总是变成“屎山“?——业务架构缺失的代价

3. 如何画出一张真正能落地的业务架构图?——六要素实战指南

一、企业AI落地的核心痛点

在推进企业AI转型的过程中,我观察到几个普遍存在的痛点。首先是模型选择困难——市场上存在大量AI模型,GPT、DeepSeek、千问、文心一言、Claude等,每个模型都有不同的技术特点,企业难以确定应该采用哪种方案。其次是数据分散问题——企业数据分散在ERP、CRM、OA等多个业务系统中,知识资源更是分散在各个部门和员工的个人设备中。

再一个就是安全合规担忧。AI应用涉及敏感数据处理,如何在利用AI能力的同时确保数据安全、内容合规、操作可追溯,是企业技术决策者必须面对的问题。最后是可观测性缺失——AI系统的决策过程往往是"黑盒",当出现问题时,难以快速定位根因,这对于生产环境的应用来说是不可接受的。

基于这些痛点,企业需要的并非单一的"AI工具",而是一个完整的"底座"系统——能够将模型、数据、知识、工具进行有效整合,使企业能够快速构建符合自身需求的AI应用。

二、OpenClaw的三层架构设计

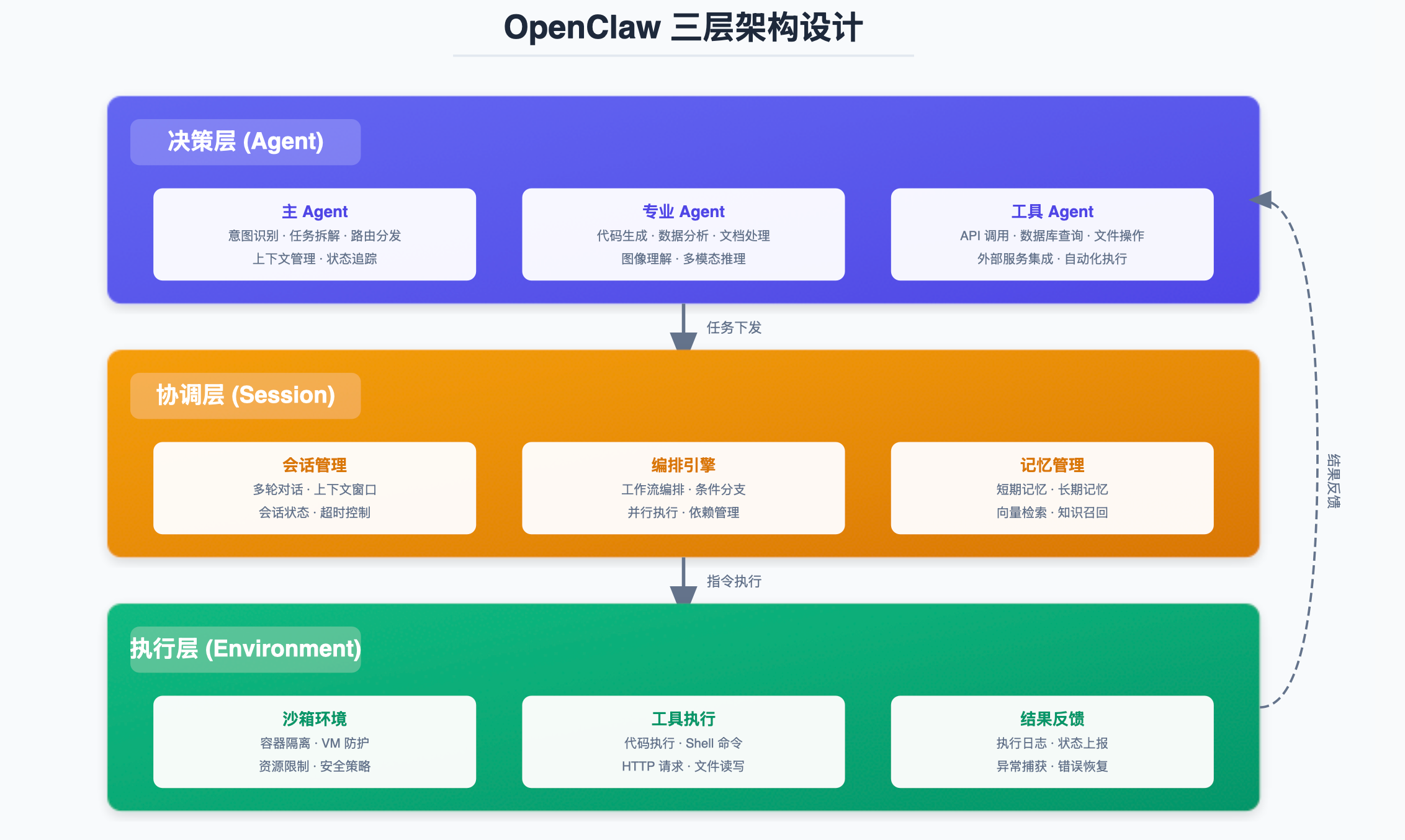

OpenClaw作为一个开源AI智能体框架,其架构设计体现了对enterprise-grade(企业级)需求的深刻理解。它采用三层架构设计——决策层(Agent)、协调层(Session)、执行(Environment),每一层都有明确的职责定位,层层递进,形成完整的技术体系。

图1:OpenClaw三层架构设计——决策层、协调层、执行层各司其职

2.1 决策层(Agent):智能中枢

决策层是整个系统的"大脑",负责意图识别、任务拆解和路由分发。在实际应用中,这一层通常包含三种类型的Agent:主Agent负责接收用户请求,理解意图,并将复杂任务拆解为可执行的子任务;专业Agent针对特定领域(如代码生成、数据分析、文档处理)提供专业化能力;工具Agent则负责与外部系统交互,执行API调用、数据库查询等具体操作。

在这个过程中,上下文管理是关键。Agent需要维护对话历史、用户偏好、任务状态等信息,确保在多轮交互中保持一致性。OpenClaw通过向量检索和知识召回机制,使Agent能够访问企业知识库,提供更准确的响应。

2.2 协调层(Session):流程编排

协调层承担着会话管理、工作流编排和记忆管理的职责。多轮对话的上下文窗口管理、会话状态追踪、超时控制等功能,都在这层实现。编排引擎支持工作流的可视化编排,包括条件分支、并行执行、依赖管理等复杂场景。

记忆管理是协调层的核心能力之一。短期记忆用于维护当前会话的上下文,长期记忆则通过向量数据库实现知识的持久化存储。这种设计使得Agent能够"记住"历史交互,在后续对话中提供更个性化的服务。

2.3 执行层(Environment):安全执行

执行层是AI指令的实际执行环境,包含沙箱隔离、工具执行和结果反馈三个核心模块。沙箱环境通过容器隔离和VM防护,确保AI执行的操作不会对生产环境造成影响。工具执行模块支持代码执行、Shell命令、HTTP请求、文件读写等多种操作类型。结果反馈模块则负责收集执行日志、上报状态、捕获异常并实现错误恢复。

三、三道安全墙:纵深防御体系

在企业环境中,安全是AI应用落地的首要考量。OpenClaw设计了"三道安全墙"防护体系——身份墙、内容墙、执行墙,层层拦截,构建纵深防御。

图2:三道安全墙防护体系——身份墙、内容墙、执行墙层层拦截

3.1 第一道:身份墙(Identity Wall)

身份墙是安全防护的第一道防线,负责验证"谁在访问"。它包含身份认证、权限校验、租户隔离和会话管理四个核心模块。身份认证支持OAuth2、JWT等标准协议,并结合多因素认证(MFA)提升安全性。权限校验基于RBAC模型,实现细粒度的访问控制。租户隔离确保多租户环境下的数据隔离,每个租户的API Key绑定到特定租户,避免数据泄露。会话管理则负责Token有效期控制和异常登录检测。

3.2 第二道:内容墙(Content Wall)

内容墙关注"访问什么",负责输入输出的内容审核。输入过滤模块检测Prompt注入攻击,过滤敏感词汇;输出审核模块对AI生成的内容进行合规性检查,确保输出符合企业规范。数据脱敏模块自动识别PII(个人身份信息)并进行脱敏处理。上下文隔离模块确保会话上下文在不同租户之间完全隔离,避免跨租户数据泄露。

3.3 第三道:执行墙(Execution Wall)

执行墙是最后一道防线,控制"如何执行"。沙箱隔离通过容器级隔离和VM虚拟机防护,确保AI执行的操作在安全环境中进行。权限最小化遵循最小权限原则,采用白名单机制限制可执行的操作类型。资源限制模块对CPU、内存、网络访问进行严格控制,防止资源耗尽攻击。操作审计模块记录全量操作日志,对异常行为进行实时告警。

这三道墙形成纵深防御策略:身份认证 → 内容审核 → 执行隔离,三层联动,任何一层拦截失败都不会影响整体安全性。多层防护确保零信任架构在企业环境中真正落地。

四、执行层安全沙箱:VM + 容器双重防护

执行层的安全沙箱是OpenClaw架构中的关键组件。它采用VM(虚拟机)+ 容器(Docker)的双重防护设计,确保AI执行环境的安全隔离。

图3:执行层安全沙箱架构——VM提供硬件级隔离,容器提供轻量级进程级隔离

4.1 第一层:虚拟机隔离

VM层提供硬件级的资源隔离边界。每个VM拥有独立的操作系统内核,避免内核级漏洞的横向传播。虚拟网络(VPC)隔离配合安全组策略,实现南北向和东西向流量的精细管控。CPU、内存、磁盘的硬限制防止资源耗尽攻击,I/O带宽限制确保系统稳定性。VM快照功能支持快速回滚,当检测到异常状态时,可以自动恢复到干净环境。

4.2 第二层:容器隔离

在VM内部,通过Docker容器实现轻量级的进程级隔离。每个Agent执行在独立的容器中,拥有隔离的运行时环境(如Python 3.11、Node.js 20、Java 17等)。容器采用只读根文件系统,禁用特权模式,并通过seccomp系统调用过滤、AppArmor安全策略、Capabilities裁剪等机制强化安全。每个容器的CPU和内存资源都有明确配额,防止单个Agent占用过多资源。

双重防护的设计理念是:VM提供强隔离边界,容器提供灵活的资源调度。两者结合,既保证了安全性,又兼顾了执行效率。在实际应用中,这种设计能够有效防止AI生成的恶意代码对生产环境造成影响。

五、端到端可观测性:Trace链路追踪

AI系统的可观测性是生产环境应用的必备能力。OpenClaw通过端到端的Trace链路追踪,实现全链路的可观测性,使问题能够快速定位。

图4:端到端可观测性Trace链路——从用户请求到结果返回的全链路追踪

5.1 Trace ID贯穿全链路

每个用户请求都会生成唯一的Trace ID,贯穿整个处理流程。从API Gateway接收请求,到Agent进行意图识别,再到工具调用和沙箱执行,最后结果返回给用户,每个环节都会记录对应的Span信息。Span包含时间戳、组件位置、执行状态、Span ID等关键信息,形成完整的调用链。

5.2 三大数据采集维度

可观测性数据采集涵盖三个维度:Metrics(指标)、Traces(链路)、Logs(日志)。Metrics关注系统性能指标,包括请求延迟(P50/P95/P99)、Token消耗统计、API调用成功率、沙箱资源使用率、并发会话数、错误率告警等。Traces提供完整的调用链追踪,支持Span依赖关系分析、耗时热点分析、异常链路标记、服务拓扑图生成。Logs记录结构化日志,与Trace ID关联,包含Agent决策日志、工具调用参数、沙箱执行输出、安全审计日志等详细信息。

这种设计使得运维团队能够快速定位问题根因。当某个请求出现异常时,通过Trace ID可以追溯到完整的处理流程,查看每个环节的输入输出、耗时、状态等信息,大幅缩短故障排查时间。

六、多Agent协同:专业分工与编排

在企业实际应用中,单一Agent往往无法满足复杂业务需求。OpenClaw支持多Agent协同架构,通过专业分工和编排引擎,实现复杂任务的高效处理。

图5:多Agent协同架构——编排Agent统筹,专业Agent分工协作

6.1 专业Agent分工

系统支持多种专业Agent:代码开发Agent负责代码生成与补全、Bug修复与优化、单元测试生成、代码审查建议;数据分析Agent支持SQL查询生成、数据可视化、趋势预测分析、异常数据检测;文档处理Agent处理技术文档生成、API文档维护、会议纪要整理、多语言翻译;运维监控Agent负责日志分析诊断、故障根因分析、性能优化建议、自动告警处理。

6.2 协同工作流程

以一个典型的需求到部署流程为例:文档Agent首先解析PRD(产品需求文档),提取功能需求点,生成技术方案初稿;代码Agent接收需求,生成核心业务代码并编写单元测试用例;代码Agent进行自检,运维Agent进行性能评估,生成审查报告;最后运维Agent执行部署,实时监控指标,异常时自动回滚。整个过程由编排Agent统筹协调,确保各环节顺畅衔接。

多租户隔离是多Agent协同的重要保障。每个租户拥有独立的Agent实例和资源配置,避免租户之间的相互影响。这种设计使得平台能够同时服务多个企业客户,保证服务质量和数据安全。

七、多层级组织架构与分级权限管理

在面向企业的AI应用构建过程中,一个容易被忽视但至关重要的问题是:企业内部的AI应用并非"一刀切"的单一形态。不同层级、不同团队对AI的需求差异巨大——公司层面关注战略决策与跨部门协同,部门层面聚焦专业领域的效率提升,项目组层面需要围绕具体交付物进行协作,而个人层面则追求日常工作的智能化辅助。

因此,面向企业的OpenClaw,首先应该具备支持分级构建的能力——面向全公司、部门、项目组(或兴趣组)、个人提供不同层级范围的服务。不同层级拥有不同的知识库、系统接入和工作流定义,层级之间既有明确的边界,又存在合理的共享与继承关系。

图6:多层级组织架构与分级权限管理——四级组织层级,五大核心特征

7.1 四级组织层级设计

企业内部的AI应用天然存在四个层级的需求。公司级关注全局性的制度规范、战略文档和跨部门流程(如审批、报销、入职等),需要接入ERP、OA、财务系统等公司级系统。部门级聚焦本部门的专业领域,如研发部门的技术方案、培训材料,需要对接Jira、Confluence、GitLab等部门级工具链。项目组级围绕具体交付目标,涉及需求文档、WBS(工作分解结构)、会议纪要等项目资产,同时需要整合采购、合同、人力等多个关联系统的数据。个人级则面向日常工作辅助,包含个人知识库、常用工具集和快捷操作流。

图7:四级组织层级设计——逐级嵌套,上层可调度下层,下层不可越级访问上层

这四个层级并非孤立存在,而是形成逐级嵌套的关系。上层可以访问下层的资源——公司级沙箱可以调度部门级的Agent,部门级可以调用项目组的工作流。但下层不可越级访问上层,确保数据安全和权限边界清晰可控。

7.2 知识库分级与共享

知识库是AI应用的核心资产。在企业场景中,知识库同样需要分级管理。公司级知识库存储制度规范与战略文档,部门级知识库存放技术方案与培训材料,项目级知识库管理需求文档与会议纪要,个人级知识库则是个人的工作笔记与经验沉淀。

图8:知识库分级与共享机制——四级知识库体系,组内共享,组间隔离,个人多库访问

共享机制的设计原则是"组内共享、组间隔离"。同一个项目组内的成员,可以自由访问该组的项目知识库、系统数据和工作流,实现高效协同。但不同项目组之间的数据严格隔离——项目组A的成员无法访问项目组B的知识库和数据。同时,一个人可以同时访问和管理多个不同层级的知识库,例如一位研发工程师可能同时拥有公司知识库的只读权限、部门知识库的读写权限、所在项目知识库的完整管理权限,以及个人知识库的完全控制权。

7.3 数据隔离与共享机制

数据隔离与共享是分级权限管理的核心。隔离解决的是"哪些数据不能被看到"的问题——不同层级组之间的数据需要严格隔离,确保敏感信息不会横向泄露。共享解决的是"哪些数据需要被协作使用"的问题——同一组内的成员需要共享该组的系统数据、知识库和工作流,才能实现真正的协同效应。

图9:数据隔离与共享机制——组间严格隔离,组内自由共享,多系统数据整合

以项目组为例,一个典型的项目组可能涉及多个外部系统的数据:采购系统的供应商和物料信息、人力系统的团队成员和工时数据、合同系统的条款和付款节点、以及项目本身的WBS和进度数据。这些数据在项目组内需要被共享,但不应被其他项目组访问。这种"组内透明、组间隔离"的机制,是企业在安全与效率之间取得平衡的关键。

7.4 灵活权限管理与配置管理员角色

要实现上述分级管理,灵活的权限管控能力是基础。系统需要支持细粒度的RBAC(基于角色的访问控制)模型,能够精确控制:谁可以修改哪些数据、谁只能读取哪些数据、谁可以操作工作流中的特定节点、谁可以接入或断开某个外部系统。

图10:灵活权限管理与配置管理员角色——细粒度RBAC模型,配置管理员统一管控

权限的设定不应由每个用户自行决定,而应由专人——配置管理员——统一管理和维护。每个层级组设置专属的配置管理员,负责该组的权限分配、知识库维护、工作流节点授权和系统接入管理。这种集中式的权限管控模式,确保了安全策略的一致性和可审计性。当发生权限变更时,完整的审计日志可以追溯每一次授权的来源和依据。

7.5 企业级OpenClaw应具备的核心特征

基于以上分析,可以推导出企业级OpenClaw需要具备以下五个核心特征:

图11:企业级OpenClaw五大核心特征——相互关联,层层递进,缺一不可

这五个特征相互关联、层层递进:多层级沙箱提供了执行环境的物理边界,知识库分级解决了知识资产的归属与共享问题,数据隔离共享机制在安全与效率之间建立了平衡,灵活权限为这一切提供了技术实现手段,而配置管理员角色则确保了整个体系的持续运转和合规审计。只有同时具备这五个特征,OpenClaw才能真正成为面向企业的AI应用底座,而非仅仅是一个"个人效率工具"。

八、实践建议与思考

基于在企业推行AI应用落地的实践经验,我总结了几点建议,供技术决策者参考。

首先,从小场景切入,快速验证价值。不要一开始就追求大而全的方案,而是选择1-2个高频、高价值的场景进行验证,快速证明AI应用的可行性。在这个过程中,重点关注用户反馈,持续优化体验。

其次,安全合规是底线。在AI应用的设计阶段,就应该将安全合规纳入考量,而不是事后补救。三道安全墙的设计思路值得借鉴,通过身份认证、内容审核、执行隔离的多层防护,构建纵深防御体系。

再一个就是可观测性必须前置。AI系统的决策过程往往是"黑盒",如果没有完善的可观测性设计,当出现问题时将难以定位。Trace链路追踪、Metrics指标监控、Logs日志记录,这三者缺一不可。

最后,组织架构和团队能力同样重要。AI应用的落地不仅仅是技术问题,还涉及组织架构调整、团队能力提升、工作流程变革等多个方面。技术团队需要与业务团队紧密协作,共同推进AI转型。

欢迎留言你的实践经验和心得,一起助力加速中国AI企业实际应用!

关于作者

80后理工男,自2008年起从事软件开发与技术管理工作,现任某物联网科技公司技术总监。持有软考系统架构设计师、软考高级项目管理师、PMP认证,参与编制多项国家标准。

近18年的技术生涯中,经历了从高级开发工程师到技术总监的完整蜕变,主导过多个从0到1的产品构建,包括无代码/低代码平台、IoT能力平台、智能装备物联网云平台等。近两年专注于企业AI转型推行,构建企业化AI应用底座,助力多部门实现AI赋能。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)