OpenClaw 连接 Ollama 完整图文教程

OpenClaw 连接 Ollama 图文教程

前置准备

-

已安装并可以正常打开

OpenClaw Windows。 -

OpenClaw 顶部

Gateway状态保持在线。 -

电脑已联网,可正常访问 Ollama 官网。

-

电脑磁盘空间充足,因为本地模型通常会占用较大空间。

-

建议提前确认自己准备下载的模型名称,例如

gemma4:e4b。 -

open claw部署包:https://xiake.yun/api/download/package/12?promoCode=IVD643FDE29A

图文步骤

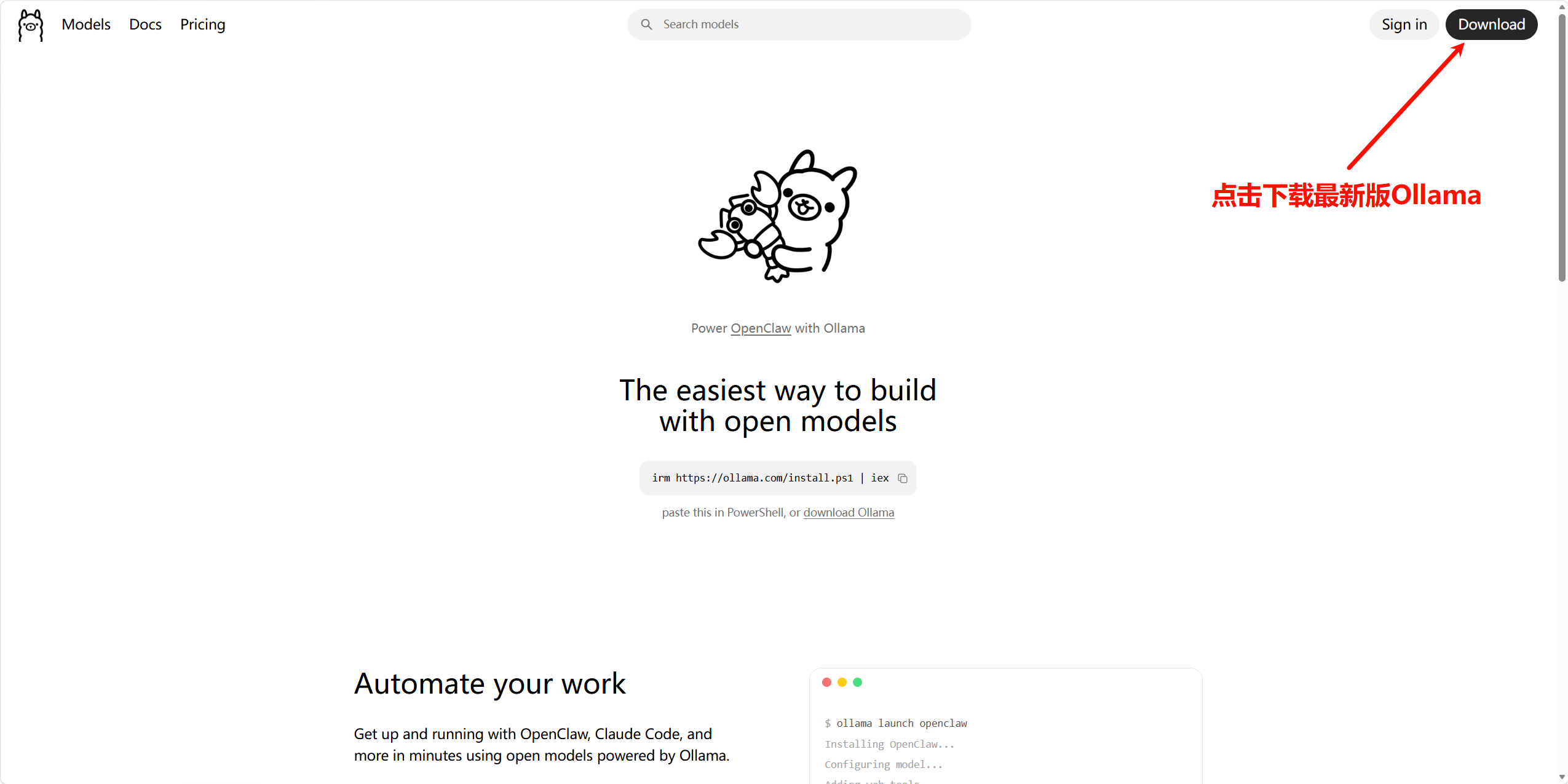

步骤 1:打开 Ollama 官网并下载最新版安装包

先打开 Ollama 官网首页: https://ollama.com/

进入页面后,点击右上角的 Download,准备下载安装最新版 Ollama。

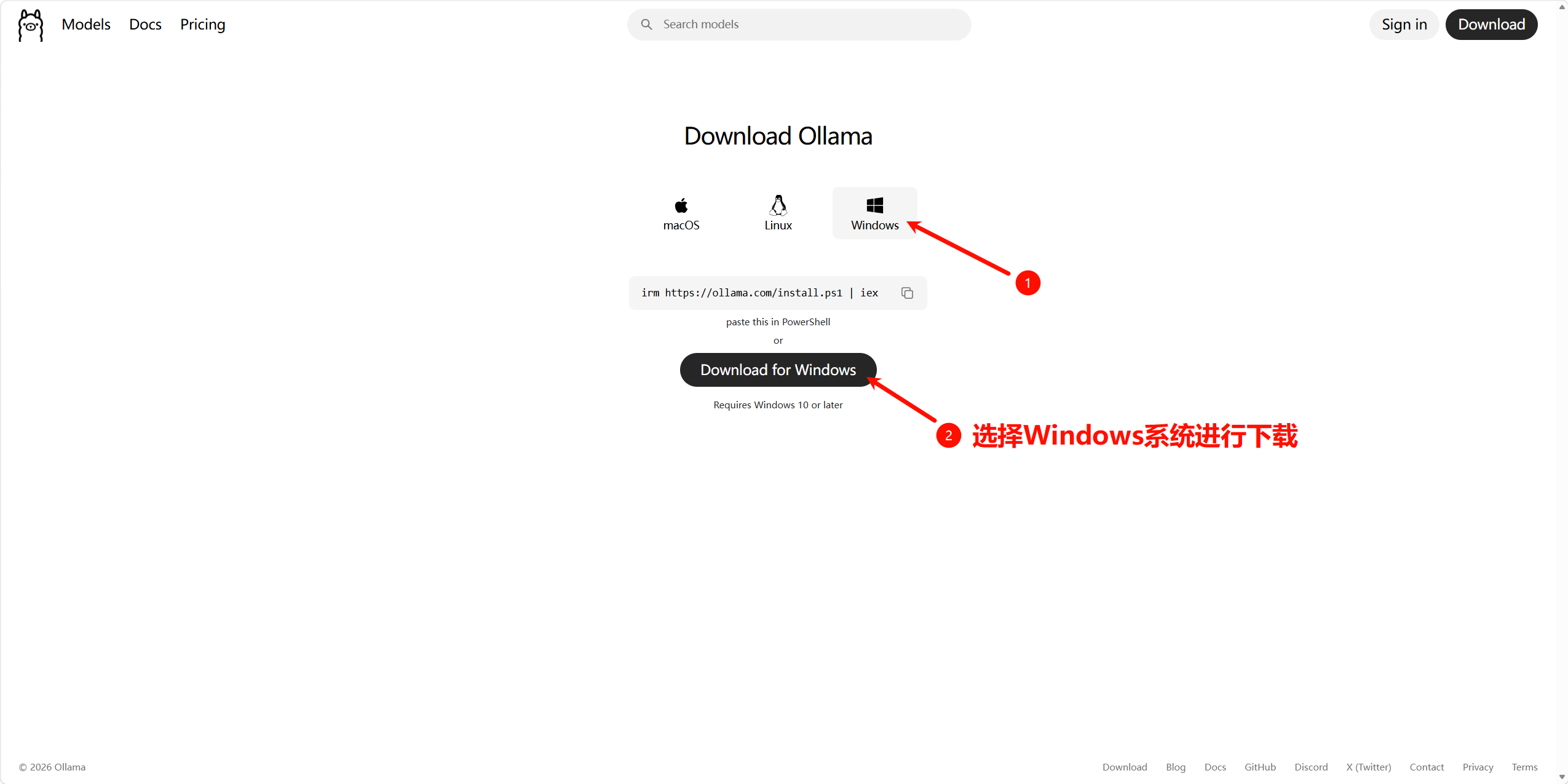

步骤 2:选择 Windows 版本下载

进入下载页面后:

-

选择

Windows -

点击

Download for Windows

这样就会开始下载 Windows 版 Ollama 安装包。

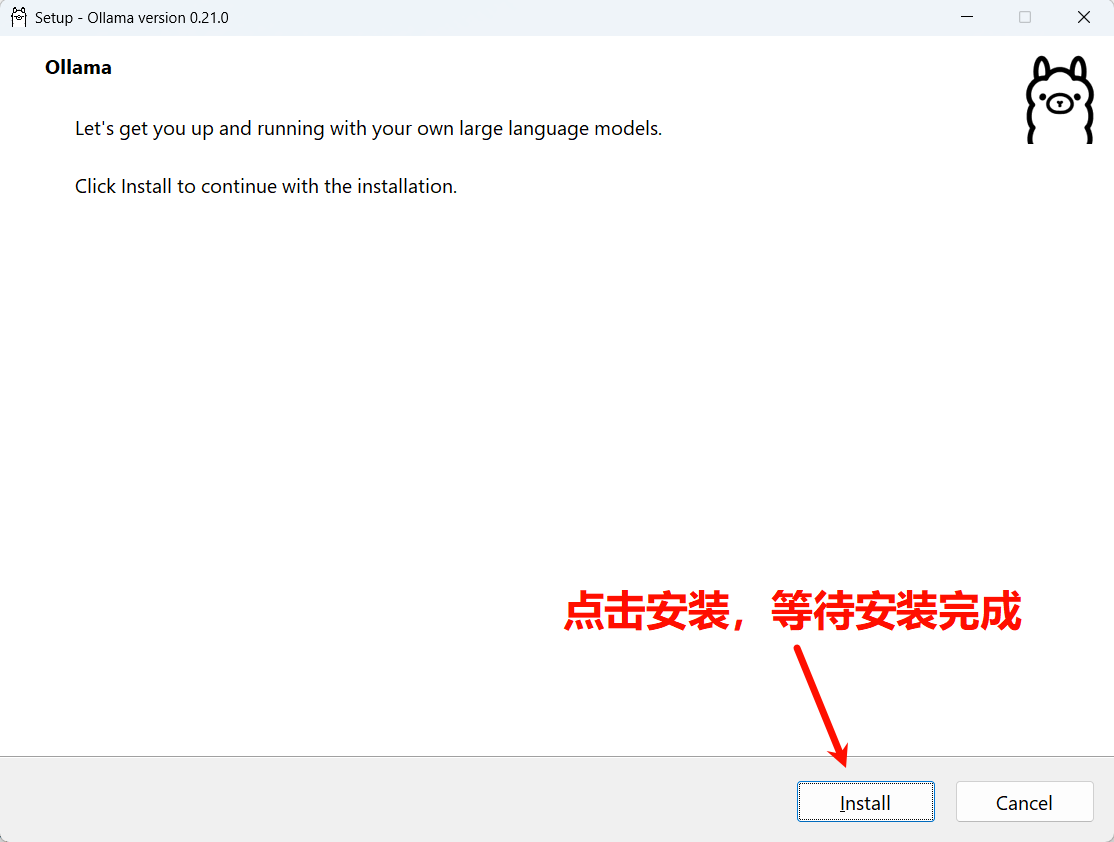

步骤 3:安装 Ollama

下载完成后,双击安装程序。 在安装窗口中点击 Install,然后等待安装完成即可。

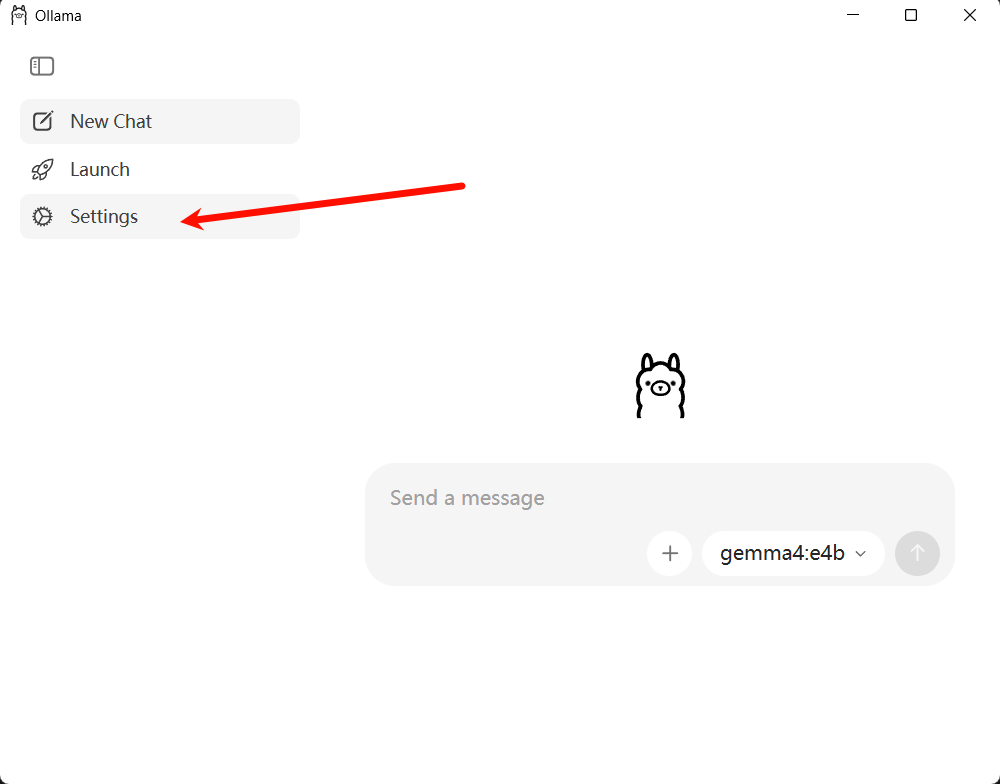

步骤 4:打开 Ollama 设置页

安装完成并启动 Ollama 后,进入左侧菜单。 点击 Settings,准备修改本地模型的存储位置。

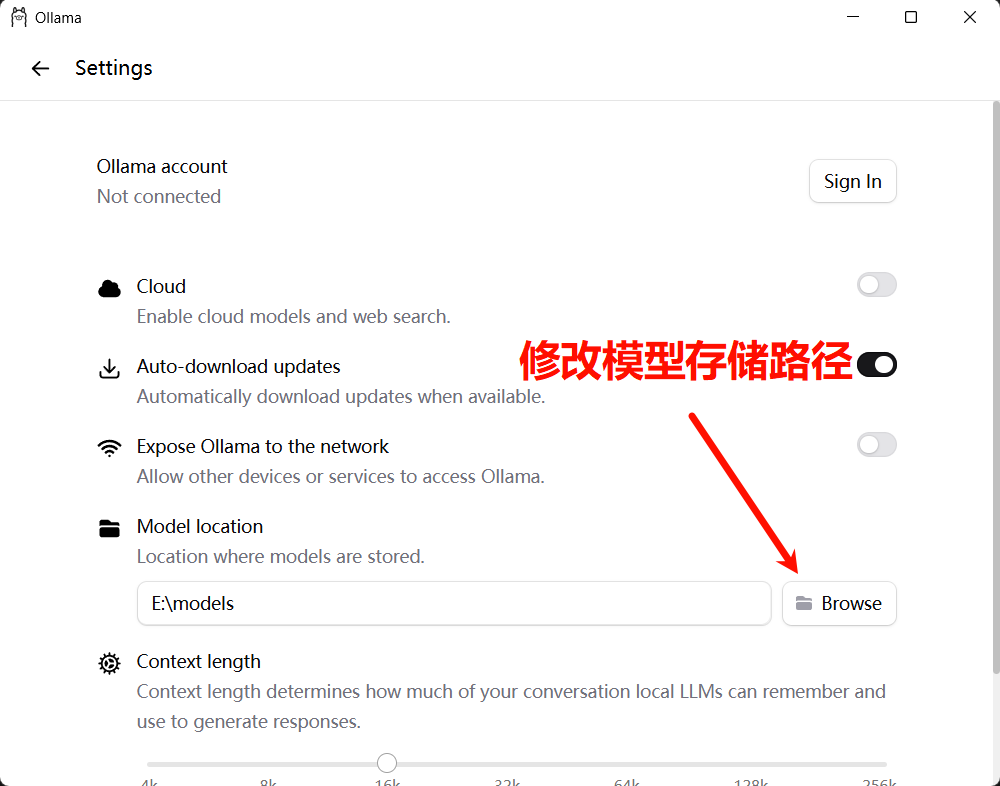

步骤 5:修改模型存储路径

在设置页面中找到 Model location。 点击 Browse,把模型存储目录改到你希望保存模型的磁盘位置,例如图中的 E:\models。

如果你不想改存储位置,也可以保留默认路径继续使用。

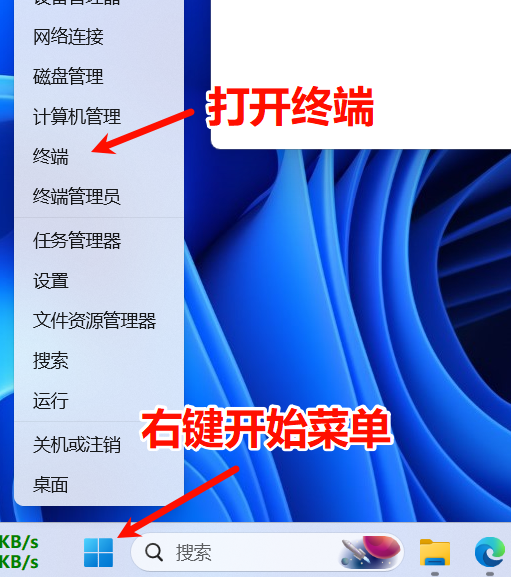

步骤 6:打开 Windows 终端

在 Windows 桌面上右键开始菜单。 然后点击 终端 (Powershell),打开命令行窗口

步骤 7:执行命令拉取并运行模型

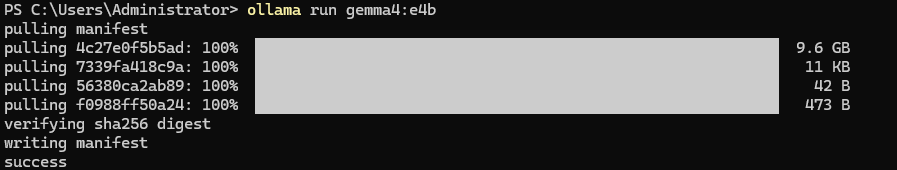

在终端中输入你要下载的模型命令,例如:

ollama run gemma4:e4b

第一次执行时,Ollama 会自动开始下载对应模型。 下载完成后,终端里会显示 success。

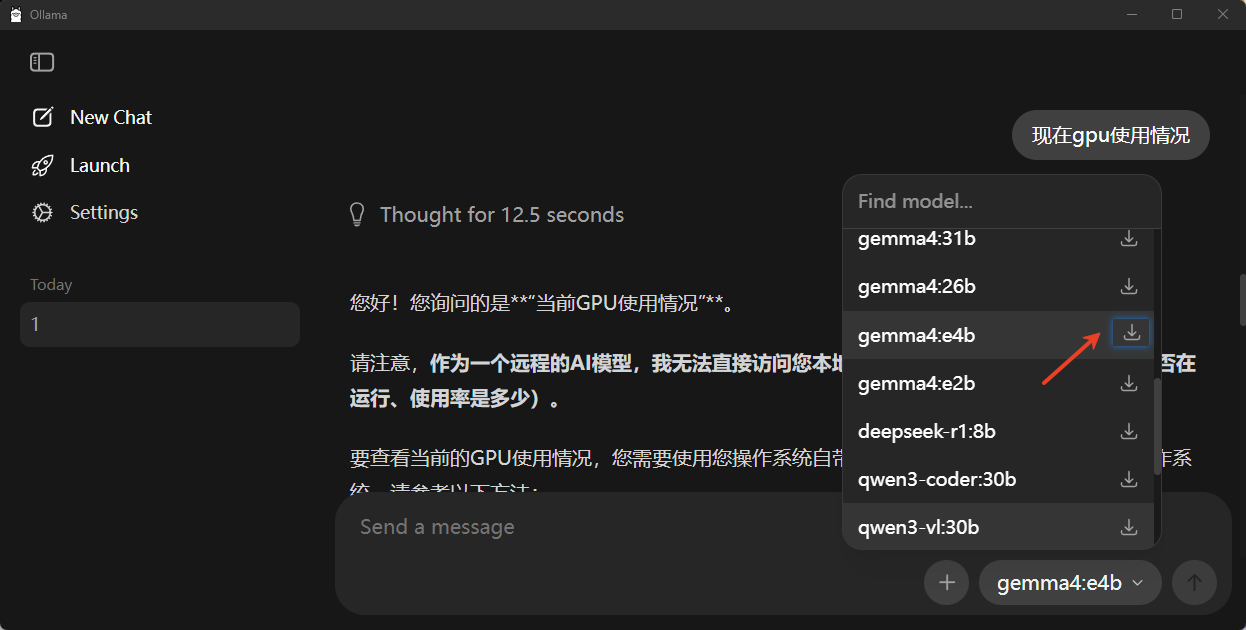

步骤 8:在 Ollama 客户端确认模型已下载

回到 Ollama 客户端,在模型选择列表里找到刚刚下载的模型,例如 gemma4:e4b。 如果模型右侧不再是未下载状态,就说明模型已经拉取成功。

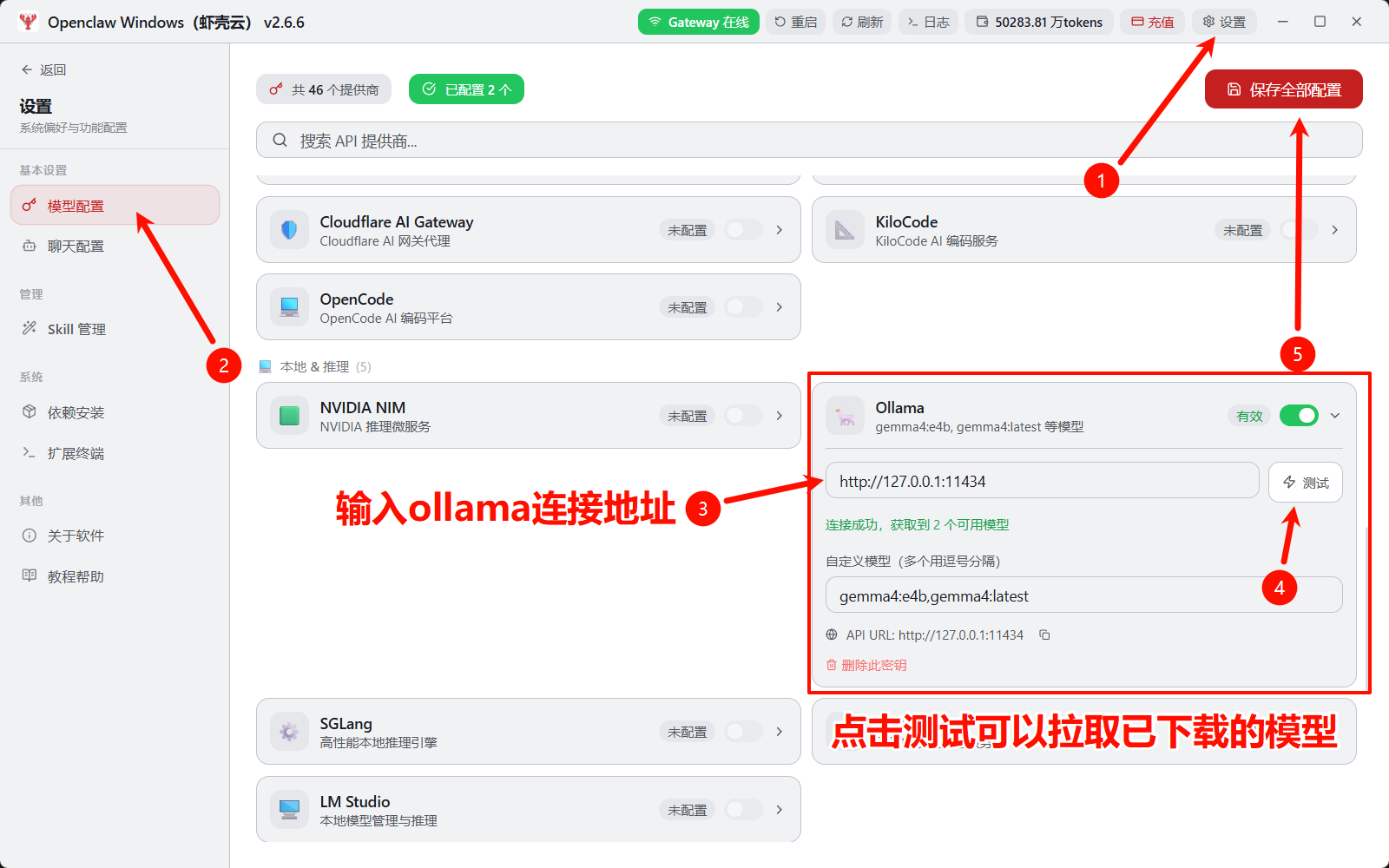

步骤 9:在 OpenClaw 中配置 Ollama 地址并测试

回到 OpenClaw:

-

点击右上角

设置 -

进入左侧

模型配置 -

找到

Ollama -

在地址栏输入

http://127.0.0.1:11434 -

点击

测试 -

点击右上角

保存全部配置

测试成功后,OpenClaw 会识别到已下载的本地模型。

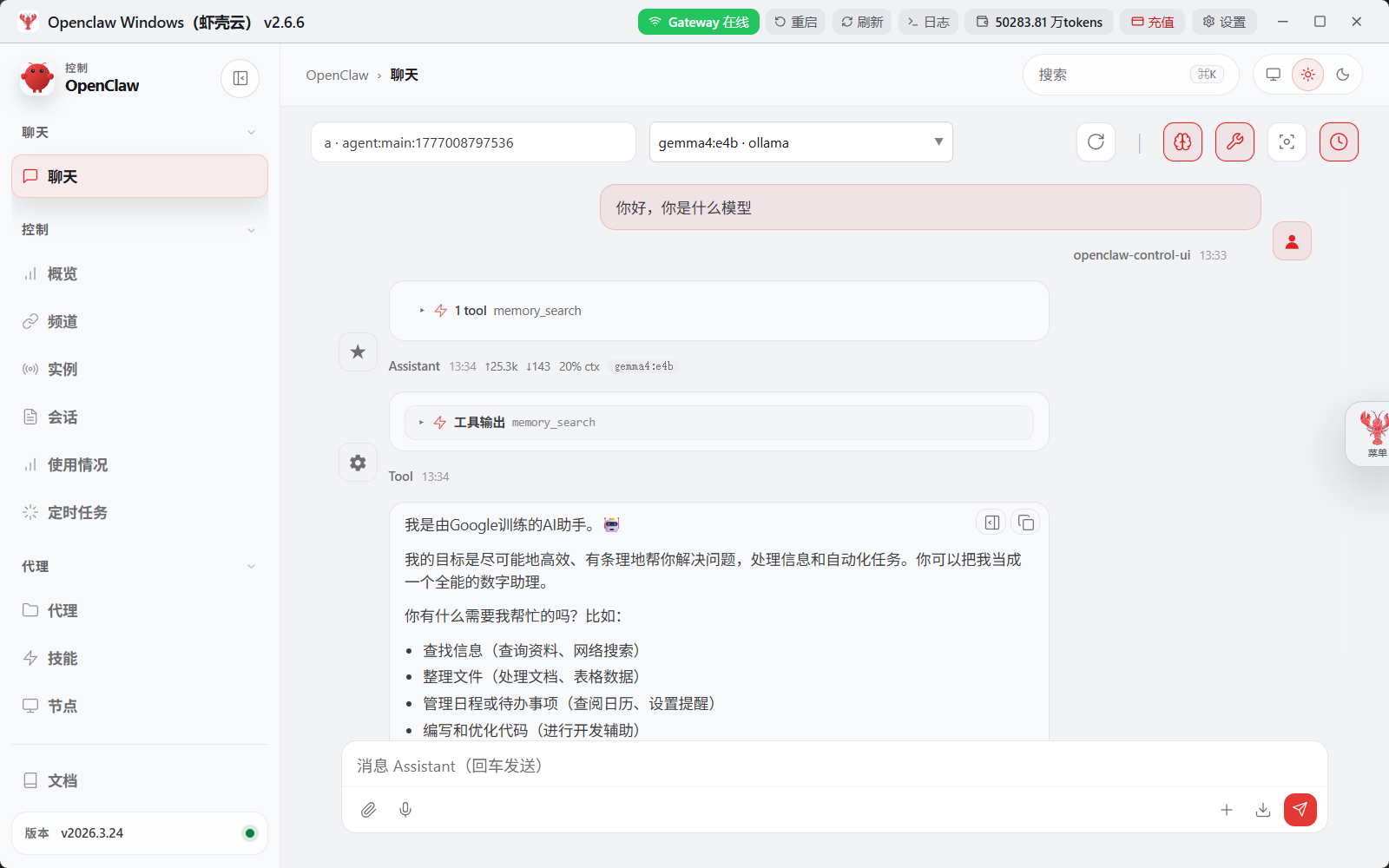

步骤 10:在聊天页选择 Ollama 模型

进入 OpenClaw 左侧 聊天 页面。 在模型选择框中搜索刚才下载的模型名称,例如 gemma4:e4b。 注意确认模型后面的标签是 ollama,再点击选中。

步骤 11:发送消息测试模型是否可用

选择好模型后,直接在聊天输入框中发送一条测试消息,例如: 你好,你是什么模型

如果页面能够正常返回内容,就说明 Ollama 已经成功接入 OpenClaw。

接入完成后的自检清单

-

已从 Ollama 官网下载并安装 Windows 版本。

-

已成功启动 Ollama。

-

已按需修改模型存储路径。

-

已在终端执行

ollama run 模型名命令。 -

模型下载完成后终端显示

success。 -

OpenClaw 中 Ollama 地址已填写为

http://127.0.0.1:11434。 -

已点击

测试并识别到可用模型。 -

已点击

保存全部配置。 -

聊天页中已选中带

ollama标签的模型。 -

已成功发送测试消息并收到回复。

常见问题

1. Ollama 地址应该填什么?

一般本机默认填写:

http://127.0.0.1:11434

如果 Ollama 就安装在当前这台电脑上,通常直接使用这个地址即可。

2. 为什么点击测试后没有识别到模型?

优先检查下面几项:

-

Ollama 是否已经正常启动。

-

是否已经在终端执行过

ollama run 模型名。 -

模型是否已经下载完成。

-

地址是否填写为

http://127.0.0.1:11434。 -

是否被本机防火墙或安全软件拦截。

3. 为什么需要先在终端里运行一次模型?

因为 ollama run 模型名 在首次执行时会自动下载模型。 只有模型真正下载到本地后,OpenClaw 才能在测试时识别到它。

4. 模型文件太大怎么办?

本地模型通常比较占磁盘空间。 如果系统盘空间不足,建议像教程里一样,先把 Model location 修改到容量更大的磁盘,再下载模型。

附上open claw部署包:https://xiake.yun/api/download/package/12?promoCode=IVD643FDE29A

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献47条内容

已为社区贡献47条内容

所有评论(0)