GPT-Image-2凭啥霸榜?聊聊它的推理架构、文字渲染和多图一致性

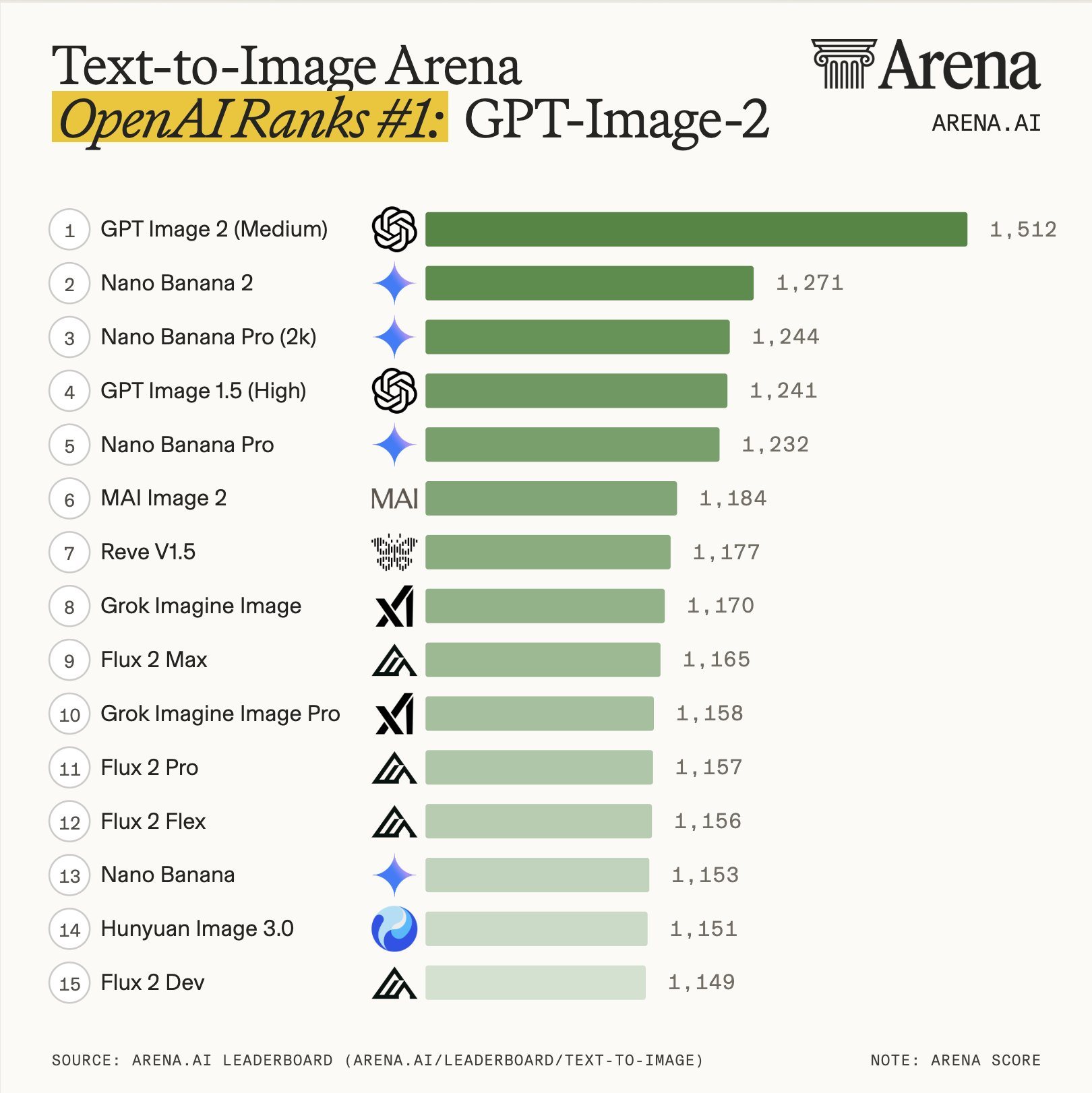

2026年4月,OpenAI上线GPT-Image-2,在LMSYS Image Arena文生图榜单上以1512分登顶,领先第二名242分。但技术人关注的不是分数本身,而是它到底在细节和一致性上做了什么不一样的事。

文字渲染:从“画出字的形状”到“理解字的意义”

用AI生图的人都有过这种体验:图上需要写“产品发布会”五个字,出来的是“产口口发不口”。这不是模型偷懒,而是传统文生图模型根本不认识汉字。扩散模型处理文字时,本质上是在临摹文字的视觉轮廓——它把“字”当成花纹来画,而不是当成语言符号来理解。

GPT-Image-2换了一条路。它把O系列推理引擎和视觉理解模型做了深度融合,让模型在生成文字之前,先理解这段文字是什么意思、在画面中担任什么角色——是标题还是注释,是品牌名还是数据标签。当模型理解了“这是标题,需要醒目”,它才会调用对应的排版逻辑,选择合适的字号和位置。

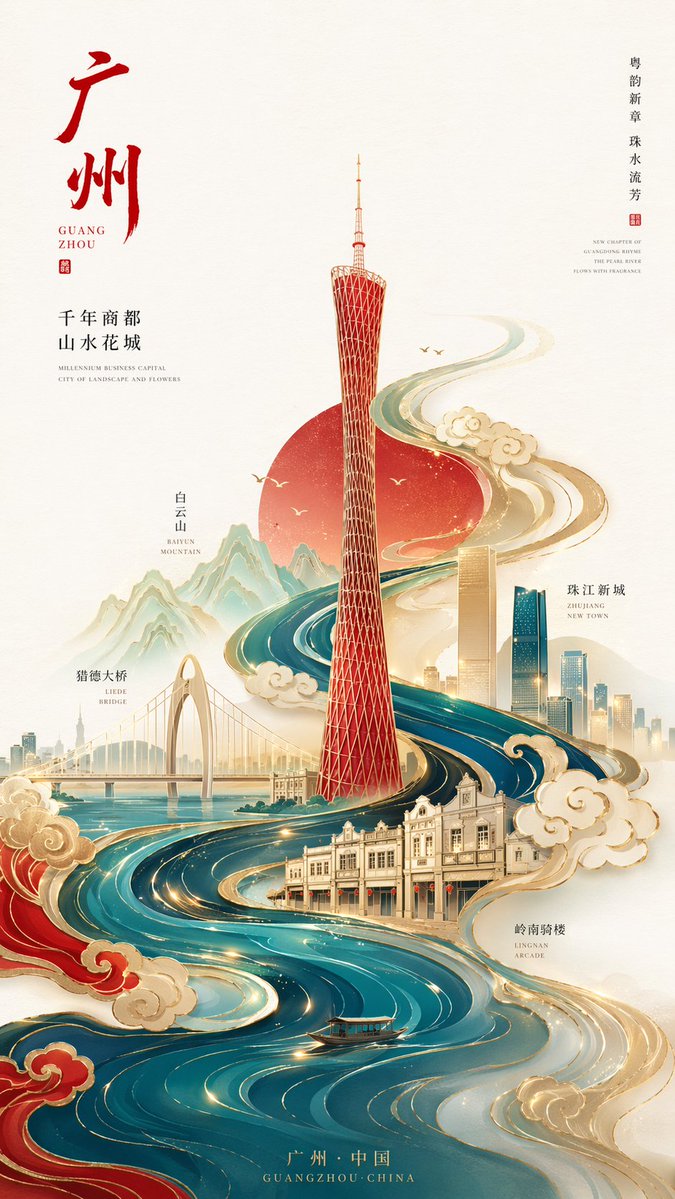

结果就是文字准确率从前代的90-95%跃升到99%以上。中日韩文字从此不再乱码,连餐厅菜单上密密麻麻的菜名和价格、信息图表里小字号的图例标注,都能稳定输出。

物理逻辑:先推理再渲染,不靠“蒙”

早期模型画一个玻璃杯还行,画三个透明玻璃杯叠在一起就会出问题——光线折射不对,遮挡关系混乱,杯子的边缘该实的地方虚了,该虚的地方又太实。

GPT-Image-2的处理方式是先推理再渲染。它在生成像素之前,会在隐空间里做一轮物理逻辑规划——先搞清楚画面中有几个物体、各自的空间位置、光源方向和材质属性,然后再逐块生成。这不是在“画”图,而是在“算”图。

举一个实际的例子:如果提示词要求生成一张“阳光穿过百叶窗照在木地板上”的画面,传统模型可能随机画一些条纹,GPT-Image-2则会计算光线的入射角度、百叶窗叶片间距和投影比例,让每一条光斑的位置和宽度都符合光学逻辑。

多图一致性:不是“记住上一张”,而是“共享同一套规则”

做系列配图时,最怕的是换一张图就换一张脸。传统做法是把上一张图反复上传作为参考,但效果不稳定。

GPT-Image-2的做法不同。它在同一对话窗口内维护了一个共享上下文表征——简单说,就是把人物外貌、色调风格、画面调性这些信息锁定在一个持久化的表示空间里。后续每一次生成,模型都会从这个空间里读取这些锁定值,再叠加新的指令。

比如你先生成了一张“穿白大褂的女科学家在实验室里”,然后再输入“她在讲台上做学术报告”,模型会自动延续同一个人物的外貌特征和服装风格。这种连贯性不是靠图片参考实现的,而是靠上下文表征的持久化锁定。

这个设计还有一个容易被忽视的好处:单次提示词可以生成最多8张图像,且角色、物体和配色保持高度统一。对于需要做产品详情页、漫画分镜、社交媒体系列配图的团队来说,批量生成时最耗时的“风格对齐”环节被压缩了。

指令遵循:越听话的模型,越需要说清楚

GPT-Image-2的指令遵循度很高,它能严格保留提示词中的关键细节——小图标、UI元件、图例标注、字体风格约束,都不会被模型“自由发挥”给带偏。

但这恰好是一个双刃剑。模型精确执行你给的每一句话,包括那些说得不够准确的话。写“画一个科技感的背景”,它一定会画,但画出来的可能是训练数据里“科技感”的平均值——蓝色发光线条加网格。如果能明确写成“深蓝色背景上布满发光的电路板纹路,画面中央悬浮一个半透明数据球体”,模型能精确到纹路走向和球体透明度。

这和传统扩散模型的逻辑正好相反。扩散模型擅长“脑补”,你给模糊指令它也能画出不错的结果,因为它在用概率填充未知。GPT-Image-2则更倾向“你说什么我做什么”——不确定性越少,偏差就越小。

总结

GPT-Image-2在图像细节和一致性上的技术路线很清晰:文字渲染靠语义理解而非轮廓临摹,物理逻辑靠先推理再渲染而非像素猜测,多图一致靠共享上下文表征而非图片参考。这三条路都指向同一个方向——文生图不是画得更美,而是画得更对。技术上的每次突破,最终都是在降低从“心里想的画面”到“屏幕上看到的图”之间的损耗。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)