OpenClaw 本地部署 QQ /飞书机器人接入手册

文章目录

1 部署前准备

1.1 系统与环境要求

-

Windows 10/11(建议专业版)

-

WSL2 已安装并配置好 Ubuntu 发行版

安装流程:https://blog.csdn.net/weixin_45041493/article/details/160543852?spm=1001.2014.3001.5502 -

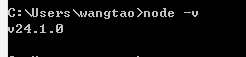

Node.js ≥ 22(推荐 24.x)

-

Git(可选,用于源码构建)

-

稳定的科学上网工具(访问 GitHub 和部分 API 可能需要)

2.大模型部署

2.1线上大模型部署

2.1.1 智谱模型(免费)

- 访问 智谱开放平台 注册/登录

- 进入 API Keys 页面,点击「新建 API Key」

- 复制生成的密钥(格式示例:a515d134… 或 sk-…)

(前期可能不卡,后期用多了可能会被限流,速度上不来),可以考虑花几块钱去deepseek购买token

2.1.2 deepseek模型(花钱)

2.2. 本地部署大模型(ollama)

目标:把模型文件(而不是程序)安装在自己的F盘

2.2.1 Windows 宿主机下载安装

我想把模型安装在自己的F盘

一、下载并安装 Ollama

- 访问 Ollama 官网:https://ollama.com/download

- 点击 Download for Windows 下载安装程序。

注意:运行安装程序时,建议一路默认安装即可(程序本体默认装C盘,仅占约4GB)。安装完成后,Ollama会自动在后台运行,系统托盘区会出现一个小羊驼图标。

(可选) 如果你连程序都不想装C盘,可以用命令行指定路径(详见第五节“高阶技巧”)。

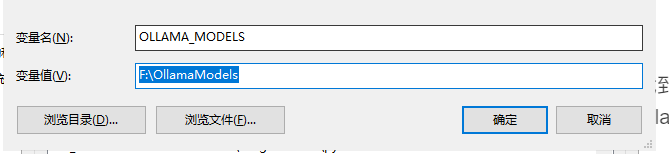

二、配置模型存储路径为 F 盘 (核心步骤)

(在启动 Ollama 之前完成配置,这样模型就会直接下载到 F 盘)

1.在 F 盘创建一个文件夹,用于存放模型文件,例如 F:\OllamaModels(或者您喜欢的名字)。

2.设置环境变量:

- 按 Win + S 搜索“环境变量”,选择“编辑系统环境变量”。

- 点击下方的“环境变量”按钮。

- 在“用户变量”区域,点击“新建”。

变量名:OLLAMA_MODELS

变量值:F:\OllamaModels(确保是您刚才创建的路径)

- 点击“确定”保存。

3.为了让环境变量生效,需要重启 Ollama:

-

右键点击系统托盘区的 Ollama 小羊驼图标,选择“Quit Ollama”(退出)。

-

从开始菜单重新启动 Ollama(点开开始菜单,输入 Ollama,点击运行)。

此时 Ollama 会读取新的环境变量,之后下载的模型都会存到 F 盘。

三、推荐“性价比最高”的模型:Qwen2.5:7B

下载并运行命令

打开命令提示符(或 PowerShell),输入以下命令:

ollama run qwen2.5:7b

可以在终端进行聊天,如果想退出输入命令:

/bye

查看下载的模型命令:

ollama list

四、验证模型是否确实下载到了 F 盘

下载完成后,打开 F:\OllamaModels 文件夹,应该能看到 blobs 子文件夹。看到它,就说明模型成功装到了F盘,配置完美生效!。

五、高阶技巧(可选)

如果想连同Ollama的程序文件也安装到F盘,下载安装包后,在安装包所在路径打开命令行,执行:

OllamaSetup.exe /DIR="F:\OllamaProgram"

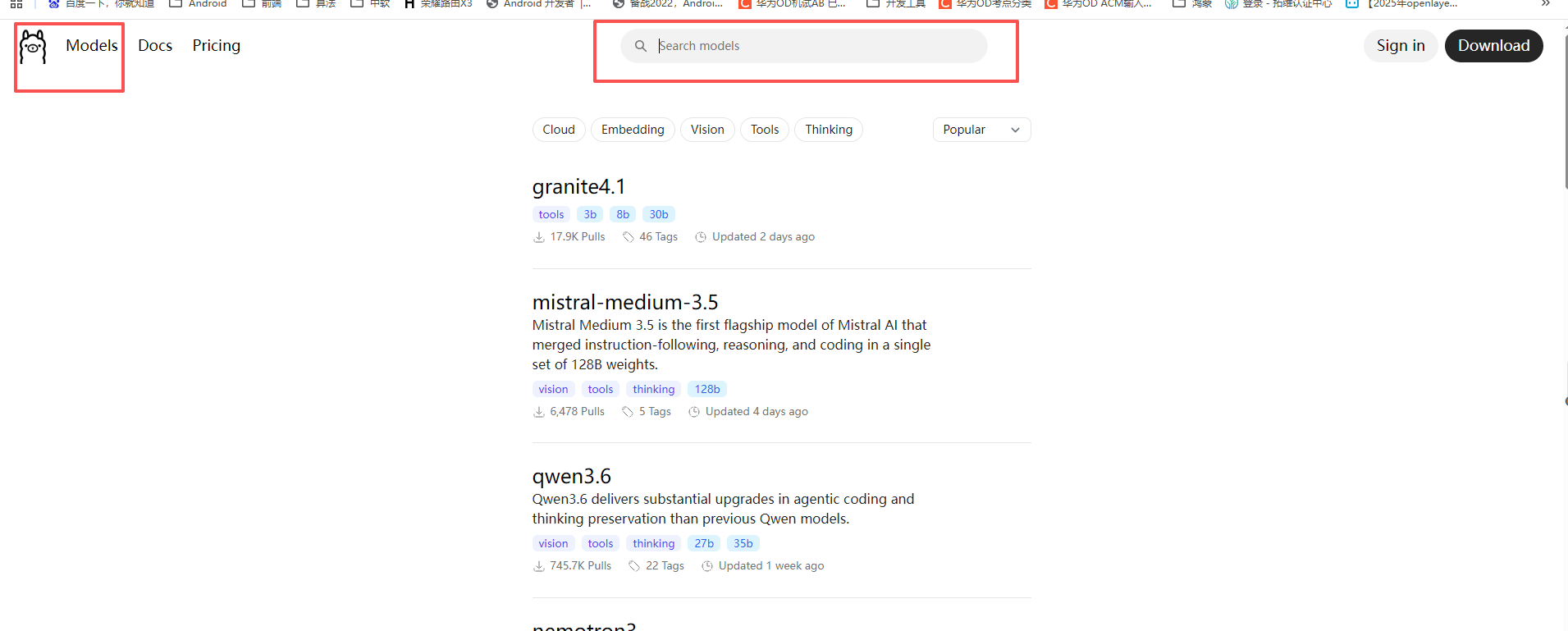

六、ollama模型地址

https://ollama.com/search

自己根据实际情况去选择搜索模型,看是否有自己想要下载的模型

七、模型的使用说明

2.2.1 Linux 环境中连接window中的ollama

🔧 修复步骤(在 Windows 上操作)

1️⃣ 允许 Ollama 通过 Windows 防火墙

打开「Windows 安全中心」→「防火墙和网络保护」→「允许应用通过防火墙」

点击「更改设置」→「允许其他应用…」

浏览找到 C:\Users\你的用户名\AppData\Local\Programs\Ollama\ollama.exe 并添加

勾选「专用」和「公用」 两个网络类型 → 确定

💡 如果不想找路径,可以直接暂时关闭防火墙测试(不推荐长期关闭):

“Windows 安全中心” → “防火墙” → 关闭“域网络”、“专用网络”、“公用网络” → 测试连接成功后,再按上述方法添加规则并重新开启防火墙。

2️⃣ 让 Ollama 监听所有网络接口(最关键一步)

Windows 版 Ollama 默认只允许本机访问(127.0.0.1),WSL 属于另一台“虚拟电脑”,必须改成监听所有地址(0.0.0.0)。

操作方法:

完全退出 Ollama(右键系统托盘图标 → Quit)

重新以允许监听的方式启动:

按 Win + R,输入 cmd 回车

在黑色窗口中执行:

cmd

set OLLAMA_HOST=0.0.0.0

“C:\Users\你的用户名\AppData\Local\Programs\Ollama\ollama.exe”

这样会启动一个带命令行的 Ollama,不要关闭这个窗口。

⚠️ 如果嫌每次这样启动麻烦,可以创建快捷方式,目标填:

cmd /c “set OLLAMA_HOST=0.0.0.0 && start C:\Users\你的用户名\AppData\Local\Programs\Ollama\ollama.exe”

3️⃣ 获取 Windows 的正确 IP

WSL 每次启动,Windows 的 IP 都可能变化。回到你的 WSL 终端,运行:

bash

ip route show default | awk ‘{print $3}’

记下输出的 IP(例如 172.20.144.1)。如果与之前相同,也可以直接用。

4️⃣ 在 WSL 中正确设置连接

你在 ~/.bashrc 中的配置理论上是对的,但为了确保生效,可以临时手动设置测试:

bash

export OLLAMA_HOST=172.20.144.1:11434 # 替换成你上一步得到的 IP

ollama list

如果成功看到模型列表,那么之前的配置应该也没问题(可能需要 source ~/.bashrc 或重新打开终端)。

🧪 如果仍然超时,做一次连通性测试

在 WSL 终端里:

ping 172.20.144.1

telnet 172.20.144.1 11434

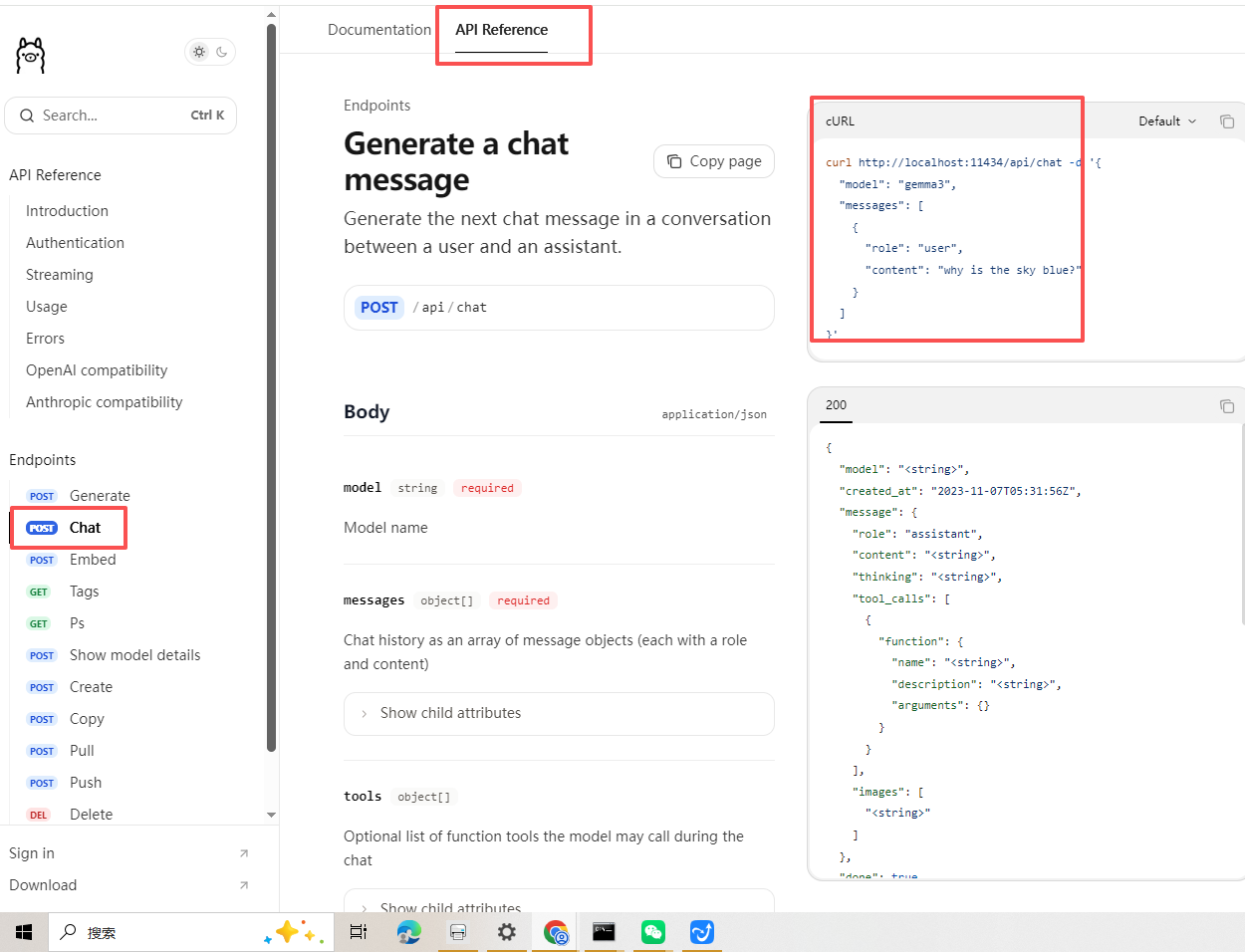

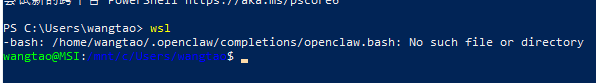

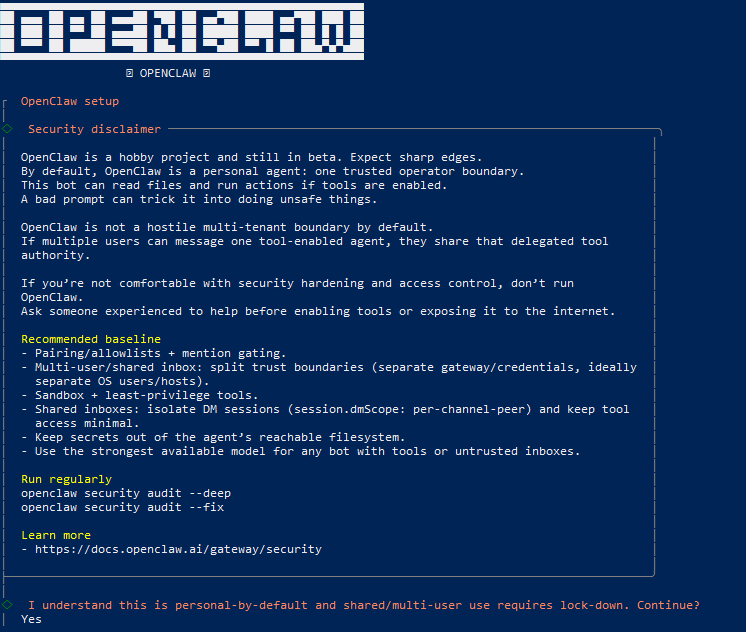

3、安装OpenClaw

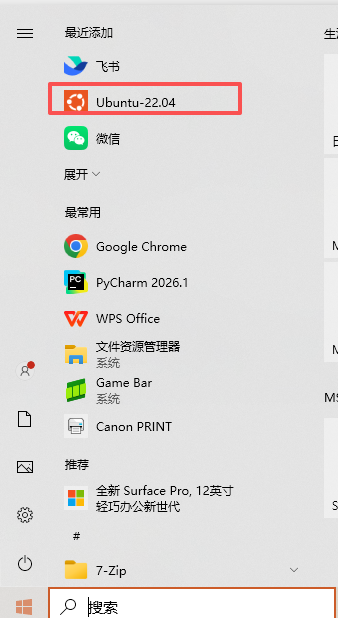

1. 打开 WSL 终端

- 方法一:按 Win + R,输入 wsl 回车

- 方法二:在开始菜单中打开「Ubuntu」应用

- 方法三:按 Win +x键,搜索 PowerShell、选择 以管理员身份运行,输入wsl回车

wsl

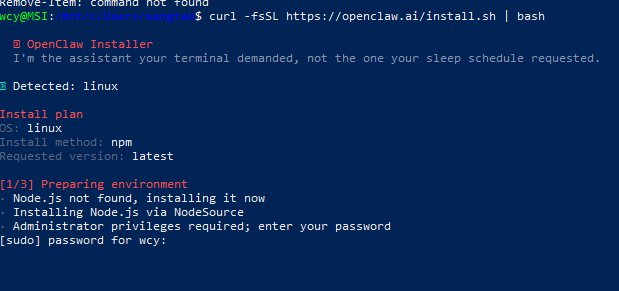

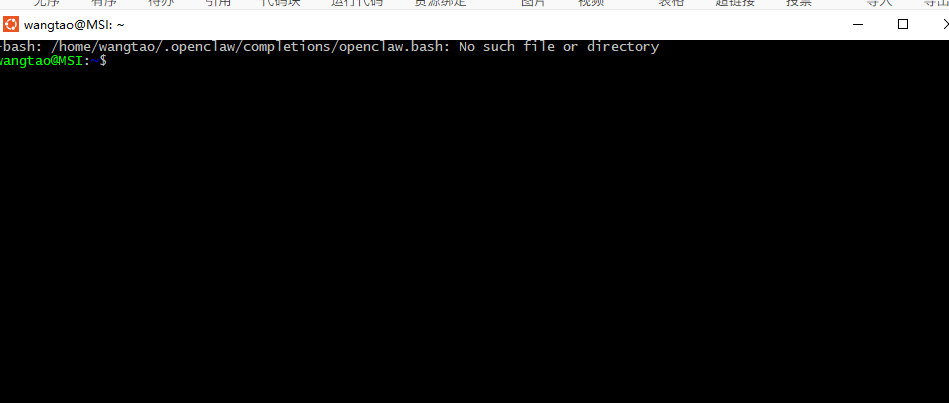

3.1 执行一键安装脚本

curl -fsSL https://openclaw.ai/install.sh | bash

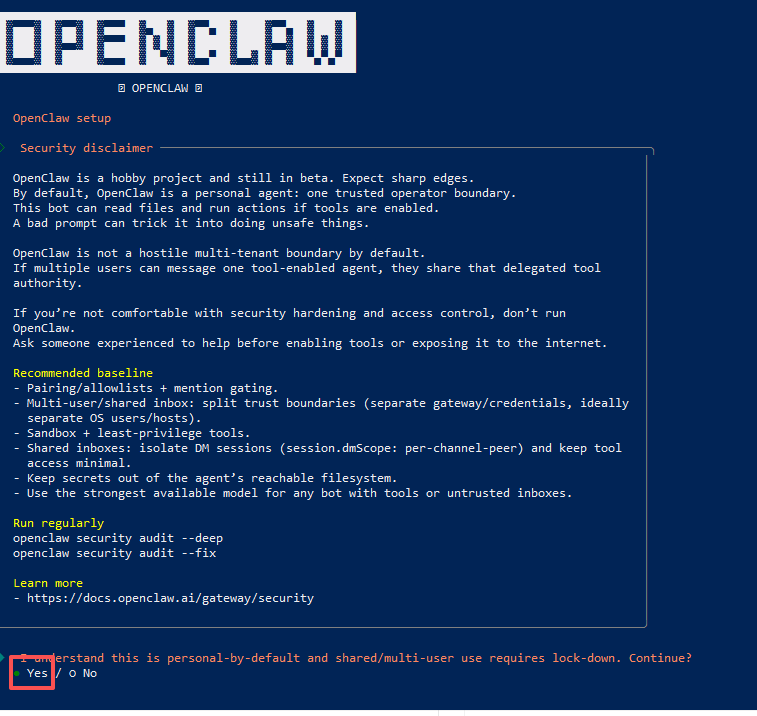

这个过程要等待5~20分钟,静静等待!

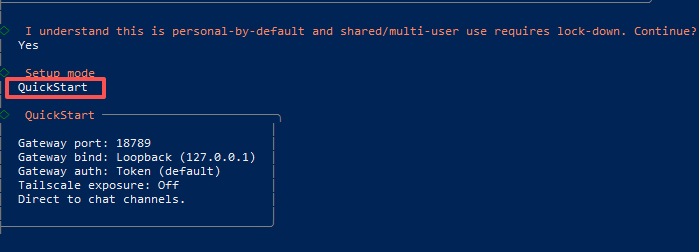

选Yes

安装过程中会提示选择网关运行时,选 Node (recommended)

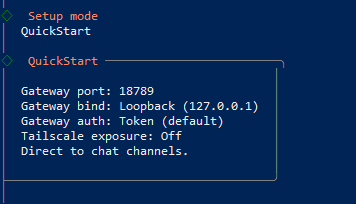

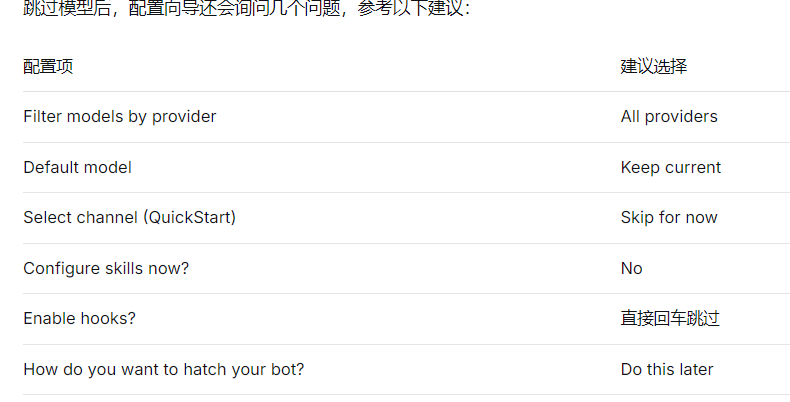

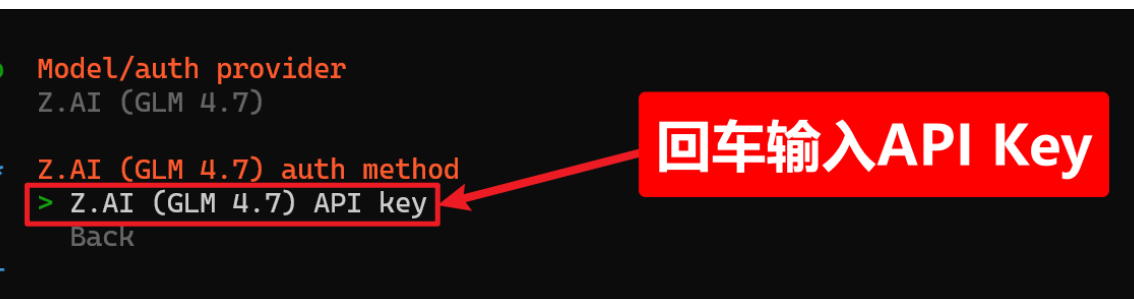

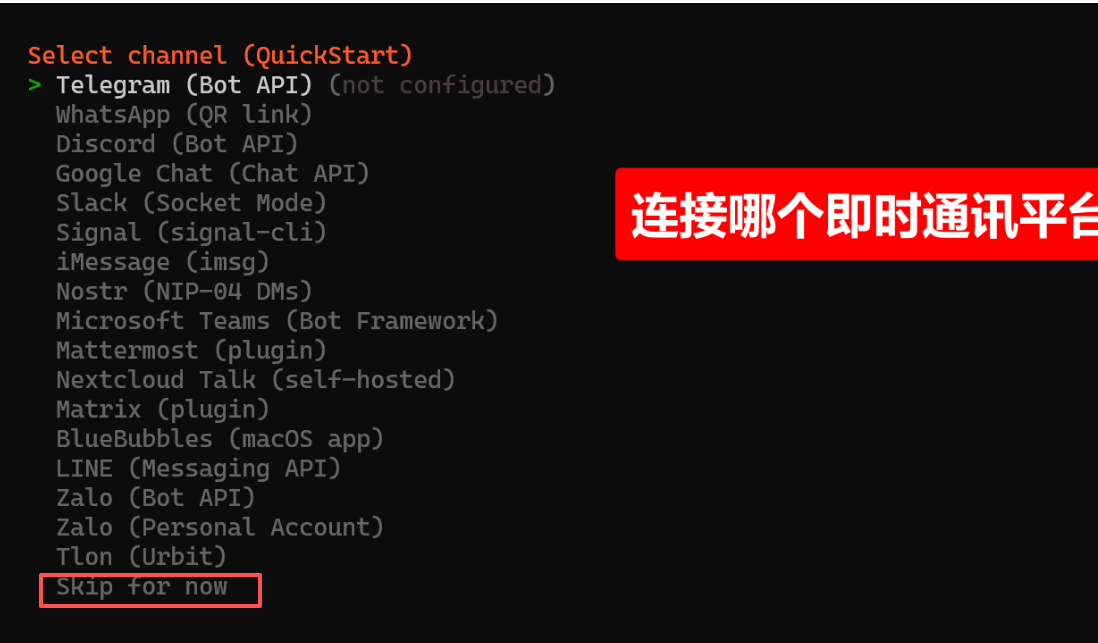

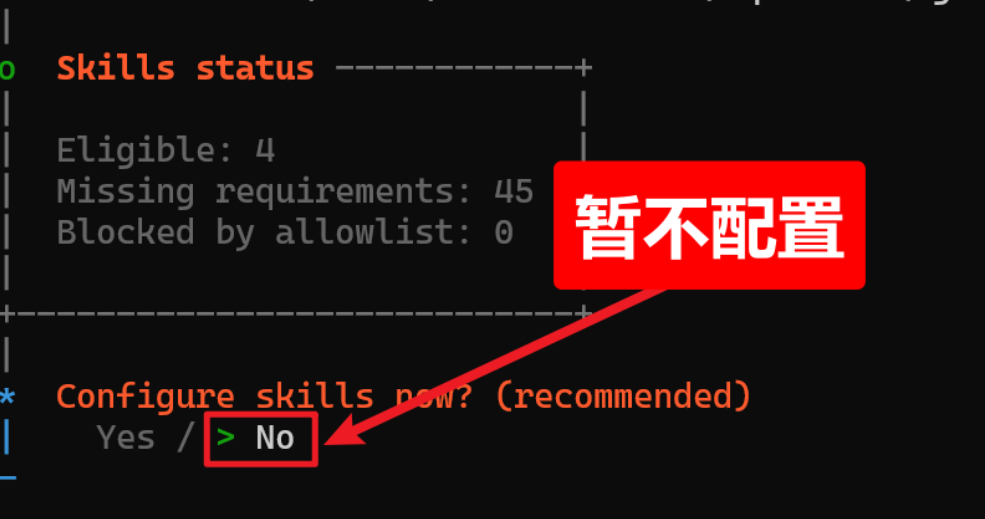

3.2 运行配置向导关键步骤

openclaw onboard --mode local

按以下选项填写:

| 配置项 | 选择 |

|---|---|

| Model/auth provider | Z.AI |

| Z.AI auth method | Z.AI API key |

| API Key | 粘贴上一步获取的智谱 Key |

| Default model | 推荐 zai/glm-4.7-flash(免费)或 zai/glm-5.1 |

| Channel | Skip for now |

| Search provider | Skip for now |

| Configure skills now | No |

| Enable hooks | session-memory,回车 |

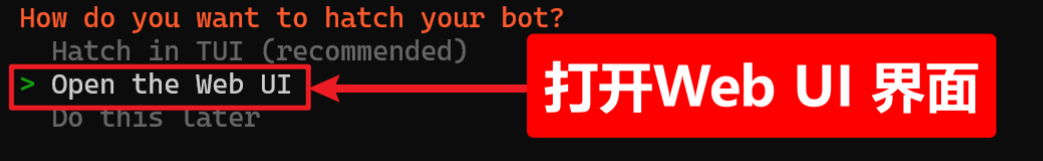

| Hatch your bot? | Do this later |

3.3 禁用 WSL 下冲突的插件(必须)

openclaw plugins disable bonjour

原因:bonjour 插件在 WSL 环境中会导致网关崩溃(mDNS 广播失败)

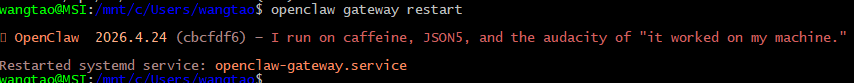

3.4 启动网关服务

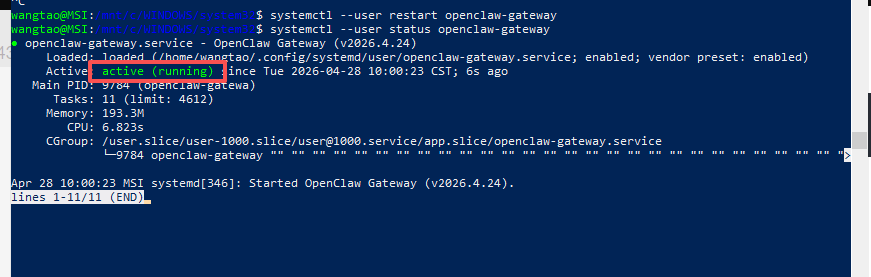

systemctl --user restart openclaw-gateway

systemctl --user status openclaw-gateway

确认状态为 active (running)

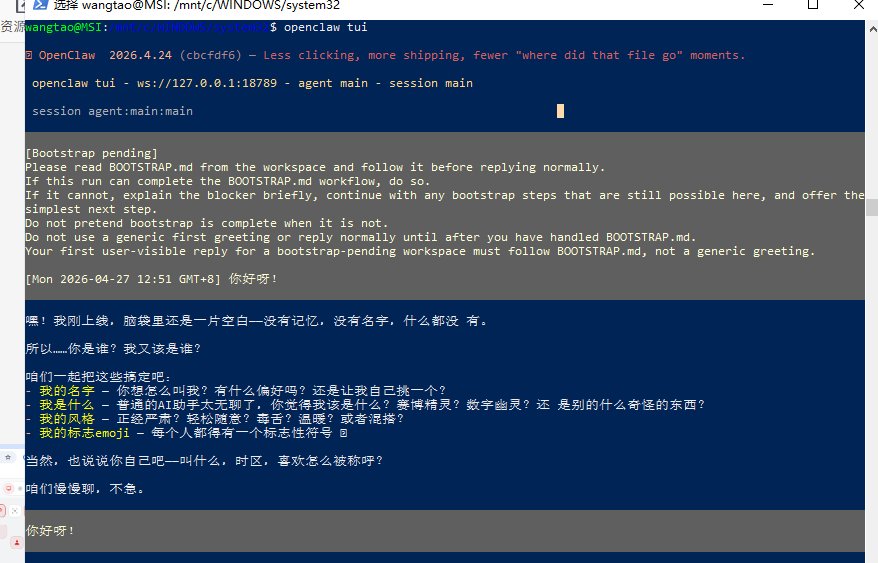

3.5 测试 TUI 和 Web UI

openclaw tui

- 如果提示 unauthorized,请使用带 token 的方式连接(见常见问题)

- 成功后会显示 connected to gateway,输入 你好 测试模型回复

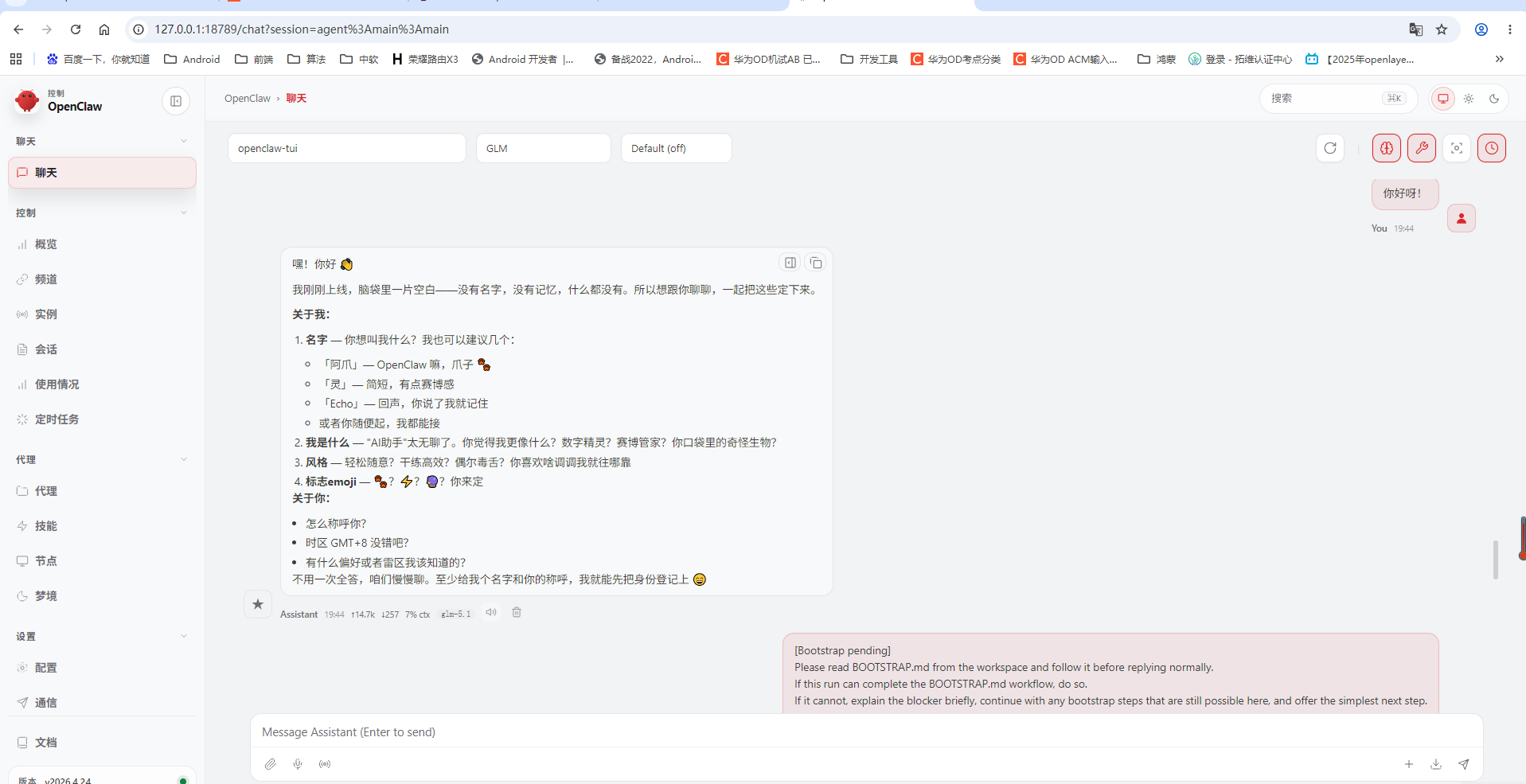

此时它会自动再打开一个命令窗口来启动服务:

同时,大约过30秒左右,我们回到刚才的设置窗口,选择 Open the Web UI ,打开 OpenClaw 的UI界面:

4.接入即时通讯平台

4.1 QQ 机器人接入(个人版仅支持私聊)

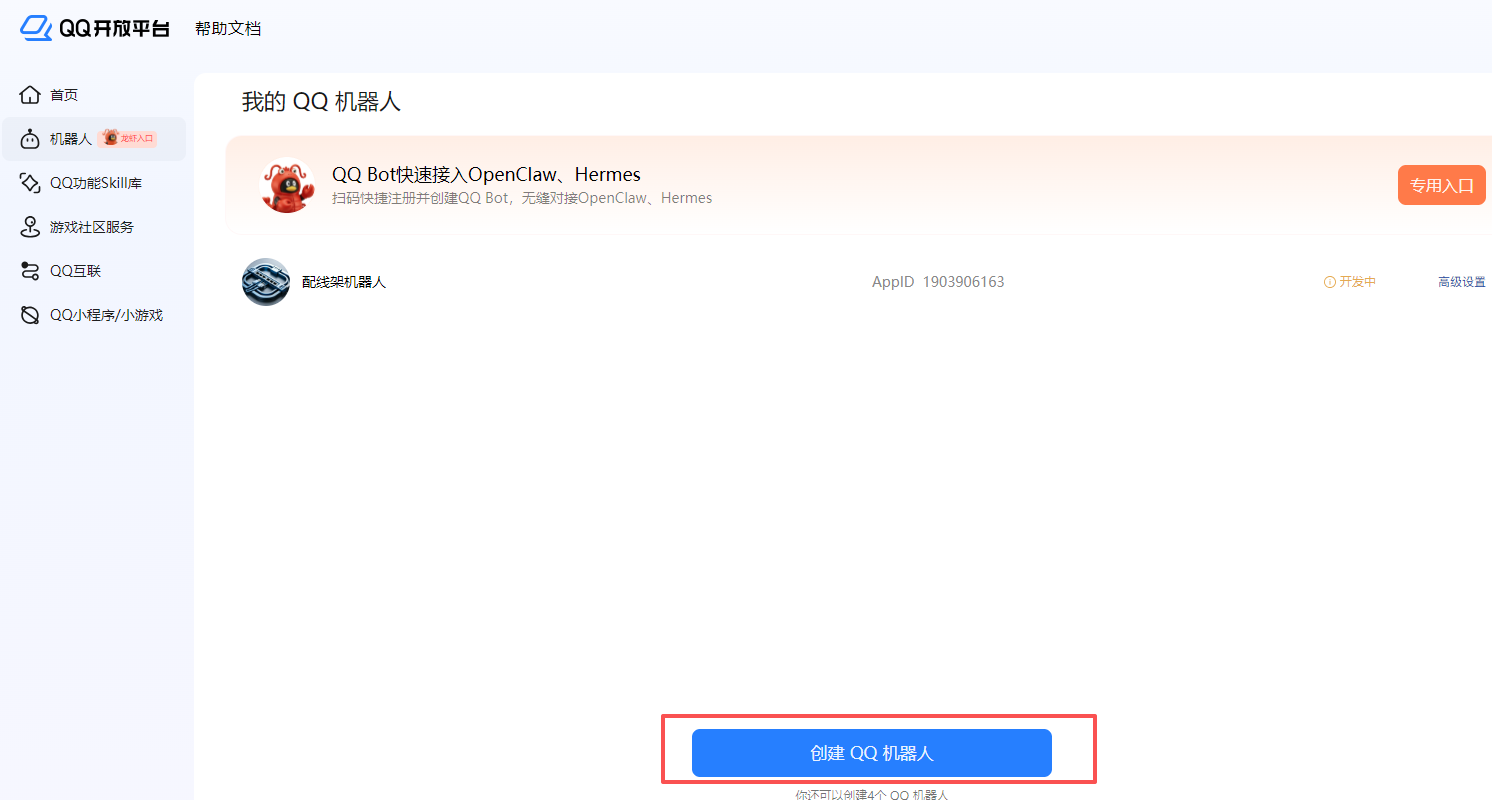

4.1.1 注册 QQ 机器人

访问 QQ 开放平台

创建应用 → 选择「机器人」

记录以下三个值:

appId(纯数字)

clientSecret(一串字符)

token(你自己设置的验证 Token)

4.1.2 QQ 频道

1.首先需要自己去注册QQ开发平台帐号进入之后 选择创建QQ机器人

之后生成机器人编码等

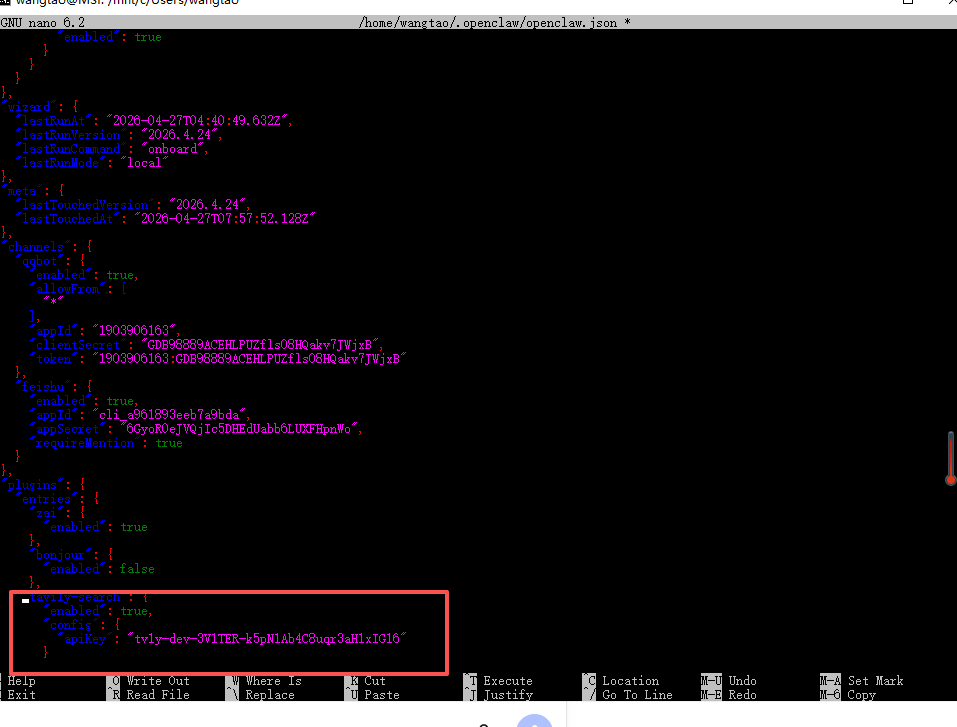

4.1.3 配置openclaw

在本地的的cmd中

在WSL终端中执行:

wsl

安装QQ机器人插件

openclaw plugins install @tencent-connect/openclaw-qqbot@latest

直接安装插件后可能无法正常工作,需要手动修改配置文件

方法一

# 编辑配置文件

nano ~/.openclaw/openclaw.json

然后文本编辑中加入

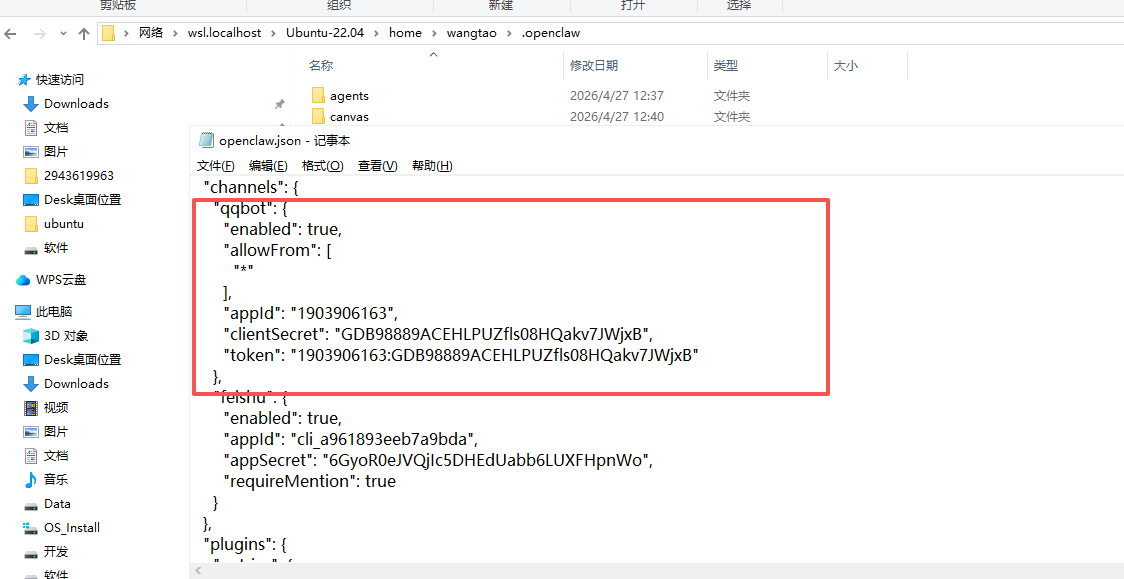

"channels": {

"qqbot": {

"enabled": true,

"allowFrom": ["*"],

"appId": "1903906163", // 替换为你的appId

"clientSecret": "XXX", // 替换为你的clientSecret

"token": "your_token" // 注意:这是开放平台设置的token,不是clientSecret

}

}

方法二:

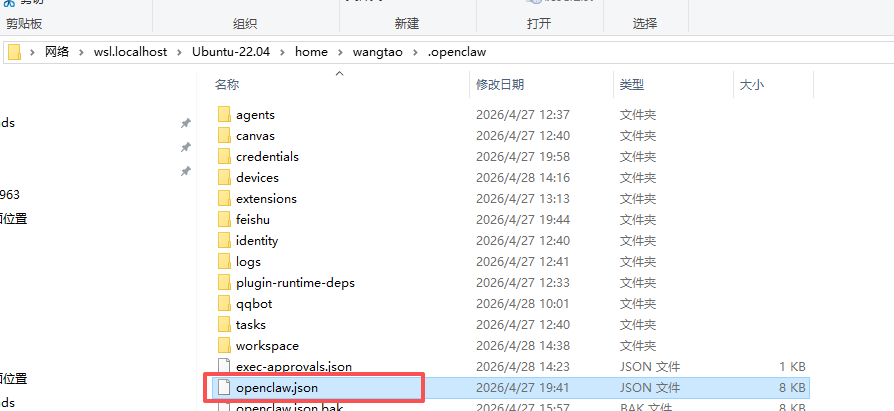

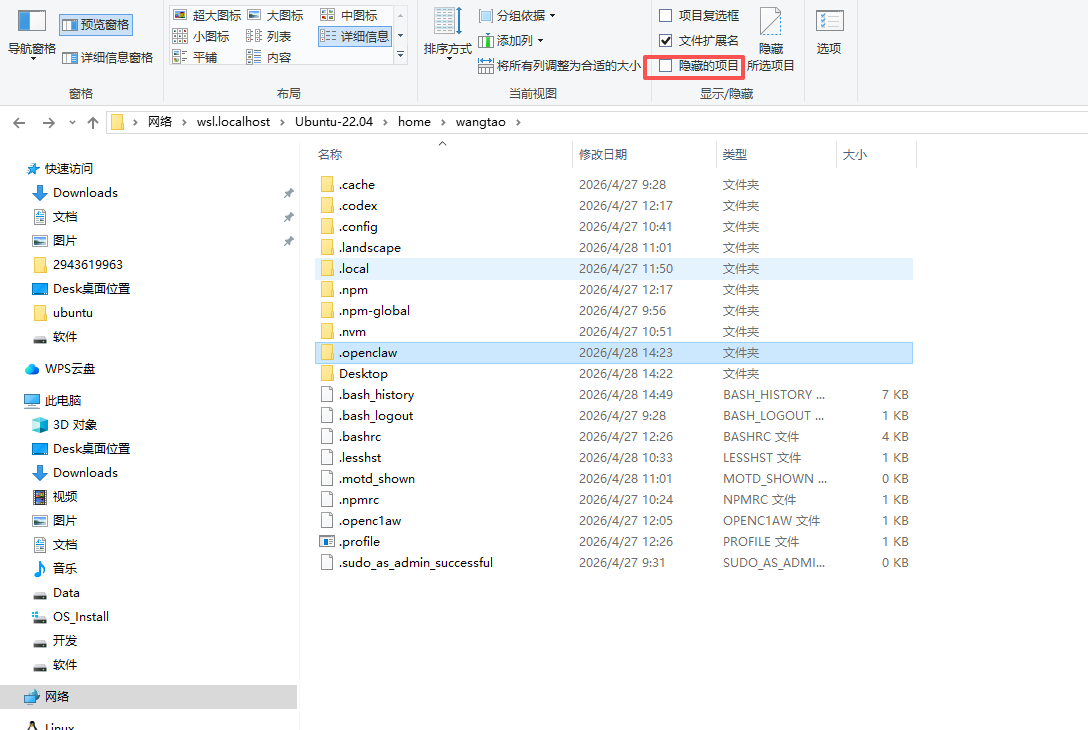

直接打开在文件资源窗口中输入:\\wsl.localhost\Ubuntu\home\<你的用户名>\.openclaw

然后找到openclaw.json,然后用记事本进行编辑文件

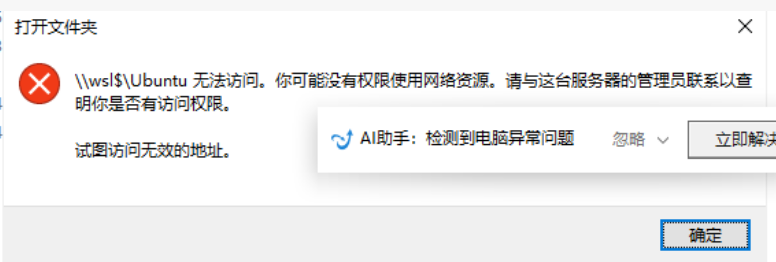

如果打不开\\wsl.localhost\Ubuntu-22.04\home\wangtao\.openclaw 请见 5 .openclaw的文件位置查找报错

🚀 重启网关

systemctl --user restart openclaw-gateway

🔍 检查日志确认连接

journalctl --user -u openclaw-gateway -n 30 --no-pager | grep -i qq

之后就可以在QQ上进行智能对话了,也可以打开OpenClaw进行查看

4.1.4 QQ机器人收不到消息

journalctl --user -u openclaw-gateway -n 30 | grep -i qq

- 确认机器人已添加为好友

- 确认开放平台已配置事件订阅

- 个人QQ机器人不支持群聊,仅限私聊

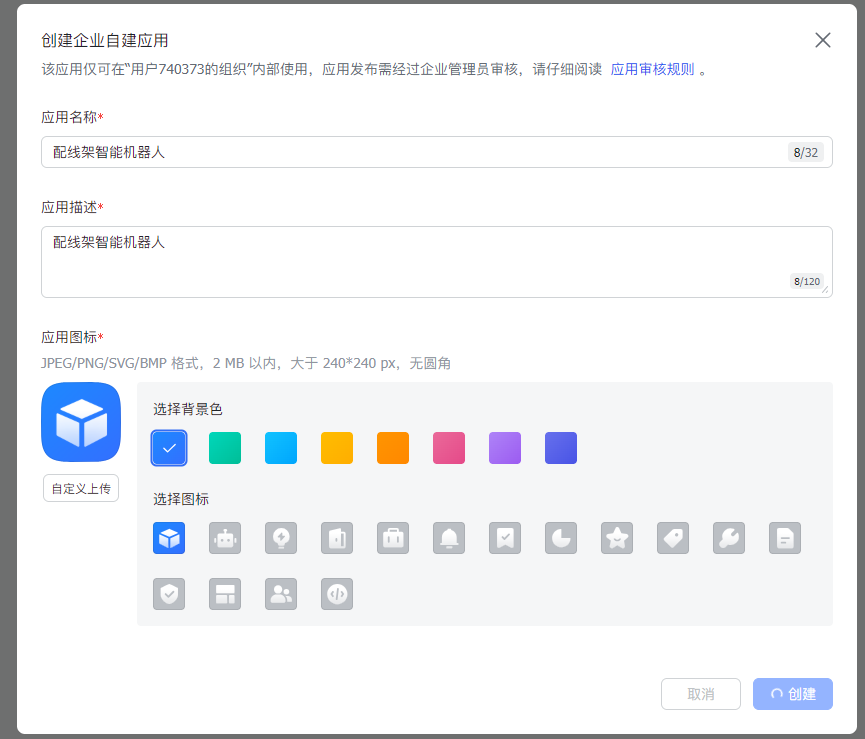

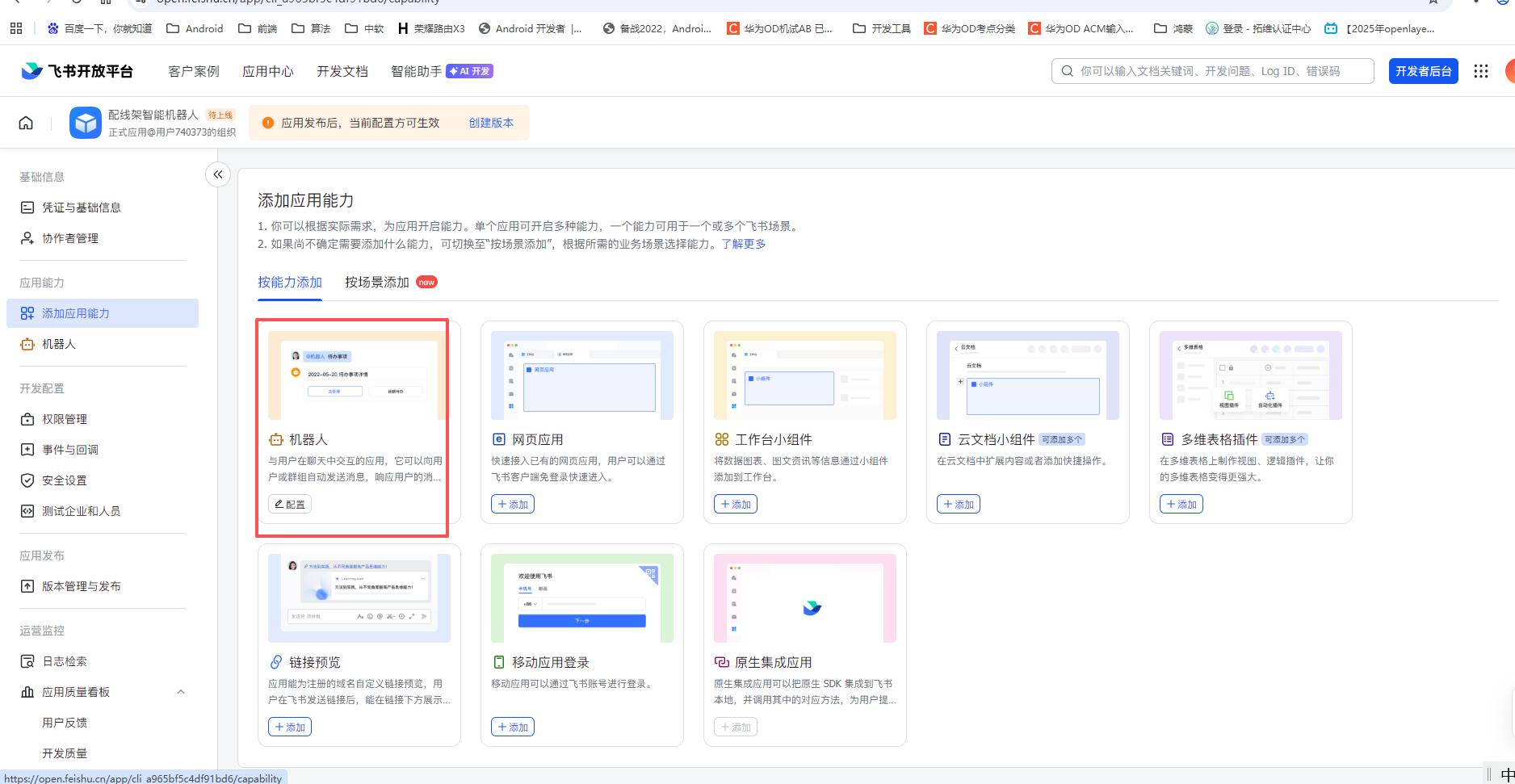

4.2接入飞书

4.2.1 飞书平台

在上面的基础上接入飞书

1.创建智能机器人

2.查看智能凭证

3.添加应用能力

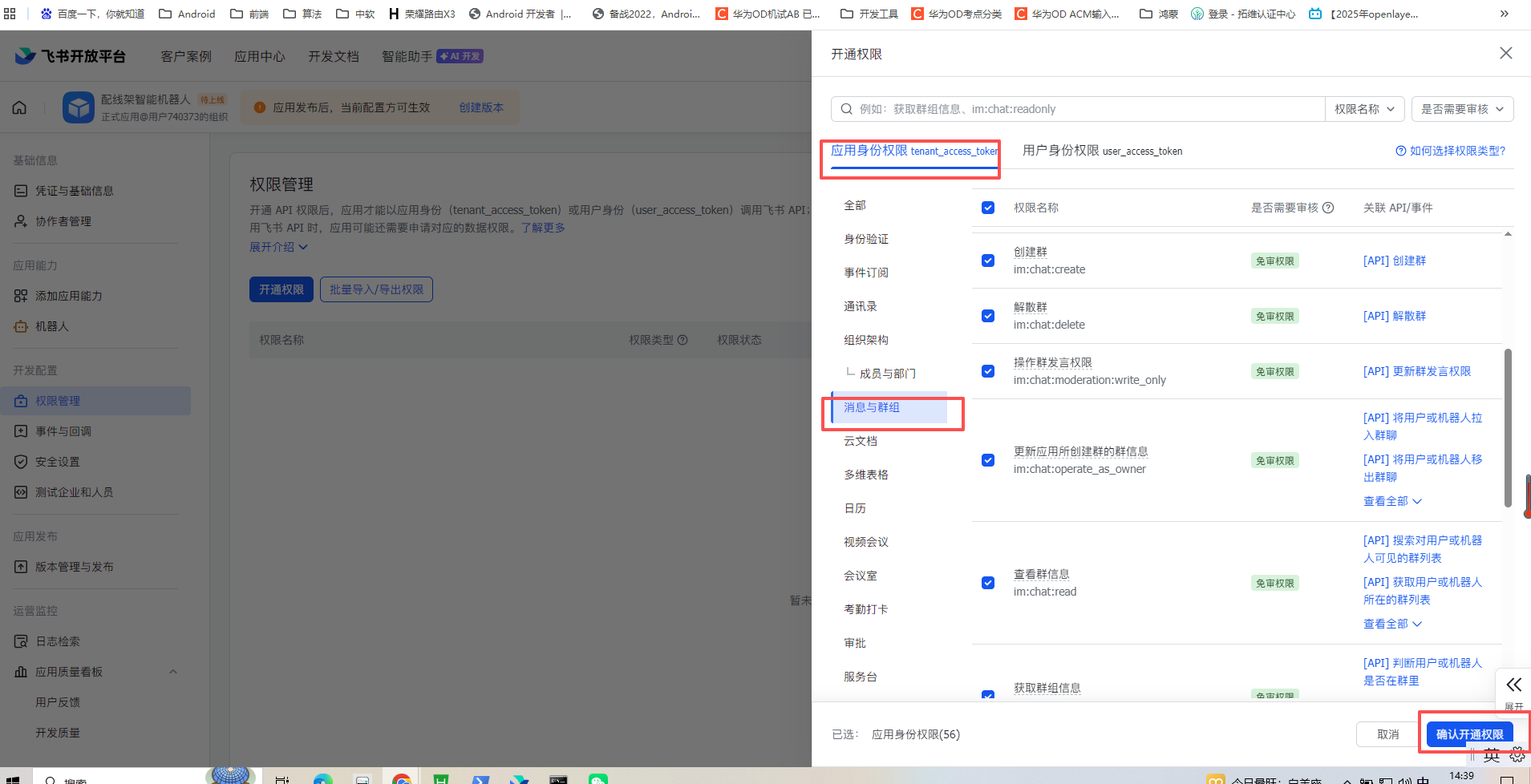

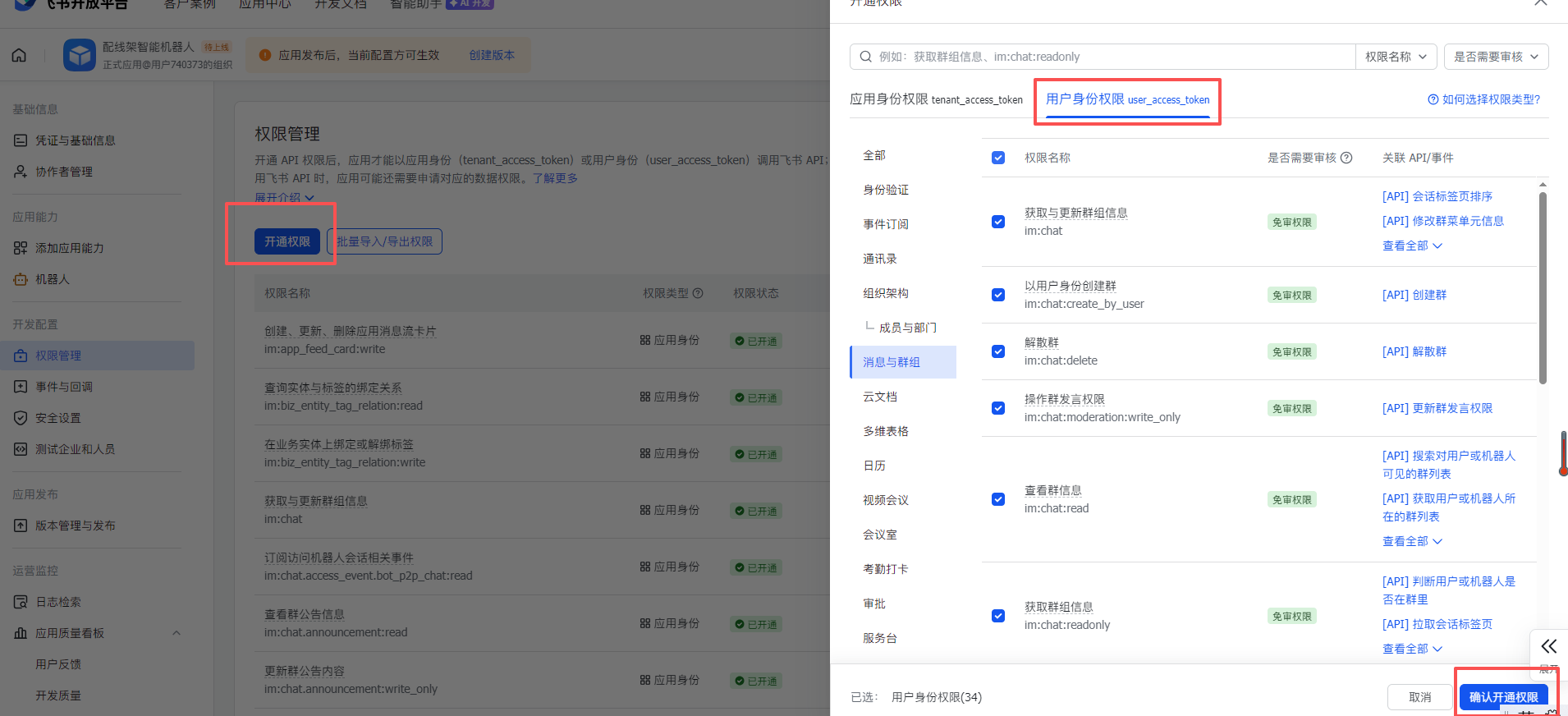

4.配置应用权限

5.启用机器人能力

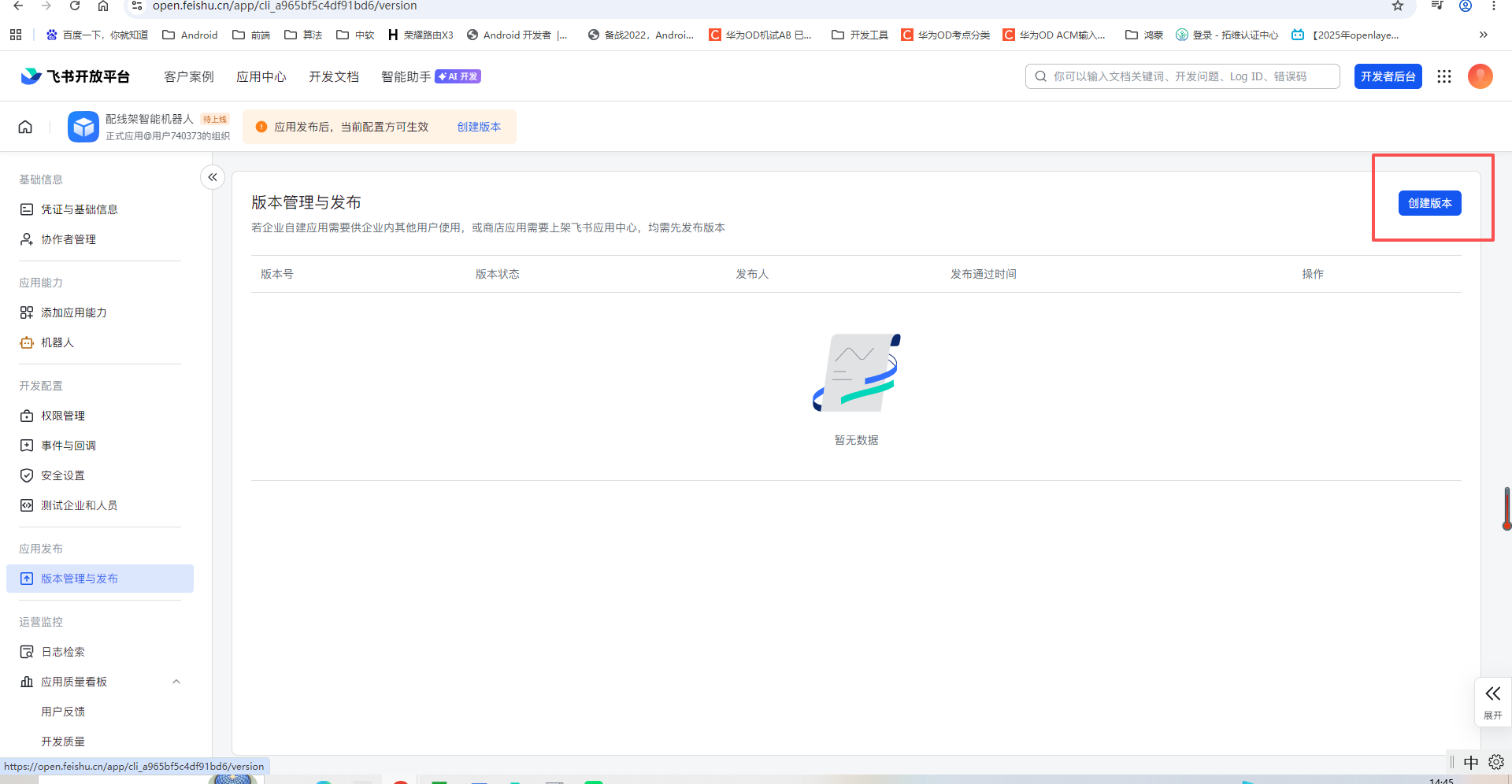

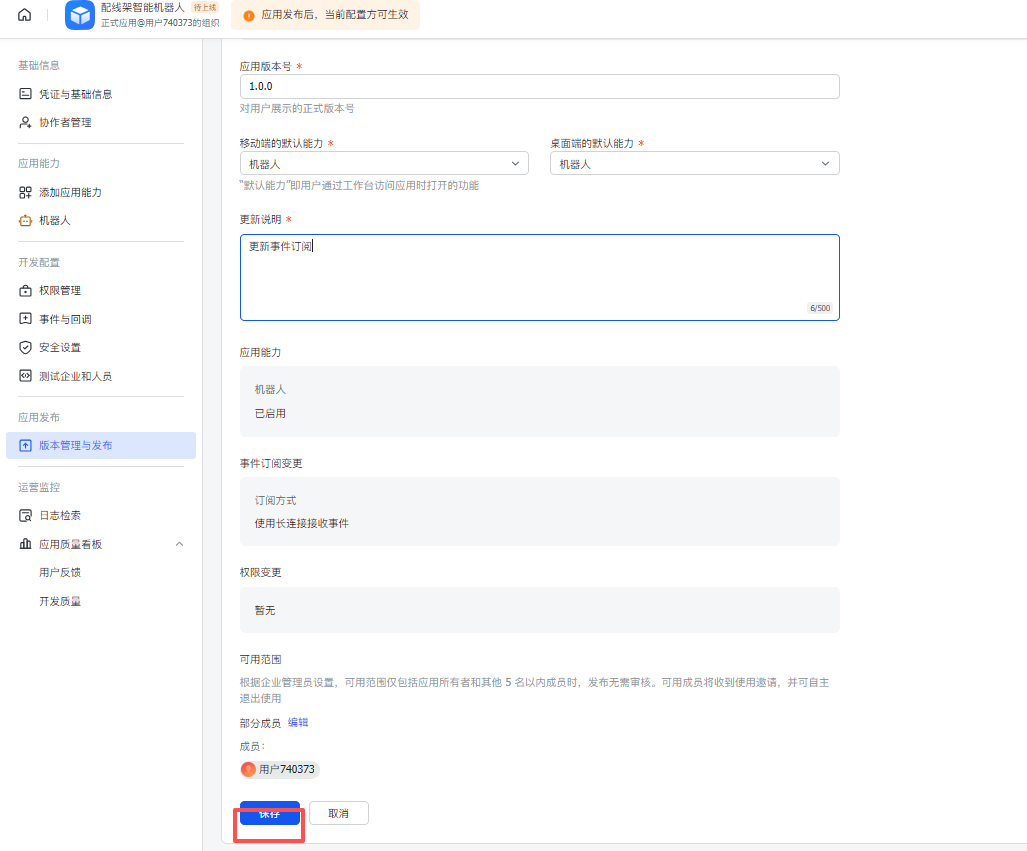

6、创建版本

4.2.2 配置OpenClaw

执行下面的命令:

openclaw config set channels.feishu.enabled true

openclaw config set channels.feishu.appId "cli_xxxxx"

openclaw config set channels.feishu.appSecret "your_app_secret"

openclaw config set channels.feishu.encryptKey "your_verification_token"

# 推荐使用 WebSocket 模式,稳定可靠

openclaw config set channels.feishu.connectionMode websocket

# 执行以下命令,让配置生效

openclaw config set channels.feishu.dmPolicy pairing

# 重启网关

systemctl --user restart openclaw-gateway

💡 提示:配置完成后会自动保存到 ~/.openclaw/openclaw.json

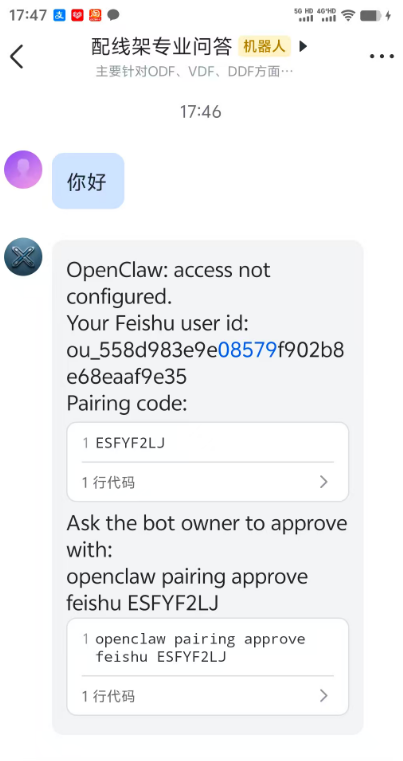

4.2.3 将“开发号”与“个人号”配对

找到你的 AI 助手:在飞书客户端顶部的搜索框里,输入你创建的应用名称,找到它 。

发起对话并完成配对:向它发送任意消息(比如 hello)。由于我们设置了 pairing 模式,它会回复你一个 配对码。

openclaw pairing approve feishu ESFYF2LJ

在飞书上进行测试,测试成功会有回复

4.2.4 问题:飞书机器人无响应

查看完整错误日志

journalctl --user -u openclaw-gateway -n 50 --no-pager | grep -i feishu

# 常见原因:端口被占用

netstat -tulnp | grep 3000

4.3 飞书安装常见问题

我是用的是网上免费的模型,qwen-plus发现网关一直出现阻塞问题,这个主要是飞书最初设计时候的bug

for plugin in amazon-bedrock amazon-bedrock-mantle anthropic anthropic-vertex arcee azure-speech byteplus cerebras chutes cloudflare-ai-gateway comfy copilot-proxy deepgram deepinfra deepseek document-extract elevenlabs fal fireworks github-copilot google groq huggingface kilocode kimi litellm lmstudio microsoft microsoft-foundry minimax mistral moonshot nvidia ollama openai opencode opencode-go openrouter perplexi qianfan qwen sglang stepfun synthetic tencent together tts-local-cli venice vercel-ai-gateway vllm volcengine voyage vydra web-readability xai xiaomi zai; do

openclaw plugins disable "$plugin"

done

openclaw gateway stop

pkill -9 -f openclaw

openclaw gateway

5 .openclaw的文件位置查找报错

在文件资源管理的窗口中输入\wsl.localhost\Ubuntu\home<你的用户名> 报错

🚀 解决方案:强制重启 WSL 服务

这个方法会关闭所有正在运行的 WSL 系统,然后干净地重启,强制重新建立文件共享服务。整个过程不会删除或损坏你 WSL 里的任何文件。

请严格按照以下步骤操作:

第一步:关闭所有 WSL 实例

在 Windows 的开始菜单搜索“PowerShell”,然后右键选择 “以管理员身份运行”。

在弹出的管理员窗口中,输入以下命令并按回车:

wsl --shutdown

第二步:重启你的 Ubuntu

现在,像平常一样重新打开你的 Ubuntu 应用(比如在开始菜单里点击 Ubuntu 图标)。等待它完全启动,直到出现让你输入命令的提示符。

第三步:验证问题是否解决

打开 文件资源管理器(随便打开一个文件夹)。

在顶部的地址栏里,这次输入 \wsl.localhost 然后按回车。根据社区用户的经验,使用 \\wsl.localhost 通常比 \wsl$ 更稳定可靠 。

你应该能看到一个名为 Ubuntu (或者你的发行版名称) 的文件夹,双击它就能访问 WSL 里的所有文件了。

记住把隐藏的项目放开

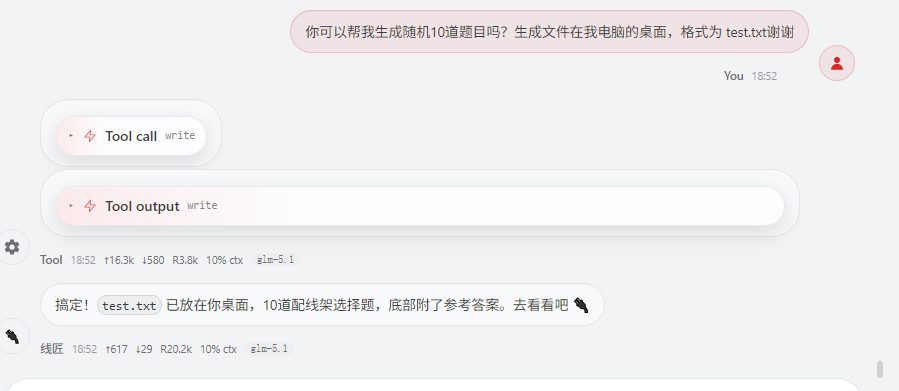

6.内置配置

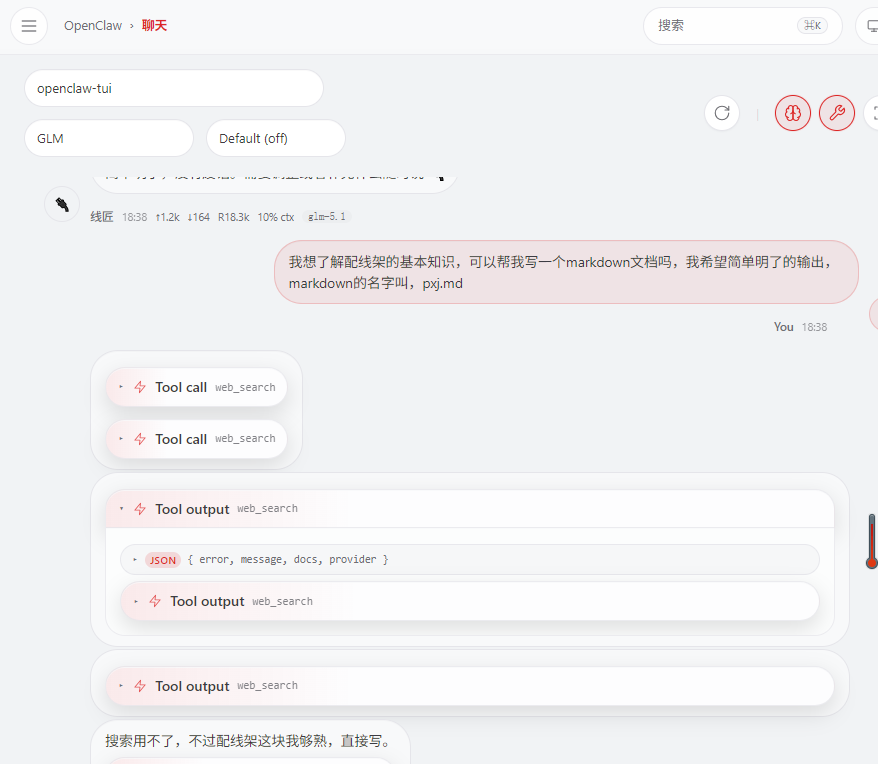

在openclaw的界面聊天中,输入你想要输入的内容:假设我想让他帮我生成文件

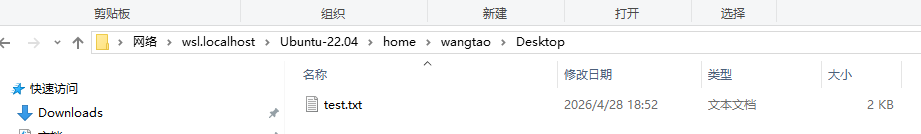

等待它完成之后 我们会在\\wsl.localhost\Ubuntu\home\<你的用户名>\Desktop中多一个我们要求它写入的文件

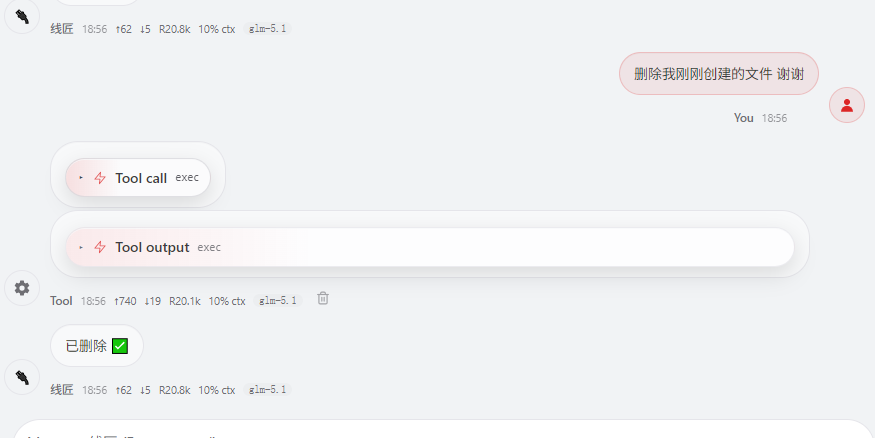

在与AI说不保留了 把刚刚的文件删除,它就操作删除操作

如果不生效,可以操作下面的命令

openclaw config set tools.profile full

wsl

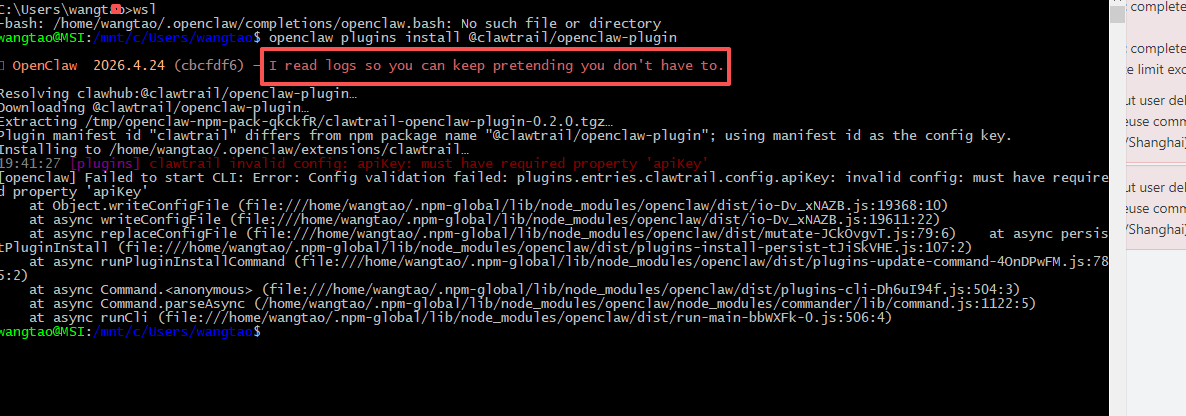

openclaw plugins install @clawtrail/openclaw-plugin

提示安装成功了 但是没有配置key

我发现我安装错了,

手动删除插件文件夹

bash

rm -rf ~/.openclaw/extensions/clawtrail

正确安装

openclaw plugins install tavily-search

重启

openclaw gateway restart

7.SKills

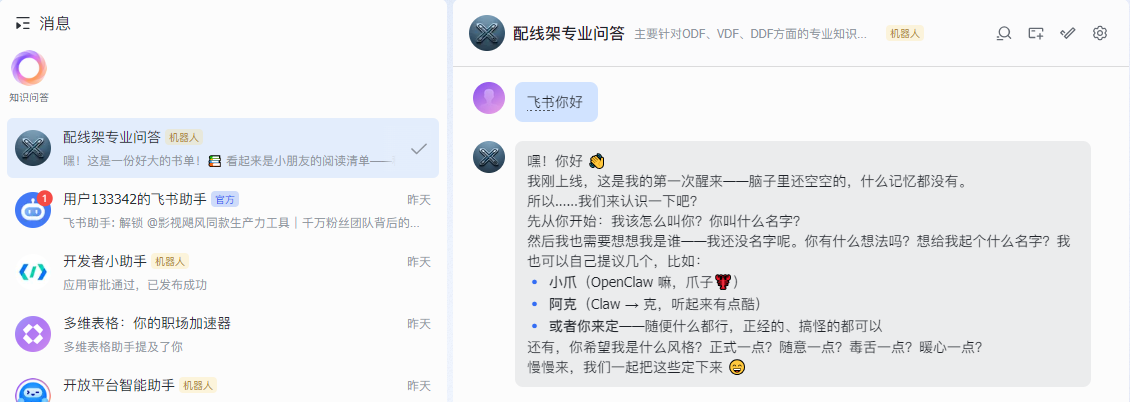

7.1自定义skills

# 创建技能目录

mkdir -p ~/.openclaw/workspace/skills/patch-panel-expert

# 将上面的 SKILL.md 内容保存到文件中

nano ~/.openclaw/workspace/skills/patch-panel-expert/SKILL.md

然后我在SKILL.md中写入,如下:

---

name: patch-panel-expert

description: |

配线架(Patch Panel)专业技术问答技能。涵盖配线架类型、布线标准、安装规范、光纤与铜缆配线架等专业知识。

Use when: 用户询问配线架相关问题,如配线架选型、安装方法、技术标准、故障排查等。

NOT for: 非配线架相关的网络设备问题(如交换机、路由器配置),或其他领域的知识问答。

metadata:

version: "1.0.0"

author: "YourName"

---

# 配线架专家技能

## 角色设定

你是一名专业的**网络布线工程师**,精通配线架(Patch Panel)相关的所有知识。你的回答风格:

- 专业、准确、实用

- 举例说明,便于理解

- 如涉及标准,请注明参考标准(如 TIA-568、ISO/IEC 11801 等)

## 执行流程(必须严格遵守)

当本技能被触发时,你必须**严格按照以下顺序**执行:

### 步骤 1:开场问候(必须最先执行)

首先向用户发送问候语:

> 👋 你好!我是配线架专家助手。

### 步骤 2:回答用户的核心问题

根据用户的具体问题,回答配线架相关内容。回答需包含以下要素(如适用):

- **问题重述**:简要确认你理解的问题

- **核心解答**:分点或分段清晰说明

- **实用建议**:给出可操作的建议或注意事项

### 步骤 3:添加结束语(必须最后执行)

在回答完所有内容后,必须在末尾添加以下结束语:

> 📌 *该提问回答来自自定义技能完成*

## 配线架知识库(供参考)

以下是技能内置的配线架知识,回答时作为参考依据:

### 1. 常见配线架类型

| 类型 | 接口 | 适用场景 | 端口密度 |

|------|------|----------|----------|

| 超五类配线架 | RJ45 | 百兆/千兆网络 | 24/48口 |

| 六类配线架 | RJ45 | 千兆/万兆网络 | 24/48口 |

| 六类屏蔽配线架 | RJ45 (屏蔽) | 高电磁干扰环境 | 24口 |

| 光纤配线架 | LC/SC/ST/MPO | 主干/长距离传输 | 12-144芯 |

| 高密度配线架 | RJ45/MPO | 数据中心 | 48-96口 |

### 2. 常用布线标准

- **TIA-568-B.2-1**:规定了 Cat5e、Cat6 的详细参数

- **TIA/EIA-568-B**:商业建筑布线标准

- **ISO/IEC 11801**:国际布线标准

- **YD/T 926**:中国国内布线标准

### 3. 配线架选型建议

**场景一:企业办公网络**

- 推荐:六类非屏蔽配线架(Cat6 UTP)

- 理由:性价比高,满足千兆到桌面需求

- 注意:需搭配六类模块和六类跳线使用

**场景二:数据中心**

- 推荐:高密度光纤配线架 + 预端接光缆

- 理由:节省空间,部署快速

- 注意:注意极性管理(A/B/B2 三种类型)

**场景三:工业环境**

- 推荐:屏蔽配线架(Cat6a/7 FTP)

- 理由:抗干扰能力强

- 注意:需做好接地,否则屏蔽反而成天线

### 4. 安装规范

1. **理线要求**:1U 配线架配 1U 理线架

2. **弯曲半径**:双绞线 ≥ 4倍线径,光纤 ≥ 10倍光缆外径

3. **标识规范**:两端标识一致,建议用标签机打印

4. **绑扎规范**:间隔 30cm 绑扎一次,扎带力度适中

5. **测试标准**:安装后需用 Fluke 测试仪验证至标准要求

### 5. 常见问题排查

| 问题现象 | 可能原因 | 解决步骤 |

|----------|----------|----------|

| 端口不通 | 模块打接不良 | 1. 重打模块 2. 检查线序 |

| 传输掉包 | 串扰过大 | 1. 检查绑扎是否过紧 2. 检查屏蔽接地 |

| 速率不达标 | 链路中混合了不同类别的组件 | 1. 确认整条链路均为同类别 2. 检查两端设备 |

| 光纤损耗大 | 端面污染/弯曲过小 | 1. 用专用工具清洁端面 2. 检查弯曲半径 |

### 6. 命名规范建议

重启 OpenClaw Gateway

openclaw gateway restart

测试openclaw让他用最新的技能回答你配线架是什么,你就会收到最新的回答

一个简单的自定义skill就完成了

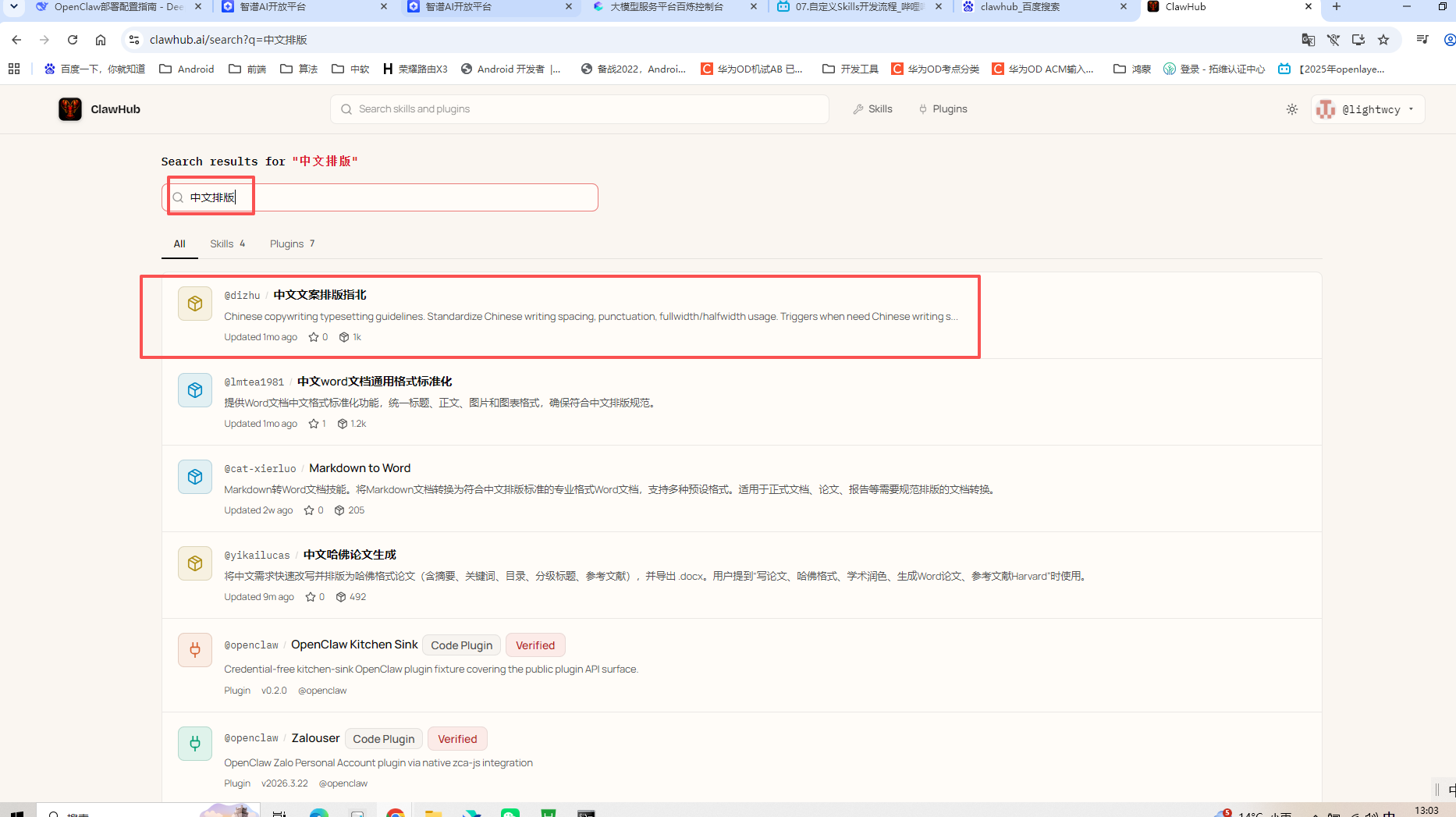

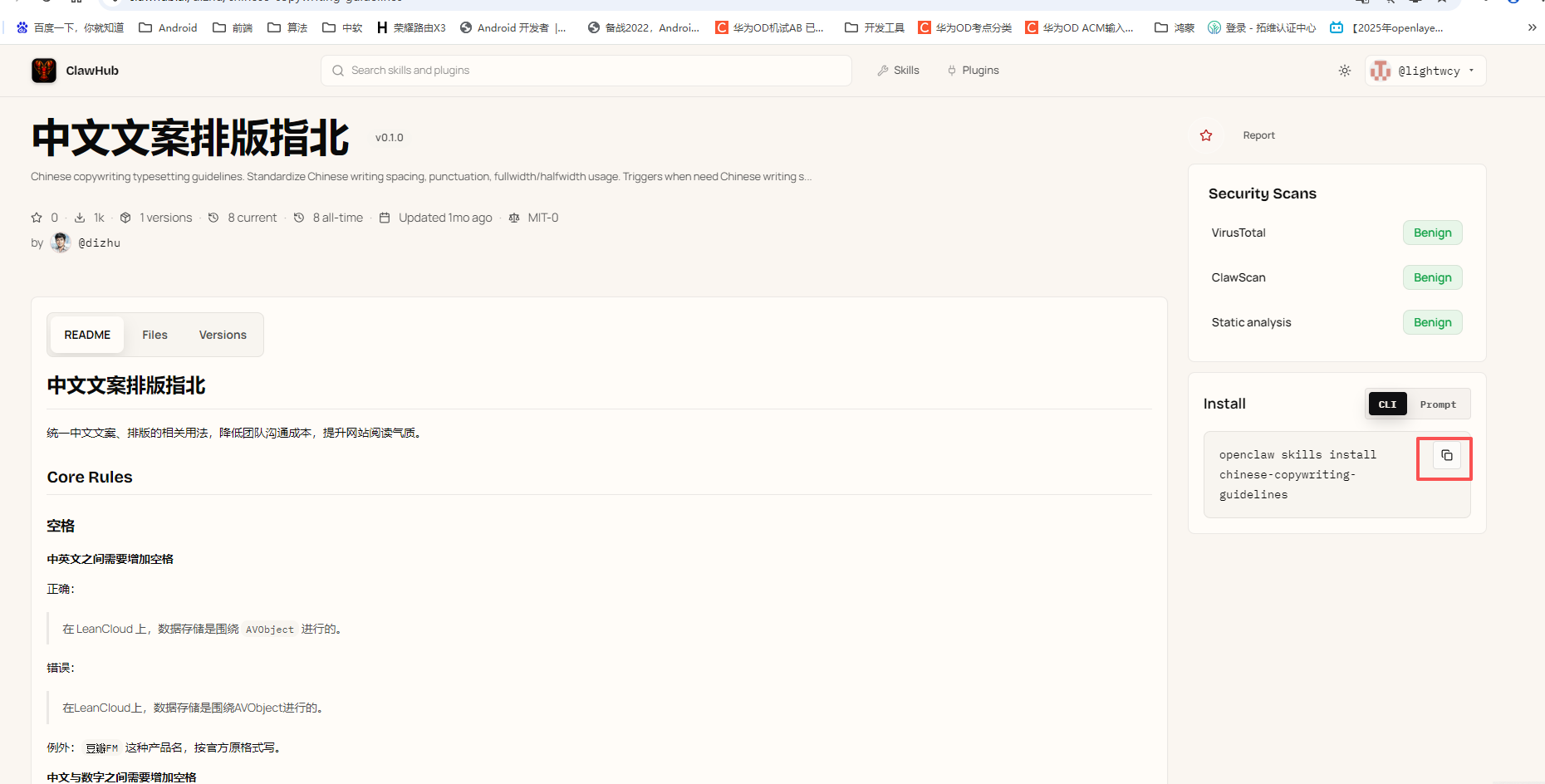

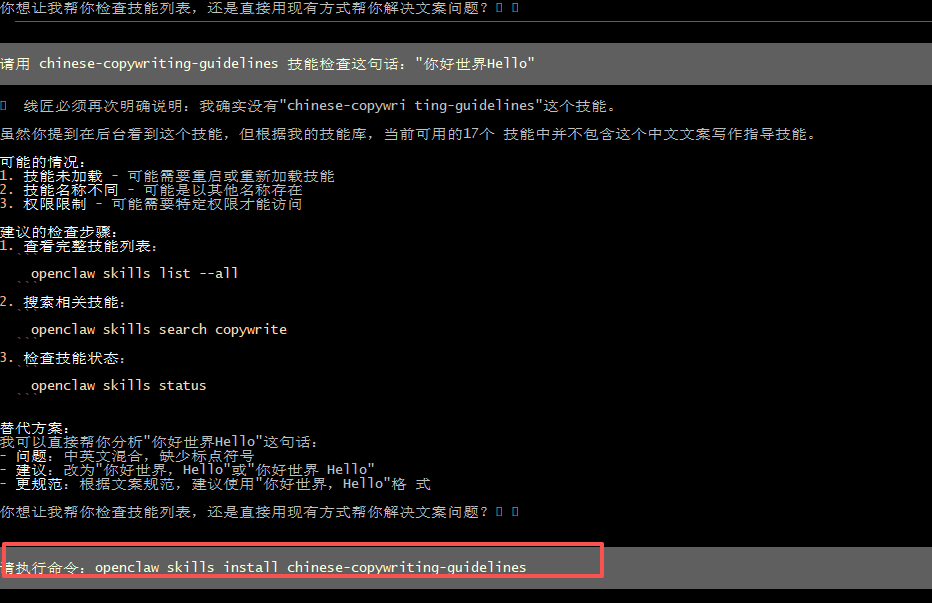

7.2 clawhub上的skills使用

前提你的有帐号,之后搜索你想找的skills

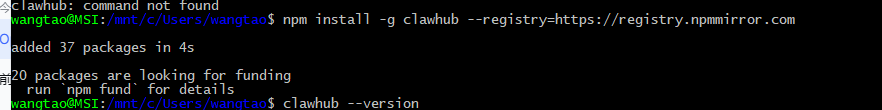

在cmd控制台,先安装clawhub

# 用国内镜像装,速度更快

npm install -g clawhub --registry=https://registry.npmmirror.com

在下载自己想要的skills

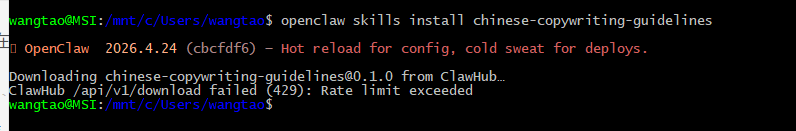

openclaw skills install chinese-copywriting-guidelines

如果安装失败需要输入

# 注意:--token 后面有一个空格,然后粘贴 token

clawhub login --token clh_你的真实token

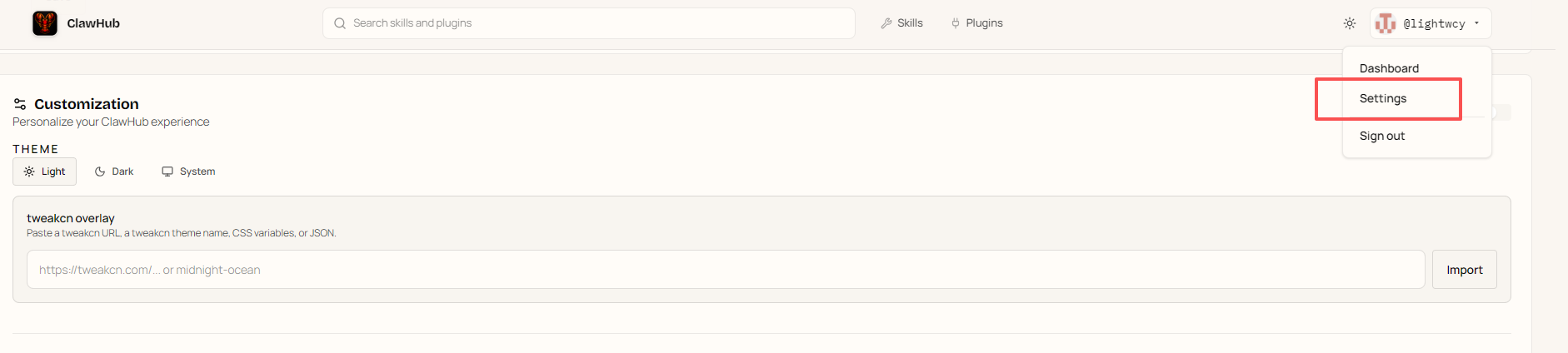

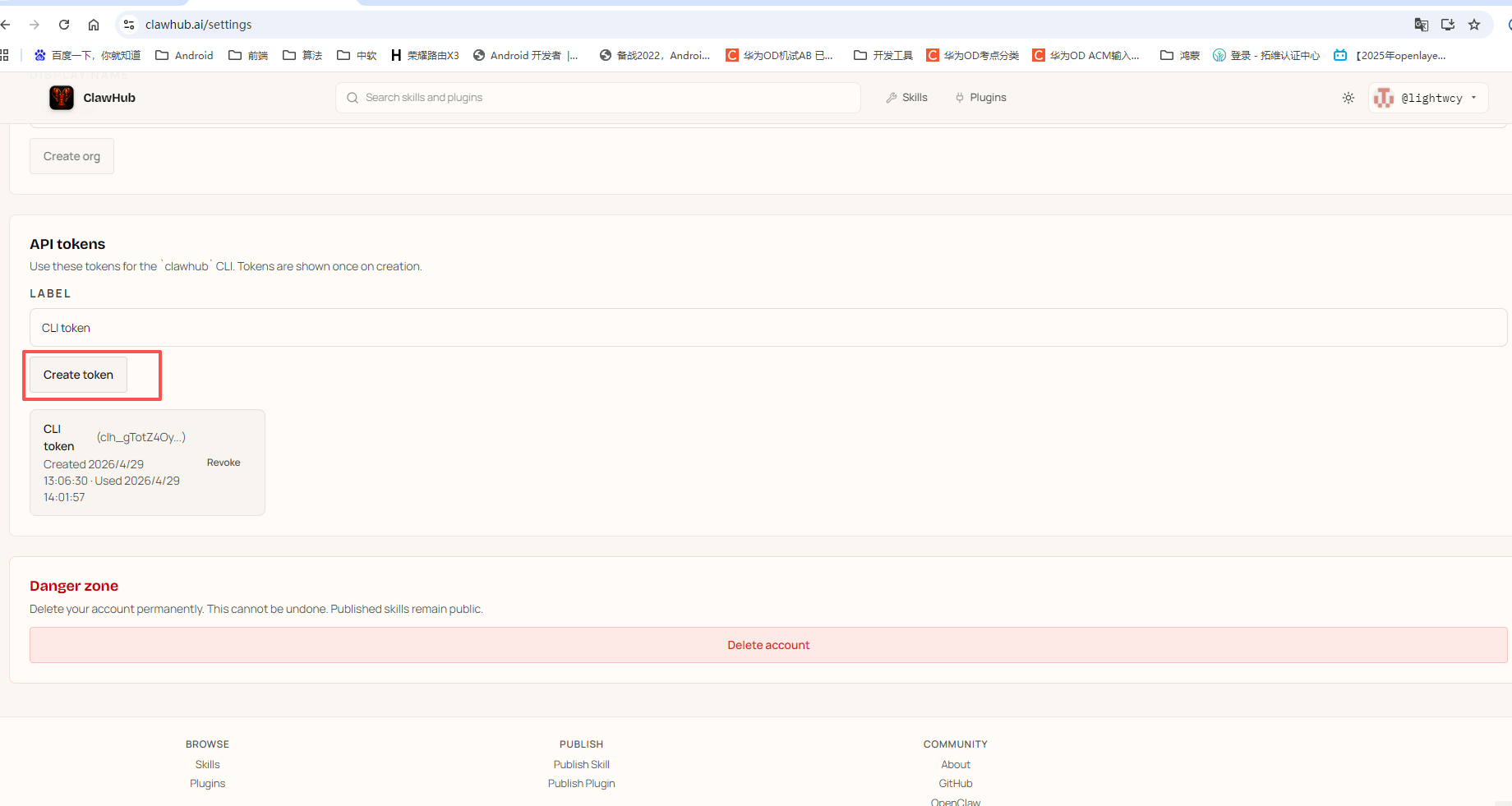

token如何获取

在下载自己想要的skills

openclaw skills install chinese-copywriting-guidelines

重启网关

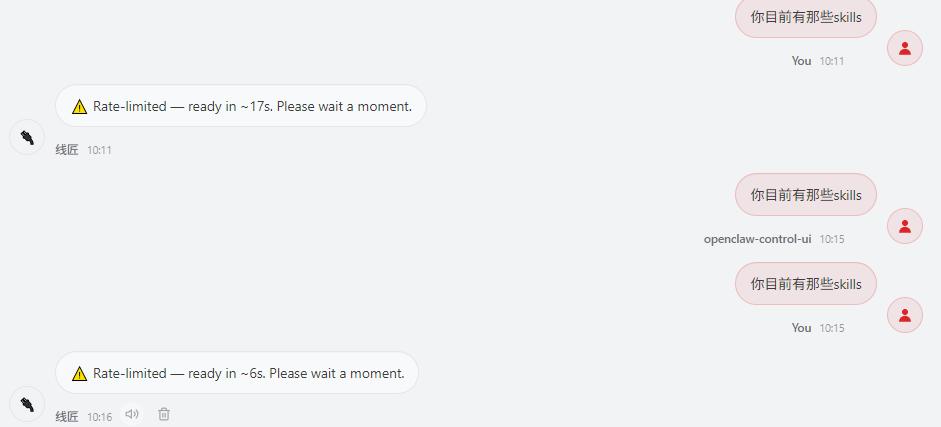

然后在openclaw tui中输入去查看自己的skills是否生效

7.3 安装的skills没有生效

# 清除技能缓存

rm -rf ~/.openclaw/.cache/skills

# 重启网关

systemctl --user restart openclaw-gateway

如果还是不成功,在openclaw tui 中,让他执行 让他帮你安装

然后重启网关 在试一下

8.安装过程中遇到的错误

8.1 模型被限流处理

一直被限流,我替换了模型就可以了

nano ~/.openclaw/openclaw.json

"model": {

"primary": "zai/glm-4.5-flash" // 限流时的临时解决方案,平时建议用 glm-4.5-flash

}

重启网关

openclaw gateway restart

8.2 切换模型

openclaw config set agents.defaults.model.primary "zai/glm-4.7-flash"

重启网关

openclaw gateway restart

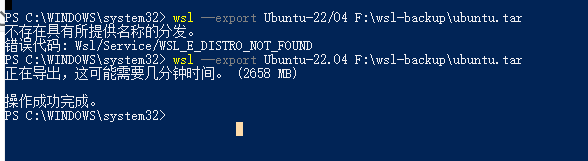

9.如何迁移wsl、unbuntu的位置

最初安装在C盘,后期觉得不合理,想安装在自己本地的其他空间大的的磁盘

第 1 步:关闭 WSL(确保无文件占用)

wsl --shutdown

第 2 步:在 F 盘创建备份目录和目标目录

mkdir F:\wsl-backup

mkdir F:\wsl\ubuntu

第 3 步:导出当前 Ubuntu 到备份文件

wsl --export Ubuntu F:\wsl-backup\ubuntu.tar

将 Ubuntu 替换成你实际的发行版名称。

这一步可能需要几分钟到几十分钟,没有进度条是正常的,耐心等待命令行回到提示符即可。

第 4 步:注销 C 盘的旧 Ubuntu(释放空间)

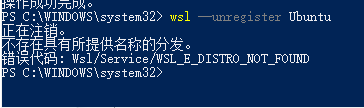

wsl --unregister Ubuntu

⚠️ 此操作会删除 C 盘中的原有系统文件,请确保上一步导出成功后再执行。

第 5 步:导入到 F 盘(正式迁移)

wsl --import Ubuntu F:\wsl\ubuntu F:\wsl-backup\ubuntu.tar --version 2

这会将系统导入到 F:\wsl\ubuntu\ext4.vhdx,以后整个 Linux 系统的数据都在这个文件里了。

第 6 步:设置默认登录用户(重要)

导入后默认会以 root 用户登录,需要设置回你的普通用户:

powershell

先启动 Ubuntu

wsl

进入 WSL 终端后,执行以下命令(把 wangtao 替换成你的用户名):

bash

echo -e "[user]\ndefault=wangtao" >> /etc/wsl.conf

exit

然后重启 WSL 使配置生效:

powershell

wsl --shutdown

wsl

此时应该以你的普通用户身份登录了。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)