智能体架构模型

智能体架构模型

前面我们已经完成了天机AI助手智能体功能的开发,实际上我们实现的方式只是最为基础的一种模式,一般应用系统中的智能体架构有6种,分别是:

- 增强型智能体

- 链式工作流智能体

- 路由工作流智能体

- 并行工作流智能体

- 协调器工作流智能体

- 评估优化工作流智能体

下面,我们一起来了解下这6种架构模式,重点要关注:路由工作流智能体。

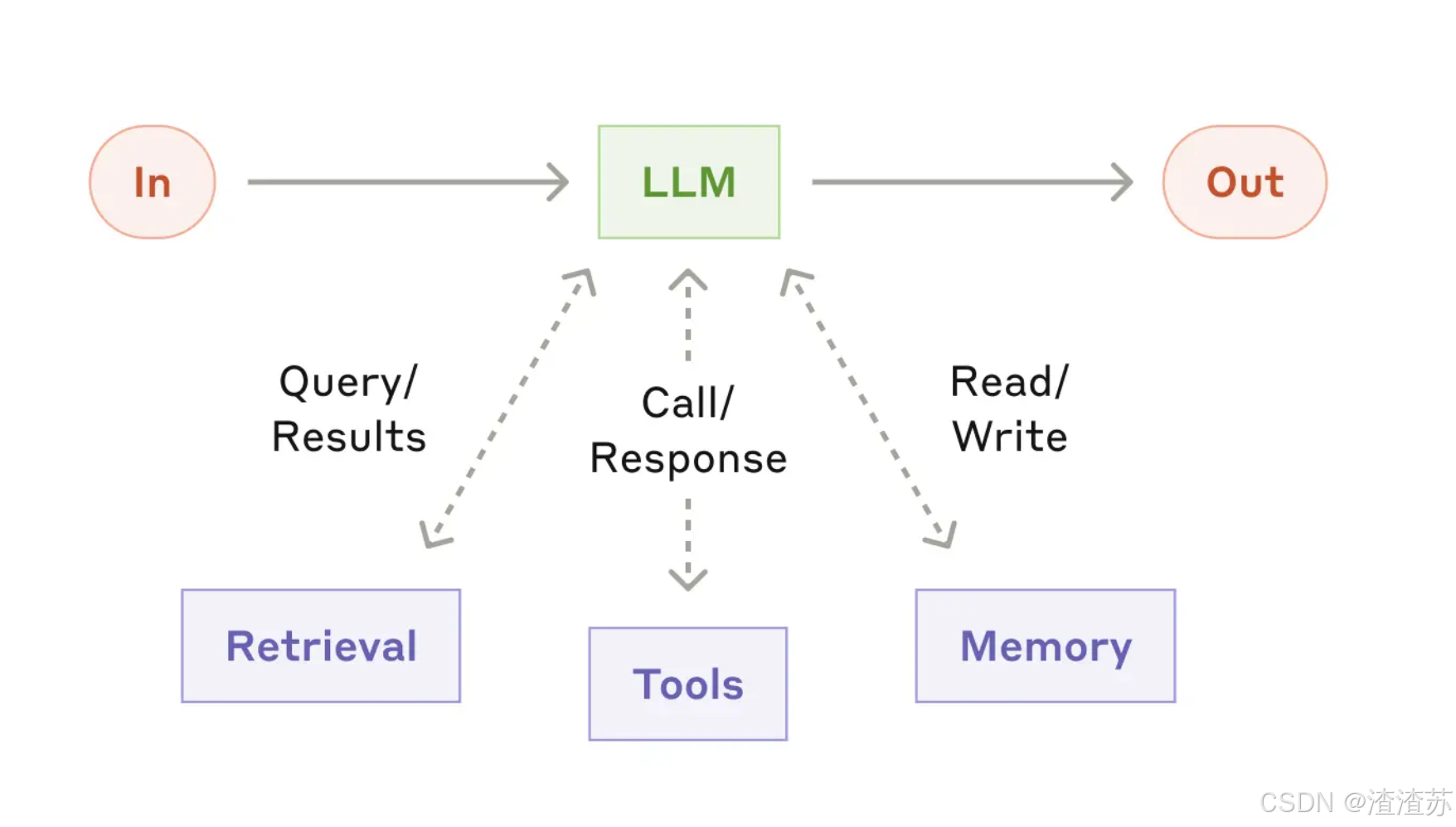

增强型智能体

增强型智能体的基本构建块是一个增强的LLM,其中包含检索、工具和记忆等增强功能。

来自:https://www.anthropic.com/engineering/building-effective-agents

📚 模式说明:

- 输入输出系统:整个流程是线性的,就是从输入到大模型(LLM),再到输出。简单来说,就是 Input → LLM → Output。

- 大模型(LLM):它就像个中央处理器,负责协调三个主要的功能模块——检索(Retrieval)、工具(Tools)和记忆(Memory),一起来完成信息处理。

- 这种模型,适用于业务不是很复杂的场景。

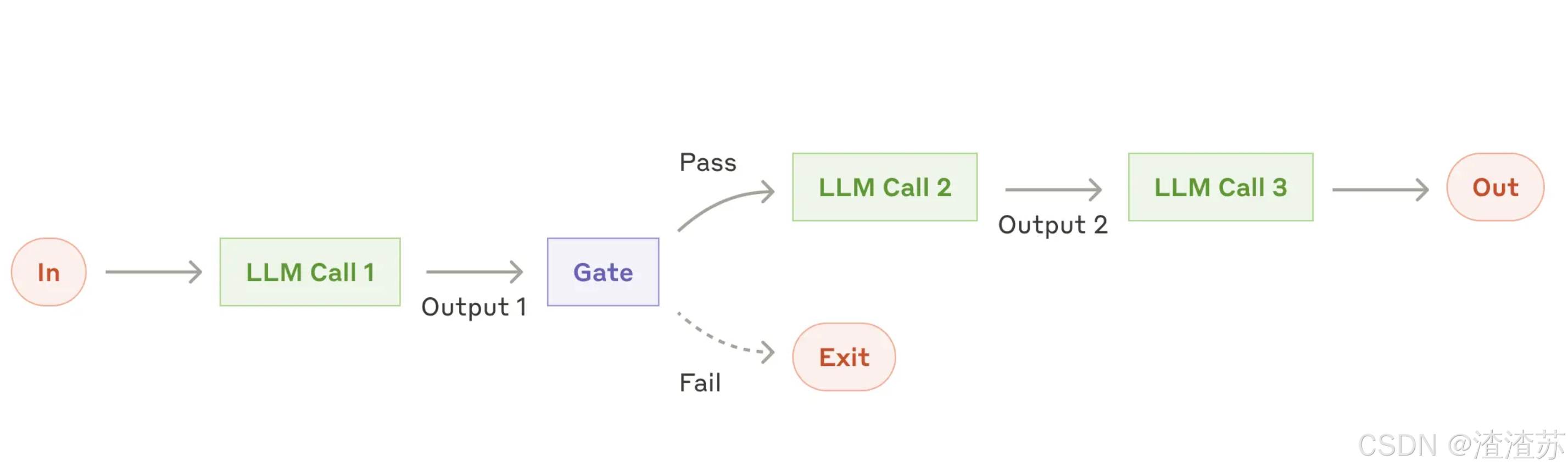

链式工作流智能体

工作流智能体模式,就是将任务分解为一系列步骤,其中每个LLM调用处理上一个步骤的输出,通过多步骤LLM调用分阶段处理复杂任务。

来自:https://www.anthropic.com/engineering/building-effective-agents

📚 模式说明:

- **顺序分解:**将任务拆解为 LLM Call 1 → LLM Call 2 → LLM Call 3 的固定步骤链。

- **中间检查(Gate):**在第一步输出后插入 Gate 决策点,实现中间验证阻断错误传播。

- 上下文传递:Output 1 作为 LLM Call 2 的输入,Output 2 作为 LLM Call 3 的输入,通过链式传递上下文保持任务连贯性。

- 这种模式适用于任务比较复杂,但处理流程固定的场景

- 比如:写文章 → 生成大纲 → 校验大纲 → 依据大纲编写内容 → 对内容校验 → 最后输出。

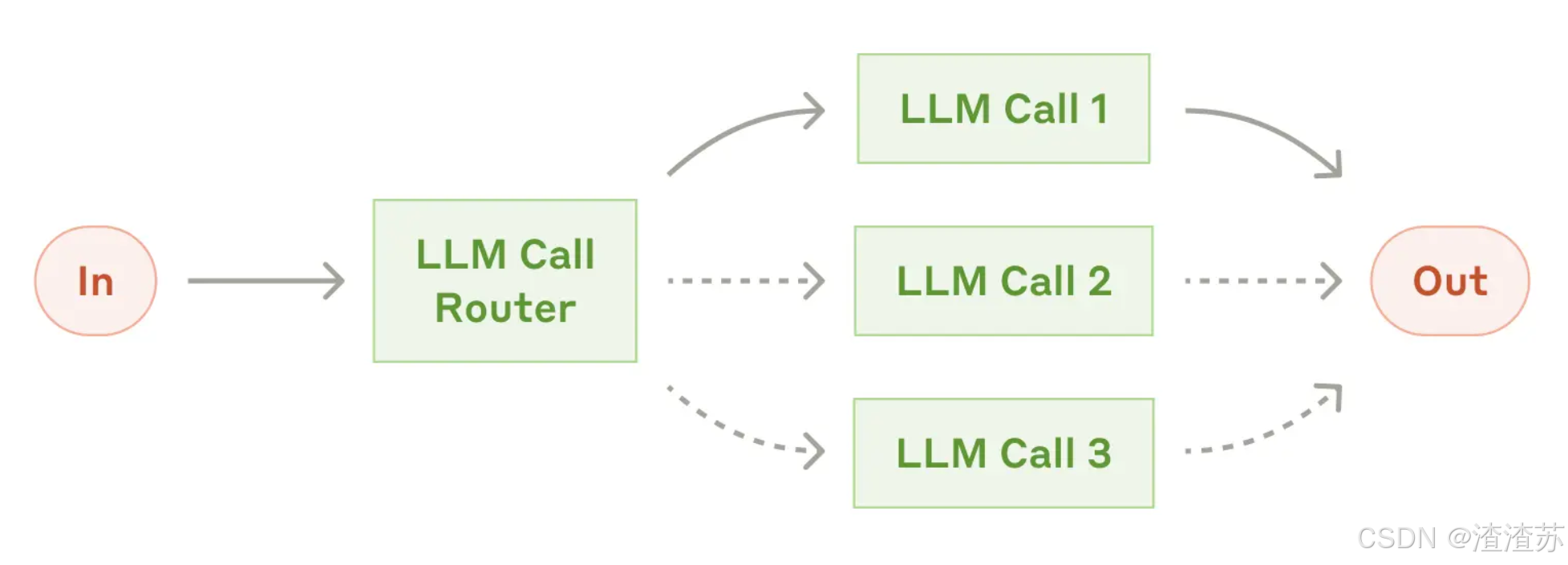

路由工作流智能体

路由工作流智能体,这种模式是将输入通过 **LLM Call Router **对意图识别,再交由下游的 **LLM **执行。

来自:https://www.anthropic.com/engineering/building-effective-agents

📚 模式说明:

- 动态路径选择:Router 节点根据输入特征(如内容类型、用户意图)决定调用哪个LLM。

- 集中式决策:所有输入需先经过Router(而非直接调用LLM),使用路由控制器降低业务系统之间的耦合度。

- 可扩展性:图中预设3个LLM调用路径,实际上,可扩展更多分支,也就是说,路由模式可以灵活的增减处理模块,比较灵活。

- 这种模式适用于复杂业务,并且后续的处理逻辑比较独立的场景。

- 比如:天机AI助理,推荐课程、查询课程、购买课程,这都是独立的业务,可以用独立的智能体实现。

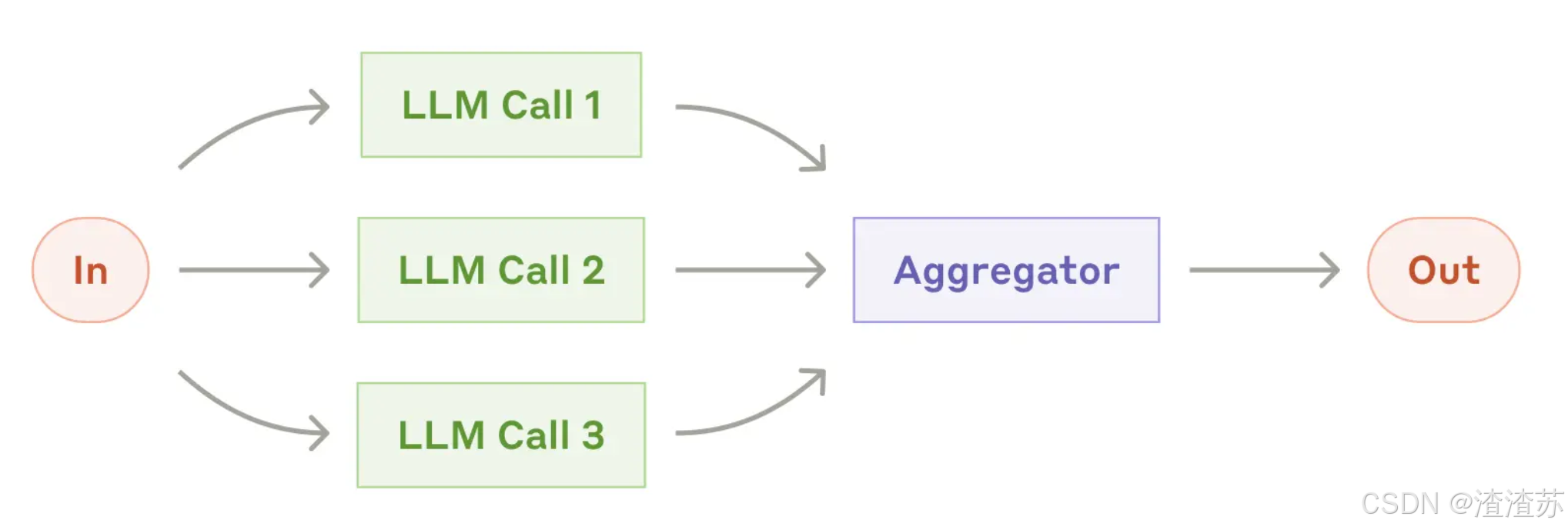

并行工作流智能体

并行工作智能体,是值一个输入同时交给多个LLM去执行,再将这些大模型的输出进行汇总处理,再输出。

来自:https://www.anthropic.com/engineering/building-effective-agents

📚 模式说明:

- 任务并行拆分:输入(In)同时分发给 LLM Call 1/2/3 并行处理,通过并发执行独立子任务提升效率。

- 结果聚合策略:通过 Aggregator 模块整合多个LLM输出,用冗余计算换取结果可靠性。

- 模块化隔离:各LLM节点无直接依赖关系(仅通过Aggregator连接),降低单点故障风险的容错设计。

- 这种模式,一般会在两种场景中使用:

- 将一个任务,拆分成多个子任务,并行执行,提升效率。

- 例如:需要开发一个多维度内容审核系统,包括:是否含攻击性言论、关键数据是否准确、是否引用未授权内容等检测,这些检测可以并行执行,提升系统效率。

- 将同一个任务,由不同的大模型执行多次,得到不同的输出,再聚合处理,以得到更准确的结果。

- 例如:如医疗诊断辅助、金融风险评估

- 将一个任务,拆分成多个子任务,并行执行,提升效率。

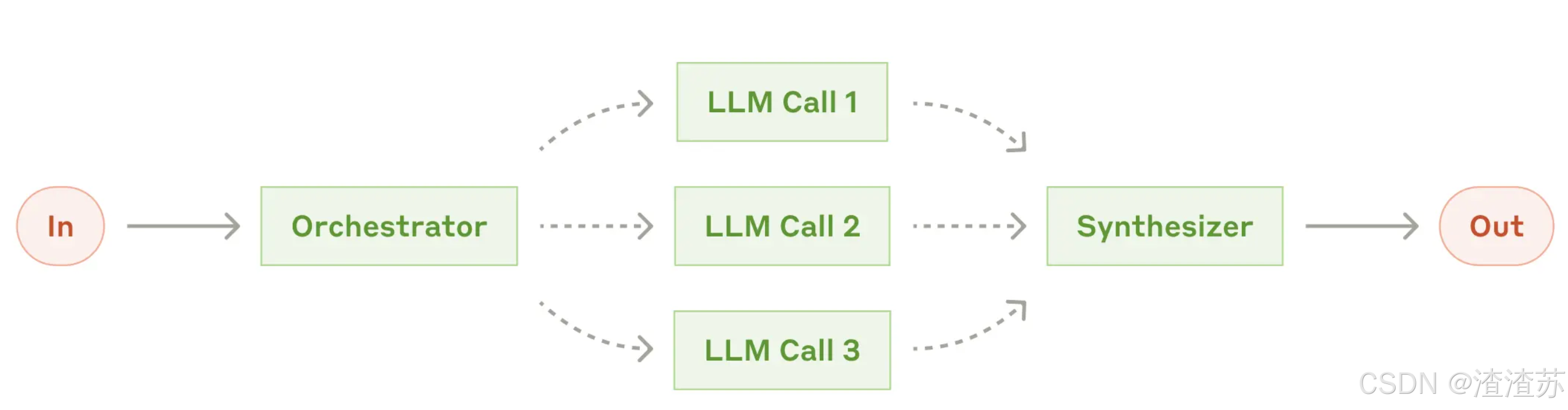

协调器工作流智能体

协调器工作流智能体,这种模式是,由Orchestrator LLM作为智能调度中心,**动态生成**子任务列表,子任务可以是并行或串行执行,结果由Synthesizer进行聚合输出。

📚 模式说明:

- 动态任务分解: Orchestrator 担任智能调度的核心角色,能够利用大型语言模型(LLM)动态地生成子任务列表。

- 异构模型协同工作: 通过并行或串行方式调用多个大型语言模型,并依据各个子任务的具体需求选择最适合的模型执行,以此实现高效的资源分配策略。

- 结果智能化整合: Synthesizer 采用语义融合技术,确保来自不同模型的结果在最终输出时达到高度的一致性和连贯性。

- 这种工作流程适合处理复杂且细节不确定的任务(如编程时根据实际情况修改文件)。它看起来像并行处理,但更灵活:任务不是预先定义好的,而是由协调器根据进展动态分配和调整。

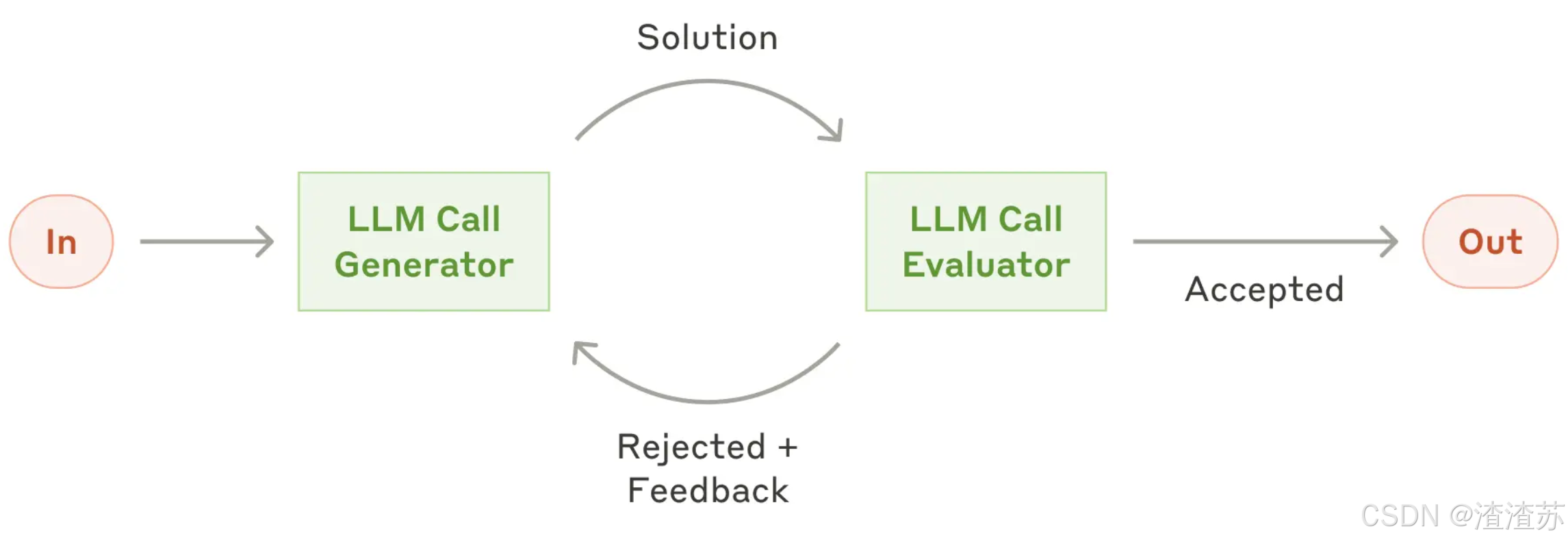

评估优化工作流智能体

评估优化工作流智能体,是这一种 生成 → 评估 → 反馈 循环反馈的机制。

:::info

📚 模式说明:

-

生成阶段(Generator):产生初始解决方案(Solution)

-

评估阶段(Evaluator):验证输出质量,可以选择Accepted(认可)或 Rejected+Feedback(拒绝+反馈)

-

决策阶段:根据评估结果选择终结输出或重新生成

-

举例:

-

场景:

- 在文学翻译领域,译者型语言模型(LLM)可能在初次尝试时未能完全把握文本中的细微差异,但评估型语言模型(LLM)能够对此提供具有建设性的反馈。

- 在执行复杂的搜索任务时,往往需要通过多轮的搜索与分析来确保信息收集的全面性。在此过程中,评估者将根据已获取的信息质量及完整性,判断是否有必要展开进一步的搜索活动。

:::

总结

| 模式名称 | 控制方式 | 延迟水平 | 可靠性 | 典型应用场景 | 开发复杂度 |

|---|---|---|---|---|---|

| 增强型智能体 | 直接输出 | 最低 | 低 | 简单问答、内容润色 | 简单 |

| 链式工作流智能体 | 线性顺序执行 | 中等 | 中高 | 分阶段任务(如大纲→内容→格式优化) | 中等 |

| 路由工作流智能体 | 条件分支选择 | 低-中等 | 中 | 多领域处理(如客服分流转人工) | 中等 |

| 并行工作流智能体 | 多模型并发执行 | 中等 | 高 | 可靠性敏感任务(如医疗诊断辅助) | 较高 |

| 协调器工作流智能体 | 动态任务分解+调度 | 高 | 最高 | 复杂业务(如商业智能分析系统) | 极高 |

| 评估优化工作流智能体 | 迭代优化+反馈修正 | 最高 | 极高 | 质量敏感场景(如法律文件生成) | 高 |

模式选型建议,根据业务需求选择:

- 简单任务 → 增强型智能体 / 链式工作流智能体

- 多分支处理 → 路由模式

- 高实时性 → 并行化(需任务可拆分)

- 超复杂任务 → 协调器工作流智能体

- 超高可靠性 → 评估优化工作流智能体

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)