Deep Agents 框架-基础篇

引言

本节主要介绍deepagents,这是新出来的,更上层的API。前面已经讲过langchain和langgraph,这里涉及重复的地方可能只会简单介绍一下。langchain、langgraph、deepagents三者之间的关系从功能定位上容易看出他们之间的抽象层级关系 langgraph --> langchain-->deepagents。deeagents定义是更高级别抽象,是harness架构的一个实践者。官方的建议是简单的用langchain,复杂的工作流用langgraph,更高级的长期运行的任务用deepagents(包括环境隔离,上下文管理、虚拟文件系统、沙箱环境等)。这句话你咋一看好像是懂了,但是当你接触到一些API示例的时候,你发现这段话的埋的坑特别深。因为你一开始的时候,你并不知道你的系统有多复杂,于是你信了他的鬼话(已近写了很多代码),后面你发现你的东西越来越复杂,你需要用图,这时候开始使用图API改造你langchain代码,这时候后你就开始意识到我为啥不一开始就用langgraph写以前我的逻辑(统一风格),我浪费这个时间重写我这个代码干嘛?用图的API写langchain代码比起重构那肯定是比起重构要节约很多时间(pyhon体系的毛病来了,默认忽略工程化,虽然一直在努力)。现在又来了一个deepagents,这个更高级的API鼓吹是提供了更多更高级的功能,所以你的第一印象是deepagents应该是会更好用,不用关心langchain、langgraph、代码全部用deepagents写。如果你这样想,那就是太天真了,如果你不懂langchain、langgraph,你根本没法玩deepagents。deepagents这玩意至少到目前为止,不是一个独立完整的框架。理想的场景是即使deepagents依赖于langgraph、langchain,也要把他们的能力包装到deepagents,对使用者来说,看到deepagents就行了。但是实际上不是的,deepagents的代码多半会存在langchain和langgraph代码,所以说用deepagents,你还得懂langchain和langgraph,学习成本相当高(每一门估计至少一周以上)。deepagents某种意义上来说不是一个完整的框架。从他与langchain和langgraph组合使用情况来看,他更像另外一个库,但是他的定位又是更高级,易用的API。综合起来像是个半吊子框架,相互穿插,有些混乱。deepagents如果从使用层面不能独立出来,那么他的学习成本和维护成本都是高昂的。另一个层面就是体现了工程化问题。

以上基本上是我对这个这个体系的最近研究的一些感悟,了解的目的最主要是主要是了解其到底能做到什么程度,做好工程化选择。这只是我个人的一个观点,仅供参考,如果确实如我所说,那么工程化问题就值得深思。

1 概览

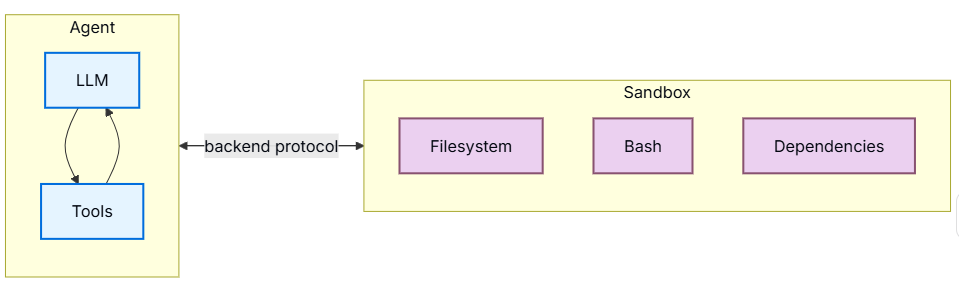

这是开始构建由大语言模型驱动的智能体和应用的最简单方法——它内置了任务规划、用于上下文管理的文件系统、子智能体生成以及长期记忆等能力。你可以将 deep agents 用于任何任务,包括复杂的、多步骤的任务。我们将 deepagents 视为一种“智能体框架”。它拥有与其他智能体框架相同的核心工具调用循环,但额外提供了内置的工具和功能。deepagents 是一个独立的库,构建于 LangChain 的核心智能体模块之上。它利用 LangGraph 运行时来实现持久化执行、流式传输、人机协同等功能。

deepagents 代码仓库包含以下内容:

- Deep Agents SDK: 一个用于构建能够处理任何任务的智能体的软件包。

- Deep Agents CLI: 一个基于 Deep Agents SDK 构建的终端编码智能体。

- ACP 集成: 一个代理客户端协议连接器,用于在 Zed 等代码编辑器中使用 deep agents。

LangChain 是提供智能体核心构建模块的框架。要了解 LangChain、LangGraph 和 Deep Agents 之间的区别,请参阅“框架、运行时和框架”

这玩意应该是 Agent harnesses 智能体驾驭的衍生品,概念还比较新。

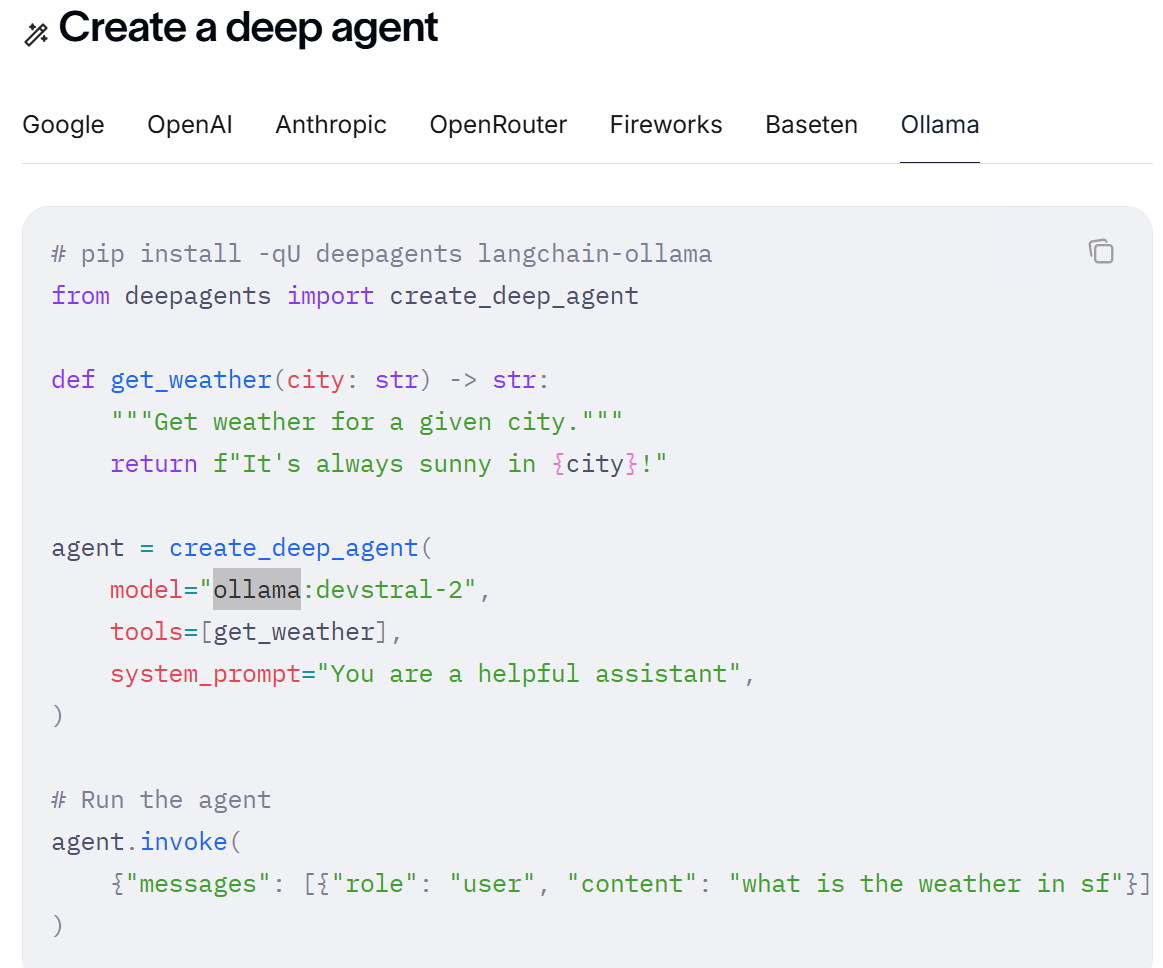

1.1 创建agent

上面看起来和原始langchain agent很像

1.2 何时使用 Deep Agents

当您希望构建具备以下能力的智能体时,请使用 Deep Agents SDK:

🧩 处理复杂任务

- 处理需要规划和拆解的复杂多步骤任务。

- 将工作委派给专门的子智能体,以实现上下文隔离。

🧠 上下文与记忆管理

- 通过文件系统工具和摘要功能管理大量上下文信息。

- 在对话和线程之间持久化记忆。

🛠️ 基础设施与工具

- 灵活切换文件系统后端,支持内存状态、本地磁盘、持久化存储、沙箱或您自己的自定义后端。

- 在使用沙箱后端时,通过

execute工具执行 Shell 命令。 - 模型无关性:支持使用任何具备工具调用功能的模型,兼容各类前沿模型和开源模型。

🔒 安全与人工干预

- 通过声明式权限规则控制文件系统访问,限制智能体可读写的文件范围。

- 通过人机回环工作流,要求对敏感操作进行人工审批。

提示: 对于构建更简单的智能体,建议考虑使用 LangChain 的

create_agent或构建自定义的 LangGraph 工作流。

1.3 核心能力

Deep Agents SDK 提供了一系列强大的功能,旨在构建高效、安全且智能的代理。

🧩 规划与任务拆解

- 内置待办工具: 包含内置的

write_todos工具,使代理能够将复杂任务分解为独立的步骤。 - 动态适应: 支持跟踪进度,并随着新信息的出现调整计划。

🧠 上下文管理

- 文件系统工具: 提供

ls、read_file、write_file、edit_file等工具,允许代理将大量上下文卸载到内存或文件系统存储中。 - 防止溢出: 防止上下文窗口溢出,并支持处理可变长度的工具结果。

- 自动摘要: 当上下文窗口过长时,自动压缩旧的对话消息,确保代理在长时间会话中保持高效。

💻 Shell 执行

- 沙箱后端: 在使用沙箱后端时,代理会获得

execute工具来运行 Shell 命令(用于测试、构建、Git 操作和系统任务)。 - 安全隔离: 沙箱后端提供隔离环境,使代理能够执行代码而不会危及您的主机系统。

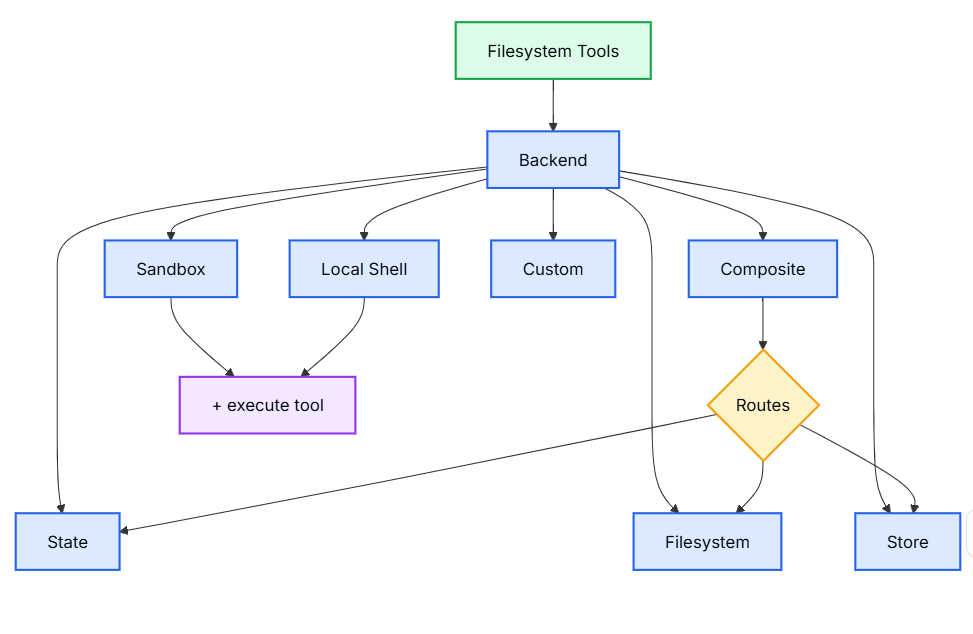

🔌 可插拔文件系统后端

- 灵活切换: 虚拟文件系统由可插拔后端提供支持,您可以根据用例进行切换。

- 多种选择: 可选择内存状态、本地磁盘、用于跨线程持久化的 LangGraph 存储、用于隔离代码执行的沙箱(如 Modal、Daytona、Deno),或通过复合路由组合多个后端。

- 自定义: 您也可以实现自己的自定义后端。

👥 子智能体生成

- 上下文隔离: 内置的

task工具使代理能够生成专门的子智能体,以实现上下文隔离。 - 专注任务: 这能保持主代理的上下文清洁,同时深入处理特定的子任务。

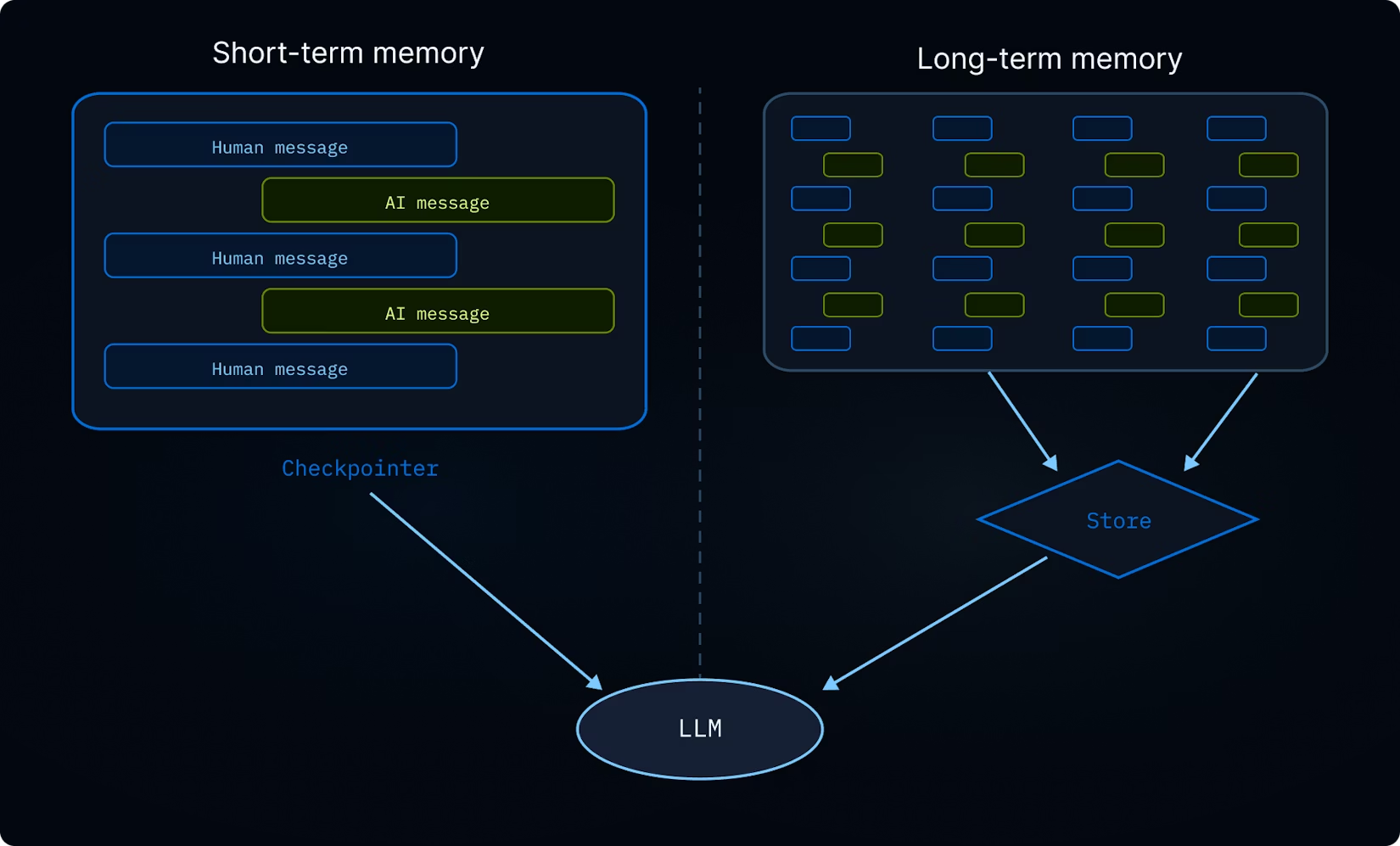

🗄️ 长期记忆

- 跨线程持久化: 使用 LangGraph 的 Memory Store 扩展代理,实现跨线程的持久化记忆。

- 信息存取: 代理可以保存和检索以前对话中的信息。

🔒 文件系统权限

- 规则声明: 声明权限规则,控制代理可以读写哪些文件和目录。

- 继承与覆盖: 子智能体可以继承或覆盖父代理的规则。

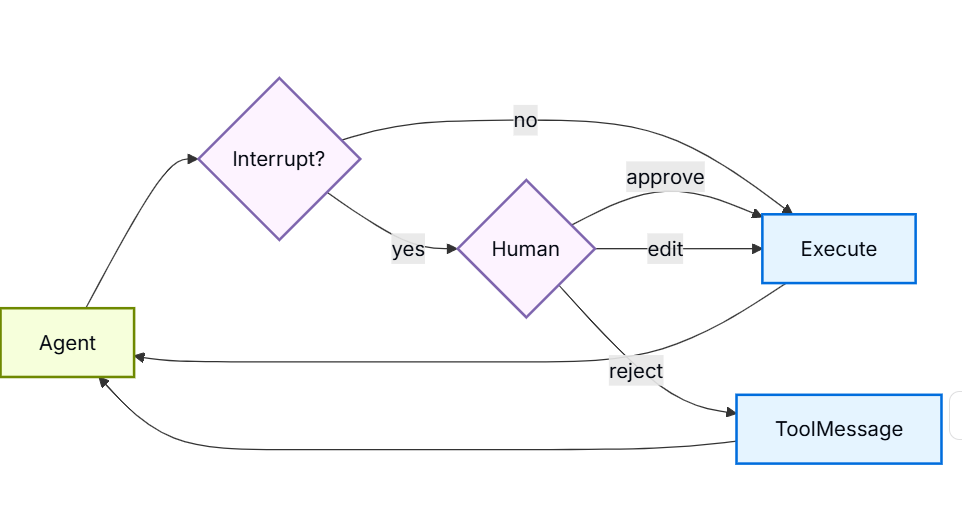

🤝 人机回环

- 人工审批: 利用 LangGraph 的中断功能,配置对敏感工具操作的人工审批。

- 执行控制: 控制哪些工具在执行前需要确认。

🛠️ 技能

- 功能扩展: 通过可重用的技能扩展代理,提供专门的工作流、领域知识和自定义指令。

💡 智能默认设置

- 预设提示词: 附带了经过优化的系统提示词,教导模型如何有效地使用其工具——在行动前规划、验证工作并管理上下文。

- 灵活定制: 您可以根据需要自定义或替换这些默认设置。

1.4 langchain vs langgraph vs deep agents

LangChain 维护着几个开源包,旨在帮助你构建智能体。它们在智能体开发栈中各自扮演着不同的角色。理解“智能体框架”、“智能体运行时”和“智能体驾驭”之间的区别,能帮你根据需求选择最合适的工具。

1.4.1 核心概念对比

| 类别 | 框架 | 运行时 | 驾驭 |

|---|---|---|---|

| 核心价值 | 抽象化 集成 |

持久化执行 流式传输 人机协同 持久化存储 |

预定义工具 提示词 子智能体 |

| 适用场景 | 快速上手 团队开发标准化 |

底层控制 长运行、有状态的工作流和智能体 |

更自主的智能体 处理复杂、非确定性任务的智能体 |

| 代表产品 | LangChain Vercel AI SDK CrewAI OpenAI Agents SDK Google ADK LlamaIndex |

LangGraph Temporal Inngest |

Deep Agents SDK Claude Agent SDK Manus |

1.4.2 智能体框架(例如 LangChain)

智能体框架提供了抽象化封装,让你在使用大语言模型进行开发时更容易上手。

LangChain 就是一个智能体框架,它提供了诸如结构化内容块、智能体循环和中间件等抽象概念。LangChain 的抽象设计旨在兼顾易用性与高级用例所需的灵活性。

虽然 LangChain 构建于 LangGraph 之上,但在使用 LangChain 时,你并不需要深入了解 LangGraph。

其他智能体框架的例子还包括 Vercel 的 AI SDK、CrewAI、OpenAI Agents SDK、Google ADK、LlamaIndex 等等

何时使用 LangChain

在以下情况请使用 LangChain:

- 你想快速构建智能体和自主应用。

- 你需要针对模型、工具和智能体循环的标准抽象。

- 你想要一个既易用又具备灵活性的框架。

- 你正在构建不需要复杂编排的简单智能体应用。

1.4.3 智能体运行时(例如 LangGraph)

智能体运行时提供了在生产环境中运行智能体所需的工具。支持的功能可能包括:

- 持久化执行: 智能体在遇到故障时能保持状态,可以长时间运行,并能从中断处恢复。

- 流式传输: 支持工作流和响应的流式输出。

- 人机协同: 通过检查和修改智能体状态来引入人工监督。

- 持久化存储: 用于状态管理的线程级和跨线程持久化。

- 底层控制: 直接控制智能体编排,无需高层抽象。

LangGraph 是一个用于构建、管理和部署长运行、有状态智能体的底层编排框架和运行时。

智能体框架通常层级更高,并且运行在智能体运行时之上。例如,LangChain 1.0 就是构建在 LangGraph 之上的。

其他智能体运行时的例子包括 Temporal、Inngest 以及其他持久化执行引擎。

何时使用 LangGraph

在以下情况请使用 LangGraph:

- 你需要对智能体编排进行细粒度的底层控制。

- 你需要为长运行、有状态的智能体提供持久化执行能力。

- 你正在构建结合了确定性步骤和智能体步骤的复杂工作流。

- 你需要用于智能体部署的生产级基础设施。

1.4.4 智能体驾驭(例如 Deep Agents SDK)

智能体框架是一种带有鲜明观点、“开箱即用”的框架,内置了构建复杂、长运行智能体所需的工具和能力。支持的功能可能包括:

- 规划能力: 通过待办事项列表跟踪多个任务。

- 任务委派: 通过子智能体委派工作并保持上下文整洁。

- 文件系统: 在不同的可插拔存储后端上读写文件。

- 令牌管理: 对话历史摘要和大型工具结果的移除。

Deep Agents SDK 构建在 LangGraph 之上,并增加了规划能力、用于上下文管理的文件系统、生成子智能体的能力等。Deep Agents 专为需要规划和拆解的复杂多步骤任务而设计。

任务示例包括处理搜索结果、脚本以及状态中的其他产物。

其他智能体框架的例子包括 Claude Agent SDK、Manus 以及其他编码命令行界面。

何时使用 Deep Agents SDK

在以下情况请使用 Deep Agents SDK:

- 你正在构建长时间运行的智能体。

- 你正在构建需要处理复杂多步骤任务的智能体。

- 你想使用预定义的工具,如文件系统操作、Bash 执行和自动化上下文工程。

- 你想使用预定义的提示词和子智能体。

2 起步

本指南将带您创建第一个具备规划、文件系统工具和子智能体功能的深度代理。您将构建一个能够进行研究和撰写报告的研究代理

🤖 使用 AI 编程助手?

如果您正在使用 AI 编程助手,建议安装以下组件以增强其能力:

📚 安装 LangChain 文档 MCP 服务器

- 目的: 让您的代理能够访问最新的 LangChain 文档和示例。

- 作用: 确保代理获取的信息是最新的,减少幻觉。

-

目的: 提高您的代理在 LangChain 生态系统任务中的表现。

- 作用: 赋予代理更专业的领域知识和处理能力。

2.1 先决条件

在开始之前,请确保您已具备以下条件:

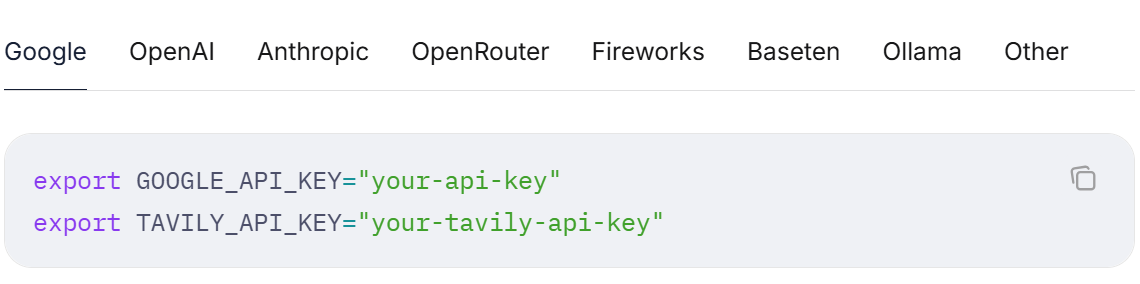

🔑 API 密钥

- 您必须拥有一个模型提供商(例如 Gemini、Anthropic 或 OpenAI)的 API 密钥。

🛠️ 模型要求

1 安装依赖

pip install deepagents tavily-python本指南使用 Tavily 作为示例搜索提供商,但您可以替换为任何搜索 API(例如 DuckDuckGo、SerpAPI、Brave Search)。

2 设置API KE 3 创建搜索工具

3 创建搜索工具

import os

from typing import Literal

from tavily import TavilyClient

from deepagents import create_deep_agent

tavily_client = TavilyClient(api_key=os.environ["TAVILY_API_KEY"])

def internet_search(

query: str,

max_results: int = 5,

topic: Literal["general", "news", "finance"] = "general",

include_raw_content: bool = False,

):

"""Run a web search"""

return tavily_client.search(

query,

max_results=max_results,

include_raw_content=include_raw_content,

topic=topic,

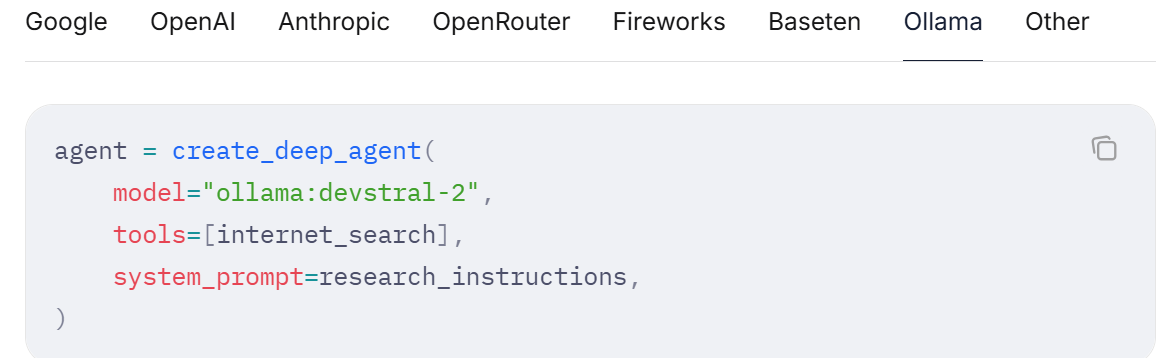

)4 创建deep agent

# System prompt to steer the agent to be an expert researcher

research_instructions = """You are an expert researcher. Your job is to conduct thorough research and then write a polished report.

You have access to an internet search tool as your primary means of gathering information.

## `internet_search`

Use this to run an internet search for a given query. You can specify the max number of results to return, the topic, and whether raw content should be included.

"""您可以传入 provider:model 格式的模型字符串,或者传入一个已初始化的模型实例。有关所有提供商支持的模型以及经过测试的推荐模型,请参阅“支持的模型”部分。

5 运行agent

result = agent.invoke({"messages": [{"role": "user", "content": "What is langgraph?"}]})

# Print the agent's response

print(result["messages"][-1].content)🤔 它是如何工作的?

您的深度代理会自动执行以下步骤:

📝 规划方法

使用内置的 write_todos 工具将研究任务分解为具体的步骤。

🔍 开展研究

调用 internet_search 工具来收集信息。

🧠 管理上下文

使用文件系统工具(write_file、read_file)将大量的搜索结果卸载存储,以防止上下文溢出。

👥 生成子智能体

根据需要生成子智能体,将复杂的子任务委派给专门的子智能体处理。

📄 综合报告

将调查结果汇编成连贯的响应,最终生成一份报告。

2.2 示例

有关您可以使用 Deep Agents 构建的代理、模式和应用,请参阅“示例”部分

2.3 流式传输

Deep Agents 利用 LangGraph 内置了流式传输功能,可提供代理执行的实时更新。

这使得您能够:

- 逐步观察输出: 实时查看生成过程。

- 审查与调试: 检查代理和子智能体的工作,包括工具调用、工具结果和大语言模型响应。

2.4 后续步骤

既然您已经构建了第一个深度代理,接下来可以:

🎨 自定义您的代理:了解自定义选项,包括自定义系统提示词、工具和子代理。

🧠 添加长期记忆:启用跨对话的持久化记忆。

🌐 部署到生产环境:了解 Deep Agents 的部署选项

2.5 总结

从步骤看起来和langchain agent使用差不多,一些外围的功能更自动化了。

3 自定义Deep Agents

以下是 create_deep_agent 的主要配置参数:

- 模型:指定智能体使用的大语言模型。

- 工具:定义智能体可以调用的功能或 API。

- 系统提示词:设定智能体的行为准则、角色和指令。

- 中间件:用于在请求处理流程中插入自定义逻辑。

- 子智能体:配置可被主智能体调用的专用子智能体。

- 后端:设置虚拟文件系统的存储方式(如内存、本地磁盘等)。

- 人机回环:配置需要人工审批的敏感操作。

- 技能:为智能体添加可重用的专业工作流或知识。

- 记忆:管理智能体的短期或长期记忆存储

create_deep_agent(

model: str | BaseChatModel | None = None,

tools: Sequence[BaseTool | Callable | dict[str, Any]] | None = None,

*,

system_prompt: str | SystemMessage | None = None,

middleware: Sequence[AgentMiddleware] = (),

subagents: Sequence[SubAgent | CompiledSubAgent | AsyncSubAgent] | None = None,

skills: list[str] | None = None,

memory: list[str] | None = None,

permissions: list[FilesystemPermission] | None = None,

backend: BackendProtocol | BackendFactory | None = None,

interrupt_on: dict[str, bool | InterruptOnConfig] | None = None,

response_format: ResponseFormat[ResponseT] | type[ResponseT] | dict[str, Any] | None = None,

context_schema: type[ContextT] | None = None,

checkpointer: Checkpointer | None = None,

store: BaseStore | None = None,

debug: bool = False,

name: str | None = None,

cache: BaseCache | None = None

) -> CompiledStateGraph[AgentState[ResponseT], ContextT, _InputAgentState, _OutputAgentState[ResponseT]]有关完整的参数列表,请参阅 create_deep_agent API 参考文档

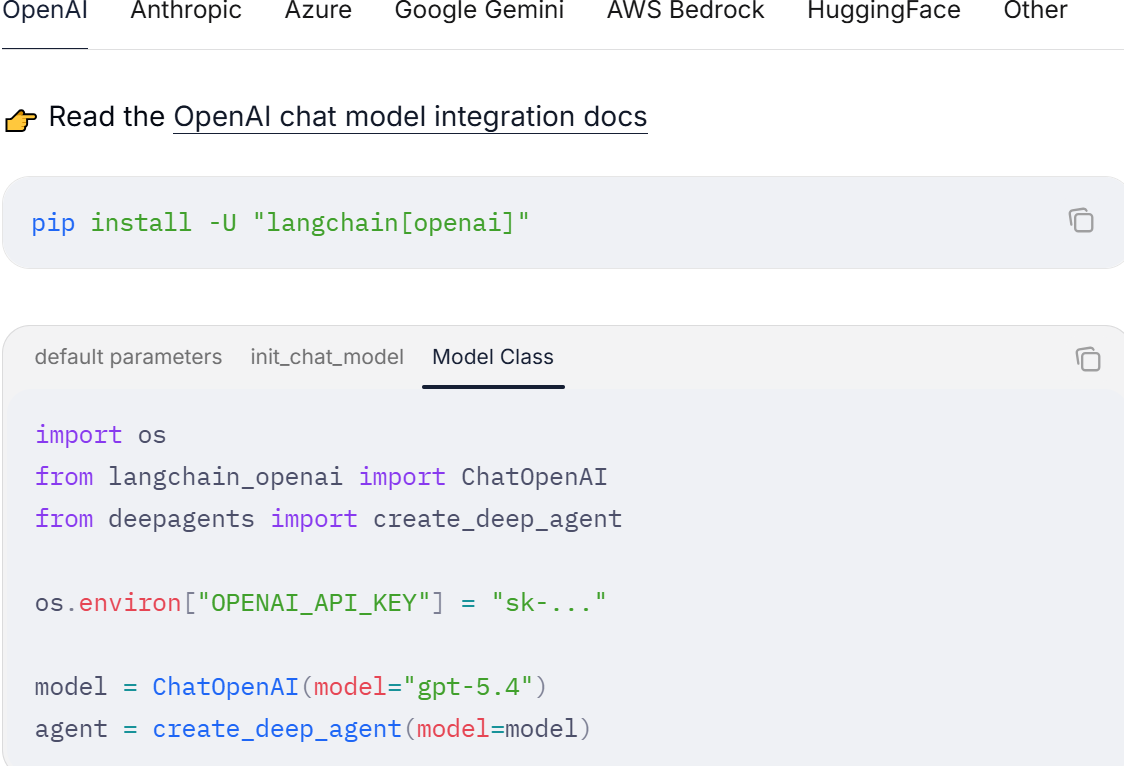

3.1 模型参数

您可以传入 provider:model 格式的模型字符串,或者传入一个已初始化的模型实例。有关所有提供商支持的模型以及经过测试的推荐模型,请参阅“支持的模型”部分。

使用 provider:model 格式(例如 openai:gpt-5.4)可以快速在不同模型之间进行切换

连接弹性

LangChain 聊天模型具备内置的连接恢复机制,能够自动重试失败的 API 请求,并采用指数退避策略。

默认重试行为

- 重试次数:默认最多重试 6 次。

- 适用场景:

- 网络错误

- 速率限制(429)

- 服务器错误(5xx)

- 不重试的情况:客户端错误(如 401 未授权或 404 未找到)不会触发重试。

自定义配置:您可以通过在创建模型时调整 max_retries 参数,根据具体环境优化此行为。

from langchain.chat_models import init_chat_model

from deepagents import create_deep_agent

agent = create_deep_agent(

model=init_chat_model(

model="google_genai:gemini-3.1-pro-preview",

max_retries=10, # Increase for unreliable networks (default: 6)

timeout=120, # Increase timeout for slow connections

),

)针对在不稳定网络环境下运行的长时间代理任务,建议采取以下优化措施以增强系统的健壮性:

🛡️ 增强连接弹性与持久化

-

增加最大重试次数

- 建议将

max_retries参数增加到 10–15 次。 - 原因:长时间任务遭遇临时网络波动的概率更高,增加重试次数能显著提高任务最终成功的概率。

- 建议将

-

配合使用检查点

- 建议将高重试策略与检查点机制结合使用。

- 作用:确保在发生故障时,任务进度能够被保存和恢复,避免因重试失败导致整个长任务从头开始,从而保留已有的执行成果。

3.2 工具

除了用于规划、文件管理和生成子智能体的内置工具外,您还可以提供自定义工具来扩展智能体的能力

import os

from typing import Literal

from tavily import TavilyClient

from deepagents import create_deep_agent

tavily_client = TavilyClient(api_key=os.environ["TAVILY_API_KEY"])

def internet_search(

query: str,

max_results: int = 5,

topic: Literal["general", "news", "finance"] = "general",

include_raw_content: bool = False,

):

"""Run a web search"""

return tavily_client.search(

query,

max_results=max_results,

include_raw_content=include_raw_content,

topic=topic,

)

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

tools=[internet_search]

)3.3 系统提示词

Deep Agents 自带一个内置的系统提示词。该默认提示词包含了关于如何使用内置规划工具、文件系统工具以及子智能体的详细说明。当中间件添加特殊工具(如文件系统工具)时,相关的使用说明会自动追加到系统提示词中。除了默认设置外,每个深度代理还应包含一个自定义系统提示词,以专门针对其特定的使用场景进行优化。

from deepagents import create_deep_agent

research_instructions = """\

You are an expert researcher. Your job is to conduct \

thorough research, and then write a polished report. \

"""

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

system_prompt=research_instructions,

)3.4 中间件

默认情况下,Deep Agents 内置了多种中间件来增强其功能。根据您启用的配置(如记忆、技能或人机回环),还会自动加载相应的扩展中间件。

默认中间件

以下中间件默认可用:

- TodoListMiddleware:跟踪和管理待办列表,帮助组织代理的任务和工作流。

- FilesystemMiddleware:处理文件系统操作,如读取、写入和导航目录。

- SubAgentMiddleware:生成并协调子智能体,以便将任务委派给专门的代理。

- SummarizationMiddleware:当对话过长时,自动压缩消息历史,确保不超出上下文限制。

- AnthropicPromptCachingMiddleware:在使用 Anthropic 模型时,自动减少冗余的令牌处理。

- PatchToolCallsMiddleware:当工具调用在收到结果前被中断或取消时,自动修复消息历史。

扩展中间件

如果您配置了特定功能,以下中间件也会被包含:

- MemoryMiddleware:当提供了

memory参数时,用于跨会话持久化和检索对话上下文。 - SkillsMiddleware:当提供了

skills参数时,用于启用自定义技能。 - HumanInTheLoopMiddleware:当提供了

interruptOn参数时,用于在指定节点暂停以等待人工批准或输入。

📦 预构建中间件

LangChain 提供了额外的预构建中间件,让您可以轻松添加各种通用功能,例如:

- 重试机制

- 降级策略

- PII(个人身份信息)检测

提示:

deepagents库还专门暴露了create_summarization_tool_middleware。与基于固定令牌间隔的总结不同,该中间件允许代理在合适的时机(例如任务之间)主动触发总结。

🏢 针对特定提供商的中间件

针对特定大语言模型提供商优化的中间件,请参阅官方集成和社区集成文档。

🛠️ 自定义中间件

您可以编写并提供额外的中间件,以实现以下目标:

- 扩展功能

- 添加工具

- 实现自定义钩子

from langchain.tools import tool

from langchain.agents.middleware import wrap_tool_call

from deepagents import create_deep_agent

@tool

def get_weather(city: str) -> str:

"""Get the weather in a city."""

return f"The weather in {city} is sunny."

call_count = [0] # Use list to allow modification in nested function

@wrap_tool_call

def log_tool_calls(request, handler):

"""Intercept and log every tool call - demonstrates cross-cutting concern."""

call_count[0] += 1

tool_name = request.name if hasattr(request, 'name') else str(request)

print(f"[Middleware] Tool call #{call_count[0]}: {tool_name}")

print(f"[Middleware] Arguments: {request.args if hasattr(request, 'args') else 'N/A'}")

# Execute the tool call

result = handler(request)

# Log the result

print(f"[Middleware] Tool call #{call_count[0]} completed")

return result

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

tools=[get_weather],

middleware=[log_tool_calls],

)前面langchain中间件可以通过装饰器和继承类两种方式实现。上面这种就是通过@wrap_tool_call实现的

⚠️ 初始化后请勿修改属性

在开发自定义中间件或组件时,这是一个关于并发安全的关键原则。

核心原则

- 禁止操作:在初始化完成后,不要直接修改组件自身的属性(例如在类实例中保存计数器或累积数据)。

- 潜在风险:在并发调用(并行处理多个请求)时,直接修改属性会导致竞争条件,因为多个线程可能会同时读写同一个属性,导致数据混乱。

正确做法:使用图状态

- 解决方案:如果您需要在不同的钩子调用之间跟踪数值或数据,请务必使用 图状态。

- 优势:图状态在设计上是按线程隔离的。这意味着每个对话线程都有独立的状态副本,因此对状态的更新是线程安全的,不会受到并发执行的影响。

#正确做法

class CustomMiddleware(AgentMiddleware):

def __init__(self):

pass

def before_agent(self, state, runtime):

return {"x": state.get("x", 0) + 1} # Update graph state instead#不要这样做

class CustomMiddleware(AgentMiddleware):

def __init__(self):

self.x = 1

def before_agent(self, state, runtime):

self.x += 1 # Mutation causes race conditions在开发自定义中间件时,原地修改是一个需要极力避免的操作模式,因为它会导致难以察觉的 Bug 和竞争条件。

为什么原地修改是危险的?

Deep Agents 框架中有许多操作是并发运行的,包括:

- 子智能体的执行

- 并行工具的调用

- 不同线程上的并发代理调用

如果您在钩子(如 before_agent)中直接修改 self.x 或其他共享值,这些并发操作会同时读写同一块内存区域,从而导致数据不一致或逻辑错误。

正确的解决方案

- 使用图状态:请务必通过扩展 图状态 来管理自定义属性。图状态是按线程隔离的,因此更新是安全的。

- 参考文档:关于如何扩展状态,请参阅“自定义中间件 - 自定义状态模式”章节。

建议:如果您必须在自定义中间件中使用变异操作,请务必仔细考虑当子智能体、并行工具或并发代理调用同时运行时可能发生的后果。

3.5 子图

为了隔离详细的工作流程并避免主上下文的过度膨胀,请使用子智能体:

- 上下文隔离:将复杂的任务委派给子智能体,主代理只需接收最终结果,而无需处理生成该结果的中间步骤和大量数据。

- 避免上下文膨胀:防止详细的中间结果(如多次网络搜索或文件读取的内容)填满主代理的上下文窗口,确保主代理专注于核心任务规划。

import os

from typing import Literal

from tavily import TavilyClient

from deepagents import create_deep_agent

tavily_client = TavilyClient(api_key=os.environ["TAVILY_API_KEY"])

def internet_search(

query: str,

max_results: int = 5,

topic: Literal["general", "news", "finance"] = "general",

include_raw_content: bool = False,

):

"""Run a web search"""

return tavily_client.search(

query,

max_results=max_results,

include_raw_content=include_raw_content,

topic=topic,

)

research_subagent = {

"name": "research-agent",

"description": "Used to research more in depth questions",

"system_prompt": "You are a great researcher",

"tools": [internet_search],

"model": "openai:gpt-5.4", # Optional override, defaults to main agent model

}

subagents = [research_subagent]

agent = create_deep_agent(

model="claude-sonnet-4-6",

subagents=subagents

)欲了解更多信息,请参阅子智能体相关文档

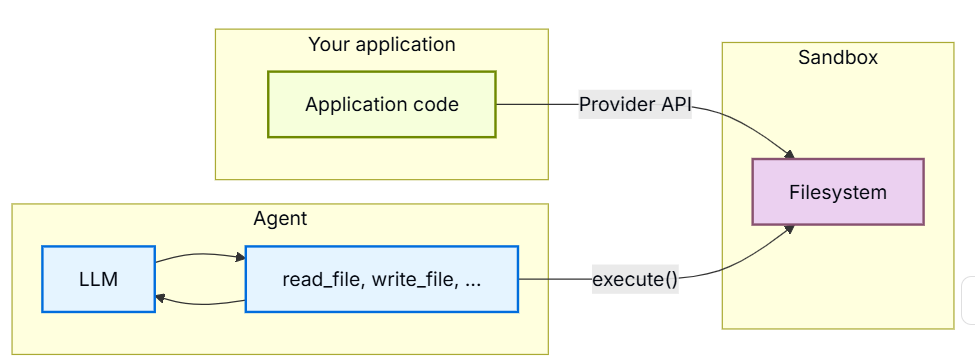

3.6 后端

深度代理的工具可以利用虚拟文件系统来存储、访问和编辑文件。默认情况下,深度代理使用 StateBackend。这是一种临时存储机制,文件保存在当前线程的状态中。如果您计划使用技能或记忆功能,则必须在创建代理之前,将预期的技能文件或记忆文件添加到后端中。

StateBackend

FilesystemBackend

LocalShellBackend

StoreBackend

CompositeBackend它是一种临时的文件系统后端,将文件存储在 LangGraph 的状态中,其生命周期仅限于单个线程。

📝 StateBackend 的特点

- 临时性:它就像一个智能体的临时草稿本,用于在执行过程中写入和读取中间结果。

- 线程内持久化:数据在单个线程的多次对话轮次中是持久化的,但当该线程的会话结束后,所有文件都会丢失。

- 默认选择:这是深度代理(Deep Agents)在未显式配置其他后端时的默认选择。

# By default we provide a StateBackend

agent = create_deep_agent(model="google_genai:gemini-3.1-pro-preview")

# Under the hood, it looks like

from deepagents.backends import StateBackend

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=StateBackend()

)欲了解更多信息,请参阅后端相关文档。

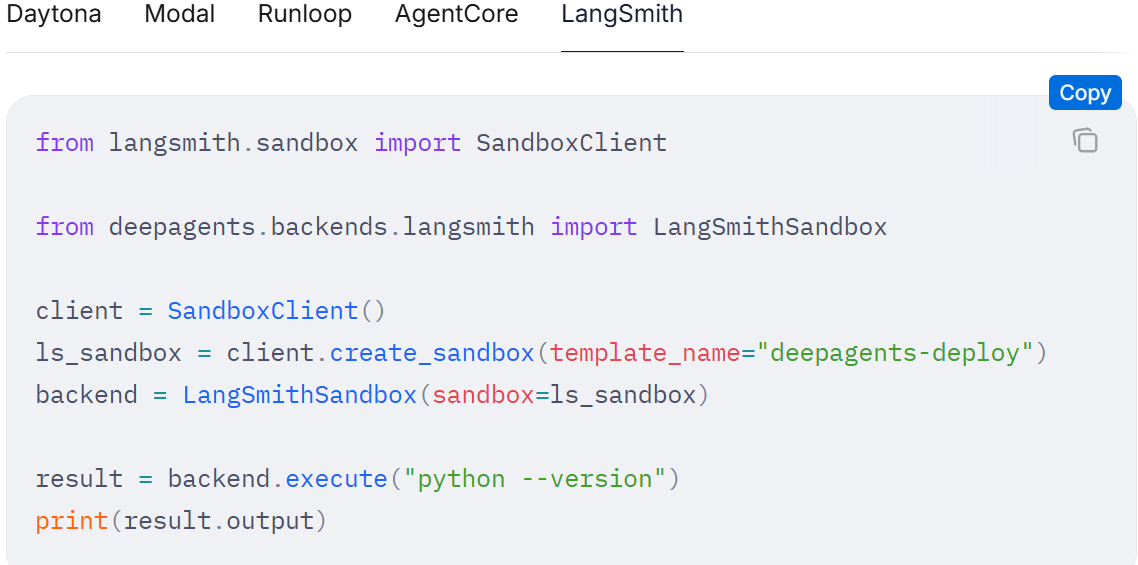

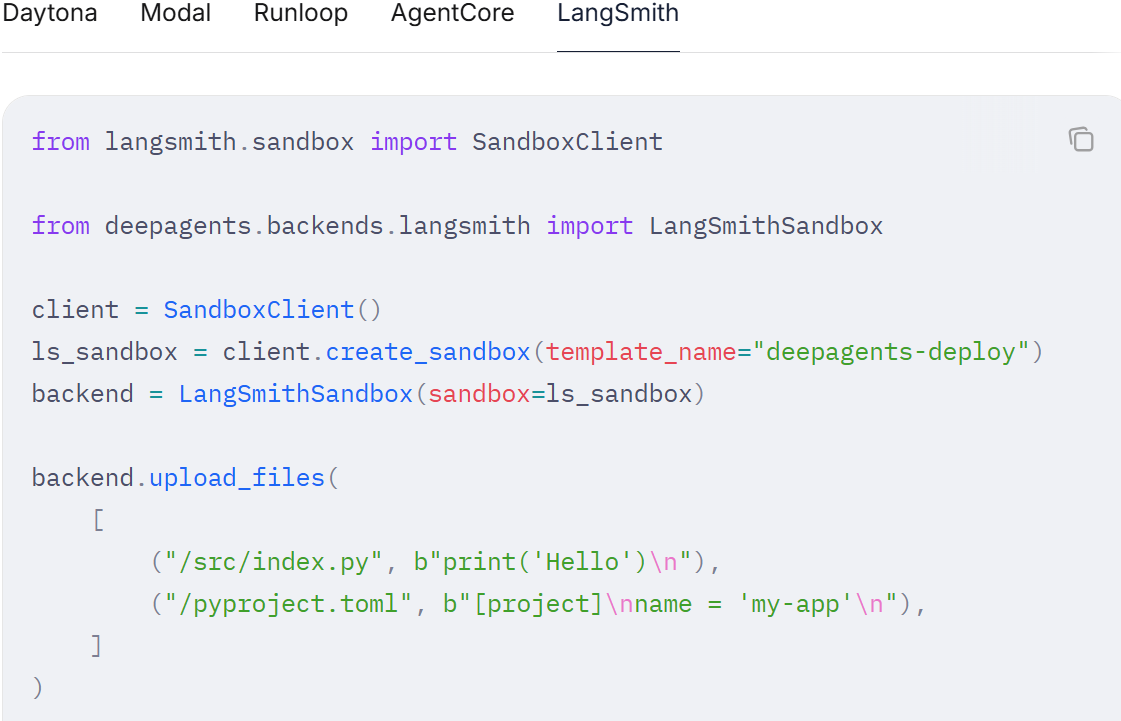

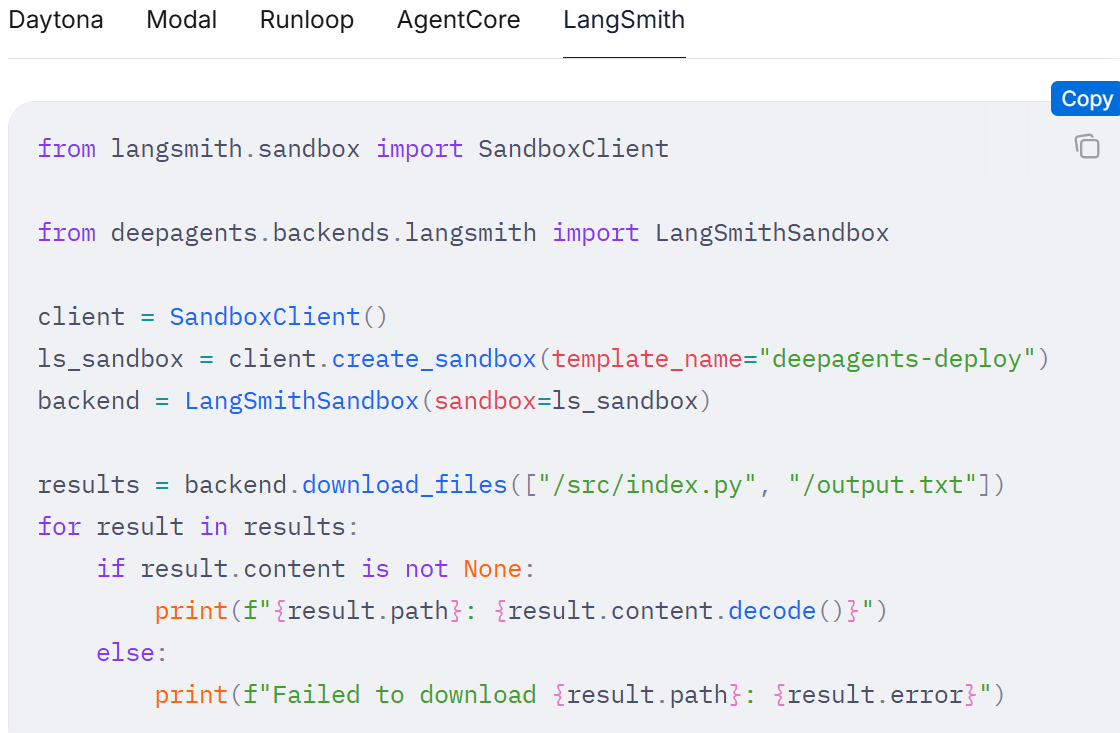

沙箱

沙箱是一种特殊的后端,它能在一个隔离的环境中运行代理代码,拥有独立的文件系统和用于执行 Shell 命令的工具。当您希望深度代理执行以下操作,同时又不想影响本地机器的环境时,就应该使用沙箱后端:

- 写入文件

- 安装依赖

- 运行命令

在创建深度代理时,通过将沙箱后端传递给 backend 参数来完成配置:

import modal

from deepagents import create_deep_agent

from langchain_anthropic import ChatAnthropic

from langchain_modal import ModalSandbox

app = modal.App.lookup("your-app")

modal_sandbox = modal.Sandbox.create(app=app)

backend = ModalSandbox(sandbox=modal_sandbox)

agent = create_deep_agent(

model=ChatAnthropic(model="claude-sonnet-4-6"),

system_prompt="You are a Python coding assistant with sandbox access.",

backend=backend,

)

try:

result = agent.invoke(

{

"messages": [

{

"role": "user",

"content": "Create a small Python package and run pytest",

}

]

}

)

finally:

modal_sandbox.terminate()欲了解更多信息,请参阅沙箱相关文档

from langchain.tools import tool

from deepagents import create_deep_agent

from langgraph.checkpoint.memory import MemorySaver

@tool

def delete_file(path: str) -> str:

"""Delete a file from the filesystem."""

return f"Deleted {path}"

@tool

def read_file(path: str) -> str:

"""Read a file from the filesystem."""

return f"Contents of {path}"

@tool

def send_email(to: str, subject: str, body: str) -> str:

"""Send an email."""

return f"Sent email to {to}"

# Checkpointer is REQUIRED for human-in-the-loop

checkpointer = MemorySaver()

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

tools=[delete_file, read_file, send_email],

interrupt_on={

"delete_file": True, # Default: approve, edit, reject

"read_file": False, # No interrupts needed

"send_email": {"allowed_decisions": ["approve", "reject"]}, # No editing

},

checkpointer=checkpointer # Required!

)您可以为代理和子智能体配置中断,既可以在调用工具时触发,也可以在工具调用内部触发。欲了解更多信息,请参阅人机交互相关文档

3.7 技能

您可以使用技能来为您的深度代理提供新的能力和专业特长。虽然工具倾向于覆盖较低级别的功能(如原生文件系统操作或规划),但技能则包含更丰富的内容:

- 详细指令:关于如何完成特定任务的逐步指南。

- 参考资料:相关的背景信息或知识库。

- 其他资产:如模板、脚本等。

渐进式披露

这些文件仅在代理确定技能对当前提示词有用时才会被加载。这种渐进式披露机制减少了代理在启动时必须考虑的 Token 数量和上下文长度,从而提高了效率。

提示:有关技能示例,请参阅 Deep Agents 示例技能库

配置方法

若要将技能添加到您的深度代理中,请将它们作为参数传递给 create_deep_agent 函数:

statebackend

from urllib.request import urlopen

from deepagents import create_deep_agent

from deepagents.backends.utils import create_file_data

from langgraph.checkpoint.memory import MemorySaver

checkpointer = MemorySaver()

skill_url = "https://raw.githubusercontent.com/langchain-ai/deepagents/refs/heads/main/libs/cli/examples/skills/langgraph-docs/SKILL.md"

with urlopen(skill_url) as response:

skill_content = response.read().decode('utf-8')

skills_files = {

"/skills/langgraph-docs/SKILL.md": create_file_data(skill_content)

}

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

skills=["/skills/"],

checkpointer=checkpointer,

)

result = agent.invoke(

{

"messages": [

{

"role": "user",

"content": "What is langgraph?",

}

],

# Seed the default StateBackend's in-state filesystem (virtual paths must start with "/").

"files": skills_files

},

config={"configurable": {"thread_id": "12345"}},

)storebankend

from urllib.request import urlopen

from deepagents import create_deep_agent

from deepagents.backends import StoreBackend

from deepagents.backends.utils import create_file_data

from langgraph.store.memory import InMemoryStore

store = InMemoryStore()

skill_url = "https://raw.githubusercontent.com/langchain-ai/deepagents/refs/heads/main/libs/cli/examples/skills/langgraph-docs/SKILL.md"

with urlopen(skill_url) as response:

skill_content = response.read().decode('utf-8')

store.put(

namespace=("filesystem",),

key="/skills/langgraph-docs/SKILL.md",

value=create_file_data(skill_content)

)

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=StoreBackend(),

store=store,

skills=["/skills/"]

)

result = agent.invoke(

{

"messages": [

{

"role": "user",

"content": "What is langgraph?",

}

]

},

config={"configurable": {"thread_id": "12345"}},

)文件系统bankend

from deepagents import create_deep_agent

from langgraph.checkpoint.memory import MemorySaver

from deepagents.backends.filesystem import FilesystemBackend

# Checkpointer is REQUIRED for human-in-the-loop

checkpointer = MemorySaver()

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=FilesystemBackend(root_dir="/Users/user/{project}"),

skills=["/Users/user/{project}/skills/"],

interrupt_on={

"write_file": True, # Default: approve, edit, reject

"read_file": False, # No interrupts needed

"edit_file": True # Default: approve, edit, reject

},

checkpointer=checkpointer, # Required!

)

result = agent.invoke(

{

"messages": [

{

"role": "user",

"content": "What is langgraph?",

}

]

},

config={"configurable": {"thread_id": "12345"}},

)3.8 记忆

您可以使用 AGENTS.md 文件为您的深度代理提供额外的上下文信息。

statebackend

from deepagents import create_deep_agent

from deepagents.backends import FilesystemBackend

from langgraph.checkpoint.memory import MemorySaver

# Checkpointer is REQUIRED for human-in-the-loop

checkpointer = MemorySaver()

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=FilesystemBackend(root_dir="/Users/user/{project}"),

memory=[

"./AGENTS.md"

],

interrupt_on={

"write_file": True, # Default: approve, edit, reject

"read_file": False, # No interrupts needed

"edit_file": True # Default: approve, edit, reject

},

checkpointer=checkpointer, # Required!

)storebackend

from urllib.request import urlopen

from deepagents import create_deep_agent

from deepagents.backends import StoreBackend

from deepagents.backends.utils import create_file_data

from langgraph.store.memory import InMemoryStore

with urlopen("https://raw.githubusercontent.com/langchain-ai/deepagents/refs/heads/main/examples/text-to-sql-agent/AGENTS.md") as response:

agents_md = response.read().decode("utf-8")

# Create the store and add the file to it

store = InMemoryStore()

file_data = create_file_data(agents_md)

store.put(

namespace=("filesystem",),

key="/AGENTS.md",

value=file_data

)

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=StoreBackend(),

store=store,

memory=[

"/AGENTS.md"

]

)

result = agent.invoke(

{

"messages": [

{

"role": "user",

"content": "Please tell me what's in your memory files.",

}

],

"files": {"/AGENTS.md": create_file_data(agents_md)},

},

config={"configurable": {"thread_id": "12345"}},

)FilesystemBackand

from deepagents import create_deep_agent

from deepagents.backends import FilesystemBackend

from langgraph.checkpoint.memory import MemorySaver

# Checkpointer is REQUIRED for human-in-the-loop

checkpointer = MemorySaver()

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=FilesystemBackend(root_dir="/Users/user/{project}"),

memory=[

"./AGENTS.md"

],

interrupt_on={

"write_file": True, # Default: approve, edit, reject

"read_file": False, # No interrupts needed

"edit_file": True # Default: approve, edit, reject

},

checkpointer=checkpointer, # Required!

)深度代理支持结构化输出。您可以通过将所需的结构化输出模式作为 response_format 参数传递给 create_deep_agent() 调用来进行设置。当模型生成结构化数据时,它会被捕获、验证,并返回到深度代理状态的 structured_response 键中

import os

from typing import Literal

from pydantic import BaseModel, Field

from tavily import TavilyClient

from deepagents import create_deep_agent

tavily_client = TavilyClient(api_key=os.environ["TAVILY_API_KEY"])

def internet_search(

query: str,

max_results: int = 5,

topic: Literal["general", "news", "finance"] = "general",

include_raw_content: bool = False,

):

"""Run a web search"""

return tavily_client.search(

query,

max_results=max_results,

include_raw_content=include_raw_content,

topic=topic,

)

class WeatherReport(BaseModel):

"""A structured weather report with current conditions and forecast."""

location: str = Field(description="The location for this weather report")

temperature: float = Field(description="Current temperature in Celsius")

condition: str = Field(description="Current weather condition (e.g., sunny, cloudy, rainy)")

humidity: int = Field(description="Humidity percentage")

wind_speed: float = Field(description="Wind speed in km/h")

forecast: str = Field(description="Brief forecast for the next 24 hours")

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

response_format=WeatherReport,

tools=[internet_search]

)

result = agent.invoke({

"messages": [{

"role": "user",

"content": "What's the weather like in San Francisco?"

}]

})

print(result["structured_response"])

# location='San Francisco, California' temperature=18.3 condition='Sunny' humidity=48 wind_speed=7.6 forecast='Pleasant sunny conditions expected to continue with temperatures around 64°F (18°C) during the day, dropping to around 52°F (11°C) at night. Clear skies with minimal precipitation expected.'欲了解更多信息和示例,请参阅响应格式相关文档

4 Deep Agents Vs Claude Agent SDK

本页面介绍了 LangChain Deep Agents 与 Claude Agent SDK 的对比。两者均为用于构建自定义智能体的支撑框架,但在执行环境、部署方式以及厂商绑定方面做出了不同的权衡

4.1 概览

| 维度 | Deep Agents | Claude Agent SDK |

|---|---|---|

| 运行位置 | 在沙箱内部,或在沙箱外部远程执行命令 | 在沙箱内部 |

| 执行后端 | 可插拔式:支持本地、虚拟文件系统、远程沙箱或自定义后端 | 仅限于其运行所在沙箱的本地文件系统 |

| 模型提供商 | 任意模型(支持 Anthropic, OpenAI, Google 等 100+ 家服务商) | 仅限 Claude(支持 Anthropic, Bedrock, Vertex, Azure 等渠道) |

| 部署方式 | 1. 通过 deepagents deploy 使用 LangSmith 托管云2. 通过 langgraph build 自托管独立镜像 |

需自托管:需自行构建服务器、鉴权和流式传输层 (注:Claude 托管代理是另一款独立产品) |

| 多租户支持 | 内置支持:包含作用域线程、每用户沙箱、基于角色的访问控制 | 需自行构建 |

| 开源协议 | MIT | MIT(但 Claude Code 本身是专有软件) |

4.2 主要差异

4.2.1 智能体与执行环境

连接智能体与沙盒主要有两种模式:将智能体运行在沙盒内部,或者将智能体运行在沙盒外部并将沙盒作为工具使用。

Claude Agent SDK 仅支持第一种模式。你的智能体运行在沙盒内部,并针对沙盒的本地文件系统执行工具。Anthropic 托管的 Claude 托管智能体使用的是解耦模型,这反映了生产级智能体架构的未来发展方向。

Deep Agents 同时支持这两种模式,并允许你选择后端来将它们连接起来。在实践中,这意味着你可以:

- 在沙盒内部运行智能体(与 Claude Agent SDK 相同的模式)。

- 在长生命周期的容器中运行智能体,并将远程沙盒作为工具使用,通过网络执行命令。

- 在测试时换用虚拟文件系统,或者为你自己的基础设施换用自定义后端

4.2.3 多租户支持

当你将应用程序投入生产环境时,通常需要面向众多终端用户,因此必须为每个用户隔离环境。

在 Claude Agent SDK 中,SDK 将智能体与其沙盒紧密绑定。为了给每个用户提供隔离的执行环境,你必须构建一个 API 包装层,负责为每个用户启动一个沙盒,追踪哪个沙盒属于谁,并在之后将其销毁。

Deep Agents 直接处理这个问题:你可以在框架(Harness)中配置每个用户或每个助手的沙盒,其中已包含作用域线程、运行历史记录和基于角色的访问控制。如果你使用 LangSmith Sandbox,还可以直接获得一个认证代理,这样终端用户就可以在沙盒内调用第三方 API,而无需你为每个用户单独配置凭证。

4.2.4 核心区别

简单来说,Deep Agents 在这里省去了很多“造轮子”的麻烦:

- Claude Agent SDK:你需要自己动手写代码来管理用户的隔离环境(启动、追踪、销毁),相当于你要自己当“房东”给每个用户分房间。

- Deep Agents:它自带“物业管理”。它内置了隔离机制、权限管理和历史记录。特别是那个“认证代理”功能,相当于它帮用户解决了进门刷卡(API 密钥管理)的问题,你不用给每个用户单独发钥匙了

4.2.5 生产级智能体服务器

要想向终端用户开放自托管的 Claude Agent SDK 应用,你需要自己编写 HTTP/WebSocket 或 SSE 服务器,用来调用智能体、流式回传文本片段(tokens),并管理对话线程。这个服务器需要由你自己构建、运维和保障安全。

Deep Agents 的部署方案则直接包含了开箱即用的智能体服务器:自带流式传输端点、线程管理、运行历史记录、Webhooks 以及身份认证功能。

4.2.6 托管云或自托管

Claude Agent SDK 的部署方式仅限于自托管。该 SDK 与 Claude 托管智能体是两个独立的产品。针对 SDK 编写的代码无法直接部署到托管服务中。

Deep Agents 无需更改代码即可在两种模式下运行:

- 托管模式:使用

deepagents deploy命令部署到 LangSmith 托管云。 - 自托管模式:运行

langgraph build生成一个独立的 Docker 镜像,你可以将其部署到任何地方。

4.2.7 大语言模型

Claude Agent SDK 的执行环境将模型、后端和部署捆绑在一起,并优化这三者之间的支持。而在 Deep Agents 中,你可以独立选择模型提供商、执行后端和部署目标。通过选择这个框架,你在模型和基础设施的选择上保留了最大的灵活性

4.2.8 总结

- 选择 Deep Agents:如果你想要模型和基础设施的灵活性,需要内置的多租户部署功能,并且希望无需更改代码就能在“托管”和“自托管”模式之间切换。

- 选择 Claude Agent SDK:如果你坚定地只使用 Claude 模型,打算自托管,并且愿意亲自动手构建 API、身份认证和多租户层级

5 Harness 架构

智能体框架是多种不同能力的组合,旨在让构建长期运行的智能体变得更加容易。这些能力包括:

- 规划能力:让智能体学会拆解目标。

- 虚拟文件系统:提供一个模拟的文件操作环境。

- 文件系统权限:控制智能体对文件的读写范围。

- 任务委派(子智能体):允许主智能体将任务分派给专门的子智能体。

- 上下文与令牌管理:高效管理记忆和对话长度,防止溢出。

- 代码执行:赋予智能体编写并运行代码的能力。

- 人机协同:在关键节点允许人类介入进行确认或干预。

除了上述能力外,Deep Agents 还利用技能和记忆来提供额外的上下文信息和指令

核心定义与本质

- 本质:Harness = AI Agent 的全套支撑系统,包含代码、配置、规则、工具、状态、反馈等所有包裹在大模型之外的组件。

- 经典公式:

Agent = 大模型(Model) + Harness(驾驭层)

模型决定能力上限,Harness 决定实际落地效果 410。 - 比喻:若将 AI 智能体比作一辆车:

- 大模型 = 引擎(动力)

- Prompt = 方向盘(初步引导)

- Harness = 变速箱 + 制动器 + 仪表盘 + 安全带(有序输出、按规则行驶、掌握状态、防止失控)4

演进历程

-

Prompt Engineering(提示词工程)时代(2023–2024)

- 依赖人工调优指令(如 Few-shot、CoT)提升单次输出质量。

- 局限:脆弱、无状态、不可扩展 4。

-

Context Engineering(上下文工程)过渡期(2025)

- 引入 RAG、外部记忆(如 AutoGPT 的

.txt文件)、上下文压缩。 - 仍不足:只管“信息存取”,不管“流程执行”与“质量保障” 4。

- 引入 RAG、外部记忆(如 AutoGPT 的

-

Harness Engineering(驾驭工程)时代(2026 至今)

- 构建“约束 + 引导 + 监控 + 纠错”闭环系统。

- 核心目标:将非确定性的 LLM 转化为可信赖、可审计、可规模化的生产力工具

5.1 规划能力

该框架提供了一个 write_todos 工具,智能体可以使用它来维护一个结构化的任务列表。

功能特点:

- 跟踪多个任务及其状态:包括“待办”、“进行中”和“已完成”。

- 持久化存储在智能体状态中:确保任务列表不会丢失。

- 帮助智能体组织复杂的多步骤工作:让复杂的任务变得井井有条。

- 适用于长期运行的任务和规划:特别适合需要长时间处理的工作

5.2 虚拟文件系统访问

该框架提供了一个可配置的虚拟文件系统,它可以由不同的可插拔后端提供支持。这些后端支持以下文件系统操作:

| 工具 | 描述 |

|---|---|

| ls | 列出目录中的文件及其元数据(大小、修改时间)。 |

| read_file | 读取文件内容并带行号,支持通过偏移量/限制来读取大文件。也支持为非文本文件(如图像、视频、音频和文档)返回多模态内容块。请参见下方支持的文件扩展名。 |

| write_file | 创建新文件。 |

| edit_file | 在文件中执行精确的字符串替换(支持全局替换模式)。 |

| glob | 查找匹配特定模式的文件(例如 **/*.py)。 |

| grep | 搜索文件内容,提供多种输出模式(仅文件、带上下文的内容或计数)。 |

| execute | 在环境中运行 Shell 命令(仅限沙盒后端可用)。 |

支持的文件扩展名

| Type | Extensions |

|---|---|

| Image | .png, .jpg, .jpeg, .gif, .webp, .heic, .heif |

| Video | .mp4, .mpeg, .mov, .avi, .flv, .mpg, .webm, .wmv, .3gpp |

| Audio | .wav, .mp3, .aiff, .aac, .ogg, .flac |

| File | .pdf, .ppt, .pptx |

虚拟文件系统会被框架的其他几项能力所使用,例如技能、记忆、代码执行和上下文管理。在为 Deep Agents 构建自定义工具和中间件时,你也可以利用这个文件系统

5.3 文件系统权限

该框架支持声明式权限规则,用于控制智能体可以读取或写入哪些文件和目录。权限适用于上面列出的内置文件系统工具,并按照声明顺序进行评估,遵循“首次匹配生效”的原则。

工作原理:

- 传递规则列表:在创建智能体时,通过

permissions=参数传递一个规则列表。 - 规则定义:每个规则指定操作("read" 读取,"write" 写入)、路径(通配符模式)和模式("allow" 允许 或 "deny" 拒绝)。

- 匹配逻辑:第一条匹配的规则生效。如果没有规则匹配,则默认允许该操作。

为什么它很有用:

- 限制目录范围:将智能体限制在特定目录内(例如

/workspace/)。 - 保护敏感文件:保护敏感文件(例如

.env文件、凭证)。 - 子智能体权限隔离:给予子智能体比主智能体更窄的访问权限。

注意事项:

权限不适用于沙盒后端,因为沙盒后端通过 execute 工具支持任意命令执行。对于自定义验证逻辑,请使用后端策略钩子。有关完整的规则结构、示例和子智能体继承,请参阅权限文档

5.4 任务委派(子智能体)

该框架允许主智能体为独立的、多步骤的任务创建临时的“子智能体”。

为什么它很有用:

- 上下文隔离:子智能体的工作过程不会弄乱主智能体的上下文(记忆)。

- 并行执行:多个子智能体可以同时运行,提高效率。

- 专业化分工:子智能体可以拥有不同的工具或配置,术业有专攻。

- 令牌效率:庞大的子任务上下文会被压缩成一份最终结果,节省资源。

工作原理:

- 主智能体拥有一个

task工具。 - 当调用该工具时,它会创建一个拥有独立上下文的全新智能体实例。

- 子智能体自主执行任务,直到完成。

- 最后只向主智能体返回一份最终报告。

- 注意:子智能体是无状态的(不能像聊天那样来回发多条消息,只能给个最终结果)。

默认子智能体:

- 系统自动提供一个“通用型”子智能体。

- 它默认拥有文件系统工具。

- 你可以通过添加工具或中间件来自定义它。

自定义子智能体:

- 你可以定义拥有特定工具的专用子智能体。

- 例如:代码审查员、网络研究员、测试运行器。

- 通过

subagents参数进行配置。

5.5 上下文管理

该框架负责管理上下文,以便深度智能体能够在令牌限制范围内处理长期运行的任务,同时保留它们所需的信息。

工作原理:

输入上下文:系统提示词、记忆、技能和工具提示词,共同塑造了智能体启动时所知道的内容。

压缩:内置的“卸载”和“总结”功能,确保在任务进行中,上下文始终保持在窗口限制内。

隔离:子智能体将繁重的工作隔离开来,只返回结果(参见任务委派)。

长期记忆:通过虚拟文件系统,实现跨线程的持久化存储。

为什么它很有用:

突破限制:使得智能体能够执行超过单个上下文窗口限制的多步骤任务。

自动筛选:让最相关的信息保持在视野范围内,无需手动修剪。

节省成本:通过自动总结和卸载,减少令牌使用量。

有关配置详情,请参阅上下文工程。

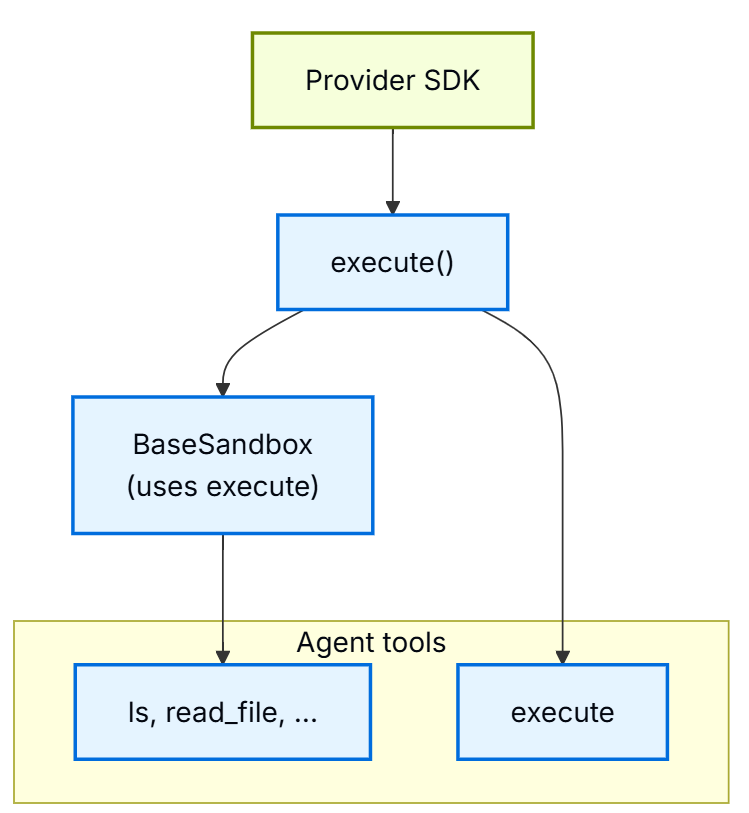

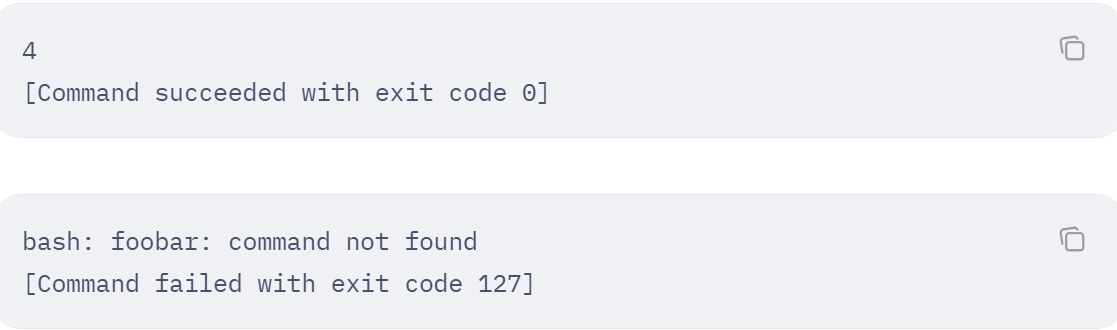

5.6 代码执行

当使用沙箱后端(Sandbox Backend)时,Agent Harness 会暴露一个 execute 工具,允许 Agent 在隔离环境中运行 Shell 命令。这使得 Agent 能够作为任务的一部分安装依赖项、运行脚本和执行代码。

工作原理

- 协议检测:沙箱后端实现了

SandboxBackendProtocolV2接口。一旦 Harness 检测到该接口,就会自动将execute工具添加到 Agent 可用的工具集中。 - 功能限制:如果没有配置沙箱后端,Agent 仅拥有文件系统工具(如

read_file、write_file等),无法执行任何命令。 - 返回结果:

execute工具会返回合并后的标准输出(stdout)和标准错误(stderr)、退出码(exit code)。如果输出内容过大,系统会自动截断并保存为文件,供 Agent 增量读取。

核心价值

-

安全性

代码在隔离环境中运行,有效保护主机系统免受 Agent 操作的影响。即使 Agent 生成恶意代码或遭受攻击,风险也被限制在沙箱内部。 -

纯净环境

无需在本地进行复杂配置,即可使用特定的依赖库或操作系统配置。这消除了“在我机器上能跑”的环境差异问题。 -

可复现性

为团队提供一致的执行环境,确保不同成员或在不同时间运行的任务具有相同的行为表现。

有关沙箱的设置、支持的提供商以及文件传输 API 的详细信息,请参阅 Sandboxes 相关文档。

5.7 人机协同

该框架可以在特定的工具调用时暂停智能体的执行,以便让人类进行批准或修改。此功能通过 interrupt_on 参数按需开启。

配置方法:

- 在调用

create_deep_agent时,传递interrupt_on参数,该参数是一个将工具名称映射到中断配置的字典。 - 示例:

interrupt_on={"edit_file": True}会在每次编辑文件之前暂停。 - 当被提示时,你可以提供批准信息,或者修改工具的输入参数。

为什么它很有用:

- 安全闸门:防止破坏性操作(比如误删文件)。

- 用户验证:在进行昂贵的 API 调用之前,先让用户确认一下(省钱)。

- 交互式调试与指导:在运行过程中,人类可以随时介入纠正方向

5.8 技能

该框架支持“技能”,可以为你的深度智能体提供专门的工作流程和领域知识。

工作原理:

- 遵循标准:技能遵循“智能体技能”标准。

- 文件结构:每个技能都是一个目录,其中包含一个

SKILL.md文件,里面有指令和元数据。 - 丰富资源:技能目录里还可以包含额外的脚本、参考文档、模板和其他资源。

- 渐进式披露:技能只有在智能体判断对当前任务有用时才会被加载(平时是隐藏的)。

- 加载机制:智能体在启动时会读取每个

SKILL.md文件的“页眉元数据”(frontmatter),只有在需要时才会去查看完整的技能内容。

为什么它很有用:

- 节省令牌:只在需要时加载相关技能,大大减少了令牌消耗。

- 能力打包:将多种能力打包成更大的动作,并附带额外的上下文信息。

- 保持整洁:提供专业知识,但不会弄乱系统提示词(主指令)。

- 模块化与复用:让智能体的能力变得模块化,可以重复使用。

有关更多信息,请参阅技能文档。

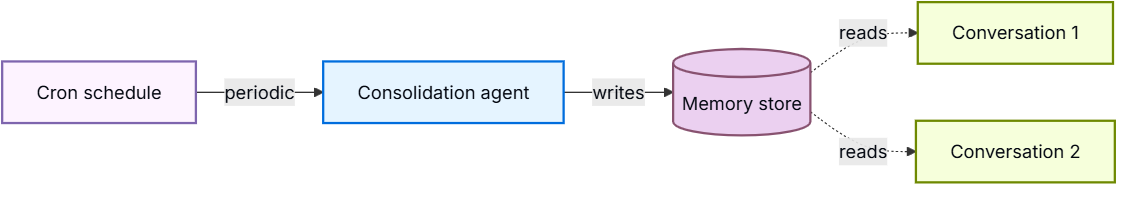

5.9 记忆

该框架支持持久化的记忆文件,可以在多次对话中为你的深度智能体提供额外的上下文。这些文件通常包含通用的编码风格、偏好设置、惯例和指南,帮助智能体理解如何与你的代码库协作,并遵循你的偏好。

工作原理:

- 使用

AGENTS.md文件:利用这些文件来提供持久化的上下文。 - 始终加载:记忆文件是总是被加载的(这与使用渐进式披露的“技能”不同)。

- 配置路径:在创建智能体时,将一个或多个文件路径传递给

memory参数。 - 存储位置:文件存储在智能体的后端中(

StateBackend、StoreBackend或FilesystemBackend)。 - 自我进化:智能体可以根据你们的互动、反馈和识别出的模式来更新记忆。

为什么它很有用:

- 持久化上下文:提供持久的上下文,不需要在每次对话时都重新指定。

- 存储偏好:非常适合存储用户偏好、项目指南或领域知识。

- 始终可用:智能体随时可以使用这些信息,确保行为的一致性。

有关配置详情和示例,请参阅记忆文档。

6 模型

Deep Agents 可以与任何支持工具调用的 LangChain 聊天模型协同工作

6.1 支持的模型

请使用 提供商:模型 的格式来指定模型(例如 google_genai:gemini-3.1-pro-preview、openai:gpt-5.4 或 anthropic:claude-sonnet-4-6)。关于有效的提供商字符串,请参阅 init_chat_model 的 model_provider 参数。关于特定提供商的配置,请参阅聊天模型集成文档。

🌟 推荐模型

这些模型在 Deep Agents 评估套件中表现良好,该套件主要测试智能体的基本操作能力。注意: 通过这些评估只是必要条件,并不代表模型在更长、更复杂的任务中一定能表现出色。

| 提供商 | 模型 |

|---|---|

| gemini-3.1-pro-preview, gemini-3-flash-preview | |

| OpenAI | gpt-5.4, gpt-4o, gpt-5.4, o4-mini, gpt-5.2-codex, gpt-4o-mini, o3 |

| Anthropic | claude-opus-4-6, claude-opus-4-5, claude-sonnet-4-6, claude-sonnet-4, claude-sonnet-4-5, claude-haiku-4-5, claude-opus-4-1 |

| Open-weight (开源权重) | GLM-5, Kimi-K2.5, MiniMax-M2.5, qwen3.5-397B-A17B, devstral-2-123B |

Open-weight 模型可以通过 Baseten、Fireworks、OpenRouter 和 Ollama 等提供商获取。

6.2 配置模型参数

你可以通过两种方式配置模型:

- 使用字符串:在调用

create_deep_agent时,以提供商:模型的格式传递一个模型字符串。 - 使用实例:直接传递一个已经配置好的模型实例,以获得完全的控制权。

模型字符串会在底层通过 init_chat_model 函数进行解析和实例化。

若要配置特定于模型的参数(比如温度、最大令牌数等),你可以使用 init_chat_model 函数,或者直接实例化一个提供商的模型类:

#init_chat_model

from langchain.chat_models import init_chat_model

from deepagents import create_deep_agent

model = init_chat_model(

model="google_genai:gemini-3.1-pro-preview",

thinking_level="medium",

)

agent = create_deep_agent(model=model)

#

from langchain_google_genai import ChatGoogleGenerativeAI

from deepagents import create_deep_agent

model = ChatGoogleGenerativeAI(

model="gemini-3.1-pro-preview",

thinking_level="medium",

)

agent = create_deep_agent(model=model)可用参数因提供商而异。请参阅“聊天模型集成”页面,查看特定于提供商的配置选项。

6.3 在运行时选择模型

如果你的应用程序允许用户选择模型(例如使用 UI 中的下拉菜单),请使用中间件在运行时交换模型,而无需重新构建智能体。通过运行时上下文传递用户的模型选择,然后使用 @wrap_model_call 装饰器,通过 wrap_model_call 中间件在每次调用时覆盖模型:

from dataclasses import dataclass

from langchain.chat_models import init_chat_model

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from deepagents import create_deep_agent

from typing import Callable

@dataclass

class Context:

model: str

@wrap_model_call

def configurable_model(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse],

) -> ModelResponse:

model_name = request.runtime.context.model

model = init_chat_model(model_name)

return handler(request.override(model=model))

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

middleware=[configurable_model],

context_schema=Context,

)

# Invoke with the user's model selection

result = agent.invoke(

{"messages": [{"role": "user", "content": "Hello!"}]},

context=Context(model="openai:gpt-5.4"),

)6.4 上下文工程

上下文工程是指以正确的格式提供正确的信息和工具,以便你的深度智能体能够可靠地完成任务。

深度智能体可以使用多种类型的上下文:

- 启动时:有些来源是在智能体启动时就提供的(比如系统预设)。

- 运行时:有些来源是在运行过程中才出现的(比如用户的输入)。

深度智能体内置了各种机制,用于在长时间运行的会话中管理这些上下文。

本页将概述你的深度智能体可以访问和管理的各种上下文类型。刚接触上下文工程?请查看概念概览,了解不同类型的上下文以及何时使用它们

6.5 上下文的类型

| 上下文类型 | 你可以控制的内容 | 作用范围 |

|---|---|---|

| 输入上下文 | 决定在启动时放入智能体提示词的内容(系统提示词、记忆、技能) | 静态的,每次运行都会应用 |

| 运行时上下文 | 在调用时传递的静态配置(用户元数据、API 密钥、连接信息) | 每次运行,并会传播给子智能体 |

| 上下文压缩 | 内置的卸载和摘要机制,用于将上下文保持在窗口限制内 | 自动的,当接近限制时触发 |

| 上下文隔离 | 使用子智能体来隔离繁重的工作,只将结果返回给主智能体 | 每个子智能体,仅在委托任务时 |

| 长期记忆 | 使用虚拟文件系统在多个线程间进行持久化存储 | 跨对话持久化 |

6.6 输入上下文

输入上下文是指在启动时提供给深度智能体的信息,这些信息会成为其系统提示词的一部分。最终的提示词由以下几个来源组成:

- 系统提示词

包含你提供的自定义指令,以及内置的智能体指导原则。 - 记忆

配置后始终会被加载的持久化AGENTS.md文件。 - 技能

仅在相关时才会加载的按需能力(渐进式披露)。 - 工具提示词

关于如何使用内置工具或自定义工具的说明。

6.6.1 系统提示词

你的自定义系统提示词会被前置(添加在前面)到内置的系统提示词中。包含关于规划的指导、文件系统工具的使用说明、子智能体的使用说明。你应该用它来定义:智能体的角色、行为、知识

from deepagents import create_deep_agent

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

system_prompt=(

"You are a research assistant specializing in scientific literature. "

"Always cite sources. Use subagents for parallel research on different topics."

),

)system_prompt 参数是静态的,这意味着它在每次调用时不会改变。

为什么需要动态提示?

在某些用例中,你可能需要一个动态的提示词。例如:

- 权限控制:根据情况告诉模型“你拥有管理员权限”或者“你只有只读权限”。

- 用户偏好:从长期记忆中注入用户喜好,比如“用户喜欢简洁的回复”。

如何实现?

如果你的提示词依赖于上下文或 runtime.store(运行时存储),请使用 @dynamic_prompt 装饰器来构建感知上下文的指令。

技术细节:

- 你的中间件可以读取

request.runtime.context和request.runtime.store。 - 关于添加自定义中间件,请参阅“定制化”章节;关于示例,请参阅 LangChain 上下文工程指南。

关于工具(Tools)的特别说明:

- 不需要中间件的情况:如果仅仅是工具需要使用上下文或

runtime.store,你不需要写中间件。因为工具会直接接收ToolRuntime对象(其中包含运行时上下文和存储)。 - 需要中间件的情况:只有当你需要根据上下文更新系统提示词(也就是改变给模型的指令)时,才需要添加中间件。

6.6.2 记忆

记忆文件(即 AGENTS.md 文件)提供了持久化的上下文,这些内容始终会被加载到系统提示词中。

你应该用“记忆”来存储:

- 项目惯例(比如代码风格、命名规范)

- 用户偏好(比如“我喜欢用深色模式”)

- 关键准则(那些在每次对话中都必须遵守的规则

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

memory=["/project/AGENTS.md", "~/.deepagents/preferences.md"],

)与技能不同,记忆是始终被注入的——不存在渐进式披露。优化建议:

- 保持记忆最小化:以避免上下文过载(即令牌数超标)。

- 使用技能:将详细的工作流程和特定领域的内容放在“技能”中。

有关配置的详细信息,请参阅“记忆”章节

6.3.3 技能

技能提供了按需使用的能力。

工作机制:

- 启动时:智能体只会读取每个

SKILL.md文件的文件头(frontmatter,即元数据摘要)。 - 运行时:只有当智能体判断该技能与当前任务相关时,才会加载该技能的完整内容。

好处:

这种方式在提供专业工作流的同时,有效地减少了令牌的使用量

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

skills=["/skills/research/", "/skills/web-search/"],

)技能的编写最佳实践

核心原则:

- 保持专注:让每个技能只专注于单一的工作流或领域。

- 避免宽泛:宽泛或重叠的技能会稀释相关性,并且在加载时会膨胀上下文(浪费令牌)。

内容组织:

- 保持精简:在技能文件内部,保持主要内容简洁。

- 外部引用:将详细的参考资料移动到单独的文件中,然后在技能文件中引用它们(而不是把长文直接贴进去)。

区分用途:

- 记忆:用来存放那些“永远相关”的惯例。

有关编写和配置的详细信息,请参阅“技能”章节。

6.3.4 工具提示词

工具提示词是指导模型如何使用工具的指令。

基本原理:

所有工具都会向模型暴露元数据(通常是模式和描述),模型会在其提示词中看到这些信息。

- 当你通过

tools参数传递工具时,这些工具的元数据(模式和描述)就会呈现给模型。 - 深度智能体的内置工具通常被封装在中间件中,并且通常会通过更多的指导说明来更新系统提示词。

1. 内置工具

这些是中间件添加的“装备”能力(规划、文件系统、子智能体)。它们会自动将特定于工具的指令附加到系统提示词中,从而创建解释如何有效使用这些工具的提示词:

- 规划提示词:指导如何使用

write_todos来维护一个结构化的任务列表。 - 文件系统提示词:关于

ls、read_file、write_file、edit_file、glob、grep的文档(如果在使用沙盒后端,还包括execute)。 - 子智能体提示词:关于如何使用

task工具来委派工作的指导。 - 人机回环提示词:关于在指定工具调用时暂停的用法(当设置了

interrupt_on时)。 - 本地上下文提示词:当前目录和项目信息(仅限 CLI)。

2. 你提供的工具

通过 tools 参数传递的工具,其描述(来自工具模式)会被发送给模型。你也可以添加自定义中间件来添加工具并追加其自己的系统提示词指令。

编写建议:

对于你提供的工具,请务必提供清晰的名称、描述和参数描述。

- 这些内容会指导模型推理何时以及如何使用该工具。

- 在描述中包含“何时使用该工具”,并描述每个参数的作用。

@tool(parse_docstring=True)

def search_orders(

user_id: str,

status: str,

limit: int = 10

) -> str:

"""Search for user orders by status.

Use this when the user asks about order history or wants to check

order status. Always filter by the provided status.

Args:

user_id: Unique identifier for the user

status: Order status: 'pending', 'shipped', or 'delivered'

limit: Maximum number of results to return

"""

# Implementation here

...关于内置能力,请参阅 “Harness” 章节。关于直接传递工具,请参阅 “Customization” 章节

6.3.5 完整的系统提示词

深度智能体的系统消息——也就是模型在运行开始时接收到的组装好的系统提示词——由以下几个部分组成:

- 自定义系统提示词(如果你提供了的话)

- 基础智能体提示词

- 待办列表提示词:关于如何使用待办列表进行规划的指令

- 记忆提示词:

AGENTS.md内容 + 记忆使用指南(仅当提供了记忆文件时存在) - 技能提示词:技能存放路径 + 包含文件头信息的技能列表 + 使用说明(仅当提供了技能时存在)

- 虚拟文件系统提示词(文件系统 + 执行工具的文档,如果适用的话)

- 子智能体提示词:任务工具的使用说明

- 用户提供的中间件提示词(如果你提供了自定义中间件的话)

- 人机回环提示词(当设置了

interrupt_on时存在)

6.6 运行时上下文

运行时上下文是你调用 Agent 时传入的“单次运行”配置。 它不会自动包含在发给模型的提示词里;只有当工具、中间件或其他逻辑主动读取它,并将其添加到消息或系统提示词中时,模型才能看到它。运行时上下文用来存储用户元数据(如 ID、偏好设置、角色)、API 密钥、数据库连接、功能开关,或其他你的工具和框架需要的值。使用 context_schema 来定义数据的结构(Shape):可以使用 dataclasses.dataclass 或 typing.TypedDict 类。通过调用 invoke 或 ainvoke 时的 context 参数来传递具体的值。关于完整细节,请查阅 Runtime and LangGraph runtime context 文档。在工具内部: 请从注入的 ToolRuntime 中读取上下文。

from dataclasses import dataclass

from deepagents import create_deep_agent

from langchain.tools import tool, ToolRuntime

@dataclass

class Context:

user_id: str

api_key: str

@tool

def fetch_user_data(query: str, runtime: ToolRuntime[Context]) -> str:

"""Fetch data for the current user."""

user_id = runtime.context.user_id

return f"Data for user {user_id}: {query}"

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

tools=[fetch_user_data],

context_schema=Context,

)

result = agent.invoke(

{"messages": [{"role": "user", "content": "Get my recent activity"}]},

context=Context(user_id="user-123", api_key="sk-..."),

)运行时上下文会传播给所有的子智能体。当子智能体运行时,它会接收到与父代理完全相同的运行时上下文。如果需要为单个子智能体设置独立的上下文(例如使用命名空间键),请查阅 Subagents 文档

6.7 上下文压缩

长时间运行的任务会产生大量的工具输出和冗长的对话历史。上下文压缩的作用就是在保留任务相关细节的同时,缩小 Agent 工作记忆中的信息体积。以下是内置的机制,用于确保传递给大语言模型(LLMs)的上下文始终保持在窗口限制之内:

- 卸载

将大型的工具输入和结果存储到文件系统中,并在上下文中用引用链接来替代它们(即不直接占内存,而是指个路)。 - 摘要

当上下文接近限制时,利用 LLM 将旧的消息压缩生成一份摘要。

6.7.1 卸载

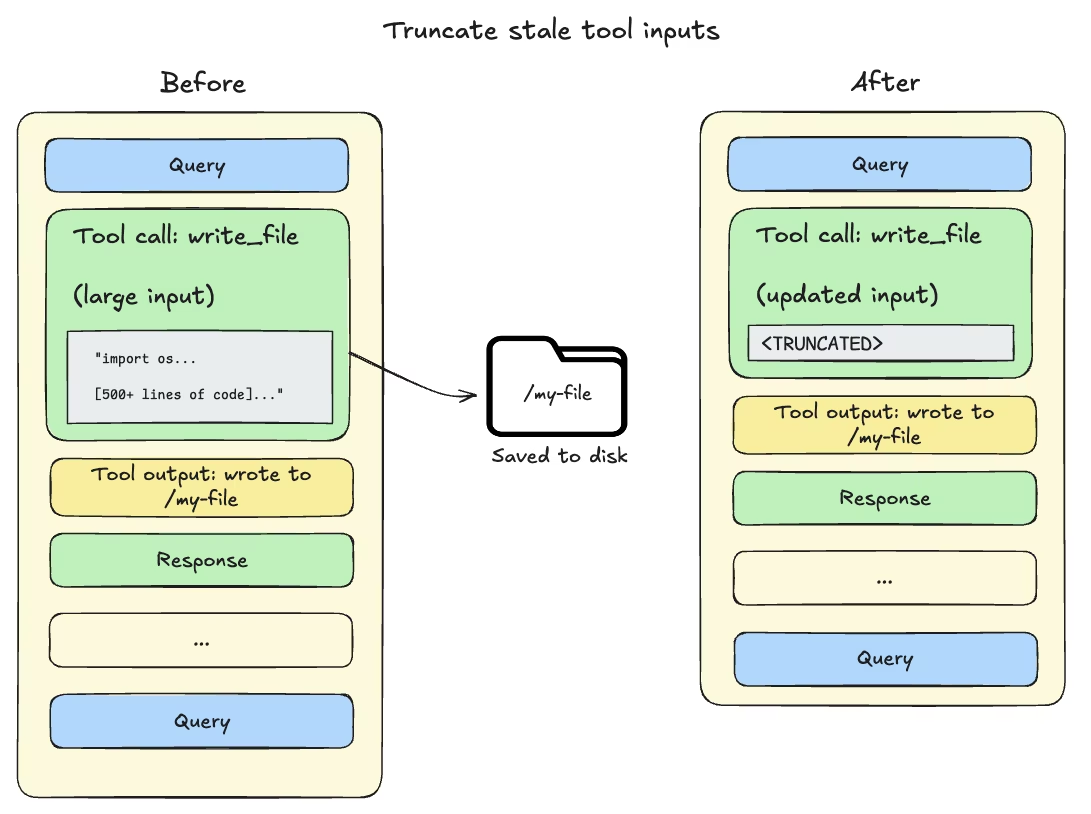

Deep Agents 利用内置的文件系统工具,自动将内容卸载(存储到磁盘),并在需要时搜索和检索这些已卸载的内容。当工具调用的输入或结果超过设定的 Token 阈值(默认为 20,000)时,就会触发内容卸载:

1 工具调用输入超过 20,000 Token 时:

文件写入和编辑操作会在 Agent 的对话历史中留下包含完整文件内容的工具调用记录。由于这些内容已经持久化到了文件系统中,历史记录里的完整内容往往就成了冗余数据。

当会话上下文占用量达到模型可用窗口的 85% 时,Deep Agents 会截断(删除)旧的工具调用记录,将其替换为指向磁盘上文件的指针,从而减小活跃上下文的大小。

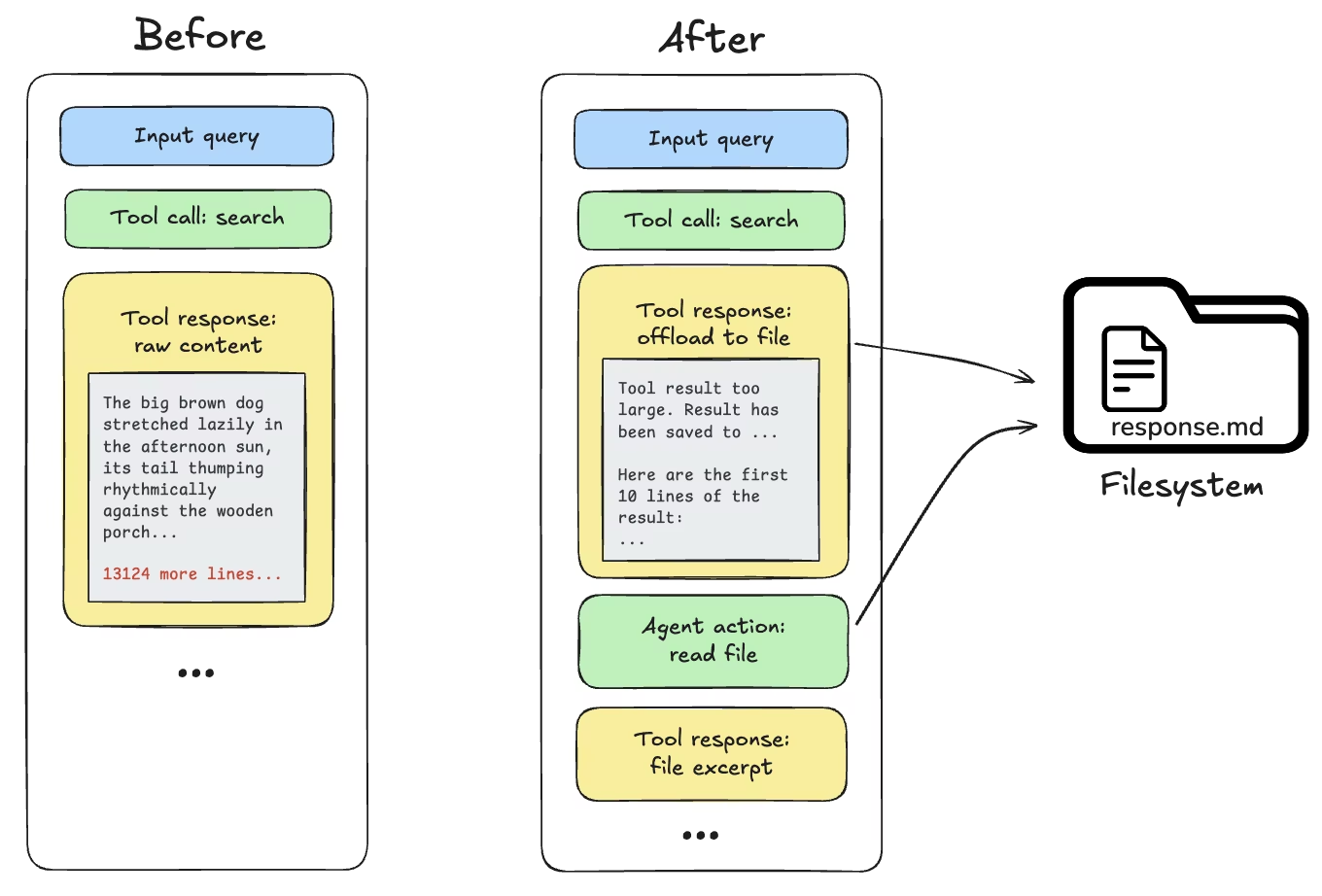

2 工具调用结果超过 20,000 Token 时:

当发生这种情况,Deep Agent 会将响应内容卸载(存储)到配置好的后端中,并用一个文件路径引用以及前 10 行的预览内容来替代原本庞大的结果。随后,Agent 可以根据需要重新读取或搜索该内容。

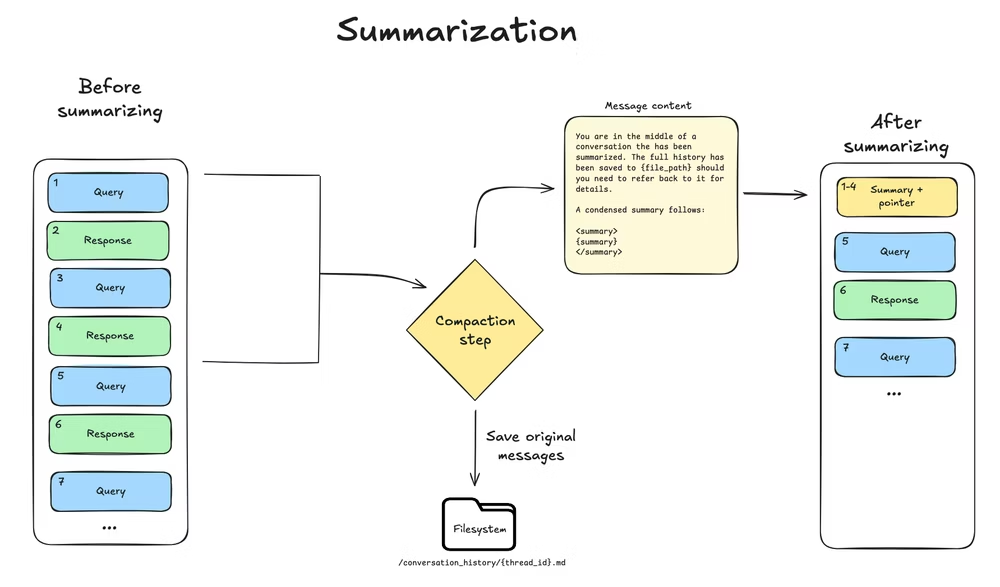

摘要

当上下文大小超过了模型的上下文窗口限制(例如达到了 max_input_tokens 的 85%),并且没有更多的上下文可以被卸载(即没法再通过存文件来省空间了)时,Deep Agent 会对消息历史进行摘要。

这个过程包含两个部分:

- 上下文内摘要:

LLM 会生成一份结构化的对话摘要,内容包括会话意图、创建的工件(产物)以及后续步骤。这份摘要将替代 Agent 工作记忆中的完整对话历史。 - 文件系统归档:

完整的、原始的对话消息会被写入文件系统,作为一份标准记录保存下来。

这种双重方法确保了 Agent 既能通过摘要掌握其目标和进度,又能在需要时通过搜索文件系统来恢复具体的细节。

配置:

- 触发阈值:当上下文占用达到模型配置文件中

max_input_tokens的 85% 时触发。 - 保留策略:保留 10% 的 Token 作为最近的上下文(即保留最新的对话内容不被压缩)。

- 默认回退值:如果无法获取模型配置文件,则默认回退到 170,000 Token 触发阈值,并保留 6 条消息。

- 错误处理:如果任何模型调用抛出了标准的

ContextOverflowError(上下文溢出错误),Deep Agent 会立即回退到摘要模式,并使用“摘要 + 最近保留的消息”进行重试。 - 处理方式:旧的消息由模型进行摘要生成

从 Agent 流式传输的 Token 通常会包含摘要步骤生成的 Token。你可以利用它们关联的元数据来过滤掉这些 Token:

for chunk in agent.stream(

{"messages": [...]},

stream_mode="messages",

version="v2",

):

token, metadata = chunk["data"]

if metadata.get("lc_source") == "summarization":

continue

else:

...摘要工具

摘要工具中间件需要 deepagents>=1.6.0 版本。

Deep Agents 包含一个可选的摘要工具,使 Agent 能够在合适的时机(例如在任务之间)触发摘要,而不是仅在达到固定的 Token 间隔时触发。

你可以通过将该工具添加到中间件列表中来启用它:

from deepagents import create_deep_agent

from deepagents.backends import StateBackend

from deepagents.middleware.summarization import (

create_summarization_tool_middleware,

)

backend = StateBackend # if using default backend 内存状态

model = "google_genai:gemini-3.1-pro-preview"

agent = create_deep_agent(

model=model,

middleware=[

create_summarization_tool_middleware(model, backend),

],

)启用此功能不会禁用模型上下文限制达到 85% 时的默认摘要操作。有关详细信息,请参阅 SummarizationToolMiddleware API 参考文档

6.8 子智能体上下文隔离

子智能体是解决上下文膨胀问题的利器。当主代理使用那些会产生大量输出的工具(如网络搜索、文件读取、数据库查询)时,上下文窗口会迅速被填满。子智能体可以将这些工作隔离开来——主代理只会收到最终结果,而不会看到产生该结果所经历的数十次工具调用。你还可以独立配置每个子智能体(例如模型、工具、系统提示词和技能),使其与主代理不同。

工作原理:

- 主代理拥有一个用于分配工作的任务工具。

- 子智能体带着自己全新的上下文开始运行。

- 子智能体自主执行任务直到完成。

- 子智能体向主代理返回一份最终报告。

- 主代理的上下文保持干净。

最佳实践:

- 委托复杂任务:对于那些会弄乱主代理上下文的多步骤工作,请使用子智能体。

- 保持子智能体响应简洁:指示子智能体返回摘要,而不是原始数据:

research_subagent = {

"name": "researcher",

"description": "Conducts research on a topic",

"system_prompt": """You are a research assistant.

IMPORTANT: Return only the essential summary (under 500 words).

Do NOT include raw search results or detailed tool outputs.""",

"tools": [web_search],

}利用文件系统处理大数据:子智能体可以将结果写入文件;主代理只需读取它需要的部分。有关配置和上下文管理的详情,请参阅 Subagents 文档,了解运行时上下文传播和每个子智能体的命名空间管理。

6.9 长期记忆

使用默认文件系统时,Deep Agent 的工作记忆文件存储在 Agent 状态中,这仅在线程内持久化。长期记忆功能使 Deep Agent 能够跨不同的线程和对话持久化信息。Deep Agents 可以利用长期记忆来存储用户偏好、积累的知识、研究进度或任何应该超出单次会话范围的信息。

要使用长期记忆,你必须使用 CompositeBackend,它将特定路径(通常是 /memories/)路由到 LangGraph Store,后者提供持久的跨线程持久化。CompositeBackend 是一种混合存储系统,其中一些文件无限期持久化,而其他文件仍限定在单个线程范围内

from deepagents import create_deep_agent

from deepagents.backends import CompositeBackend, StateBackend, StoreBackend

from langgraph.store.memory import InMemoryStore

def make_backend(runtime):

return CompositeBackend(

default=StateBackend(runtime),

routes={"/memories/": StoreBackend(runtime)},

)

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

store=InMemoryStore(),

backend=make_backend,

system_prompt="""When users tell you their preferences, save them to

/memories/user_preferences.txt so you remember them in future conversations.""",

)你不需要预先填充 /memories/ 目录下的文件。你只需提供后端配置、存储库以及系统提示词指令,告诉 Agent 该保存什么以及保存在哪里。例如,你可以提示 Agent 将偏好设置存储在 /memories/preferences.txt 中。该路径初始为空,当用户分享值得记住的信息时,Agent 会使用其文件系统工具(write_file、edit_file)按需创建文件。

若要预先植入记忆,请在 LangSmith 上部署时使用 Store API。有关设置和用例,请参阅 长期记忆 文档。

6.10 最佳实践

- 从正确的输入上下文开始 —— 保持记忆最小化,仅用于始终相关的约定;使用聚焦的技能(Skills)来处理特定任务的能力。

- 利用子代理处理繁重工作 —— 将多步骤、输出量大的任务委托出去,以保持主代理的上下文干净。

- 在配置中调整子代理输出 —— 如果你在调试时注意到子代理生成了过长的输出,可以在子代理的

system_prompt中添加指导,要求其创建摘要和总结返回内容。 - 使用文件系统 —— 将大量输出持久化到文件中(例如子代理写入或自动卸载),以便活动上下文保持小巧;当模型需要细节时,可以使用

read_file和grep拉取片段。 - 记录长期记忆结构 —— 告诉 Agent 什么内容存储在

/memories/中以及如何使用它。 - 为工具传递运行时上下文 —— 使用上下文传递用户元数据、API 密钥以及其他工具所需的静态配置。

6.11 相关资源

- Harness —— 上下文管理概览、卸载、摘要

- 子代理 —— 上下文隔离、运行时上下文传播

- 长期记忆 —— 跨线程持久化

- 技能 —— 渐进式披露和技能编写

- 后端 —— 文件系统后端和 CompositeBackend

- 上下文概念概览 —— 上下文类型和生命周期

7 后端

Deep Agents 通过 ls、read_file、write_file、edit_file、glob 和 grep 等工具向 Agent 暴露了一个文件系统界面。这些工具通过一个可插拔的后端进行操作。read_file 工具在所有后端中原生支持图像文件(.png、.jpg、.jpeg、.gif、.webp),并将它们作为多模态内容块返回。

沙箱和 LocalShellBackend 还提供了一个 execute 工具。本页面将解释如何:

- 选择后端,

- 将不同路径路由到不同后端,

- 实现你自己的虚拟文件系统(例如 S3 或 Postgres),

- 设置文件系统访问权限,

- 遵守后端协议

7.1 起步

这里有几个预构建的文件系统后端,你可以快速在你的 Deep Agent 中使用:

| 内置后端 | 描述 |

|---|---|

默认agent = create_deep_agent(model="...") |

状态中的临时存储。代理的默认文件系统后端存储在 langgraph 状态中。请注意,此文件系统仅在线程内持久化。 |

本地文件系统持久化agent = create_deep_agent(..., backend=FilesystemBackend(root_dir="/Users/...")) |

这使 Deep Agent 能够访问你本地机器的文件系统。你可以指定代理有权访问的根目录。请注意,提供的 root_dir 必须是绝对路径。 |

持久化存储 (LangGraph Store)agent = create_deep_agent(..., backend=StoreBackend()) |

这使代理能够访问跨线程持久化的长期存储。这对于存储长期记忆或适用于代理多次执行的指令非常有用。 |

沙箱agent = create_deep_agent(..., backend=sandbox) |

在隔离环境中执行代码。沙箱提供文件系统工具以及用于运行 Shell 命令的 execute 工具。可选择 Modal、Daytona、Deno 或本地 VFS。 |

本地 Shellagent = create_deep_agent(..., backend=LocalShellBackend(...)) |

直接在主机上访问文件系统和执行 Shell。无隔离——仅在受控的开发环境中使用。见下方的安全注意事项。 |

| 复合 默认临时, /memories/ 持久化。 |

复合后端具有最大的灵活性。你可以指定文件系统中的不同路由指向不同的后端。见下方的复合路由示例。 |

7.2 内置后端

7.2.1 StateBackend (ephemeral)

# By default we provide a StateBackend

agent = create_deep_agent(model="google_genai:gemini-3.1-pro-preview")

# Under the hood, it looks like

from deepagents.backends import StateBackend

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=StateBackend()

)工作原理:

- 通过

StateBackend将文件存储在当前线程的 LangGraph 代理状态中。 - 通过检查点(checkpoints),在同一线程的多个代理回合中保持持久化。

最适合:

- 作为代理写入中间结果的草稿纸(scratch pad)。

- 自动移除(eviction)大型工具输出,随后代理可以逐块读回这些输出。

注意: 此后端由监督者代理(supervisor agent)和子代理(subagents)共享,子代理写入的任何文件在子代理执行完成后,仍会保留在 LangGraph 代理状态中。这些文件将继续可供监督者代理和其他子代理使用。

7.2.2 FilesystemBackend (本地磁盘)

FilesystemBackend 会在一个可配置的根目录下,进行真实文件的读取和写入操作。

FilesystemBackend 的核心作用是将 Agent 的文件操作直接映射到你指定的本地磁盘目录。当 Agent 使用 write_file 或 read_file 工具时,它会真实地创建、修改或读取你硬盘上的文件。

⚠️ 安全警告详解

你贴出的这段文字,本质上是一份高风险操作的安全清单。我们来逐条拆解:

适用与不适用场景

- 适用:

- 本地开发 CLI:比如你自己在电脑上运行的编程助手,需要修改你的项目代码。

- CI/CD 流水线:在自动化的构建和部署流程中,Agent 需要生成或修改文件。

- 不适用:

- Web 服务器或 HTTP API:绝对禁止。如果你的 Agent 通过网页接口提供服务,使用

FilesystemBackend意味着任何用户都可能通过提示词注入等方式,让 Agent 读取或删除服务器上的任意文件。在这种场景下,必须使用StateBackend或沙箱后端。

- Web 服务器或 HTTP API:绝对禁止。如果你的 Agent 通过网页接口提供服务,使用

主要安全风险

- 秘密泄露:Agent 可以读取其权限范围内的任何文件,包括

.env、id_rsa等包含 API 密钥和凭证的敏感文件。 - SSRF 攻击:如果 Agent 同时拥有网络访问工具(如

curl),它可能会将读取到的秘密文件内容发送到外部恶意服务器。 - 不可逆的文件修改:Agent 的操作是永久性的。一个错误的指令可能导致

rm -rf式的灾难性后果,文件被删除后难以恢复。

推荐的安全防护措施

- 启用 HITL (Human-in-the-Loop):为

execute或文件写入等敏感操作设置人工审批环节,让 AI 在执行危险操作前必须获得你的确认。 - 隔离秘密文件:确保 Agent 可访问的目录(

root_dir)中不包含任何敏感信息。 - 生产环境使用沙箱:在任何生产环境中,都应使用

SandboxBackend(如基于 Docker 的沙箱),将 Agent 的操作限制在一个完全隔离的环境中。 - 强制开启虚拟模式 (virtual_mode=True):这是最关键的一点。在初始化

FilesystemBackend时,必须同时设置root_dir和virtual_mode=True。virtual_mode=True会阻止 Agent 使用..、~或绝对路径来访问root_dir之外的目录,从而将 Agent 的活动范围牢牢锁在你指定的项目文件夹内。- 警告:如果

virtual_mode=False(默认值),即使设置了root_dir,也没有任何安全防护作用。

from deepagents.backends import FilesystemBackend

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=FilesystemBackend(root_dir=".", virtual_mode=True)

)工作原理:

- 在可配置的

root_dir(根目录)下读取/写入真实文件。 - 你可以选择设置

virtual_mode=True,以便在root_dir下进行路径的沙箱化和标准化。 - 使用安全路径解析,尽可能防止不安全的符号链接遍历,可以使用

ripgrep进行快速grep搜索。

最适合:

- 你机器上的本地项目

- CI 沙箱环境

- 挂载的持久化卷

7.2.3 LocalShellBackend (local shell)

警告: 该后端赋予 Agent 直接的文件系统读写权限以及在你主机上无限制执行 Shell 命令的权限。请务必极其谨慎,仅在合适的环境中使用。

适用场景

- 本地开发命令行工具:例如运行在你自己电脑上的编程助手或开发工具。

- 个人开发环境:你完全信任该 Agent 生成的代码,并且是在你自己的机器上运行。

- CI/CD 流水线:前提是必须做好了完善的密钥管理。

不适用场景

- 生产环境:例如 Web 服务器、API 服务或多租户系统(绝对禁止)。

- 处理不可信的用户输入:或者执行不可信的代码时。

安全风险

- 任意命令执行:Agent 可以以你的用户权限执行任何 Shell 命令(例如

rm -rf /或格式化硬盘)。 - 文件读取:Agent 可以读取任何可访问的文件,包括敏感信息(API 密钥、凭证、

.env文件)。 - 秘密泄露:敏感数据可能会被暴露。

- 不可逆的操作:文件修改和命令执行是永久性的,无法撤销。

- 主机直接运行:命令直接在你的宿主机系统上运行,而不是在隔离环境中。

- 资源耗尽:命令可能会消耗无限的 CPU、内存或磁盘空间(例如挖矿脚本或死循环)。

推荐的安全防护措施

- 启用 HITL (Human-in-the-Loop):强烈建议开启人工介入中间件,在执行操作前进行审查和批准。

- 仅在专用环境运行:永远不要在共享系统或生产系统上使用。

- 使用沙箱后端:如果生产环境确实需要执行 Shell 命令,请使用基于 Docker 的沙箱后端。

关于虚拟模式的重要说明

注意: 当启用了 Shell 访问权限时,设置

virtual_mode=True无法提供任何安全保障。因为 Shell 命令(如cd /或cat /etc/passwd)可以绕过文件系统的限制,访问系统上的任何路径。

from deepagents.backends import LocalShellBackend

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=LocalShellBackend(root_dir=".", env={"PATH": "/usr/bin:/bin"})

)它是如何工作的?

- 继承文件功能:它首先包含了

FilesystemBackend的所有功能,意味着 Agent 可以读写文件。 - 增加执行工具:它提供了一个

execute工具,允许 Agent 运行 Shell 命令。 - 无沙箱运行:这是最关键的一点。命令是通过 Python 的

subprocess.run(shell=True)直接在你的主机上运行的。这意味着没有隔离层,Agent 运行的程序就是你运行的程序。 - 资源限制:为了防止命令卡死或输出过大,它支持以下配置:

timeout:超时时间(默认 120 秒)。max_output_bytes:最大输出字节数(默认 100,000 字节)。env/inherit_env:用于控制环境变量。

关键安全机制:关于 root_dir

这里有一个非常重要的细节需要注意:

"Shell commands use root_dir as the working directory but can access any path on the system."

- 工作目录:命令会在

root_dir指定的目录下启动(就像你先cd进了那个文件夹)。 - 访问权限:但是,Shell 命令本身不受

root_dir限制。如果 Agent 运行cat /etc/passwd或者ls /,它依然可以访问你系统上的任何文件。 - 结论:在

LocalBackend中,root_dir仅仅是一个“起始位置”,而不是一个“监狱”。

最佳使用场景

- 本地编程助手:当你自己在电脑上开发,需要一个能帮你运行代码、测试脚本的助手时。

- 快速迭代开发:在开发过程中,当你信任 Agent 能够帮你执行命令(如

npm install,python test.py)以加快进度时。

7.2.4 StoreBackend (LangGraph store)

from langgraph.store.memory import InMemoryStore

from deepagents.backends import StoreBackend

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=StoreBackend(

namespace=lambda ctx: (ctx.runtime.context.user_id,),

),

store=InMemoryStore() # Good for local dev; omit for LangSmith Deployment

)在本地开发时,我们通常需要自己配置一个 Store(比如使用 InMemoryStore 或连接 Redis/Postgres)来让 Agent 拥有长期记忆或跨会话的数据存储能力。

但是,当你把代码部署到 LangSmith Deployment 平台时:

- 不要在

create_deep_agent函数中传入store=...参数。 - 原因:LangSmith 平台会自动为你的 Agent 分配并管理一个持久化的存储后端。

namespace 参数用于控制数据隔离。在多用户部署中,务必设置命名空间工厂,以实现按用户或租户隔离数据。

工作原理:StoreBackend 将文件存储在运行时提供的 LangGraph BaseStore 中,从而实现跨线程的持久化存储。

最适合:

- 当你已经配置并运行了 LangGraph 存储时(例如 Redis、Postgres 或基于

BaseStore的云端实现)。 - 当你通过 LangSmith Deployment 部署代理时(系统会自动为你的代理配置一个存储)。

命名空间工厂

命名空间工厂控制 StoreBackend 读取和写入数据的位置。它接收一个 LangGraph Runtime(运行时),并返回一个用作存储命名空间的字符串元组。请使用命名空间工厂来隔离用户、租户或助手之间的数据。

在构建 StoreBackend 时,将命名空间工厂传递给 namespace 参数

NamespaceFactory = Callable[[Runtime], tuple[str, ...]]Runtime(运行时)提供:

rt.context—— 通过 LangGraph 上下文模式传递的用户自定义上下文(例如user_id)。rt.server_info—— 在 LangGraph Server 上运行时特有的服务器元数据(助手 ID、图 ID、认证用户)。rt.execution_info—— 执行身份信息(线程 ID、运行 ID、检查点 ID)。

Runtime 参数在 deepagents>=0.5.2 中可用。早期的 0.5.x 版本传递的是 BackendContext——请参见下文关于从 BackendContext 迁移的说明。rt.server_info 和 rt.execution_info 需要 deepagents>=0.5.0 版本。

通用命名空间模式

from deepagents.backends import StoreBackend

# Per-user: each user gets their own isolated storage

backend = StoreBackend(

namespace=lambda rt: (rt.server_info.user.identity,),

)

# Per-assistant: all users of the same assistant share storage

backend = StoreBackend(

namespace=lambda rt: (

rt.server_info.assistant_id,

),

)

# Per-thread: storage scoped to a single conversation

backend = StoreBackend(

namespace=lambda rt: (

rt.execution_info.thread_id,

),

)这段话主要是在讲如何定义和限制命名空间的规则,翻译过来就是:

您可以组合多个组件来创建更具体的作用域——例如,使用 (user_id, thread_id) 来实现每个用户、每个会话的隔离,或者添加像 "filesystem" 这样的后缀,以便在同一个作用域使用多个存储命名空间时进行区分。

命名空间组件必须仅包含字母数字字符、连字符、下划线、点、@、+、冒号和波浪号。通配符(*、?)会被拒绝,以防止 glob 注入。

如果没有提供命名空间工厂(namespace factory),传统的默认行为会使用 LangGraph 配置元数据中的 assistant_id。这意味着同一个 assistant 的所有用户将共享同一份存储。对于要上线到生产环境的多用户应用,请务必提供一个命名空间工厂。

7.2.4 CompositeBackend (router)

from deepagents import create_deep_agent

from deepagents.backends import CompositeBackend, StateBackend, StoreBackend

from langgraph.store.memory import InMemoryStore

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=CompositeBackend(

default=StateBackend(),

routes={

"/memories/": StoreBackend(),

}

),

store=InMemoryStore() # Store passed to create_deep_agent, not backend

)工作原理

CompositeBackend 会根据路径前缀,将文件操作路由到不同的后端。并且,它会在文件列表和搜索结果中保留原始的路径前缀。

适用场景

- 混合存储需求:当你希望 Agent 同时拥有临时存储(ephemeral)和跨线程存储(cross-thread)时,

CompositeBackend允许你同时提供一个StateBackend和一个StoreBackend。 - 统一文件视图:当你有多个信息来源,但希望将它们作为单一文件系统的一部分提供给 Agent 时。

举个例子

假设你有长期记忆存储在某个 Store 的 /memories/ 路径下,同时你还有一个自定义后端,里面存放着可以通过 /docs/ 访问的文档。使用 CompositeBackend,你可以把这两者合并,让 Agent 感觉像是在操作同一个文件系统。

7.3 指定一个后端

请传递一个后端实例给 create_deep_agent(model=..., backend=...)。文件系统中间件会利用它来支持所有的工具操作。该后端必须实现 BackendProtocol 接口(例如 StateBackend()、FilesystemBackend(root_dir=".") 或 StoreBackend())。

如果省略该参数,默认会使用 StateBackend()

7.4 不同后端路由

将命名空间的不同部分路由到不同的后端。这通常用于持久化存储 /memories/*(例如长期记忆),同时保持其他所有内容仅作为临时(ephemeral)存储。

from deepagents import create_deep_agent

from deepagents.backends import CompositeBackend, StateBackend, FilesystemBackend

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=CompositeBackend(

default=StateBackend(),

routes={

"/memories/": FilesystemBackend(root_dir="/deepagents/myagent", virtual_mode=True),

},

)

)行为表现

/workspace/plan.md→ 路由到 StateBackend(临时存储,用完即焚)。/memories/agent.md→ 路由到 FilesystemBackend,实际存储路径为/deepagents/myagent(持久化存储)。ls、glob、grep等命令会汇总所有后端的结果,并显示原始的路径前缀(让你感觉像是在操作同一个文件系统)。

注意事项

- 更长前缀优先:如果规则有冲突,路径匹配更精确(前缀更长)的规则会胜出。例如,专门针对

/memories/projects/的路由规则,可以覆盖掉通用的/memories/规则。 - StoreBackend 路由的前提:如果你要路由到

StoreBackend,请务必通过create_deep_agent(model=..., store=...)提供一个 store 实例,或者确保平台已经配置好了 store。

7.5 使用虚拟化文件系统

构建一个自定义后端,将远程或数据库文件系统(例如 S3 或 Postgres)映射到 tools 命名空间中。

设计指南:

- 路径映射:路径采用绝对路径形式(如

/x/y.txt)。你需要自行决定如何将其映射到底层的存储键或数据行。 - 高效查询:高效地实现

ls(列出目录)和glob(模式匹配)。如果底层存储支持,尽量在服务端进行过滤,否则再在本地进行过滤。 - 外部持久化存储:对于 S3、Postgres 等外部持久化存储,在调用写入或编辑操作的结果中,请将

files_update设为None(Python)或直接省略filesUpdate(JS)——只有纯内存状态的后端才需要返回文件更新字典。 - 方法命名:请直接使用

ls和glob作为方法名。 - 错误处理:返回结构化的结果类型。如果遇到文件缺失或模式无效的情况,请在结果中包含一个

error字段,不要直接抛出异常。

S3 风格的大纲示例:

from deepagents.backends.protocol import (

BackendProtocol, WriteResult, EditResult, LsResult, ReadResult, GrepResult, GlobResult,

)

class S3Backend(BackendProtocol):

def __init__(self, bucket: str, prefix: str = ""):

self.bucket = bucket

self.prefix = prefix.rstrip("/")

def _key(self, path: str) -> str:

return f"{self.prefix}{path}"

def ls(self, path: str) -> LsResult:

# List objects under _key(path); build FileInfo entries (path, size, modified_at)

...

def read(self, file_path: str, offset: int = 0, limit: int = 2000) -> ReadResult:

# Fetch object; return ReadResult(file_data=...) or ReadResult(error=...)

...

def grep(self, pattern: str, path: str | None = None, glob: str | None = None) -> GrepResult:

# Optionally filter server‑side; else list and scan content

...

def glob(self, pattern: str, path: str = "/") -> GlobResult:

# Apply glob relative to path across keys

...

def write(self, file_path: str, content: str) -> WriteResult:

# Enforce create‑only semantics; return WriteResult(path=file_path, files_update=None)

...

def edit(self, file_path: str, old_string: str, new_string: str, replace_all: bool = False) -> EditResult:

# Read → replace (respect uniqueness vs replace_all) → write → return occurrences

...数据表结构:

files(path text primary key, content text, created_at timestamptz, modified_at timestamptz)

(包含路径、内容、创建时间和修改时间字段)

将工具操作映射到 SQL 上:

ls(列出目录):使用 WHERE path LIKE $1 || '%' 进行查询。

glob(模式匹配):可以在 SQL 语句中直接过滤,或者先获取数据再在 Python 中应用 glob 规则。

grep(文本搜索):可以先通过文件扩展名或最后修改时间拉取候选行,然后再逐行扫描匹配内容。

7.6 权限

通过权限设置,你可以用一种声明式的方式,明确控制代理(Agent)能够读取或写入哪些文件和目录。这些权限规则适用于内置的文件系统工具,并且会在调用后端(backend)之前进行预先评估。

from deepagents import create_deep_agent, FilesystemPermission

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

backend=CompositeBackend(

default=StateBackend(),

routes={

"/memories/": StoreBackend(

namespace=lambda rt: (rt.server_info.user.identity,),

),

"/policies/": StoreBackend(

namespace=lambda rt: (rt.context.org_id,),

),

},

),

permissions=[

FilesystemPermission(

operations=["write"],

paths=["/policies/**"],

mode="deny",

),

],

)如果想了解完整的配置选项(包括规则排序、子代理权限以及复合后端交互等),请查阅权限指南

7.7 添加策略钩子

对于那些基于路径的允许/拒绝规则之外的自定义验证逻辑(比如速率限制、审计日志、内容审查等),可以通过继承(subclassing)或者包装(wrapping)一个后端来执行企业级的规则

from deepagents.backends.filesystem import FilesystemBackend

from deepagents.backends.protocol import WriteResult, EditResult

class GuardedBackend(FilesystemBackend):

def __init__(self, *, deny_prefixes: list[str], **kwargs):

super().__init__(**kwargs)

self.deny_prefixes = [p if p.endswith("/") else p + "/" for p in deny_prefixes]

def write(self, file_path: str, content: str) -> WriteResult:

if any(file_path.startswith(p) for p in self.deny_prefixes):

return WriteResult(error=f"Writes are not allowed under {file_path}")

return super().write(file_path, content)

def edit(self, file_path: str, old_string: str, new_string: str, replace_all: bool = False) -> EditResult:

if any(file_path.startswith(p) for p in self.deny_prefixes):

return EditResult(error=f"Edits are not allowed under {file_path}")

return super().edit(file_path, old_string, new_string, replace_all)通用包装器(适用于任何后端)

from deepagents.backends.protocol import (

BackendProtocol, WriteResult, EditResult, LsResult, ReadResult, GrepResult, GlobResult,

)

class PolicyWrapper(BackendProtocol):

def __init__(self, inner: BackendProtocol, deny_prefixes: list[str] | None = None):

self.inner = inner

self.deny_prefixes = [p if p.endswith("/") else p + "/" for p in (deny_prefixes or [])]

def _deny(self, path: str) -> bool:

return any(path.startswith(p) for p in self.deny_prefixes)

def ls(self, path: str) -> LsResult:

return self.inner.ls(path)

def read(self, file_path: str, offset: int = 0, limit: int = 2000) -> ReadResult:

return self.inner.read(file_path, offset=offset, limit=limit)

def grep(self, pattern: str, path: str | None = None, glob: str | None = None) -> GrepResult:

return self.inner.grep(pattern, path, glob)

def glob(self, pattern: str, path: str = "/") -> GlobResult:

return self.inner.glob(pattern, path)

def write(self, file_path: str, content: str) -> WriteResult:

if self._deny(file_path):

return WriteResult(error=f"Writes are not allowed under {file_path}")

return self.inner.write(file_path, content)

def edit(self, file_path: str, old_string: str, new_string: str, replace_all: bool = False) -> EditResult:

if self._deny(file_path):

return EditResult(error=f"Edits are not allowed under {file_path}")

return self.inner.edit(file_path, old_string, new_string, replace_all)7.8 从后端工厂迁移

在 deepagents>=0.5.2 (Python) 和 deepagents>=1.9.1 (TypeScript) 版本中,命名空间工厂(namespace factories)现在接收的是 LangGraph Runtime 对象,而不再是之前的 BackendContext 包装器。

虽然旧的 BackendContext 形式通过向后兼容的 .runtime 和 .state 访问器依然可以使用,但这些访问器会发出弃用警告,并且将在 deepagents>=0.7 版本中被正式移除。

具体变动如下:

- 工厂函数的参数现在是一个 Runtime 对象,不再是 BackendContext。

- 去掉

.runtime访问器 —— 例如,原本的ctx.runtime.context.user_id现在需要改为rt.server_info.user.identity。 - 没有针对

ctx.state的直接替代方案。命名空间信息在单次运行(run)的生命周期内应当是只读且稳定的,而 state(状态)是可变的,并且会随着每一步(step)发生变化——如果基于它来派生命名空间,可能会导致数据被存入不一致的键(keys)下。如果你有必须读取代理状态(agent state)的用例,请提交一个 Issue(问题反馈)。

# Before (deprecated, removed in v0.7)

StoreBackend(

namespace=lambda ctx: (ctx.runtime.context.user_id,),

)

# After

StoreBackend(

namespace=lambda rt: (rt.server_info.user.identity,),

)7.9 协议引用

后端,必须包含以下这些核心方法和数据类型:

必须实现的核心方法:

- ls(path: str):列出目录内容。返回的条目至少要包含

path(路径)。如果有条件,尽量带上is_dir(是否目录)、size(大小)和modified_at(修改时间)。为了保证输出结果稳定,记得按路径进行排序。 - read(file_path: str, offset: int = 0, limit: int = 2000):读取文件数据。如果文件不存在,不要抛出异常,而是返回一个带有错误信息的

ReadResult(error="Error: File '/x' not found")。 - grep(pattern: str, path: Optional[str] = None, glob: Optional[str] = None):在文件中搜索文本。返回结构化的匹配结果;如果遇到错误,同样返回带有

error字段的GrepResult。 - glob(pattern: str, path: str = "/"):根据模式匹配文件。返回匹配到的文件列表(如果没有匹配到则返回空列表)。

- write(file_path: str, content: str):写入文件(仅限创建新文件)。如果文件已存在(发生冲突),返回带有

error的WriteResult。如果写入成功,需要设置path;对于纯内存状态的后端,需要设置files_update={...},而对于外部存储后端(如 S3、Postgres),则应将files_update设为None。 - edit(file_path: str, old_string: str, new_string: str, replace_all: bool = False):编辑文件内容。除非

replace_all=True,否则必须确保old_string在文件中是唯一的。如果找不到要替换的字符串,返回错误;如果成功,需要在结果中包含替换的次数(occurrences)。

支持的数据类型(结构化返回结果):

- LsResult:包含

error和entries(成功时是FileInfo列表,失败时为 None)。 - ReadResult:包含

error和file_data(成功时是FileData字典,失败时为 None)。 - GrepResult:包含

error和matches(成功时是GrepMatch列表,失败时为 None)。 - GlobResult:包含

error和matches(成功时是FileInfo列表,失败时为 None)。 - WriteResult:包含

error、path和files_update。 - EditResult:包含

error、path、files_update和occurrences(替换次数)。

基础数据字段:

- FileInfo:必须包含

path,可选包含is_dir、size、modified_at。 - GrepMatch:包含

path(文件路径)、line(行号)、text(匹配到的文本内容)。 - FileData:包含

content(内容字符串)、encoding(编码,如 "utf-8" 或 "base64")、created_at和modified_at。

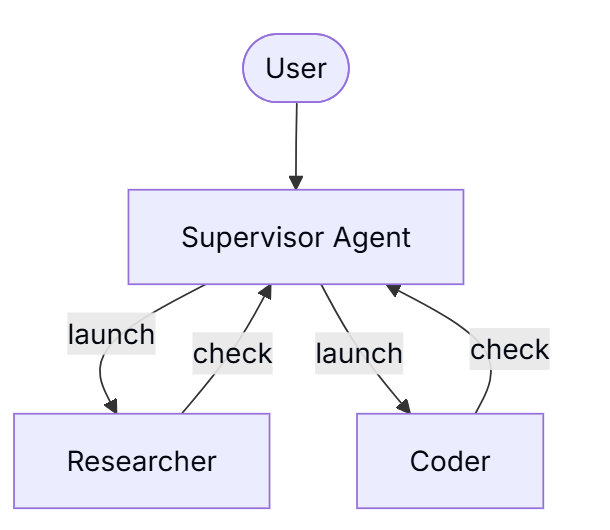

8 子智能体

8.1 使用理由

子代理主要是为了解决“上下文臃肿”的问题。 当主代理使用那些会产生大量输出的工具(比如网页搜索、读取文件、数据库查询)时,上下文窗口很快就会被各种中间结果塞满。而子代理可以把这些繁琐的细节工作隔离出去——主代理最终只会收到一个简洁的结论,而不需要去消化为了得出这个结论所执行的几十次工具调用。

什么时候应该使用子代理:

✅ 处理那些会让主代理上下文变得杂乱无章的多步骤任务。

✅ 处理需要专属指令或特定工具的专业领域任务。

✅ 需要调用不同模型能力(比如某个步骤需要更强的推理模型,另一个需要更快的模型)的任务。

✅ 当你希望主代理能专注于高层级的协调与指挥时。

什么时候不应该使用子代理:

❌ 简单的、单一步骤就能搞定的任务。

❌ 需要保留或依赖中间步骤上下文信息的任务。

❌ 使用子代理带来的额外开销(比如时间、成本)超过了它带来的好处时。

简单来说,子代理就像是主代理手下的“专业外包团队”,把脏活累活打包出去,让主代理保持头脑清醒,只关注最终交付的结果。

8.2 配置

子代理(subagents)应该是一个由字典或 CompiledSubAgent 对象组成的列表。 这里面主要涉及两种类型:

默认子代理(Default subagent)

除非你手动提供了一个同名的同步子代理,否则 Deep Agents 框架会自动为你添加一个同步的“通用子代理(general-purpose subagent)”。

关于这个默认子代理,你有三种处理方式:

- 替换它:直接传入一个你自己写的、名字叫

general-purpose的子代理即可。 - 重命名或修改它的提示词(re-prompt):在当前激活的 harness profile(配置档案)上,设置

general_purpose_subagent=GeneralPurposeSubagentProfile(...)。 - 彻底移除它:在当前激活的 harness profile 上,设置

general_purpose_subagent=GeneralPurposeSubagentProfile(enabled=False)。

如果在经过上述操作后,系统中没有任何同步子代理了,Deep Agents 就不会再自动添加那个“任务工具(task tool)”。需要注意的是,这种机制只影响同步子代理,异步子代理依然会使用在“异步子代理”章节中描述的那些异步任务工具。

基于字典的子智能体

对于大多数使用场景,你只需要创建一个符合规范的字典,并包含以下字段即可

| 字段 (Field) | 类型 (Type) | 说明与继承规则 (Description & Inheritance) |

|---|---|---|

| name | str |

必填。子代理的唯一标识符。主代理调用 task() 工具时会用到它,同时也会作为元数据出现在消息流中。 |

| description | str |

必填。描述子代理的功能。需要具体且以行动为导向,主代理会根据它来决定何时委派任务。 |

| system_prompt | str |

必填。子代理的专属指令(包含工具使用指南和输出格式要求)。不会从主代理继承。 |

| tools | list[Callable] |

选填。子代理可用的工具列表。默认继承自主代理;一旦指定,将完全覆盖继承的工具。 |

| model | str | BaseChatModel |

选填。用于覆盖主代理的模型(可填模型字符串如 'openai:gpt-5.4' 或模型对象)。默认继承自主代理。 |

| middleware | list[Middleware] |

选填。额外的中间件(用于自定义行为、日志或限流等)。不会从主代理继承。 |

| interrupt_on | dict[str, bool] |

选填。配置特定工具的“人机协同”中断功能(需配合 checkpointer)。默认继承自主代理,子智能体的值会覆盖默认值。 |

| skills | list[str] |

选填。技能源码的目录路径列表。指定后子智能体将拥有独立的技能集,状态完全隔离。不会从主代理继承。 |

| response_format | ResponseFormat |

选填。结构化输出模式(如 Pydantic 模型)。设置后父代理收到的将是 JSON 而非自由文本。 |

| permissions | list[FilesystemPermission] |

选填。文件系统权限规则。默认继承自主代理;一旦指定,将完全替换掉父代理的权限。 |

- CLI(命令行)用户:你可以直接在磁盘上创建一个

AGENTS.md文件来定义子智能体,完全不用写代码。在这个文件里,name(名称)、description(描述)和model(模型)这些字段直接映射到文件的 YAML 头部(frontmatter)中,而 Markdown 的正文部分就会自动变成system_prompt(系统提示词)。具体的文件格式可以参考“Custom subagents(自定义子智能体)”章节。 - 部署(Deploy)用户:只需要在

subagents/目录下创建对应的文件夹,里面放上它们专属的deepagents.toml配置文件和AGENTS.md文件即可。打包工具(bundler)会自动发现并加载它们。完整的配置指南可以查看“Deploy subagents(部署子智能体)”章节。

对于更复杂的业务流程,你可以直接使用一个预先构建好的 LangGraph 图(CompiledSubAgent)来作为子代理。它的字段定义如下:

编译的子智能体

| 字段 (Field) | 类型 (Type) | 说明 (Description) |

|---|---|---|

| name | str |

必填。子代理的唯一标识符。该名称会作为元数据附加在 AI 消息和流式传输中,方便区分不同的代理。 |

| description | str |

必填。描述这个子代理的具体功能。 |

| runnable | Runnable |

必填。一个已经编译过的 LangGraph 图(传入前必须先调用 .compile() 方法)。 |

8.3 使用子智能体

import os

from typing import Literal

from tavily import TavilyClient

from deepagents import create_deep_agent

tavily_client = TavilyClient(api_key=os.environ["TAVILY_API_KEY"])

def internet_search(

query: str,

max_results: int = 5,

topic: Literal["general", "news", "finance"] = "general",

include_raw_content: bool = False,

):

"""Run a web search"""

return tavily_client.search(

query,

max_results=max_results,

include_raw_content=include_raw_content,

topic=topic,

)

research_subagent = {

"name": "research-agent",

"description": "Used to research more in depth questions",

"system_prompt": "You are a great researcher",

"tools": [internet_search],

"model": "openai:gpt-5.4", # Optional override, defaults to main agent model

}

subagents = [research_subagent]

agent = create_deep_agent(

model="claude-sonnet-4-6",

subagents=subagents

)8.4 使用编译的子智能体

对于更复杂的使用场景,你可以使用 CompiledSubAgent 来提供自定义的子智能体。你可以通过 LangChain 的 create_agent,或者使用图 API 创建一个自定义的 LangGraph 图来构建自定义子智能体。如果你正在创建一个自定义的 LangGraph 图,请确保该图包含一个名为 "messages" 的状态键:

from deepagents import create_deep_agent, CompiledSubAgent

from langchain.agents import create_agent

# Create a custom agent graph

custom_graph = create_agent(

model=your_model,

tools=specialized_tools,

prompt="You are a specialized agent for data analysis..."

)

# Use it as a custom subagent

custom_subagent = CompiledSubAgent(

name="data-analyzer",

description="Specialized agent for complex data analysis tasks",

runnable=custom_graph

)

subagents = [custom_subagent]

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

tools=[internet_search],

system_prompt=research_instructions,

subagents=subagents

)8.5 流

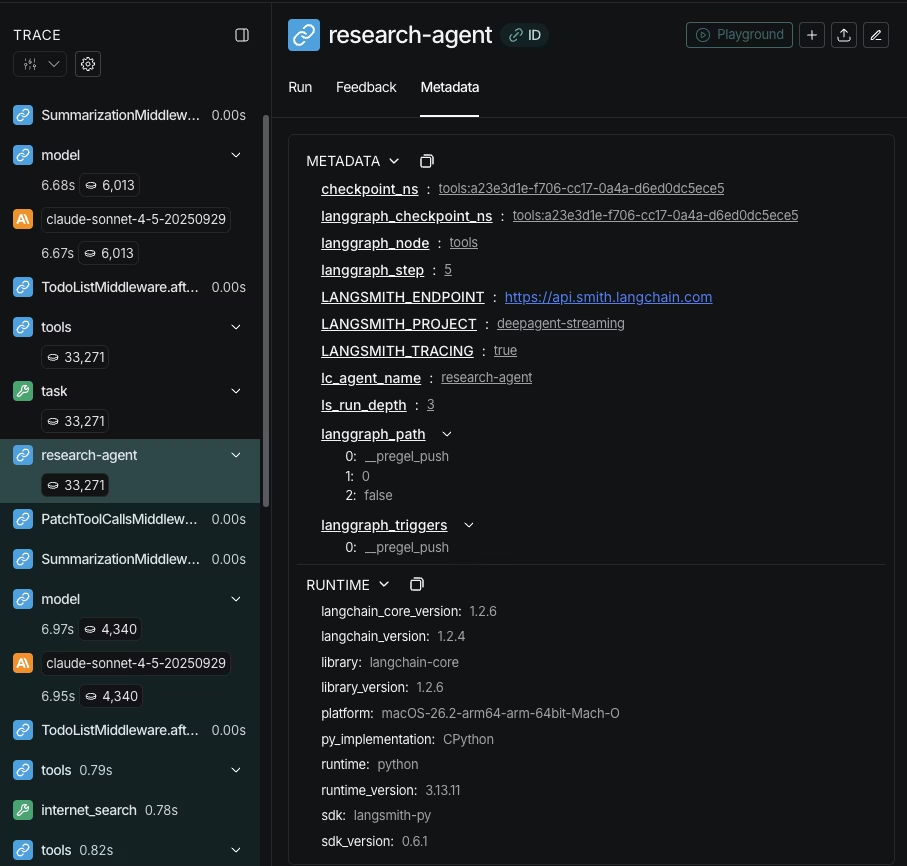

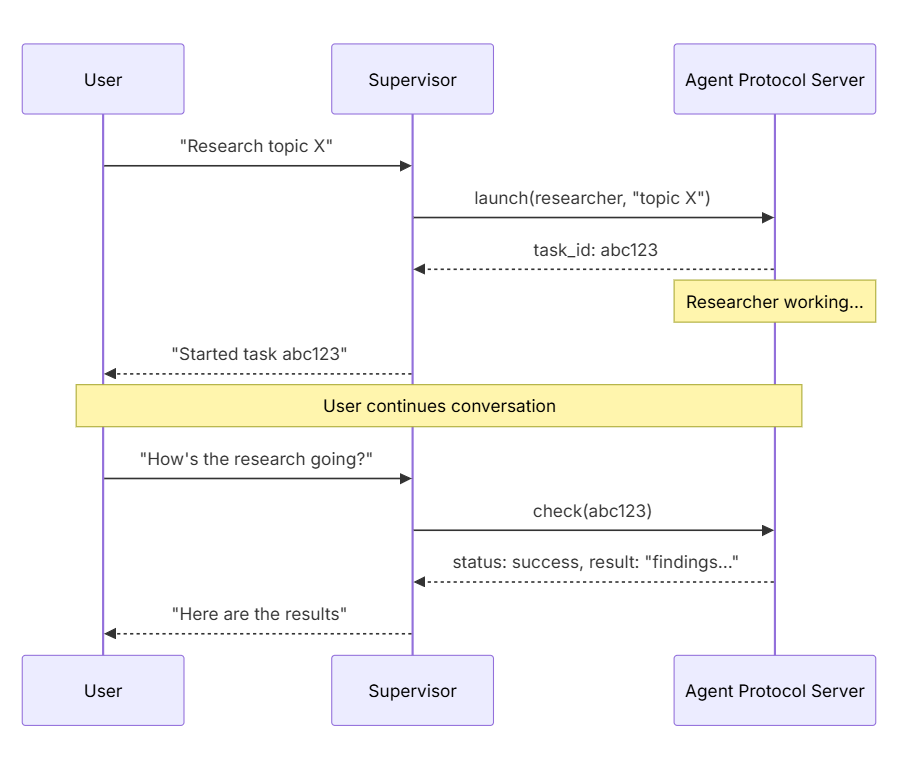

在流式传输追踪信息时,代理的名称会以 lc_agent_name 的形式出现在元数据(metadata)中。当你在查看追踪信息时,就可以利用这个元数据来轻松区分数据到底是来自哪个代理的。

下面这个例子展示了如何创建一个名为 main-agent 的深度代理(deep agent),以及一个名为 research-agent 的子代理:

import os

from typing import Literal

from tavily import TavilyClient

from deepagents import create_deep_agent

tavily_client = TavilyClient(api_key=os.environ["TAVILY_API_KEY"])

def internet_search(

query: str,

max_results: int = 5,

topic: Literal["general", "news", "finance"] = "general",

include_raw_content: bool = False,

):

"""Run a web search"""

return tavily_client.search(

query,

max_results=max_results,

include_raw_content=include_raw_content,

topic=topic,

)

research_subagent = {

"name": "research-agent",

"description": "Used to research more in depth questions",

"system_prompt": "You are a great researcher",

"tools": [internet_search],

"model": "google_genai:gemini-3.1-pro-preview", # Optional override, defaults to main agent model

}

subagents = [research_subagent]

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

subagents=subagents,

name="main-agent"

)

8.6 结构化输出

子代理(Subagents)支持结构化输出,这样一来,父代理接收到的就是可预测、易于解析的 JSON 数据,而不再是随意的自由文本。

你只需要在子代理的配置中传入 response_format 参数。当子代理任务完成时,它的结构化响应会被序列化为 JSON,并作为 ToolMessage 的内容返回给父代理。这里的 schema 接受任何 create_agent 所支持的格式,包括 Pydantic 模型、ToolStrategy(...)、ProviderStrategy(...),或者是原生的 schema 类型。

from pydantic import BaseModel, Field

from deepagents import create_deep_agent

class ResearchFindings(BaseModel):

"""Structured findings from a research task."""

summary: str = Field(description="Summary of findings")

confidence: float = Field(description="Confidence score from 0 to 1")

sources: list[str] = Field(description="List of source URLs")

research_subagent = {

"name": "researcher",

"description": "Researches topics and returns structured findings",

"system_prompt": "Research the given topic thoroughly. Return your findings.",

"tools": [web_search],

"response_format": ResearchFindings,

}

agent = create_deep_agent(

model="claude-sonnet-4-6",

subagents=[research_subagent],

)

result = await agent.ainvoke(

{"messages": [{"role": "user", "content": "Research recent advances in quantum computing"}]}

)

# The parent's ToolMessage contains JSON-serialized structured data:

# '{"summary": "...", "confidence": 0.87, "sources": ["https://..."]}'如果不设置 response_format,父代理就会原封不动地收到子代理最后一条消息的文本内容。而一旦设置了它,父代理就一定能收到符合该 schema 的有效 JSON 数据。这在父代理需要以编程方式处理结果,或者需要把结果传递给下游工具时,会非常有用。

关于 schema 类型和策略(工具调用与原生供应商模式)的更多细节,可以查阅“Structured output(结构化输出)”相关文档。

8.7 通用子智能体

除了你自己定义的子代理之外,每个深度代理(deep agent)其实都随时自带一个“通用子代理”(general-purpose subagent)。它的特点如下:

- 拥有和主代理完全相同的系统提示词(system prompt)

- 可以使用完全相同的工具

- 使用相同的模型(除非你手动覆盖)

- 会继承主代理的技能(前提是配置了技能的话)

如何覆盖通用子代理

如果你想在子代理列表中加入一个名为 name="general-purpose" 的子代理,就可以直接替换掉系统默认的那个。通过这种方式,你可以为这个通用子代理单独配置不同的模型、工具或者系统提示词。

from deepagents import create_deep_agent

# Main agent uses Gemini; general-purpose subagent uses GPT

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

tools=[internet_search],

subagents=[

{

"name": "general-purpose",

"description": "General-purpose agent for research and multi-step tasks",

"system_prompt": "You are a general-purpose assistant.",

"tools": [internet_search],

"model": "openai:gpt-5.4", # Different model for delegated tasks

},

],

)什么时候使用它

通用子代理非常适合用来实现“上下文隔离”,同时又不需要引入特殊的定制行为。主代理可以将复杂的多步骤任务委托给这个子代理,从而只拿回一个简洁的最终结果,避免了中间繁琐的工具调用过程污染上下文。

举个例子

与其让主代理自己进行 10 次网页搜索,导致大量搜索结果塞满它的上下文,不如直接把这些工作委托给通用子代理:task(name="general-purpose", task="调研量子计算的发展趋势")。这样一来,子代理会在内部默默完成所有的搜索工作,最后只向主代理返回一份精炼的总结。

技能继承机制

当你使用 create_deep_agent 来配置技能时,需要区分两种情况:

- 通用子代理(General-purpose subagent):它会自动继承主代理的所有技能。

- 自定义子代理(Custom subagents):默认情况下不会继承主代理的技能。如果你想让它们拥有特定的技能,需要通过

skills参数为它们单独指定。

只有那些配置了 skills 的子代理才会获得一个 SkillsMiddleware(技能中间件)实例——如果没有传入 skills 参数,自定义子代理是不会有的。

一旦启用了该中间件,技能状态会在父子代理之间实现完全的双向隔离:也就是说,父代理的技能对子代理不可见,同时子代理的技能也不会反向传播给父代理

from deepagents import create_deep_agent

# Research subagent with its own skills

research_subagent = {

"name": "researcher",

"description": "Research assistant with specialized skills",

"system_prompt": "You are a researcher.",

"tools": [web_search],

"skills": ["/skills/research/", "/skills/web-search/"], # Subagent-specific skills

}

agent = create_deep_agent(

model="google_genai:gemini-3.1-pro-preview",

skills=["/skills/main/"], # Main agent and GP subagent get these

subagents=[research_subagent], # Gets only /skills/research/ and /skills/web-search/

)8.8 最佳实践

8.8.1 编写清晰的描述

主代理是依靠描述来决定调用哪个子代理的,所以一定要写得具体明确:

✅ 好的例子:“分析财务数据,并生成带有置信度评分的投资见解”

❌ 不好的例子:“处理财务相关的事情”

8.8.2 保持系统详尽的提示词

记得在提示词中包含具体的指导,告诉子代理该如何使用工具以及如何规范输出格式。

research_subagent = {

"name": "research-agent",

"description": "Conducts in-depth research using web search and synthesizes findings",

"system_prompt": """You are a thorough researcher. Your job is to: