DeepSeek-V4来了:国产顶配模型的崛起与Claude Code接入实战

2026年4月24日,深度求索团队正式发布了备受期待的DeepSeek-V4预览版。这不仅是DeepSeek系列时隔15个月的一次重大迭代,更标志着国产大模型在性能、成本和生态兼容性上迈入了全新阶段。本文将结合官方最新发布信息,为您详细介绍DeepSeek-V4的核心亮点,并手把手教您如何将其接入Claude Code,享受流畅、低成本的AI编程服务。

DeepSeek-V4:迈入百万上下文普惠时代

DeepSeek-V4系列包含两个版本:DeepSeek-V4-Pro(旗舰版)和DeepSeek-V4-Flash(轻量版)。官方宣布,从现在开始,1M(一百万)token的超长上下文将是DeepSeek所有官方服务的标配,这意味着处理《三体》三部曲级别的超长文本将不再是高端配置,而是一种基础能力。![[图片]](https://i-blog.csdnimg.cn/direct/66cf9b8c40f64bdaa74a9bc6fdde5a33.png)

核心技术亮点

- 性能比肩顶级闭源模型

![[图片]](https://i-blog.csdnimg.cn/direct/293ac882c92b43a898022e0d4d605a2b.png)

- Agent能力大幅提高:DeepSeek-V4-Pro的Agent能力显著增强。在Agentic Coding评测中,已达到当前开源模型最佳水平。据公司内部员工反馈,其使用体验优于Claude Sonnet 4.5,交付质量接近Opus 4.6的非思考模式。

- 丰富的世界知识:在世界知识测评中,V4-Pro大幅领先其他开源模型,仅稍逊于顶尖闭源模型Gemini-Pro-3.1。

- 世界顶级推理性能:在数学、STEM、竞赛型代码的测评中,V4-Pro超越当前所有已公开评测的开源模型,取得了比肩世界顶级闭源模型的优异成绩。

![[图片]](https://i-blog.csdnimg.cn/direct/86397711b2604ddfb089409ae494a569.png)

-

结构创新与超高上下文效率

V4开创了一种全新的注意力机制,在token维度进行压缩,结合DSA稀疏注意力,实现了全球领先的长上下文能力,并大幅降低了对计算和显存的需求。从现在开始,1M(一百万)上下文将是DeepSeek所有官方服务的标配。![[图片]](https://i-blog.csdnimg.cn/direct/19e269c1a859410a9c57a4686126433f.png)

-

Agent能力专项优化

DeepSeek-V4针对Claude Code、OpenClaw、CodeBuddy等主流Agent产品进行了适配和优化,在代码任务、文档生成任务等方面表现均有提升。![[图片]](https://i-blog.csdnimg.cn/direct/df70d9395b2140459e076dbdbbbed9ce.png)

-

API访问说明

目前,DeepSeek API已同步上线V4-Pro与V4-Flash,支持OpenAI ChatCompletions接口与Anthropic接口,方便开发者无缝集成。![[图片]](https://i-blog.csdnimg.cn/direct/f3dba198248346a3a33bd900877a2819.png)

- 接口调用方式:访问新模型时,base_url保持不变(即原有的DeepSeek API地址),只需将model参数改为deepseek-v4-pro或deepseek-v4-flash即可。

- 双接口兼容:

- 若使用 OpenAI SDK,请保持原有base_url(如 https://api.deepseek.com/v1),更换model 名称。

- 若使用 Anthropic SDK,需将base_url指向 https://api.deepseek.com/anthropic,并同样更换 model 名称。

- 思考模式支持:两个模型版本均同时支持非思考模式与思考模式。对于复杂的 Agent 场景(如使用 Claude Code 进行大型项目分析),建议启用思考模式,并可将reasoning_effort参数设置为max以获得最佳效果。具体参数调整方法请参考官方 API 文档。

- 两个版本,各有所长

- V4-Pro:性能顶配版,适合对Agent能力、世界知识和推理性能有最高要求的复杂场景。

- V4-Flash:经济高效版,在简单任务上与Pro版旗鼓相当,但服务更快捷、价格更经济。世界知识储备稍逊于Pro版,但在高难度推理任务上仍保持接近的能力。

重要变更提醒

- 旧有API接口deepseek-chat与deepseek-reasoner将于2026年7月24日停止使用。当前阶段,这两个模型名分别指向deepseek-v4-flash 的非思考模式与思考模式。

- 新模型调用请使用deepseek-v4-pro或deepseek-v4-flash。

- 两个版本均同时支持非思考模式与思考模式,对于复杂的Agent场景建议使用思考模式,并可将 reasoning_effort参数设置为max。

开源权重和本地部署

- DeepSeek-V4 模型开源链接:

https://huggingface.co/collections/deepseek-ai/deepseek-v4

https://modelscope.cn/collections/deepseek-ai/DeepSeek-V4 - DeepSeek-V4 技术报告:

https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/blob/main/DeepSeek_V4.pdf

接入Claude Code:用国产模型驱动顶级编程工具

在之前文章给ClaudeCode配置“中国芯”中,我们已经介绍了如何将Claude Code接入DeepSeek的Anthropic兼容接口。现在,随着DeepSeek-V4的发布,这套配置迎来了真正的“用武之地”。

DeepSeek官方已明确针对Claude Code进行了适配和优化。这意味着,之前配置好的接入通道,现在可以直接调用V4-Pro或V4-Flash模型,获得更强大的Agent能力和百万上下文支持。

第一步:获取DeepSeek API Key

- 注册并登录DeepSeek开放平台。

- 在控制台中创建API Key。创建后会生成一串以sk-开头的密钥,请妥善保存。

![[图片]](https://i-blog.csdnimg.cn/direct/21a06f1352a049cb8fa6b29374577c35.png)

![[图片]](https://i-blog.csdnimg.cn/direct/5dc1c1558a4d435da54369cb49076c4c.png)

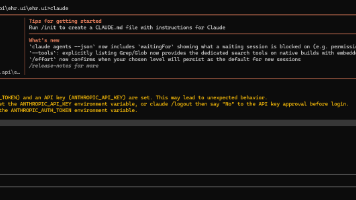

第二步:配置Claude Code环境变量

通过配置文件让Claude Code指向DeepSeek的兼容接口。

- 打开终端,创建或编辑 ~/.claude/settings.json 文件。

- 在文件中添加以下内容(请务必将API Key替换为你自己的):

{

"env": {

"ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic",

"ANTHROPIC_AUTH_TOKEN": "你的DeepSeek-API-Key",

"ANTHROPIC_MODEL": "deepseek-v4-pro",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-pro",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-pro",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-flash",

"CLAUDE_CODE_SUBAGENT_MODEL": "deepseek-v4-flash",

"CLAUDE_CODE_EFFORT_LEVEL": "max",

"API_TIMEOUT_MS": "3000000"

}

}

第三步:验证与使用

完成配置并完全退出重启Claude Code后,启动界面会显示当前使用的模型信息,还可以输入/model命令查看当前可用的模型列表,确认deepseek-v4-pro和deepseek-v4-flash![[图片]](https://i-blog.csdnimg.cn/direct/e7d083bd353c4f1bb33a82f300a132ff.png)

兼容性细节与注意事项

DeepSeek的Anthropic API实现了核心功能兼容,支持文本对话、工具调用等。已知限制:图片、文档等多模态内容暂不支持。对于不支持的模型名,API后端会自动映射到deepseek-v4-flash。

结语

DeepSeek-V4的发布,不仅展示了国产大模型在性能、成本和技术创新上的顶尖实力,更通过全兼容Anthropic API并针对Claude Code等产品进行专项优化,无缝接入了顶级的AI编程生态。现在,无论是开发者个人还是企业团队,都可以通过简单的配置,用极具竞争力的成本,享受到世界级的AI辅助编程体验。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)