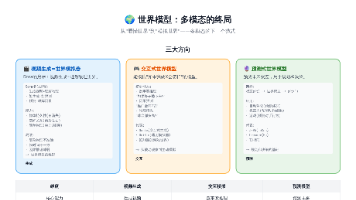

AI Agent 技能评估:从能力边界到可量化指标的实践方法

AI Agent 技能评估:从能力边界到可量化指标的实践方法

前言

随着 Claude Code、Cursor、Copilot、各类浏览器自动化 Agent 以及垂直领域智能体逐渐进入真实工作流,“会不会调用工具”已经不再是衡量 AI Agent 的唯一标准。真正影响生产效率的是:它能否稳定完成任务、能否在失败时自我诊断、能否解释关键决策、能否在安全边界内执行,以及能否让用户放心地把复杂流程交给它。

因此,技能评估不应只是一次演示或主观打分,而应该是一套面向真实任务的工程化评估体系。本文从能力边界、评估维度、指标设计、测试流程和最佳实践几个方面,讨论如何系统评估一个 AI Agent 技能。

一、什么是技能评估

这里的“技能”可以理解为 AI Agent 为完成某类任务而沉淀下来的能力包,例如:

- 自动发布技术博客;

- 调用视频生成平台创建短片;

- 搜索历史记忆并总结上下文;

- 自动化浏览器完成表单填写;

- 在代码仓库中定位问题、修改代码并运行测试。

技能评估,就是用可复现的任务集合去验证这些能力是否可靠。它关注的不只是“最终有没有成功”,还包括执行过程是否透明、失败处理是否合理、成本是否可控、是否遵守安全和权限边界。

一个成熟的技能评估体系,至少要回答三个问题:

- 这个技能能完成什么任务?

- 在什么条件下容易失败?

- 失败后能否给出可操作的恢复路径?

二、为什么需要技能评估

2.1 防止演示效果掩盖真实风险

很多 Agent 在演示环境中表现很好,但一旦进入真实业务场景,就会遇到登录状态、页面结构变化、权限限制、网络波动、工具超时、用户中途改需求等问题。如果没有系统评估,很容易把一次成功演示误认为稳定能力。

2.2 让能力边界更加清晰

技能评估可以帮助团队明确:哪些任务可以放心自动化,哪些任务需要人工确认,哪些任务目前不应该交给 Agent 执行。例如,保存草稿是低风险操作,而公开发布文章、发起付款、删除资源、推送代码到远程仓库等动作则需要更严格的确认机制。

2.3 为持续优化提供依据

如果没有指标,优化只能依赖感觉。通过记录成功率、平均重试次数、失败类型、人工介入点和用户满意度,团队可以发现最值得改进的环节。

三、技能评估的核心维度

3.1 任务完成率

任务完成率是最直观的指标,表示 Agent 是否能在给定条件下完成目标。评估时应区分:

- 完全成功:无需人工介入,结果符合预期;

- 部分成功:完成主要步骤,但存在小问题;

- 失败但可恢复:失败原因明确,用户可以继续处理;

- 不可恢复失败:状态混乱,无法判断下一步。

3.2 稳定性

稳定性关注技能在多次执行、不同输入和环境变化下的表现。例如浏览器自动化技能需要面对动态 ref、弹窗、登录状态变化和页面加载延迟。稳定的技能应该能够先观察当前状态,再决定下一步,而不是盲目点击固定位置。

3.3 可解释性

好的 Agent 不只是执行命令,还要说明为什么这样做。尤其在复杂任务中,它应该能解释:

- 当前处于哪个阶段;

- 为什么选择某个工具或参数;

- 哪些操作会影响外部系统;

- 失败时判断依据是什么。

可解释性越强,用户越容易信任并接管流程。

3.4 安全性

安全性是技能评估中最容易被忽视、但最重要的维度。评估时应检查:

- 是否避免泄露密钥、Token、账号信息;

- 是否在公开发布、删除、推送等高风险操作前确认;

- 是否拒绝越权、破坏性或恶意用途;

- 是否遵守最小权限原则。

3.5 成本与效率

Agent 调用外部 API、生成视频、执行搜索、运行测试都可能产生时间或费用成本。评估时应记录:

- 单次任务平均耗时;

- API 调用次数;

- 失败重试成本;

- 是否存在不必要的重复操作。

一个高质量技能并不一定是“最快”的,而是在可靠性和成本之间取得合理平衡。

3.6 用户体验

用户体验包括交互清晰度、进度反馈、错误提示和最终结果呈现。对于长流程任务,Agent 应该在关键节点汇报状态;对于失败任务,应给出下一步建议,而不是只返回一段原始报错。

四、一套可落地的评估流程

4.1 定义任务集

先把技能要覆盖的典型场景列出来,例如自动发布博客技能可以包含:

| 场景 | 目标 | 风险等级 |

|---|---|---|

| 打开编辑器 | 验证登录和页面可访问 | 低 |

| 写入标题正文 | 验证内容生成和表单填写 | 中 |

| 保存草稿 | 验证低风险持久化 | 中 |

| 发布文章 | 对外公开内容 | 高 |

| 获取链接 | 验证结果回传 | 低 |

4.2 设计测试用例

每个场景都要有正常用例和异常用例。正常用例验证能力,异常用例验证鲁棒性。

常见异常包括:

- 页面元素不存在;

- 网络超时;

- 用户未登录;

- API 凭证缺失;

- 输入内容不满足平台限制;

- 用户中途修改需求;

- 工具调用被中断。

4.3 制定评分矩阵

可以使用 1 到 5 分制进行量化:

| 维度 | 1 分 | 3 分 | 5 分 |

|---|---|---|---|

| 完成率 | 经常失败 | 大多数场景可完成 | 稳定完成并处理边界情况 |

| 稳定性 | 依赖固定路径 | 能处理部分异常 | 能观察状态并动态调整 |

| 可解释性 | 只给结果 | 有阶段说明 | 能解释决策和风险 |

| 安全性 | 缺少确认 | 关键操作部分确认 | 高风险操作严格受控 |

| 成本 | 重复调用多 | 成本基本可控 | 调用精简且有重试策略 |

| 体验 | 报错难理解 | 有基本提示 | 反馈清晰、可接管 |

4.4 记录执行日志

每次评估都应记录输入、环境、工具调用结果、失败点和最终输出。日志不是为了追责,而是为了让问题可复现、可比较、可优化。

五、以 AI Agent 技能为例的实践建议

5.1 先评估边界,再扩大自动化范围

不要一开始就让 Agent 执行完整闭环。可以先评估读取信息、生成草稿、保存草稿等低风险环节,再逐步开放发布、提交、删除等高风险动作。

5.2 把“人工确认点”设计成能力的一部分

人工确认不是自动化失败,而是安全设计。优秀的技能应该知道什么时候可以自主执行,什么时候必须暂停并请求确认。

5.3 避免只看单次成功

一次成功不能说明技能稳定。至少要在不同输入、不同时间和不同异常条件下重复验证,才能判断它是否具备生产可用性。

5.4 让失败信息可行动

失败提示应包含三类信息:发生了什么、可能原因、下一步建议。例如“凭证未绑定,请先打开授权链接完成登录后重试”,就比“请求失败”更有价值。

5.5 持续维护评估集

平台页面会变化,API 会升级,模型能力也会变化。评估集应该随着真实问题不断更新,而不是一次性文档。

六、常见误区

6.1 把模型能力等同于技能能力

模型很强,不代表技能稳定。技能还依赖工具、环境、权限、流程设计和错误恢复能力。

6.2 只评估最终结果,不评估过程

对于 Agent 来说,过程同样重要。一个结果正确但过程越权、泄露信息或无法复现的技能,不能算合格。

6.3 忽略用户中断和需求变更

真实工作中,用户经常会中途改变目标。技能评估应考虑中断后的状态恢复能力,以及是否能继续接上原来的任务。

七、总结

技能评估的本质,是把 AI Agent 从“看起来能做”推进到“可验证、可复现、可交付”。它需要同时关注任务完成率、稳定性、可解释性、安全性、成本和用户体验。

对于团队而言,建立技能评估体系并不是增加流程负担,而是在为自动化能力建立质量底座。只有当技能的边界被清楚定义,风险被明确控制,失败路径被充分验证,AI Agent 才能真正进入高价值、可持续的生产工作流。

参考资料

- Claude Code 与 AI Agent 工具化实践

- 浏览器自动化与端到端测试方法

- LLM 应用评估与可观测性实践

- AI Agent 安全边界与人工确认机制

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)