Nginx 为什么强:不只是 epoll 和零拷贝,而是一整套高并发工程设计

Nginx 为什么强:不只是 epoll 和零拷贝,而是一整套高并发工程设计

很多人聊 Nginx 的高性能,第一反应通常是两个关键词:

epoll

sendfile - 零拷贝

这个判断没错。

Nginx 的确很好地利用了操作系统提供的高性能 IO 能力:

epoll:高效管理大量连接

sendfile:高效发送静态文件

但如果只把 Nginx 的强归结为 epoll 和零拷贝,其实低估了它。

因为 epoll 不是 Nginx 发明的,sendfile 也不是 Nginx 发明的。

Nginx 真正厉害的地方在于:

它把操作系统能力、事件驱动模型、进程模型、内存管理、配置系统和模块体系,

组合成了一个极其稳定、克制、可运维的高并发服务器。

一句话:

Nginx 的创新不是单个底层 API 创新,而是工程架构创新。

一、Nginx 解决的核心问题是什么?

Nginx 最擅长的不是复杂业务计算,而是 IO 编排。

典型场景包括:

静态文件服务

反向代理

负载均衡

API 网关入口

HTTP 缓存

TLS 终止

TCP/UDP 代理

这些场景的共同点是:

连接多

请求多

数据转发多

等待多

慢客户端多

上游服务响应时间不稳定

所以 Nginx 面对的核心问题不是:

如何执行复杂业务逻辑?

而是:

如何用尽可能少的资源,稳定管理大量连接和数据转发?

这和普通业务系统不一样。

普通业务系统通常关心:

查数据库

执行业务规则

处理事务

生成 JSON

调用下游服务

而 Nginx 更关心:

谁有事件?

谁可以读?

谁可以写?

谁超时了?

谁该转发到哪个上游?

谁需要限流?

谁需要复用连接?

所以 Nginx 本质上是一个非常典型的:

高性能 IO 编排系统。

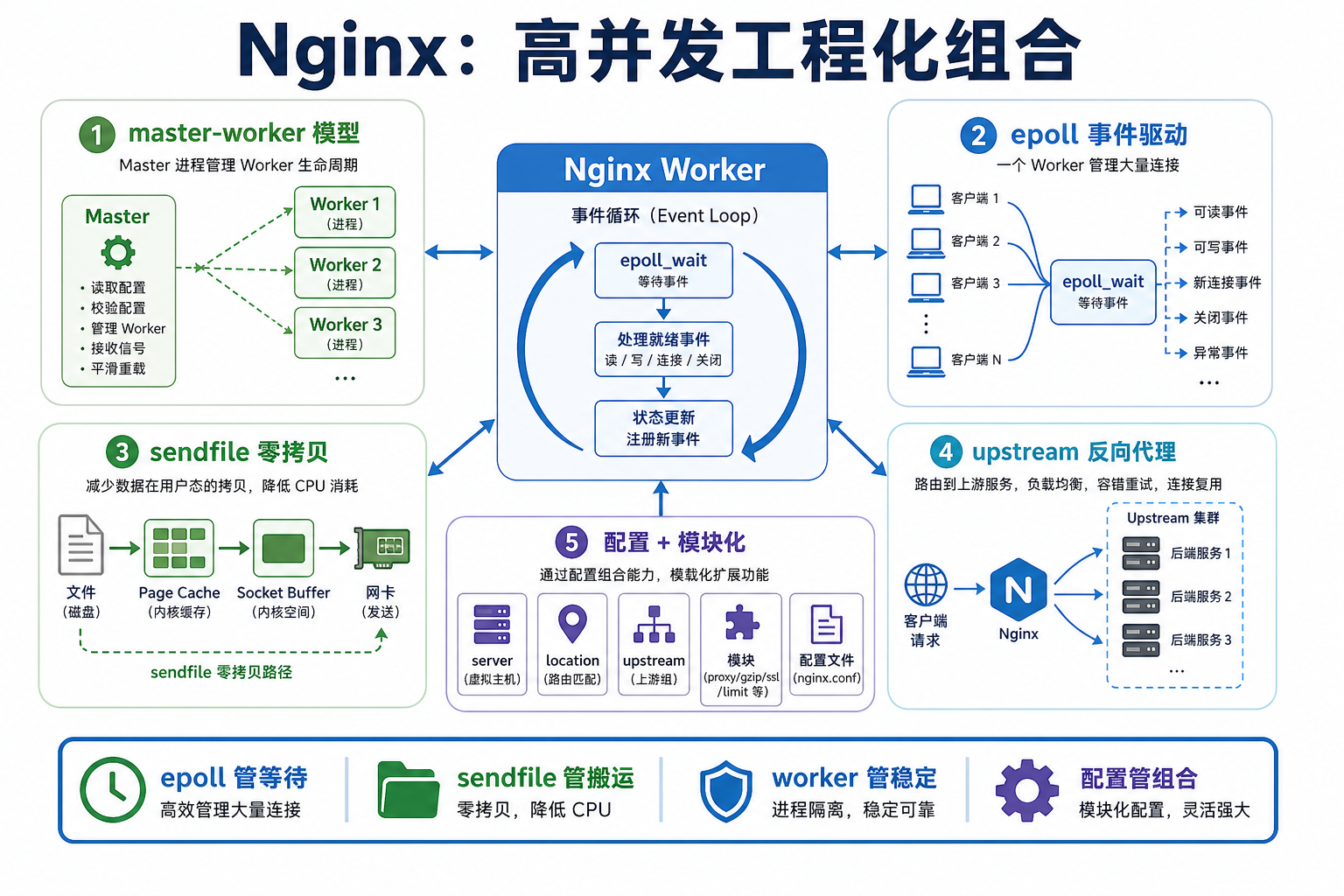

二、master-worker:简单但极其稳定的进程模型

Nginx 的进程模型非常经典:

master process

↓

worker process 1

worker process 2

worker process 3

...

master 进程主要负责:

读取配置

校验配置

管理 worker 生命周期

接收信号

平滑重载

热升级

回收异常 worker

worker 进程主要负责:

接收连接

处理请求

反向代理

发送响应

记录日志

执行模块逻辑

这个设计看起来不复杂,但非常适合高并发服务器。

它的好处是:

进程隔离强

一个 worker 崩溃不容易拖垮整个服务

worker 之间尽量减少共享状态

减少多线程锁竞争

方便按 CPU 核心数扩展

方便平滑重载配置

很多高性能系统不是越复杂越好,而是要在关键路径上尽量克制。

Nginx 的 worker 进程模型就是这种克制设计:

少共享

少锁

少切换

少惊喜

三、事件驱动:Nginx 不让连接数绑定线程数

传统阻塞 IO 模型很容易变成:

一个连接 / 一个请求

↓

一个线程或进程

连接数一多,线程或进程数也跟着膨胀。

这样会带来:

线程栈内存

上下文切换

调度器压力

慢连接占用线程

线程池耗尽

Nginx 不是这个模型。

Nginx 的 worker 通常是事件驱动的:

每个 worker 进程

↓

一个事件循环

↓

epoll / kqueue / event ports 等机制

↓

管理大量连接

也就是说:

大量连接

↓

少量 worker

↓

事件就绪后再处理

这就是 Nginx 高并发能力的基础。

Nginx 不需要为每个连接创建一个线程。

它让操作系统帮忙等待事件:

哪些连接可读?

哪些连接可写?

哪些连接关闭?

哪些连接异常?

worker 只处理已经就绪的事件。

所以 Nginx 的关键不是让单次 IO 神奇变快,而是:

把连接数和线程数解耦。

四、慢连接为什么拖不垮 Nginx?

慢连接是 Web 服务器非常头疼的问题。

比如客户端下载很慢:

服务端已经准备好响应

客户端接收速度很慢

如果是阻塞线程模型,线程可能会卡在 write() 上。

一个慢客户端占一个线程,慢客户端多了,就可能把线程池拖死。

Nginx 的处理方式是事件驱动的:

能写多少写多少

写不完就记录状态

注册可写事件

先去处理别的连接

等下次 socket 可写再继续

读请求也是类似:

能读多少读多少

读不完整就等下一次可读事件

不会阻塞在某一个连接上

这就是 Nginx 适合处理大量慢连接的原因。

它不会让一个慢客户端长期占住一个执行线程。

更准确地说:

Nginx 不是没有等待,

而是把等待交给事件机制,

worker 不在单个连接上傻等。

这和我们理解 epoll 时的那句话是一致的:

阻塞可以发生在统一等待所有连接的地方,

不能发生在处理某一个连接的地方。

五、sendfile:Nginx 对零拷贝的工程化使用

Nginx 发送静态文件时,常见配置是:

sendfile on;

传统文件发送路径大概是:

磁盘

↓

内核 page cache

↓

用户态 buffer

↓

内核 socket buffer

↓

网卡

这中间会有不必要的用户态数据搬运。

如果应用只是想把文件原样发给客户端,其实不需要让文件内容经过用户态。

sendfile 优化的路径更接近:

磁盘

↓

内核 page cache

↓

socket / 网卡发送路径

↓

网卡

所以零拷贝优化的不是磁盘上限,也不是网卡上限,而是:

减少 CPU 参与大块数据搬运。

Nginx 很适合使用 sendfile,因为静态文件服务天然就是:

file -> socket

这也是 Nginx 作为静态资源服务器非常强的原因之一。

但也要注意:

sendfile 不是所有场景都能用。

如果响应需要:

动态生成

内容改写

压缩

应用层加密

复杂过滤

数据就需要进入应用层处理,严格零拷贝就会受到限制。

六、Nginx 不只是用 sendfile,还会利用很多系统能力

Nginx 的工程化强在:它不迷信单个技术点,而是综合利用操作系统能力。

例如:

sendfile

tcp_nopush / TCP_CORK

tcp_nodelay

keepalive

reuseport

accept_mutex

open_file_cache

这些能力分别解决不同问题。

sendfile 解决:

文件发送时减少 CPU 拷贝。

tcp_nopush / TCP_CORK 解决:

尽量把响应头和文件数据组织成更合适的 TCP 包发送,

减少小包和碎片化发送。

tcp_nodelay 解决:

降低小响应的延迟。

keepalive 解决:

复用 TCP 连接,

减少频繁建连和断连成本。

open_file_cache 解决:

缓存打开文件的信息,

减少频繁 stat/open 带来的开销。

这些不是 Nginx 发明的底层能力。

但 Nginx 的价值在于:

它把这些能力变成了可配置、可组合、可在线上长期稳定运行的工程实践。

七、反向代理:Nginx 是典型 IO 编排器

反向代理是 Nginx 最重要的使用场景之一。

请求路径大概是:

客户端

↓

Nginx

↓

上游服务

Nginx 要同时管理两边:

客户端连接

上游连接

它要处理:

客户端请求是否读完

上游连接是否建立

请求体是否转发完成

上游响应是否返回

客户端是否还能继续接收

连接是否超时

是否需要重试其他上游

所以反向代理不是简单的:

读客户端 -> 写上游 -> 等响应 -> 写客户端

如果这么同步阻塞地写,一个慢客户端或慢上游都可能卡住执行线程。

Nginx 的方式是事件化管理:

客户端可读,就读客户端

上游可写,就写上游

上游可读,就读响应

客户端可写,就写回客户端

本质上,Nginx 是在协调多个 IO 端点之间的数据流动。

这也是为什么说:

Nginx 是一个高性能 IO 编排器。

八、upstream:不只是转发,还有负载均衡和容错

Nginx 的反向代理能力不仅是把请求转发出去。

它还有 upstream 机制。

例如:

upstream backend {

server 10.0.0.1:8080;

server 10.0.0.2:8080;

server 10.0.0.3:8080;

}

server {

location /api/ {

proxy_pass http://backend;

}

}

这背后包含一整套能力:

负载均衡

失败重试

超时控制

连接复用

上游状态管理

请求缓冲

响应缓冲

错误处理

这些能力对线上系统非常重要。

因为真实世界里的上游服务并不总是稳定的:

有的响应慢

有的连接失败

有的偶发超时

有的机器正在重启

有的接口返回大响应

Nginx 的价值在于:

把这些复杂的网络不确定性,封装成稳定可配置的代理能力。

九、配置驱动:Nginx 为什么这么好用?

Nginx 很强的一点是配置驱动。

很多能力不用写代码,只需要配置。

例如:

server {

listen 80;

location /static/ {

root /data/www;

}

location /api/ {

proxy_pass http://backend;

}

}

这几行配置背后包含:

端口监听

路由匹配

静态资源服务

反向代理

上游转发

响应返回

Nginx 的配置系统让它可以组合很多能力:

server

location

upstream

rewrite

proxy

gzip

ssl

cache

limit_req

limit_conn

access_log

这使 Nginx 不只是一个高性能服务器,还是一个非常实用的基础设施工具。

它的流行不只是因为性能好,还因为:

部署简单

配置直观

能力组合灵活

线上运维友好

十、模块化:Nginx 的能力可以组合

Nginx 的很多能力都是模块化组织的。

常见模块包括:

HTTP core

static file

proxy

upstream

rewrite

gzip

ssl

access

auth

limit_req

limit_conn

log

stream

mail

模块化让 Nginx 可以扮演很多角色:

静态文件服务器

反向代理服务器

负载均衡器

缓存服务器

API 网关入口

TCP/UDP 代理

TLS 终止节点

限流组件

这也是 Nginx 的工程美感所在:

核心保持克制,

能力通过模块扩展,

行为通过配置组合。

这比把所有能力硬编码进一个大系统里更灵活,也更适合长期演进。

十一、平滑重载:性能之外的可运维性

Nginx 还有一个特别重要的能力:

平滑重载配置。

典型操作是:

nginx -s reload

它的大致过程是:

master 读取新配置

master 校验新配置

启动新的 worker

旧 worker 停止接收新连接

旧 worker 继续处理已有连接

已有连接处理完后旧 worker 退出

这对线上系统非常重要。

因为网关、代理、入口服务不能随便中断。

Nginx 不只是追求:

跑得快。

它还追求:

改配置不惊动用户

升级过程尽量平滑

异常 worker 可恢复

线上行为可预测

这就是可运维性。

很多系统能跑高 QPS,但线上不好维护,也很难成为基础设施。

Nginx 的强,在于它把性能和运维稳定性都考虑进去了。

十二、Nginx 本身有创新吗?

有。

但不是那种:

发明了 epoll

发明了 sendfile

发明了非阻塞 IO

这些底层能力都不是 Nginx 发明的。

Nginx 的创新更像是:

架构创新

工程化创新

产品化创新

它把很多底层能力组合成一个完整系统:

master-worker 进程模型

事件驱动

非阻塞 IO

sendfile 零拷贝

上游负载均衡

模块化体系

配置驱动

平滑重载

可观测日志

线上稳定性设计

可以这样理解:

Linux 提供了很多高性能零件;

Nginx 把这些零件组装成了一台可靠的生产机器。

所以 Nginx 的创新不是某一个点,而是整套设计的取舍。

它没有追求把业务能力做复杂,而是始终围绕一个核心目标:

低成本、稳定地管理大量连接和数据转发。

十三、Nginx 给我们的工程启发

Nginx 的设计对后端系统很有启发。

第一,性能不是只靠一个技术点。

epoll 很重要,但只有 epoll 不够。

sendfile 很重要,但只有 sendfile 不够。

真正的高性能来自一整套设计:

调度模型

数据搬运

内存管理

连接管理

错误处理

配置系统

运维能力

第二,少做事本身就是性能优化。

Nginx 在关键路径上非常克制:

少创建线程

少共享状态

少锁竞争

少拷贝数据

少阻塞等待

第三,基础设施系统要优先考虑稳定性。

高并发入口服务最怕:

一个慢连接拖住线程

一个上游异常拖垮整体

一次 reload 中断服务

一个 worker 崩溃影响全部请求

Nginx 的很多设计都是为了让这些风险可控。

十四、结论:Nginx 强在工程化组合

最后总结一下。

Nginx 的确使用了:

epoll

sendfile

非阻塞 IO

keepalive

TCP 优化

但它的强不只是这些底层技术。

epoll 解决的是:

等待和调度。

sendfile 解决的是:

数据搬运。

master-worker 解决的是:

进程隔离和稳定运行。

模块化解决的是:

能力扩展。

配置系统解决的是:

能力组合和运维效率。

平滑重载解决的是:

线上变更的稳定性。

所以最准确的说法是:

Nginx 的强,不是发明了 epoll 和零拷贝;

而是把这些底层能力组织成了一套稳定、克制、可配置、可运维的高并发工程系统。

这也是为什么 Nginx 到现在依然是很多系统入口层、代理层、静态资源层的重要基础设施。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献34条内容

已为社区贡献34条内容

所有评论(0)