接 Gemini API 前,先别急着把代码写死

很多人第一次关注 Gemini API,都会先看模型能力。

上下文有多长,支持不支持多模态,响应速度怎么样,价格贵不贵,和 GPT、Claude、DeepSeek 比到底强在哪里。

这些当然重要。

但真到业务接入阶段,开发者很快会发现,最麻烦的往往不是模型能力本身,而是模型怎么稳定、低成本、可维护地进入现有系统。

也就是说,Gemini API 真正进入工程期后,问题就变了。

先说结论:接入 Gemini,不只是调通一个接口

如果只是写个 demo,调用 Gemini API 并不复杂。

拿到 key,照着文档发请求,拿到返回结果,再把它显示出来。这个阶段解决的是“能不能跑”。

但实际业务不是 demo。

一旦你要把模型放进产品里,就会遇到一整套工程问题:

- 模型调用失败怎么办

- 响应太慢怎么办

- 成本突然升高怎么办

- 上下文太长怎么截断

- 不同模型之间怎么切换

- 日志和调用记录怎么留

- 未来要加 GPT、Claude、DeepSeek 怎么办

- 国内团队结算、访问和稳定性怎么处理

这些问题加起来,才是真正的接入成本。

所以今天聊 Gemini API,不能只聊“怎么调用”。更应该聊“怎么把它接成一条长期可维护的链路”。

从 demo 到业务,中间隔着一层接入工程

很多 AI 项目最开始都很轻。

一个产品经理想验证功能,一个开发者写个脚本,一个团队先做内部工具。这个阶段只要接口能跑,大家就会觉得事情差不多了。

但只要调用量开始上来,问题会马上变多。

比如你做一个 AI 写作工具。

早期用户每天生成几十篇内容,怎么调都行。但当用户开始上传长文档、频繁改稿、多轮对话、批量生成标题时,模型调用就不再是一个简单请求。

你要开始处理:

- prompt 模板管理

- token 成本估算

- 并发限制

- 超时和重试

- 内容安全和过滤

- 用户维度的额度统计

- 不同任务的模型选择

这时候,Gemini 只是其中一个模型。

你真正需要的是一层可管理的模型接入层。

为什么不要一开始就把代码写死在单个模型上

很多项目早期为了快,会直接把某个模型接口写进业务代码。

这在 demo 阶段没问题,但长期风险很高。

因为模型变化太快。

今天你觉得 Gemini 适合长文档,明天可能 GPT 的某个版本更适合代码,后天 Claude 在复杂推理上表现更稳,再过一段时间 DeepSeek 在中文和成本上更划算。

如果你的业务代码深度绑定某一个模型,后面每次换模型都要改调用方式、参数格式、错误处理和返回解析。

这件事很烦,而且会越拖越贵。

更好的做法,是从一开始就把模型调用抽象成统一层。

业务侧只关心任务:

- 总结一篇文章

- 改写一段文案

- 分析一个图片

- 生成一段代码

- 提取一份报告里的关键信息

至于底层到底调用 Gemini、GPT、Claude 还是 DeepSeek,应该由接入层来管理。

这才是长期更稳的做法。

Gemini API 适合进入哪些业务场景?

Gemini 的能力特点,决定了它更适合优先测试几类场景。

第一类是长资料理解。

比如合同、报告、论文、产品文档、会议纪要、知识库。只要你的任务不是简单问答,而是需要理解较长材料,Gemini 就值得放进候选。

第二类是多模态输入。

如果业务里有图片、截图、表格、文档混合输入,Gemini 的价值会比纯文本场景更明显。

第三类是搜索和信息整理。

很多业务不是让模型“凭空生成”,而是让它基于资料做总结、对比和判断。这个方向和 Google 的生态优势更贴近。

第四类是办公自动化。

邮件、文档、表格、简报、会议纪要,这些场景本身就和 Google 生态有天然关联。

第五类是内容生产辅助。

不是让模型直接替你写完,而是让它参与选题、资料整理、大纲、初稿和改稿流程。

但业务接入不能只看“这个任务 Gemini 做得好不好”

选模型时,很多人会做一组测试 prompt。

同样的问题给几个模型,谁回答好就选谁。

这一步有必要,但远远不够。

真实业务里还要看:

- 响应是否稳定

- 高峰期是否可用

- 价格是否可控

- 输出格式是否稳定

- 失败时能否自动降级

- 是否能快速切换备用模型

- 调用记录和成本能不能追踪

比如一个内容生成任务,Gemini 某次回答很好,但如果链路不稳定、成本不好算、错误处理不好做,最终还是很难进入正式业务。

反过来,一个模型未必每次都最惊艳,但如果稳定、便宜、易接入,反而更适合承担大量基础任务。

这也是 AI 工程化和 AI 体验最大的差别。

体验看上限,工程看长期可用。

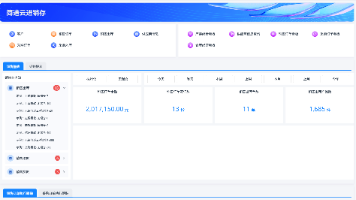

147AI 适合放在 Gemini API 接入的哪一层?

如果你只想直接体验 Gemini,官方入口就够了。

但如果你要做业务接入,尤其是同时测试多个模型,就很适合考虑 147AI 这种统一入口。

它的价值不在于把某个模型包装得更神,而在于帮你把多模型接入这件事收口。

对开发者来说,最现实的好处有几个:

- 不用为每个模型单独维护一套接入逻辑

- 更方便在

Gemini、GPT、Claude、DeepSeek 等模型之间切换 - 更适合做 A/B 测试和备用模型降级

- 成本和调用管理更容易集中处理

- 历史项目迁移压力更小

这类平台的定位,更像 AI 应用的模型接入层。

它不替你决定哪个模型最好,但它让你更容易测试、比较和切换。

这件事在模型快速变化的阶段非常重要。

因为今天最优的模型,不一定是三个月后的最优模型。真正稳的架构,不应该被某一个模型锁死。

一个更稳的 Gemini 接入思路

如果你正在考虑把 Gemini API 接进项目,我建议按这个顺序来。

第一步,不要先改业务主流程,先做独立测试层。

把几个典型任务拿出来,比如摘要、改写、问答、图片理解、代码生成,用固定样本测试 Gemini 和其他模型。

第二步,设计统一的任务接口。

业务侧不要直接写“调用 Gemini”。而是写“执行摘要任务”“执行改写任务”“执行文档分析任务”。底层模型以后可以换。

第三步,保留模型切换能力。

同一个任务至少准备一个主模型和一个备用模型。主模型失败时可以降级,或者按成本、速度、质量动态切换。

第四步,记录调用日志和成本。

不要等账单异常了才回头查。每次调用的模型、耗时、token、费用、用户、任务类型都应该能追踪。

第五步,把 147AI 这类统一入口作为接入层选项。

如果你不想从头维护多模型接入和切换逻辑,可以先用 147AI 承接模型入口,再把精力放回业务本身。

开发者最容易忽略的几个坑

第一个坑,是只测成功样例。

模型回答正确时大家都开心,但业务最怕的是错误、超时、格式混乱和偶发失败。接入前一定要测失败场景。

第二个坑,是没有成本上限。

长上下文、多轮对话、批量任务都会让成本快速上升。如果没有额度控制,很容易在用户增长后失控。

第三个坑,是没有模型替换能力。

大模型变化太快,接口、价格、速度、效果都可能变。架构里如果没有替换位置,后面会很被动。

这些坑和 Gemini 本身强不强关系不大,但会直接决定你的 AI 功能能不能长期运行。

最后

Gemini API 值得接,但不要把它理解成“调通一个接口”这么简单。

真正进入业务以后,模型只是链路中的一部分。更重要的是统一接入、稳定调用、成本控制、模型切换和长期维护。

如果你只是做一次 demo,直接调用就可以。

但如果你要把 Gemini 和 GPT、Claude、DeepSeek 等模型一起放进产品里,建议从一开始就考虑接入层设计。147AI 这类平台的价值,正是在这里:它让开发者不用把大量时间花在重复接模型上,而是更快回到业务验证和产品迭代。

AI 应用走到工程期后,比的已经不是“能不能调用模型”,而是谁能把模型稳定地接进真实业务。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献24条内容

已为社区贡献24条内容

所有评论(0)