手把手教你用 OpenClaw 接入 DeepSeek V4 Pro

最近Deepseek发布最新模型deepseekV4,那么怎么把它接入到”龙虾“?小编这次就来分享一下

一、DeepSeek V4 Pro 是什么?

你可以把它理解为一个超级聪明的人工智能大脑,由 DeepSeek 公司最新推出。

它最厉害的地方有两点:

- • 记性特别好:一次能读完一整本技术书,再也不会看到后面忘了前面

- • 写得特别多:一次能输出超长内容,写完整项目代码都不在话下

二、怎么把它接入 OpenClaw?

OpenClaw 接入 DeepSeek V4 Pro 需要两步:告诉 OpenClaw 去哪找它 + 提供一把"钥匙"(API Key)。

第一步:添加服务商配置

你需要在 OpenClaw 的配置文件里加入下面这段内容(不用懂是什么意思,照着抄就行):

{

"models": {

"providers": {

"deepseek": {

"baseUrl": "https://api.deepseek.com",

"apiKey": "<你的 API Key>",

"api": "openai-completions",

"models": [

{

"id": "deepseek-v4-pro",

"name": "DeepSeek V4 Pro",

"reasoning": true,

"input": ["text"],

"cost": {

"input": 1.74,

"output": 3.48,

"cacheRead": 0.145,

"cacheWrite": 1.74

},

"contextWindow": 1000000,

"maxTokens": 384000

}

]

}

}

}

}📌 小提示:把

<你的 API Key>替换成你自己的密钥(获取方法见下文)。

第二步:获取你的 API Key(密钥)

- 1. 打开网站:platform.deepseek.com

- 2. 注册或登录你的账号

- 3. 进入「API Keys」页面

- 4. 点击创建新的密钥,复制保存好

你也可以通过 OpenClaw 自带的命令来登录配置:

openclaw models auth login --provider deepseek --method api-key

跟着提示输入密钥即可,和上面手动改配置文件是一样的效果。

三、接入之后怎么用?

接入完成后,你就可以在各种场景下使用 DeepSeek V4 Pro 了。

方式一:在命令行里直接用

问个简单问题:

openclaw chat -m deepseek/deepseek-v4-pro -p "解释量子纠缠"

让它帮你写代码:

openclaw chat -m deepseek/deepseek-v4-pro -p "用 Rust 实现一个线程安全的 LRU 缓存"

让它帮你读长文档:

openclaw chat -m deepseek/deepseek-v4-pro -f large_document.md -p "总结核心观点"

📌 这些命令里的

-m是指定用哪个模型,-p是你要问的问题,-f是你要上传的文件。

方式二:在聊天对话中随时切换

如果你正在和 AI 聊天,突然想换成 DeepSeek V4 Pro,只需要输入:

/model deepseek/deepseek-v4-pro

方式三:给特定任务指定专用模型

如果你有一个专门用来写代码的 AI 助手,可以在配置里这样设置,让它默认就使用 DeepSeek V4 Pro:

{

"agents": {

"list": [

{

"id": "my-coding-agent",

"defaults": {

"model": {

"primary": "deepseek/deepseek-v4-pro"

}

}

}

]

}

}四、什么时候用最划算?

🖥️ 写代码、改代码的时候

它在写代码、找 bug、重构代码方面表现很出色。因为它一次能输出很多内容(最多 38 万字),所以能一次性帮你生成整套项目文件,不用你反复催它继续写。

📄 处理超长文档的时候

它的"记忆力"有一百万个 token(大约等于 75 万汉字),可以一次性处理:

- • 整本技术书籍或学术论文

- • 一个大型项目的所有代码文件

- • 很长的聊天记录

💰 怎么用省钱?

相比其他顶级模型,DeepSeek V4 Pro 的价格比较友好,很适合以下场景:

- • 批量处理大量数据

- • 频繁调用 AI 接口

- • 长时间连续对话

- • 大量代码审查工作

🔄 当备用模型使用

你可以把它设置为"备用选项"——当你的主力模型挂了或者额度用完了,自动切换到它,保证服务不中断。

五、使用注意事项

- 1. 国内访问无障碍:服务器在国内可直接访问,不需要翻墙

- 2. 只支持文字:不能识别图片,如果需要处理图片得换其他模型

- 3. 推理过程可见:它思考的中间步骤会显示出来,方便你了解它是怎么得出答案的,但也意味着你需要对输出做一点整理再分享给别人

- 4. 输出太长要等:虽然它一次能写很多,但写得越多耗时越长,建议按需设置输出长度限制

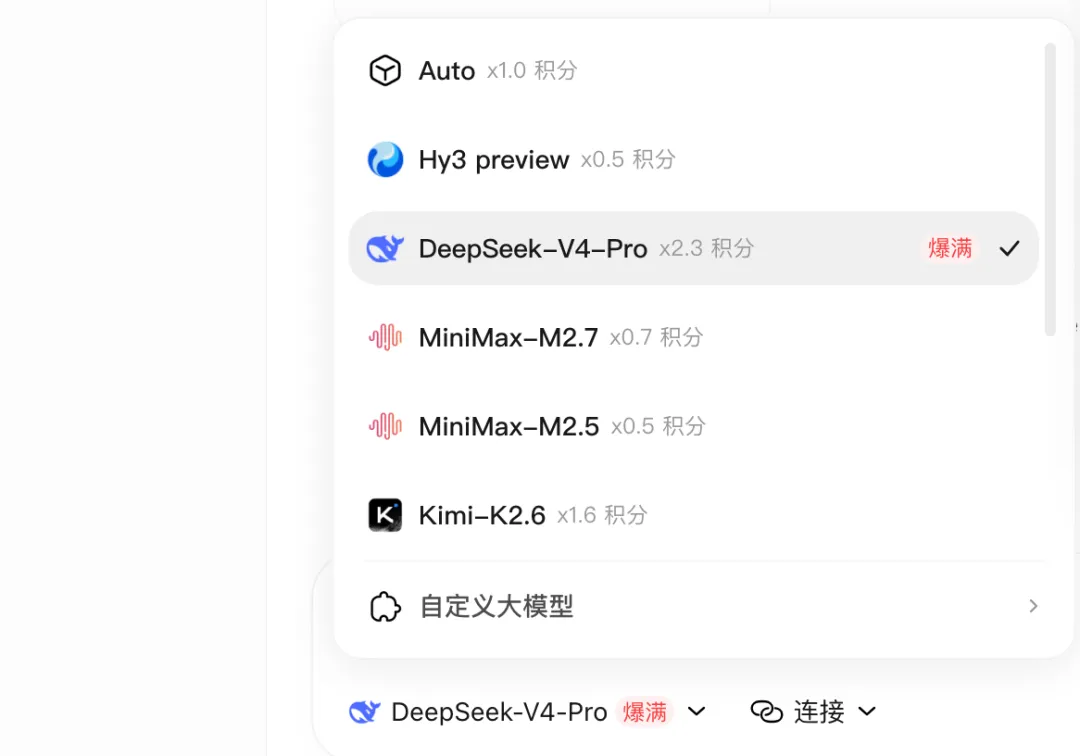

没安装OpenClaw的小伙伴也别慌,腾讯Qclaw等也都接入了deepseekV4Pro(就是太火爆了)

感兴趣的小伙伴赶紧去试试吧!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)