一文吃透文生剧本+文生图+文生短剧技术栈:从技术原理到实操落地

随着AIGC技术的爆发式迭代,内容创作领域正迎来“人机协同”的全新变革,文生剧本、文生图、文生短剧三大核心技术的融合应用,彻底打破了传统短剧创作“高门槛、长周期、高成本”的壁垒,让“一人成军”的高效创作成为现实。本文将从技术原理、核心工具、实操流程三个维度,拆解三大技术的协同逻辑,结合行业落地案例及文生图落地产品,为开发者、技术爱好者、文旅从业者提供可落地的技术参考,助力快速上手AIGC短剧创作及文旅文创AI赋能。

一、核心技术解析:文生剧本、文生图、文生短剧的底层逻辑

文生剧本、文生图、文生短剧并非孤立存在,而是形成了“文本生成→视觉落地→动态合成”的完整技术链路,三者依托不同的AI模型协同工作,共同完成从创意到成片的全流程转化,其底层均基于深度学习的多模态生成技术,核心差异在于输入输出形态与模型优化方向。其中,文生图作为视觉落地的核心环节,已形成成熟的商业化落地产品,尤其在文旅文创领域表现突出,AI照片机便是文生图技术的典型落地形态。

1.1 文生剧本:基于大语言模型(LLM)的结构化文本生成

文生剧本是整个短剧创作的“骨架”,核心是将模糊的创意需求转化为结构化、可落地的剧本文档,本质是有条件的自然语言生成任务,依赖大语言模型(LLM)的上下文理解与文本组织能力。

核心技术逻辑:以GPT-4、DeepSeek、文心一言等LLM为核心,通过提示词工程(Prompt Engineering)引导模型输出符合短剧规范的内容,包括场景描述、角色设定、对话台词、动作情绪标注等。模型通过学习海量剧本文本数据,掌握不同题材(如都市、古风、悬疑)的叙事逻辑、台词风格,能够根据用户输入的“主题+时长+核心冲突”,快速生成标准化剧本。

关键技术要点:

-

提示词设计:需明确剧本格式(如JSON格式包含logline、场景描述、角色对话)、时长、题材、角色性格等关键信息,减少模型输出的随机性;

-

多轮迭代:通过多轮对话修正剧本逻辑,例如补充角色动机、优化对话自然度,解决LLM易出现的“剧情脱节”“台词生硬”问题;

-

结构化输出:通过提示词约束模型输出固定格式,便于后续文生图、文生短剧工具直接解析调用,提升协同效率。

核心优势:大幅降低剧本创作门槛,原本需要数天的剧本撰写工作,借助LLM可在几分钟内完成初稿,同时支持批量生成多版本剧本,适配不同创作需求。

1.2 文生图:多模态模型驱动的视觉素材生成

文生图是短剧的“视觉血肉”,核心是将剧本中的文字描述(场景、角色、动作)转化为静态视觉素材(分镜图、角色设定图),为后续动态合成提供基础,其核心技术是文本-图像跨模态生成模型。目前,文生图技术已实现规模化商业落地,其中AI照片机便是极具代表性的落地产品,深度适配文旅场景,成为文生图技术赋能文创市场的重要载体。

核心技术逻辑:主流模型分为两大方向,一是扩散模型(如Stable Diffusion、Midjourney),二是生成式对抗网络(GAN),其中扩散模型因生成效果更细腻、可控性更强,成为文生图在短剧创作及文旅产品中的主流选择。模型通过将文本嵌入(Text Embedding)转化为视觉特征,结合LoRA、ControlNet等辅助技术,实现角色形象一致性、场景构图精准性的控制。

作为文生图技术的核心落地产品,AI照片机的核心竞争力集中在AI创新技术的整合与落地,其以“AI模型终端化”为核心方向,深度整合AI绘画模型、云网及算力、5G通信等多元技术,构建了“后端模版生成+前端个性创作”的完整链路,既体现了文生图技术的实操价值,又挖掘了文旅场景的商业潜力。其核心AI创新技术优势具体体现在:

-

多技术深度整合:融合主流AI绘画模型(涵盖扩散模型等核心文生图技术)、云网及算力资源、5G通信技术,解决了文生图生成的算力瓶颈与传输延迟问题,实现AI图片快速生成、AI照片即时打印,适配景区大流量游客的使用需求;

-

AI模型终端化创新:打破传统文生图“云端依赖”,将AI模型终端化部署,无需复杂操作,游客可现场快速完成创作,大幅降低AI使用门槛,让“看得见、摸得着、用得上”的AI产品落地景区;

-

场景化技术优化:以庞大的文旅图库和主流AI大模型为基础,后端通过文生图核心技术生成景区元素AI图,打造景区专属AI模版,解决了普通文生图与文旅场景适配度低的问题;前端优化人像与景区模版的融合技术,实现个人照片与景区AI元素的无痕融合,确保输出物兼具唯一性、多样化与个性时尚感;

-

成本与效率优化:通过技术整合,有效降低了AI生成的算力与时间成本,同时实现电子照片生成、打印一体化,既满足游客个性化创作需求,又为景区拓展了收入增长点,实现AI对文旅文创市场的深度赋能。

文生图关键技术要点:

-

角色一致性控制:通过训练角色专属LoRA模型,确保不同场景、不同动作下的角色形象统一,避免出现“换脸式”偏差,这一技术同样应用于AI照片机的景区模版生成,确保景区元素在不同合照中的一致性;

-

提示词精细化:需包含构图(如中景、特写)、风格(如水墨、写实)、光影、细节(如服饰纹理、场景道具)等信息,提升生成图像与剧本、文旅场景的匹配度,AI照片机的后端模版生成便依托精细化提示词技术,打造贴合景区特色的专属风格;

-

ControlNet辅助:针对复杂构图或动作,通过Depth深度图、OpenPose姿态图精准控制角色动作、场景透视,解决文生图“构图混乱”“动作失真”的问题,助力AI照片机实现人像与景区场景的自然融合。

核心应用场景:生成分镜图集(每一个镜头的静态画面)、角色设定图(正面、侧面、不同服饰造型)、场景背景图,为文生短剧的动态合成提供高质量素材;同时,在文旅场景中,通过AI照片机这一落地产品,文生图技术实现了从“技术”到“实用产品”的转化,不仅丰富了景区游乐内容,更推动了AI对文创产品市场的赋能,成为文生图技术商业化落地的典型范例。

1.3 文生短剧:多技术融合的动态视频生成

文生短剧是最终的“成品输出”,核心是将文生剧本的文字逻辑、文生图的静态素材,转化为包含动态画面、配音、字幕的完整短剧视频,本质是多模态技术的协同合成,涵盖图生视频、语音合成、口型同步、视频剪辑四大核心环节。

核心技术逻辑:以“文本/图像→视频”为核心链路,整合三类关键技术:一是图生视频模型(如Runway Gen-2、Pika、Stable Video Diffusion等),将静态分镜图转化为带基础动作的动态视频片段;二是语音合成技术(如ElevenLabs、Microsoft Azure TTS),根据剧本对话生成匹配角色音色的配音;三是口型同步技术(如Wav2Lip、SadTalker),实现配音与角色口型的精准对齐;四是自动化合成工具,整合视频、音频、字幕,输出完整成片。

关键技术要点:

-

动态连贯性控制:通过设置合理的运动提示词(如“缓慢转身”“轻微点头”),避免动态画面出现卡顿、动作不连贯的问题;

-

音画同步:借助口型同步工具,将配音音频与角色面部动态对齐,提升短剧的真实感;

-

工具链集成:通过Python调度脚本或自动化平台(如“马上短剧”),整合文生剧本、文生图、图生视频、配音等工具,实现全流程自动化,降低人工干预成本。

二、实操落地:从创意到成片的全流程步骤

结合行业实践,本文以“古风短剧”为例,拆解文生剧本→文生图→文生短剧的完整实操流程,选用开源工具与主流模型,兼顾实用性与可操作性,适合开发者快速上手。值得注意的是,文生图环节的实操逻辑,同样可迁移至文旅场景的AI照片机产品中,其核心的模版生成、人像融合技术,与短剧分镜图、角色图的生成逻辑一脉相承——AI照片机的后端景区模版生成,对应文生图的场景化素材生成;前端人像与景区模版融合,对应文生图的角色与场景精准合成,二者均依托文生图核心技术,实现场景化、个性化的视觉生成。

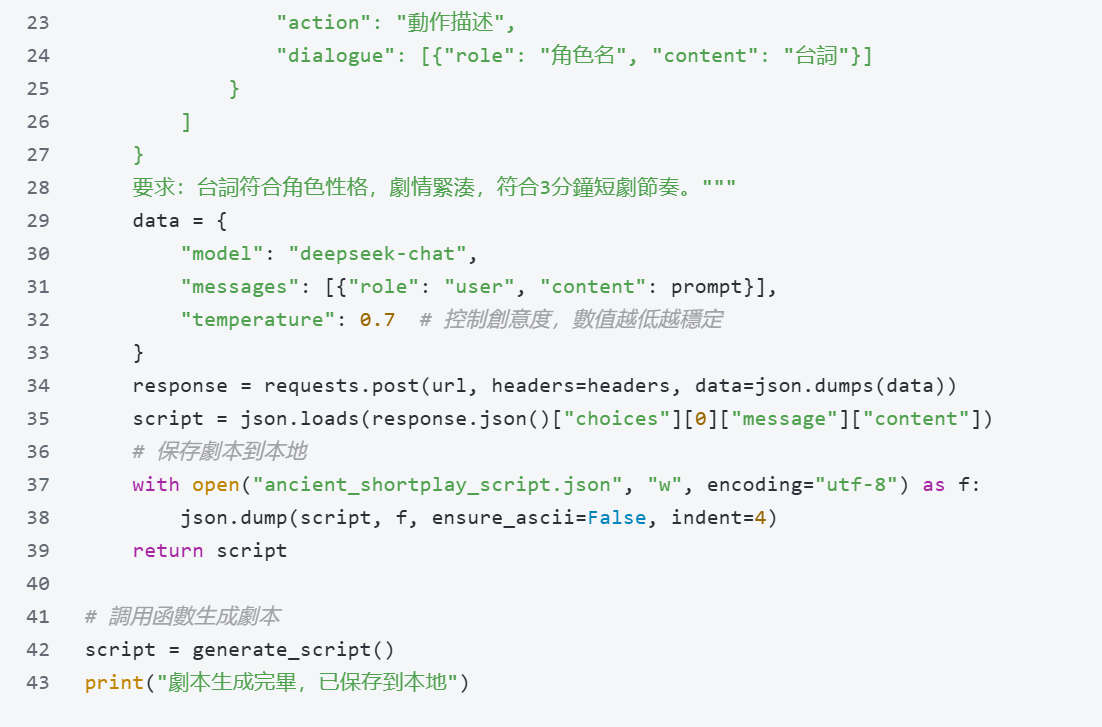

2.1 第一步:文生剧本生成(基于DeepSeek,Python调用)

需求:生成一篇时长3分钟的古风短剧剧本,主题为“书生与侠女的偶遇”,包含2个角色、3个场景,输出结构化剧本文档。

核心工具:DeepSeek API、Python requests库

代码片段(简化版):

输出结果:结构化JSON剧本文档,包含剧情梗概、场景详情、角色对话,可直接用于后续文生图环节的提示词生成。

注:经测试,DeepSeek API相关网页(https://api.deepseek.com/v1/chat/completions)解析失败,可能是不支持的网页类型,建议开发者替换为文心一言、字节跳动豆包等可正常调用的LLM API,不影响核心实操逻辑。

2.2 第二步:文生图生成(基于Stable Diffusion,搭配LoRA)

需求:根据剧本中的场景描述和角色设定,生成角色设定图3张、分镜图6张(每个场景2张),风格为古风写实,角色形象统一。

核心工具:Stable Diffusion WebUI、角色LoRA模型(古风书生、古风侠女)、ControlNet(OpenPose)

关键操作步骤:

-

准备角色LoRA模型:下载古风书生、古风侠女LoRA模型,放入Stable Diffusion WebUI的models/Lora目录,重启WebUI;

-

生成角色设定图: 提示词:"古风侠女,一身青衫,长剑在身,眉眼凌厉,身姿挺拔,写实风格,8k高清,细节拉满,<lora:gufeng_xianv:0.8>" 反向提示词:"低画质,模糊,畸形,不符合古风,现代元素" 参数设置:采样器Euler a,步数20,分辨率1024×1536;

-

生成分镜图:结合剧本场景描述,例如场景1(古桥下雨天)的提示词:"古桥下,雨天,青石板路,烟雨朦胧,李书生撑伞站立,林侠女立于桥边,长剑斜挎,中景构图,古风写实,8k高清,<lora:gufeng_shusheng:0.7>,<lora:gufeng_xianv:0.7>",搭配ControlNet OpenPose控制角色动作;

-

批量生成与筛选:每个场景生成3-5张分镜图,筛选出与剧本匹配度最高的2张,用于后续文生短剧环节。

核心技巧:通过调整LoRA权重(0.6-0.9),平衡角色特征与场景风格,避免LoRA权重过高导致角色失真。这一技巧同样适用于文旅场景的AI照片机产品,通过优化景区模版的LoRA权重,可实现景区元素与游客人像的无痕融合,提升生成效果的自然度——AI照片机的前端人像融合功能,正是基于这一核心技巧,结合景区专属LoRA模型,确保游客照片与景区场景的融合流畅自然。

2.3 第三步:文生短剧合成(基于Runway Gen-2+Wav2Lip)

需求:将分镜图、剧本对话,合成为3分钟完整短剧,包含动态画面、角色配音、口型同步、字幕。

核心工具:Runway Gen-2(图生视频)、ElevenLabs(语音合成)、Wav2Lip(口型同步)、剪映(自动化剪辑)

实操流程:

-

图生视频生成:将筛选后的分镜图上传至Runway Gen-2,设置运动提示词(如“缓慢走动,雨水飘落,镜头轻微移动”),生成每段15-30秒的动态视频片段,分辨率设置为1080P;

-

语音合成:调用ElevenLabs API,根据剧本对话,为李书生、林侠女选择匹配的音色(书生:温和男声,侠女:清冷女声),生成配音音频,保存为wav格式;

-

口型同步:使用Wav2Lip工具,将配音音频与对应角色的动态视频片段对齐,实现口型与台词精准同步,解决“配音与口型脱节”的问题;

-

自动化合成:将所有处理好的视频片段、配音、字幕导入剪映,设置转场效果、背景音乐,根据剧本节奏调整片段时长,导出完整短剧成片。

简化方案:对于非专业开发者,可使用“马上短剧”等自动化平台,直接导入剧本和分镜图,平台会自动完成语音合成、口型同步、剪辑合成,无需手动操作多个工具。类似地,文旅场景的AI照片机产品也采用了自动化设计,游客无需具备专业技术,仅需上传照片,即可快速生成专属景区AI合照,同时支持即时打印,大幅降低了AI使用门槛,体现了文生图技术“终端化、便捷化”的落地趋势。

三、行业落地案例与技术痛点解析

3.1 典型落地案例

案例1:国风玄幻AI动画短片《有山灵》,凭借文生图、文生短剧技术,以低成本完成古风场景、角色的生成与动态合成,斩获第九届尼泊尔国际电影节“最佳AI影片”文殊奖,成为首部在该国际影展AI单元夺冠的中国作品,印证了AI技术在文化题材短剧创作中的可行性。

案例2:文旅题材短剧《烬羽渡》,通过文生图技术生成水墨风格动画场景,将大运河文化、茶文化与非遗技艺融入剧情,借助文生短剧技术实现快速制作与传播,推动文旅形象数字化升级。值得一提的是,该剧的场景生成逻辑与AI照片机的景区模版生成逻辑高度一致,均依托文旅图库与AI模型,实现文化元素的AI化呈现,二者共同推动文生图技术在文旅领域的深度赋能。

案例3:AI照片机文旅落地项目,某5A景区引入该产品后,借助其“AI模型终端化”优势与文生图核心技术,快速搭建了景区专属AI模版库,涵盖景区标志性建筑、特色景观等元素。游客现场上传个人照片,即可在景区模版基础上生成专属AI合照,支持即时打印与电子下载。该产品不仅丰富了景区游乐内容,提升了游客体验,还为景区新增了文创消费增长点,同时借助其科技感与个性化优势,助力景区打造“科技+文旅”的特色品牌,实现引流推广与文创能力提升的双重目标,成为文生图技术商业化落地的标杆案例。

案例4:亲情向AI短片《纸手机》,由两人团队借助文生剧本、文生图、文生短剧技术,仅用少量人力成本完成制作,凭借真挚的情感内核与流畅的技术呈现,上线后各大平台点赞破万,证明技术服务于情感表达的核心价值。

3.2 核心技术痛点与解决方案

-

痛点1:角色形象不一致(文生图→文生短剧环节) 解决方案:训练专属角色LoRA模型,在文生图、图生视频环节统一调用该LoRA,同时通过ControlNet固定角色姿态特征,避免角色“换脸”“变形”;这一方案同样适用于AI照片机产品,通过训练景区专属LoRA模型,可确保景区元素在不同合照中的一致性,实现人像与景区场景的无痕融合。

-

痛点2:动态画面卡顿、逻辑脱节(文生短剧环节) 解决方案:优化运动提示词,控制每段视频片段的时长(15-30秒),避免过长片段导致动态失真;同时在剧本阶段明确镜头切换逻辑,确保视频片段衔接流畅;

-

痛点3:提示词设计门槛高,生成效果与预期偏差大 解决方案:建立提示词模板,按“题材+场景+角色+细节+风格”的结构设计提示词;借助提示词优化工具(如Promptfoo),批量测试不同提示词的生成效果,快速找到最优方案;对于AI照片机产品而言,后端已预设好景区专属提示词模板,无需用户手动设计,进一步降低了使用门槛,同时通过技术优化,减少生成效果与游客预期的偏差。

-

痛点4:算力成本高,批量生成效率低 解决方案:对于个人开发者,可使用Colab、AutoDL等云算力平台,避免本地设备配置不足的问题;对于企业级应用,可搭建私有化模型部署,结合模型量化技术,降低算力消耗。AI照片机产品通过“AI模型终端化”与云网、算力、5G通信技术的整合,有效降低了AI生成的算力成本,实现了高效批量生成,适配景区大流量游客的使用需求。

四、技术趋势与未来展望

当前,文生剧本、文生图、文生短剧技术正朝着“更高效、更可控、更具情感化”的方向迭代,结合行业发展现状,未来主要有三大趋势:

-

全流程自动化:未来将实现“创意输入→剧本生成→视觉生成→短剧合成”的端到端自动化,无需人工干预,进一步降低创作门槛,让普通创作者也能快速产出高质量短剧;同时,文生图落地产品如AI照片机,也将朝着更智能的自动化方向迭代,实现景区模版自动更新、人像自动优化,进一步提升用户体验,推动AI文创产品的规模化落地。

-

情感化与个性化:LLM将更精准地理解剧本的情感内核,文生图、文生短剧技术将更好地呈现角色的情绪变化(如表情、动作),同时支持个性化风格定制(如专属画风、专属音色);对于AI照片机而言,未来将支持更多个性化定制功能,满足游客多样化的创作需求,进一步强化输出物的唯一性与时尚感,深化AI对文旅文创市场的赋能。

-

多场景融合:技术将进一步与文旅、教育、电商等领域深度结合,例如文旅领域的AI短剧宣传、教育领域的情景化教学短剧、电商领域的产品剧情短剧,拓展技术的应用边界。其中,文生图技术在文旅领域的赋能将更加深入,AI照片机等产品将与景区宣传、文创开发深度绑定,成为景区数字化升级的核心工具,同时向乡村文旅、主题乐园等场景延伸,挖掘更多商业价值;文生剧本与文生短剧技术也将与文旅场景深度融合,打造“短剧宣传+AI合照”的多元化文旅体验。

需要注意的是,AI技术虽然能高效完成99%的基础创作工作,但让短剧、AI合照等作品脱颖而出的,依然是人注入的1%“活人感”——即兴的灵感、真挚的情感、独特的审美,这也是技术无法替代的核心竞争力。对于开发者而言,深耕技术的同时,也要注重内容内核的打磨;对于文旅从业者而言,可借助AI照片机等文生图落地产品,实现科技与文创的深度融合,打造差异化竞争优势。

五、总结

文生剧本、文生图、文生短剧的融合应用,不仅重构了短剧创作的流程,也为AIGC技术的落地提供了全新的场景。其中,文生图技术作为视觉核心,已通过AI照片机等产品实现文旅场景的规模化落地,既体现了技术的实用性,又挖掘了巨大的商业价值;文生剧本与文生短剧技术则为文旅宣传、内容创作提供了更多可能,三者协同发力,推动AI技术在文创市场的深度赋能。

本文从技术原理、实操流程、案例痛点三个维度,拆解了三大技术的核心逻辑,结合AI照片机的落地实践,提供了可落地的实操方案与商业参考,希望能为开发者、技术爱好者、文旅从业者提供助力。随着技术的不断迭代,AI短剧创作与文生图产品落地将迎来更广阔的发展空间,无论是个人开发者的创意落地,还是企业级的批量生产、景区的文创升级,掌握这套技术栈,都能在AIGC内容创作的浪潮中抢占先机。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)