Ollama 完全指南:手把手教你搭建免费、私密的本地大模型开发环境

告别昂贵的 API 账单,让 AI 助手在你的电脑上自由奔跑

一、为什么你需要关注 Ollama?

你是否遇到过这些困扰?

-

使用 Claude、GPT-4 等云端模型,每月 API 账单动辄上百美元

-

代码、文档上传云端,担心数据泄露风险

-

网络波动导致 AI 助手卡顿,影响工作效率

-

想尝试最新开源模型,却被复杂的部署流程劝退

Ollama 就是解决这些问题的钥匙。它被誉为“大模型领域的 Docker”——只需一行命令,就能在本地运行 Llama、Qwen、Gemma 等热门模型,彻底告别云端依赖。

二、Ollama 能给你带来什么?

真正免费,不再按 token 付费

本地部署后,没有 API 调用计费,只有电费和硬件成本。对于个人开发者或中小团队,长期使用成本趋近于零。

数据绝对安全

所有推理都在你自己的电脑上完成,代码、文档、对话记录从不离开设备。这对金融、医疗、政府等强合规场景至关重要。

离线可用,永不断线

无需互联网,在飞机、高铁或网络受限的环境中也能稳定使用。

硬件门槛友好

你无需拥有 H100 显卡。一台配备 16GB 内存的普通电脑,就能流畅运行 7B~14B 参数模型,满足日常编码、写作、问答需求。

生态丰富,无缝对接

Ollama 提供 OpenAI 兼容的 API 接口,可以轻松接入 VS Code、JetBrains IDE、Continue、LobeChat 等 75+ 个工具。

三、本地部署 vs. 云厂商 MaaS:如何选择?

| 维度 | Ollama 本地部署 | 云厂商 MaaS(阿里百炼、腾讯混元等) |

|---|---|---|

| 成本 | 前期硬件投入,长期近乎零运营成本 | 按 token 计费,高频调用成本高 |

| 数据隐私 | 数据不出本地,完全可控 | 数据需上传云端 |

| 弹性 | 受限于本地硬件 | 秒级弹性伸缩,支持万亿参数模型 |

| 运维 | 需要自行管理模型、驱动、存储 | 免运维,开箱即用 |

| 功能扩展 | 需自行集成 RAG、微调等 | 内置内容安全、RAG、Agent 框架 |

结论:如果你追求隐私、低成本、离线可用,选 Ollama;如果你需要无限弹性、免运维、工业化级服务,选云 MaaS。两者也可以混合使用——日常任务用本地模型,复杂推理调云 API。

四、如何不买会员就用上 Claude Code?

Claude Code 是 Anthropic 推出的强大 AI 编程智能体,能理解代码库、执行复杂任务。但官方需要订阅($20~$200+/月)。好消息是:你可以用 Ollama + 开源工具,完全免费地在本地实现类似体验。

下面这张表整理了 5 种实用方案:

| 方案 | 工作原理 | 付费 | 数据去向 | 适合人群 |

|---|---|---|---|---|

| Claw Code | 本地模拟 Claude Code UI + 本地模型 | 免费 | 本地 | 追求高保真体验、数据敏感用户 |

| Ollama Launch | 一行命令自动配置 Claude Code 使用本地模型 | 免费 | 本地 | 懒人必选,最快上手 |

| budgetai | 本地代理 + 第三方免费 API(NVIDIA NIM) | 有免费额度 | 云端模型 | 想用高端模型但不花钱 |

| OpenCode | 独立开源 AI 编码代理,支持 75+ 模型提供商 | 免费 | 本地或自选 | 喜欢模块化、多智能体协作 |

| Continue 插件 | 在 VS Code / JetBrains 中集成 Ollama | 免费 | 本地 | IDE 深度用户 |

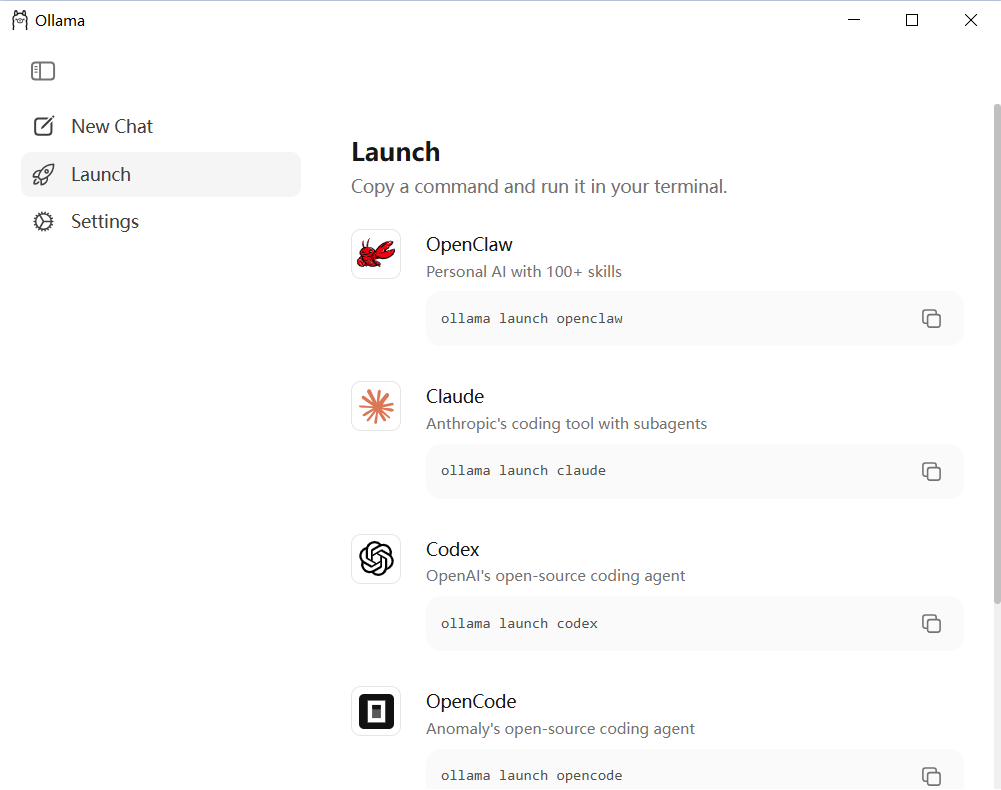

重点推荐:Ollama Launch(懒人一键方案)

2026 年初,Ollama 悄然上线了 launch 命令。你只需要在终端输入:

bash

ollama launch claude

按提示选择本地模型(如 qwen2.5-coder:14b),回车。Ollama 会自动下载模型、配置环境,把一个完整的 Claude Code 智能体跑在你本地。整个过程不超过 3 分钟。

硬件建议:

-

8GB 内存:

phi4-mini:3.8b -

8~16GB 内存:

qwen2.5-coder:7b(推荐,平衡之选) -

16GB+ 内存:

qwen2.5-coder:14b或更高

五、ollama launch 工具矩阵:不止于 Claude

ollama launch 官方支持多个顶尖 AI 编程工具,你可以根据需要自由组合:

| 工具 | 核心能力 | 最佳场景 |

|---|---|---|

| OpenCode | 终端 TUI,支持 75+ 模型,插件化多智能体 | 结构化编码流水线 |

| Droid | 深度集成 VSCode、JetBrains,全流程管理 | 无缝融入现有团队协作 |

| CodeX | 浏览器自动化,多智能体编排 | 网页抓取、自动填表、截图 |

| Pi | 极简可扩展底座,支持 /skill 扩展 |

打造属于自己的专属工具 |

| OpenClaw(小龙虾) | 连接微信、飞书、Discord 等,系统级自动化 | 跨应用办公自动化(收发消息、文件整理、邮件处理) |

OpenClaw 特别介绍:你的个人自动化秘书

OpenClaw 是唯一能将 AI 能力从“聊天”升级为“动手执行”的工具。例如:让 AI 从微信接收指令 → 自动读取邮件 → 整理文件 → 控制浏览器填写表单 → 最后通过飞书发送报告。它是名副其实的“国产小龙虾”,但请谨慎授予系统权限。

六、热门问题答疑

Q1:本地跑大模型会不会很耗电?

以 RTX 5090(575W)为例,每天高负载运行 4 小时,月电费约 11 美元。相比 API 账单,依然经济得多。

Q2:所有开源模型都能免费商用吗?

不一定。例如 Llama 4 对月活>7亿的实体有额外要求;MiniMax M2.7 个人研究免费,商业使用需书面授权。部署前请仔细阅读许可证。

Q3:Ollama 能替代企业级 AI 应用吗?

对于个人开发者、小团队、数据敏感部门(如医疗研究),Ollama 完全胜任。但对于需要高并发、SLA 保障、内容审核的规模化业务,建议结合云 MaaS 使用。

七、总结:一条清晰的本地化提效路径

-

安装 Ollama(支持 Windows/macOS/Linux)

-

拉取模型:

ollama pull qwen2.5-coder:7b -

选择工具:

-

编码 →

ollama launch claude或opencode -

办公自动化 →

ollama launch openclaw -

IDE 集成 → Continue 插件 + Ollama

-

-

进阶玩法:通过

ollama launch同时运行多个工具,构建自己的 AI 智能体矩阵。

Ollama 不是终点,而是起点——它让你用最低的门槛,掌握大模型时代的核心生产力。从今天起,让 AI 真正成为你的本地搭档,而不是按时计费的云端工具。

本文基于 Ollama 官方文档及社区最新实践整理,方案均经过实测。如果你在使用中遇到任何问题,欢迎在评论区交流。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)