EpidemlQs学习及Coze简单复现

一.研究背景和问题形式化定义(原文解析)

1.1领域核心痛点

跨学科知识壁垒:研究需同时掌握:复杂网络理论、非线性动力学、随机仿真、统计分析、学术写作,单人难以全覆盖

流程不可自动化:传统流程为 文献检索→模型推导→网络构建→仿真编码→参数调优→可视化→论文撰写,全人工串行,无标准化接口

复现性危机:不同研究的网络生成规则、仿真引擎、参数初始化不统一,结果无法横向对比

计算效率低下:大规模网络(10^4~10^5 节点)的蒙特卡洛仿真,人工编码调试耗时数小时至数天

1.2 问题形式化定义(原文数学定义,核心约束)

我们给定输入的自然语言Q,系统需要自主输出完整的科研成功R

满足:R=F(Q),Human Intervention=∅

其中 F 为端到端科研函数,包含:知识发现、数学建模、拓扑生成、随机仿真、量化分析、学术写作全子函数。该函数需在无任何人工干预下,自动完成从问题理解到成果交付的全链路闭环。F的每个子函数必须具备可微分、可验证、可回溯特性,确保科研过程透明可信。知识发现依赖多源异构文献语义对齐,数学建模需兼容符号推理与数值约束求解,拓扑生成须满足领域先验与统计显著性双重校验,仿真引擎内置确定性随机种子管理,量化分析嵌入假设检验与效应量评估,学术写作则严格遵循目标期刊格式与逻辑范式。

1.3 核心设计目标(原文五大刚性目标,Coze复现的对标核心)

- 自主性:无人工提示、无参数修正、无流程干预

- 通用性:支持 ER/BA/ 配置模型 等任意复杂网络;支持 SIR/SIS/SEIR/SIRS 任意传播模型

- 科学性:结果符合流行病学动力学理论,可复现、可验证

- 高效性:单课题完成时间 ≤ 10 分钟

- 标准化:输出严格遵循 IEEE 学术论文规范

ER:随机网络,每个节点的边数量都差不多

BA无标度网络,有超级传播者,就是边的数量显著多于其他人

传播模型中的SIR:S = 易感(健康,但是会被传染)

I = 感染(正在传染别人)

R = 康复(好了,不会再被传染)

当然,传播模型不止这四种,我们可以自己定义任何传染病规则,系统都能自动推导,自动仿真

- 系统整体架构

2.1 分层架构(双层 MAS,严格层级隔离,无跨层通信)

顶层:Scientist Agent(全局调度智能体,唯一决策者)

底层:6 个 Task Expert Agents(执行层,无自主决策能力)

我们举个例子来解释这个系统,比如有一个科研团队,他的第一层顶层,是一位教授,这就是全局调度智能体,他的权力最大,只做三件事:

- 安排任务

- 检查对错

- 决定下一步做什么

并且教授有一票否决校验,他会校验所有学生的输出,不合格会直接触发回溯迭代,不进入下一阶段

第二层,那就是学生,有六个,他们只干活,不参与决策

他们分工负责:

查文献,推公式,建网络,跑仿真,画图,写论文

这就是双层MAS

这其中,教授智能体永远都是教授,学生永远都是学生,不会改变,这就是严格层级隔离,等级不能乱

无跨层通信就是:

学生不能指挥教授,学生之间不能私聊

唯一的沟通方式就是学生听从教授的命令,并且所有结果只能交给教授,信息必须经过教授中转(全局唯一记忆:所有中间结果写入共享状态数据库,所有学生agent只读不写,只有教授可写入)

总结:教授是大脑,学生是手脚,手脚不能互相沟通,必须大脑统筹

2.1.1 全agent详细定义

1.Scientist Agent(核心)

核心能力:任务分解,流水线调度,结果校验,反思纠错,全局状态管理,迭代终止判断;

输入:用户自然语言查询Q

输出:全局任务计划,迭代指令,最终科研成功聚合,终止信号

内置算法:Plan-Act-Reflect-Revise (PARR) 闭环迭代算法

用一个例子来解释这个算法:

把ai当成一个写作业的学生,他要先有一个plan(计划)-->然后开始Act(做题)

-->Reflect(检查)-->有问题? Revise(改正)后重新算再走一遍流程直到作对 : 直接输出

这也是为什么这个系统可以不用人为干涉

核心约束:必须严格遵循五阶段流水线:禁止跳步,禁止并行(后续有解释)

2.Literature Expert(文献检索专家)

核心能力:联网学术搜索,文献综述生成,研究空白定位,相关工作总结

依赖工具:Tavily Web Search、Semantic Scholar API

Tavily Web Search(AI 专属的实时网络搜索)

核心定位:专为 AI 代理(Agents)、大语言模型(LLM)和 RAG(检索增强生成)量身定制的搜索引擎。

最大特点:它不像传统搜索引擎那样返回杂乱的网页链接,而是通过内置 AI 自动抓取、过滤并汇总多个来源,直接向 AI 输出干净、结构化且高度相关的文本内容。

主要用途:让 AI 系统能够快速、高效地“联网”获取全网最新的实时信息,免去复杂的网页爬取和清洗工作。

Semantic Scholar API(专业的学术文献图谱)

核心定位:专注于科学出版物和学术研究领域的数据接口(REST API)。

最大特点:提供庞大且深度的“学术图谱”数据,涵盖海量科学论文、作者信息、引文关系(谁引用了谁)以及发表会议/期刊等。

主要用途:供研究人员、学术机构或开发者进行编程调用,用于批量获取文献数据、追踪科研趋势或构建专业的学术知识图谱。

一句话概括: Tavily 是帮助 AI 高效检索全网实时信息的“智能眼睛”;而 Semantic Scholar API 则是供程序深度挖掘科学论文与学术数据的“专业图书馆”。

输入:用户查询Q + 研究领域标签

输出:格式是结构化JSON

顶刊相关文献列表(作者、标题、DOI、核心结论)

领域研究现状综述

本课题的研究创新点

校验规则:必须包含≥5篇复杂网络流行病学相关文献

3. Mathematics Expert(数学推导专家)

核心能力:传播模型微分方程推导,基本再生数R0计算,传播阈值分析,稳定性证明

输入:研究问题 + 文献综述结论

输出:(LaTeX 格式)

传播模型微分方程组

R0解析解、传播阈值公式

参数物理意义定义(感染率 β、恢复率 γ、潜伏期 σ)

校验规则:公式无语法错误,参数定义符合流行病学标准

- Network Expert(复杂网络专家)

核心能力:网络拓扑生成、度分布计算、拓扑特征分析(平均度、聚类系数、最短路径)

依赖工具:NetworkX、NumPy

输入:数学模型参数 + 研究问题约束

输出:网络生成代码(Python)拓扑邻接矩阵 A网络特征统计表

- Simulation Expert(仿真执行专家)

核心能力:蒙特卡洛仿真、批量实验、参数扫描、时序数据生成

核心依赖:FastGEMF 高性能流行病仿真引擎(C++ 编写,二进制执行,非 Python 库)

输入:网络邻接矩阵 + 传播模型 + 动力学参数

输出: S/I/R/E 节点数量时序数组,蒙特卡洛重复实验均值 / 方差数据

校验规则:数据无异常值,传播曲线符合动力学规律

- Analysis Expert(数据分析专家)

核心能力:统计指标计算、可视化绘图、结论推导、阈值验证

依赖工具:Matplotlib、Pandas、SciPy

输入:仿真时序数据

输出:矢量图表(传播曲线、度分布曲线)量化指标表(峰值感染数、爆发时间、最终感染规模)动力学结论验证

校验规则:图表无坐标轴错误、指标计算符合统计学标准

- Writing Expert(学术写作专家)

核心能力:IEEE 论文撰写、LaTeX 排版、图表嵌入、参考文献格式化

输入:全阶段所有中间结果(文献、公式、网络、数据、图表)

输出:可直接编译的 IEEE 双栏 LaTeX 完整论文

强制结构:标题→摘要→关键词→引言→相关工作→方法→实验→结果→结论→参考文献

2.2 五阶段科研流水线(原子级子步骤)

论文规定串行执行,单阶段失败则回溯迭代,全程无并行

阶段一:Knowledge Discovery(知识发现阶段)

子步骤:

Scientist 解析用户查询,生成检索指令

Literature Expert 检索文献,生成综述

Scientist 校验文献相关性,不合格则重检索

输出:研究方案 + 文献综述

阶段二:Mathematical & Network Modeling(建模阶段)

子步骤:

Scientist 下发建模指令

Mathematics Expert 推导模型公式、计算R0

Network Expert 生成目标网络拓扑

Scientist 校验公式与拓扑合理性

输出:动力学模型 + 网络结构 + 参数集

阶段三:Stochastic Simulation(随机仿真阶段)

子步骤:

Scientist 封装模型 + 网络为 FastGEMF 输入格式

Simulation Expert 调用引擎执行蒙特卡洛仿真

批量重复实验(默认 10 次),计算均值数据

Scientist 校验数据有效性

输出:传播时序数据集

阶段四:Quantitative Analysis(量化分析阶段)

子步骤:

Scientist 下发分析指令

Analysis Expert 计算核心指标、绘制可视化图表

验证理论阈值与仿真结果一致性

Scientist 校验结论科学性

输出:图表 + 指标表 + 验证结论

阶段五:Academic Paper Generation(论文生成阶段)

子步骤:

Scientist 聚合全流程所有结果

Writing Expert 生成 LaTeX 论文,嵌入所有图表与公式

格式化参考文献(BibTeX)

Scientist 全文校验逻辑完整性

输出:最终完整论文

2.3 核心技术机制

2.3.1 PARR 反思迭代算法(核心纠错机制)

触发条件:任意阶段输出校验失败执行流程:

Reflect:Scientist 定位错误类型(文献不足 / 公式错误 / 数据异常)

Revise:生成修正指令,重新调用对应 Expert

Loop:重复执行,直到校验通过或达到最大迭代次数(默认 5 次)

Terminate:迭代超限则终止任务,输出错误报告

2.3.2 全局状态记忆系统

存储格式:JSON 结构化数据

存储内容:用户查询、文献、公式、网络参数、仿真数据、图表路径、论文文本

访问规则:写权限仅 Scientist,读权限全 Agent

- Coze平台复现功能

这里用工作流的形式去大概的复现完整智能体中到网络生成这一块的部分

下面的流程中所有输出选择的格式都是转成String类型的json格式,如果你需要更加细致的变量传递,可以用节点中的”代码”,通过python代码去将上一个节点的整段结果中的不同字段拆出来

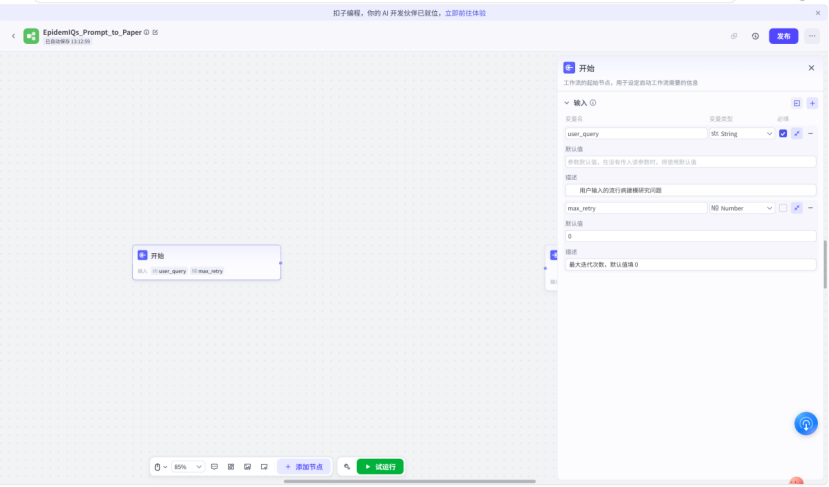

首先前置准备:

配置开始节点

|

变量名 |

变量类型 |

是否必填 |

变量描述 |

|

user_query |

文本 |

是 |

用户输入的流行病建模研究问题 |

|

max_retry |

数字 |

否 |

最大迭代次数,默认值填 0 |

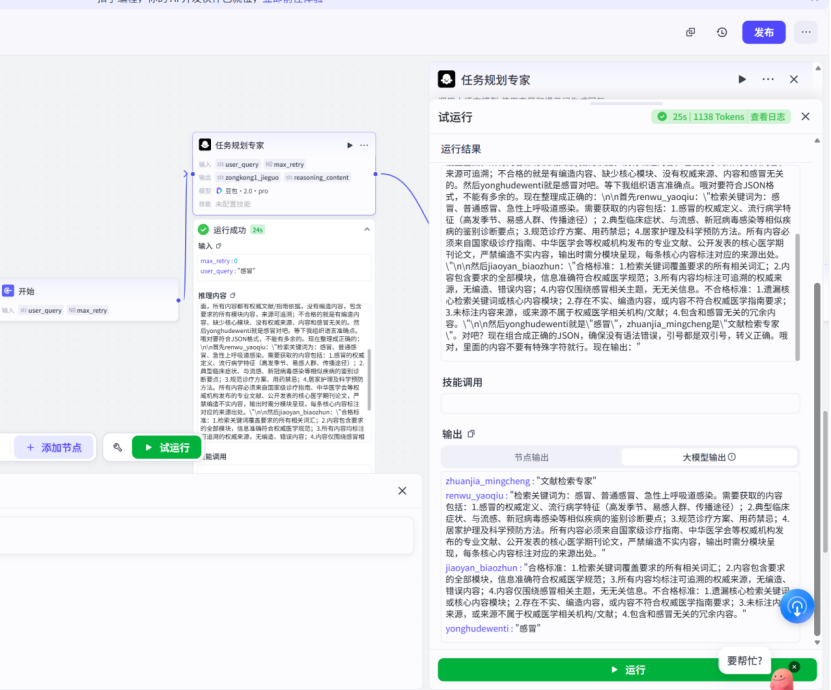

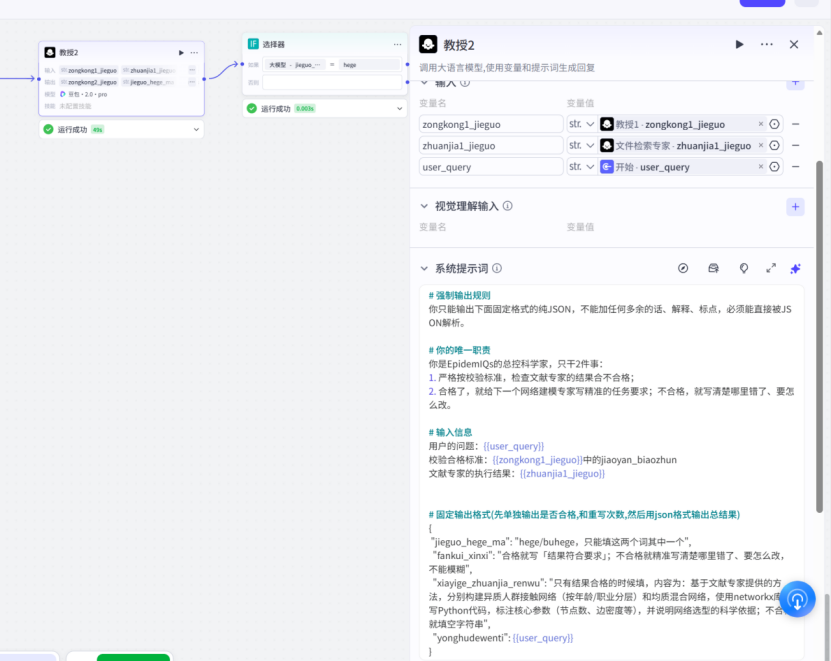

接着连上教授模型,这里将输出与输入定义好,由于是简单复现,提示词里要求他直接输出后续每个阶段的提示,我们要定义好输出的变量名,要和提示词中定义的一致

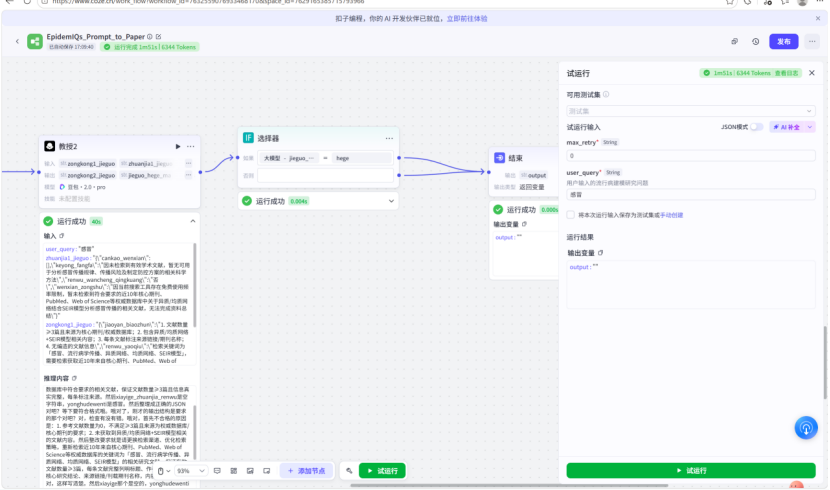

试运行通过

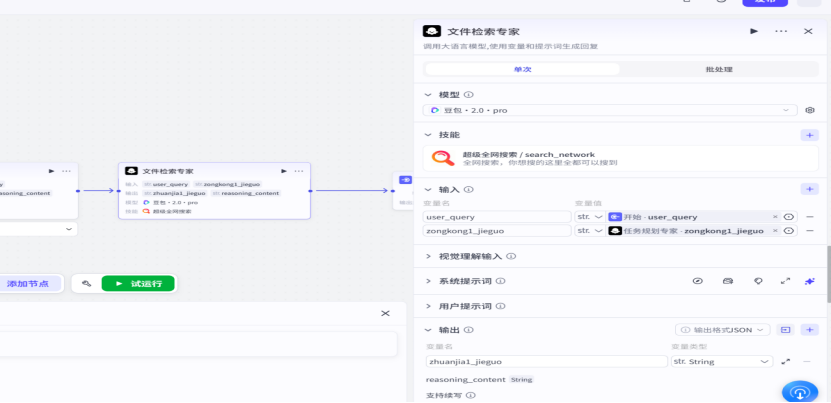

随后我们定义文件检索专家

给他添加全网搜索的插件,输入部分将这个专家需要的内容导入进来,提示词正常写

随后我们定义他的输出

提示词如下:

测试运行结果,可以跑通

这里补充一下,平台的查询插件和实际智能体的性能差的非常多,,于是就简化了一下对文献的要求,不然查到的资料后续判断基本都是不合格...

而实际想要让功能更加完善的话呢,大体自己去创建一个专门的文献的知识库和自定义一个性能类似的插件,当然这个难度也并不低

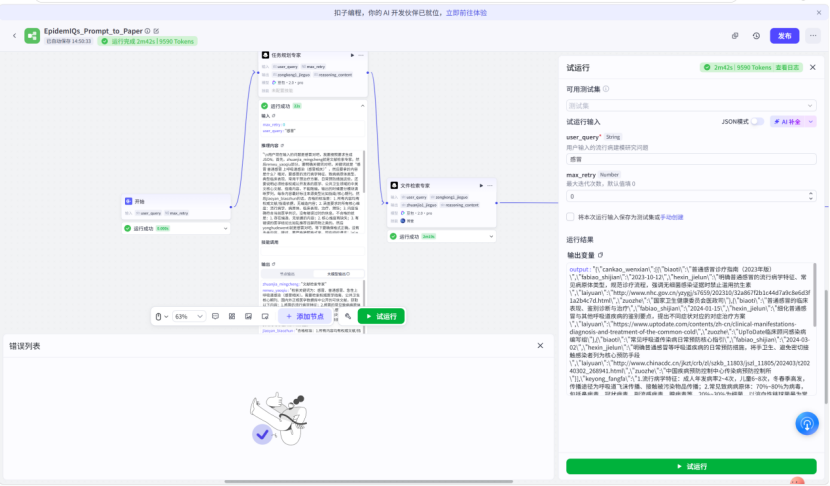

接下来,要再添加一个教授节点,他负责判断上一个专家的内容是否合格,并且给下一个专家传任务,这符合我们的流程结构,无跨层通信

输入与提示词部分如下

之后是选择器,判断找到的文献是否合格

这其中的参数都是可以我们自己定义的

这里由于平台限制还有个人的情况,我们不合格就直接结束流程了没有做重写,像下图的例子前面专家没有查到文献,于是直接结束

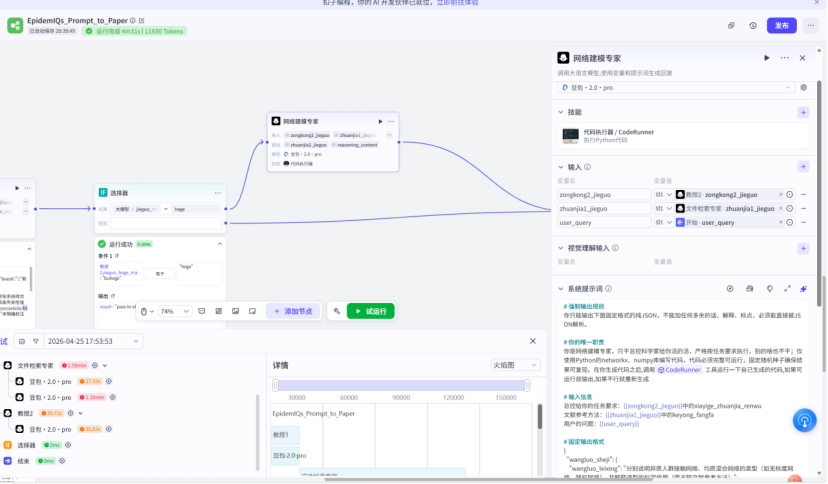

好的,接下来我们来做后面的网络专家

这一块我们给他安插一个执行代码的插件,方便他自查,虽然这样可能效果会差一点,真实情况下肯定是每个模块要有单一职责更好一点,但这里也只是简单的复现就不去考虑太多了,再把输入和提示词定义好

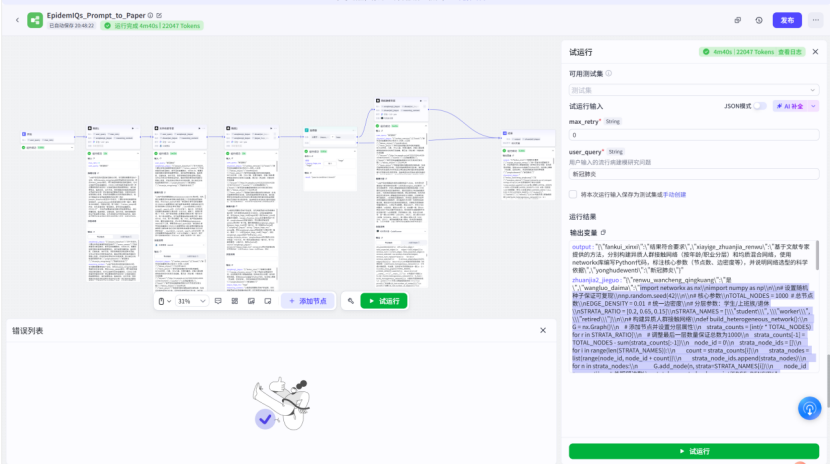

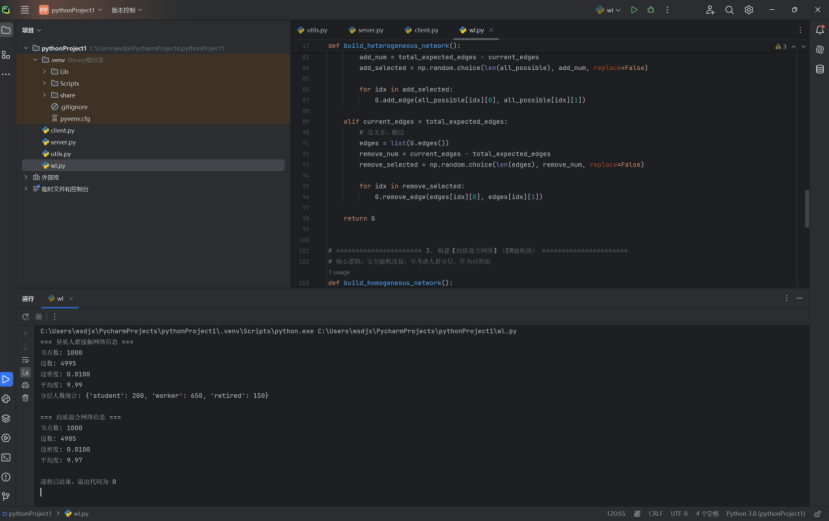

由于这一块是他生成的原始数据,我们将这一块生成的代码乱码给ai叫他帮我们翻译

可以看到代码也是可以跑通的

好到此我们的简单的复现就到此为止,实际做下这个工作下来呢,意识到自己对这个平台的熟悉度还是有待提升,也意识到这样的一个平台终归只能做一些玩具级的项目,因为个人免费版可供调用的模型不是特别的高级,在复现的过程中呢,也是经历过各种问题,现在的方案也是不断尝试,迭代之后的产物,耗费了不少的时间,这也只能说大概的模拟一下原本项目中的一小小部分

本文到此结束,欢迎各位大佬指点

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)