DeepSeek-V4 预览版重磅发布:百万上下文普惠时代,正式开启!

今天,我们怀着激动的心情,正式向大家介绍 DeepSeek 全新系列模型——DeepSeek-V4 的预览版本!它已正式上线并同步开源。

这不仅是又一次模型迭代,更是一次向“普惠”目标的坚实迈进。从现在开始,1M(一百万)超长上下文,将成为 DeepSeek 所有官方服务的标配。

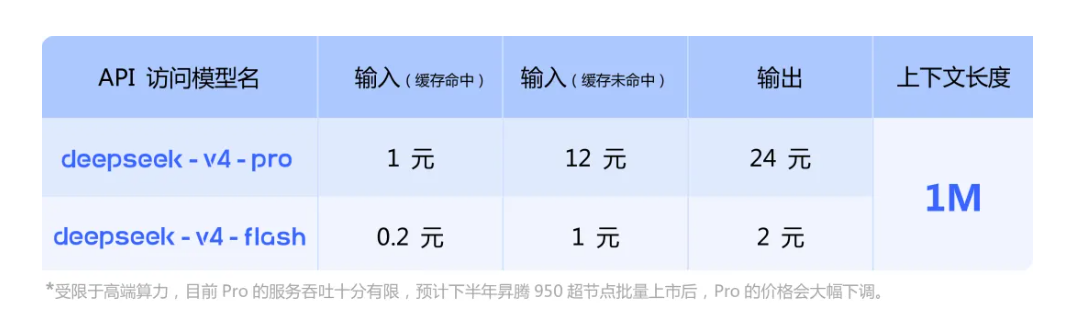

即日起,登录官网 chat.deepseek.com 或官方 App,即可与最新的 DeepSeek-V4 对话,亲身探索 1M 超长上下文带来的全新记忆体验。API 服务也已

两大版本,如何选择?

两大版本,如何选择?

Pro 旗舰与 Flash 经济之选

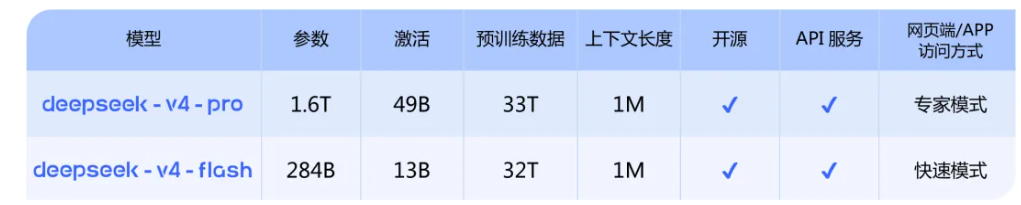

为满足不同场景与成本需求,DeepSeek-V4 按模型规模和激活参数分为两个版本:DeepSeek-V4-Pro 与 DeepSeek-V4-Flash。

DeepSeek-V4-Pro:性能比肩顶级闭源模型。作为性能旗舰,DeepSeek-V4-Pro 在多项评测中展现出顶尖实力:

-

Agent 能力大幅提高:在 Agentic Coding 评测中,V4-Pro 已达到当前开源模型最佳水平。据公司内部员工反馈,其作为 Agentic Coding 模型,使用体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式(与 Opus 4.6 思考模式仍有一定差距,但我们正在持续追赶)。

-

丰富的世界知识:在世界知识测评中,V4-Pro 大幅领先其他开源模型,成绩仅稍逊于顶尖闭源模型 Gemini-Pro-3.1。

-

世界顶级推理性能:在数学、STEM、竞赛型代码的测评中,DeepSeek-V4-Pro 超越所有已公开评测的开源模型,取得了比肩世界顶级闭源模型的优异成绩。

多维度评测:

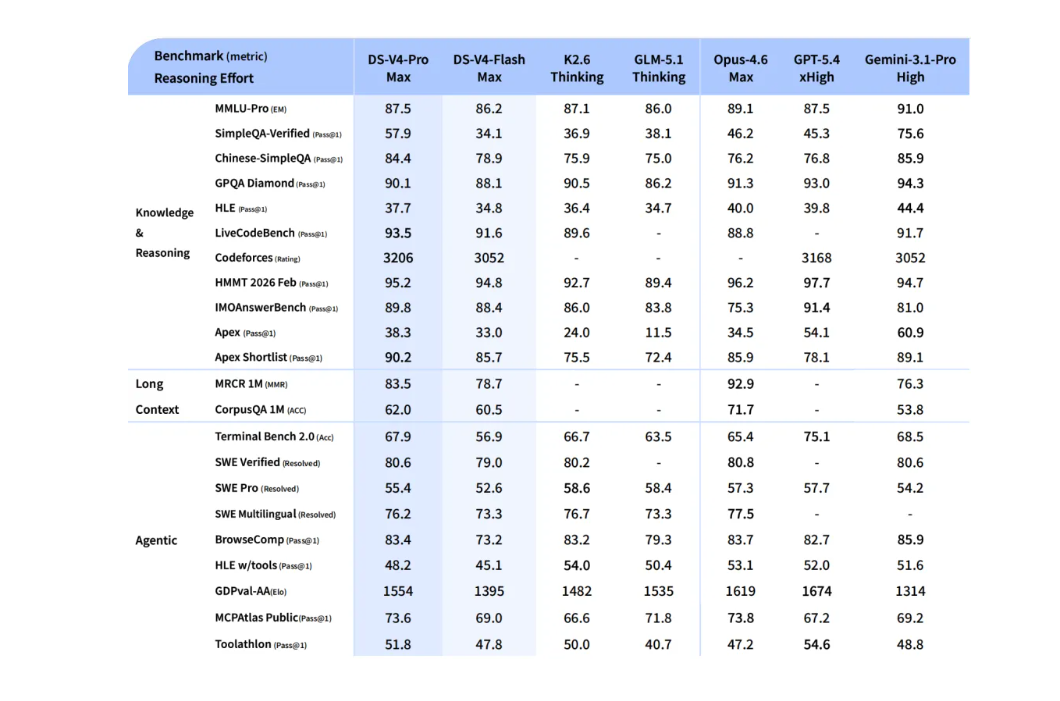

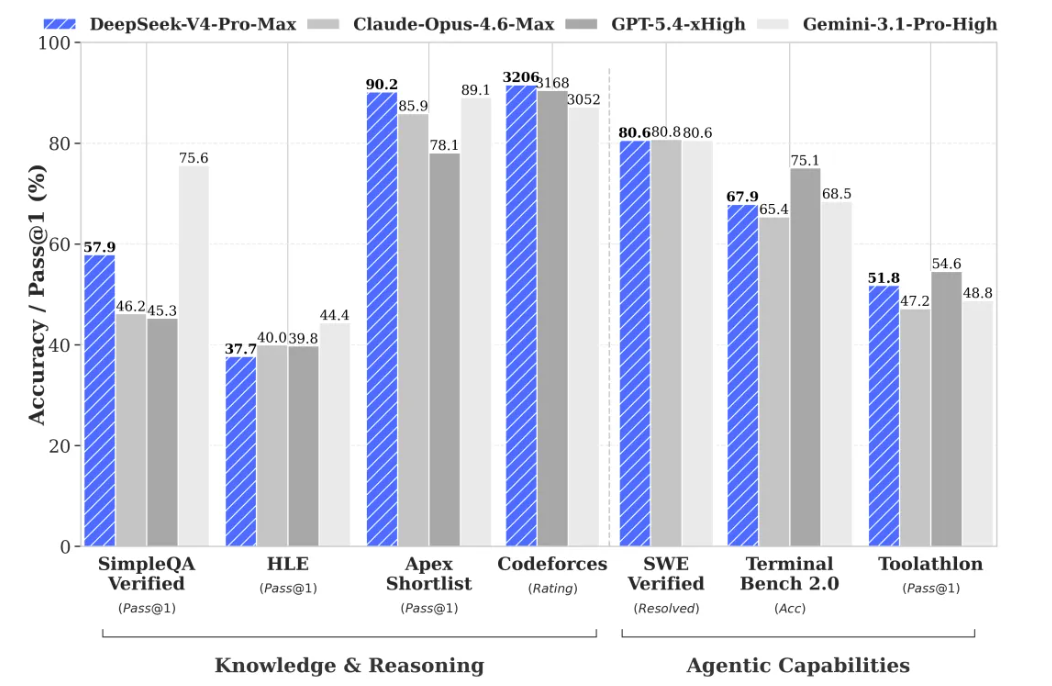

为了更直观地展示 V4-Pro 的实力,我们选取了 DeepSeek-V4-Pro-Max(Pro 版本配合 Max 思考强度)与当前世界顶级的闭源模型——Claude-Opus-4.6-Max、GPT-5.4-xHigh、Gemini-3.1-Pro-High 进行多维度评测对比。结果如下:

-

事实性问答(SimpleQA):DeepSeek-V4-Pro-Max 取得 57.9% 的高分,远超 Claude 和 GPT,仅次于 Gemini。这说明我们的模型在真实世界知识回忆和准确率上已达到第一梯队。

-

高难度推理(HLE):与顶尖模型仍有微小差距,但我们正快速追赶。

-

综合能力(Apex Shortlist):DeepSeek 以 90.2% 的 Pass@1 拔得头筹,证明其在多任务综合评测中的卓越表现。

-

编程能力(Codeforces Rating):与 Claude 并列第一(3206),超越 GPT 和 Gemini。SWE Verified 上四家模型持平,均为 80.6%,表明我们已跻身最强代码模型行列。

-

终端任务与工具使用(Terminal Bench 2.0 & Toolathlon):DeepSeek 在这两项上均取得第一,尤其在工具调用(Toolathlon)中以 75.1% 大幅领先 Claude(68.5%)和 Gemini(54.6%),充分体现了 V4-Pro 在 Agent 场景下的强大实力。

这些数据有力证明:DeepSeek-V4-Pro 已具备比肩甚至部分超越世界顶级闭源模型的性能,并且我们坚持开源,让每一位开发者都能自由使用。

如果您需要处理复杂 Agent 任务、高难度推理或追求当前最佳的开源模型体验,V4-Pro 是当之无愧的首选。

而DeepSeek-V4-Flash是更快捷高效的经济之选:

-

它在世界知识储备方面虽稍逊于 Pro 版,但展现出了十分接近的推理能力,足以应对绝大多数日常场景。

-

由于模型参数和激活更小,V4-Flash 能够提供更加快捷、经济的 API 服务,显著降低调用成本。

-

在 Agent 测评中,V4-Flash 在简单任务上与 Pro 版旗鼓相当,仅在超高难度任务上存在合理差距。

两个版本均支持 1M 超长上下文、非思考模式与思考模式(可通过 reasoning_effort 参数调节思考强度)。对于复杂 Agent 场景,建议使用思考模式并将强度设为 max。

技术突破与 API 升级

技术突破:全新注意力机制,让百万上下文成为标配。

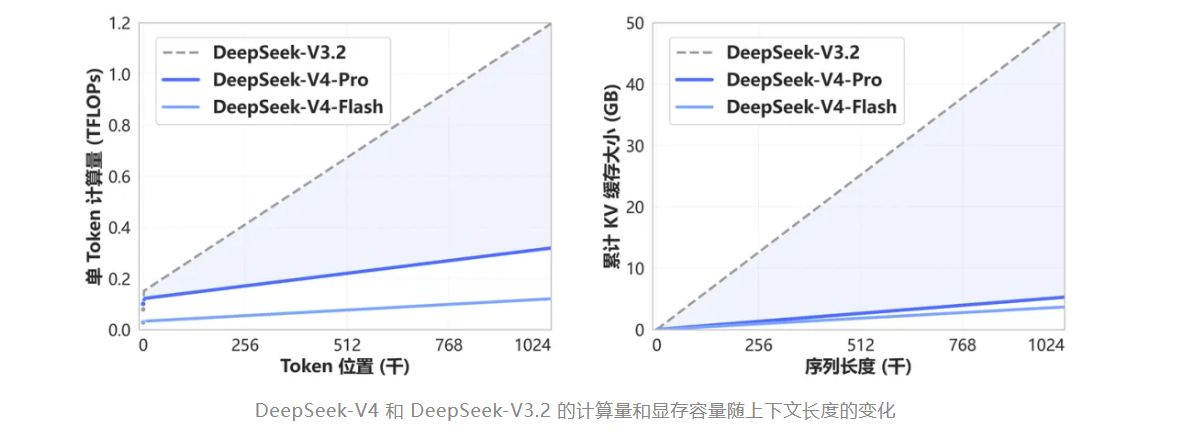

如此强大的长上下文能力,并非单纯堆砌算力,而是源于 DeepSeek-V4 开创性的架构创新。

Deepseek团队设计了一种全新的注意力机制:在 token 维度进行动态压缩,同时结合 DSA 稀疏注意力(DeepSeek Sparse Attention)。这使得 V4 在实现全球领先的长上下文能力的同时,大幅降低了对计算和显存的需求。与传统方法相比,DeepSeek-V4 的计算量和显存占用随上下文长度增长的曲线极为平缓——哪怕在 1M 上下文长度下,资源消耗依旧可控。

这意味着:百万上下文不再是少数人的“玩具”,而是每个人都可以轻松调用的基础能力。无论是一次性处理整本《三体》三部曲,还是分析长达数千页的代码仓库,DeepSeek-V4 都能从容应对。

此外,我们还针对 Claude Code、OpenClaw、OpenCode、CodeBuddy 等主流 Agent 产品进行了全面适配与优化,在代码任务、文档生成、PPT 自动生成等场景下表现均有显著提升。

API 升级与开源:立即体验,旧模型名将停用

API 调用方式:

目前,DeepSeek API 已同步上线 V4-Pro 与 V4-Flash。访问新模型时,base_url 不变,只需将 model 参数改为 deepseek-v4-pro 或 deepseek-v4-flash 即可调用。两个模型均支持 OpenAI ChatCompletions 接口与 Anthropic 接口。

重要时间节点提醒:

旧有 API 接口的两个模型名 deepseek-chat 与 deepseek-reasoner 将于 三个月后(2026 年 7 月 24 日) 停止使用。当前过渡阶段内,deepseek-chat 将指向 deepseek-v4-flash 的非思考模式,deepseek-reasoner 指向 deepseek-v4-flash 的思考模式。请大家提前做好迁移准备。

OpenClaw学术智能体

👉飞书免费体验群

ALL IN ONE 通用智能(AGI)服务

行业领先的AI服务供应商

探索智能边界

发现无限可能

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)