DeepSeek V4降AI痕迹避坑指南,2026年4月8个常见错误

DeepSeek V4降AI痕迹避坑指南,2026年4月8个常见错误

DeepSeek V4 在 2026 年 4 月 24 日正式发布,新版本的语言流畅度比 V3 又上了一个台阶,但也因此让"AI 痕迹"问题变得更隐蔽。很多同学拿 DeepSeek V4 写完论文,第一次跑知网 AIGC 检测就被打到 60% 以上,反复改也降不下来。问题不在 DeepSeek V4 本身,而在于使用方式踩了坑。这份避坑指南整理了 2026 年 4 月最常见的 8 个错误,每一条都给出对应的解决方案,并附上工具组合建议,帮你少走两周弯路。

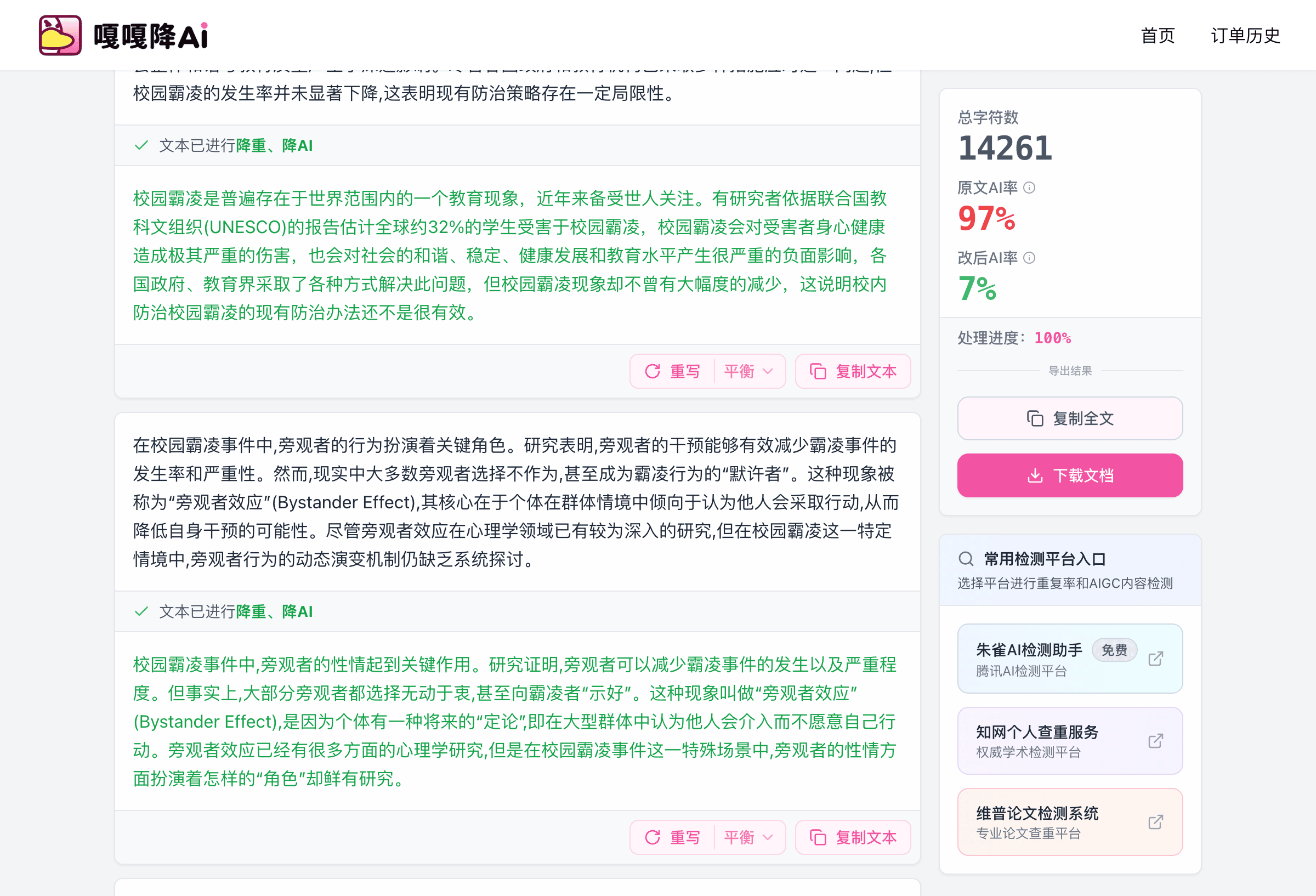

文章里会用到几款本次推荐工具汇总里的产品:嘎嘎降AI(www.aigcleaner.com)作为主力,覆盖知网/维普/万方/朱雀等 9 个平台;率零(www.0ailv.com)适合维普万方场景;去i迹(quaigc.com)适合朱雀和社媒内容。下面进入正题。

一、Prompt 写得太"标准",AI 味直接拉满

错误 1:让 DeepSeek V4 “用学术语言写一篇关于 XX 的论文”

这是最高频的踩坑。DeepSeek V4 看到"学术语言"四个字,会自动调用最规整的句式:综上所述、值得注意的是、首先其次最后、并列三句一组。这种结构在 AIGC 检测器眼里就是教科书级别的 AI 特征,知网 3.0 算法对这种并列结构的识别准确率超过 92%。

解决方案:把 Prompt 改成具体场景的口语化指令。例如:

“请用研究生写论文的视角,重写以下段落。要求:去掉’综上所述’‘首先…其次…最后’这类结构;句子长度在 12 到 35 字之间随机分布;保留专业术语,但允许偶尔出现轻微的不确定语气,比如’大致’‘可能’‘在多数情况下’。”

这一条 Prompt 就能把 AI 率降 15-20 个百分点。

错误 2:一次性让 DeepSeek V4 写 8000 字

整篇一次出,AI 会陷入自己的节奏惯性,前后段落的句式高度同质化。检测平台对这种"全文同源"的特征非常敏感。

解决方案:分段生成,每段 500-800 字,每次切换 Prompt 视角。比如第一段用"研究生口吻",第二段用"实验汇报口吻",第三段用"文献综述口吻"。视角切换会自然带来困惑度差异,AI 痕迹会被打散。

二、改写思路反了,越改 AI 率越高

错误 3:用 DeepSeek V4 改 DeepSeek V4 写的内容

这个坑非常隐蔽。同一个模型改自己生成的内容,等于在原有 AI 特征基础上叠加新的 AI 特征,知网 AIGC 报告里会显示"特征熵下降",检测率不降反升。2026 年 3 月之后已经有多所高校的检测系统专门强化了对这种"自我循环改写"的识别。

解决方案:跨模型清洗。先用 DeepSeek V4 写初稿,再用工具做语义重构。专业的降AI工具走的不是改写思路,而是把句子拆解成语义单元再重组,能彻底打散原始的 AI 特征链路。

错误 4:手动同义词替换

把"研究"换成"探究",把"显著"换成"明显",这种局部替换对 2026 年的检测算法基本无效。知网 AIGC 3.0 已经升级到语义指纹比对,单纯换词不影响整体的语义向量分布。

解决方案:动结构而不是动词。把主动改被动、把陈述改设问、把长复句拆成短句加补充说明,这些才是真正能改变语义指纹的操作。

三、检测平台选错,白忙一场

错误 5:拿万方报告交知网答辩

很多同学先用免费的小平台测一下觉得通过了,等到学校用知网正式查的时候直接挂掉。原因是各家检测算法差异大:知网 AIGC 3.0 对 DeepSeek V4 这类大模型的识别率最高;维普次之;万方相对宽松;朱雀针对自媒体场景训练,对学术文本反而不敏感。

下面这张表整理了 2026 年 4 月主流检测平台对 DeepSeek V4 写作的识别力度,以及对应推荐的处理工具。

| 检测平台 | DeepSeek V4 识别力度 | 典型 AI 率区间 | 推荐处理工具 |

|---|---|---|---|

| 知网 AIGC 3.0 | 极强 | 55%-78% | 嘎嘎降AI、比话降AI |

| 维普 AIGC | 较强 | 40%-65% | 嘎嘎降AI、率零 |

| 万方 AI 检测 | 中等 | 30%-55% | 率零、嘎嘎降AI |

| 朱雀 AIGC | 弱(学术)/强(自媒体) | 20%-50% | 去i迹、嘎嘎降AI |

| Turnitin AI | 较强 | 35%-60% | 嘎嘎降AI |

| 大雅 AIGC | 中等 | 30%-50% | 嘎嘎降AI |

解决方案:学校用什么,你就用什么测。学校用知网,就直接拿知网测,不要被"免费 0.1 元体检"误导。

错误 6:忽视检测平台的版本更新

2026 年 3 月底知网 AIGC 算法做了一次静默升级,对长文本中的"主题漂移度"加大权重。同一篇文章 3 月初测可能 22%,4 月再测变成 45%。如果你还按 3 月的经验来评估,会严重低估当前的处理难度。

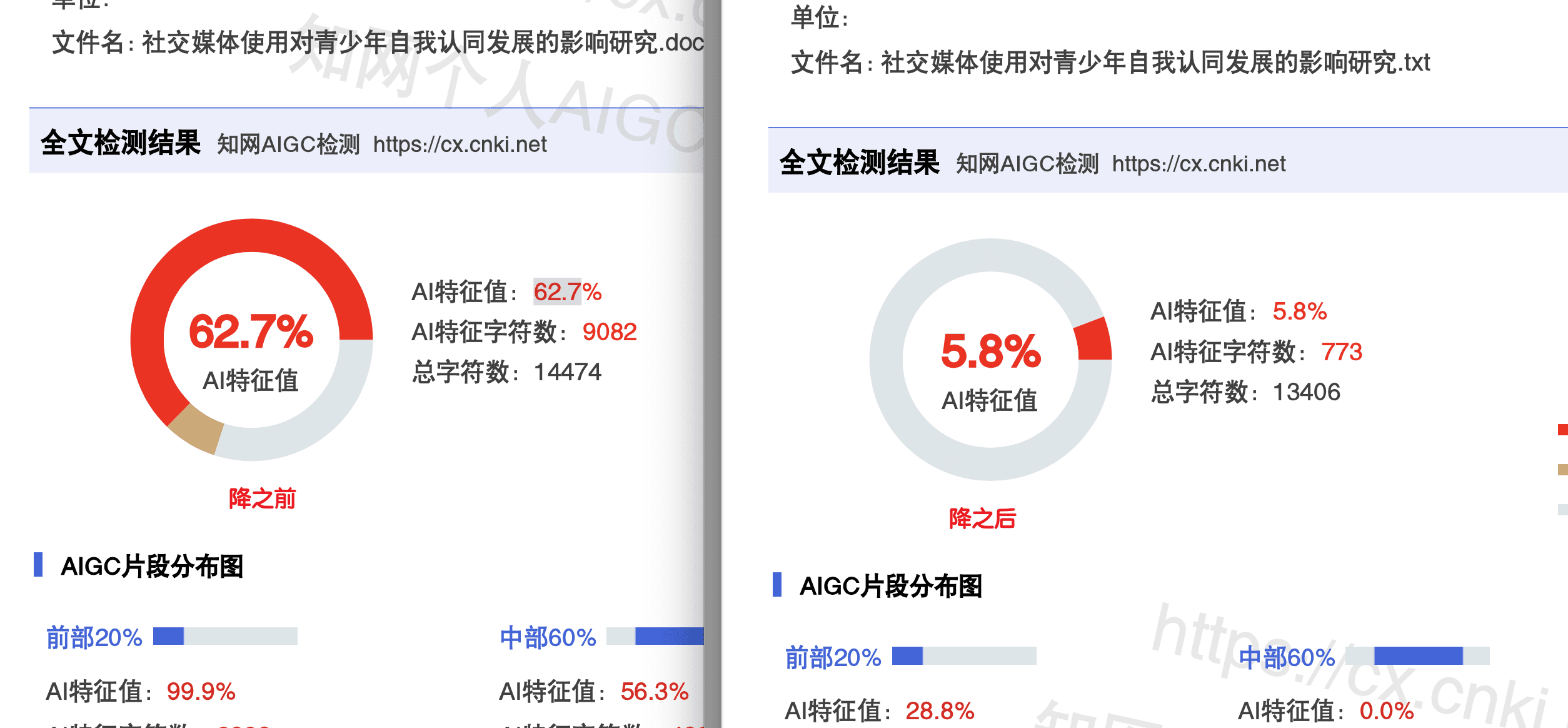

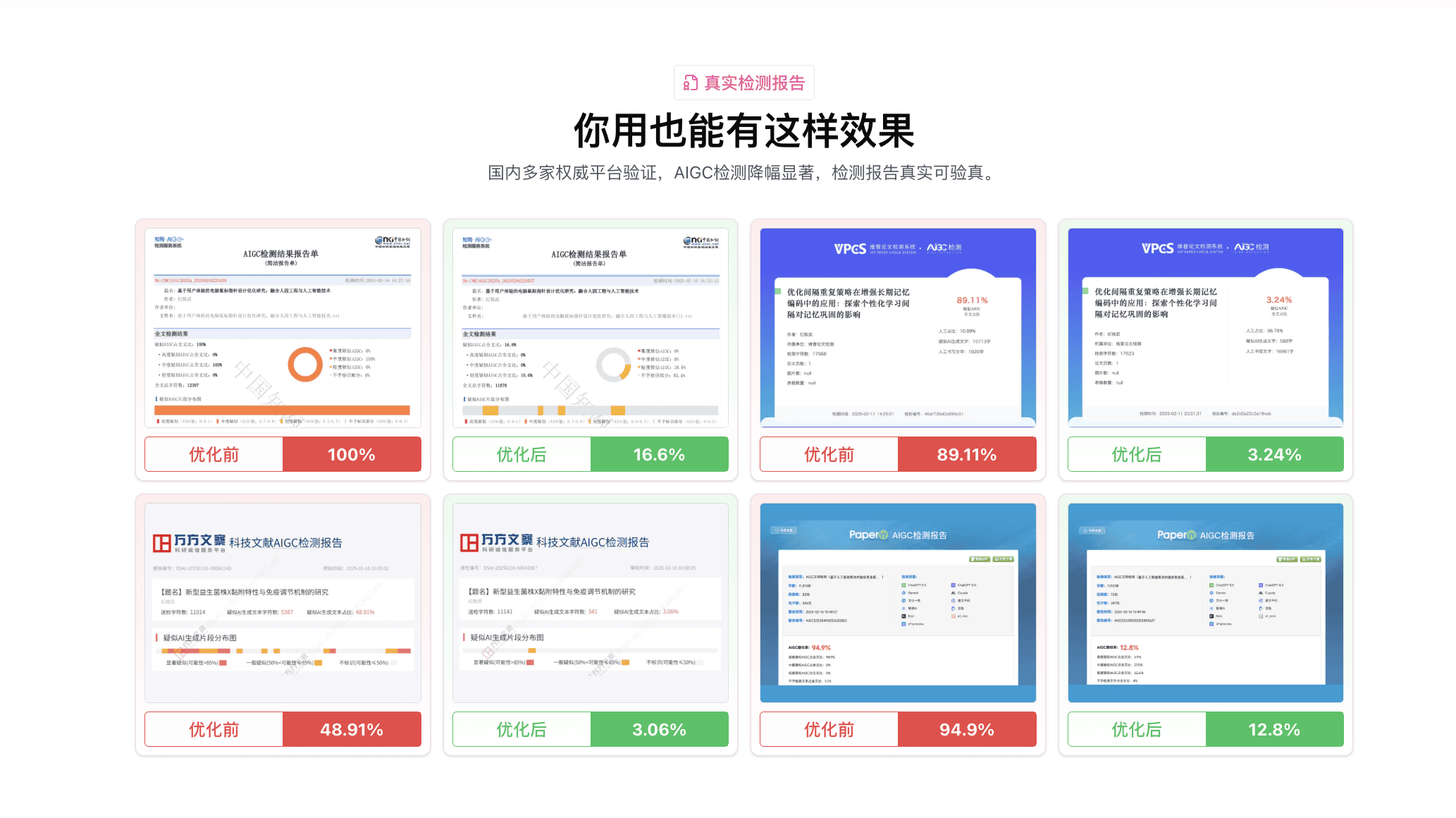

解决方案:每次正式提交前重新测一次,不要拿一周前的报告当依据。处理工具上选有定期对接平台算法的产品。嘎嘎降AI 在 2026 年 4 月已经完成了对知网 3.0 新版本的同步适配,处理后再测可以稳定降到 10% 以下。

四、降重和降AI混为一谈,钱白花了

错误 7:拿降重工具去降 AI 率

降重和降AI是两件事。传统降重工具(PaperPass、PaperYY 这类老牌的)针对的是文字重复率,处理逻辑是把"研究表明"换成"经研究发现"。但 AI 率检测看的是语义指纹和句式分布,传统降重处理完,重复率从 30% 降到 8%,AI 率却纹丝不动。

解决方案:分清需求再选工具。

- 只降重:用学校系统认可的查重工具

- 只降AI:用降AI专用工具

- 两个一起:选支持双引擎的产品

嘎嘎降AI 的优势就在于一次处理同时降重和降AI,4.8 元/千字。市面上单独买降重工具和降AI工具,叠加下来通常 8 元/千字以上,嘎嘎降AI 走双引擎路线,相当于一次处理覆盖两个维度,性价比合适。

如果是维普万方场景的论文,率零的 DeepHelix 深度语义重构在万方场景下表现稳定,3.2 元/千字适合预算有限的本科生;如果是朱雀检测的自媒体内容或公众号文章,去i迹的 HumanRestore 引擎专门针对社媒场景训练,2 分钟交付。

五、时间安排错乱,截稿日才开始处理

错误 8:答辩前一天才想起来跑 AIGC 检测

这是最致命的错误。AI 率高需要二轮处理是常态,第一轮工具处理后通常会从 60% 降到 15-20%,离学校要求的 10% 或 15% 阈值还差一口气。这一口气往往需要人工微调,加上重新检测的等待时间,至少留 3 天。

解决方案:倒推时间表。

- D-7 天:用 DeepSeek V4 写完初稿,自测一次知网 AIGC

- D-5 天:第一轮工具处理,处理后再测

- D-3 天:人工微调高亮段落,第二轮处理

- D-1 天:终稿测试,留缓冲

选工具时优先看售后保障。嘎嘎降AI 在 9 大平台都提供不达标退款承诺,比话降AI 专攻知网,承诺 AI 率不低于 15% 全额退款加检测费。这类带退款保障的工具在临近截稿时尤其重要,万一处理效果不达标,不会让你陷入既花了钱又没解决问题的双重困境。

六、配合 DeepSeek V4 的正确指令模板

避坑之外,给两条经过实测的 Prompt 模板,配合工具使用效果会更稳。

第一轮预降 Prompt:

“保留以下段落的核心观点和数据,重写为困惑度更高的版本。要求:单句长度在 12-35 字之间随机分布;偶尔加入轻微的不完美措辞,比如’据我观察’‘从已有资料看’;避免完美的并列结构;保留所有专业术语和引用标注。”

第二轮人工对照 Prompt:

“下面这段话被 AIGC 检测标红,请帮我分析三个最可能的 AI 特征点,并给出三种不同视角的改写版本:版本 A 偏研究生口吻、版本 B 偏实验汇报、版本 C 偏文献综述。”

DeepSeek V4 处理过的初稿,再交给嘎嘎降AI 做语义重构,整体流程下来 AI 率从 65% 降到 8% 左右是常见结果。如果初稿用了维普或万方做检测目标,把嘎嘎降AI 替换成率零也能拿到接近的效果。

写在最后

2026 年 4 月 DeepSeek V4 的发布让降AI这件事进入了新阶段。模型越聪明,留下的痕迹越像人,但平台检测算法也在同步升级。8 个错误本质上是 4 个层面的问题:Prompt 写法、改写思路、平台选择、时间管理。把这四件事处理好,AI 率不会成为毕业路上的拦路虎。

工具上的选择按场景匹配:知网场景嘎嘎降AI+比话降AI 双保险;维普万方场景嘎嘎降AI+率零组合;朱雀和社媒场景去i迹+嘎嘎降AI。先想清楚检测平台,再决定工具组合,比一上来就买最贵的更靠谱。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献944条内容

已为社区贡献944条内容

所有评论(0)