别再说“天又塌了”!面对每周一个新模型,我劝你掌握这项核心竞争力

天不用再塌了,一文教你如何评测模型能力

项目已开源: https://github.com/SWUSTcyt/llm-eval-playground.git

欢迎 Star、Fork、提 Issue,一起打造更好用的评测工具。

关注同名公众号获取更多技术资讯!

一、前言:模型大爆发,焦虑从何来

1.1 大模型"井喷"时代

从 2025 年末到 2026 年初,大模型赛道进入了前所未有的高密度发布期。几乎每隔一两周,就会有一款"重磅新模型"刷屏社交媒体:

🌍 国外阵营:性能与效率的双重巅峰

- OpenAI GPT-5 系列: 继 GPT-4o 之后,OpenAI 接连推出 GPT-5.2 和 GPT-5.3-Codex。其中 Codex 版本专门针对代码场景优化,支持全新的 Responses API,在编程辅助领域表现亮眼。

- Google Gemini 3 系列: 除了主打高性价比的 Gemini 3 Flash,Gemini 3.1 Pro 的发布补齐了全能型选手的拼图。它在保持超长上下文窗口的同时,大幅提升了逻辑推理和多模态理解能力,被视为目前最强的“六边形战士”之一。

🇨🇳 国内阵营:百花齐放,各显神通

- 阿里 Qwen3.5 系列: Qwen3.5-Plus 和 Qwen3.5-397B-A17B(MoE 架构)先后发布。397B 参数量惊人,但实际激活参数仅 17B,兼顾了性能和成本。

- Minimax M2.5 系列: 作为国内第一梯队的“黑马”,Minimax最新发布的M2.5模型,在感性理解、长文本处理和拟人化交互上表现极其亮眼。其独特的“原生 Agent”能力,使其成为中文语境下最有温度、也最具行动力的模型之一。

- DeepSeek 深度求索: 尽管对DeepSeek-V4(即将发布)的实测还未完成,但根据已引爆社区的V4 Lite版本表现,其在逻辑推理和代码能力上依然保持了恐怖的“性价比”。从“价格屠夫”到“性能悍将”,DeepSeek 始终是市场无法忽视的变量。

每次新模型发布,社交媒体上总会出现类似的声音:

“天又塌了!XXX 模型碾压一切!”

久而久之,大家都患上了"模型焦虑症"——到底该信谁?换了新模型,之前的选型还靠谱吗?

1.2 与其焦虑,不如自己动手测

面对层出不穷的模型,与其被各种营销话术牵着走,不如掌握自己的判断力。

本文会从两个角度帮你建立这种判断力:

- 角度一:如何看懂权威评测榜单——了解"别人是怎么测的",学会从公开数据中获取信息。

- 角度二:如何搭建自己的评测系统——动手写代码,亲自跑一遍,用真实数据说话。

文章末尾会附上完整的开源项目地址,你可以直接拉取代码,配置好 API Key,一键跑出自己的评测报告。

二、权威榜单与评测基准

在动手之前,先了解一下业界已有的评测体系。这些公开榜单能帮你快速建立一个"基准感",知道各家模型大致处在什么水位。

2.1 主流评测基准介绍

以下是几个最常被引用的评测基准,每个都有不同的侧重点:

- MMLU / MMLU-Pro(综合知识)

全称 Massive Multitask Language Understanding,覆盖 57 个学科(从历史到物理再到法律),是目前衡量模型"知识广度"最常用的基准。看的核心指标是整体 accuracy。MMLU-Pro 是其升级版,难度更高、更不容易"刷分"。 - GSM8K(数学推理)

包含约 8000 道小学数学应用题,重点测试模型的逐步推理(Chain-of-Thought)能力。指标是 exact_match(精确匹配率)。别看只是小学数学,很多模型在这上面的表现差距明显。 - HumanEval / HumanEval+(代码生成)

由 OpenAI 提出,164 道 Python 编程题,测试模型写代码的能力。HumanEval+ 是 EvalPlus 项目的增强版,增加了更多测试用例来减少"碰巧通过"的情况。核心指标是 pass@1(一次生成就能通过的概率)。 - IFEval(指令遵循)

测试模型能否严格遵守指令——比如"用 JSON 格式输出"、“回答不超过 100 字”、“只用英文回复”。这个基准能很好地反映模型在实际应用场景中的"听话程度"。 - LMSYS Chatbot Arena(竞技场)

这是最贴近真实用户体感的评测方式:真人用户在盲评模式下和两个匿名模型对话,然后投票选出更好的那个。最终按 ELO 评分排名。不依赖任何固定数据集,能反映模型在开放场景下的综合表现。 - C-Eval(中文能力)

专门面向中文场景的综合评测,覆盖中国高考、公务员考试、专业资格考试等题型。对于需要在中文业务场景中使用大模型的开发者来说,这是非常有参考价值的基准。

2.2 去哪里看这些榜单

以下几个网站是查看模型排名的常用入口:

- LMSYS Chatbot Arena(https://arena.ai/leaderboard):真人对战 ELO 排名,被认为是最贴近实际的评测。

- OpenCompass 司南(https://opencompass.org.cn):国内最全面的开源评测平台,支持上百种基准。

- Hugging Face Open LLM Leaderboard(https://huggingface.co/spaces/open-llm-leaderboard):开源模型排行榜,社区驱动。

- Artificial Analysis(https://artificialanalysis.ai):侧重性能、价格、延迟的横向对比,选型时非常实用。

💡 提示: 建议在阅读本文的同时,打开这几个网站对照查看,体会每个榜单的侧重点。

2.3 怎么理解榜单数字

看榜单时,有几个常见的"坑"需要注意:

- 同一基准的不同版本分数不可直接比较。比如 MMLU 和 MMLU-Pro 的分数体系差异很大,A 模型在 MMLU 上 90 分不代表比 B 模型在 MMLU-Pro 上 85 分更强。

- 厂商自报 vs 第三方复现。厂商发布时公布的数字往往是最优配置下的结果,实际使用时可能有差距。优先参考第三方独立复现的数据。

- 数据污染问题。部分模型可能在训练时"见过"测试集的题目,导致分数虚高。这也是为什么社区在不断推出新版本的基准(如 MMLU-Pro、HumanEval+)。

- 分数高不代表实际好用。Arena 这种真人盲评的排名,往往比固定数据集的分数更能反映用户体感。

总结一句话:榜单是参考,实测才是王道。

接下来,我们就来搭建自己的评测系统。

三、动手实战:搭建属于自己的评测系统

3.1 整体设计思路

我们的开源项目 llm-eval-playground 采用了一个简单但实用的设计:

核心理念:统一接口,逐模型评测,自动生成报告。

整体流程如下:

config.json 定义模型列表

↓

各评测脚本逐模型运行

(推理 / RAG / Function Calling / 多轮对话 / 延迟)

↓

结果写入 results/*.json

↓

run_all.py 汇总生成 Markdown 报告

所有模型统一走 OpenAI 兼容接口(/v1/chat/completions),不管你用的是 OpenAI 官方、阿里 DashScope、还是第三方代理,只需要在配置文件中指定 base_url 和 api_key_env 即可。

本次评测选取了 5 个模型,涵盖国内外三大厂商:

| 模型 | 厂商 | 定位 |

|---|---|---|

| qwen-turbo-latest | 阿里 | 极致性价比,低延迟 |

| qwen3.5-plus | 阿里 | 中高端,综合能力强 |

| qwen3.5-397b-a17b | 阿里 | MoE 大模型,397B 参数 |

| gemini-3-flash-preview | 低延迟,高性价比 | |

| gpt-5.3-codex | OpenAI | 代码专精,最新一代 |

3.2 评测维度详解

我们从五个维度对模型进行评测,每个维度都对应实际业务中的常见需求。

3.2.1 推理能力

- 这是什么? 推理能力是大模型最核心的能力之一。简单来说,就是模型能否"一步一步想清楚",而不是直接蒙一个答案。

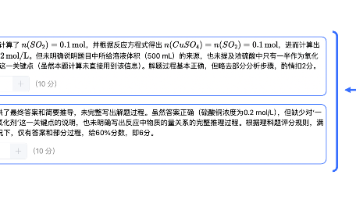

- 我们怎么测? 使用业界标准的 lm-evaluation-harness 框架,选取 GSM8K(小学数学应用题)作为推理基准。每个模型跑 50 道题(2-shot,即给两个示例),通过 OpenAI 兼容接口调用。

举个例子,一道典型的 GSM8K 题目是这样的:

小明有 5 个苹果,给了小红 2 个,又买了 3 个。请问小明现在有几个苹果?

模型需要列出计算步骤,最终给出正确答案"6"。

- 看什么指标?

exact_match(精确匹配率)——模型给出的最终数字是否和标准答案完全一致。这个指标非常严格,不接受"差不多对"。

3.2.2 RAG 能力(检索增强生成)

- 这是什么? RAG(Retrieval-Augmented Generation)是目前企业落地大模型最常见的架构:先从知识库中检索相关文档,再把文档内容拼接到 prompt 里,让模型基于这些"证据"来回答问题。这个场景中我们关心的是:模型能否基于给定的文档准确回答,而不是"瞎编"。

- 我们怎么测? 整个流程分四步:

- 准备一组测试文档和对应的问答对;

- 使用 Embedding 模型将文档向量化,存入 FAISS 索引;

- 对每个问题检索 Top-K 最相关的文档片段,拼接到 prompt 中让模型回答;

- 使用 ragas 框架(一个专业的 RAG 评测工具)自动计算指标。

- 看什么指标? ragas 框架提供三个核心指标:

- answer_relevancy(答案相关性):回答是否切题,不答非所问。

- faithfulness(忠实度):回答是否基于检索到的文档内容,而非模型自己"编造"的知识。这个指标在企业场景中尤其重要——你不希望客服机器人"自由发挥"。

- context_precision(上下文精度):检索到的文档片段里,有多少是真正有用的。

3.2.3 Function Calling(工具调用)

-

这是什么? 现在的大模型不仅能聊天,还能"调用工具"——比如查天气、发邮件、执行计算。Function Calling 能力决定了模型能否在 Agent 场景中正确工作。

-

我们怎么测? 设计了 10 个测试场景:

-

6 个需要调用工具的场景(如"今天北京天气怎么样?"应该调用 get_weather)

-

4 个不需要调用工具的场景(如"请做一下自我介绍"不应该调用任何工具)

-

模型需要做到三件事:选对工具、提取对参数、在不需要工具时正确拒绝。

-

看什么指标?

-

工具选择准确率:是否选对了该调用的工具

-

参数准确率:传给工具的参数是否正确

-

无需调用准确率:在不需要工具时,是否正确地没有调用

3.2.4 多轮对话

-

这是什么? 实际使用中,我们很少只和模型说一句话。多轮对话能力决定了模型在持续交互中能否"记住"之前说了什么、保持一致的行为、正确理解指代关系。

-

我们怎么测? 设计了 8 个多轮对话场景,覆盖三个维度:

-

上下文记忆:在第一轮告诉模型"我叫张伟,是一名软件工程师",几轮对话后问"我叫什么名字?"——看模型是否还记得。

-

指令一致性:告诉模型"从现在开始只用英文回答",然后故意用中文提问——看模型是否坚持用英文回复,不会被"带偏"。

-

指代消解:先聊"Python 是一种编程语言",然后问"它是谁发明的?"——看模型是否理解"它"指的是 Python。

-

看什么指标? 通过关键词命中和禁词检查自动判定每个场景是否通过,最终计算各维度的通过率。

3.2.5 延迟与吞吐量

-

这是什么? 能力再强,如果回复要等半分钟,用户体验也会很差。延迟和吞吐量直接决定了模型在生产环境中的可用性。

-

我们怎么测? 分三组测试:

-

短 prompt(约 50 字)、中 prompt(约 200 字)、长 prompt(约 500 字),每组各测 3 次取平均。

-

额外做一组 3 并发压测,模拟真实使用场景。

-

看什么指标?

-

平均延迟(秒):从发出请求到收到完整回复的时间

-

平均吞吐(tok/s):每秒生成的 token 数,越高越好

-

并发延迟:同时发多个请求时的平均响应时间

3.3 评测结果与分析

以下是我们使用上述五个模型、五个维度实测的结果。

推理能力(GSM8K exact_match)

| 模型 | 得分 |

|---|---|

| qwen-turbo-latest | 0.960 |

| qwen3.5-plus | 0.980 |

| qwen3.5-397b-a17b | 0.980 |

| gpt-5.3-codex | 0.920 |

| gemini-3-flash-preview | 0.020 |

💡 分析: Qwen 全系列表现非常稳定,qwen3.5 系列达到了 0.98 的高水平。GPT-5.3-Codex 虽然主打代码,但在数学推理上也有 0.92 的不错成绩。Gemini Flash 在该基准上得分偏低,可能与代理接口的兼容性有关,不一定反映模型真实能力。

RAG 能力(ragas 指标)

| 模型 | 答案相关性 | 忠实度 | 上下文精度 |

|---|---|---|---|

| qwen-turbo-latest | 0.844 | 1.000 | 1.000 |

| qwen3.5-plus | 0.967 | 1.000 | 1.000 |

| qwen3.5-397b-a17b | 0.967 | 0.917 | 1.000 |

| gpt-5.3-codex | 0.939 | 1.000 | 1.000 |

| gemini-3-flash-preview | 0.617 | 0.649 | 0.917 |

💡 分析: RAG 场景下,Qwen3.5 系列和 GPT-5.3-Codex 的忠实度几乎满分,说明它们很"老实",严格基于给定文档回答,不会胡编乱造。Gemini Flash 的忠实度偏低(0.649),在对准确性要求高的场景中需要特别注意。

Function Calling(工具调用)

| 模型 | 工具选择 | 参数准确率 | 无需调用 |

|---|---|---|---|

| qwen-turbo-latest | 100.0% | 83.3% | 100.0% |

| qwen3.5-plus | 100.0% | 66.7% | 100.0% |

| qwen3.5-397b-a17b | 100.0% | 66.7% | 100.0% |

| gpt-5.3-codex | 83.3% | 80.0% | 100.0% |

| gemini-3-flash-preview | 0.0% | 0.0% | 100.0% |

💡 分析: Qwen 全系列在工具选择上达到了 100% 的准确率,表现最为稳定。有趣的是,qwen-turbo 这个最"便宜"的模型,参数准确率反而是 Qwen 系列中最高的(83.3%)。所有模型在"不需要调用工具"的场景中都做出了正确判断。

多轮对话

| 模型 | 总体 | 上下文记忆 | 指代消解 | 指令一致性 |

|---|---|---|---|---|

| qwen-turbo-latest | 100.0% | 100.0% | 100.0% | 100.0% |

| qwen3.5-plus | 100.0% | 100.0% | 100.0% | 100.0% |

| qwen3.5-397b-a17b | 87.5% | 66.7% | 100.0% | 100.0% |

| gpt-5.3-codex | 100.0% | 100.0% | 100.0% | 100.0% |

| gemini-3-flash-preview | 100.0% | 100.0% | 100.0% | 100.0% |

💡 分析: 大部分模型全部通过。值得注意的是,参数量最大的 qwen3.5-397b-a17b 在上下文记忆方面反而有所遗漏(66.7%),说明"参数大不一定什么都强",MoE 架构在多轮记忆上可能有其特殊性。

延迟与吞吐量

| 模型 | 平均延迟 | 吞吐(tok/s) | 短prompt | 长prompt | 并发延迟 |

|---|---|---|---|---|---|

| qwen-turbo-latest | 1.55s | 73.8 | 0.50s | 2.43s | 1.42s |

| gemini-3-flash-preview | 2.79s | 79.4 | 2.43s | 2.95s | 2.33s |

| gpt-5.3-codex | 18.62s | 35.2 | 1.93s | 48.37s | 7.44s |

| qwen3.5-397b-a17b | 27.83s | 79.4 | 6.55s | 24.01s | 121.27s |

💡 分析: 速度方面差异巨大。qwen-turbo 以 1.55 秒的平均延迟遥遥领先,短 prompt 甚至只需 0.5 秒,非常适合对响应速度要求高的场景。Gemini Flash 虽然名字里有"Flash",延迟也确实控制在 3 秒以内。大参数模型(397B、Codex)延迟明显更高,尤其在长 prompt 和并发场景下。

费用对比

| 模型 | 一轮评测费用 |

|---|---|

| qwen-turbo-latest | $0.24 |

| qwen3.5-plus | $0.71 |

| gemini-3-flash-preview | $0.85 |

| qwen3.5-397b-a17b | $2.14 |

| gpt-5.3-codex | $3.65 |

跑完五个维度的完整评测,最便宜的 qwen-turbo 只需 $0.24(约 1.7 元人民币),即使是最贵的 gpt-5.3-codex 也只要 $3.65(约 26 元)。对个人开发者来说,这个成本完全可以接受。

3.4 总结:没有"万能模型",只有"合适的选择"

通过实测数据可以很清晰地看到——没有哪个模型在所有维度上都"碾压"其他选手。每个模型都有自己的强项和短板:

- 要速度和性价比 → qwen-turbo-latest(延迟最低、费用最低、推理和 Function Calling 表现优秀)

- 要综合能力最强 → qwen3.5-plus(推理满分级别、RAG 忠实度满分、多轮对话全通过)

- 要代码能力 → gpt-5.3-codex(代码场景专精,RAG 忠实度也很高)

- 要低延迟 + 国际化 → gemini-3-flash-preview(延迟低、吞吐量高)

所以下次再看到"天又塌了"的标题,不用焦虑——打开你的评测系统,跑一遍数据,答案自然就有了。

本文所有评测数据基于 2026 年 2 月底实测,不同网络环境和 API 版本下结果可能略有差异。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)