Transformer:不只是NLP模型,更是现代AI的基石!

Transformer模型凭借其独特的建模方式,在NLP、视觉、多模态等多个领域展现出强大的能力。本文深入探讨了Transformer为何能成为主流架构,其内部组件如何协同工作,以及它在当今依然强大的原因。文章分析了Transformer相较于RNN/LSTM和CNN的优势,解释了Self-Attention和FFN的核心思想,并详细解剖了Encoder-Decoder架构。此外,本文还讨论了Transformer的表示能力、工程优势、模态无关性以及在规模扩展中的表现,并指出了其局限与演进方向。Transformer的成功不仅源于其强大的表示能力,还在于它与现代硬件和训练系统的完美匹配,使其在大模型时代成为不可或缺的基础架构。

Transformer 早已不只是 NLP 领域中的一个模型名称。过去几年,大语言模型、视觉模型、多模态模型,乃至部分科学计算模型,都在不同程度上建立在它提出的建模方式之上。

它之所以重要,不只是因为效果强,更因为它同时改变了表示学习、工程实现和规模扩展这三件事的做法。

本文想做的,不是把 Transformer 神化,也不是只重复教科书里的几个公式。本文更关心三个问题:

- 它为什么能替代旧架构成为主流?

- 它内部各个组件如何协同工作?

- 它为什么在今天仍然强大,却又远不是一个已经完结的答案?

一、历史背景

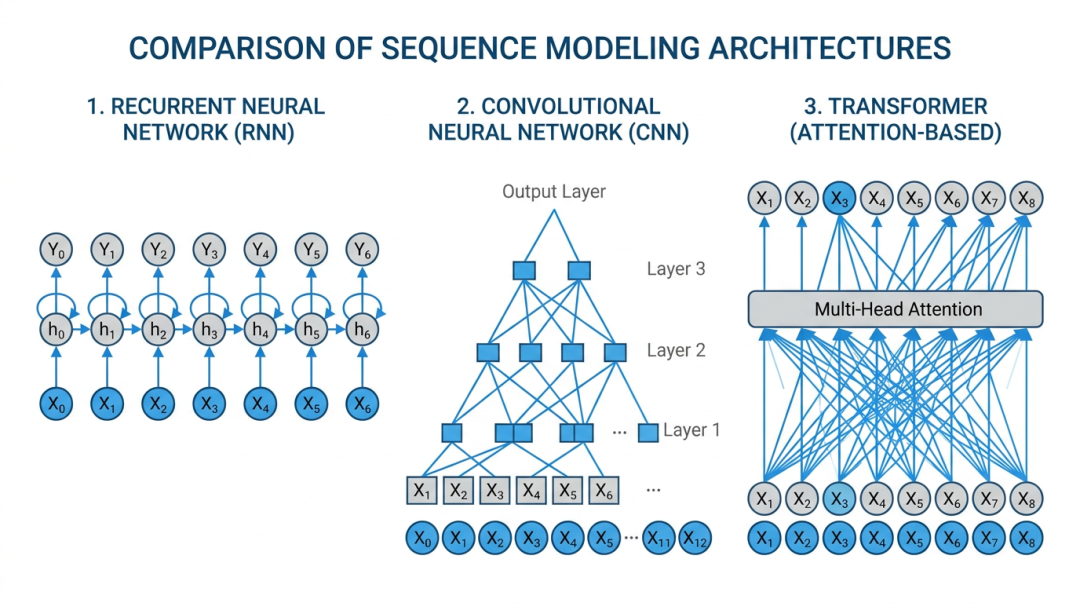

要理解 Transformer 的重要性,先要看它出现之前,序列建模主要依赖什么思路。弄清楚在 Transformer 出现之前,主流方法到底卡在了哪里。

1.1 RNN/LSTM 的主导地位与结构限制

2017 年之前,处理序列数据的主流方法是循环神经网络(RNN)及其变体 LSTM、GRU。它们的基本思想是:用一个隐状态 持续汇总历史信息,再把这个状态传给下一步。

这个设计很自然,但也带来两个结构性约束。

- 顺序依赖强:处理长度为 的序列时,第 步通常要等第 步完成,训练和推理都难以充分并行。

- 长程依赖难建模:位置 的信息要经过多次状态变换才能影响位置 ,距离越远,优化越困难。LSTM 虽然显著缓解了梯度消失,但并没有消除这种路径过长的问题。

因此,RNN/LSTM 在中短序列上效果不错,但一旦模型和数据规模继续扩大,串行计算和长依赖退化就会逐渐成为瓶颈。

1.2 CNN 对序列建模的替代尝试

另一条路线是用卷积处理序列,如 WaveNet、TCN 等。卷积的优势是并行友好,而且局部归纳偏置很强,训练往往比 RNN 更稳定。

但卷积也有明显边界:它天然偏向局部感受野。虽然可以通过堆叠更多层、增大卷积核或使用 dilation 扩展覆盖范围,但长程依赖的建立仍然是间接的,路径长度通常随距离增长。

1.3 Attention 从“辅助模块”变成“主结构”

注意力机制最早在 Seq2Seq 模型中广泛流行,是为了让 Decoder 在生成当前 Token 时,能够有选择地关注编码器输出的不同位置。那时,Attention 很重要,但它仍然依附于 RNN 框架。

《Attention Is All You Need》论文做了一件当时非常重要的事:将注意力从辅助机制提升为核心计算框架,完全去掉循环结构。

Transformer 的意义,不只是提出了一个新模块,而是把“序列建模必须依赖递归状态传递”这个默认前提拿掉了。此后,大规模预训练模型的主流路线基本都建立在这一转变之上。

更具体地说,Transformer 并不是简单把旧模型里的某个零件换掉,而是连“信息必须按时间步逐个传递”这一基本假设也一并改写了。

二、核心思想

一句话概括 Transformer 的基本思想:

用直接的、全局的内容交互,替代间接的、逐步传递的信息流。

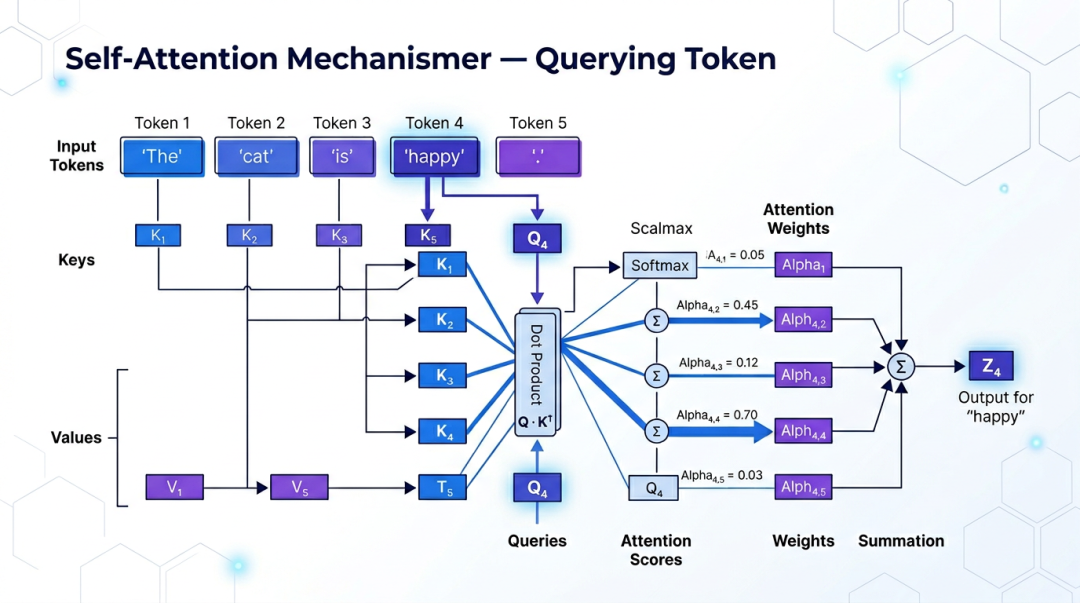

2.1 Self-Attention 的直觉

Self-Attention 的直觉并不复杂:对序列中的每个位置,模型都会问一个问题

为了更好地表示当前位置,我应该从序列中哪些位置收集信息,以及各收集多少?

这个“收集多少”不是手工规则,而是由模型根据输入内容动态计算出来的权重。

可以把它想象成一次小型讨论。每个 Token 都带着三个视角参与:

Query:我现在想找什么信息Key:我这里能提供什么信息Value:真正被传递出去的信息内容

直观地说,Query 可以理解为“检索条件”,Key 可以理解为“索引标签”,Value 则对应“实际内容”。

当前位置用自己的 Query 去和其他位置的 Key 比较,得到相关性,再按相关性对别人的 Value 做加权汇总。这样一轮之后,每个位置的表示都会吸收全局上下文,而不需要像 RNN 那样靠中间状态层层转手。

2.2 信息路径为什么变短了

在 RNN 中,位置 对位置 的影响通常要经过 次状态传递;距离越远,路径越长。

在标准 Self-Attention 中,任意两个位置在同一层里都可以直接交互。因此从计算图的角度看,信息路径长度可以视为 ****。

这并不意味着长程依赖从此“自动解决”,而是意味着:

- 模型有能力直接建立远距离关系

- 梯度可以通过更短的路径传播

- 整个序列的同层计算可以并行执行

这三点叠加起来,正是 Transformer 相比 RNN 的关键优势。

但一个真正能够改变行业的架构,还必须回答另一个问题:这套思路怎样落成一个可训练、可扩展、可复用的具体系统?

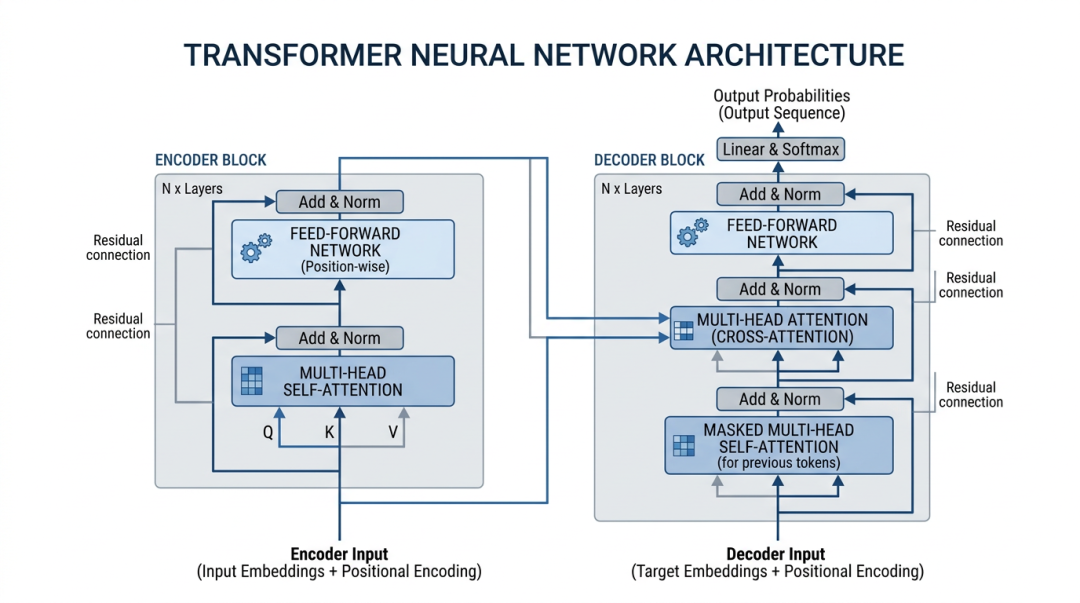

三、架构解剖

原始 Transformer 是一个 Encoder-Decoder 架构。后来的主流模型往往只保留其中一半:

- BERT 类模型主要保留 Encoder,用于双向表示学习

- GPT 类模型主要保留 Decoder,用于自回归生成

- T5 类模型则继续使用完整的 Encoder-Decoder 结构

先看构成 Transformer 的关键模块,再看不同变体为何分化。

本节可以带着一个很简单的阅读框架往下看:

Attention负责跨位置通信FFN负责逐位置加工- 残差、归一化和位置编码负责让这套系统既能训得动,也不丢掉顺序信息

3.1 Scaled Dot-Product Attention

Attention 的标准形式:

其中:

这里 、、 都是输入 的线性投影。如果输入序列长度是 、模型维度是 ,那么可以把 理解为一个 的矩阵,其中每一行对应一个 Token 的表示。这个公式可以分成四步理解。

- 计算相似度: 得到一个 的分数矩阵,第 项表示位置 对位置 的关注强度。直观上,它回答的是“对我当前这个位置来说,你提供的信息有多相关”。

- 按 缩放: 当特征维度较大时,点积值的方差会增大,softmax 更容易进入过于尖锐的区域,训练会变得不稳定。除以 是为了控制数值尺度。

- Softmax 归一化: softmax 把相关性分数转成权重分布,使每个位置对其他位置的注意力总和为 1。

- 对 做加权求和: 最终输出是对所有 value 的加权组合,也就是一种内容相关的动态聚合。

需要说明的是:Attention 里真正的“聚合”这一步是线性的,但因为权重本身来自输入相关的非线性 Softmax,所以整个 Attention 模块并不是线性映射。

3.2 Multi-Head Attention:多种关系并行建模

单头注意力只有一种相似度空间。Multi-Head Attention 的做法是,把表示投影到多个子空间中,并在每个子空间分别计算注意力:

这样做的意义,不只是“多几份参数”,还允许模型同时表达不同类型的关系。需要说明的是,在总模型维度固定时,把注意力拆成多个 head,通常不会显著改变参数量的数量级,更多是在改变表示被分解和组织的方式。

已有分析工作表明,不同 head 往往会分化出不同偏好,如局部邻接、句法依赖、指代关系或特殊标记关注等。但要注意,这些模式并非每个模型、每一层都会稳定出现,也不应把单个 head 的功能解释得过于确定。

3.3 FFN:逐位置非线性变换与容量来源

每个 Transformer block 在 Attention 之后还包含一个前馈网络(Feed-Forward Network, FFN):

在现代模型里,激活函数通常会换成 GELU、SwiGLU 等形式,但结构思想相同:对每个位置独立应用同一组非线性变换。

如果说 Attention 做的是“和别人交换信息”,那么 FFN 更像是在每个位置内部做一次“本地加工”。

FFN 的作用主要有三点。

- 提供非线性表达能力:Attention 负责在不同位置之间交换信息,FFN 负责在单个位置内部对这些信息做更复杂的重映射

- 显著增加模型容量:在常见配置下,FFN 的中间维度通常是模型维度的 4 倍左右,因此单个 block 的大部分参数常常集中在 FFN 中

- 可能承载部分可检索知识:FFN 的行为可在一定程度上近似为键值记忆。但这更适合作为一种有解释力的研究视角,而不是对“模型知识存储位置”的最终定论

用参数量粗略估算,如果模型维度为 ,中间维度取 ,那么 FFN 参数量约为:

而 Attention 中的 投影加输出投影约为:

因此在典型配置下,FFN 的参数量大致占一个 block 的三分之二。这也解释了为什么很多人在第一次细看 Transformer 时,会发现“注意力并非全部,FFN 才是主要的参数来源”。

当然,这个比例依赖具体实现;如果采用 SwiGLU 等变体,参数量会有所变化,但“FFN 是容量主要来源之一”这个判断通常仍然成立。

到这里为止,Attention 和 FFN 已经解释了“信息如何交换、表示如何加工”。接下来的几个组件,则更多是在回答:这样一个深网络为什么真的能训起来。

3.4 残差连接:让深层优化成为可能

Transformer 的每个子层都带残差连接:

残差的意义不只是“防梯度消失”。更准确地说,它给网络提供了一条稳定的恒等路径,使模型可以在保留已有表示的前提下,只学习需要新增的那部分变化。

这会显著降低深层网络的优化难度。没有残差连接,Transformer 很难扩展到今天这样的深度和规模。

3.5 LayerNorm:控制训练中的数值尺度

LayerNorm 的形式是:

它对单个样本内部的特征维度做归一化,而不是像 BatchNorm 那样依赖 batch 统计量。对于长度不固定、批间分布变化较大的序列建模任务,这种设计通常更稳妥。

原始 Transformer 使用的是 Post-LN,也就是先经过子层,再做归一化。后来大量大模型改用 Pre-LN,即先归一化,再进入 Attention/FFN。Pre-LN 通常更容易训练深层网络,因为梯度可以更顺畅地沿着残差路径传播。

严格来说,“每层输入尺度更稳定”更多是 Pre-LN 版本的经验优势,而不是所有 Transformer 结构都天然具备的性质。

3.6 位置编码:为序列引入顺序信息

如果不显式加入位置信息,Self-Attention 对输入顺序本身并不敏感。更准确地说,它是置换等变的:输入顺序一起打乱,输出也会以同样方式打乱,但模型本身不知道“原来的先后关系”是什么。

因此,Transformer 需要额外注入位置信号。

原始论文采用固定的正弦位置编码:

后续又发展出多种位置方案:

| 方案 | 特点 | 代表模型 |

|---|---|---|

| 正弦位置编码 | 固定函数形式,不引入额外位置参数 | 原始 Transformer |

| 可学习位置编码 | 灵活,但长度外推能力通常一般 | BERT、GPT-2 |

| 相对位置编码 | 更关注相对距离关系 | T5 等 |

| RoPE | 通过旋转方式把位置信息引入注意力计算 | LLaMA、GPT-NeoX |

| ALiBi | 用线性偏置编码距离,工程实现简洁 | BLOOM、MPT |

位置编码的持续演进说明了一点:顺序感知并不是 Transformer 的内生优势,而是需要额外设计来补足的部分。 这并不意味着它不可用,但的确是架构设计中长期反复优化的一环。

3.7 Encoder、Decoder、Mask 与 Cross-Attention

如果只讨论 Self-Attention 而不讨论 mask,那么对 Transformer 的结构说明仍然是不完整的。

Encoder 的 Self-Attention 通常是双向的。每个位置都能看到整段输入,所以它适合做理解类任务,比如分类、抽取、检索表示学习等。

Decoder 的 Self-Attention 则要加上 Causal Mask。也就是说,位置 只能看到自己以及更早的位置,不能偷看未来 Token。正是这个约束,使 Decoder 可以用于自回归语言建模:

p(x1,…,xn)=∏t=1np(xt∣x<t)=“” Cross-Attention 出现在完整的 Encoder-Decoder 架构中。此时 Decoder 的 Query 来自当前生成状态,而 Key/Value 来自 Encoder 输出。它的作用是:生成每个目标 Token 时,有条件地读取源序列表示。这也是机器翻译、摘要、语音到文本等 Seq2Seq 任务中非常关键的结构。

这三者的区别,决定了后来主流模型的分化方向:

BERT依赖双向 Encoder 表示,因此擅长理解;GPT依赖带因果掩码的 Decoder,因此适合生成;T5保留完整 Encoder-Decoder,更适合显式输入到输出映射任务。

如果再往前走一步看训练目标,差异会更清楚:

BERT的原始预训练目标主要是 Masked Language Modeling(MLM),让模型根据双向上下文恢复被遮掉的 Token;GPT的核心目标是 Next-token Prediction,也就是标准自回归语言建模;T5则把各种任务统一改写成 Text-to-Text 形式,本质上仍是条件生成。

也正因为结构和目标函数同时不同,这三条路线后来才分别发展出“表示学习”“开放式生成”和“统一 Seq2Seq 任务建模”三种典型范式。

把这一节收一下,可以得到一个更清楚的整体图景:Transformer 不是“一个注意力公式”,而是一套围绕注意力组织起来的完整深网络设计。前面的模块负责表示能力,后面的设计负责训练稳定性,而 Encoder/Decoder 的分化则决定了它后来如何演化成 BERT、GPT 和 T5 这样的不同路线。

四、表示能力

本节会有点“抽象”。它的作用不是证明 Transformer 在所有任务上都必然更强,而是解释:为什么这样一套看上去相对简单的模块组合,能够在很多场景里学出足够丰富的表示。

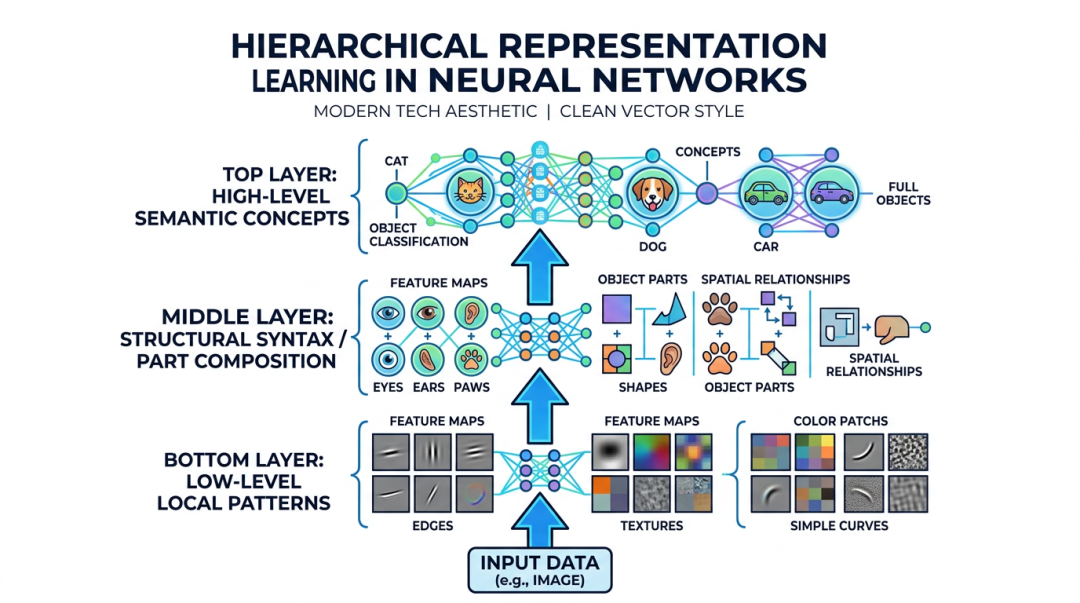

4.1 可以看作全连接图上的消息传递

从图神经网络的角度看,Transformer 可以被理解为:把每个 Token 当作一个节点,在一张动态加权的全连接图上做消息传递。每一层 Attention 都在重新估计“谁应该从谁接收多少信息”。

这个视角有助于解释它为什么灵活:相比 CNN 的局部连接、RNN 的顺序连接,Transformer 对信息流动的结构约束更弱。它不是完全没有归纳偏置,而是采用了一种更软、更可学习的关系建模方式。

4.2 理论表达能力与归纳偏置

从理论上看,Yun et al.(2019)证明了 Transformer 具有通用逼近能力;Pérez et al.(2019)则从另一角度讨论了相关架构的图灵完备性。两者结论不完全相同,但都说明 Transformer 并不是“表达能力受限”的模型族。

不过,通用逼近本身并不能解释它为什么在实践中成功。真正关键的是,Transformer 的归纳偏置处在一个相对平衡的位置:

- 比纯 MLP 更结构化,能够直接建模 Token 间关系

- 比 CNN/RNN 更灵活,不强行限定信息流路径

- 在大规模数据下,往往比强先验模型更容易持续受益

ViT 的经验结果很能说明这个问题:在中等规模图像数据上,纯 Transformer 并不天然优于 CNN;但在更大规模预训练条件下,它的上限会明显提高。这说明弱一些的归纳偏置,在数据和算力足够时反而可能更有扩展空间。

4.3 层次化表示通常会自发出现

很多分析工作发现,Transformer 的不同层往往会呈现一定的层次分工:

- 较浅层更容易保留词法、局部模式和邻近关系;

- 中间层更常编码句法或局部结构信息;

- 较深层更容易承载语义、指代或任务相关抽象。

Tenney et al.(2019)在 BERT 上的 probing 结果显示,不同语言学特征确实会在不同层达到更高可分性。但这里也要保持谨慎:这些结论更多是经验统计规律,而不是一种严格固定的“每层职责分工表”。

本节的要点可以概括成一句话:Transformer 的强项不只是“能看到全局”,而是它能在相对弱约束的前提下,逐层构造出越来越高层的表示。

五、工程优势

Transformer 的成功不仅来自表示能力,也来自它与现代硬件、现代训练系统之间的高度匹配。

上节讨论的是“它有没有足够的表达能力”,这一节讨论的是另一个同样现实的问题:就算有能力,它能不能被高效地训练到足够大。

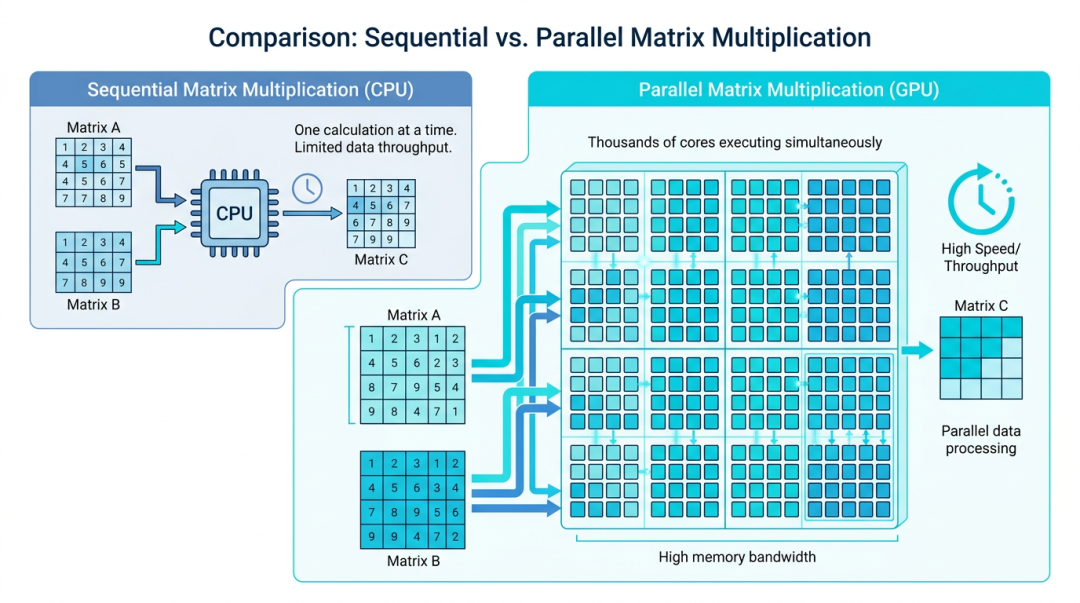

5.1 同层计算高度并行

在训练阶段,序列中所有位置的 Q/K/V 都可以同时算出;注意力矩阵可以用大规模矩阵乘法统一处理;FFN 也是对所有位置并行执行。

与 RNN 的时间步串行计算相比,这种结构显著提高了 GPU/TPU 的利用率。对大模型训练来说,这一点不是附加优势,而是决定可扩展性的核心条件之一。

5.2 核心操作与硬件优化方向一致

Transformer 的主计算由 GEMM、softmax、归一化和逐点算子组成,其中最重的部分是矩阵乘法。现代 GPU、TPU 以及配套的软件栈,本来就对这类计算做了极强优化。

因此,Transformer 不只是“理论上可以并行”,而是“非常适合被现有硬件高效实现”。FlashAttention、张量并行、流水并行、FSDP、量化推理等工程成果,也大多是在这套基本计算图上持续迭代出来的。

5.3 深层训练的稳定性相对可控

残差连接、LayerNorm、成熟的初始化方案、学习率调度和混合精度训练,共同构成了 Transformer 可规模化训练的工程基础。

更准确地说,并不是“只靠残差和 LayerNorm 就能训练大模型”,而是 Transformer 这套结构在引入这些技术后,表现出了比许多替代架构更好的稳定性和可重复扩展性。

也正因为“表示能力”和“工程可扩展性”同时成立,Transformer 才没有停留在论文结果上,而是迅速变成了大模型时代最实际的基础架构候选。

六、模态无关性

Transformer 之所以能跨越多个领域,一个重要原因是它对输入接口的要求非常统一。

前面两节解释了它为什么“能学”和“能训”,本节将再回答一个更宏观的问题:为什么同一套框架还能跨模态复用。

6.1 统一接口:把不同模态转成序列表示

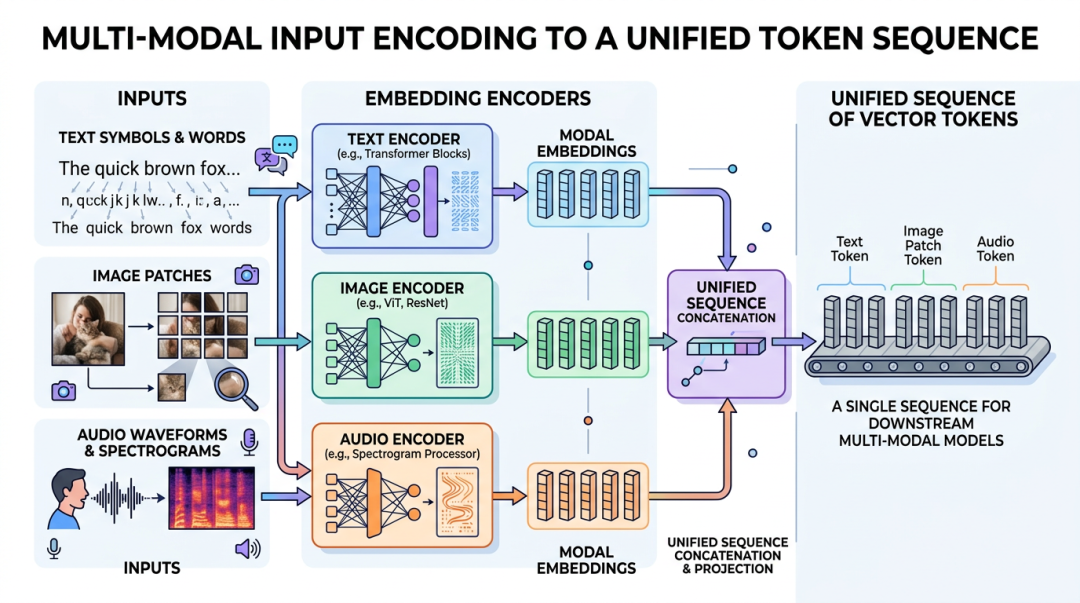

从建模接口看,Transformer 接收的是一串向量表示。不同模态需要先经过各自的前端处理,再映射成这种统一形式。

这里的“序列”更像是一种计算上的组织方式,不一定意味着原始数据天然就是时间序列。图像被切成 Patch 之后会排成一个序列,视频也可以被重写成时空块序列;这只是为了进入统一的计算框架。几个典型例子:

- 文本:先做词或子词切分,再查表得到 Embedding,这本来就是天然的离散序列。

- 图像:ViT 将图像切成固定大小的 Patch,每个 Patch 线性投影成 Token 向量,一张图像于是被改写成 Patch 序列。

- 音频:可以先提取声学特征,再按时间帧编码;也可以直接对波形做分块。不同模型的前端差异很大,但后续常会接入 Transformer 做时序建模。

- 视频:通常把时间和空间一起离散化成若干时空块,再把这些块作为 Token 输入。

- 代码:在大多数实现里,代码仍被当作文本序列处理,只是 Tokenization、上下文长度和训练目标会更贴近编程语言场景。

- 蛋白质与生物序列:氨基酸序列天然是离散符号序列,但像 AlphaFold2 这样的系统并不是“把序列直接丢给标准 Transformer”那么简单,它还引入了 Pair Representation、结构模块等专门设计。这里更准确的说法是:Transformer 风格的注意力机制成为了核心部件之一,而不是完整解决方案的全部。

因此,“只要转成向量序列,Transformer 就能处理”这句话作为抽象层面的描述是成立的;但工程上是否高效、是否最优、是否还需要模态专属先验,仍然要看具体任务。

6.2 多模态不是简单拼接,而是统一建模框架

Transformer 在多模态领域的价值,也不应简单理解成“把不同 Token 拼起来就够了”。更常见的做法是:

- 各模态先用专属编码器得到表示;

- 通过投影层把表示映射到兼容空间;

- 再用拼接、Cross-Attention、Adapter 或 Connector 等方式做交互。

但这里最好再区分两条常见路线:

- 第一类是共享表示空间对齐。以

CLIP为代表,图像编码器和文本编码器分别产生表示,再通过对比学习把语义相近的图文样本拉到一起。这类方法的重要性在于跨模态对齐,而不是 Token 级融合。 - 第二类是条件生成或深度融合。以

Flamingo及后来的视觉语言模型为代表,图像表示会通过 Cross-Attention、Connector 或视觉 Token 注入语言模型,使文本生成过程能够显式读取视觉信息。

Attention 之所以关键,在于它为这两类系统都提供了统一的关系建模语言:有的模型用它做跨模态对齐,有的模型用它做跨模态条件生成。但“多模态统一”并不意味着所有模型都在做同一种融合结构。

6.3 统一架构带来的真正收益

这种接口统一带来几项长期收益:

- 架构复用:很多训练、推理、并行化和压缩工具链可以跨模态共享;

- 研究迁移:注意力优化、位置编码、长上下文技术等改进常能较快迁移到其他领域;

- 系统整合:多模态模型更容易在一个统一框架下协同训练和部署。

因此,Transformer 的“模态无关性”更准确地说是一种统一建模框架能力,而不是“完全不需要模态特定设计”。

这也解释了为什么过去几年许多突破看上去发生在不同领域,底层却常常共享同一套架构语言:一旦某种表示能被改写成 Token 序列,Transformer 及其配套工具链往往就能够接入。

- Scaling Laws

Transformer 能成为大模型时代的主角,除了结构本身,还与一个关键经验规律有关:规模扩大时,性能往往能继续稳定改善。

如果说前面解释的是“为什么 Transformer 是一个好架构”,那么本节讨论的是“为什么它会在大模型时代越做越大,而且越做越值得做”。

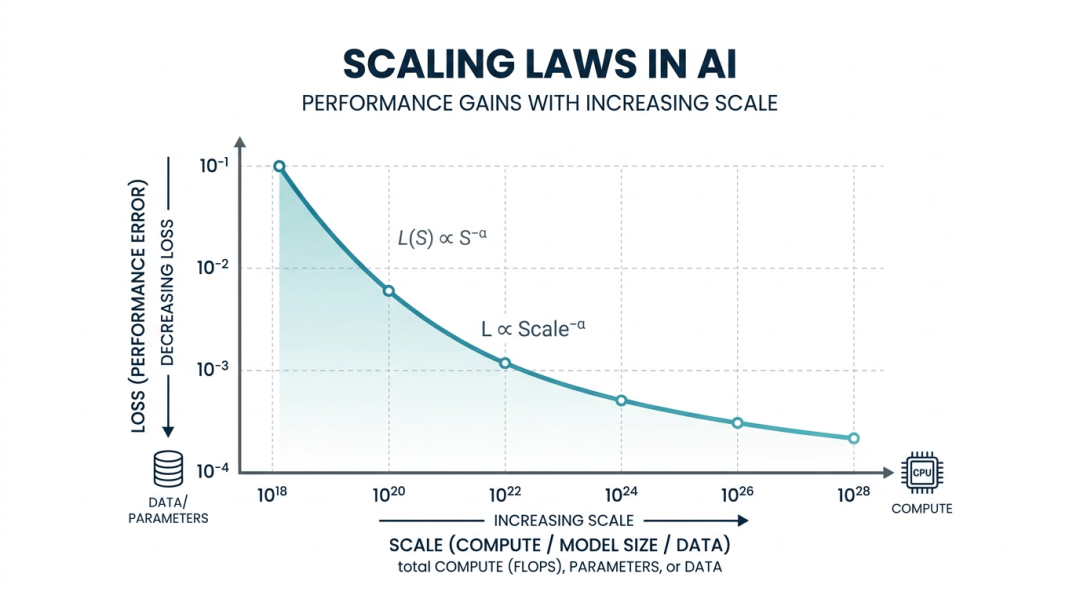

7.1 性能与规模之间的幂律关系

Kaplan et al.(2020)观察到,在一定实验范围内,当模型参数量、数据量和训练计算量分别扩展时,语言模型损失与这些变量之间近似满足幂律关系:

其中 表示参数规模, 表示训练数据量, 表示训练计算量。

这里的“性能”在原始工作里主要指预训练阶段的损失或其对应指标,而不是所有下游任务分数都严格遵守同一条公式。

这里需要注意两点:

- Scaling Law 是经验规律,不是放之四海而皆准的物理定律。它依赖模型族、数据分布、训练目标和优化设置。

- 它表达的也不是“只要无脑增大一切就一定最好”,而是“在较大范围内,性能改进通常是连续、可预测的”。这对工程决策非常重要,因为它让研究者可以在训练前预估不同规模方案的大致收益。

7.2 Chinchilla 对“最优扩展比例”的修正

Kaplan 的早期结论更偏向“在固定算力下,多用参数、少训练一些 Token”。Hoffmann et al.(2022)的 Chinchilla 工作则表明,许多模型处于“参数过大、数据不足”的状态。

Chinchilla 的核心修正是:参数规模与训练数据量需要更均衡地一起扩展。 这一结果后来深刻影响了大模型设计。它并不否定 Scaling Law,而是把“如何扩展”的问题表述得更精确了。

7.3 为什么是 Transformer 更容易吃到规模红利

严格来说,Scaling Law 不是 Transformer 独占的现象;但在现阶段,Transformer 是最稳定、最成熟地把这种规律变成工业现实的架构之一,原因大致有三点:

- 优化稳定:深层训练在工程上相对可控;

- 并行高效:训练大模型时能充分使用集群算力;

- 表示灵活:弱一些的归纳偏置让模型更容易持续从更多数据中获益。

也就是说,Scaling Law 的存在和 Transformer 的胜出是两件相关但不同的事。前者告诉我们“规模可能有用”,后者则告诉我们“哪种架构更适合把规模真的做起来”。

7.4 “涌现”现象需要谨慎表述

随着模型规模增大,研究者观察到某些能力在评测中会出现看似突然的跃升,例如 few-shot 能力、复杂推理能力或代码生成质量的明显改善(Wei et al., 2022)。

不过,“涌现”本身仍有争议。Schaeffer et al.(2023)指出,一些非连续跳变可能来自评测指标的阈值效应,而不一定意味着模型内部真的发生了相变。

因此,更稳妥的表述是:大模型会出现一些在小模型阶段不明显、在更大规模时显著增强的能力,但这些现象的形成机制并未完全厘清。

这一节的核心并不是“规模可以解决一切”,而是:在 Transformer 这类架构上,规模扩展往往确实是一个持续有效、而且可以被工程化管理的方向。

八、局限与演进

Transformer 的主导地位并不意味着它没有明显短板。恰恰相反,过去几年的很多研究,都是围绕这些短板展开的。

把问题讲清楚同样重要,因为如果只讲优势,读者很容易得出一个错误印象:Transformer 好像已经彻底解决了序列建模问题。事实并非如此。

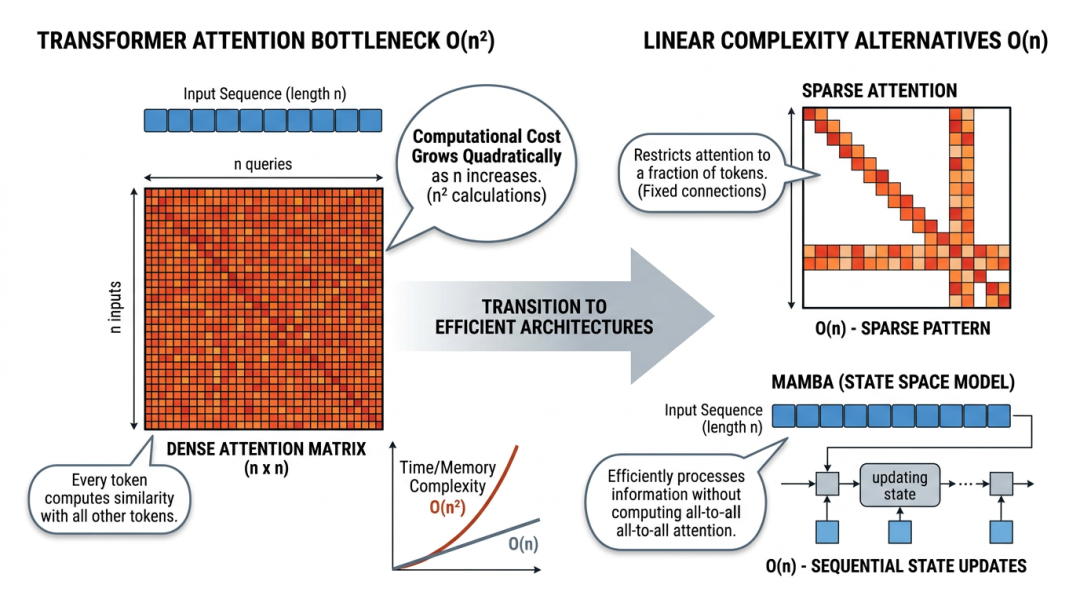

8.1 二次复杂度

标准 Self-Attention 的时间复杂度约为 ,显存开销通常也随 增长。序列一长,代价会迅速变高。

这在长文档、长上下文代码、高分辨率视觉和长视频任务里都很突出,尤其是在训练阶段和推理中的 prefill 阶段更明显。

主要改进方向包括:

- 稀疏注意力:只计算局部窗口、全局 token 或若干特定模式;

- 线性注意力:通过核技巧或状态重写降低复杂度;

- 更高效的 Exact Attention 实现:例如 FlashAttention 通过 IO 优化显著降低实际开销,但不改变标准注意力的数学结果。

8.2 自回归生成的串行瓶颈

GPT 类模型在推理时必须逐 token 生成。KV Cache 可以避免对历史上下文的重复计算,但它不能打破“当前 token 依赖前面 token”的因果顺序。

因此,推理延迟仍会随生成长度线性增长,而长上下文下的 KV Cache 显存消耗也会成为瓶颈。

常见缓解方向包括:

- 推测解码:小模型先生成草稿,大模型再并行验证;

- 并行或半并行解码:尝试一次生成多个 token 或多个候选分支;

- 更紧凑的状态表示:减少缓存体积或降低访存代价。

8.3 样本效率并不总占优

Transformer 的归纳偏置较弱,这让它在大数据环境下很有扩展性,但在小数据、强结构先验场景下不一定占优。视觉里 CNN 的卷积先验、某些科学计算任务里的显式结构约束,依然可能更有效。

所以“Transformer 通吃一切”并不准确。它更像是在大规模预训练范式下,展现出最强综合竞争力。

8.4 可解释性仍然有限

Attention 权重很直观,但不能简单等价为“模型认为哪里最重要”。Jain & Wallace(2019)已经指出,高注意力权重并不必然意味着高因果贡献。

现在关于 Transformer 的解释性研究,主要包括 probing、attention rollout、特征归因、mechanistic interpretability 等方向。它们已经提供了很多有启发性的发现,但距离形成统一、可靠、可操作的解释框架还有不小距离。

8.5 位置外推仍是开放问题

即使 RoPE、ALiBi 以及后续针对长上下文的缩放方法改善了长上下文表现,模型在超出训练长度很多倍时的稳定泛化仍然不是彻底解决的问题。

更细一点说,这里至少有两个层面的问题:

- 位置编码方案本身 是否允许模型表示更长的位置范围;

- 模型是否真的学会 在更长上下文中稳定利用这些位置信息。

这说明位置建模虽然不是 Transformer 最耀眼的部分,却持续影响着长上下文能力的上限。

8.6 新架构为什么不断出现

正因为上述问题长期存在,近年才会出现一些试图替代或补充 Transformer 的路线。最有代表性的一类是状态空间模型(SSM),如 Mamba,它希望用递推状态更新替代显式全局注意力,从而在长序列推理时获得更好的时间和内存效率。

此外,也有一些混合式路线尝试在“并行训练便利”和“递推推理高效”之间寻找折中。它们共同说明的一点是:研究界并没有把 Transformer 视为最终答案,而是在持续追问一个更本质的问题:能否在不牺牲表达能力的前提下,把长序列效率和推理成本进一步降下来。

这些新路线目前还没有全面取代 Transformer,但它们提醒我们:Transformer 的领先地位是现实结果,不是理论终点。

所以这一节真正想表达的不是“Transformer 有很多缺点”,而是:它之所以仍然值得研究,恰恰是因为它已经足够成功,成功到它的每一个短板都会变成下一波研究的出发点。

结语:抓住大模型时代的职业机遇

AI大模型的发展不是“替代人类”,而是“重塑职业价值”——它淘汰的是重复性、低附加值的工作,却催生了更多需要“技术+业务”交叉能力的高端岗位。对于求职者而言,想要在这波浪潮中立足,不仅需要掌握Python、TensorFlow/PyTorch等技术工具,更要深入理解目标行业的业务逻辑(如金融的风险控制、医疗的临床需求),成为“懂技术、懂业务”的复合型人才。

无论是技术研发岗(如算法工程师、研究员),还是业务落地岗(如产品经理、应用工程师),大模型都为不同背景的职场人提供了广阔的发展空间。只要保持学习热情,紧跟技术趋势,就能在AI大模型时代找到属于自己的职业新蓝海。

最近两年大模型发展很迅速,在理论研究方面得到很大的拓展,基础模型的能力也取得重大突破,大模型现在正在积极探索落地的方向,如果与各行各业结合起来是未来落地的一个重大研究方向

大模型应用工程师年包50w+属于中等水平,如果想要入门大模型,那现在正是最佳时机

2025年Agent的元年,2026年将会百花齐放,相应的应用将覆盖文本,视频,语音,图像等全模态

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

给大家推荐一个大模型应用学习路线

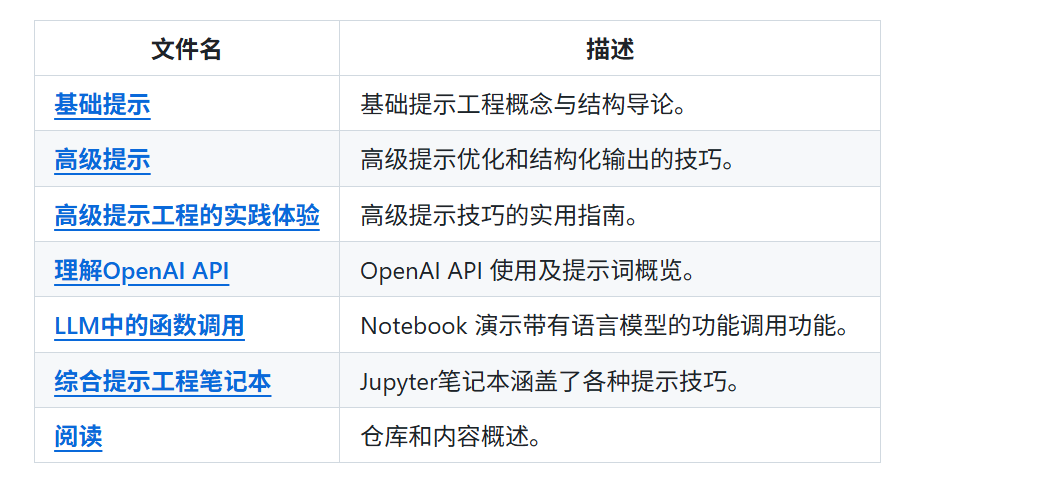

这个学习路线的具体内容如下:

第一节:提示词工程

提示词是用于与AI模型沟通交流的,这一部分主要介绍基本概念和相应的实践,高级的提示词工程来实现模型最佳效果,以现实案例为基础进行案例讲解,在企业中除了微调之外,最喜欢的就是用提示词工程技术来实现模型性能的提升

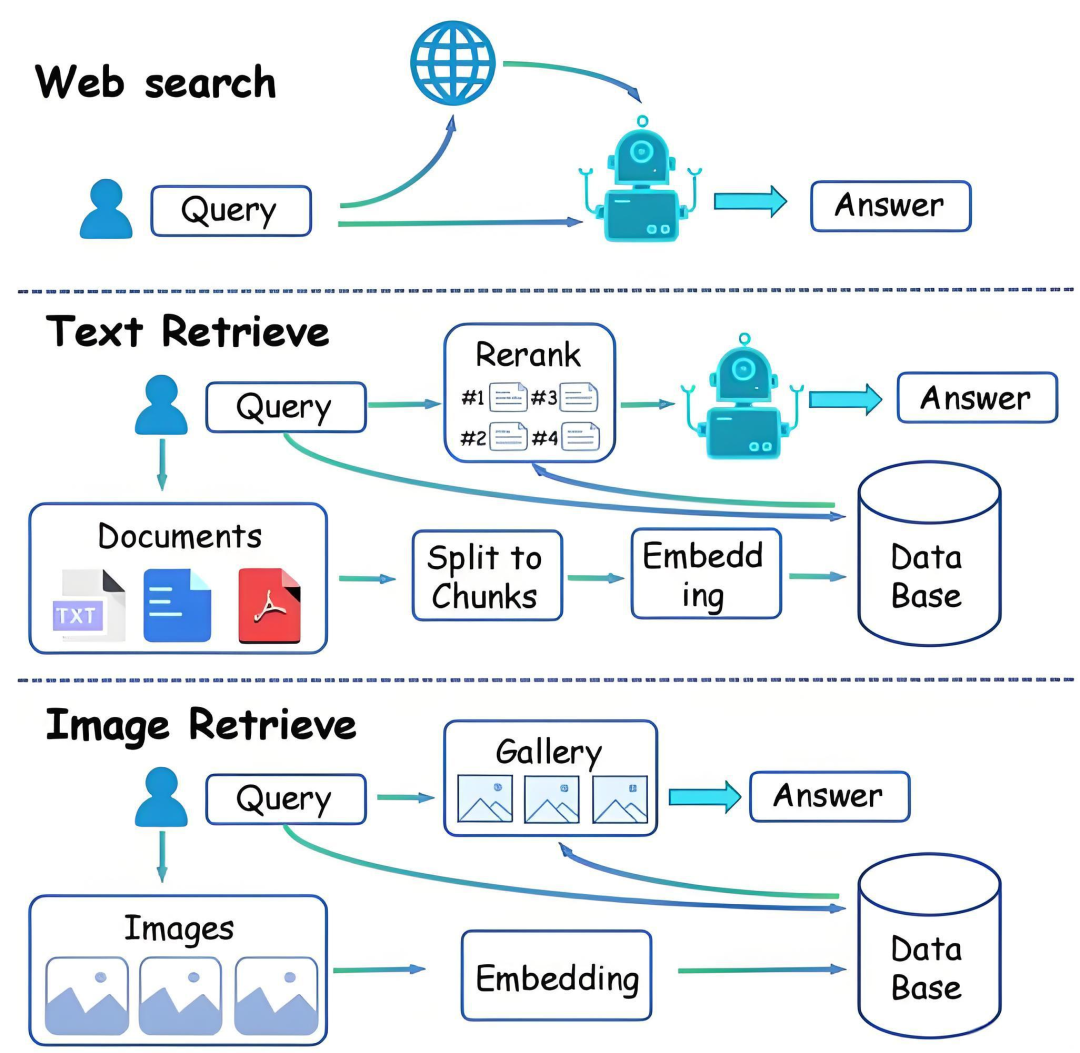

第二节:检索增强生成(RAG)

可能大家经常会看见RAG这个名词,这个就是将向量数据库与大模型结合的技术,通过外部知识来增强改进提升大模型的回答结果,这一部分主要介绍RAG架构与组件,从零开始搭建RAG系统,生成部署RAG,性能优化等

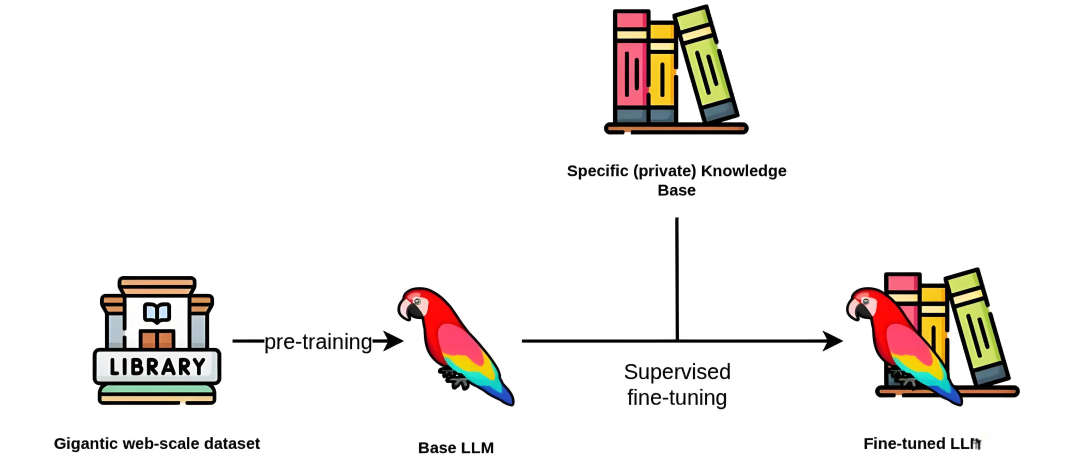

第三节:微调

预训练之后的模型想要在具体任务上进行适配,那就需要通过微调来提升模型的性能,能满足定制化的需求,这一部分主要介绍微调的基础,模型适配技术,最佳实践的案例,以及资源优化等内容

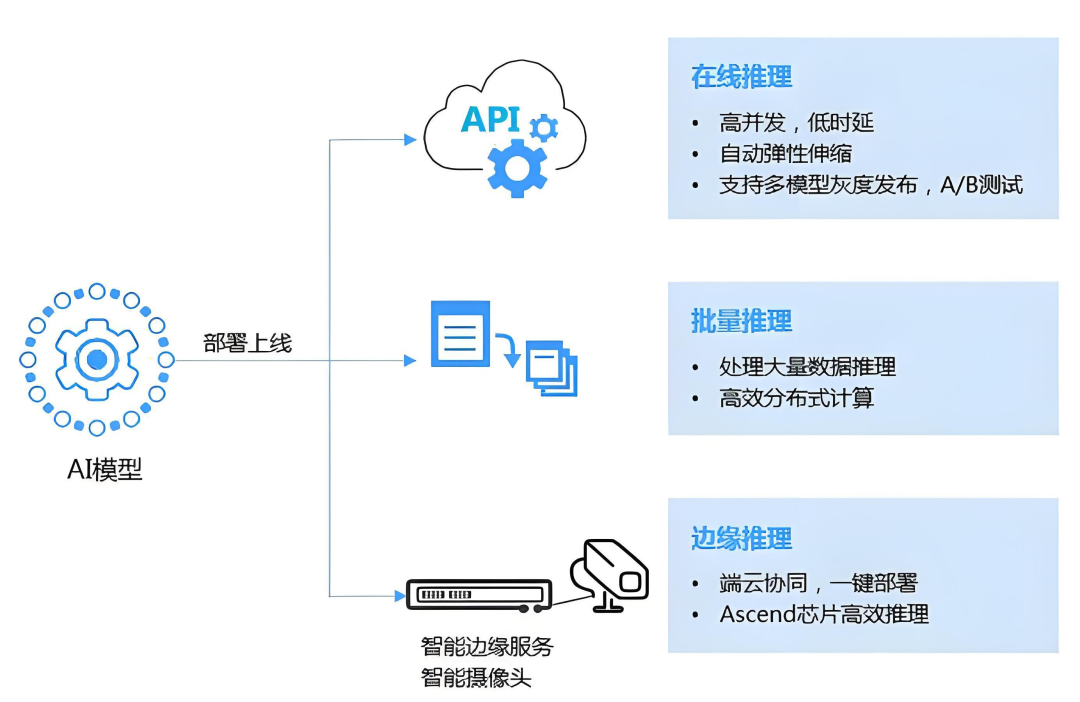

第四节:模型部署

想要把预训练或者微调之后的模型应用于生产实践,那就需要部署,模型部署分为云端部署和本地部署,部署的过程中需要考虑硬件支持,服务器性能,以及对性能进行优化,使用过程中的监控维护等

第五节:人工智能系统和项目

这一部分主要介绍自主人工智能系统,包括代理框架,决策框架,多智能体系统,以及实际应用,然后通过实践项目应用前面学习到的知识,包括端到端的实现,行业相关情景等

学完上面的大模型应用技术,就可以去做一些开源的项目,大模型领域现在非常注重项目的落地,后续可以学习一些Agent框架等内容

上面的资料做了一些整理,有需要的同学可以下方添加二维码获取(仅供学习使用)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献134条内容

已为社区贡献134条内容

所有评论(0)