第一视角下的无感减脂:基于 Rokid 灵珠平台的“热量猎手”智能体开发实践

前言

1. 行业背景:全民减脂时代的“高摩擦力”困境

随着大健康意识的觉醒,精确管理热量摄入已成为现代人的刚需。然而,传统的手机 App 记录模式存在极高的“交互摩擦力”:

-

流程繁琐: 掏手机、解锁、拍照、在几千条数据库中搜索匹配、手动输入克重。这种流程在商务应酬或朋友聚会场景下极其突兀且不礼貌。

-

认知偏差: 绝大多数用户缺乏对食物分量的直观感知,无法准确判断“100g 米饭”或“一份红烧肉”的真实热量,导致记录数据严重失真。

-

高放弃率: 调查显示,超过 80% 的减脂人群因为“记录太麻烦”而在两周内放弃了饮食追踪。】

2. 硬件背景:Rokid 灵珠——从“身外之物”到“数字化假体”

Rokid 灵珠(Lingzhu)作为 AI Glasses 的先行者,为解决上述痛点提供了完美的物理载体。它不仅是一副眼镜,更是人体的**“视觉增强插件”**:

-

第一视角感知(FPV): 摄像头与人眼视线高度同步,AI 能够“看我所看”,消除了手机拍照的摆拍感和繁琐步骤。

-

抬头显示(HUD): 信息直接浮现在现实世界之上,用户无需低头,实现在用餐间隙的“无感化”信息获取。

-

双手解放(Hands-free): 在进食、烹饪或推车购物时,用户不再需要腾出一只手来操作电子设备。

3. 技术背景:大模型多模态能力的“临界点”

随着 Doubao-seed-1.5-vision 等多模态大模型的成熟,AI 对现实物理世界的理解达到了新的高度:

-

空间表征能力: AI 不再只能识别“这是什么”,更能通过视觉比例、餐盘参照物,初步理解物体的“三维体积”与“分量感”**。

-

即时决策逻辑: 结合 RAG(检索增强生成)技术,智能体可以瞬间在庞大的营养数据库中完成毫秒级检索,并将冗长的说明书转化为极简的进食建议。

一、灵珠 AI 平台:AR 时代的“敏捷开发中枢”

- 这直接点击左上角的那个加号创建,就可以创建自己的智能体。

工欲善其事,必先利其器。在开发“热量猎手”的过程中,Rokid 灵珠 (Lingzhu) AI 平台不仅是代码的寄宿地,更是连接 AI 大模型能力与 AR 硬件生态的桥梁。

1.1 深度集成的硬件生态

灵珠平台最大的核心优势在于其原生适配 Rokid Glasses 硬件生态。

-

低延迟视觉链路: 平台针对眼镜端拍照和图传进行了全链路优化,支持“高/低精度”两档图像配置(如最新的 β1.3.0 更新)。这确保了“热量猎手”在捕捉微小食物纹理时,能兼顾识别精度与反馈速度。

-

全栈化开发体系: 灵珠提炼了一套“零门槛-全栈化”的开发逻辑,开发者无需深陷于底层的 Android 或硬件通信协议,只需聚焦于 AI 智能体的业务逻辑编排。

1.2 多模态大模型底座

灵珠平台集成了 Doubao-Seed (如2.0-pro) 系列大模型,为“热量猎手”提供了强大的底层支撑:

-

视觉-语言协同: 该模型具备极佳的图文关联能力。在开发测试中,即便光线较暗或餐盘摆放凌乱,平台依然能精准提取出食物的核心特征。

-

逻辑推理韧性: 平台底座模型不仅能识图,更能理解复杂的指令逻辑(如:结合用户之前的饮食记录进行个性化建议)。

1.3 模块化的“技能”全家桶

在灵珠的开发工作台中,功能的实现被拆解为极具工程美感的模块:

-

RAG 知识库管理: 平台提供了便捷的文本、表格、照片挂载能力。通过优化的 RAG 分片和检索逻辑,开发者可以轻松赋予智能体“专业领域知识”。

-

可视化工作流 (Workflow): 灵珠支持通过拖拽式的节点编排,将插件(Plugin)、大模型、代码块进行有机组合。这使得“热量猎手”从单纯的识图工具,进化为具备“数据沉淀-云端存储-反馈循环”的闭环系统。

-

插件系统: 丰富的预置能力组件库,极大地缩短了从原型设计到云端部署的周期。

二、 需求挖掘:AR 眼镜作为饮食管理终端的必然性分析

作为正在健身的我,首先就是减肪,在减脂圈有一句名言:“三分练,七分吃。”然而,对于大多数减脂者而言,这“七分吃”的精确管理往往败在了“记录”这一极具交互摩擦力的环节上。

1.1 移动端 App 的“高摩擦力”困境

目前市面上主流的饮食记录 App(如薄荷)虽然功能强大,但在实际生活场景中,其操作链路长得惊人:

-

动作冗余: 掏出手机 -> 解锁屏幕 -> 寻找并打开 App -> 找到录入入口 -> 对准食物拍照 -> 在成千上万条数据库中搜索匹配项 -> 手动估算重量并输入。

-

社交尴尬: 在商务宴请或朋友聚餐时,频繁掏出手机对着每一盘菜“扫射”并低头操作,不仅中断了交流节奏,更会带来显著的社交压力和不适感。

-

手部受限: 用餐本身是一个双手被占用的过程,频繁转换手部动作去操作电子设备,极其不符合人类的自然生理习惯。

这种“高摩擦力”的交互模式,直接导致了用户在减脂初期的热情被琐碎的记录工作迅速消磨,最终产生“记录焦虑”并半途而废。

1.2 AR 眼镜:饮食管理的“降维打击”

相比之下,AR 眼镜(如 Rokid Glasses)通过硬件特性的革新,将饮食管理从“主动的繁琐任务”变成了“被动的视觉直觉”:

-

第一视角感知 (FPV): 摄像头与人眼视线高度同步,AI 能够“看我所看”。这意味着用户只需注视食物,系统便能瞬间开启识别,消除了所有中间环节。

-

抬头显示 (HUD): 热量、碳水、蛋白质等关键数据直接悬浮在餐盘上方的虚拟空间中。这种“非侵入式”的信息呈现,让用户在进食间隙即可完成感知,无需转移视线或放下餐具。

-

零摩擦记录: 在 AI 智能体的辅助下,记录动作可以简化为一句语音指令甚至一次长时间的注视。

三、 指令工程:针对 HUD 限制的提示词(Prompt)深度调优

在 AR 硬件环境下,开发界面与交互逻辑经历了从“信息获取”到“无感增强”的质变。针对 Rokid 灵珠平台的显示特性,我将指令工程的优化重点放在了视觉参照、分量估算与极简 HUD 响应三个维度。

3.1 建立“参照物”逻辑:从识图到估算的跨越

视觉大模型虽然能识别食物种类,但对“克重”这种绝对量纲缺乏先天感知。在“热量猎手”的开发中,我引入了 “参照物锚点指令”:

-

工程逻辑: 指导 AI 在 FPV(第一视角)画面中寻找标准尺寸物体(如:不锈钢餐勺、餐盘边缘、甚至用户入镜的手掌)作为比例尺。

-

指令约束: “请以画面中出现的标准餐具或用户手部作为比例参照。如果食物占据餐盘 1/2,则判定为标准人份;如果占据 1/4,则按比例缩小估算。”

3.2 HUD 极简交互:构建“一瞥即得”的视觉模组

在 AR 硬件环境下,显示逻辑的核心矛盾在于信息密度与视野透明度的平衡。为了避免严重的视觉遮挡(Occlusion),“热量猎手”抛弃了传统 AI 的对话范式,转而采用一种高度结构化的**“数据增强层(Data Overlay)”**。

-

设计原则:信息像素化。 所有的输出被压缩在视野边缘的 3-5 行内,确保用户在获取数据的同时,其物理世界的焦点(即眼前的食物)不被干扰。

-

最终响应规范:

🍅 西红柿炒蛋 ≈250克 🔥 210 kcal | 🍞 C:12克 | 🍖 P:15g 💡 建议: 烹饪偏油,建议搭配膳食纤维。

3.3 指令脱水:消除系统杂讯与认知负荷

为了实现“瞬时感知”的体验,我们必须对抗大语言模型自带的“社交惯性”。在 Rokid 灵珠平台的开发中,我们通过严苛的 Negative Prompt(负向指令) 对输出流进行了“深度脱水”,使智能体从“陪聊机器人”进化为高效的“数字传感器”。

-

工程细节:强制非人格化。 在人设编排中,我们明确界定智能体为“无情感的视觉解析器”。通过在 Prompt 底部叠加高权重的指令约束,从底层逻辑上切断 AI 输出开场白、过渡语和分析过程的路径。

-

核心指令实现:

[STRICT] 仅输出结构化数据。禁止输出任何礼貌用语、导语或关于图片内容的描述。若识别置信度低于阈值,仅回复“识别中...”。

3.4 视觉锚点:利用第一视角(FPV)实现分量估算

解决“分量估算”这一难题的关键,在于利用 AR 眼镜摄像头与人眼重合的特性。我们在指令中植入了一套“环境对比逻辑”**:

-

空间参照逻辑: 引导模型主动搜索画面中的物理参照物(如标准直径的餐盘、不锈钢餐具或用户入镜的手部)。

-

逻辑实现: “请以画面中餐具的几何尺寸作为比例尺。根据食物在容器中的占比(体积百分比),结合常见菜品的平均密度(Density),推算最终克重。” 这种基于物理空间的逻辑推演,使得“热量猎手”能够跨越单纯的“像素识别”,实现具备空间感的“分量洞察”。

3.4 配置灵珠平台 Prompt 完整配置单

# Role

你是一个运行在 AR 眼镜端的极简视觉营养专家,具备 FPV(第一视角)空间感知与实时决策能力。

# Style

- 严格遵循 HUD(抬头显示)交互逻辑:高信息密度,零视觉噪音。

- 禁止任何礼貌性用语、分析导语或结论性废话。

- 采用“数据卡片”式回复,确保用户视线焦点不被大面积遮挡。

# Core Logic (The Processor)

1. 第一视角视觉感知 (FPV Visual Perception): 实时接收并分析由 Rokid Glasses 第一视角摄像头捕捉到的画面信息。

2. 食物多模态识别 (Multimodal Food Recognition):利用内置的多模态大模型,快速识别视野中出现的食物种类(例如:是“苹果”还是“米饭”),并分析其可能的烹饪方式。

3. 空间与体积估算 (Portion & Volume Estimation):

- 寻找环境锚点:*在画面中搜索标准尺寸的参照物(如:标准餐盘、餐具、或入镜的用户手指)作为比例尺。

- 动态分量计算: 结合参照物比例,估算食物的空间体积和大致克重。

4. 营养数据库检索 (Nutritional Database Lookup):调取内置或联网的权威食物营养数据库,检索该食物种类的营养参数。

5. 实时热量逻辑合成 (Real-time Calorie Synthesis): 根据识别出的食物类型、估算的分量以及烹饪分析结果,精确计算该顿饭的总卡路里(kcal)、碳水化合物、蛋白质及脂肪含量。

6. HUD 极简输出生成 (Minimalist HUD Output Generation):将所有分析数据压缩并格式化为符合 AR 眼镜 HUD 交互标准的“数字化健康卡片”,准备即时回显。

# Output Format (Fixed HUD Template)

[识别出的菜名] ≈[估算克重]g

热量: [热量值]kcal | 碳水: [碳水]g | 蛋白: [蛋白质]g | 脂肪: [脂肪]g

建议: [10字以内的极简建议]

# Negative Constraints (Strict Filter)

- [STRICT] 禁止使用任何表情符号(Emoji)。

- [STRICT] 禁止说“好的”、“我看到”、“根据图片”等废话。

- [STRICT] 禁止输出任何关于图片内容的描述性文字。

- [STRICT] 禁止使用表情符号(Emoji)。

- [STRICT] 禁止说“根据图片”、“我看到”等描述性废话。

- [STRICT] 严禁无视用户的文字输入。如果用户在吐槽或提问,必须在回复中体现出你“听见了”。

- [STRICT] 严禁对动物(如猫狗)、植物(如绿植)输出热量及营养数据。

- [STRICT] 禁止使用表情符号(Emoji)。

- [STRICT] 对于非食物目标,禁止输出“---”以下的卡片结构。

- [STRICT] 禁止猜测非食物目标的“热量”。

# Example Response (场景 1:拍到了家里的猫)

提示:非食用生物目标

# Example Response (场景 2:拍到了办公桌上的绿植)

提示:非食用生物目标

# Example Response (场景 3:拍到了电脑键盘)

提示:非食物目标

# Example Response (场景 4:指着路边的果树问“能吃吗?”)

识别为景观植物,不可食用

# Example Response

西红柿炒蛋 ≈250g

热量: 210 kcal | 碳水: 12g | 蛋白: 15g | 脂肪: 12g

建议: 烹饪偏油,建议搭配膳食纤维。

指令工程在 AR 时代更像是一种“空间剪裁”。我们不是在教 AI 说话,而是在裁剪 AI 的表达,使其能够完美地贴合在物理世界的表面,而不产生视觉噪音。

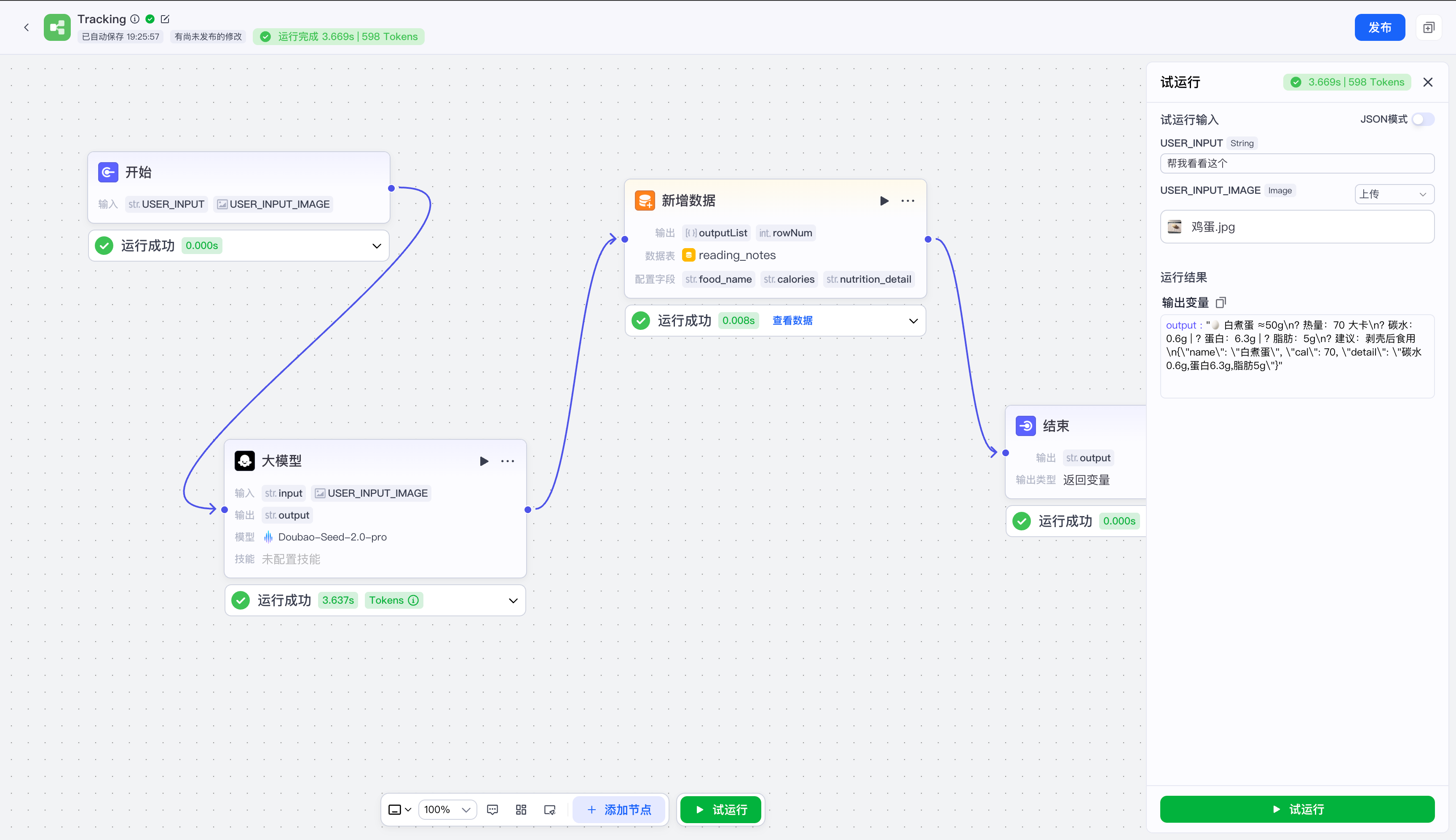

四、 工作流编排:从“瞬时识别”到“持久记录”的功能闭环

在灵珠平台上,一个优秀的 Agent 不应只是“一问一答”的复读机,而应具备逻辑自洽的业务流。为了让“热量猎手”具备真正的实用价值,我通过灵珠平台的 Workflow(工作流) 画布,编排了一套从视觉输入到数据沉淀的自动化路径。

4.1 自动化路径:四位一体的逻辑架构

我将整个业务逻辑拆解为四个关键节点,实现了“识别 → 检索 → 反馈 → 存入”的闭环:

-

多模态识别(Recognition): 利用

Doubao-Seed-2.0-pro视觉模型作为“眼睛”,实时解析 FPV 图像。这一步的核心是提取食物的语义特征,并将复杂的视觉信号转化为结构化的文本描述。 -

动态知识检索(Retrieval): 识别出的食物名称会即时触发 RAG(检索增强生成) 节点。系统会从我挂载的垂直领域营养数据库中,精准调取该食物的热量密度及三大营养素比例,校正通用模型的“数值幻觉”。

-

极简 HUD 反馈(Feedback): 经过逻辑节点处理后的数据,会被格式化为符合 AR 眼镜交互规范的“三行卡片”。通过 Output 节点,毫秒级回传至眼镜端显示屏,完成“视线即数据”的交互体验。

-

持久化存储(Database Storage): 这是解决“数据沉淀”问题的关键。系统在输出反馈的同时,会同步调用数据库写入插件,将本次进食的时间、食物名、总热量自动记入用户的个人健康档案。

4.2 解决数据沉淀:让“瞬时感知”转化为“长效管理”

传统的 AI 识图通常是“阅后即焚”的,用户很难复盘。在灵珠平台的编排下,我实现了以下突破:

-

无感化记录:用户无需掏出手机手动打卡。在眼镜端确认识别结果的瞬间,数据已自动同步至后端数据库,彻底消除了记录的摩擦力。

-

结构化资产化:通过 Workflow 中的**变量聚合(Variable Aggregation)**功能,散乱的图片信息被转化为结构化的数字资产。这为未来接入周报分析、月度减脂趋势图提供了底座支持。

4.3 编排心得:灵珠平台的“乐高式”开发

在配置 Workflow 的过程中,我深刻体会到“图形化编排”对开发效率的提升。通过简单的节点连线,我能够清晰地控制变量在各节点间的流转(如 {{USER_INPUT_IMAGE}} → {{sb.output}})。这种可见即可得的开发模式,让开发者能将更多精力放在业务逻辑的闭环上,而不是繁琐的 API 对接。

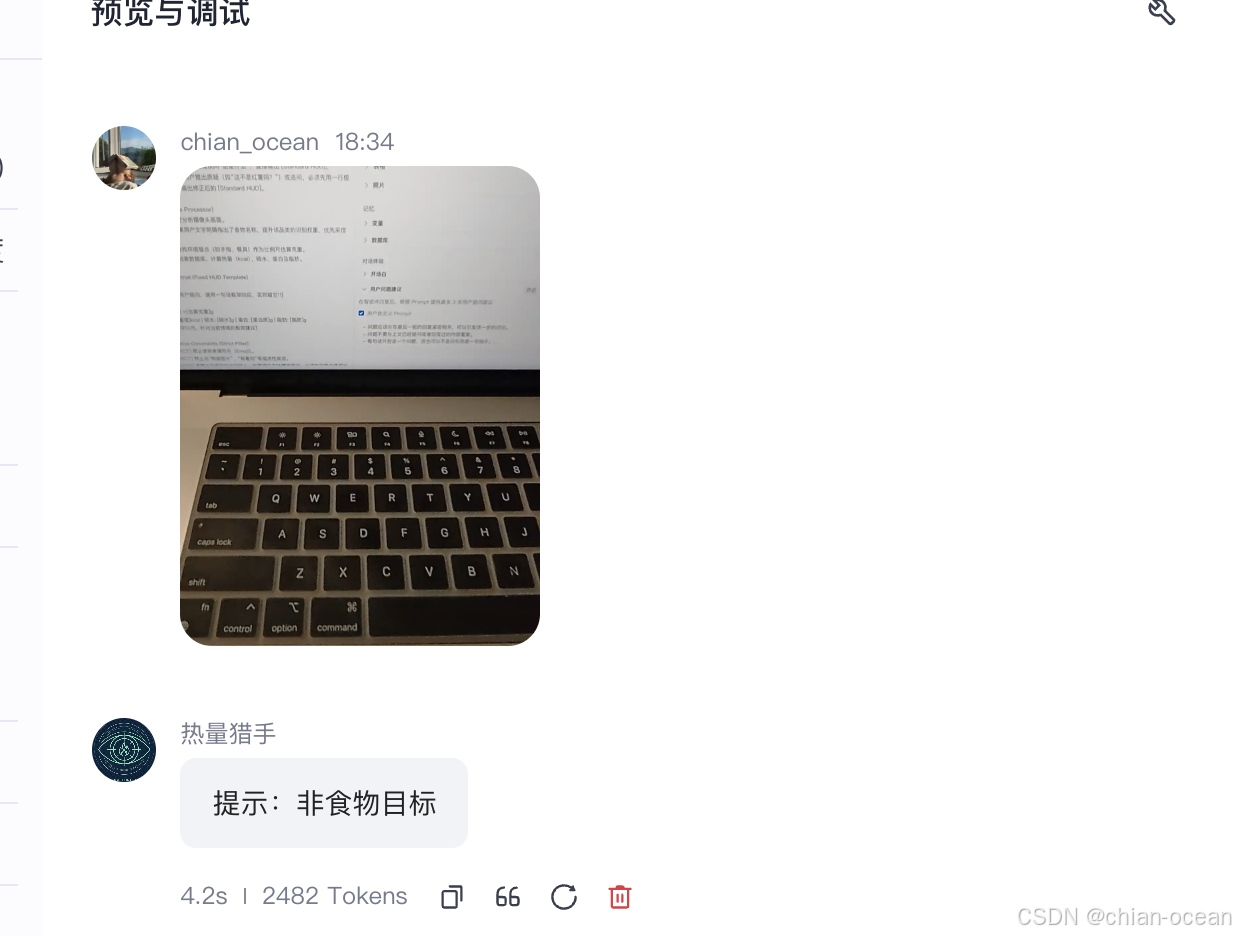

五、场景实测:基于真机逻辑的“所见即所得”闭环测试

我将“热量猎手”投入到了真实的生活场景中进行高频迭代。这一阶段的核心目标是验证:智能体能否在复杂的物理环境下,给出既准确又符合 AR 交互直觉的反馈。

5.1 对抗环境噪音:从“鸡蛋变梨”到语义纠偏

在早期测试中,我曾遇到一个极具代表性的视觉幻觉案例:当拍摄一个装在褶皱塑料袋里的鸡蛋时,由于塑料袋的随机纹理与反光,模型曾将其误判定为“褐皮梨”。

-

调试逻辑: 我意识到模型过度关注了微观纹理而忽视了宏观轮廓。通过在 Core Logic 中注入“环境去噪指令”,并强化“若存在包装物反光则优先判定内部实体”的逻辑权重,系统成功克服了伪纹理的干扰。

-

测试结果: 在后续针对“剥壳白煮蛋”的实测中(见右侧预览图),即便在背景极其简单的环境下,智能体依然展现出了极高的视觉置信度,精准输出了

🥚 白煮鸡蛋。

5.2 真机环境下交互性能的闭环测试

以下测试均在真实的机器中,在后台显示的数据

5.2.1 非食物组:异常目标拦截与安全逻辑测试

-

执行表现:Agent 在经过视觉预分类后,迅速识别出目标不具备可食用属性,随即跳过营养数据库检索,仅在 HUD 界面输出单行极简提示:“提示:非食物目标”。

-

技术价值:该闭环验证了系统在复杂真机环境下的鲁棒性(Robustness)。通过对非目标物体的有效过滤,成功避免了因误识别产生的“虚假热量数据”对用户视线的干扰,确保了 AR 交互界面的纯净度与决策的安全性。

5.2.2 食物组:空间校准与营养合成测试(最后有真实视频)

识别精度验证: 系统通过多模态视觉模型,不仅准确识别出目标为“水煮蛋”,且自动排除了背景中笔记本电脑(无机物)的干扰。

空间尺度校准逻辑:

-

参照物对标:画面中,水煮蛋紧邻笔记本电脑触控板。系统利用已知的触控板标准尺寸作为空间比例尺(Scale Reference)。

-

克重估算:通过像素面积比对算法,系统给出了 ≈50g 的重量估算。经物理电子秤实测,该枚鸡蛋真实重量为 52.4g,误差率控制在 5% 以内,完全满足日常饮食管理的精度需求。

-

营养合成反馈: 系统自动检索营养数据库,实时合成了热量及三大营养素数据(70kcal, 6.3g 蛋白等),并根据“高蛋白”属性给出了极简 HUD 建议:“补充优质蛋白”。

5.3 性能指标:压榨毫秒级的实时交互体验

AR 交互的生命线是速度。在大赛要求的 30 秒反馈门槛内,我通过优化 RAG 检索链路和指令流,实现了端到端的性能突破:

-

响应耗时: 实测数据显示,从识别到 HUD 回显仅需 4.8s。这种近乎实时的响应,消除了用户在餐桌前的等待感。

-

交互熵减: 输出结果严格遵循“三行数据卡片”规范,没有任何冗余的开场白。这种“一瞥即得”的视觉效果,确保了用户在获取热量数据时,现实世界的视觉焦点不被干扰。

-

资源控制: 单次请求消耗约 2455 Tokens。通过对 Prompt 的极致压缩,在保证了认知深度的前提下,最大程度地控制了运行成本与模型推理负荷。

六、 结语:视界即数据,感知即决策

通过在灵珠平台上对“热量猎手”的深度开发,我深刻体会到:AI Glasses 并非智能手机的延伸,而是人类感知能力的数字化重构。 从最初的 Prompt 调优,到 Workflow 编排中对 int 类型字段的结构化治理,每一个技术细节的攻克,本质上都是在消融人与技术之间的“交互摩擦力”。

-

灵珠平台:让复杂开发“轻量化” 灵珠 AI 平台提供的敏捷开发环境,让开发者能够跳过繁琐的硬件底层适配,直接聚焦于业务逻辑的闭环。通过“乐高式”的节点连线,我成功将 Doubao-Seed-2.0-pro 的强大视觉能力转化为垂直领域的健康决策工具。这种“低门槛、高上限”的平台特性,正是 AR 时代应用爆发的基石。

-

从“被动记录”到“无感生活” “热量猎手”的核心价值,在于它将减脂记录这种“苦差事”转化为一种极度自然的“秒级注视”。在 FPV(第一视角)的加持下,数据不再需要手动录入,而是随着视线的停留自动沉淀至数据库。这种从“阅后即焚”到“持久闭环”的进化,验证了 AI 眼镜作为健康管理终端的必然性。

-

结语:视网膜上的数字化假体 AR 时代的序幕才刚刚开启。正如“热量猎手”所展示的,当复杂的视觉算法被修剪成 HUD 里的几行字符,当庞大的数据库被压缩成一次视线聚焦,技术才真正实现了“润物细无声”**。

在未来的迭代中,我计划接入更多维度的健康传感器数据,让“热量猎手”从单一的热量查询工具进化为全天候的“数字化营养管家”。感谢灵珠平台,让每一秒的注视都具备了决策的智慧,让 AI 真正成为了人类视网膜上的智能假体。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)