【2026】基于计算机视觉的AI驱动足球分析

AI Driven Soccer Analysis Using Computer Vision

论文基本信息

| 项目 | 内容 |

|---|---|

| 英文论文名 | AI Driven Soccer Analysis Using Computer Vision |

| 中文论文名 | 基于计算机视觉的AI驱动足球分析 |

| 论文链接 | https://arxiv.org/abs/2604.08722 |

| 作者 | Adrian Manchado, Tanner Cellio, Jonathan Keane, Yiyang Wang |

| 机构 | Milwaukee School of Engineering, Department of Computer Science and Software Engineering |

| 发表时间 | 2026年4月9日 |

| 研究领域 | Computer Vision, Sports Analytics, Object Detection, Image Segmentation |

摘要分析

本文提出了一种基于计算机视觉的足球比赛分析系统,旨在从原始视频 footage 中自动提取球员的二维场地表示。系统结合了多种先进的深度学习模型,包括:

核心方法概述

-

目标检测与跟踪:使用 YOLO 和 Faster R-CNN 进行球员检测,配合 SAM2(Segment Anything Model 2)进行像素级分割和长期跟踪

-

关键点检测:训练自定义 CNN 模型识别足球场地的关键特征点(如罚球弧、中圈、 midfield 线交点等)

-

单应性变换:通过直接线性变换(DLT)算法估计单应性矩阵,将摄像机视角转换为俯视图

-

团队分类:采用 K-Means 聚类算法根据球员球衣颜色自动分类为两个球队

应用价值

系统可将转换后的真实世界坐标用于计算球员速度、跑动距离、位置热力图等战术洞察,为教练和球员提供此前标准视频分析无法获得的可操作性能数据。

研究现状

1. 目标检测与跟踪技术

SAM2(Segment Anything Model 2)

SAM2 是具有流式内存的 Transformer 架构,专为实时视频处理设计。其核心创新在于使用记忆注意力机制存储和利用跨帧上下文信息,有效解决遮挡、光照变化和时序一致性等挑战,非常适合体育分析中的长期跟踪任务。

YOLO 系列

YOLO 将目标检测重新定义为单阶段回归问题,直接预测边界框和类别概率,实现实时检测:

- YOLOv5:使用 CSPDarknet53 作为骨干网,结合 FPN 和 PAN 进行多尺度检测

- YOLOv8:引入 CSPLayer 提升精度,优化不平衡数据集的损失函数

- YOLOv11(最新版本):采用 C3k2 模块和 C2PSA 技术,显著减少参数量同时提升精度

Faster R-CNN

作为两阶段检测器,Faster R-CNN 首先生成区域提议(通过 RPN),再进行分类和边界框精修,与 YOLO 的单阶段方法形成对比。

2. 场地配准技术

将摄像机测量转换为真实世界距离是体育分析的关键挑战。传统方法(如传感器校准、模板匹配)在非标准角度或极端变化下表现不佳。

现代方法遵循标准流程:

- 提取场地特定特征(关键点)

- 建立特征与二维场地模板的对应关系

- 估计单应性矩阵

文献表明 CNN 在该领域表现优异,如 Zhang 等人的级联 CNN 在挑战条件下达到 95.62% 的关键点检测精度。

创新点

创新点一:零标注数据处理流程

本文展示了从完全无标注的原始视频数据中创建二维场地表示的 AI 系统应用,这与大多数需要精心标注数据集的体育分析系统形成鲜明对比。

创新点二:YOLO + SAM2 协同检测架构

- YOLO 仅在第一帧初始化检测器,SAM2 负责后续连续跟踪

- 相比传统 DeepSORT,显著降低计算开销同时提升跟踪一致性

- SAM2 提供像素级精确跟踪,对遮挡和外观变化具有鲁棒性

创新点三:轻量化团队分类

使用基于 K-Means 聚类的无监督方法,仅根据球员球衣颜色特征自动分类,无需开发监督分类器。

创新点四:小样本关键点检测模型

在仅有 146 帧标注数据的情况下,通过预处理增强、水平翻转数据增强和贝叶斯超参数优化,训练出泛化能力强的关键点检测 CNN。

数据集分析

数据来源

- 主要数据集:2024赛季 MSOE 男足球队 10 场主场比赛的综合 footage

- 录制条件:白天、夜间、雨天等多种环境条件

- 录制设备:BePro 高清摄像机,位于 elevated 位置

数据标注

球员边界框(Player Bounding Boxes)

- 使用 SAM2 在 390 个连续帧上生成地面真值标注

- 借助 YOLO 预测加速标注过程

- 将 SAM2 分割掩码反转为边界框用于模型评估

场地关键点(Field Key Points)

- 标注规模:146 帧,包含 4-12 个关键点/帧

- 数据来源:2 场不同比赛(92帧强光条件 + 54帧阴天)

- 关键点选择:罚球弧、中圈、midfield 线交点等高显著性位置

- 策略优势:交点作为稳定视觉锚点,避免线端点减少标注歧义

数据划分

- 训练集/测试集比例:80/20

- 数据增强:水平翻转 + 坐标调整

算法结构

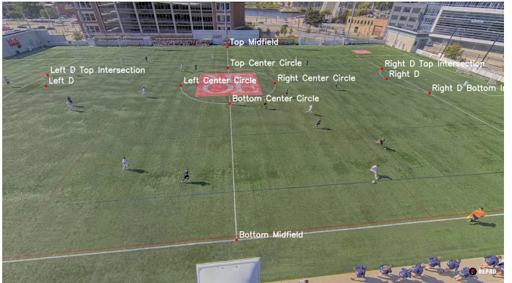

整体工作流程

系统由四个核心模块组成,形成完整的视频分析 pipeline:

原始视频 → 球员检测(YOLO/Faster R-CNN) → SAM2分割跟踪

↓

场地关键点检测(CNN) → 单应性矩阵估计

↓

团队分类(K-Means聚类) → 坐标变换

↓

二维场地可视化 + 战术分析

关键算法详解

1. 球员检测模块

- 输入:视频第一帧

- 输出:球员边界框及中心点

- 模型选择:YOLOv5x(F1-score: 0.8451,Recall: 0.7995)

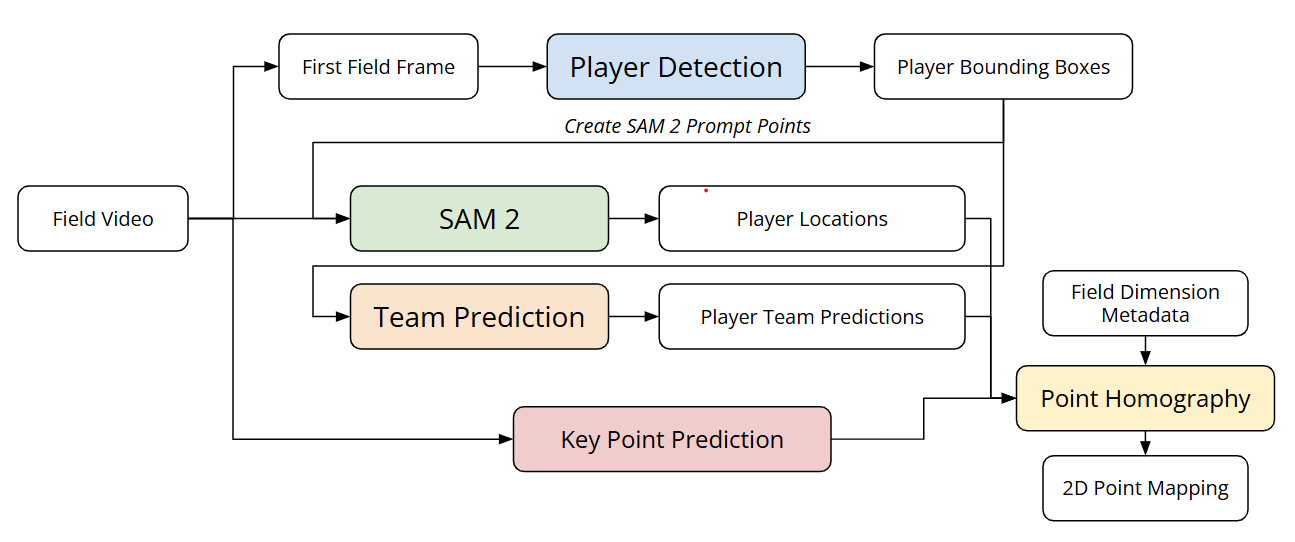

2. 关键点检测 CNN

- 架构:多任务卷积神经网络

- 输出:12 个预定义场地关键点的可见性概率 + 归一化坐标

- 预处理:阈值滤波 + 形态学膨胀 + 白线增强 + resize(710×400) + 归一化

- 损失函数:

- 坐标损失:仅对可见点计算 MAE(权重 10)

- 可见性损失:Binary Cross-Entropy(权重 1)

- 优化器:Adam + 指数衰减学习率 + 贝叶斯超参数搜索

3. 单应性估计

- 算法:Direct Linear Transformation (DLT)

- 输入:图像关键点 ↔ 二维场地模板关键点

- 方法:奇异值分解(SVD)求解线性方程组

- 输出:3×3 单应性矩阵

4. 团队分类

- 特征提取:边界框中心 5×5 像素 patch 的 RGB 平均颜色

- 聚类算法:K-Means(k=2)

- 输出:每名球员分配至对应球队

结果分析

球员检测模型性能对比

| 模型 | Mean IoU | Recall | Precision | F1-Score |

|---|---|---|---|---|

| Faster R-CNN | 0.6837 | 0.6574 | 0.7942 | 0.7194 |

| YOLOv11x | 0.7934 | 0.6805 | 0.9229 | 0.7834 |

| YOLOv8x | 0.7466 | 0.8152 | 0.8765 | 0.8447 |

| YOLOv5x | 0.7644 | 0.7995 | 0.8963 | 0.8451 |

分析结论:

- 所有 YOLO 模型在各项指标上均优于 Faster R-CNN

- YOLOv5x 获得最高 F1-Score(0.8451),体现精确率与召回率的最佳平衡

- YOLOv11x 虽然精确率最高(0.9229),但召回率显著较低(0.6805)

- 使用 YOLOv5x 成功检测到 17/22 名球员(无 fine-tuning)

关键点检测模型性能

| 指标 | 训练集 | 测试集 |

|---|---|---|

| 可见性准确率 | 99.89% | 97.18% |

| MAE(归一化) | 0.0107 | 0.0138 |

| MAE(像素) | 5.96 | 7.65 |

分析结论:

- 模型展现出强泛化能力,训练/测试性能差距小

- 约 7.65 像素的平均定位误差可满足战术分析需求

端到端系统性能

| 指标 | 数值 |

|---|---|

| 地面真值关键点 MAE | 0.225 米 |

| 预测关键点 MAE | 0.26 米 |

| 单应性投影平均误差 | 0.499 米 |

图表详细分析

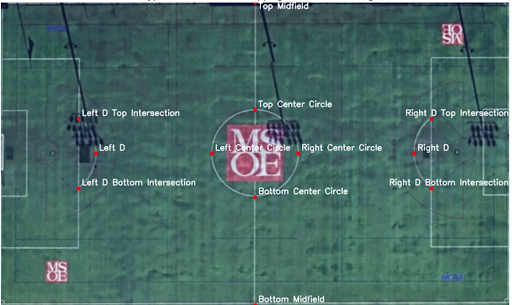

图1:关键点标注示意

左图展示了足球场地的二维模板及预定义的 12 个关键点位置,这些点均匀分布在场地各个区域,包括:

- 中圈与中线的交点

- 两侧罚球区边界

- 球门区角点

- 角球区标记点

右图展示了实际比赛 footage 中的标注示例,关键点用彩色圆点标记,不同颜色对应不同的场地区域。这种标注方式确保了关键点在各种摄像机角度下都能被准确识别。

图2:系统整体工作流程

该图清晰展示了系统的完整 pipeline:

- 黄色模块:YOLO 目标检测器

- 绿色模块:SAM2 分割与跟踪

- 蓝色模块:关键点检测 CNN

- 红色模块:单应性变换

- 白色模块:数据状态(视频帧、检测结果、分割掩码、变换坐标)

各模块协同工作,从原始视频帧逐步提取球员位置信息并转换为二维场地坐标。

图3:关键点预测模型工作流程

该图详细展示了关键点检测 CNN 的处理流程:

阶段一(左侧):

- 输入原始比赛帧

- 应用阈值滤波增强场地白线

- 形态学膨胀处理

- 生成增强图像

阶段二(右侧):

- 增强图像输入 CNN

- 输出预测关键点位置

- 可视化关键点预测结果

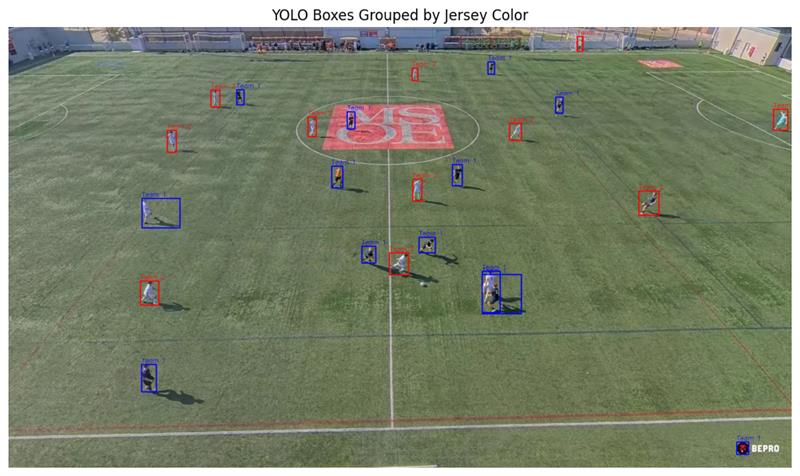

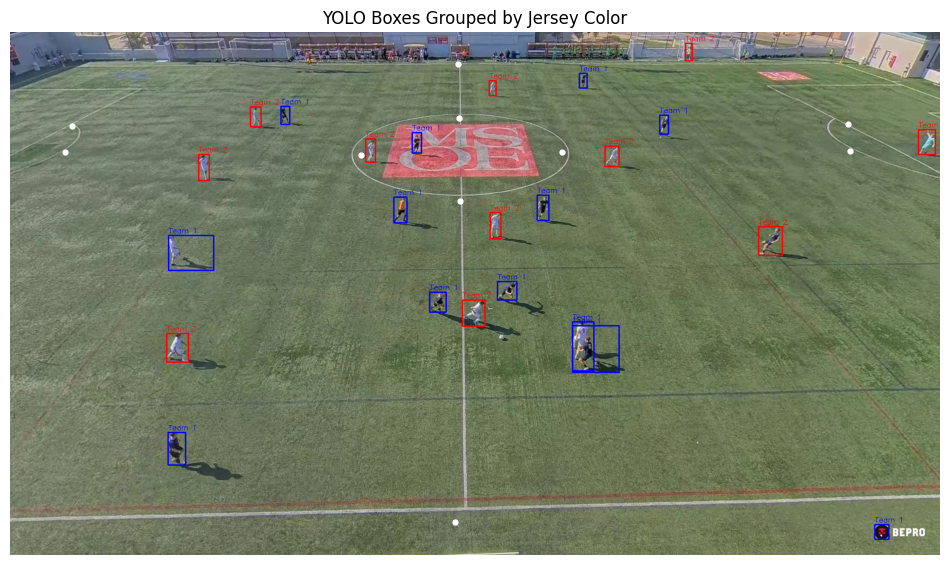

图4:团队分类结果

该图展示了基于 K-Means 聚类的团队分类效果:

- 不同颜色代表不同球队

- 边界框中心区域的像素颜色被提取为特征

- 两支球队被清晰分开(红色 vs 蓝色)

该方法的有效性在于足球比赛中两队通常穿着对比色球衣,便于颜色聚类区分。

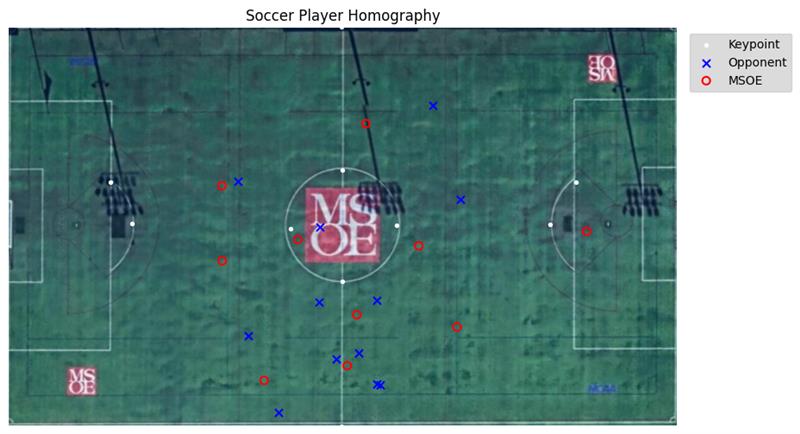

图5:完整系统输出示例

左图展示了检测模块的原始输出:

- YOLO 检测到的球员边界框(绿色)

- CNN 预测的场地关键点(彩色圆点)

- 同时检测到球童、裁判等非球员目标

右图展示了应用单应性变换后的二维场地表示:

- 球员被精确定位到俯视图位置

- 不同颜色区分两支球队

- 可用于计算跑动距离、位置分布等战术统计

局限性分析

- 误检问题:系统将球童、裁判误识别为球员

- 团队分类错误:强光或阴影影响下,颜色特征可能失真导致误分类

- 关键点检测不完美:影响二维坐标的准确性

- 数据泛化局限:模型仅基于 MSOE 主场比赛数据训练,对其他场地泛化能力待验证

未来工作方向

- 球员重识别:处理球员进出画面时的身份维护

- 跨场地泛化:扩充数据集,涵盖不同摄像机角度和场地背景

- 球检测:增加足球检测模块,分析比赛实际进程

结论

本文成功构建了一套从足球比赛原始视频中自动提取二维场地球员表示的计算机视觉系统。通过整合预训练模型(YOLO、SAM2)与自定义训练的关键点检测 CNN,结合单应性变换技术,系统实现了无需任何人工标注即可分析比赛的目的。尽管存在团队分类和关键点检测精度方面的改进空间,但该系统已展现出为资源有限的足球协会提供可扩展体育分析解决方案的潜力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)