AI写代码越快,能力掉得越快?给从业者的5个警告

AI写代码越快,能力掉得越快?给从业者的5个警告

你以为自己在“提效”,实际可能在透支未来的工程判断力。基于 Anthropic 随机对照实验和多项后续研究,这篇文章给所有 AI 编程从业者一个不太舒服、但很重要的提醒。

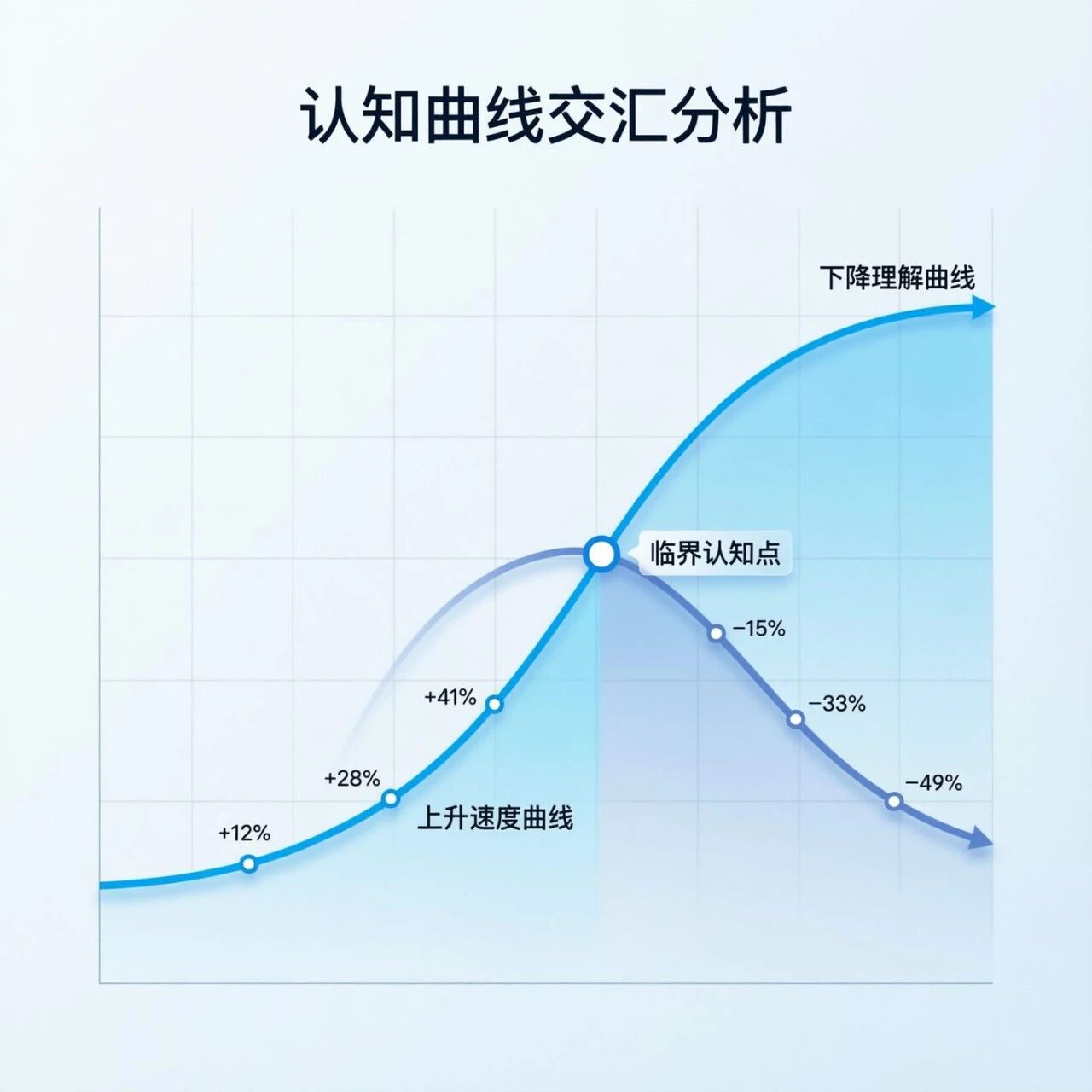

开篇引入:真正要警惕的,不是AI写得慢,而是你学得慢

过去一年,很多团队把“AI写代码速度”当作第一指标。但如果把时间维度拉长,你会发现一个更危险的问题:

- 交付速度可能提升了

- 代码理解深度却在下降

- 一旦离开AI,定位问题和重构能力明显变弱

Anthropic 在 2026 年 1 月发布的研究,第一次把这个矛盾用对照实验讲清楚:当任务是“学习新技术”而不是“执行熟练任务”时,AI 可能让你更快完成,却更难真正掌握。

对编程职业来说,短期效率不是终局,长期可迁移能力才是护城河。

警告一:速度优势没你想的那么大

在这项随机对照实验里,52 名程序员学习自己都不熟悉的 Trio(Python 异步库):

- 对照组:手动编码 + 搜索

- 实验组:AI助手 + 搜索

结果很反直觉:AI 组平均只快了约 2 分钟,而且没有统计学显著性。

这意味着什么?

- 你在新领域用 AI 的“速度红利”,可能并不稳定

- 提示词构思、反复追问、筛选答案,会吃掉大量时间

- 看似更快,很多时候只是把时间从“写代码”转移到了“问AI”

论文中甚至记录到,有参与者仅构思查询就花了 11 分钟,占总时限 35 分钟的约 30%,最多发起 15 轮查询。

警告二:真正的代价是理解力下滑,而不是几分钟快慢

真正刺眼的数据是测验成绩。实验后的 27 分测验中:

- AI 组平均分:50%

- 手动组平均分:67%

- 差距显著:Cohen’s d = 0.738, p = 0.01

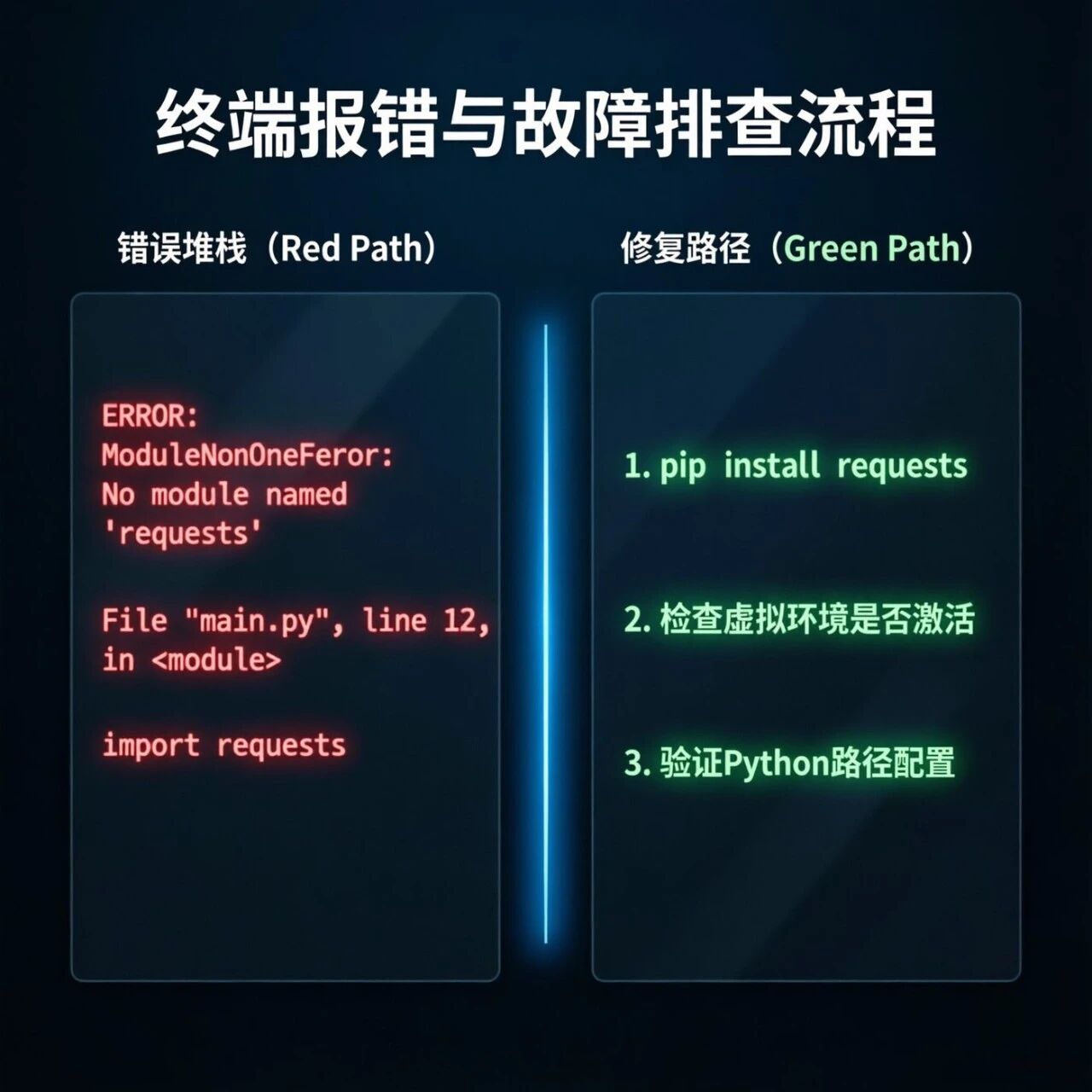

这个差距接近两个字母等级,不是小波动。并且最大差距出现在调试题,说明被削弱最明显的是:

- 识别代码何时出错

- 理解错误为什么发生

- 在陌生上下文里修复问题

如果你是工程师,这三件事恰恰就是“不可外包的核心竞争力”。

AI 可以替你写第一版,但线上事故、边界条件和架构债,最终都要你自己扛。

警告三:不是“用不用AI”的问题,而是“怎么用AI”的问题

Anthropic 对屏幕录制做了手工标注,识别出 6 种使用模式,结果非常两极化:

| 模式 | 平均分 | 典型行为 |

|---|---|---|

| AI Delegation(全托管) | 约24% | 完全让AI写,自己复制粘贴 |

| Progressive AI Reliance(渐进依赖) | 约24% | 先问少量问题,后期全面交给AI |

| Iterative AI Debugging(迭代调试) | 约39% | 频繁让AI调试验证,自己推理不足 |

| Mixed Code Explanation(混合解释型) | 65%-86% | 让AI给代码同时解释,主动理解 |

| Conceptual Queries(概念提问) | 65%+ | 只问概念,代码仍然自己写 |

| Follow-up Questions(追问型) | 65%+ | 生成后持续追问“为什么这样实现” |

结论很明确:低分组的共同点是认知卸载,高分组的共同点是认知参与。

这也给团队管理一个关键启发:

- 不能只统计“AI使用率”

- 要统计“解释请求率、追问率、独立调试率”等学习型指标

警告四:这不是单点现象,跨研究都在指向同一风险

除了 Anthropic,这个风险在其他研究里也反复出现。

- 微软与卡内基梅隆(319 名知识工作者)发现:对 AI 越有信心,投入的批判性思维越少,认知努力从“产出内容”转向“校验与整合”。

- 2026 年系统性综述指出:LLM 助手确实常带来效率收益,但也伴随认知卸载、协作弱化,以及质量结论不一致的问题。

- 你给出的教育研究汇总同样显示:初级学习者更容易出现“复制答案但未形成心智模型”的情况。

把这些放在一起看,一个共识正在形成:

AI 的主要风险并不是“会不会写代码”,而是“会不会让人停止构建能力”。

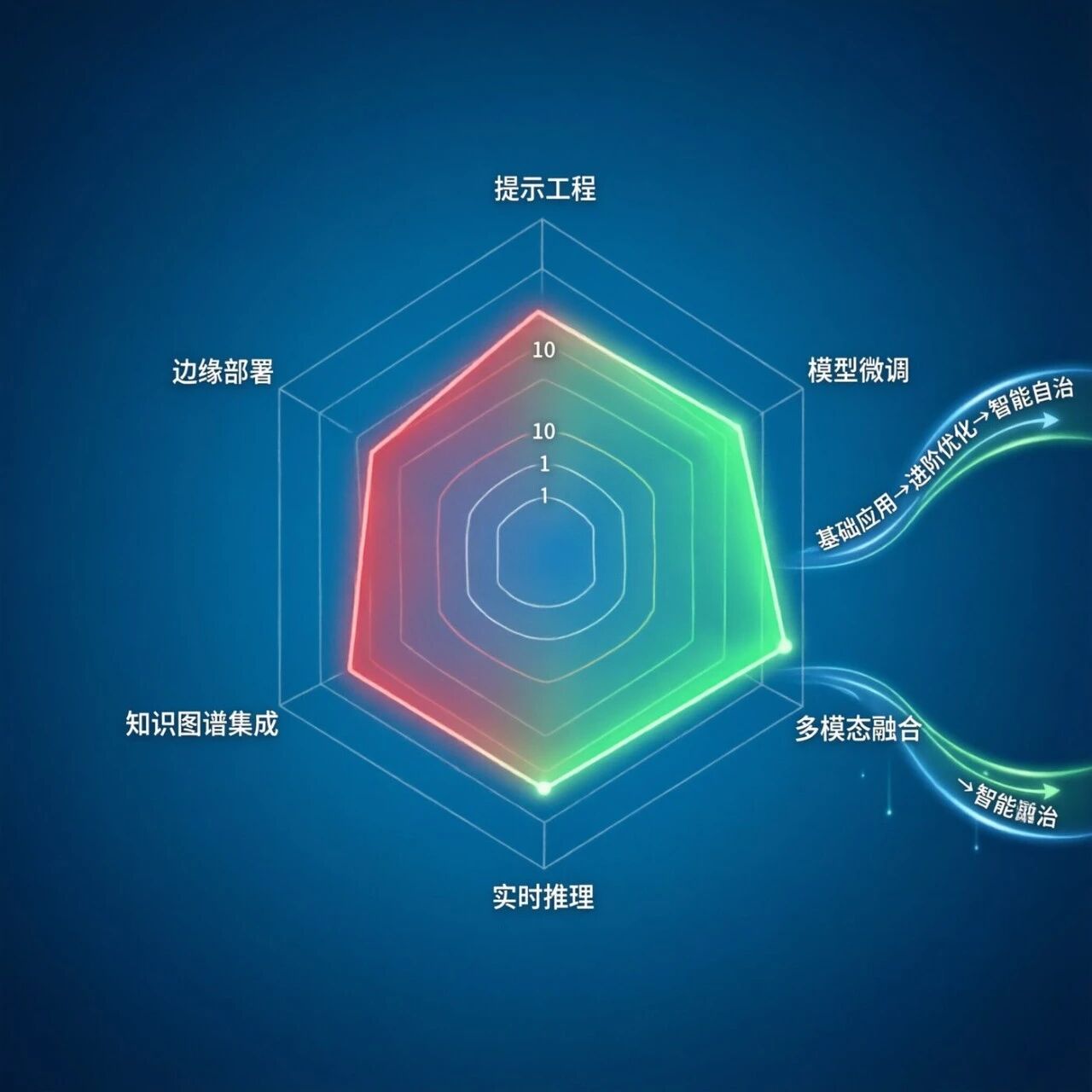

给AI编程从业者的5条硬性建议

如果你希望 3 年后仍有工程竞争力,建议把下面 5 条当作工作协议,而不是鸡汤。

- 每次让 AI 生成代码后,必须写出一句“为什么这样实现”的解释,再允许提交。

- 新技术学习期执行“先手写后AI”规则:先独立写 20 分钟,再允许调用助手。

- 调试阶段先做 1 轮人工定位,再让 AI 参与,避免把排错能力外包。

- 每周固定一段“无AI编码窗口”(例如 2 小时),维持基础语法与问题分解肌肉。

- 评估个人成长时,除了交付速度,再看独立修复率、代码阅读速度和架构解释能力。

这些动作看起来“慢”,但它们会决定你能否从“提示词操作员”升级为“系统级工程师”。

写在最后

AI 编程不是洪水猛兽,但它确实会放大人的工作习惯。

如果你的习惯是思考,它会成为放大器;如果你的习惯是跳过思考,它也会成为放大器。真正的分水岭,从来不在模型,而在你是否把“理解”这件事牢牢握在自己手里。

你可以把这篇文章转给团队里最依赖 AI 的同事,并约定一个小实验:连续两周,严格执行“生成后必须解释”的规则,再看代码质量和调试速度会不会反而提升。

参考来源(可核验)

- Anthropic Research (2026-01-29): How AI assistance impacts the formation of coding skills

https://www.anthropic.com/research/AI-assistance-coding-skills - Shen, Tamkin et al. (2026): How AI Impacts Skill Formation (arXiv:2601.20245)

https://arxiv.org/abs/2601.20245 - Microsoft Research / CMU (2025): The Impact of Generative AI on Critical Thinking

https://www.microsoft.com/en-us/research/publication/the-impact-of-generative-ai-on-critical-thinking-self-reported-reductions-in-cognitive-effort-and-confidence-effects-from-a-survey-of-knowledge-workers/ - Mohamed, Assi, Guizani (v2, 2026-03-23): The Impact of LLM-Assistants on Software Developer Productivity (arXiv:2507.03156)

https://arxiv.org/abs/2507.03156

说明:文中“编程教育场景中的细分百分比”来自你提供的研究汇总材料。若用于正式对外发布,建议再补充具体论文题目与链接。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)